교호 인터페이스 설명 가능성이 AI 생성 로고 사용자 수용도에 미치는 영향 연구

Copyright ⓒ 2026 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

인공지능은 브랜드 디자인 분야의 시각 창작 방식을 변화시키고 있으며, AI 생성 로고는 브랜드 아이덴티티 구축을 위한 효율적 도구로 부상하고 있다. 그러나 사용자들의 신뢰도, 미학적 평가, 사용 의도에 대한 인식은 여전히 상이하다. 본 연구는 설명가능성이 AI 생성 로고의 사용자 수용에 미치는 영향을 분석하기 위해, 설명가능성 수준이 서로 다른 세 가지 인터페이스를 설계하고 설문 기반 실험을 수행하였다. 분석 결과, 설명가능성은 신뢰도, 미학적 평가, 사용 의도에 모두 유의한 영향을 미쳤으며, 중간 수준의 설명가능성이 가장 높은 미학적·행동적 성과를 나타냈다. 또한 연령, AI 사용 경험, 사용 빈도는 신뢰도에 유의미한 영향을 미치는 요인으로 확인되었다. 본 연구는 AI 기반 브랜드 디자인에서 사용자 수용 메커니즘에 대한 실증적 근거를 제시하고, 인간–AI 협업 인터페이스 설계를 위한 실무적 시사점을 제공한다.

Abstract

Artificial intelligence (AI) is transforming visual creation in brand design, with AI-generated logos emerging as an efficient tool for brand identity building. However, user perceptions of trust, aesthetics, and usage intention remain varied. This study examines the effects of interface explainability on user acceptance of AI-generated logos through a questionnaire-based experiment involving three interfaces with different levels of explainability. The results indicate that explainability significantly influences trust, aesthetic evaluation, and usage intention, moderate level of what yielding the highest aesthetic and behavioral outcomes. User characteristics, including age, AI experience, and usage frequency, also significantly affect trust. The findings suggest that interface explainability and user attributes jointly shape perceptions of AI systems. This study offers empirical evidence for user acceptance in AI-based brand design and provides practical implications for human–AI collaborative interface design.

Keywords:

AI-Generated Logos, Interactive Interface, Explainability Design, User Acceptance, Brand Design키워드:

AI 생성 로고, 교호 인터페이스, 설명가능성 디자인, 사용자 수용도, 브랜드 디자인Ⅰ. 서 론

1-1 연구 배경

최근 인공지능(Artificial Intelligence, AI) 기술의 급격한 발전은 디자인 산업의 지능화 전환을 가속화하고 있다[1]. 특히 브랜드 디자인과 시각 디자인 분야에서 AI 생성 콘텐츠(AIGC, Artificial Intelligence Generated Content) 기술의 도입은 디자인 프로세스 전반에 깊은 변화를 촉발하였다[2]-[4]. AI 생성 로고 시스템은 알고리즘 기반의 고속 연산과 다양성 있는 출력 능력을 바탕으로 단시간 내에 대량의 창의적 아이디어를 제공할 수 있어, 기업 이미지 구축 및 브랜드 아이덴티티 디자인에서 고효율성, 지능화, 개인화라는 장점을 발휘한다[5]. 전통적인 수작업 중심의 디자인 프로세스와 비교할 때, AI 생성 방식은 산출 속도를 향상시킬 뿐 아니라 디자이너 개개인의 한계를 넘어 알고리즘 기반의 다양성과 참신성을 제시한다.

그러나 AI의 브랜드 디자인 분야 확산은 다양한 논의를 불러일으키고 있다. 로고는 단순한 시각 요소를 넘어 기업의 가치관, 문화적 함의, 정서적 공명을 담지하는 중요한 상징체계이다[6]. AI 생성 로고가 기술적으로 높은 창조 잠재력을 보임에도 불구하고, 사용자 측면에서의 수용도는 뚜렷한 차이를 보인다. 일부 사용자는 AI를 혁신적 보조 도구로 인식하며 디자인 효율성과 창의적 영감의 향상을 기대하는 반면[7], 다른 사용자들은 AI 디자인의 신뢰성, 심미성 및 독창성에 대해 회의적인 시각을 갖고 있으며, 출력 결과가 인간 디자이너의 미적 판단과 문화적 감수성을 결여할 수 있다는 우려를 제기한다[8]. 이처럼 AI의 브랜드 디자인 활용은 단순한 기술 문제에 그치지 않고, 신뢰·심미적 평가·정서적 공명 등 다차원적 요인에 의해 좌우된다.

AI 디자인 도구의 인간-기계 상호작용 과정에서, 교호 인터페이스의 설명가능성(Explainability)은 사용자 신뢰와 사용 의도에 영향을 미치는 핵심 요소로 부상하고 있다[9],[10]. 설명가능성은 사용자가 AI의 디자인 논리를 이해할 수 있는지 여부와 직결되며, 나아가 생성 결과에 대한 인지적 품질 평가와 심리적 수용성에 직접적인 영향을 미친다. 기존의 '블랙박스(black-box)' 방식의 AI 출력은 사용자가 시스템의 창작 근거를 파악하기 어렵게 만들어 불확실성과 불신을 야기한다. 반면 설명 기능을 갖춘 교호 인터페이스는 디자인 아이디어, 핵심 키워드의 연관성, 생성 근거 등을 제시함으로써 시스템의 투명성과 통제 가능성을 제고하고, 사용자가 AI의 설계 논리를 이해함과 동시에 신뢰감과 참여감을 향상시킨다[11]. 그러나 브랜드 로고 디자인과 같이 심미성과 정서적 요소가 복합적으로 작용하는 맥락에서, 인터페이스 설명가능성이 사용자 수용도에 어떤 방식으로 영향을 미치는지에 대한 학술적 논의는 여전히 부족하다.

사용자 경험(User Experience, UX) 연구의 진전과 함께, AI 디자인 도구의 가치는 기술적 능력뿐 아니라 사용자가 이를 어떻게 이해하고 수용하며 활용하는지의 과정에서도 평가되어야 한다. 기존 AI 생성 로고 도구는 알고리즘 성능과 결과 제시에 중점을 두는 경향이 있으며, 사용자 경험 관점에서의 교호 설명가능성은 상대적으로 간과되어 왔다. 대부분의 시스템은 결과만 제시할 뿐, 디자인 논리에 대한 충분한 설명을 제공하지 않아 사용자가 AI 설계의 타당성을 이해하기 어렵게 만든다. 이러한 ‘블랙박스식’ 생성 방식은 사용자 신뢰도를 약화시키고, AI 결과를 전문적 설계가 아닌 임의적 조합으로 인식하게 하여 사용 의도 감소로 이어진다. 반면 적절한 수준의 설명가능성 제공은 사용자가 디자인 논리의 흐름을 이해하는 과정에서 심미적 공감과 정서적 연결을 강화하며, 공창의 경험을 부여할 수 있다.

종합하면, AI가 본격적으로 브랜드 디자인 영역에 진입하고 있는 현 시점에서 교호 인터페이스 설명가능성을 통해 사용자의 AI 생성 로고에 대한 신뢰도, 심미적 평가, 사용 의도를 어떻게 향상시킬 것인가라는 질문은 중요한 연구 과제가 되고 있다. 본 연구는 사용자 수용도 관점에서 AI 생성 로고에 대한 신뢰, 미학적 평가, 사용 의도에 교호 인터페이스 설명가능성이 미치는 영향을 탐구하고자 하며, 이는 AI 디자인 연구에서 필수적으로 다뤄야 할 문제이다. 본 연구는 인간-기계 협업 창작 과정에서의 심리적 메커니즘을 밝히는 데 기여함은 물론, AI 교호 인터페이스 디자인 및 사용자 수용도 연구의 공백을 메우고, 나아가 AI 기반 브랜드 디자인 도구의 최적화를 위한 실천적 시사점을 제공하는 것을 목표로 한다.

1-2 연구 목적 및 방법

본 연구는 브랜드 디자인 분야에서 AIGC의 급속한 확산이라는 시대적 배경을 바탕으로, AI 생성 로고의 사용자 측면에서 나타나는 신뢰, 심미적 평가, 사용 의도 등의 문제에 주목하고 이를 교호 인터페이스 디자인 관점에서 체계적으로 탐구하고자 한다. 연구는 교호 인터페이스의 설명가능성을 핵심 변수로 설정하고, 설명가능성이 사용자의 AI 생성 논리 이해, 신뢰 형성, 심미적 판단 및 궁극적으로 사용 의도에 미치는 영향 메커니즘을 분석함으로써, AI 디자인 시스템 내 인간-기계 상호작용의 지각 규칙과 수용 경로를 규명하는 데 목적이 있다. 이를 위해 신뢰감, 심미적 평가, 사용 의도라는 세 차원을 포괄하는 사용자 수용도 모델을 구축하여, 사용자가 AI 로고 생성 도구를 활용하는 과정에서 경험하는 심리적 변화와 행동적 반응을 체계적으로 정리한다. 또한 본 연구는 설문 기반 평가 방법을 적용하여, 서로 다른 설명가능성 수준(무설명, 부분 설명, 전체 설명)을 갖춘 세 가지 교호 인터페이스를 설계하였으며, 인터페이스 정보 투명성이 사용자 지각 및 행동에 미치는 영향 경로를 실증적으로 검증함으로써 AI 기반 브랜드 디자인 도구의 설계와 이론적 발전에 기여하고자 한다.

위와 같은 연구 목적을 중심으로, 본 연구는 다음의 핵심 연구 질문을 제기한다.

RQ1: 사용자가 AI 생성 로고 시스템을 활용할 때, 교호 인터페이스 설명가능성은 디자인 결과에 대한 신뢰와 이해에 어떠한 영향을 미치는가?

RQ2: 상이한 설명가능성 수준은 사용자의 심미적 평가 및 사용 의도에 유의한 차이를 초래하는가?

RQ3: 다양한 사용자 집단인 연령, 전공 배경, AI 사용 경험 및 사용 빈도는 설명가능성 인터페이스 하에서의 신뢰도, 심미적 평가, 사용 의도에서 유의한 차이를 보이는가?

이러한 연구 질문을 탐색함으로써, 본 연구는 AI 생성 로고에 대한 사용자 수용도를 향상시키는 효과적인 교호 인터페이스 디자인 전략을 도출하고, 관련 분야의 학술 연구에 이론적 근거를 제공하는 것을 목표로 한다.

Ⅱ. 이론적 배경

2-1 브랜드 디자인 분야에서의 AI 생성 디자인 적용

인공지능 기반 생성 콘텐츠의 부상은 디자인 영역의 창작 방식에 근본적인 변화를 일으키고 있다. AI는 딥러닝과 생성 모델인 예 GAN, Diffusion Models 등 기술을 활용하여 의미적 입력을 자동으로 인식하고, 디자인 특징을 추출하며, 고품질의 시각 이미지를 생성함으로써 브랜드 시각 정체성, 광고, 패키지 디자인 등 다양한 분야에 효율적이고 창의적인 지원을 제공한다. 이러한 인공 창작에서 지능 기반 공창으로의 전환은 디자인 생산 방식을 인간 중심의 경험 기반 설계에서 데이터 기반 생성 디자인인(Generative Design)으로 변화시키고 있다[12].

브랜드 디자인 영역에서 AIGC 기술의 도입은 시각 정체성 시스템(Visual Identity System, VIS)에 새로운 창작 논리를 부여하고 있다. 특히 AI 생성 로고 시스템의 활용은 매우 대표적이다. AI는 키워드, 형태적 의미 또는 시각적 은유에 기반하여 다양한 디자인안을 자동으로 생성할 수 있어, 디자인 효율성과 혁신 잠재력을 크게 향상시킨다. AI 기반 시각 생성 시스템은 브랜드 디자인에서 창의적 영감과 인지 확장을 제공하며[13], AIGC 도구는 로고 생성 과정에서 의미 기반의 그래픽 변환을 가능하게 하여 브랜드 이념의 상징적 표현을 더욱 유연하고 혁신적으로 만든다[14]. 또한 AI 생성 로고의 ‘다중안 병렬 출력’ 특성은 디자인 의사결정에 새로운 선택 메커니즘을 제시하여, 디자이너와 클라이언트가 짧은 시간 안에 아이디어 선별과 심미적 적합성 평가를 수행할 수 있게 한다[15]. 사용자는 AI 생성 로고를 평가할 때 단순한 시각적 미감뿐 아니라 브랜드의 감성 및 가치 제안도 고려하게 된다[16]. 이러한 방식은 전통적 디자인에서 인간 중심의 경험 생성 방식이 갖는 한계를 뛰어넘어, 디자인 활동이 데이터 중심 및 의미 연산 기반의 지능적 특성을 띠도록 한다.

AI가 점차 브랜드 창의 작업의 핵심 단계에 적용되면서, 사용자와 디자이너는 AI 생성 결과의 ‘통제 가능성’과 ‘이해 가능성’에 대한 요구를 더욱 강하게 제기하게 되었다. 사용자가 AI 생성물의 형성 논리를 이해하지 못할 경우 인지적 불확실성이 증가하며, 이는 AI 창작 결과에 대한 신뢰 및 수용도를 저하시킬 수 있다[17]. 따라서 AI 생성 디자인이 브랜드 디자인 분야에서 발전하기 위해서는 알고리즘 향상만으로는 충분하지 않으며, ‘인간-기계 상호작용 단계’에서의 설명 투명성과 경험적 타당성에 대한 고려가 반드시 필요하다. 설명 가능성 인터페이스 디자인(Explainable Interface Design)은 AI 시각 시스템에서 핵심 연구 분야로 부상하고 있으며, 사용자가 AI의 창작 논리를 이해하는 데 중요한 지각적 기반을 제공한다[18].

2-2 설명가능성 인공지능(XAI)

설명가능성은 원래 인공지능 의사결정 시스템 연구에서 비롯된 개념으로, 시스템이 내부 논리, 특성 가중치, 의사결정 과정을 인간이 이해할 수 있는 방식으로 제시하는 능력을 의미한다[19]. 설명가능한 인공지능은 이러한 설명 가능성을 중심으로 발전한 핵심 연구 분야로, 기계학습 모델의 해석성과 접근성을 향상시켜 보다 광범위한 사용자층이 AI 시스템을 이해할 수 있도록 하는 데 초점을 둔다. XAI의 주된 목적은 AI 시스템의 의사결정 과정을 명확하게 설명함으로써 투명성을 제고하고 신뢰를 구축하는데 있다. XAI는 사용자와 실무자가 AI 출력 뒤에 존재하는 논리를 이해하고 신뢰할 수 있도록 하는 보다 투명한 AI 실천 방식을 지향한다. XAI 연구의 핵심은 시각화, 특성 기여도 분석, 의사결정 근거 제시 등의 방법을 통해 사용자가 AI 판단의 근거를 이해하도록 돕고, 이를 통해 모델의 신뢰성과 상호작용 경험을 향상시키는 데 있다. 전통적인 ‘블랙박스(black-box)’ 방식의 AI에 비해, XAI는 모델과 사용자 간의 인지적 소통을 더욱 중시하며, 시스템이 단순히 결정을 내리는 것을 넘어 그 결정을 설명할 수 있는 능력을 갖추도록 한다.

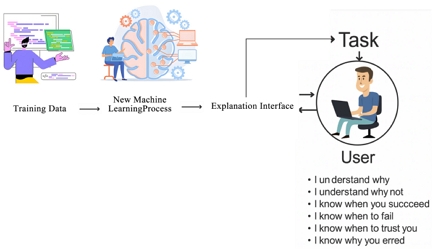

그림 1에서 제시된 바와 같이, XAI의 일반적 프로세스는 네 가지 핵심 단계—훈련 데이터, 기계학습 과정, 설명 모델 및 인터페이스, 사용자 과제—로 구성된다. 이러한 과정을 통해 사용자는 시스템이 특정 결과를 왜 도출했는지, 왜 다른 대안을 선택하지 않았는지, 언제 성공하거나 실패하는지를 이해할 수 있으며, 나아가 언제 시스템을 신뢰할지 판단하고 오류의 원인을 식별할 수 있다.

2-3 설명가능성 교호 인터페이스 디자인과 사용자 수용도

AI가 디자인 분야에 적용됨에 따라 설명가능성은 점차 인터페이스 차원으로 확장되며 새로운 연구 방향인 인터페이스 설명가능성으로 발전하고 있다[20]. 설명가능한 사용자 인터페이스(Explainable User Interfaces, XUIs)의 발전은 XAI 분야에서 핵심적인 관심 영역으로 부상하고 있으며, 이는 사용자로 하여금 기반이 되는 계산 과정을 이해할 수 있도록 보장하기 위한 요구를 충족시키는 데 목적이 있다. 인터랙션 디자인에서 인터페이스 설명가능성은 알고리즘의 이해 가능성뿐 아니라 정보 제시 방식, 시각적 피드백 메커니즘, 그리고 사용자가 AI 생성 논리를 인지하는 경험 전반을 포괄한다. 시각 생성 도구의 맥락에서 인터페이스는 AI의 생성 논리를 시각화 방식으로 제시하여 사용자가 AI가 왜 이러한 결과를 생성하는지를 이해할 수 있도록 해야 한다. 이러한 인터페이스 투명성은 사용자 불확실성과 신뢰 위기를 완화하는 데 기여한다[21]. 설명 영역의 존재는 사용자의 이해 능력을 유의미하게 향상시키고 사용자 만족도를 높이며 인간-컴퓨터 상호작용 연구에 긍정적으로 기여한다[22]. 더 나아가 XUIs의 디자인 유형은 다차원적 관점에서 분류될 수 있다[23].

우선, 설명적 모드와 탐색적 모드로 구분된다. 설명적 XUIs는 시각적 또는 텍스트 기반 출력을 통해 구체적이고 집중적인 설명을 제공한다. 이들은 모델 기능을 구성하는 다양한 요소를 명확하게 드러내어 특정 측면에 대한 직관적 통찰을 제시하는 것을 목표로 한다. 이러한 방식은 사용자가 모델과 깊이 있게 상호작용하지 않더라도 직접적이고 정밀한 설명을 필요로 할 때 특히 유용하다. 반면, 탐색적 XUIs는 보다 동적이고 상호작용적인 사용자 경험을 제공하며, 사용자가 모델의 행동을 자율적으로 탐색·조작할 수 있도록 한다. 사용자가 입력값을 변경하여 다양한 결과를 관찰할 수 있기 때문에 모델의 구조와 논리를 체험적으로 이해하는 데 특히 효과적이다. 이러한 방식은 이해의 깊이를 확장시킬 뿐 아니라, 입력 변화가 예측 결과에 미치는 영향을 투명하게 보여줌으로써 AI에 대한 신뢰도를 높이는 데 기여한다[24].

또한 정적 설명과 상호작용적 설명의 구분도 존재한다. 정적 설명은 사용자 상호작용에 따라 변하지 않는 고정된 정보를 제공하여 일관성을 유지하지만, 설명 범위가 제한적이라는 단점이 있다. 반면 상호작용적 설명은 사용자 질의나 행동에 따라 설명 내용을 동적으로 조정함으로써 보다 깊이 있는 모델 탐색을 가능하게 한다. 이러한 동적 설명 방식은 유연하고 풍부한 이해를 지원하며, 사용자가 필요로 하는 정보에 집중할 수 있게 해줌으로써 보다 사용자 중심적인 설명 경험을 제공한다[25].

사용자 수용도 관점에서 보면, 사용자는 심리적으로 AI 생성 결과를 충분히 수용하지 못하는 경우가 많다. 한편으로는 AI 생성 로고의 높은 자동화 수준이 결과의 독창성과 미학적 가치에 대한 의구심을 불러일으키며[26], 다른 한편으로는 AI 시스템 내부의 ‘블랙박스’ 특성이 사용자 이해를 제한하여 신뢰감과 사용 의도를 저하시킨다[27]. 따라서 AI 디자인 도구의 설명가능성과 교호 투명성은 사용자 채택과 신뢰에 직접적인 영향을 미치는 핵심 요인이다[28]. AI 시스템의 ‘비설명가능성’은 의사결정 합리성에 대한 사용자의 인지적 평가를 약화시키며, 이는 기술 수용 의도를 낮추는 주요 장애가 된다. 다양한 XAI 연구는 적용 분야별 설명 요구와 한계를 논의하며, 특히 ‘인간 중심적 설명’이 AI 시스템의 신뢰성을 강화하는 데 필수적임을 강조한다[29]. 적절히 설계된 설명 인터페이스는 인간 기계 협업에서의 신뢰 수준을 크게 높인다. 특히 시각 디자인 작업에서는 '결과의 논리 구조'와 '생성 과정'의 시각화가 인터페이스 최적화의 핵심 과제로 부상한다. 아울러 사용자 배경과 개인적 차이는 설명가능성이 작동하는 데 있어 중요한 조절 변수이다[30]. 사용자 특성(예: 연령, 경험, 성격적 개방성)은 XAI 인터페이스의 이해 및 신뢰에 유의미한 영향을 미친다[31]. AI 도구를 활용한 로고 생성과 전통적 수작업 설계를 비교한 연구에서는 비전공 사용자들이 시각적 직관성과 효율을 중시하는 반면, 전문 디자이너들은 브랜드 의미, 디자인 방향성, 상징적 기능에 더 집중하는 경향이 나타났다[32]. 한편 생성형 AI가 창의 디자인 분야에서 빠르게 확산되고 있음에도 불구하고, 설명가능성 부족은 여전히 사용자 신뢰와 채택을 저해하는 핵심 장애요인으로 지적된다[33]. 따라서 AI 생성 로고 시스템의 인터페이스 최적화에서는 사용자 다양성을 고려한 차별화된 설명 전략이 필요하다. 사용자 차이와 맥락적 요인은 설명가능성 디자인에서 반드시 고려해야 하는 요소이다.

종합하면, 기존 연구는 AI 생성 디자인에 대한 사용자 수용 메커니즘을 이해하는 데 유용한 시사점을 제공했지만 다음과 같은 한계가 존재한다. 첫째, 기존 연구의 대부분은 AI 설명가능성의 일반적 적용에 집중하고 있으며, 브랜드 및 로고 디자인처럼 심미성과 상징성이 매우 중요한 전문 영역에서는 실증 연구가 부족하다. 둘째, 기존 연구는 기술적 관점 또는 디자인 프로세스 중심의 접근이 주를 이루어, 교호 인터페이스 디자인과 사용자 경험이 결합된 시각에서 설명가능성이 사용자 신뢰·심미적 평가·사용 의도에 미치는 영향을 체계적으로 분석한 사례는 매우 제한적이다. 따라서 본 연구는 교호 인터페이스 설명가능성과 사용자 수용도 간의 관계를 심층적으로 검토하고, 사용자가 AI 생성 로고를 수용하는 심리적·행동적 특성을 규명함으로써 AI 기반 브랜드 디자인 도구의 인터페이스 최적화를 위한 실질적 전략을 제시하고자 한다.

Ⅲ. 연구설계

본 연구는 교호 인터페이스의 설명가능성이 사용자의 AI 생성 로고에 대한 신뢰도, 미학적 평가, 그리고 사용 의도에 어떠한 영향을 미치는지를 탐색하는 것을 목적으로 하며, 이를 위해 설문조사 방법을 적용하고자 한다. 본 연구에서 조작하는 ‘인터페이스 설명가능성’은 단순히 설명 텍스트 정보의 양을 의미하는 것이 아니라, 인터페이스가 제공하는 사용자 개입 수준(교호 개방성), 즉 생성 파라미터에 대한 사용자의 조정 가능성까지 포괄하는 개념으로 정의된다. 첫 번째 단계에서는 설명가능성 수준에 따른 사용자 인터페이스 디자인을 개발하였으며, 초기 프로토타입은 저 설명가능성 인터페이스, 중 설명가능성 인터페이스, 고 설명가능성 인터페이스의 세 가지 유형으로 구성되었다. 두 번째 단계에서는 개발된 인터페이스를 기반으로 사용자 설문 평가를 실시하였다. 연구의 과학성과 실증적 타당성을 확보하기 위해, 본 장에서는 연구 참여자 구성, 프로토타입 설계, 설문 구성, 그리고 데이터 분석 절차의 세 가지 측면에서 연구의 구체적 실행 과정을 상세히 기술한다.

3-1 연구 참여자

본 연구는 총 100명의 참여자를 모집하여 설문 평가를 실시하였다. 표 1에 제시된 바와 같이, 참여자 구성은 디자인 전공 배경 사용자인 그래픽 디자이너, 브랜드 디자이너, 디자인 관련 학부와 대학원 재학생과 비디자인 배경 사용자인 디자인 혹은 AI 생성 도구에 대한 전문적 훈련이 없는 일반 사용자를 모두 포함하여 표본의 다양성과 비교 가능성을 확보하였다. 참여자 모집은 연구팀이 대학 디자인학과, 디자이너 커뮤니티, 소셜 플랫폼 등을 통해 공개적으로 모집 공고를 진행하는 방식으로 이루어졌다. 또한 표본의 대표성을 확보하기 위해 성별 비율을 균형 있게 조정하였다. 전체 표본에서 남성과 여성의 비율이 유사하도록 설정하였으며, 디자인 배경과 비디자인 배경 두 집단 각각에서도 성별 비율이 크게 치우치지 않도록 통제하였다.

3-2 프로토타입 설계 및 과제 설계

본 연구는 서로 다른 설명가능성 수준을 갖춘 세 가지 AI 생성 로고 시스템 교호 인터페이스 프로토타입을 개발하여, 인터페이스 설명가능성이 사용자 신뢰도, 미학적 평가 및 사용 의도에 미치는 영향을 검증하였다. 연구의 과학성과 비교 가능성을 확보하기 위해, 세 가지 프로토타입은 생성 논리, 교호 절차 및 인터페이스 스타일을 동일하게 유지하였으며, 정보 제시 방식에서의 설명가능성 수준만을 체계적으로 조작하였다.

실험 통제와 사용자 경험의 일관성을 확보하기 위하여, 인터페이스 설계는 다음의 원칙을 준수하였다.

1) 일관성(Consistency): 세 인터페이스는 레이아웃, 색채 체계, 교호 경로, 로고 생성 알고리즘, 결과 제시 수량 등에서 동일성을 유지하며, 설명 정보의 양과 방식만을 조작하였다.

2) 사용성(Usability): 명확한 구조, 합리적인 교호 논리, 직관적인 피드백 메커니즘을 갖추어, 인터페이스 조작의 복잡성이나 이해 편차로 인한 외생적 간섭을 최소화하고, 서로 다른 설명가능성 수준의 인터페이스 간 비교 결과의 통제성과 비교 가능성을 확보하였다.

3) 중립적 시각 스타일(Neutral Design Style): 인터페이스의 심미적 차이가 주관적 평가에 미치는 영향을 최소화하기 위해 통일된 시각 템플릿을 적용하였다.

4) 시스템 안정성(System Robustness): 세 버전의 프로토타입은 동일한 AI 생성 모델을 사용하여 결과 생성 논리의 반복 가능성을 확보하였다.

5) 설명가능성 일관성(Interpretability Consistency): 세 가지 인터페이스는 핵심 기능과 생성 역량을 동일하게 유지하고, 설명 정보의 투명성과 사용자 조정 가능성이라는 두 차원에서만 조작을 수행하였다. 이를 통해 기능 복잡도가 아니라 설명가능성이 주요 독립변수로 작동하도록 설계함으로써, 대안적 설명 가능성을 낮추고자 하였다.

본 연구는 3(인터페이스 설명가능성 수준: 저/중/고) × 2(사용자 배경: 디자인 전공/비전공)의 완전 독립표본 실험설계를 적용하였다. 각 참여자는 무선으로 하나의 설명가능성 인터페이스 조건에만 배정되며, 해당 과제를 수행한 후 그 인터페이스에 대해 1회성 평가를 실시하였다. 본 연구에서 사용된 AI 생성 로고 인터페이스는 다음의 세 가지 유형으로 구성된다.

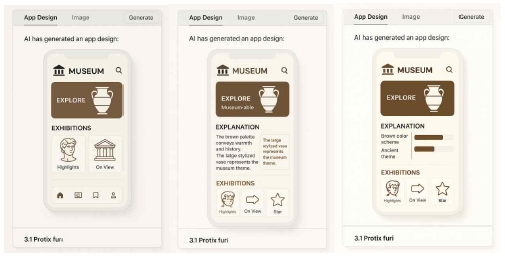

A형(저 설명가능성 인터페이스): 블랙박스 출력 방식으로 AI 생성 결과만 제시하며, 생성 논리에 대한 설명은 제공하지 않는다.

B형(중 설명가능성 인터페이스): 생성 결과 옆에 간단한 키워드와 디자인 근거를 제공하여, 일정 수준에서 사용자의 이해와 판단을 유도한다.

C형(고 설명가능성 인터페이스): 비교적 완전한 생성 논리의 시각화 및 설명적 안내를 제공하며, 일부 핵심 생성 파라미터에 대한 조정 권한을 개방함으로써 더 높은 수준의 정보 투명성과 교호 개방성을 구현하였다. 이때 파라미터 조정 기능은 ‘사용자 개입 가능성’을 조작화하기 위한 것이며, 시스템 기능 복잡도를 강화하기 위한 목적은 아니다.

‘인터페이스 설명가능성’ 변수를 조작화하기 위해, 본 연구는 그림 2와 같이 박물관을 주제로 서로 다른 설명 수준을 갖는 세 가지 인터페이스 프로토타입을 설계하였다. 따라서 본 연구에서의 ‘설명가능성’은 단순히 텍스트 정보량의 증가만을 의미하는 것이 아니라, 사용자 개입 수준(조정 가능성)이라는 인터페이스 속성까지 포함한다. 이는 각각 저 설명가능성(A형), 중 설명가능성(B형), 고 설명가능성(C형)에 대응한다.

추가로 설명할 필요가 있다. 본 연구는 사용된 AI 생성 모델, 입력 주제 및 인터페이스 시각 템플릿을 통일함으로써 생성 조건을 체계적으로 통제하였으나, 생성형 AI의 작동 메커니즘상 서로 다른 생성 결과 간에는 일정 수준의 형식적 및 스타일적 차이가 여전히 존재할 가능성이 있다. 이론적 관점에서 볼 때, 이러한 차이는 특정 조건하에서 사용자들의 미적 지각에 영향을 미칠 수 있다.

그러나 본 연구는 설문조사 방법을 채택하고 있으며, 측정의 초점은 개별 로고 결과에 대한 전문적 미학 판단에 두기보다는, 특정 상호작용 인터페이스 조건하에서 AI가 생성한 로고 전반에 대한 사용 경험에 대한 사용자의 주관적 인식에 있다. 설문 문항은 신뢰도, 미학적 평가, 사용 의향 등 경험 차원을 중심으로 구성되었으며, 개별 그래픽 스타일이나 디자인 세부 요소의 비교보다는 상호작용 맥락과 생성 결과에 대한 종합적 지각을 평가하는 데 중점을 두었다. 따라서 생성 결과에 존재할 수 있는 개별적 스타일 차이는 본 연구에서 설정한 미학적 평가 변수의 핵심적인 교란 요인으로 작용하지 않는다.

잠재적 영향을 추가로 완화하기 위하여, 본 연구는 실험 설계 단계에서 생성 주제를 통일하고, 출력 수량과 제시 방식을 제한하였으며, 중립적이고 미니멀한 인터페이스 시각 스타일을 적용하여 생성 결과 차이가 주관적 판단에 미치는 영향을 최소화하였다. 그럼에도 불구하고, 생성 결과 간 스타일 차이가 보다 정교한 미학적 판단에서 어떠한 역할을 수행하는지에 대해서는 향후 연구에서 추가적인 검토가 필요하다. 후속 연구에서는 생성 결과를 고정하거나, 전문가 평가를 도입하거나, 다회 평균 평가 방식을 활용함으로써 인터페이스 설명가능성과 디자인 스타일이 미학적 평가에 미치는 상대적 영향을 보다 명확히 구분할 수 있을 것이다.

3-3 데이터 수집 도구 및 분석

연구 결과의 체계성과 유효성을 확보하기 위하여, 본 연구는 구조화된 설문지를 활용하였다. 설문지는 기본 정보, 인터페이스 인지 척도, 개방형 피드백 등으로 구성되었으며, 모든 문항은 7점 리커트 척도(1=전혀 동의하지 않음, 7=매우 동의함)를 사용하여 평가하도록 설계하였다. 신뢰도와 타당도를 확보하기 위해 본 조사 이전에 소규모 예비조사(N=10)를 실시하고 문항의 표현을 수정·보완하였다.

서로 다른 설명가능성 수준인 저중고와 사용자 배경인 디자인 비디자인이 사용자 인지 및 행동적 반응에 미치는 영향을 검증하기 위해 본 연구는 정량 및 정성 분석을 병행하였다. 주요 분석 절차는 다음과 같다: 기술통계분석, 신뢰도 및 타당도 검증, 이원분산분석(Two-way ANOVA), 그리고 개방형 응답에 대한 주제분석(Thematic Analysis). 먼저 빈도분석을 통해 응답자의 기본 정보를 기술통계적으로 파악하여 이후 분석의 기초자료로 활용하였다. 다음으로 SPSS 26.0을 사용하여 기술통계 분석을 실시하고, Cronbach’s α, 복합신뢰도(CR), 평균분산추출량(AVE) 등의 지표를 통해 척도의 내적 일관성, 수렴타당도 및 판별타당도를 검증하였다.이후 이원분산분석에서는 '인터페이스 설명가능성 수준'과 '사용자 배경'을 독립변수로, 신뢰도, 미학적 평가, 사용 의도를 종속변수로 설정하여 주효과와 상호작용효과를 검증하였다. 더 나아가 일원분산분석(One-way ANOVA)을 수행하여 연령, AI 도구 사용 경험 및 사용 빈도 등 집단 특성이 서로 다른 설명가능성 인터페이스에서 어떻게 차별적으로 나타나는지 분석하였다. 마지막으로 개방형 응답에 대한 주제 군집 분석을 통해 사용자들이 AI 생성 디자인 시스템에 대해 갖는 심리적 인식과 개선 제안을 도출하고, 설명가능성 수준에 따른 사용자 심리 메커니즘과 경험 차이를 심층적으로 규명하였다.

Ⅳ. 연구 결과

4-1 인구통계적 특성

본 연구에서는 총 100부의 유효한 설문지를 회수하였다. 표본의 대표성과 분석의 신뢰성을 확보하기 위해, 응답자의 성별, 연령, 전공 배경, AI 도구 사용 경험, 그리고 AI 도구 사용 빈도 등을 통계적으로 분석하였다. 전체 표본 구조는 아래 표 2에 제시하였다.

표본 구조를 살펴보면, 남성은 48명(48.0%), 여성은 52명(52.0%)으로 성별 비율이 유사하여 성별이 실험 결과에 미칠 수 있는 잠재적 영향을 효과적으로 통제할 수 있었다. 연령 분포를 보면, 20-29세가 55명(55.0%)으로 가장 많은 비중을 차지하였고, 30-39세가 30명(30.0%), 40-50세가 15명(15.0%)으로 나타났다. 전체적으로 비교적 젊은 층의 참여자가 많은 분포이며, 이는 디지털 도구 사용 습관이 높은 사용자 집단의 AI 생성 로고 인터페이스 수용도를 관찰하는 데 유리한 조건이다.

전공 배경에 있어서는 디자인 전공 사용자 50명(50.0%), 비디자인 배경 사용자 50명(50.0%)으로 구성되어, 두 집단 간 비교 가능성을 충분히 확보하였다. AI 도구 사용 경험 측면에서는 57명(57.0%)이 사용 경험이 있는 것으로 나타났으며, 43명(43.0%)은 사용 경험이 없었다. 사용 경험이 있는 57명을 대상으로 사용 빈도를 분석한 결과, 가끔 사용하는 경우가 25명(43.9%), 자주 사용하는 경우가 20명(35.1%), 고빈도로 사용하는 경우가 12명(21.1%)이었다. 사용 경험이 없는 43명은 해당 빈도에서 '전혀 사용하지 않음(43.0%)'에 해당한다.

종합적으로 볼 때 본 연구의 표본은 성별, 연령, 전공 배경 및 AI 도구 사용 경험 측면에서 균형 있게 분포되어 있으며, 경험이 있는 사용자와 경험이 없는 사용자가 모두 포함되어 있어 다양한 배경의 사용자가 AI 생성 로고 인터페이스를 경험하는 과정에서 나타나는 행동 및 심리적 반응을 대표성 있게 반영할 수 있다. 이는 이후 신뢰도, 미학적 평가 및 사용 의도에 대한 분석을 수행하는 데 신뢰할 만한 기초 자료로 기능한다.

4-2 신뢰도와 타당도

다른 수준의 설명가능성 인터페이스에서 사용자의 지각 및 행동 반응을 평가하기 위해서는, 우선 사용된 측정 척도의 신뢰도와 타당도를 검증하여 모델 변수들이 충분한 내부 일관성과 구성 개념 간 구분성을 갖추고 있는지 확인할 필요가 있다. 본 연구에서는 신뢰도, 미학적 평가, 사용 의도 등의 요인을 중심으로 내부 신뢰도 분석과 확인적 요인 분석을 수행하였다.

내부 일관성 신뢰도는 Cronbach's α 계수를 통해 평가하였다. 분석 결과, 모든 잠재 변수의 α 값은 0.83에서 0.86 사이로 나타났으며, 일반적으로 인정되는 기준치인 0.70을 모두 상회하였다. 이는 각 척도가 높은 수준의 내부 일관성을 지니고 있음을 의미한다. 수렴 타당도(convergent validity)의 경우, 각 잠재 변수의 평균분산추출량은 0.61에서 0.65 사이에 분포하였으며, 복합 신뢰도는 모두 0.84 이상으로 나타났다. Mersha가 제시한 기준에 따르면 AVE > 0.50, CR > 0.70일 때 수렴 타당도가 확보되었다고 판단할 수 있으므로, 본 연구의 측정 모형은 양호한 수렴 타당성을 갖춘 것으로 평가된다. 구체적인 신뢰도 및 수렴 타당도 지표는 표 3에 제시하였다.

본 연구는 잠재변수 간 판별타당도를 추가적으로 검증하였다. 표 4에 제시된 바와 같이, 모든 변수의 AVE 제곱근(표의 대각선 이탤릭 부분)이 다른 변수들과의 상관계수보다 높은 것으로 나타났다. 이는 각 구성개념 간에 양호한 구분성이 확보되었으며, 측정 중복 또는 구성개념 간 중첩 문제가 존재하지 않음을 의미한다. 또한 모든 요인적재치가 0.73-0.84 범위에 분포하여, 각 문항이 대응하는 구성개념에 대해 우수한 집합타당성을 보유하고 있음을 추가적으로 입증하였다.

Discriminant validity matrix of latent variables (italicized values represent the square roots of AVE)

종합적으로 볼 때, 본 연구에서 사용된 설문지는 신뢰도, 미학적 평가 및 사용 의도 세 가지 차원에서 우수한 집합타당도와 내부 일관성을 확보하였을 뿐만 아니라, 뚜렷한 판별타당도 또한 나타냈다. 이러한 결과는 이후 실시되는 이원분산분석과 교호 인터페이스의 설명가능성이 사용자 신뢰도, 미학적 평가 및 사용 의도에 미치는 영향을 검증하기 위한 신뢰성 있는 데이터 기반을 제공한다.

4-3 이원분산분석

인터페이스 설명가능성 수준과 사용자 배경이 사용자 신뢰도, 미학적 평가 및 사용 의향에 미치는 영향을 검토하기 위하여, 각 참여자가 하나의 인터페이스 조건만을 평가하는 실험 설계에 근거해 본 연구는 3×2 완전 독립표본 설계의 이원분산분석을 적용하였다. 이를 통해 인터페이스 설명가능성 수준, 사용자 배경, 그리고 두 변수 간 상호작용 효과를 검증하였으며, 분석 결과는 표 5에 제시하였다.

분산분석을 실시하기에 앞서 자료의 통계적 전제 조건을 먼저 검토하였다. 그 결과, 모든 실험 조건에서 종속변수는 정규분포에서 유의미하게 이탈하지 않았으며(Shapiro-Wilk 검정, p > .05), 분산의 동질성 가정 또한 충족되는 것으로 나타났다(Levene 검정, p > .05). 또한 본 연구에서 인터페이스 설명가능성 수준과 사용자 배경은 모두 피험자 간 변수로 설정된 완전 독립표본 설계를 채택하고 있으므로, 반복측정 설계나 구형성 가정 검증은 적용 대상에 포함되지 않는다.

인터페이스 설명가능성 수준은 신뢰도에 대해 유의미한 주효과를 보였으며, 편 η² = 0.408로 나타나 인터페이스 설명가능성이 사용자 신뢰도를 설명하는 효과 크기가 비교적 큼을 시사한다. 사후 비교(Tukey HSD) 결과, 중간 수준의 설명가능성 인터페이스(B)와 높은 수준의 설명가능성 인터페이스(C) 모두 낮은 수준의 설명가능성 인터페이스(A)에 비해 신뢰도가 유의미하게 높았으며(p < .05), B와 C 간의 차이는 통계적으로 유의하지 않았다. 전반적으로 서로 다른 인터페이스 설명가능성 수준 조건에서 사용자 신뢰도 평가는 유의미한 차이를 보였고, 낮은 설명가능성 인터페이스에 비해 더 높은 수준의 설명 정보 제공은 AI 생성 로고에 대한 사용자 신뢰를 증진시키는 데 기여하는 것으로 나타났다.

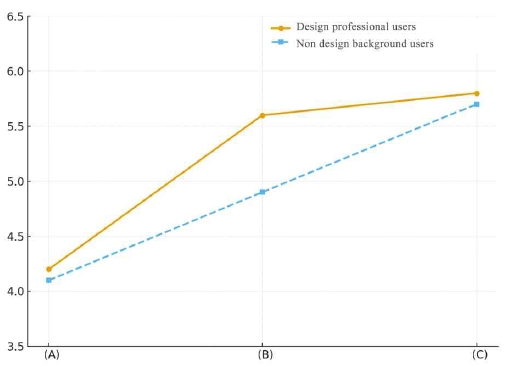

사용자 배경의 주효과 역시 유의미하게 나타났으며, F(1,94)=7.82, p=0.006, 편 η² = 0.077로 확인되었다. 디자인 전공 사용자(M=5.45)의 신뢰도는 비디자인 전공 사용자(M=4.87)에 비해 유의미하게 높았다. 또한 인터페이스 설명가능성과 사용자 배경 간에는 유의미한 상호작용 효과가 관찰되었으며, F(2,94)=6.24, p=0.003, 편 η² = 0.117로 나타났다. 인터페이스 설명가능성 수준과 사용자 배경 간 상호작용이 유의미하였으므로, 주효과 수준의 사후 비교 결과는 전체 평균 차이를 주로 반영하는 데 그친다. 이에 따라 사용자 배경별 구체적인 차이 양상은 그림 3을 통해 추가로 제시한다. 분석 결과, 디자인 전공 사용자는 중간 수준의 설명가능성 인터페이스 조건에서 신뢰도 향상이 보다 두드러진 반면, 비디자인 전공 사용자는 높은 수준의 설명가능성 인터페이스 조건에서 더 높은 신뢰도를 보였다. 이는 사용자 배경에 따라 인터페이스 설명가능성이 신뢰도에 미치는 영향이 서로 다른 양상으로 나타남을 의미한다.

인터페이스 설명가능성 수준은 미학적 평가에 대해 유의미한 주효과를 보였으며, F(2,94)=28.76, p<0.001, 편 η² = 0.380으로 나타나 인터페이스 설명가능성이 미학적 평가를 설명하는 데 비교적 강한 효과를 지님을 시사한다. 사후 비교(Tukey HSD) 결과, 중간 수준의 설명가능성 인터페이스(B)와 높은 수준의 설명가능성 인터페이스(C) 모두 낮은 수준의 설명가능성 인터페이스(A)에 비해 미학적 평가가 유의미하게 높았다(p < .05). 중간 수준의 설명가능성 인터페이스의 평균 미학적 평가가 높은 수준의 설명가능성 인터페이스보다 다소 높게 나타났으나(M_B = 5.42; M_C = 5.35), 두 조건 간 차이는 통계적으로 유의하지 않았으며(B ≈ C), 이는 유의한 감소라기보다는 기술적 경향으로 해석되어야 한다. 한편, 사용자 배경의 주효과는 미학적 평가에서 유의하지 않았고, F(1,94)=2.15, p=.15, 편 η² = 0.022로 확인되었다. 또한 인터페이스 설명가능성 수준과 사용자 배경 간의 상호작용 효과 역시 유의수준에 도달하지 않았으며, F(2,94)=0.92, p=.40, 편 η² = 0.019로 나타났다. 이는 서로 다른 사용자 배경 집단 간에 미학적 평가에 대한 반응 양상이 전반적으로 일관되게 나타났음을 의미한다.

인터페이스 설명가능성 수준은 사용 의향에 대해 유의미한 주효과를 보였으며, F(2,94)=25.34, p<0.001, 편 η² = 0.350으로 나타나 인터페이스 설명가능성이 사용자 사용 의향을 설명하는 데 비교적 큰 효과를 지님을 시사한다. 사후 비교(Tukey HSD) 결과, 중간 수준의 설명가능성 인터페이스(B)와 높은 수준의 설명가능성 인터페이스(C) 모두 낮은 수준의 설명가능성 인터페이스(A)에 비해 사용 의향이 유의미하게 높았다(p < .05). 중간 수준의 설명가능성 인터페이스의 평균 사용 의향이 높은 수준의 설명가능성 인터페이스보다 다소 높게 나타났으나(M_B = 5.50; M_C = 5.30), 두 조건 간 차이는 통계적으로 유의하지 않았으며(B ≈ C), 이는 유의한 감소라기보다는 기술적 경향으로 해석되어야 한다. 한편, 사용자 배경의 주효과는 사용 의향에서 유의하지 않았고, F(1,94)=1.98, p=.16, 편 η² = 0.021로 확인되었다. 또한 인터페이스 설명가능성 수준과 사용자 배경 간의 상호작용 효과 역시 유의수준에 도달하지 않았으며, F(2,94)=0.85, p=.43, 편 η² = 0.018로 나타났다. 이는 인터페이스 설명가능성이 서로 다른 사용자 배경 집단에서 사용 의향에 미치는 영향 양상이 전반적으로 일관됨을 의미한다.

종합하면, 연구 결과는 인터페이스 설명가능성 수준이 AI 생성 로고에 대한 사용자 평가를 형성하는 핵심 요인임을 일관되게 보여준다. 신뢰도, 미학적 평가, 사용 의향의 세 차원 모두에서 인터페이스 설명가능성은 유의미한 주효과를 나타냈으며, 효과 크기 역시 중간에서 비교적 큰 수준에 도달하였다. 이는 설명 정보가 사용자 전반적 경험을 구성하는 데 중요한 역할을 수행함을 시사한다. 구체적으로, 낮은 설명가능성 인터페이스에 비해 중간 및 높은 설명가능성 인터페이스는 세 평가 차원 모두에서 사용자 인식을 유의미하게 향상시켰으나, 중간과 높은 설명가능성 조건 간의 차이는 통계적으로 유의하지 않아 일관된 기술적 경향만을 보였다.

사용자 배경 요인의 경우, 주효과는 신뢰도 차원에서만 유의미하게 나타났으며, 디자인 전공 사용자의 전반적 신뢰도가 비디자인 전공 사용자보다 높았다. 반면 미학적 평가와 사용 의향 차원에서는 유의한 차이가 관찰되지 않았다. 또한 인터페이스 설명가능성과 사용자 배경 간의 상호작용 효과는 신뢰도 차원에서만 유의미하게 나타나, 사용자 배경에 따라 인터페이스 설명가능성이 신뢰 형성에 미치는 영향 양상이 상이함을 보여준다. 이에 비해 미학적 평가와 사용 의향 차원에서는 이러한 영향 패턴이 사용자 집단 전반에 걸쳐 대체로 동일하게 유지되었다.

4-4 설명가능성 주제 군집 분석

본 연구에서는 서로 다른 인터페이스 설명가능성 수준과 사용자 배경에 대한 사용자의 반응을 심층적으로 이해하기 위해 주제 분석을 실시하였다. 데이터 내에서 반복적으로 나타나는 주제나 패턴을 식별하고 해석함으로써 연구에 보다 깊이 있는 통찰을 제공하였다. 본 연구에서 주제 분석의 주요 목적은 서로 다른 인터페이스 설명가능성 조건에 직면했을 때 사용자의 주관적 감정, 인지 과정 및 행동 동기를 탐색하는 데 있다.

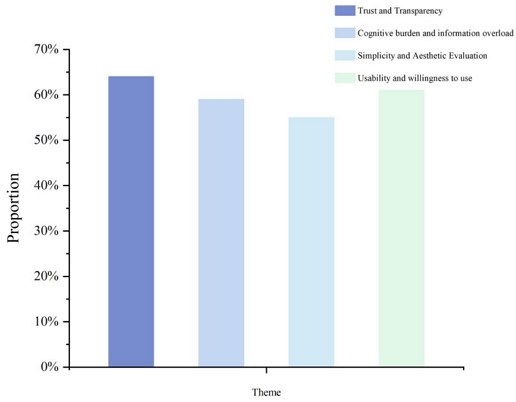

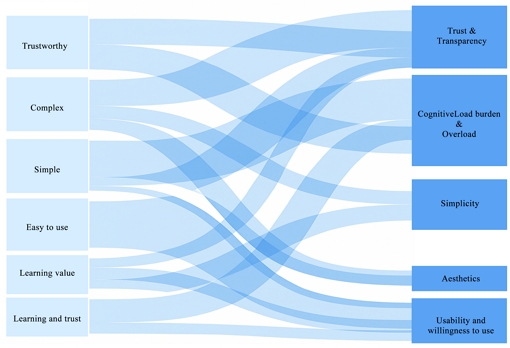

사용자의 주관적 의견과 개선 제안을 수집하여 반복적으로 나타나는 핵심 주제를 정리·식별하였다. 이를 바탕으로 다음과 같은 주요 범주로 분류하였다(그림 4).

신뢰와 투명성 측면에서는 전체 참여자의 64%가 설명 정보가 제공되는 인터페이스를 선호한다고 응답하였으며, 이는 높은 설명가능성 수준이 사용자로 하여금 AI 생성 로고에 대한 신뢰감을 형성하는 데 기여한다는 점을 보여준다. 특히 디자인 전공 사용자에서 이러한 반응이 더욱 두드러지게 나타났다.

인지적 부담과 정보 과부하 측면에서는 59%의 참여자가 과도한 설명 정보가 인지적 부담을 초래한다고 언급하였으며, 이러한 현상은 고 설명가능성 인터페이스에서 특히 뚜렷하게 나타났다. 다수의 비디자인 배경 사용자는 정보 과부하로 인해 혼란감이나 피로감을 느낀다고 피드백하였다.

단순성과 미학적 평가 측면에서는 전체 참여자의 55%는 인터페이스 단순성이 미학적 평가에 중요하다고 강조하였으며, 중 설명가능성 인터페이스는 시각적 단순성과 기능성을 동시에 유지함으로써 높은 미학적 평가를 얻을 수 있다고 응답하였다. 반면, 지나치게 복잡한 인터페이스 설명 정보는 시각적 경험을 저해할 수 있으며, 이는 특히 디자인 전공 사용자에서 더욱 강하게 나타나는 경향이 있었다.

사용 용이성과 사용 의향 측면에서는 61%의 참여자는 고 설명가능성 인터페이스가 신뢰도를 향상시키기는 하지만, 그 복잡성으로 인해 사용 의향이 감소한다고 언급하였다. 비교 분석 결과, 중 설명가능성 인터페이스가 단순성 및 정보 제공 간의 균형을 적절히 유지함으로써 사용자 사용 의향을 더욱 효과적으로 자극하는 것으로 나타났다.

결과는 적정 수준의 설명가능성 디자인이 사용자 요구를 보다 효과적으로 충족시킬 수 있음을 보여준다. 즉, 충분한 정보를 제공하여 신뢰를 형성하는 동시에 과도한 인지적 부담을 회피함으로써 사용자 만족도와 사용 의향을 향상시킬 수 있다는 점이 확인되었다.

그림 5는 설문 피드백을 기반으로 한 설명가능성 주제 군집 분석 결과를 제시하며, 이는 사용자가 설명가능성 인터페이스를 지각하는 과정에서 나타나는 다양한 관심 지점과 심리적 모델을 반영한다.

그림에서 확인할 수 있듯이, 키워드 Trustworthy는 ‘신뢰와 투명성’ 주제와 가장 밀접한 관련성을 보이며, 이는 다수의 사용자가 인터페이스 설명가능성이 높을수록 AI 생성 로고에 대한 신뢰감이 강화된다고 인식하고 있음을 나타낸다. 명확하고 합리적인 설명 정보는 사용자가 AI의 논리적 추론 과정을 이해하도록 도울 뿐 아니라, 시스템에 대한 투명성과 신뢰성을 높이는 데 기여한다는 점이 강조된다.

키워드 Complex는 주로 ‘인지적 부담과 정보 과부하’와 연관되어 나타났으며, 이는 설명 정보가 지나치게 복잡할 경우 사용자가 정보량이 과도하다고 느끼고 이해 과정에서 어려움을 경험함을 반영한다. 특히 비디자인 배경 사용자에게 이러한 인지적 피로는 더욱 두드러지게 나타났다. 반면 Simple과 Easy to Use는 ‘단순성’ 및 ‘미학적 평가’와 높은 연관성을 보였으며, 이는 사용자들이 교호 인터페이스 경험에서 단순하고 직관적이며 미적 완성도가 높은 디자인을 선호함을 의미한다.

또한 일부 참여자가 언급한 Learning Value와 Learning and Trust는 ‘사용 용이성과 사용 의향’ 주제와 유의한 연관성을 지니는 것으로 나타났다. 이는 고 설명가능성 인터페이스가 정보량을 증가시킬 수 있음에도 불구하고, 일부 사용자에게는 AI의 논리 구조를 학습하고 신뢰의 전이를 촉진하는 중요한 경험 경로로 인식될 수 있음을 보여준다.

전체적으로 볼 때, 주제 군집 분석은 앞서 제시한 정량적 결과를 추가적으로 검증하였다. 즉, 적정 수준의 설명가능성이 사용자 신뢰도, 미학적 평가, 사용 의향 간에서 최적의 균형을 달성함을 확인할 수 있었다. 사용자는 설명가능성 인터페이스를 접할 때 신뢰 형성, 인지적 부담, 시각적 경험 사이에서 지속적으로 균형을 모색하며, 이 세 요소를 동시에 충족시키는 지점이 바로 '적정 수준의 설명'이라는 점이 명확하게 드러났다.

4-5 집단 차이 분석

연령 변수가 설명가능성 디자인에 미치는 영향을 탐색하기 위해, 본 연구는 응답자를 세 개 연령대(20-29세, 30-39세, 40-50세)로 구분하고 일원분산분석을 통해 신뢰도, 미학적 평가, 사용 의향의 세 차원에서 연령대 간 점수 차이를 검증하였다. 그 결과는 다음과 같다(표 6).

결과는 연령 집단 간 신뢰도(F=4.87, p=0.010), 미학적 평가(F=3.94, p=0.023), 사용 의향(F=5.26, p=0.007)에서 모두 유의한 차이가 존재함을 보여주었다. 세부적으로 살펴보면, 20-29세 집단은 세 차원 모두에서 가장 높은 점수를 기록하였으며, 이는 젊은 사용자들이 설명가능성 인터페이스에 대해 전반적으로 더 긍정적인 태도를 보인다는 점을 의미한다. 특히 신뢰도와 사용 의향에서 그 차이가 두드러지게 나타났다. 30-39세 집단은 미학적 평가에서 비교적 높은 점수를 보였는데, 이는 이들이 인터페이스의 단순성 및 심미적 균형을 보다 중시함을 시사한다. 반면 40-50세 집단은 세 항목 모두에서 가장 낮은 점수를 나타내어, 고 설명가능성 인터페이스의 복잡성이 연령이 높은 사용자에게는 부담으로 작용하며, 정보량이 적고 직관적으로 이해 가능한 디자인을 더 선호한다는 점을 보여준다.

종합적으로 볼 때, 연령 요인은 사용자 신뢰 형성, 미학적 인지 및 사용 의향에 유의미한 영향을 미치는 것으로 나타났다. 젊은 연령층은 상대적으로 높은 설명가능성 디자인을 수용하는 경향이 있는 반면, 중·장년층은 정보가 간결하고 인지적 부담이 낮은 인터페이스를 선호하는 경향을 보였다. 이러한 결과는 향후 AI 기반 인터페이스 설계에서 연령 특성을 고려한 차별화된 최적화 전략이 필요하며, 이를 통해 전체 사용자 경험 및 신뢰 수준을 향상시킬 수 있음을 시사한다.

사용자가 AI 도구 사용 경험을 보유하고 있는지가 인터페이스 설명가능성 디자인에 대한 지각에 어떠한 영향을 미치는지를 탐색하기 위해, 본 연구는 응답자를 두 집단으로 구분하였다. 즉, AI 사용 경험이 있는 집단(예: ChatGPT, Midjourney, Canva AI 등을 사용한 경험이 있는 경우)과 AI 사용 경험이 없는 집단으로 나누어 분석하였다. 본 절의 분석은 보충적 성격의 탐색적 분석으로 수행되었다.

분석 방법으로는 One-way ANOVA를 적용하여, 인터페이스 설명가능성 수준과 AI 사용 경험(유/무)이 신뢰도, 미학적 평가, 사용 의도의 세 차원에서 나타내는 효과를 검증하였다. 그 결과는 다음과 같다.

One-way ANOVA results for the three-dimensional perception dimensions across groups with different ai usage experience

결과는 AI 도구 사용 경험이 있는 사용자의 신뢰도가 사용 경험이 없는 사용자보다 유의하게 높음을 보여준다(F=6.12, p=0.015). 이는 AI 시스템에 익숙한 사용자가 AI 생성 로고를 접할 때 시스템의 작동 메커니즘에 대한 기본적인 이해를 바탕으로 불확실성을 줄이고 더 쉽게 신뢰를 구축할 수 있음을 시사한다. 두 집단 간 미학적 평가에서는 유의한 차이가 나타나지 않았으며(F=2.04, p=0.16), AI 사용 경험 여부가 사용자 미적 판단에 미치는 영향은 제한적임을 보여준다. AI 사용 경험은 시각적 선호보다는 이해 및 신뢰 형성과 같은 인지적 측면에서 더 큰 영향을 미치는 것으로 해석된다. AI 도구 사용 경험이 있는 집단의 사용 의향은 경험이 없는 집단보다 유의하게 높게 나타났다(M=5.23, M=4.86; F=5.01, p=0.028). 이는 AI에 익숙한 사용자가 설명 기능을 갖춘 AI 기반 디자인 도구를 보다 적극적으로 수용하고 지속적으로 사용하려는 경향을 보인다는 점을 보여준다.

종합적으로 볼 때, AI 사용 경험은 사용자 신뢰도와 사용 의향에 유의미한 영향을 미치지만 미학적 평가에는 상대적으로 적은 영향을 미친다. AI 경험이 있는 사용자는 기술 이해도가 높아 이에 기반한 신뢰 및 사용 동기가 더 쉽게 형성되는 반면, 경험이 없는 사용자는 AI 생성 논리에 대한 낮은 이해로 인해 보다 보수적이거나 신중한 태도를 보일 가능성이 크다. 이러한 결과는 교육적 설명 또는 투명한 교호 인터페이스를 통해 사용자의 AI 친숙도를 제고하는 것이 신뢰도와 사용 의향 향상에 효과적일 수 있음을 시사한다. 해당 집단 간 표본 수가 다소 불균형하다는 점을 고려할 때, 상기 결과는 주로 경향적 차이를 반영한 것으로 해석되어야 하며, 탐색적 발견으로서 제한적으로 해석할 필요가 있다.

사용자의 AI 도구 사용 빈도가 인터페이스 설명가능성 디자인에 대한 지각에 어떠한 영향을 미치는지를 분석하기 위해, 본 연구는 응답자를 자기보고식 사용 빈도에 따라 세 집단으로 분류하였다. 즉, 저빈도 집단(가끔 사용), 중빈도 집단(주당 수회 사용), 고빈도 집단(거의 매일 사용)으로 구분하였다. 이후 일원분산분석을 통해 세 집단 간 신뢰도, 미학적 평가, 사용 의향의 세 차원에서 점수 차이가 존재하는지를 비교하였으며, 그 결과는 표 8에 제시되어 있다.

One-way ANOVA results for the three-dimensional perception dimensions across groups with different AI usage frequencies

결과는 AI 사용 빈도 집단 간 신뢰도에서 유의한 차이가 존재함을 보여준다(F=5.94, p=0.004). 고빈도 집단은 저빈도 집단보다 신뢰도가 유의하게 높았으며(p<0.01), 중빈도 집단은 양 집단의 중간 수준을 나타냈다. 이는 AI 도구를 자주 사용하는 사용자가 AI 생성 디자인 결과를 더 쉽게 신뢰한다는 점을 시사한다. 미학적 평가는 사용 빈도가 증가함에 따라 점수가 소폭 상승하는 경향을 보였으나, 그 차이는 통계적으로 유의하지 않았다(p=0.095). 이는 AI 사용 빈도가 사용자 미적 판단에 미치는 영향이 제한적이며, 시각적 선호가 비교적 안정적인 특성을 지닌다는 점을 의미한다. AI 사용 빈도는 사용 의향에 유의한 영향을 미쳤으며(F=6.08, p=0.003), 고빈도 집단의 사용 의향은 가장 높았고 저빈도 집단보다 유의하게 높았다(p<0.01). 이는 장기간의 AI 활용 경험이 설명가능성 인터페이스에 대한 수용도와 사용 동기를 강화하는 데 기여함을 보여준다.

종합적으로 볼 때, AI 사용 빈도가 높아질수록 사용자들의 AI 생성 로고에 대한 신뢰도와 사용 의향은 뚜렷하게 증가한다. 빈번하게 AI를 사용하는 사용자는 AI의 작동 논리에 대한 이해도가 높기 때문에 보다 긍정적인 신뢰 형성과 적극적인 사용 태도를 보일 가능성이 크다. 반면, 미학적 평가에서는 사용 빈도의 영향이 상대적으로 약하며, 이는 시각적 미감이 경험적 차이에 의해 쉽게 변하지 않는 비교적 안정적인 성향을 지닌다는 점을 보여준다. 사용 빈도 집단 간 표본 수가 불균형한 점(예: 고빈도 집단의 표본 수가 상대적으로 적음)을 고려할 때, 상기 결과는 주로 경향적 차이를 기술하기 위한 것으로 활용되며, 탐색적 발견으로서 해석되어야 한다.

4-6 AI의 인터페이스 디자인 및 사용자 경험 최적화 전략

앞선 연구 분석을 기반으로, AI가 인터페이스 디자인 및 사용자 경험(UX) 최적화 측면에서 적용할 수 있는 핵심 전략을 도출할 수 있다. 이러한 전략은 사용자 신뢰도, 미학적 인지 및 사용 의향을 향상시키는 설계 근거를 제공할 뿐만 아니라, 인간-AI 협업 시스템의 설명가능성 최적화를 위한 방향성을 제시한다.

적정 정보량과 인지 부담의 균형을 통해 ‘적정 수준의 설명’을 구현하는 것이 중요하다. 연구 결과 중 설명가능성 인터페이스는 신뢰도, 미학적 평가, 사용 의향 측면에서 가장 우수한 성과를 보였다. 설명 정보가 지나치게 적으면 사용자가 AI의 논리를 이해하기 어렵고 과도할 경우 인지적 부담이 증가하여 부정적 경험을 초래한다. 따라서 인터페이스 디자인에서는 단계적 제공 방식이나 조절 가능한 설명 모듈인 예를 들어 ‘자세히 보기’, ‘이유 설명 보기’를 활용하여 사용자가 필요 시 정보의 깊이를 선택할 수 있도록 설계해야 한다. 이를 통해 사용자 요구에 기반한 온디맨드 형태의 개인화된 설명 경험이 가능해진다.

투명성을 기반으로 신뢰를 구축하기 위해 AI 의사결정 과정의 시각화가 필수적이다. 신뢰와 투명성은 사용자 지각에서 중심적 역할을 하는 주제이며, 디자인은 AI 생성 로직과 의사결정 근거를 시각적으로 표현함으로써 이러한 요구를 충족할 수 있다. 예를 들어 도식화된 설명 구조나 가중치 막대 등을 활용하여 AI의 선택 이유를 직관적으로 보여주고, 비전문가에게는 자연어 기반 설명과 비교 사례를 제공하여 이해 장벽을 낮춘다. 반면 디자인 전문가에게는 구체적인 파라미터 정보와 알고리즘 근거를 제공함으로써 전문적 신뢰를 강화할 수 있다.

고 설명가능성 인터페이스의 정보 과부하 문제를 완화하기 위해서는 상호작용 흐름의 최적화가 필요하다. 설명 정보가 지나치게 많을 경우 인터페이스는 정보 밀집, 시각적 난잡함, 읽기 단절 등의 문제를 초래한다. 이를 해결하기 위해 단계적 정보 제시, 애니메이션 기반 전환, 시각적 그룹화 등의 전략을 적용하여 시각적 부담을 줄일 수 있다. 또한 사용자 행동 데이터를 기반으로 필요 정보량을 예측하는 AI의 조정 기능을 활용하면, 동적으로 설명 수준을 조절하는 인지 자가적응형 인터페이스 구현이 가능하다.

미학과 기능성을 통합하여 인터페이스의 즐거움과 몰입감을 강화하는 것도 중요한 전략이다. 단순성 및 미학적 평가 결과는 사용자가 명확하고 균형 잡힌 시각적 구조를 가진 인터페이스를 선호한다는 점을 보여준다. 이에 따라 AI 인터페이스 설계는 기능적 가독성과 시각적 미감을 동시에 추구해야 하며, 과도한 기술 정보나 텍스트 중심 레이아웃을 피해야 한다. 적절한 여백, 계층적 구조, 색채 조절 등을 통해 인터페이스의 리듬감과 심미적 경험을 향상시키면, 이해 중심의 인지 경험과 감성적 만족 경험 간의 긍정적 순환을 만들 수 있다.

학습 가치와 신뢰 전이를 강화하여 장기적 사용 의향을 촉진하는 것도 핵심 전략이다. 사용자들은 고(高) 설명가능성 인터페이스가 AI의 설계 논리와 사고 방식을 이해하는 데 도움이 된다고 인식하며, 이는 장기적 신뢰 형성으로 이어진다. 이러한 점에서 AI 시스템은 학습 과정의 가시화, 생성 절차의 단계별 시연, 사용자 행동에 기반한 조언 제공 등 지속적 피드백 메커니즘을 구축해야 한다. 이를 통해 사용자는 자신의 성장 경험을 체감할 수 있으며, '학습 가능-신뢰 가능-확장 가능'이라는 신뢰 전이 구조가 강화된다.

종합하면, AI 인터페이스 디자인의 최적화는 설명 투명성, 정보량-인지 부담의 균형, 미학적·기능적 통합, 학습·신뢰 전이를 기반으로 이루어져야 한다. 적정 수준의 설명가능성은 사용자의 AI 시스템 이해도와 신뢰도를 높이고, 나아가 시각 경험과 상호작용 효율성을 동시에 개선하여 AI가 창의적 디자인 및 사용자 경험 분야에서 지속 가능한 활용을 실현하는 데 중요한 역할을 한다.

4-7 연구 결과 요약

본 장은 정량 분석과 정성 분석을 병행하여 교호 인터페이스 설명가능성이 사용자 신뢰도, 미학적 평가 및 사용 의향에 미치는 영향 메커니즘을 체계적으로 탐구하였다. 연구 결과에 따르면, 설명가능성 수준은 사용자의 AI 생성 로고 수용도에 영향을 미치는 핵심 요인으로 나타났으며, 이는 사용자 배경 및 사용 경험 등 개인 차이에 의해 조절되는 것으로 확인되었다.

먼저, 전체적 효과 측면에서 인터페이스 설명가능성은 세 가지 지각 차원 모두에서 유의미한 영향을 보였다. 설명 정보가 증가함에 따라 사용자의 AI 생성 로고에 대한 신뢰도는 유의하게 상승하였으며, 이는 적정 수준의 투명성이 사용자의 AI 설계 논리에 대한 이해와 인식을 강화한다는 점을 보여준다. 그러나 설명 정보가 과도할 경우 신뢰도는 비교적 높은 수준을 유지하더라도 미학적 평가와 사용 의향은 다소 감소하는 경향을 보였다. 이는 정보 과부하 및 인지 부담의 부정적 효과를 반영한다. 따라서 중 설명가능성 인터페이스가 세 차원 모두에서 최적의 성과를 보이며 투명성과 사용 용이성 간의 균형을 가장 효과적으로 달성하였다.

다음으로 사용자 특성 측면에서 분석한 결과, 디자인 전공 사용자의 신뢰도는 비디자인 사용자보다 유의하게 높았으며, 이는 디자인 배경을 가진 사용자들이 AI 생성 로직을 보다 쉽게 이해하고 시스템에 대한 신뢰를 형성하기 용이하다는 점을 시사한다. 반면 비디자인 사용자는 신뢰 구축 과정에서 인터페이스의 설명 정보에 더 크게 의존하며, 특히 고 설명가능성 인터페이스에 대해 긍정적인 반응을 보였다. 연령 차이 분석 결과, 젊은 집단(20-29세)은 설명가능성 인터페이스에 대한 수용도가 높고 이해력 및 탐색 의지가 강한 반면, 장년층(40-50세)은 단순하고 부담이 적은 인터페이스를 선호하는 경향을 보였다. 또한 AI 사용 경험 및 사용 빈도 역시 사용자 태도에 영향을 미쳤으며, AI 경험자 또는 고빈도 사용자 집단은 비경험자보다 신뢰도와 사용 의향이 유의하게 높았다. 이는 AI 논리에 대한 친숙성이 긍정적 인지 형성과 신뢰 전이를 촉진함을 시사한다.

주제 군집 분석을 통해 사용자의 주관적 지각에서 핵심적으로 작용하는 여러 주제가 도출되었다. 신뢰와 투명성, 인지적 부담과 정보 과부하, 단순성, 미학, 사용 용이성 및 사용 의향 등은 상호 연관성을 가지며, AI 설명가능성 인터페이스 사용 과정에서 사용자 심리의 균형 메커니즘을 구성한다. 이 중 신뢰와 투명성은 가장 중심적인 요인으로 확인되었으며, 이는 시각화된 정보 제공, 자연어 기반 설명 등 신뢰 구축을 강화하는 설계가 중요함을 시사한다. 반면 인지적 부담은 과도한 정보 제공의 위험성을 강조하며, 설명 깊이와 인터페이스 단순성 간 균형의 필요성을 제기한다.

마지막으로 정량적 결과와 사용자 피드백을 종합하여 본 연구는 AI 인터페이스 설계 최적화를 위한 전략을 제안하였다. 이는 정보량-인지 부담의 균형, 투명성 기반 신뢰 구축, 상호작용 흐름 최적화, 미학과 기능성의 통합, 학습 가치 및 신뢰 전이의 강화 등으로 구성된다. 이러한 전략은 사용자 지각 심리와 인터페이스 구조 양 측면에서 AI 기반 디자인 도구의 사용자 경험을 향상시키는 이론적·실천적 근거를 제공한다.

종합하면, 본 장의 연구 결과는 인터페이스 설명가능성이 AI 디자인 도구 사용자 수용 과정에서 핵심적인 역할을 수행함을 검증한다. 적정 수준의 설명은 사용자 신뢰도와 사용 의향을 향상시킬 뿐만 아니라, 시각적 미감과 상호작용 효율성 간의 조화를 실현하는 데 결정적으로 기여한다.

Ⅴ. 결 론

본 연구는 사용자 경험과 인간 컴퓨터 상호작용 관점에서 출발하여, AI 생성 로고 맥락에서 상호작용 인터페이스의 설명가능성이 사용자 신뢰도, 미학적 평가 및 사용 의향에 미치는 영향을 탐구하였다. 서로 다른 설명가능성 수준의 인터페이스를 비교 분석한 결과, 인터페이스 설명가능성은 사용자가 AI 생성 디자인을 수용하는 과정에서 중요한 역할을 수행하는 것으로 나타났으며, 특히 적정 수준의 설명가능성은 정보 이해와 인지적 부담 간의 균형을 형성하는 데 유리하여 긍정적인 사용 경험을 촉진하는 것으로 확인되었다. 또한 사용자의 전공 배경, 연령, AI 사용 경험은 설명 정보에 대한 이해 방식과 선호에 영향을 미치며, 서로 다른 사용자 집단은 신뢰 형성과 인터페이스 수용 방식에서 차이를 보였다. 더 나아가 주제 군집 분석 결과, 신뢰와 투명성, 인지적 부담, 미학적 지각, 사용성 및 사용 의향 등의 요인이 함께 작용하여 이해, 신뢰, 사용을 아우르는 사용자 경험의 종합적 구조를 구성함이 드러났다.

이론적 차원에서 본 연구의 주요 기여는 창의적 디자인 맥락에서 인터페이스 설명가능성의 의미를 보다 명확히 규정했다는 데 있다. 기존의 설명가능 인공지능 연구는 주로 의사결정 지원이나 기능 중심 시스템을 대상으로 하여, 설명가능성을 사용자가 시스템의 판단 근거를 이해하고 불확실성을 낮추기 위한 도구적 메커니즘으로 다루어 왔다. 반면 AI 생성 로고라는 창의적 디자인 환경에서 설명가능성은 단순한 설명 정보 제시의 수준을 넘어, 상호작용 과정에서 사용자의 이해 방식, 지각된 부담, 전반적 경험 형성에 미치는 영향을 포함한다. 본 연구는 설명 정보를 사용자가 상호작용 과정에서 경험하는 이해 부담, 체험 감각, 전체적 사용 인식에 미치는 종합적 영향으로 해석함으로써, 사용자 경험 차원에 대한 설명가능성 연구의 개념적 범위를 확장하였으며, 향후 AI 기반 브랜드 디자인과 인간 기계 협업 시스템 연구를 위한 참고 관점을 제시한다.

실천적 차원에서 본 연구는 AI 기반 브랜드 디자인 도구와 상호작용 인터페이스 설계에 시사점을 제공한다. 인터페이스 설명가능성은 설명 정보의 단순한 극대화로 이해되어서는 안 되며, 사용자 경험 목표를 중심으로 설계되어야 한다. 즉, 단계적 제시나 필요 시 확장과 같은 방식으로 설명 정보를 구성함으로써 이해를 지원하는 동시에 과도한 인지적 부담을 유발하지 않도록 해야 한다. 또한 시각 생성 중심의 시스템에서는 설명가능성 설계가 인터페이스의 미학과 조화를 이루어, 이해를 보조하는 상호작용 요소로서 전체 디자인 경험에 자연스럽게 통합될 필요가 있다. 더불어 사용자 특성에 따라 설명 정보에 대한 이해와 선호가 달라질 수 있으므로, 향후 설계에서는 보다 유연한 설명 전략을 제공하는 방안도 고려할 수 있다.

한편, 본 연구는 인터페이스 설명가능성에 대한 새로운 논의를 제시하지만, 몇 가지 연구적 한계 역시 존재한다. 본 연구는 주로 설문 척도를 통해 사용자의 주관적 인식 평가를 수집하였으며, 상호작용 경험 차원에서의 이해, 감정, 태도에 초점을 두었다. 이러한 접근은 사용자 경험의 심리적 특성을 파악하는 데 유용하지만, 인지 부하나 주의 배분과 같은 과정적 특성을 정밀하게 포착하는 데에는 한계가 있다. 향후 연구에서는 시선 추적, 뇌파 측정 또는 기타 인지 부하 지표를 결합하여, 서로 다른 설명가능성 인터페이스 조건에서 사용자의 정보 처리 과정을 보다 세밀하게 분석함으로써 설명가능 상호작용 연구에 대한 다층적 증거를 제공할 수 있을 것이다. 또한 본 연구에서의 설명가능성은 주로 인터페이스 내 텍스트와 시각화 정보를 통해 구현되었으며, 설명 제시 방식 간 차이가 사용자 경험에 미치는 영향은 충분히 논의되지 못했다. 향후 연구에서는 설명 제시 형태를 보다 명확히 구분하여, 서로 다른 설명 매체가 사용자 이해, 신뢰 및 미학적 지각에 미치는 영향 메커니즘을 체계적으로 비교할 필요가 있다. 아울러 생성 결과의 스타일 차이가 보다 정교한 미학적 판단에서 수행하는 역할 역시 후속 연구에서 추가로 검토될 필요가 있다.

종합하면, 본 연구는 사용자 경험과 인간 컴퓨터 상호작용 관점에서 출발하여, 설명가능성 수준이 상이한 인터페이스의 비교 분석을 통해 관련 쟁점을 다층적으로 논의하였다. 전반적으로 본 연구는 AI 기반 창의적 디자인 응용에서 상호작용 인터페이스 설명가능성의 작동 방식을 이해하는 데 기초적 연구 참고를 제공하며, 지능형 디자인 도구의 인터페이스 최적화, 사용자 신뢰 구축 및 창의적 공동 창작 모델을 위한 새로운 사고의 방향을 제시한다.

Acknowledgments

이 논문은 2026년도 교육부 및 서울특별시의 재원으로 서울RISE센터의 지원으로 받아 수행된 지역혁신중심 대학지원체계(RISE) 사업의 결과물입니다. (2026-RISE-01-019-04)

This research was supported by the "Regional Innovation System & Education (RISE)" through the Seoul RISE Center, funded by the Ministry of Education (MOE) and the Seoul Metropolitan Government. (2026-RISE-01-019-04)

본 연구는 과학기술정보통신부 및 정보통신기획평가원의 정보통신방송혁신인재양성(가상융합대학원)사업 연구 결과로 수행되었음(IITP-2026-RS-2023-00254529)

This work was supported by Institute of Information & communications Technology Planning & Evaluation (IITP) under the virtual convergence support program to nurture the best talents(IITP-2026-RS-2023-00254529) grant funded by the Korea government(MSIT)

References

-

V. V. Burlakov, O. A. Dzyurdzya, G. V. Fedotova, A. H. Alieva, and E. N. Kravchenko, “The Modern Trends of Development of AI Technologies,” in Proceedings of the 13th International Scientific and Practical Conference on Artificial Intelligence Anthropogenic Nature vs. Social Origin, pp. 374-383, February 2020.

[https://doi.org/10.1007/978-3-030-39319-9_43]

-

H. H. Musaiqer and A. Hamdan, “The Role of Artificial Intelligence in Brand Building: A Review,” in Emerging Trends and Innovation in Business and Finance, Berlin, Germany: Springer Nature, pp. 307-318, 2023.

[https://doi.org/10.1007/978-981-99-6101-6_22]

-

M. Karaman, “Use of Artificial Intelligence Technologies in Visual Design,” Medeniyet Sanat Dergisi, Vol. 10, No. 2, pp. 121-138, 2024.

[https://doi.org/10.46641/medeniyetsanat.1525769]

-

G. Liu, H. Du, D. Niyato, J. Kang, Z. Xiong, D. I. Kim, and X. Shen, “Semantic Communications for Artificial Intelligence Generated Content (AIGC) Toward Effective Content Creation,” IEEE Network, Vol. 38, No. 5, pp. 295-303, 2024.

[https://doi.org/10.1109/MNET.2024.3352917]

-

J. Gual-Ortí, J. A. Martínez-Moya, J. Amat-Cózar, and F. Felip-Miralles, “The Future of Logo Design: Considering Generative AI-Assisted Designs,” The International Journal of Visual Design, Vol. 19, No. 1, pp. 109-123, 2025.

[https://doi.org/10.18848/2325-1581/CGP/v19i01/109-123]

-

L. Baonan, “Cultural Connotation and Artistic Expression of Logo Design,” Frontiers in Art Research, Vol. 6, No. 11, pp.99-103, 2024.

[https://doi.org/10.25236/FAR.2024.061115]

-

J. Kim and M. L. Maher, “The Effect of AI-Based Inspiration on Human Design Ideation,” International Journal of Design Creativity and Innovation, Vol. 11, No. 2, pp. 81-98, 2023.

[https://doi.org/10.1080/21650349.2023.2167124]

-

C. Di Dio, M. Ardizzi, S. V. Schieppati, D. Massaro, G. Gilli, V. Gallese, and A. Marchetti, “Art Made by Artificial Intelligence: The Effect of Authorship on Aesthetic Judgments,” Psychology of Aesthetics, Creativity, and the Arts, Vol. 19, No. 5, pp. 1164-1176, 2025.

[https://doi.org/10.1037/aca0000602]

- S. Song, Y. Zhao, and Q. Zhu, “From ELIZA to ChatGPT: AI-Generated Content (AIGC) Credibility Evaluation in Human-Intelligent Interactive Experience,” Information and Documentation Services, Vol. 44, No. 4, pp. 35-42, 2023.

-

D. Shin, “The Effects of Explainability and Causability on Perception, Trust, and Acceptance: Implications for Explainable AI,” International Journal of Human-Computer Studies, Vol. 146, 102551, 2021.

[https://doi.org/10.1016/j.ijhcs.2020.102551]

-

C. Ebermann, M. Selisky, and S. Weibelzahl, “Explainable AI: The Effect of Contradictory Decisions and Explanations on Users’ Acceptance of AI Systems,” International Journal of Human-Computer Interaction, Vol. 39, No. 9, pp. 1807-1826, 2023.

[https://doi.org/10.1080/10447318.2022.2126812]

-

J. McCormack, T. Gifford, and P. Hutchings, “Autonomy, Authenticity, Authorship and Intention in Computer Generated Art,” in Proceedings of the 8th International Conference on Computational Intelligence in Music, Sound, Art and Design, Leipzig: Germany, pp. 35-50, April 2019.

[https://doi.org/10.1007/978-3-030-16667-0_3]

-

Y. Li, “Application Research of AI Technology in Brand Design- A Case Study of Neochild Brand Visual Design,” Design, Vol. 9, No. 4, pp. 570-582, 2024.

[https://doi.org/10.12677/design.2024.94509]

-

T. Chen, B. Pang, C. Ma, and W. Shao, “Exploration of Brand Visual Communication Innovation Design Method Based on AIGC Technology,” Procedia Computer Science, Vol. 247, pp. 519-528, 2024.

[https://doi.org/10.1016/j.procs.2024.10.062]

-

J. Gual-Ortí, J. A. Martínez Moya, J. Amat, and F. Felip Miralles, “The Future of Logo Design: Considering Generative AI-Assisted Designs,” The International Journal of Visual Design, Vol. 19, No. 1, pp. 109-123, 2025.

[https://doi.org/10.18848/2325-1581/CGP/v19i01/109-123]

- K. L. Keller, Strategic Brand Management: Building, Measuring, and Managing Brand Equity, London, UK: Pearson, 2013.

-

M. Jia, Y. C. Zhao, and X. Zhang, “Will Potential Threats Persist? Attitudes and Behavioral Responses of Creative Professionals toward GenAI,” Information Research, Vol. 30, pp. 1073-1083, 2025.

[https://doi.org/10.47989/ir30iConf47098]

-

J. Zhu, A. Liapis, S. Risi, R. Bidarra, and G. M. Youngblood, “Explainable AI for Designers: A Human-Centered Perspective on Mixed-Initiative Co-Creation,” in Proceedings of the 2018 IEEE Conference on Computational Intelligence and Games (CIG), Maastricht: Netherlands, pp. 1-8, 2018.

[https://doi.org/10.1109/CIG.2018.8490433]

-

R. Confalonieri, L. Coba, B. Wagner, and T. R. Besold, “A Historical Perspective of Explainable Artificial Intelligence,” Wiley Interdisciplinary Reviews: Data Mining and Knowledge Discovery, Vol. 11, No. 1, e1391, 2021.

[https://doi.org/10.1002/widm.1391]

-

T. Nguyen, A. Canossa, and J. Zhu, “How Human-Centered Explainable AI Interfaces Are Designed and Evaluated: A Systematic Survey,” arXiv:2403.14496, , 2024.

[https://doi.org/10.48550/arXiv.2403.14496]

-

M. Eiband, H. Schneider, M. Bilandzic, J. Fazekas-Con, M. Haug, and H. Hussmann, “Bringing Transparency Design into Practice,” in Proceedings of the 23rd International Conference on Intelligent User Interfaces, Tokyo: Japan, pp. 211-223, March 2018.

[https://doi.org/10.1145/3172944.3172961]

-

J. Wei, Y. Hu, F. Zeng, and H. Tan, “Interpretability-Based Usability Study of Visual Alarm Messages: The Case of a Vital Signs Monitor,” in Proceedings of the 17th International Conference on Human–Computer Interaction, Gothenburg: Sweden, pp. 371-387, May 2025.

[https://doi.org/10.1007/978-3-031-93730-9_25]

-

B. Hookway, Interface, MIT Press, 2014.

[https://doi.org/10.7551/mitpress/9919.001.0001]

-

B. Shneiderman, “Bridging the Gap Between Ethics and Practice: Guidelines for Reliable, Safe, and Trustworthy Human-Centered AI Systems,” ACM Transactions on Interactive Intelligent Systems (TiiS), Vol. 10, No. 4, pp. 1-31, 2020.

[https://doi.org/10.1145/3419764]

-

V. Arya, R. K. E. Bellamy, P.-Y. Chen, A. Dhurandhar, M. Hind, S. C. Hoffman, ... and Y. Zhang, “One Explanation Does Not Fit All: A Toolkit and Taxonomy of AI Explainability Techniques,” arXiv:1909.03012, , 2019.

[https://doi.org/10.48550/arXiv.1909.03012]

-

M. Günay, “Artificial Intelligence and Originality in Design,” ART/icle: Sanat ve Tasarım Dergisi, Vol. 4, No. 3, pp. 449-469, 2024.

[https://doi.org/10.56590/stdarticle.1548924]

-

V. Hassija, V. Chamola, A. Mahapatra, A. Singal, D. Goel, K. Huang, ... and A. Hussain, “Interpreting Black-Box Models: A Review on Explainable Artificial Intelligence,” Cognitive Computation, Vol. 16, No. 1, pp. 45-74, 2024.

[https://doi.org/10.1007/s12559-023-10179-8]

-

Q. V. Liao, D. Gruen, and S. Miller, “Questioning the AI: Informing Design Practices for Explainable AI User Experiences,” in Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, Honolulu: HI, pp. 1-15, April 2020.

[https://doi.org/10.1145/3313831.3376590]

-

M. Mersha, K. Lam, J. Wood, A. K. AlShami, and J. Kalita, “Explainable Artificial Intelligence: A Survey of Needs, Techniques, Applications, and Future Direction,” Neurocomputing, Vol. 599, 128111, 2024.

[https://doi.org/10.1016/j.neucom.2024.128111]

-

H. V. Subramanian, C. Canfield, and D. B. Shank, “Designing Explainable AI to Improve Human-AI Team Performance: A Medical Stakeholder-Driven Scoping Review,” Artificial Intelligence in Medicine, Vol. 149, 102780, 2024.

[https://doi.org/10.1016/j.artmed.2024.102780]

-

R. Nimmo, M. Constantinides, K. Zhou, D. Quercia, and S. Stumpf, “User Characteristics in Explainable AI: The Rabbit Hole of Personalization?” in Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems, Honolulu: HI, pp. 1-13, May 2024.

[https://doi.org/10.1145/3613904.3642352]

-

B. R. Lee, “Case Study of AI-Generated Logo Design: Focusing on Design Thinking Museum Logo Design,” Journal of Business Convergence, Vol. 8, No. 5, pp. 85-92, 2023.

[https://doi.org/10.31152/JB.2023.10.8.5.85]

-

S. R. Sindiramutty, K. R. V. Prabagaran, R. Akbar, M. Hussainand, and N. A. Malik, “Generative AI for Secure User Interface (UI) Design,” Reshaping CyberSecurity with Generative AI Techniques, pp. 333-394, 2025.

[https://doi.org/10.4018/979-8-3693-5415-5.ch010]

저자소개

2024년:명지대학교 (시각디자인학과 학사)

2024년~현 재: 세종대학교 일반대학원 디자인이노베이션학과 석사

※관심분야:교호 인터페이스, UI&UX, 시각디자인, 브랜드 디자인 등

2018년~현 재: 세종대학교 창의소프트학부 디자인이노베이션 전공 부교수

※관심분야:가상현실(VR), 확장현실(XR), 증강현실(AR), UI&UX, 브랜드 디자인 등