산업제어시스템의 안정성 향상을 위한 어텐션 기반 RNN 오토인코더 이상 탐지 기법

Copyright ⓒ 2026 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

산업 제어 시스템에서는 센서들 간의 복잡한 상호작용을 가지고 있어 단일 장애가 연쇄적인 이상으로 발생하기 쉽기 때문에 이상 징후를 초기에 발견할 수 있는 이상 탐지 기술이 필수적이다. 따라서 본 연구는 SWaT 데이터세트를 활용하여, 표준 순환 신경망 오토인코더와 여기에 어텐션 메커니즘을 추가한 RNN-AE(Recurrent Neural Network Autoencoder)의 이상 탐지 성능을 비교하였다. 또한 재구성 오류를 세 가지(Max, Mean, Top-3) 방식으로 집계하여 이상 점수의 계산이 성능에 미치는 영향을 분석하였다. 실험 결과, 어텐션 기반 GRU(Gated Recurrent Unit)-AE에 Max 집계 방식을 결합한 경우가 기준선 대비 Precision, Recall, F1-Score를 각각 0.3134, 0.0305, 0.1475만큼 향상시켜 탐지 오류를 줄였다. 이를 통해 제안한 방식이 이상 탐지의 민감도와 시스템의 실질적인 운영 안정성을 동시에 향상시킬 수 있음을 확인하였다.

Abstract

In industrial control systems, the complex interactions among sensors can lead to a single fault developing into cascading anomalies. Therefore, anomaly detection techniques capable of identifying early warning signs at an early stage are essential. This study used Secure Water Treatment (SWaT) dataset to compare the anomaly detection performance of a standard Recurrent Neural Network Autoencoder (RNN-AE) with that of an RNN-AE augmented with an attention mechanism. We also analyzed how accumulating reconstruction errors using three strategies (Max, Mean, and Top-3) affects anomaly score computation. In experimental results, combining an Attention-based Gated Recurrent Unit (GRU) Autoencoder with the Max aggregation strategy improved precision, recall, and F1-Score by 0.3134, 0.0305 and 0.1475, respectively, compared with the baseline, thereby reducing dectection errors. These findings confirm that the proposed method can simultaneously enhance the sensitivity of anomaly detection and practical operational stability of the system.

Keywords:

Attention Mechanism, Anomaly Detection, Autoencoder, Industrial Control Systems, Multivariate Time Series키워드:

어텐션 메커니즘, 이상 탐지, 오토인코더, 산업 제어 시스템, 다변량 시계열Ⅰ. 서 론

현대 산업 제어 시스템은 에너지·제조 설비 등 다양한 시설의 공정을 자동화하기 위해 여러 종류의 센서들이 결합되어 있는 복잡한 구조를 이루고 있다. 이러한 구조의 시스템은 공정 단계에서 각 센서 간의 상호 의존성이 높아 하나의 센서에서 이상이 발생했을 경우, 연쇄적으로 장애가 전파되기 쉽고 여러 센서 계층 전반에 걸친 대규모 다변량 시계열 데이터가 생성된다. 따라서 이러한 복잡한 시스템 환경에서 발생하는 이상 징후를 초기에 정확하게 탐지하는 이상 탐지 기술이 필수적이다[1].

산업 제어 시스템에서 정상 상태의 데이터는 비정상적인 데이터보다 압도적으로 많은 비율을 차지한다. 그리고 모든 이상 상태의 유형을 사전에 정의하기 어렵고, 각 이상 상태를 수동으로 라벨링하는 작업에도 매우 높은 비용이 발생한다. 따라서, 라벨이 없는 정상 데이터의 패턴만을 학습하여 정상 패턴에서 벗어나는 값을 이상으로 판단하는 비지도 학습이 주목받고 있다[2].

특히 순환 신경망(RNN; Recurrent Neural Network)의 한 종류인 GRU(Gated Recurrent Unit)와 LSTM(Long Short-Term Memory)을 오토인코더(AE; AutoEncoder)모델에 접목하는 방식은 데이터의 시간적 의존성과 순차적 패턴을 효과적으로 학습할 수 있어, 우수한 이상 탐지 성능을 보여준다. 그러나 순환 신경망 오토인코더 모델은 인코더(Encoder)에서 입력 시퀀스(Sequence)의 모든 정보를 하나의 잠재 벡터로 압축하는 구조를 가지므로, 입력 시퀀스 길이가 길어질수록 시퀀스 초반의 중요한 정보가 소실될 수 있다. 또한, 시퀀스 내 모든 시점의 정보를 동일한 중요도로 취급하는 구조적 한계를 가진다. 이로 인해 탐지에 단서가 되는 특정 센서에서 발생하는 스파이크성 이상 징후나, 여러 센서에서 나타나는 미세한 패턴 변화를 놓칠 수 있는 한계를 가진다.

본 연구에서는 이러한 한계를 극복하기 위해, 인코더-디코더(Decoder) 구조에 시점 어텐션(Att; Attention) 메커니즘을 도입하였다. 어텐션은 인코더에서 나온 전체 시점의 은닉 상태를 입력으로 받아 학습된 가중치로 가중 평균 계산을 통해 하나의 컨텍스트 벡터(Context Vector)를 생성한다. 하나의 컨텍스트 벡터로 요약함으로써, 단순히 마지막 은닉 상태 하나만 사용하는 것보다 의미 있는 정보를 더 잘 보존한다.

또한, 딥러닝 모델의 최종 성능이 모델 구조뿐 아니라 후처리 방식을 통해서 향상될 수 있다는 것을 확인하고자 한다. 기존의 연구는 입력과 재구성 차이의 평균 제곱 오차(MSE; Mean Squared Error)나 평균 절대 오차(MAE; Mean Absolute Error)와 같은 값을 이상 점수로 쓰는 것이 일반적이다[3]. 하지만, 이러한 방식들은 노이즈가 많은 환경에서 단일 재구성 오류만으로는 정상과 이상의 구분도가 떨어지는 한계가 있다[4]. 따라서 스파이크형 이상뿐만 아니라 여러 센서에 걸쳐 누적되는 분산형 이상에도 민감한 방식을 설계한다. 구체적으로 시간 축에서 최대값과 95% 분위수를 활용해 재구성 오류를 계산한 후, 이 값을 전체 평균, 최대값, 상위 3개의 평균 중 하나로 집계하여 최종 이상 점수를 정의한다. 그리고 이상 판단 기준선을 설정하여 산업 제어 시스템의 이상 탐지 성능을 향상시키는 것을 목표로 한다. 이를 위해 두 가지 관점에서 비교 분석을 수행한다. 첫 번째, 모델 관점에서는 기존의 순환 신경망 오토인코더와 어텐션 기반 순환 신경망 오토인코더의 성능을 비교한다. 두 번째, 재구성 오류를 이상 점수로 변환하는 후처리 방식이 각 모델 성능에 미치는 영향을 비교·분석한다. 최종적으로 논문에서 제안한 방식의 Recall이 약 5% 증가하여 미탐(FN)을 줄였으며, Precision 또한 개선되어 정상 구간의 오탐(FP)을 완화하였다. 이는 시스템 안정성 향상에 기여할 수 있음을 시사한다.

Ⅱ. 이론적 배경 및 관련 연구

본 장에서는 연구의 기반 모델인 오토인코더와 LSTM, GRU를 소개하고, 오토인코더의 활용과 어텐션 메커니즘의 효과에 대한 관련 연구를 살펴보고자 한다.

2-1 이론적 배경

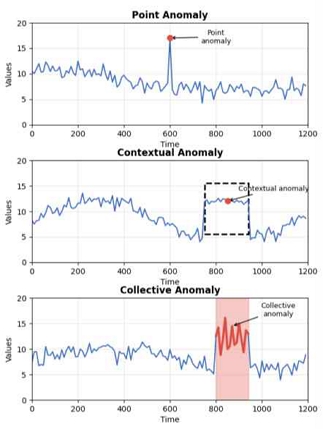

산업 제어 시스템의 안정적인 운영을 위해서는 정상 데이터에서 벗어나는 이상 신호를 잘 찾아내는 것이 중요하다. 이러한 이상 신호는 다양한 형태로 나타날 수 있으며, 특성에 따라 그림 1과 같이 크게 세 가지 유형으로 분류할 수 있다[5].

• 포인트 이상(Point Anomaly)

시스템의 정상적인 데이터 분포를 고려했을 때, 다른 정상 데이터와 극명한 차이를 보이는 단일 데이터 포인트를 의미한다. 예시로, 특정 센서의 물리적 고장으로 인해 수위 값이 갑자기 최대치를 보이는 경우가 있다.

• 상황적 이상(Contextual Anomaly)

데이터 포인트 값은 정상 범위 내에 존재하지만, 특정 시간이나 해당 데이터의 문맥을 고려했을 때 비정상적인 경우를 의미한다. 예시로, 1번 물탱크가 채워지는 과정에서 펌프가 작동하는 것은 정상이지만, 물탱크가 다 채워진 후에 펌프가 작동하는 등의 비정상적인 패턴이 있다.

• 집단 이상(Collective Anomaly)

개별 데이터 포인트는 정상으로 보일 수 있으나 연속된 데이터 포인트들이 집단을 이루어 전체적인 패턴에서 벗어나는 경우이다. 예시로, A 펌프의 유량이 미세하게 감소하고 이와 관련된 B 탱크의 수위 상승 속도가 느려지며 C 밸브의 개폐 빈도가 증가하는 등 개별적으로 봤을 땐 사소해 보이는 변화가 여러 센서에서 연쇄적으로 동시에 발생하는 경우 연쇄 장애의 초기 신호일 수 있다.

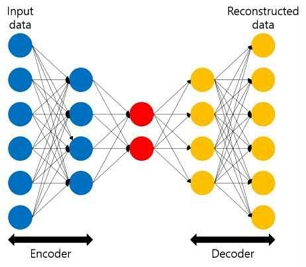

• 오토인코더(AutoEncoder)

오토인코더는 비지도 학습에서 주로 사용되는 모델로, 그림 2와 같이 데이터를 압축하는 인코더와 압축된 표현을 원본으로 복원하는 디코더로 구성된 대칭 구조를 가진다[6]. 일반적으로 정상 데이터를 이용하여 학습되며, 입력과 출력간의 차이인 재구성 오류를 최소화하는 방향으로 훈련된다. 이 과정에서 모델은 정상 패턴을 재구성하는 데 필요한 정보를 보존하는 잠재 벡터를 학습한다.

이러한 특성으로 인해 학습된 모델에 정상 데이터가 입력으로 들어가면 낮은 재구성 오류값이 나타나고, 이상 데이터를 입력하면 원본으로 복원하지 못해 재구성 오류값이 높게 나타난다. 이 재구성 오류값을 이상 점수로 활용하는 방식을 통해서 오토인코더를 이상 탐지 모델로 활용한다. 하지만, 이러한 방식은 데이터의 시간적 순서나 연속성이 중요한 시계열 데이터의 장기적인 패턴을 학습하지 못하는 한계가 있다.

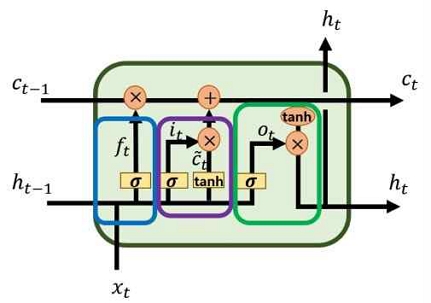

• LSTM(Long Short-Term Memory)

LSTM은 그림 3과 같이 순환 신경망의 발전된 형태로, 긴 시퀀스에서 과거의 중요한 정보가 소실되는 장기 의존성 문제를 해결하기 위해 설계되었다. 메모리 셀과 망각·입력∙출력 게이트를 가지고 있어 이전 정보를 얼마나 보존∙사용∙출력할 지를 결정한다. 다음 수식을 통해 상세히 설명된다[7].

먼저 식 (1)의 망각 게이트(ft)는 이전 시점의 장기 기억(ct-1)에서 어떤 정보를 잊어버릴지 결정한다. xt는 시간 t의 입력 벡터, ht-1은 직전 시간의 은닉 상태, Wxhf는 입력에서 망각 게이트로 갈 때 사용하는 가중치, Whhf는 이전 은닉에서 망각 게이트로 가는 가중치, bhf는 망각 게이트의 바이어스를 의미한다. σ는 시그모이드 함수로 각 원소를 (0,1) 범위로 게이트 값을 만든다.

| (1) |

이후 식 (2)의 입력 게이트(it)는 현재 시점의 새 후보 정보() 중 어떤 정보를 사용할지 결정하고 식 (3)은 식 (4)의 셀 상태(ct)에 업데이트할 때 추가될 후보 기억을 생성한다.

| (2) |

| (3) |

식 (4)는 망각 및 입력 게이트를 통해 이전 정보(ct-1)의 일부를 보존하고, 새로운 정보를 일부 더하면서 현재 시점의 셀 상태(ct)를 업데이트한다.

| (4) |

마지막으로 식 (5)의 출력 게이트(ot)는 방금 업데이트된 장기 기억(ct)에서 현재 시점에 필요한 정보만 선택하여 식 (6)과 같이 다음 시점으로 전달된 단기 기억(ht)을 만든다.

| (5) |

| (6) |

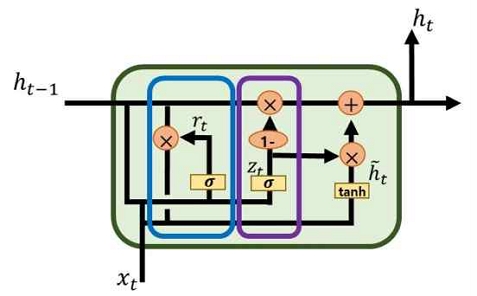

• GRU(Gated Recurrent Unit)

GRU는 그림 4에 나타난 바와 같이 LSTM의 구조를 간단하게 개선한 모델로, 망각 게이트와 입력 게이트를 업데이트 게이트(zt)로 통합하고 출력 게이트를 제거하였다. 그리고 과거 은닉 정보(ht-1)를 얼마나 반영할지 정하는 리셋 게이트(rt)를 도입하였다. 이러한 변화로 인하여 LSTM에 대비 빠른 학습 시간과 낮은 계산 복잡성을 가지고 있다[8].

먼저 식 (7)의 리셋 게이트는 이전 시점의 정보(ht-1) 중 현재 상태를 업데이트하는 데 불필요한 부분을 결정하여 제거하는 역할을 한다.

| (7) |

이후 식 (8)의 업데이트 게이트는 이전 은닉 상태를 얼마나 유지하고 새로 계산된 정보를 얼마나 반영할지를 조절하는 게이트이다.

| (8) |

이 두 게이트를 통해 최종적으로 계산되는 현재 시점의 은닉 상태(ht)는 식 (9)과 식 (10)에서 보이는 바와 같이 과거와 현재의 정보를 가중 결합하여 다음 시점으로 전달된다. 는 시간 t의 후보 은닉 상태이다.

| (9) |

| (10) |

이러한 구조를 통해 GRU는 긴 시계열 데이터에서도 중요한 패턴을 선택적으로 기억하고 학습할 수 있다[9]. 그러나 RNN 계열 모델들은 데이터를 순차적으로 처리하는 구조를 가지고 있어 병렬 처리가 어렵다. 이후 Transformer가 등장하여 어텐션 메커니즘을 활용해 병렬 처리가 가능해졌으며 긴 시퀀스 내에서도 중요한 정보를 잘 보존하여 다양한 과제에서 우수한 성능을 보여주고 있다.

2-2 관련 연구

산업 제어 시스템은 물리적으로 분산되어 있으나, 대부분의 설비가 네트워크를 통해 연결되어 있어 사이버 공격이나 내부적인 작동 이상으로 인한 장애 발생 시 치명적인 영향을 받을 수 있다. 따라서 시스템 운영 데이터를 실시간으로 분석하여 이상 징후를 탐지하려는 연구가 수행되고 있다.

재구성 오류 기반 이상 탐지 연구에 있어서, 정상 데이터만을 사용하여 정상 패턴을 학습하고 입력과 출력의 차이를 기반으로 이상을 판단하는 오토인코더가 주로 사용된다. 시계열 데이터의 시간적 연속성 및 장기적인 패턴을 탐지하기 위해, 오토인코더에 순환 신경망을 결합한 모델들이 제안되었다[10]-[12].

또한, 데이터의 복잡한 분포를 정교하게 학습하기 위해 생성형 모델을 활용한 연구가 있다. Zeng et al.은 산업용 사물 인터넷 환경의 다변량 시계열 데이터를 위해 EvoAAE(Evolutionary Adversarial Autoencoder)라는 자동화된 비지도 이상 탐지 프레임워크를 제안하였다. 이 방법은 GAN의 적대적 학습 방식을 활용하여 VAE(Variational Autoencoder)의 잠재 공간을 사전 분포에 가깝게 정렬하고, 입자 군집 최적화를 활용해 하이퍼파라미터와 신경망 구조를 자동 탐색함으로써 IIoT(Industrial Internet of Things) 전반에 적용 가능한 이상 탐지 모델을 구축한다[13].

또 다른 연구에서는 시계열의 순차적 의존성을 반영하기 위하여 RNN을 결합하는 모델을 제안하였다. S. Narmadha et al.은 네트워크 침입 탐지 분야에서 최적화된 PSO-AutoEncoder-LSTM이라는 하이브리드 모델을 개발하였다. 여기서 오토인코더는 차원 축소 및 핵심 특징 추출과 동시에 정상 데이터만 학습하여 클래스 불균형 문제를 완화하고 인코더에서 얻은 잠재 특징을 LSTM의 입력으로 사용하여 트래픽의 시간적 패턴을 학습한 뒤 정상/이상 여부를 지도 학습 방식으로 분류한다[14].

또한, 시계열 데이터의 주기적 특성을 반영하기 위해 Porcelli et al.은 계절성 시계열 데이터의 실시간 이상 탐지를 위해 RTAD-CVAE(Real-Time Anomaly Detection with Conditional Variational Autoencoder)을 제안하였다. 이 모델은 조건부 VAE를 활용하여 요일이나 시간대와 같은 계절적 컨텍스트를 조건으로 받아 슬라이딩 윈도우 방식에 의존하지 않고, 전체 계절 주기에 대한 예상 정상 패턴을 더 효율적으로 생성한 후, 실시간으로 유입되는 관측값과의 차이를 통해 이상을 탐지한다[15].

본 연구에서는 위 연구들과 달리 단순한 어텐션 기반 RNN-AE를 사용하고 재구성 오류 집계 방식을 통해 이상 탐지 성능을 향상 시킬 수 있음을 분석하였다.

긴 시퀀스 데이터에서 발생하는 정보 소실 문제를 해결하고 이상 징후가 나타나는 특정 시점의 중요도를 강조하기 위해 어텐션 메커니즘을 적용하는 연구가 주목받고 있다.

Macas et al.은 센서 간의 상호 관계를 나타내는 상관 행렬을 생성하여 CNN(Convolutional Neural Network) 인코더를 통해 상관 행렬의 공간적 패턴을 학습하고 어텐션 기반의 ConvLSTM 오토인코더를 통해 시간적 의존성을 학습하였다. 입력 어텐션 메커니즘을 추가하여 모델이 각 시점에서 가장 관련 높은 입력 특징을 선택함으로써 기존의 LSTM-AE 모델보다 더 높은 성능을 보여주었다[16].

Al Olaimat and Bozdag은 순환 신경망 오토인코더를 기반으로 이중 레벨 어텐션을 제안하였다. 이러한 메커니즘은 단순히 시점 정보만 고려하는 것이 아니라, 시점 간의 시간적 중요도를 평가하는 방문 레벨 어텐션과 각 시점의 특징 중요도를 평가하는 특징 레벨 어텐션 2가지로 구성된다. 성능 제거 연구를 통해 어텐션을 제거한 모델이 모든 상황에서 성능이 감소하는 것을 입증하였다[17].

Shi et al.은 다변량 시계열 이상 탐지를 위해 어텐션 메커니즘과 VAE를 결합한 모델을 제안하였다. GCN(Graph Convolutional Network)을 통해 피처 간의 상관관계를 학습하고, LSTM 기반 어텐션 모듈을 사용하여 각 시간 윈도우 내의 서로 다른 피처들이 이상 탐지에 얼마나 영향을 주는지에 주목하였다[18].

Ⅲ. 방법론

본 실험은 시계열 데이터의 이상 탐지를 위해 순환 신경망 기반의 오토인코더(RNN-AE) 아키텍처를 제안한다. 순환 신경망은 LSTM과 GRU를 사용하며 어텐션 모듈의 유무와 재구성 오류를 이상 점수로 변환하는 후처리 집계 방식이 모델 성능에 미치는 영향을 비교한다.

3-1 모델 아키텍처

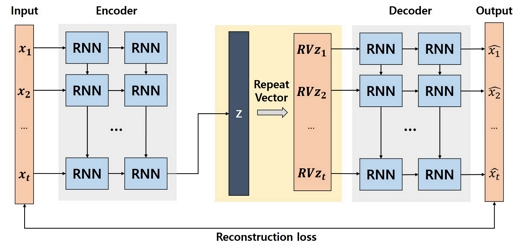

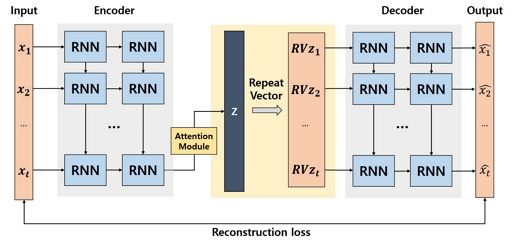

모델은 인코더-디코더 구조를 기반으로 하며 본 연구에서는 그림 5의 RNN-AE와 그림 6의 어텐션 기반 RNN-AE를 비교한다. 두 모델 모두 GRU와 LSTM 모델을 사용하여 총 4개의 아키텍처(GRU-AE, LSTM-AE, GRU-AE + Att, LSTM-AE + Att)를 구성한다.

순환 신경망 오토인코더는 정보 병목 구조를 가지는데 그림 5와 같이 인코더가 전체 입력 시퀀스의 정보를 압축하여 잠재 벡터(z)를 생성한다. 디코더는 이 z를 전달받아 원래 시퀀스를 복원하도록 학습된다. z는 정상 패턴의 요약 역할을 하며, 디코더는 z 정보에만 의존하여 전체 시퀀스를 생성한다. 본 연구에서 사용된 모델의 상세한 구조는 다음과 같다[19].

• 인코더(Encoder)

2개의 순환 신경망 레이어로 구성되며 입력 전체 시퀀스는 인코더를 거쳐 각 시점의 은닉 상태를 계산한다. 그리고 인코더의 최상위 레이어의 마지막 시점 은닉 상태를 잠재 벡터로 정의한다.

• 잠재 벡터(Latent Vector, z)

시퀀스 정보를 압축한 표현으로 RNN 특성상 시간이 지날수록 정보가 누적되므로 마지막 시점의 은닉 상태에는 과거의 정보를 잘 요약 되어있다. 다만 긴 시퀀스에서는 초기 정보가 희석될 수 있다.

• 디코더(Decoder)

디코더는 인코더와 동일하게 2개의 순환 신경망 레이어로 구성된다. z를 시퀀스 길이만큼 복제하여 디코더의 입력으로 사용하고 디코더 RNN은 각 시점의 은닉 상태를 생성한다. 그리고 이 은닉 상태에 시점별로 공유되는 선형층을 적용해 원래 시퀀스로 복원한다.

순환 신경망 기반 오토인코더의 정보 병목의 문제점을 해결하고자 그림 6과 같이 설계된 모델이다. 이 모델은 인코더의 마지막 시점의 정보만 사용하여 잠재 벡터를 만드는 대신 필요한 시점에는 큰 가중치, 덜 필요한 시점에는 작은 가중치를 부여하여 가중합으로 하나의 잠재 벡터를 생성한다.

• 어텐션 모듈(Attention Module)

인코더의 모든 시점 출력을 입력으로 받아 시점별 중요도를 계산하고, 이를 이용해 가중합 잠재 벡터를 생성한다. 이렇게 얻은 잠재 벡터를 시퀀스 길이만큼 복제하여 디코더의 입력으로 사용한다.

3-2 이상 점수 계산

원시 데이터는 시간에 따라 수집된 센서 값 행렬로, 각 행은 시간 스텝, 열은 센서를 의미한다. 본 연구에서는 연속된 T개의 시간 스텝을 하나의 윈도우로 묶어 이상 점수를 계산한다. 시퀀스 인덱스를 , 센서 인덱스를 라고 할 때, 시퀀스 w는 T × D 크기의 행렬로 표현한다. 최종 이상 점수는 각 시퀀스 w에 대해 다음과 같은 2단계 과정을 통해 계산된다. 1단계에서는 시간 축을 먼저 요약하여 센서별 오류 벡터를 만들고 2단계에서 센서 축을 집계하여 시퀀스 단위의 스칼라 이상 점수를 생성한다.

먼저 시퀀스 w 안에서 발생한 이상 징후를 잘 탐지하기 위해 각 시간 t, 센서 i에 대해 절대 재구성 오류 ew,t,i를 구한다. 절대 재구성 오류는 식 (11)을 통해 계산한다.

| (11) |

이후 센서 i에 대해 시퀀스 길이 T동안의 오류 값 중에서 최대 값과 상위 95% 분위수 값을 구하고, 두 값을 평균하여 식 (12)와 같이 센서 i의 대표 오류값 ew,i를 정의한다.

| (12) |

이렇게 얻은 벡터 는 시퀀스 w에 대해 각 센서 별로 윈도우 내에서 얼마나 이상했는지를 나타내는 대표 오류 벡터이다. 이 과정은 윈도우 내부에서 잠깐 발생하는 스파이크성 이상도 최종 오류값에 반영할 수 있다.

1단계에서 계산된 대표 오류 벡터 ew를 전달받아 다음 3가지 피처축 집계 방식을 사용하여 시퀀스의 이상 점수를 계산하고 성능을 비교한다. 각 집계 방식의 식 (13)-식 (15)와 같다.

• Mean 집계

시퀀스 w에서 모든 센서 오류를 평균내서 넓게 퍼진 이상을 탐지한다. 이 방식은 전반적인 시스템의 불안정성이나 여러 센서에서 연쇄적으로 미세하게 발생하는 이상을 탐지할 수 있다.

| (13) |

• Max 집계

시퀀스 w에서 오류가 가장 큰 센서 하나만을 기준으로 이상 점수를 계산한다. 이 집계 방식은 하나의 센서에서라도 확실한 이상 징후가 발생하면 바로 탐지할 수 있다.

| (14) |

• Top-3 집계

시퀀스 w에서 오류값 ew,i를 내림차순으로 정렬했을 때, 가장 큰 세 개의 센서만을 선택하여 그 평균을 이상 점수로 사용한다. 선택된 센서 인덱스 집합을 I3(w)이라고 한다. 이 방식은 여러 센서에서 동시에 나타나는 의미 있는 이상 패턴을 강조하는 데 적합하다.

| (15) |

3-3 모델 학습

4개 모델의 학습에는 평균 제곱 오차(MSE), 평균 절대 오차(MAE)를 결합한 형태인 식 (16)을 사용한다. 이 수식은 MSE의 큰 오차에 민감한 특성과 MAE의 이상치에 덜 민감한 특성을 활용하여 큰 오차를 줄이면서 전반적인 오차에 대한 민감도는 낮춰 모델이 정상 데이터의 패턴을 더 잘 학습하도록 도와준다. pred는 예측값, target은 정답값을 의미한다.

| (16) |

본 연구에서 제안하는 어텐션 기반 순환 신경망 오토인코더 이상 탐지 과정은 그림 6과 같이 요약되며, 구체적인 과정은 다음과 같이 구성된다.

• RNN-AE 학습

생성된 시퀀스를 입력으로 GRU-AE, LSTM-AE와 각 모델에 어텐션 모듈을 추가한 4가지 모델을 학습한다. 인코더는 GRU/LSTM 계층으로 잠재 벡터를 생성하고, 디코더는 이 벡터를 다시 시퀀스로 복원한다.

• 재구성 오류 계산 및 시간 축 요약

시계열 길이 T=20인 슬라이딩 윈도우로 분할하여 “20개 시점 × 센서 개수” 형태의 시퀀스를 생성한다. 각 시퀀스를 학습된 모델에 입력하여 시점별∙센서별 재구성 값을 얻고 실제 값과의 차이로 재구성 오류를 계산한다. 한 윈도우 내부에서 발생하는 스파이크성 이상을 보존하기 위해 센서별로 시간 축에 대해 최대값과 95% 분위수 오류를 계산하고 두 값을 평균하여 센서별 대표 오류 벡터를 얻는다.

• 피처 축 집계 및 이상 판정

센서별 대표 오류 벡터를 하나의 스칼라 이상 점수로 변환하기 위해 Mean, Max, Top-3 방식을 적용한다. 윈도우별로 얻어진 이상 점수와 정답값을 이용해 Fβ가 최대가 되는 임계값을 선택한 후, 해당 임계값을 기준으로 이상과 정상을 판단한다.

Ⅳ. 실험 및 결과

4-1 데이터세트 소개 및 실험 설정

모델의 성능 검증을 위해 실제 정수처리 공정을 모사한 산업 제어 시스템 데이터세트인 SWaT(Secure Water Treatment)을 사용하였다. SWaT은 11일간 51개의 피처에 대해 DoS, Sensor spoofing 등 36종의 공격을 기록하며 수작업 라벨링을 하였고 비지도 학습에 특화된 데이터세트이다[20].

본 실험에서는 정상 상태만으로 구성된 학습 데이터와 이상 및 정상 상태가 모두 포함된 테스트 데이터로 나누었고 테스트 데이터에만 존재하는 정답 라벨은 최종 성능 평가를 위해 따로 저장하였다. LSTM-AE와 GRU-AE 모델 모두 NVIDIA A100(40GB) 환경에서 실험을 진행하였으며, 동일한 하이퍼파라미터 설정(Time Steps는 20, Batch Size는 256, Epochs는 100, 학습률은 0.0005)으로 학습을 진행하였다. 그리고 산업 제어 시스템 환경에서는 이상 징후를 놓치는 경우가 정상 구간을 오탐지하는 경우보다 비용이 훨씬 크므로, Recall을 우선시하는 임계값 설정이 필요하다. 따라서 본 실험에서는 식 (17)로 정의되는 Fβ가 최대가 되는 지점으로 임계값을 선택하였고 β는 2로 설정하였다[21].

| (17) |

4-2 평가 지표 및 실험 결과

모델의 성능은 정밀도, 재현율, F1-Score를 사용하여 정량적으로 평가한다. 각 지표의 식은 식 (18)-식 (20)와 같다. 여기서 TP는 True Positive, FP는 False Positive, FN은 False Negative를 의미한다.

• 정밀도(Precision)

모델이 이상으로 예측한 것 중 실제 이상의 비율이다.

| (18) |

• 재현율(Recall)

실제 이상 중에서 모델이 이상으로 올바르게 예측한 비율이다.

| (19) |

• F1-점수(F1-Score)

정밀도와 재현율의 조화 평균으로, 두 지표가 모두 중요할 때 사용한다.

| (20) |

성능 향상을 검증하기 위해 LSTM과 GRU 모델에 어텐션 메커니즘을 추가하는 방법과 3가지 후처리 집계 방식을 적용하여 총 12개 모델을 비교하였다. Att가 기입된 모델은 인코더 출력 전 구간에 어텐션 모듈을 추가한 것이다. Max, Mean, Top-3는 3장에서 정의한 3가지 재구성 오류 집계 방식을 적용한 모델을 의미한다.

표 1에서 GRU-AE(Mean)를 기준선으로 놓고 Max 방식의 성능을 비교했을 때 F1-Score가 0.6250에서 0.7321로 약 0.107 향상된다. 이는 SWaT 데이터세트의 이상이 특정 센서에서 짧은 구간 동안 급격히 튀는 포인트 이상 유형에 가깝기 때문이다. 따라서 시퀀스 내 모든 센서의 오류를 평균 계산하여 이상 값이 정상값에 의해 희석되는 Mean 방식보다 정상값에서 벗어난 센서 하나만을 이상 점수로 사용하는 Max 방식이 이상 구간을 더 뚜렷하게 분리하기 때문으로 해석될 수 있다. 이는 모델의 구조를 수정하지 않더라도 재구성 오류를 집계하는 방식의 차이만으로도 성능에 영향을 줄 수 있음을 보여준다.

그리고 어텐션 모듈을 추가하였을 때, 표 1에서 보듯이 GRU/LSTM 모두에서 Mean, Max, Top-3 모든 집계 방식에 대해 F1-Score가 일관되게 증가하였다. 예를 들어 GRU-AE(Mean)의 F1-Score 0.6250이 GRU-AE+Att(Mean)에서 0.7513으로 향상된다. 이는 기존 오토인코더가 인코더의 마지막 시점 은닉 상태만을 사용해 전체 윈도우를 요약하는 반면, 제안한 구조는 어텐션을 통해 윈도우 내부에서 이상 징후가 나타나는 시점의 은닉 상태에 더 높은 가중치를 부여하기 때문에 이상 구간에서 더 큰 오차를 내도록 학습하기 때문으로 분석된다.

3가지 집계 방식을 비교하면, GRU/LSTM 모델 대부분의 Max와 Top-3방식이 Mean 방식보다 높은 F1-Score를 보이며, 특히 GRU 모델에서 이 경향이 두드러진다. 그중 GRU-AE+Att(Max)이 F1-Score에서 0.7725로 12가지의 실험 결과 중 가장 높은 성능을 보였다. SWaT와 같이 소수 센서에서 급격한 변화로 나타나는 환경에서는 시간축에서 이상 시점을 강조하는 어텐션, 피처축에서 가장 큰 센서 오류를 그대로 사용하는 Max 집계의 조합이 이상을 탐지하는 데 가장 적합하다는 것을 의미한다. 또한, LSTM보다 GRU에서 더 높은 F1-Score를 보이는 것은 본 연구와 같이 윈도우 길이가 짧고 모델 복잡도가 낮은 설정에서는 GRU가 더 적합할 수 있음을 시사한다.

Max 집계 방식은 모든 센서의 오류값 중 가장 큰 값을 이상 점수로 선택한다. SWaT 데이터세트는 주로 포인트 이상 특성을 가지기 때문에 Max 집계에서 효과적인 것으로 분석된다. 이에 따라 모델의 재구성 오류 결과값을 해석하는 방식에 따라 최종 이상 탐지의 성능도 변화한다는 것을 확인하였다.

마지막으로 표 1에서 가장 높은 F1-Score를 기록한 GRU-AE+Att(Max)은 기준선인 GRU-AE(Mean)과 비교하여, Recall이 0.6268에서 0.6573으로 향상되면서도, Precision은 0.6233에서 0.9367로 크게 증가하였다. 이는 제안하는 방법이 이상 누락을 줄이면서 정상 구간을 이상으로 오탐지하는 비율을 낮췄음을 의미하며 불필요한 경보가 시스템 운영자에게 큰 부담이 되는 산업 제어 시스템 환경에서 운영 안정성을 높이는 데 기여할 수 있다.

Ⅴ. 결 론

본 연구에서는 에너지∙제조 설비 등으로 구성된 산업 제어 시스템에서 장애가 발생하기 전에 나타나는 이상 징후를 초기에 탐지하는 방법을 제안하였다. 복잡한 상호작용 구조로 이루어진 시스템에서는 하나의 센서에서 이상이 발생하면 연쇄적으로 전파되기 쉽고, 대량의 데이터에서 비정상 상태의 라벨을 지정하기 어려워 정상 데이터 기반 비지도 이상 탐지 기법이 요구된다.

따라서 본 연구는 순환 신경망 오토인코더에 어텐션 메커니즘을 추가하여 시계열 내 중요한 시점의 정보를 가중 반영하고 재구성 오류를 Max, Mean, Top-3로 집계하는 후처리 방식을 제안하였다. 이러한 방법은 라벨이 부족한 산업 제어 시스템 환경에서 적용 가능하도록 설계되었다.

실험 결과, 어텐션 메커니즘을 적용한 모델이 GRU/LSTM-AE(Mean) 기준선 모델보다 F1-Score에서 일관되게 더 높은 성능을 기록하였다. 이는 어텐션 메커니즘이 기여도가 큰 시점의 정보를 더 많이 반영함으로써 기존의 오류를 단순히 평균할 때 발생하는 정보 손실을 보완한 결과로 분석된다. 3가지 후처리 방식을 비교한 결과에서는, 동일한 GRU-AE 모델에서 Mean 방식의 F1-Score 0.6250에서 Max방식의 F1-Score 0.7321까지 증가하였다. 그중 GRU-AE+Att(Max) 방식이 F1-Score 0.7725를 보여주며, 가장 우수한 성능을 나타냈다. 이는 모델의 구조를 변경하지 않고 재구성 오차 집계 방식을 적절히 설계하는 것만으로도 이상 탐지 성능에 영향을 줄 수 있음을 시사한다.

또한, 실험 결과에서 GRU-AE+Att(Max)모델의 Precision은 GRU-AE(Mean) 기준선 모델의 Precision 0.6233에서 0.9367로 증가시키는 동시에 Recall도 약 5% 개선됐다. 따라서 제안한 방식이 불필요한 알람을 줄이면서 탐지 성능도 높여, 시스템 안정성 향상에 기여할 수 있음을 보여준다.

하지만, 본 연구는 장애가 발생하기 전 이상 징후를 정확히 탐지하는 데 초점을 맞추었으나, 탐지된 이상의 근본 원인이 무엇인지를 파악하지 못하는 한계가 있다. 따라서 추후 연구에서는 탐지된 이상 패턴을 기반으로, 어떤 메트릭이 문제의 시작점이었는지 추적하는 근본 원인 분석(Root Cause Analysis) 알고리즘을 확장하는 것을 최종 목표로 한다.

Acknowledgments

본 연구는 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 지역지능화혁신인재양성사업(IITP-2025-RS-2022-00156287, 50%)과 2025년도 정부(과학기술정보통신부)의 재원으로 방송통신산업기술개발의 지원(No.RS-2024-00345030, 디지털 트윈 기반 네트워크 장애예방 및 운영관리 자동화 기술 개발)을 받아 수행된 연구임.

References

-

F. Wang, Y. Jiang, R. Zhang, A. Wei, J. Xie, and X. Pang, “A Survey of Deep Anomaly Detection in Multivariate Time Series: Taxonomy, Applications, and Directions,” Sensors, Vol. 25, No. 1, 190, January 2025.

[https://doi.org/10.3390/s25010190]

-

W.-H. Choi and J. Kim, “Unsupervised Learning Approach for Anomaly Detection in Industrial Control Systems,” Applied System Innovation, Vol. 7, No. 2, 18, February 2024.

[https://doi.org/10.3390/asi7020018]

-

S. Ryu, J. Yim, J. Seo, Y. Yu, and H. Seo, “Quantile Autoencoder with Abnormality Accumulation for Anomaly Detection of Multivariate Sensor Data,” IEEE Access, Vol. 10, pp. 70428-70439, June 2022.

[https://doi.org/10.1109/ACCESS.2022.3187426]

-

R. Li, Y. Li, W. He, L. Chen, and J. Luo, “Multi-Layer Reconstruction Errors Autoencoding and Density Estimate for Network Anomaly Detection,” Computer Modeling in Engineering & Sciences, Vol. 128, No. 1, pp. 381-398, June 2021.

[https://doi.org/10.32604/cmes.2021.016264]

- ACM SIGMOD Blog. Time Series Anomaly Detection [Internet]. Available: https://wp.sigmod.org/?p=3739, .

- KISDI. Generative Models and Variational Autoencoder [Internet]. Available: https://www.kisdi.re.kr/report/view.do?key=m2101113025377&masterId=4333446&arrMasterId=4333446&artId=1768416

-

F. M. Shiri, T. Perumal, N. Mustapha, and R. Mohamed, “A Comprehensive Overview and Comparative Analysis on Deep Learning Models: CNN, RNN, LSTM, GRU,” arXiv:2305.17473, , May 2023.

[https://doi.org/10.48550/arXiv.2305.17473]

-

J. Chung, C. Gulcehre, K. Cho, and Y. Bengio, “Empirical Evaluation of Gated Recurrent Neural Networks on Sequence Modeling,” arXiv:1412.3555, , December 2014.

[https://doi.org/10.48550/arXiv.1412.3555]

-

K. Zhan, C. Wang, X. Zheng, C. Kong, G. Li, W. Xin, and L. Liu, “Seq2Seq-Based GRU Autoencoder for Anomaly Detection and Failure Identification in Coal Mining Hydraulic Support Systems,” Scientific Reports, Vol. 15, January 2025.

[https://doi.org/10.1038/s41598-024-84130-8]

-

A. A. Neloy and M. Turgeon, “A Comprehensive Study of Auto-Encoders for Anomaly Detection: Efficiency and Trade-Offs,” Machine Learning with Applications, Vol. 17, September 2024.

[https://doi.org/10.1016/j.mlwa.2024.100572]

-

P. Malhotra, A. Ramakrishnan, G. Anand, L. Vig, P. Agarwal, and G. Shroff, “LSTM-Based Encoder-Decoder for Multi-Sensor Anomaly Detection,” arXiv:1607.00148, , July 2016.

[https://doi.org/10.48550/arXiv.1607.00148]

-

Z. Zhao, H. Guo, and Y. Wang, “A Multi-Information Fusion Anomaly Detection Model Based on Convolutional Neural Networks and AutoEncoder,” Scientific Reports, Vol. 14, July 2024.

[https://doi.org/10.1038/s41598-024-66760-0]

-

G.-Q. Zeng, Y.-W. Yang, K.-D. Lu, G.-G. Geng, and J. Weng, “Evolutionary Adversarial Autoencoder for Unsupervised Anomaly Detection of Industrial Internet of Things,” IEEE Transactions on Reliability, Vol. 74, No. 3, pp. 3454-3468, September 2025.

[https://doi.org/10.1109/TR.2025.3528256]

-

S. Narmadha and N. V. Balaji, “Improved Network Anomaly Detection System Using Optimized Autoencoder–LSTM,” Expert Systems with Applications, Vol. 273, May 2025.

[https://doi.org/10.1016/j.eswa.2025.126854]

-

L. Porcelli, M. Trovati, and F. Palmieri, “Real-Time Anomaly Detection in Seasonal Time Series with Conditional Variational Autoencoder,” Applied Soft Computing, Vol. 184, December 2025.

[https://doi.org/10.1016/j.asoc.2025.113761]

-

M. Macas and C. Wu, “An Unsupervised Framework for Anomaly Detection in a Water Treatment System,” in Proceedings of the 18th IEEE International Conference on Machine Learning and Applications (ICMLA), Boca Raton: FL, pp. 1298-1305, December 2019.

[https://doi.org/10.1109/ICMLA.2019.00212]

-

M. Al Olaimat, S. Bozdag, and Alzheimer’s Disease Neuroimaging Initiative, “TA-RNN: An Attention-Based Time-Aware Recurrent Neural Network Architecture for Electronic Health Records,” Bioinformatics, Vol. 40, No. 1, pp. i169-i179, June 2024.

[https://doi.org/10.1093/bioinformatics/btae264]

-

Y. Shi, B. Wang, Y. Yu, X. Tang, C. Huang, and J. Dong, “Robust Anomaly Detection for Multivariate Time Series Through Temporal GCNs and Attention-Based VAE,” Knowledge-Based Systems, Vol. 275, 110725, September 2023.

[https://doi.org/10.1016/j.knosys.2023.110725]

-

Y. Wei, J. Jang-Jaccard, W. Xu, F. Sabrina, S. Camtepe, and M. Boulic, “LSTM-Autoencoder-Based Anomaly Detection for Indoor Air Quality Time-Series Data,” IEEE Sensors Journal, Vol. 23, No. 4, pp. 3787-3800, January 2023.

[https://doi.org/10.1109/JSEN.2022.3230361]

-

J. Goh, S. Adepu, K. N. Junejo, and A. Mathur, “A Dataset to Support Research in the Design of Secure Water Treatment Systems,” in Proceedings of 11th International Conference on Critical Information Infrastructures Security (CRITIS 2016), Paris: France, pp. 88-99, October 2016.

[https://doi.org/10.1007/978-3-319-71368-7_8]

-

A. Komadina, M. Martinić, S. Groš, and Ž. Mihajlović, “Comparing Threshold Selection Methods for Network Anomaly Detection,” IEEE Access, Vol. 12, pp. 124943-124973, 2024.

[https://doi.org/10.1109/ACCESS.2024.3452168]

저자소개

2021년:전남대학교 물리학과(이학사)

2024년~현 재: 전남대학교 지능전자컴퓨터공학과 석사과정

※관심분야:머신러닝, 딥러닝

2019년:전남대학교 컴퓨터정보통신공학과(공학사)

2022년:전남대학교 ICT융합시스템공학과(공학석사)

2023년~현 재: 전남대학교 지능전자컴퓨터공학과 박사과정

※관심분야:인공지능, 네트워크, 이상탐지

2019년:한국나사렛대학교 디지털콘텐츠학과(공학사)

2021년:전남대학교 ICT융합시스템학과(공학석사)

2021년~현 재: 전남대학교 지능전자컴퓨터공학과 박사과정

※관심분야:딥러닝, 인공지능

1991년:연세대학교 전산과학과(학사)

1993년:한국과학기술원(석사)

1997년:한국과학기술원(공학박사)

1997년~1998년: 한국과학기술원(KAIST) 인공지능 연구센터 연구원

1998년~2002년: 한국전자통신연구원(ETRI) 네트워크기술연구소 선임연구원

2002년~현 재: 전남대학교 전자컴퓨터공학부 지능전자컴퓨터공학과 교수

※관심분야:인터넷 라우팅, 멀티캐스트 라우팅, 네트워크 보안, 무선 메쉬 네트워크, 인공지능

1979년:서울 국립대학교 전자공학과(공학사)

1981년:서울 국립대학교 전자공학과(공학석사)

1985년:플로리다 대학(University of Florida) 전자공학과박사과정(공학박사)

1982년~1985년: 대전 한국표준과학연구원 소속

1990년~1997년: ETRI 소속

1998년~현 재: KAIST 전자공학과 및 아스타나IT대학교 컴퓨터 및 데이터과학과 교수

※관심분야:음성 및 오디오 코딩, 음성 합성, 음성 변환, 노이즈 감소, VoIP

2001년:Computer Science from University of Utah, USA(공학사)

2005년:한국과학기술원 정보통신공학(공학석사)

2008년:한국과학기술원 정보통신공학(공학박사)

2005년~2008년: 한국전자통신연구원 IPTV 인프라 기술, 융·복합 방송/통신 분야 연구원

2009년~2012년: 나사렛대학교 멀티미디어학과 교수

2012년~현 재: 전남대학교 지능전자컴퓨터공학과 교수

※관심분야:인공지능, 메타버스, 5G, 6G 이동통신, 클라우딩 컴퓨팅