생성형 인공지능에 대한 인공지능 자기효능감과 인공지능 불안, 인공지능 신뢰가 태도와 수용의도에 미치는 영향

Copyright ⓒ 2024 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

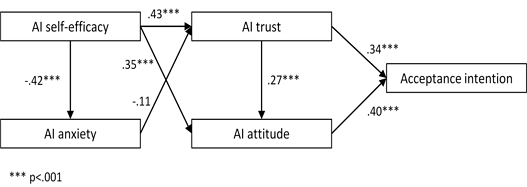

인공지능이 빠르게 확산되고 있는 상황에서 일반 대중들의 인공지능에 대한 긍정적 혹은 부정적 태도형성과 수용에 미치는 요인을 탐색하는 것은 인공지능의 바람직한 수용을 높이는데 중요한 시사점을 제공해줄 수 있다. 이에 인공지능을 사용해 본 경험이 있는 성인남녀를 대상으로 인공지능 자기효능감과 인공지능 불안, 인공지능 신뢰가 태도와 수용의도에 미치는 영향을 규명하였다. 주요 결과를 제시하면, 첫째, 인공지능 자기효능감은 인공지능 불안에 부적 영향을 미친 반면에 인공지능 신뢰와 태도에는 정적 영향을 미치는 것으로 나타났다. 둘째, 인공지능 불안은 인공지능 신뢰에 유의한 영향을 미치지 못한 것으로 나타났다. 셋째, 인공지능 신뢰는 인공지능 태도와 인공지능 수용의도에 정적 영향을 미치는 것으로 나타났다. 넷째, 인공지능에 대한 태도는 수용의도에 정적 영향을 미치는 것으로 나타났다. 이상의 결과에 기초하면 인공지능의 수용의도를 높여 바람직한 활용으로 이어지기 위해서는 사용자들의 인공지능에 대한 긍정적인 태도를 높이고, 이를 위해 인공지능 자기효능감을 촉진시켜 인공지능에 대한 신뢰로 이어질 수 있는 커뮤니케이션 전략이 마련되어야 할 것이다.

Abstract

In a context where artificial intelligence is rapidly spreading, examining the factors that influence the formation and acceptance of positive or negative attitudes toward AI among the general public can provide important insights for promoting its desirable acceptance. This study investigated the effects of AI self-efficacy, AI anxiety, and AI trust on AI attitudes and acceptance intentions among adult men and women with experience using AI. The main results are as follows: First, AI self-efficacy negatively affected AI anxiety while positively impacting AI trust and attitudes. Second, AI anxiety did not significantly affect AI trust. Third, AI trust had a positive effect on AI attitudes and intentions to accept AI. Fourth, attitudes toward AI positively affected acceptance intentions. Based on these findings, to increase AI acceptance and promote desirable use, a communication strategy should be developed to foster positive attitudes toward AI and to enhance AI self-efficacy, which can lead to greater trust in AI.

Keywords:

AI Self-efficacy, AI Anxiety, AI Trust, AI Attitude, Acceptance Intention키워드:

인공지능 자기효능감, 인공지능 불안, 인공지능 신뢰, 인공지능 태도, 수용의도Ⅰ. 서 론

최근 생성형 인공지능 기술이 급격하게 확산되면서 스마트홈이나 자율주행자동차 등 우리의 일상 삶에서 활용되고 있으며, 사회의 다양한 제 분야, 즉 교육이나 의학, 비즈니스 등에서 적극적인 개발과 응용이 이루어지고 있다. 이에 생성형 인공지능이 우리의 삶과 일하는 방식에서 전례없는 변화를 가져올 것이라는 예상은 상당한 설득력을 갖는다. 실제로 지난 몇 년 동안 인공지능의 잠재력에 대한 인식이 확산되고 인공지능 기술의 가용성이 증가함에 따라 일반 대중들 사이에서 인공지능의 활용이 확대되고 있다. 이는 인공지능의 사용이 보편화되고 있음을 의미하며, 인공지능과의 상호작용이 필수역량으로 진화하고 있음을 시사하는 것이기도 하다[1].

인공지능은 인간의 사고 과정을 이해하고 정보시스템을 통해 그 효과를 재현하는 컴퓨터 과학 영역으로써 학습과 추론, 문제해결, 인식 및 생성, 그리고 행동을 포함하는 지능형 시스템이라고 할 수 있다[2]. 이러한 인공지능은 약한 인공지능과 강한 인공지능으로 분류할 수 있는데, 약한 인공지능(narrow AI)은 인간의 모든 능력을 갖추고 있지는 않지만 알고리즘을 이용하여 문제를 해결하거나 바둑 또는 체스와 같은 특정 작업을 추론할 수 있으며, 강한 인공지능(strong AI)은 의사소통과 추론, 정서적 반응을 포함한 광범위한 인간 능력을 보유하고 다양한 작업을 수행할 수 있다[3].

현재 개발되어 상용화된 생성형 인공지능 애플리케이션은 약한 인공지능에 속하지만, 게임이나 오락, 각종 창작활동 등 다양한 영역에서 활용되고 있고, 사회적으로나 경제적으로 상당한 이점과 혜택을 가져다 줄 것으로 예상되고 있어 인공지능의 사회적 확장은 더욱 가속화될 것으로 예상된다.

이와 동시에 인공지능으로 인한 바람직하지 않은 결과들, 즉 투명성이나 개인정보보호, 책임 등 윤리적 문제들에 대한 관심도 높아지고 있어 인공지능의 이점과 위험 간의 논쟁이 확산되고 있다[4]. 인공지능 관련 위험들은 개인정보나 데이터 유출과 같은 현존하는 문제들도 있으나, 대부분 미래의 불확실성과 관련된 문제라는 점에서 일반 대중들의 막연한 두려움이나 불안 등을 야기하는 주요 원인이 된다. 사람들의 인공지능에 대한 불안은 무시할 수 없는 수준이라고 할 수 있는데, 인공지능이 인간을 위협의 대상으로 볼 수 있다는 우려가 제기되면서 일반 대중들의 인공지능에 대한 위기감이나 불안감이 높아지고 있는 것이다. 그 예로써 미국인을 대상으로 한 여론조사에서 약 47%가 인공지능이 인간을 공격할까봐 두렵다는 결과는 인공지능에 대한 일반 대중들의 불안과 두려움을 보여주는 예라고 할 수 있다[5].

인공지능에 대한 불안은 인공지능과의 협력보다는 회피의 대상으로 인식하고, 그에 따른 적대적인 반응과 무관하지 않으며, 인공지능에 대한 근본적인 불안이나 공포가 작용하고 있음을 시사한다[6]. 특히 인공지능 기술에 대한 의존이 증가하고 발전 양상에 따라 더욱 정교하고 복잡해지면 인간은 더 이상 통제할 수 없다는 의식이 높아져 결과적으로 인공지능 불안이 더욱 가속화되는 현상으로 이어질 수 있다[7].

이와 같이 인공지능에 대해 대중들이 느끼는 불안에도 불구하고, 인공지능의 사회적 적용과 활용은 멈추지 않을 가능성이 높다. 이미 인공지능 기술은 다양한 분야에서의 적용과 응용이 이루어지고 있으며, 인공지능으로 인해 우리의 삶과 직장 등에서 얻을 수 있는 혜택과 이점은 매우 클 것으로 예상된다. 그러므로 인공지능 불안은 사회적으로 극복해나가야 할 부분이기도 하다.

이에 일반 대중들의 인공지능에 대한 긍정적 혹은 부정적 태도형성과 수용에 미치는 요인을 탐색하는 것은 인공지능 불안을 극복하고 인공지능의 바람직한 사회적 수용을 가능하게 하는 방안을 모색하는데 중요한 시사점이 될 수 있다.

이를 위해 본 연구에서는 인공지능 자기효능감과 인공지능 신뢰에 주목하고자 하였다. 이전 연구들에 의하면 새로운 기술에 대한 도입은 기술-자기효능감[8]과 신뢰[9],[10]에 의해 결정될 수 있다. 즉, 특정 기술에 대해 사람들이 가지는 자기효능감과 해당 기술과의 상호작용 과정에서 형성되는 신뢰가 개인의 성향에 일정한 영향을 미칠 수 있다는 점에 근거한다[11].

인공지능과 관련 있는 자동화 기술들이 어떻게 작동하고, 무엇을 할 수 있는지, 그 한계는 무엇인지에 대한 투명성이 확보되어야만 해당 기술과의 상호작용성에 대한 통찰력이 형성되어 일정한 태도 형성과 수용으로 이어질 수 있다[12].

이 같은 관점에서 인공지능에 대한 자기효능감과 불안, 신뢰는 태도 및 수용과 밀접한 연관성을 지니는 것으로 예상되지만, 국내에서 인공지능 자기효능감과 불안, 신뢰가 태도와 수용의도에 미치는 영향을 살펴본 연구는 찾아보기 어렵다. 대중들 사이에서 인공지능 불안이 가중되면 결과적으로 인공지능 기술의 사회적 도입 및 활용이 저해되는 결과로 이어질 수 있다.

따라서 인공지능 자기효능감과 불안, 신뢰가 인공지능에 대한 태도 및 수용과 어떻게 연결되는지를 이해할 필요가 있다. 이를 통해 인공지능 불안을 낮추고, 인공지능에 대한 긍정적 태도형성과 수용을 가능하게 하는 방안을 모색함으로써 일반 대중들이 인공지능 기술을 바람직하고 효과적으로 활용하는데 요구되는 유의한 시사점을 제공해줄 수 있을 것으로 사료된다.

Ⅱ. 인공지능 태도와 수용의도 영향요인들

2-1 인공지능 자기효능감

일반적으로 자기효능감(self-efficacy)은 미래의 도전에 대처하는데 필요한 행동을 수행할 수 있는 능력에 대한 개인의 평가와 관련된 것으로, 사용자가 특정한 시스템을 사용하는 과정에서 자신의 목적이나 업무를 위해 잘 실행할 수 있다고 믿는 확고한 형태의 신념으로 이해할 수 있다[13],[14].

특정 기술과의 상호작용성에 초점을 둘 경우에는 해당 시스템과 상호작용하는 과정에서 성공적으로 사용하고, 기능적으로도 잘 다룰 수 있다는 사용자 개인의 능력에 대한 믿음으로 구체성을 띤다는 점[11]에서 인공지능 자기효능감(AI self-efficacy)은 사용자가 인공지능과 상호작용할 때, 자신의 목적에 부합하여 잘 사용하고 다룰 수 있다는 자신의 능력에 대한 확고한 신념으로 개념화된다[15].

이전 연구들에서 인공지능과 같은 특정 기술에 대해 자기효능감이 높은 사람들은 해당 기술과의 상호작용을 통해 자신이 원하는 목적을 성공적으로 달성하고 기능적으로도 적절하게 통제할 수 있다고 인식하는 경향이 높았고[12], 인공지능과 관련된 작업을 수행하는 자신의 능력에 대해 높은 자신감을 가지고 특정 작업을 시작하거나 계속해서 수행할 가능성이 높아진다고 보고된 바 있다[15]. 그러므로 인공지능 자기효능감은 인공지능 기술을 사용하는 과정에서 사용자 스스로 문제를 해결할 수 있다는 자기 자신에 대한 믿음이자 신념이라는 점에서 사용자 스스로가 주체성을 가지고 인공지능 기술의 유용성을 판단하고, 통제할 수 있다는 믿음이 전제되기 때문에 특정 기술에 대한 불안을 낮추는데 유의한 영향을 미칠 수 있다[16].

인터넷 채널을 사용하여 제품을 구매하는 과정에서 인터넷 자기효능감이 높은 사람은 인터넷 자기효능감이 낮은 사람에 비해 제품구매를 잘 수행할 것이라고 믿는 정도가 높았고, 특히 구매과정에서 발생할지도 모르는 위험성을 덜 지각하는 것으로 보고되었다[17]. 수학예비 교사들을 대상으로 한 연구에서 자기효능감과 인공지능 불안은 부적 상관관계를 형성하였고[18], 호텔 서비스 로봇의 지속사용의도에 관한 연구에서도 자기효능감은 불안감과 부적 상관을 형성하는 것으로 보고되었다[19]. 다만 국내 성인들을 대상으로 인공지능 불안을 살펴본 연구에서 자기효능감은 인공지능 불안에 유의한 영향을 미치지 못한 것으로 나타나 상반된 연구결과가 존재하기도 한다[20]. 하지만 기존 선행연구들에 기초하여 보면 인공지능을 효과적으로 사용하고 통제할 수 있다는 믿음은 인공지능 불안을 완화하는데 일정한 영향을 미칠 것으로 판단된다.

또한 인공지능 자기효능감은 인공지능 신뢰에도 중요한 영향을 미칠 것으로 예상된다. 이전 연구들에 의하면, 새로운 기술과 상호작용할 때 자기효능감이 자신감에 상당한 영향을 미치기 때문에 해당 기술에 대한 신뢰 성향을 높이는데 중요한 영향을 미치며[11],[21], 인공지능 기술에 대한 신뢰와 태도를 높이는데 있어서도 긍정적으로 직접적인 영향을 미치는 것으로 밝혀지기도 하였다[12].

이상의 논의에 기초하면 인공지능 자기효능감은 인공지능 신뢰와 태도를 효과적으로 예측하는 선행요인으로 판단된다. 이상의 논의에 기반하여 본 연구에서는 다음과 같은 가설을 설정하였다.

가설 1. 인공지능 자기효능감은 인공지능 불안에 부적 영향을 미칠 것이다.

가설 2. 인공지능 자기효능감은 인공지능 신뢰에 정적 영향을 미칠 것이다.

가설 3. 인공지능 자기효능감은 인공지능 태도에 정적 영향을 미칠 것이다.

2-2 인공지능 불안

특정 기술에 대한 불안은 인간의 삶과 사회에 부정적인 영향을 미칠 것으로 예상되는 새로운 기술이 등장할 때마다 사람들 사이에서 형성된 심리적 산물로, 컴퓨터와 같은 새로운 기술에 대해 건강하게 대처하지 못함으로써 발생하는 적응적 측면의 현대적 질환이라고 할 수 있다. 특정기술과 관련된 불안은 현대적 의미에서 과학기술의 등장과 발전에 대해 사람들이 지니는 부정적 반응으로 통칭되기도 한다[6],[22],[23].

정보통신기술의 발전은 일상 삶이나 직장에서 개인의 생산성을 향상시키거나 비즈니스를 수행하는데 있어 혁신적인 방법이지만, 그와 동시에 개인이나 조직의 삶에 미치는 부정적 결과에 대한 우려를 높이기도 한다. 예컨대, 정보통신기술이 급속히 도입됨에 따라 개인이나 조직은 기술 피로감이나 혐오감으로 인한 어려움을 겪기도 하였다. 이에 특정기술에 대한 불안은 위협으로 간주되며, 미래의 예상치 못한 부정적 결과와 관련된 불확실성을 포함하고, 사용자가 점점 더 복잡해지는 기술에 적응하는 과정에서 발생하는 신체적, 정서적 스트레스에 기인하는 것으로 이해된다[24].

이와 유사하게 인공지능 역시 삶의 다양한 측면에서 수많은 문제를 촉발시킬 것이라는 우려를 낳는다. 일자리 감소나 개인정보보호 및 투명성을 둘러싼 문제들, 알고리즘 편향, 사회경제적 격차, 비윤리적 행위 등 매우 다양한 영역에서 광범위한 문제들을 포함한다. 이러한 문제들은 특정 기술에 대한 불안과 유사하게 인공지능에 대한 불안을 유발할 가능성을 높인다.

여기서 인공지능 불안(AI anxiety)은 인공지능에 대한 과도한 두려움으로써[25], 새로운 기술과의 상호작용으로 인해 나타나는 긴장이며, 그에 따라 불안이 가중되고 높아질수록 무능력과 짜증, 통제력 상실 등으로 나타난다는 점에서[23], 인공지능 불안이 과도하게 나타날 경우에 인공지능에 대한 신뢰를 약화시키는 결과로 이어질 수 있다. 이전 연구들에서 인공지능에 대한 두려움은 신뢰와 부정적으로 연관되며[12], 인공지능과 관련된 다양한 위험성을 인식하거나 오류를 관찰한 사람들은 그렇지 않은 사람들에 비해 신뢰가 약화되는데, 신뢰가 고정적인 것이 아닌 동적인 특성을 가지고 있기 때문이다[26]. 이상의 논의에 기반하여 본 연구에서는 다음과 같은 가설을 설정하였다.

가설 4. 인공지능 불안은 인공지능 신뢰에 부적 영향을 미칠 것이다.

2-3 인공지능 신뢰

인공지능 신뢰는 자율주행자동차나 로봇, 드론 등과 같이 인공지능 기반 지능형 기술과의 상호작용에 대한 신뢰를 의미하는 것으로[12], 사용자가 인공지능과 상호작용하는 과정에서 인식하는 신뢰는 인공지능에 대한 긍정적 태도 형성과 사회적 수용에 중요한 영향을 미친다[27],[28]. 인공지능에 대한 신뢰가 부족하면 사용이 중단되거나 수용이 낮아지고, 유익한 기술이라고 하더라도 완전한 거부로 이어질 수 있다. 그러므로 인공지능의 성공적인 활용을 촉진하기 위해서는 적절한 신뢰가 매우 중요할 수밖에 없다. 다만 과도한 신뢰는 인공지능의 오용과 맹목적인 의존으로 나타날 수 있다는 점에서 바람직하지 않은 결과를 초래할 수도 있다[26]. 이전 연구들에 의하면, 특정 기술과 상호작용하는 과정에서 신뢰가 형성되면 해당 기술에 대한 긍정적 태도를 유지하는 경향이 높아지며[12], 지능형 자동화기술을 포함하여 인공지능 사용의도나 행위를 긍정적으로 예측하는데 중요한 영향을 미치는 것으로 나타났다[27],[29]. 또한 인공지능 관련 연구에서 인공지능에 대한 신뢰는 인공지능 수용의도에 정적 영향을 미치는 것으로 보고되기도 하였다[12]. 이상의 논의에 기초하여 다음과 같은 가설을 설정하였다.

가설 5. 인공지능 신뢰는 인공지능에 대한 태도에 정적 영향을 미칠 것이다.

가설 6. 인공지능 신뢰는 인공지능 수용에 정적 영향을 미칠 것이다.

2-4 태도와 수용의 관계

일반적으로 태도(attitude)는 기술수용모델이나 합리적 행동이론, 계획된 행위이론 등 다양한 모델에서 사용의도를 예측하는 강력한 변수로 이해된다. 특히, 인공지능과 같은 새로운 기술의 사용을 위한 중요한 선행요인으로 평가되고 있다는 점에서 다른 외생변수들과의 관계 규명을 위해 자주 활용된다[30]. 특정 기술에 대한 긍정적 태도는 기술사용에 대한 관심을 높이고 수용의도에 직접적인 영향을 미칠 수 있다[31]. 이전 연구들에서 심리학 전공학생들이나 간호대학생들의 인공지능에 대한 태도는 인공지능을 사용하고자 하는 욕구를 형성하는데 중요한 역할을 하였고, 실제로 수용의도를 높이는데 긍정적인 영향을 미친 것으로 밝혀졌다[32],[33]. 이상과 같이 태도는 수용의도를 직접적으로 예측하는 강력한 변인이라고 할 수 있다. 특히 인공지능 기술이 기존의 기술과는 상당히 다른, 지능과 같은 고유의 특성을 가지고 있다는 점[34]에서 인공지능에 대한 개인의 태도와 행동을 규명하는 것은 매우 의미있는 과정이라고 할 수 있다. 이상의 논의에 기반하여 본 연구에서는 다음과 같은 가설을 설정하였다.

가설 7. 인공지능에 대한 태도는 인공지능 수용에 정적 영향을 미칠 것이다.

Ⅲ. 연구방법

3-1 연구대상자

본 연구에서 모집단은 생성형 인공지능을 사용한 경험이 있는 한국 국적의 성인남녀로 설정하고 온라인전문업체에 의뢰하여 편의표본추출법을 통해 관련 데이터를 확보하였다. 조사기간은 2024년 2월 19일부터 25일까지 진행되었고 본격적인 조사 전에 설문의 목적을 간략하게 언급한 후 동의과정을 거쳐 이루어졌다. 이상의 과정을 거쳐 245부의 자료를 확보하였고, 이중에서 불성실하게 응답하였다고 판단되는 12부를 제외한 233부의 데이터를 확보하여 실제 분석에 활용하였다. 인구통계학적 특성을 살펴보면 성별은 남성 124명(53.2%), 여성 109명(46.8%)으로 나타났고, 평균 연령은 30.19세(SD=7.62), 20대는 142명(60.9%), 30대 55명(23.6%), 40대 36명(15.5%)으로 분석되었다.

3-2 연구 도구

본 연구에서 인공지능 자기효능감은 선행연구들[14],[35]에서 사용된 문항을 본 연구의 목적에 맞게 일부 보완하여 3문항으로 구성하였다. 각 문항은 5점 리커트 척도(5-point likert scale)로 구성하여 1점 ‘전혀 동의하지 않는다’에서 5점 ‘매우 동의한다’로 평정하였다. 주요 문항은 다음과 같다. ① 다른 누구의 도움없이도 생성형 인공지능을 사용할 수 있다(AISE1), ② 생성형 인공지능을 사용하여 내가 원하는 목적을 달성할 수 있다(AISE2), ③ 생성형 인공지능 사용에 어려움이 있어도 잘 수행할 수 있다(AISE3).

본 연구에서 인공지능 불안은 선행연구[36]에서 사용한 문항을 참조하여 본 연구의 목적에 맞게 일부 보완하여 4문항으로 구성하였다. 각 문항은 5점 리커트 척도를 통해 1점 ‘전혀 동의하지 않는다’에서 5점 ‘매우 동의한다’로 평정하였다. 주요 문항은 다음과 같다. ① 인공지능 발전에 대해 들으면 가슴이 철렁 내려앉는 기분이 든다(AIAN1), ② 인공지능의 미래에 대해 생각하면 답을 내릴 수 없다(AIAN2), ③ 인공지능의 역량을 생각하면 미래가 얼마나 위험할지 생각하게 된다(AIAN3), ④ 인공지능에 대해 생각하면 불안하다(AIAN4).

본 연구에서 인공지능 신뢰는 선행연구들[37],[38]을 참조하여 본 연구의 목적에 맞게 보완한 후 3문항으로 구성하였다. 각 문항은 5점 리커트 척도(5-point likert scale)로 구성하여 1점 ‘전혀 동의하지 않는다’에서 5점 ‘매우 동의한다’로 평정하였다. 주요 문항은 다음과 같다. ① 다른 누구의 도움없이도 생성형 인공지능을 사용할 수 있다(AIT1), ② 생성형 인공지능을 사용하여 내가 원하는 목적을 달성할 수 있다(AIT2), ③ 생성형 인공지능 사용에 어려움이 있어도 잘 수행할 수 있다(AIT3).

본 연구에서 인공지능에 대한 태도는 선행연구들[30],[39]에서 사용된 문항을 본 연구의 목적에 맞게 일부 수정하여 3문항으로 구성하였다. 각 문항은 5점 리커트 척도로 구성하여 1점 ‘전혀 동의하지 않는다’에서 5점 ‘매우 동의한다’로 평정하였다. 주요 문항은 다음과 같다. ① 인공지능 서비스를 사용하는 것은 좋다(AIA1), ② 인공지능 서비스를 사용하는 것은 현명한 생각이다(AIA2), ③ 인공지능 서비스를 사용하는 것은 즐겁다(AIA3).

본 연구에서 인공지능 수용의도는 선행연구[40]에 기초하여 본 연구의 목적에 맞게 보완하여 3문항으로 구성하였다. 각 문항은 5점 리커트 척도를 통해 1점 ‘전혀 동의하지 않는다’에서 5점 ‘매우 동의한다’로 평정하였다. 주요 문항은 다음과 같다. ① 나는 인공지능 서비스를 사용할 계획이 있다(ITA1), ② 나는 인공지능 서비스를 사용할 의도가 있다(ITA2), ③ 나는 인공지능 서비스를 사용할 것이다(ITA3).

3-3 타당도

본 연구에서는 주요 변수들에 대한 타당도 검증을 위하여 확인적 요인분석을 수행하였다. 우선 모델적합도는 절대적합지수(RMSEA, GFI)와 증분적합지수(NFI, IFI, CFI)를 이용하였다. 적합기준의 경우에 RMSEA는 .80 이하, GFI와 NFI, IFI, CFI는 .90 이상이면 적합기준을 충족하는 평가할 수 있다. 확인적 요인분석을 수행한 결과, 모델 적합도는 RMSEA=.08, GFI=.90, NFI=.91, IFI=.94, CFI=.94로 나타나 모든 적합지수가 적합기준을 충족하였다. 또한 잠재변수의 관측변수에 대한 표준화경로계수(β)는 .54~.92를 나타냈고, 모두 통계적으로 유의하였다. 평균분산추출값(AVE)은 .47~.74, 개념신뢰도(CR)는 .72~.89, 내적일치도(Cronbach’s α)는 .72~.90으로 확인되어 측정도구의 타당도가 확보되었다.

3-4 자료 처리

본 연구에서는 SPSS 21.0 프로그램과 AMOS 21.0 프로그램을 이용하여 다음과 같은 과정을 통해 주요 결과를 도출하였다. 첫째, 확인적 요인분석을 수행하여 주요 변수들에 대한 타당도를 검증하였다. 타당도 검증은 모델적합도와 표준화경로계수(β) 및 통계적 유의성을 검토하고 평균분산추출값(AVE)와 개념신뢰도(CR), 내적 일치도(Cronbach’s α)의 검증을 통해 이루어졌다. 둘째, 주요 변수들에 대한 상관관계를 확인하고자 상관관계분석(correlation analysis)을 수행하였다. 셋째, 도출된 모델에 기초하여 설정된 가설을 검증하고자 경로분석(path analysis)을 수행하였다.

Ⅳ. 연구결과 및 분석

4-1 상관관계 분석

주요 변수들에 대한 상관관계를 알아보기 위하여 상관관계분석을 수행하였다. 주요 결과를 보면, 우선 인공지능 자기효능감은 인공지능 불안(r=-.42, p<.01)과 부적 상관을 나타냈고, 인공지능 신뢰(r=.47, p<.01)와 인공지능에 대한 태도(r=.48, p<.01)와는 정적 상관을 형성하였다. 인공지능 불안은 인공지능 신뢰(r=-.29, p<.01)와 부적 상관을 나타냈고, 인공지능 신뢰는 인공지능에 대한 태도(r=.44, p<.01), 수용의도(r=.51, p<.01)와 정적 상관을 나타냈다. 그리고 인공지능에 대한 태도는 수용의도(r=.55, p<.01)와 정적 상관을 형성한 것으로 분석되었다.

4-2 가설 검증

본 연구에서 설정한 가설을 검증하기 위하여 경로분석을 수행하였다. 우선 가설 1, 가설 2, 가설 3과 관련하여 인공지능 자기효능감이 인공지능 불안과 인공지능 신뢰, 인공지능에 대한 태도에 미치는 영향을 살펴본 결과, 인공지능 자기효능감은 인공지능 불안(β=-.42, p<.001)에는 부적 영향을 미쳤고, 인공지능 신뢰(β=.43, p<.001)와 인공지능 태도(β=.35, p<.001)에는 정적 영향을 미치는 것으로 나타났다. 가설 4와 관련하여 인공지능 불안이 인공지능 신뢰에 미치는 영향을 살펴본 결과, 인공지능 불안은 인공지능 신뢰에 유의한 영향을 미치지 못한 것으로 나타났다(β=-.11, p>.05). 가설 5, 가설 6과 관련하여 인공지능 신뢰가 인공지능 태도와 수용의도에 미치는 영향을 살펴본 결과, 인공지능 신뢰는 인공지능 태도(β=.27, p<.001)와 수용의도(β=.34, p<.001)에 정적 영향을 미치는 것으로 나타났다. 가설 7과 관련하여 인공지능 태도가 수용의도에 미치는 영향을 살펴본 결과, 인공지능 태도는 수용의도에 정적 영향을 미치는 것으로 나타났다(β=.40, p<.001).

Ⅴ. 논의 및 결론

본 연구는 생성형 인공지능에 대한 인공지능 자기효능감과 인공지능 불안, 인공지능 신뢰가 태도와 수용의도에 미치는 영향을 규명하였으며, 주요 가설을 바탕으로 논의를 하면 다음과 같다.

우선 가설 1, 가설 2, 가설 3과 관련하여 인공지능 자기효능감은 인공지능 불안에 부적 영향을 미치고, 인공지능 신뢰와 태도에는 정적 영향을 미치는 것으로 나타났다. 그러므로 사용자가 누구의 도움 없이 생성형 인공지능을 통해 자신이 원하는 목적을 달성하고, 사용에 대한 어려움이 있어도 잘 수행할 수 있다는 인공지능 자기효능감을 높게 지각할수록 인공지능에 대한 불안은 낮아지고, 인공지능에 대산 신뢰 상승과 긍정적 태도가 형성되는 것으로 평가할 수 있다.

이러한 결과는 인공지능 자기효능감과 불안 간에 부적 상관이 형성되고[18],[19], 인터넷 자기효능감이 높을수록 구매과정에서의 위험성에 대해 낮게 지각하였다고 보고된 연구결과를 반영하며[17], 새로운 기술에 대한 자기효능감이 해당 기술에 대한 신뢰와 태도에 정적 영향을 미쳤다고 보고한 이전 연구들의 결과와 일치한다[11],[12],[21].

인공지능 자기효능감은 인공지능과의 상호작용 과정에서 자신의 목적에 부합하게 잘 활용할 수 있다는 사용자 개인의 믿음이나 신념[15]과 관련된다는 점에서 상대적으로 인공지능에 대한 과도한 불안을 낮추는 반면에 인공지능에 대한 신뢰를 높이고 긍정적 태도를 형성하는데 있어 중요한 기능을 수행하는 것으로 이해할 수 있다.

특히, 인공지능 자기효능감이 신뢰와 태도에 정적 영향을 미쳤다는 결과는 인공지능에 대해 능숙하게 사용할 수 있다는 신념이 인공지능 기술을 신뢰하는 경향으로 이어지고, 부정적 태도보다는 긍정적 태도를 형성할 수 있음을 시사한다[12]. 따라서 인공지능에 대한 막연한 불안이나 인공지능에 대한 신뢰를 높이기 위해서는 사용자들의 인공지능 자기효능감을 높일 수 있는 커뮤니케이션 전략이 요구된다고 할 것이다.

한편, 가설 4와 관련하여 인공지능 불안은 인공지능 신뢰에 유의한 영향을 미치지 못한 것으로 나타났다. 이러한 결과는 인공지능에 대한 과도한 불안이 인공지능에 대한 신뢰를 약화시키고[12], 인공지능의 위험성을 인지하거나 관찰한 사람일수록 그렇지 않은 사람들에 비해 신뢰가 낮아진다[26]는 이전의 연구결과와는 상반된다. 인공지능 불안과 신뢰의 관계를 규명한 연구들이 많지 않아 심도 있는 논의에는 한계가 있으나, 아직까지 인공지능에 대한 위험이 구체적이기 보다는 잠재적 측면에서 제기되는 위험이라는 점에서 인공지능 사용자에게 실체화된 위험으로 인식되지 않는다는 점이 일정 부분 영향을 미친 것으로 사료되며, 인공지능 불안과 신뢰의 관계에 대한 지속적인 검증이 필요함을 시사하는 부분이기도 하다.

가설 5, 가설 6와 관련하여 인공지능 신뢰는 인공지능 태도와 인공지능 수용의도에 정적 영향을 미치는 것으로 나타나 인공지능에 대한 신뢰가 높을 경우에 인공지능에 대한 긍정적 태도가 형성되고, 수용의도 역시 높아지는 것으로 평가할 수 있다.

이러한 결과는 특정 기술과의 상호작용 과정에서 신뢰가 형성될 경우에 긍정적 태도로 이어지며[12], 지능형 자동화기술을 포함한 인공지능에 대한 사용의도나 행위[27],[29], 그리고 수용의도[12]에도 정적 영향을 미쳤다고 보고된 결과들과 일치한다. 전술한 바와 같이 인공지능 신뢰가 부족해지면 인공지능 수용의 약화로 이어질 수 있으며, 아무리 사회적으로 유익한 기술이라 하더라도 수용 거부로 이어질 수 있다. 따라서 인공지능에 대한 긍정적 태도 형성과 수용의도를 높이기 위해서는 사용자의 인공지능에 대한 신뢰 형성이 우선되어야 하며, 인공지능 리터러시 교육을 통해 사용자들이 인공지능에 대해 제대로 이해할 수 있도록 해야 할 것이다.

가설 7과 관련하여 인공지능에 대한 태도는 수용의도에 정적 영향을 미치는 것으로 나타나 인공지능에 대한 긍정적 태도가 형성될수록 수용의도 역시 높아지는 것으로 평가할 수 있다. 이러한 결과는 인공지능에 대한 긍정적 태도가 인공지능 사용 욕구를 자극함으로써 수용의도에 직접적인 영향을 미치는 요인이라고 보고한 이전 연구들의 결과를 반영한다[32],[33]. 그러므로 인공지능에 대한 긍정적 태도는 인공지능의 사회적 수용을 촉진하는 강력한 예측 요인으로 평가할 수 있다.

이상과 같이 본 연구의 결과에 기초하면 인공지능의 수용의도를 높이고 바람직한 활용으로 이어지기 위해서는 사용자들의 인공지능에 대한 긍정적인 태도를 높이고, 인공지능 자기효능감을 촉진시켜 인공지능에 대한 신뢰로 이어질 수 있는 커뮤니케이션 전략이 마련되어야 할 것이다.

본 연구의 한계와 제언을 제시하면 첫째, 본 연구에서는 횡단연구를 실시하였으나, 인공지능에 대한 태도와 수용의도를 보다 면밀하게 살펴보기 위한 방법으로 종단연구의 필요성이 제기된다. 둘째, 인공지능 자기효능감에 대한 개인차를 고려하여 인공지능 불안과 인공지능 신뢰, 그리고 태도 및 수용의도와의 관계성을 살펴볼 필요가 있다. 셋째, 본 연구에서 조사대상자들은 샘플링 과정에서 20대에서 40대까지로 의도치 않게 한정되었으나, 후속연구에서는 연령대 범위를 보다 다양화할 필요가 있을 것이다.

References

- M. Pinski and A. Benlian, “AI Literacy - Towards Measuring Human Competency in Artificial Intelligence,” in Proceedings of the 56th Hawaii International Conference on System Sciences (HICSS 2023), Maui: HI, pp. 165-174, January 2023.

- R. K. Rainer and B. Prince, Introduction to Information Systems: Supporting and Transforming Business, 6th ed. Hoboken, NJ: John Wiley & Sons, 2015.

- Lifewire. Strong AI vs. Weak AI: What’s the Difference?: Strong AI Can Do Anything a Human Can Do, while Weak AI Is Limited to a Specific Task [Internet]. Available: https://www.lifewire.com/strong-ai-vs-weak-ai-7508012, .

-

A. Jobin, M. Lenca, and E. Vayena, “The Global Landscape of AI Ethics Guidelines,” Nature Machine Intelligence, Vol. 1, No. 9, pp. 389-399, September 2019.

[https://doi.org/10.1038/s42256-019-0088-2]

- Newsweek. Poll Reveals Americans’ Fears about AI [Internet]. Available: https://www.newsweek.com/poll-reveals-fears-ai-smarter-attack-humanity-1915100, .

-

M. Chung, Y. Min, and S. Y. Leem, “Artificial Intelligence as a Matter of Care: Focusing on AI Anxiety and Employment Stress among Young Adults in Their 20s,” Journal of Science & Technology Studies, Vol. 23, No. 2, pp. 112-144, August 2023.

[https://doi.org/10.22989/jsts.2023.23.2.4]

-

H. Ju, “The Meaning of Anxiety about Artificial Intelligence in TV Dramas,” Culture and Convergence, Vol. 43, No. 10, pp. 19-34, October 2021.

[https://doi.org/10.33645/cnc.2021.10.43.10.19]

- L. B. Holcomb, F. B. King, and S. W. Brown, “Student Traits and Attributes Contributing to Success in Online Courses: Evaluation of University Online Course,” The Journal of Interactive Online Learning, Vol. 2, No. 3, pp. 1-17, December 2004.

-

S. C. Kohn, E. J. de Visser, E. Wiese, Y.-C. Lee, and T. H. Shaw, “Measurement of Trust in Automation: A narrative Review and Reference Guide,” Frontiers in Psychology, Vol. 12, 604977, October 2021.

[https://doi.org/10.3389/fpsyg.2021.604977]

-

J. M. Kraus, Y. Forster, S. Hergeth, and M. Baumann, “Two Routes to Trust Calibration: Effects of Reliability and Brand Information on Trust in Automation,” International Journal of Mobile Human Computer Interaction, Vol. 11, No. 3, pp. 1-17, 2019.

[https://doi.org/10.4018/IJMHCI.2019070101]

-

J. Kraus, D. Scholz, and M. Baumann, “What’s Driving Me? Exploration and Validation of a Hierarchical Personality Model for Trust in Automated Driving,” Human Factors, Vol. 63, No. 6, pp. 1076-1105, September 2021.

[https://doi.org/10.1177/0018720820922653]

-

C. Montag, J. Kraus, M. Baumann, and D. Rozgonjuk, “The Propensity to Trust in (Automated) Technology Mediates the Links between Technology Self-Efficacy and Fear and Acceptance of Artificial Intelligence,” Computers in Human Behavior Reports, Vol. 11, 100315, August 2023.

[https://doi.org/10.1016/j.chbr.2023.100315]

- O. Isaac, Z. Abdullah, T. Ramayah, and A. M. Mutahar, “Internet Usage within Government Institutions in Yemen: An Extended Technology Acceptance Model (TAM) with Internet Self-efficacy and Performance Impact,” Science International, Vol. 29, No. 4, pp. 737-747, July-August 2017.

-

K.-H. Seo, “Kiosks Expansion in the Foodservice Industry: Integrated Technology Acceptance Model Including Personal Innovativeness, Self-Efficacy, Enjoyment, and Customer Satisfaction,” Korean Journal of Hospitality and Tourism, Vol. 30, No. 7, pp. 73-92, October 2021.

[https://doi.org/10.24992/KJHT.2021.10.30.07.73]

-

S.-C. Kong, W. M.-Y. Cheung, and G. Zhang, “Evaluation of an Artificial Intelligence Literacy Course for University Students with Diverse Study Backgrounds,” Computers and Education: Artificial Intelligence, Vol. 2, 100026, 2021.

[https://doi.org/10.1016/j.caeai.2021.100026]

-

R. G. Saadé and D. Kira, “Computer Anxiety in e-Learning: The Effect of Computer Self-Efficacy,” Journal of Information Technology Education, Vol. 8, No. 1, pp. 177-191, 2009.

[https://doi.org/10.28945/3386]

- H. Lee and N. K. Kwon, “The Role of Internet Self-Efficacy in Internet Shopping,” Korean Journal of Marketing, Vol. 1, No. 1, pp. 27-33, December 2006.

-

T. Son, “Preservice Teacher’s Understanding of the Intention to Use the Artificial Intelligence Program ‘Knock-Knock! Mathematics Expedition’ in Mathematics Lesson: Focusing on Self-Efficacy, Artificial Intelligence Anxiety, and Technology Acceptance Model,” The Mathematical Education, Vol. 62, No. 3, pp. 401-416, August 2023.

[https://doi.org/10.7468/mathedu.2023.62.3.401]

- J. Luo, A Study on the Intention of Continuous Use of Hotel Service Robots Applying the Technology Readiness Acceptance Model -Moderating Role of Self-Efficacy-, Ph.D. Dissertation, Dong-A University, Busan, August 2022.

-

J. W. Kim, An Empirical Study on Individual Traits and Interactional Factors as Antecedents of Artificial Intelligence (AI) Anxiety, Master’s Thesis, Korea University, Seoul, August 2023.

[https://doi.org/10.23186/korea.000000276643.11009.0000129]

-

J. Kraus, D. Scholz, D. Stiegemeier, and D. Baumann, “The More You Know: Trust Dynamics and Calibration in Highly Automated Driving and the Effects of Take-Overs, System Malfunction, and System Transparency,” Human Factors, Vol. 62, No. 5, pp. 718-736, August 2020.

[https://doi.org/10.1177/0018720819853686]

- C. Brod, Technostress: The Human Cost of the Computer Revolution, Reading, MA: Addison-Wesley, 1984.

-

R. I. Raja Zirwatul Aida, A. B. Azlina, and M. N. Siti Balqis, “Techno Stress: A Study among Academic and Non Academic Staff,” in Proceedings of EHAWC 2007, Beijing, China, pp. 118-124, July 2007.

[https://doi.org/10.1007/978-3-540-73333-1_15]

-

M. G. Melchionda, “Librarians in the Age of the Internet: Their Attitudes and Roles: A Literature Review,” New Library World, Vol. 108, No. 3/4, pp. 123-140, April 2007.

[https://doi.org/10.1108/03074800710735339]

-

Y.-Y. Wang and Y.-S. Wang, “Development and Validation of an Artificial Intelligence Anxiety Scale: An Initial Application in Predicting Motivated Learning Behavior,” Interactive Learning Environments, Vol. 30, No. 4, pp. 619-634, 2022.

[https://doi.org/10.1080/10494820.2019.1674887]

-

A. Klingbeil, C. Grützner, and P. Schreck, “Trust and Reliance on AI — An Experimental Study on the Extent and Costs of Overreliance on AI,” Computers in Human Behavior, Vol. 160, 108352, November 2024.

[https://doi.org/10.1016/j.chb.2024.108352]

-

L. Miller, J. Kraus, F. Babel, and M. Baumann, “More than a Feeling—Interrelation of Trust Layers in Human-Robot Interaction and the Role of User Dispositions and State Anxiety,” Frontiers in Psychology, Vol. 12, 592711, April 2021.

[https://doi.org/10.3389/fpsyg.2021.592711]

-

C. Sindermann, H. Yang, J. D. Elhai, S. Yang, L. Quan, M. Li, and C. Montag, “Acceptance and Fear of Artificial Intelligence: Associations with Personality in a German and a Chinese Sample,” Discover Psychology, Vol. 2, No. 1, 8, January 2022.

[https://doi.org/10.1007/s44202-022-00020-y]

-

G. Schiavo, S. Businaro, and M. Zancanaro, “Comprehension, Apprehension, and Acceptance: Understanding the Influence of Literacy and Anxiety on Acceptance of Artificial Intelligence,” Technology in Society, Vol. 77, 102537, June 2024.

[https://doi.org/10.1016/j.techsoc.2024.102537]

-

F. D. Davis, “Perceived Usefulness, Perceived Ease of Use, and User Acceptance of Information Technology,” MIS Quarterly, Vol. 13, No. 3, pp. 319-340, September 1989.

[https://doi.org/10.2307/249008]

-

T. Teo and M. Zhou, “Explaining the Intention to Use Technology among University Students: A Structural Equation Modeling Approach,” Journal of Computing in Higher Education, Vol. 26, No. 2, pp. 124-142, June 2014.

[https://doi.org/10.1007/s12528-014-9080-3]

-

S. Gado, R. Kempen, K. Lingelbach, and T. Bipp, “Artificial Intelligence in Psychology: How can We enable Psychology Students to Accept and Use Artificial Intelligence?,” Psychology Learning & Teaching, Vol. 21, No. 1, pp. 37-56, March 2022.

[https://doi.org/10.1177/14757257211037149]

-

Y. Kwak, Y. H. Seo, and J.-W. Ahn, “Nursing Students’ Intent to Use AI-Based Healthcare Technology: Path Analysis Using the Unified Theory of Acceptance and Use of Technology,” Nurse Education Today, Vol. 119, 105541, December 2022.

[https://doi.org/10.1016/j.nedt.2022.105541]

-

P. Mehta, C. Jebarajakirthy, H. I. Maseeh, A. Anubha, R. Saha, and K. Dhanda, “Artificial Intelligence in Marketing: A Meta-Analytic Review,” Psychology & Marketing, Vol. 39, No. 11, pp. 2013-2038, November 2022.

[https://doi.org/10.1002/mar.21716]

-

C.-M. Chao, “Factors Determining the Behavioral Intention to Use Mobile Learning: An Application and Extension of the UTAUT Model,” Frontiers in Psychology, Vol. 10, 1652, July 2019.

[https://doi.org/10.3389/fpsyg.2019.01652]

-

C. S. Chai, X. Wang, and C. Xu, “An Extended Theory of Planned Behavior for the Modelling of Chinese Secondary School Students’ Intention to Learn Artificial Intelligence,” Mathematics, Vol. 8, No. 11, 2089, November 2020.

[https://doi.org/10.3390/math8112089]

-

A. Chaudhuri and M. B. Holbrook, “The Chain of Effects from Brand Trust and Brand Affect to Brand Performance: The Role of Brand Loyalty,” Journal of Marketing, Vol. 65, No. 2, pp. 81-93, April 2001.

[https://doi.org/10.1509/jmkg.65.2.81.18255]

-

J.-W. Jun and J.-Y. Lee, “The Effects of Privacy Involvement and Technology Trust on AI Perception: A Focus on Mediating Roles of Emotional Responses,” Journal of the Korea Contents Association, Vol. 23, No. 9, pp. 186-196, September 2023.

[https://doi.org/10.5392/JKCA.2023.23.09.186]

-

J. Park, J. Yun, and W. Chang, “Intention to Adopt Services by AI Avatar: A Protection Motivation Theory Perspective,” Journal of Retailing and Consumer Services, Vol. 80, 103929, September 2024.

[https://doi.org/10.1016/j.jretconser.2024.103929]

-

S. M. Kim and Y. D. Son, “A Study on the Intention of Financial Consumers to Accept AI Services Using UTAUT Model,” Journal of Korean Society for Quality Management, Vol. 50, No. 1, pp. 43-61, March 2022.

[https://doi.org/10.7469/JKSQM.2022.50.1.43]

저자소개

2019년:성균관대학교 미디어문화융합대학원 문화융합학과 졸업(문화융합학석사)

2021년:성균관대학교 일반대학원 예술학협동과정 수료(예술학박사)

2021년~현 재: 대진대학교 문예콘텐츠창작학과 교수

2021년~현 재: 국제인공지능윤리협회 자문위원

※관심분야:인공지능, 메타버스, 드론, 실감콘텐츠, 신기술 기반 융합콘텐츠