생성형 AI를 활용한 문헌정보학 수업 설계에 대한 탐험적 연구

Copyright ⓒ 2023 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

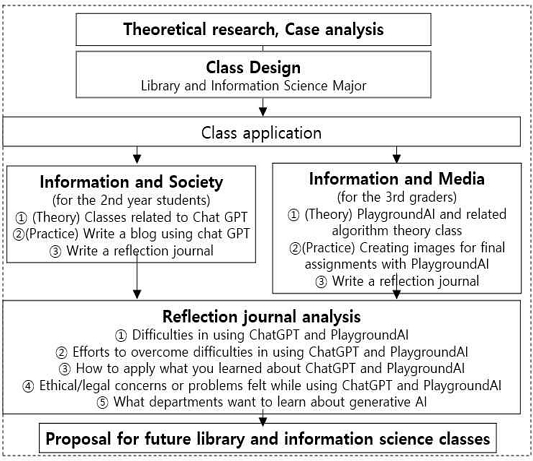

본 연구는 대학 교육에서 생성형 AI를 활용할 수 있는 방법을 정리하고 국내 문헌정보학 수업에서 도입할 수 있는 방안을 모색하였다. 챗GPT와 PlaygroundAI라는 생성형 AI를 활용하여 각각 1차시의 수업 모형을 설계하였다. 수업 전개 후 개선점을 파악하기 위해 문헌정보학과 2학년과 3학년 강의에 적용한 뒤 학생들이 느끼는 생성형 AI의 교육적 효과, 우려점, 한계를 분석하였다. 학생들의 성찰일지 분석을 통해 수업 후 교육 효과를 분석하고 추후 수정사항을 수렴하였다. 학생들은 생성형AI의 신뢰도와 프롬프트 작성에 대한 어려움을 토로하였다. 생성형 AI의 결과를 향상시키기 위해 학생들은 대부분 프롬프트를 수정하거나 가이드를 활용하는 등의 노력을 기울였다. 생성형 AI를 통해 제작된 결과물에 대한 윤리적/법적 우려를 표명하기도 하였다.본 연구를 통해 추후 미래 교육을 위한 출처 확인과 보강, 핵심 질문 설계, 중간 산출물의 메타적 읽기 등의 글쓰기 교육이 제안되었다.

Abstract

This research explores the ways in which generative AI can be utilized in university education and investigates the feasibility of implementing such technologies in a domestic course on library and information science. Two models for a single class session were designed using ChatGPT and PlaygroundAI, respectively. After applying these generative AI models to the library and information science course, the educational effects, concerns, and limitations of using generative AI were analyzed based on students' feedback and journal entries. In this way, the educational effects were examined, and necessary modifications were made for future iterations. Students expressed difficulties in creating prompts. To improve the results of generative AI, most students made efforts to modify prompts or use guides. Ethical/legal concerns about the results produced through generative AI were also expressed. Based on the results of this study, writing education, such as source identification and reinforcement, key question design, and meta-reading of intermediate products, was proposed.

Keywords:

ChatGPT, Class Design, Generative AI, Library and Information Science, PlaygroundAI키워드:

문헌정보학, 생성형 AI, 수업 설계, 챗GPT, 플레이그라운드AIⅠ. 서 론

생성형 인공지능(이하, 생성형 AI) 기술이 발전하면서 우리 삶의 다양한 영역에서 적용되고 있다. 특히 챗GPT(Chat Generative Pre-trained Transformer, 생성형 사전학습 트랜스포머)가 변화의 도화선이 되었다. 2022년 11월 30일 OpenAI사가 공개 도메인으로 챗GPT 서비스를 출시한 이후 챗GPT는 일주일 만에 구독자가 100만 명에 이를 만큼 인기를 끌었다. OpenAI에서 개발한 DALL-E와 Google이 LaMDA(Language Model for Dialogue Applications)모델로 구동하는 Bard 등이 꾸준히 소개되어 생성형 AI 서비스는 확장되고 있다[1]. 생성형 AI가 점점 그 영역을 확대하면서 교육 분야에서 생성형 AI의 활용에 대한 논쟁도 자연스럽게, 그렇지만 뜨겁게 발생하였다[1],[2].

생성형 AI는 교육자들에게 윤리적인 공격을 많이 받았다. 하지만 기존의 연구는 생성형 AI에 대한 비난보다는 우려와 흥분을 균형감 있게 수용할 수 있는 비판적 담론이 필요하다고 입을 모은다[1]. 전통적인 교육 패러다임을 고수하며 현장의 기술 발달을 외면하거나 금지하는 것은 바람직한 교육 방안이 아니며[3], 차라리 생성형 인공지능의 특징을 분석하여 장단점을 알아내고 학습자들과 공유한 뒤, 교육의 목적과 상황에 맞게 활용할 수 있도록 돕는 것이 더 타당하는 주장이다. 생성형 AI 서비스가 인간의 상호 작용이 부족하다면 다른 교수법과 함께 활용하면 강력한 교수매체가 될 수 있다[2].

이에 본 연구는 생성형 AI에 대한 논쟁을 문헌정보학의 미래 대학 교육에 대한 통찰력, 교훈이나 시사점과 조화시키기 위해 노력하였다. 본 연구는 생성형 AI를 활용할 수 있는 방법을 정리하고 국내 문헌정보학 수업에서 도입할 수 있는 방안을 모색하였다. 연구는 첫째, 생성형 AI의 특징과 장단점, 그리고 교육에 활용할 수 있는 기존의 연구 사례를 살펴보았다. 둘째, 챗GPT와 PlaygroundAI라는 생성형 AI를 활용하여 각각 1차시의 수업 모형을 설계하였다. 셋째, 문헌정보학 2학년과 3학년 강의에 적용한 뒤 학생들이 느끼는 생성형 AI의 어려운 점, 해결방안, 적용안, 윤리적/법적 문제와 추후 배우길 원하는 분야를 분석하였다. 마지막으로 학생들의 성찰일지 분석을 통해 수업 후 교육 효과를 분석하고 추후 수정사항을 수렴하였다. 성찰일지는 ① 챗GPT와 PlaygroundAI 이용 시 어려웠던 점, ② 챗GPT와 PlaygroundAI 이용 시 어려웠던 점을 극복하기 위한 노력, ③ 챗GPT와 PlaygroundAI 관련 배운 내용을 적용할 수 있는 방법, ④ 챗GPT와 PlaygroundAI를 활용하면서 느낀 윤리적/법적인 불안이나 문제, ⑤ 생성형 AI와 관련하여 학과에서 배우고 싶은 부분에 대해 질문하였다. 본 연구는 학생들의 목소리를 청취하여 생성형 AI가 라그나로크(Ragnarok, 신들의 몰락)로 향하는 것을 막고, 문헌정보학 교육을 위한 혁신적인 자원으로 공존할 수 있는 방안을 강구하고자 한다.

Ⅱ. 선행연구

2-1 생성형 AI

인공지능은 오랫동안 연구되었으나, 최근 생성형 AI가 주목을 받고 있다. 생성형 AI는 기존 데이터를 바탕으로 딥 러닝 모델을 활용하여, 복잡하고 다양한 프롬프트에 응답하는, 인간과 유사한 콘텐츠를 생성하는 기술로 정의한다[1]. 이렇게 텍스트를 분류하고 이해(discriminative)하는 것이 아니라 표현을 생성(generative)하는 수준으로 영향력을 끌어올린 기술이 상용화된 것은 챗GPT가 출현하면서 부터이다[3]. 챗GPT는 그 명칭에서 알 수 있듯이 특징을 크게 세 가지로 꼽아볼 수 있다[4]. 챗GPT(Chat Generative Pre-trained Transformer)의 생성형을 의미하는 ’Generative‘는 텍스트를 맥락에 맞게 효율적으로 학습하여 사용자의 요구에 응답하는 내용을 스스로 생성할 수 있다는 뜻이다. 챗GPT의 두 번째 단어인 Pre-trained는 기계가 미리 일정 내용을 학습했다는 뜻인데, 챗GPT는 무작위로 대량의 데이터를 전달한 뒤 인공지능이 스스로 단어 간 연관성을 파악해 지식 모델을 구축하는 비지도 학습 방법을 활용하였다. 이 방법으로 챗GPT는 저렴한 비용으로 빠르게 학습할 수 있다. 비지도 학습을 통한 연관 관계에 대해 Annotator라고 불리는 팀은 사실을 자연스럽게 표현하고, 사회 규범에 반하지 않는 답변에는 보상을 제공하여 강화학습을 진행하였다. 명칭의 마지막 단어는 Transformer인데 이는 챗GPT가 활용하는 인공 신경망 구조의 이름이다. 트랜스포머는 순차적으로 데이터를 처리하는 것이 아니라 '주의(attention)’ 메커니즘을 활용해 중요하다고 판별된 부분에만 주의를 기울여 읽도록 하였다.

본 연구에서는 이미지 작성을 위한 생성형 AI로 PlaygroundAI를 선정하였다. PlaygroundAI는 단순한 이미지가 아니라 도서관 현장에서 활용될 수 있는 그래픽이나 상품 디자인이 가능한 프로그램이다. 특히, 미술 디자이너가 아닌 전문 콘텐츠 크리에이터와 소규모 자영업자를 타겟으로 한 유일한 생성형 AI이다[5]. PlaygroundAI는 Stable Diffusion 1.5, Stable Diffusion 2.1, DALL-E 2 등의 모델을 선택하여 운영할 수 있으며, 무료로 제공되어 학생들의 접근성이 높다는 장점도 고려 대상이 되었다[6]. PlaygroundAI는 홈페이지에 흥미롭고 아름다운 이미지 갤러리를 배치하고 있는데 이용자들은 이 갤러리에서 이미지 자체나 프롬프트를 재사용할 수 있다[8]. 또는 필터와 이미지를 삽입하여 부분 변경하는 기능을 사용할 수 있는 등 손쉽게 이미지를 제작할 수 있다.

2-2 교육에서 생성형 AI 활용

인공지능은 선행연구는 교육 분야에서 생성형 AI가 활용될 수 있는 다양한 사례를 소개하고 있다. Chan과 Hu[8]의 연구에서는 홍콩의 대학생 399명을 설문 조사하였다. 학생들은 생성형 AI의 개인화되고 즉각적인 학습 지원, 글쓰기와 브레인스토밍 지원, 조사와 분석 지원, 영상과 오디오 멀티미디어 지원, 행정적 지원에 대해 긍정적인 영향이라고 언급하였다.

Baidoo-Anu과 Owusu Ansah[2]은 기존 연구를 분석하여 챗GPT는 형성 평가를 위한 기준표 작성, 맞춤형 튜터링, 개인화된 대화형 학습 촉진, 교육 및 학습 등에 정보를 제공하기 위해 지속적인 피드백을 제공하는 활동에 도입될 수 있다고 정리하였다.

또한 Lim[1]은 생성형 AI는 빠른 속도로 학습을 진행하여 새로운 지식의 발견을 가속할 수 있다고 보았으며, 평가 설계 방안을 비판적으로 분석하여 개선할 수 있다고 하였다. 생성형 AI를 학업에 활용하여 윤리적이며 발전적인 방법으로 활용할 수 있다는 점을 강조하기도 하였다.

연구마다 생성형 AI의 활용방법을 다양하게 소개하고 있으나, 정리하면 정보를 생성하는 능력을 활용한 아이디어 지원과 다양한 글쓰기, 조건에 따라 다르게 반응하는 능력을 활용하여 개인화된 튜터링, 대화형 학습 도구[9] 등으로 쓰일 수 있겠다.

2-3 교육에서 생성형 AI 활용 시 우려되는 점

Chan과 Hu[8]의 연구에서 홍콩 대학생들은 대부분 생성형 AI에 대해 긍정적인 반응을 보였다. 하지만 동시에 생성형 AI의 정확성과 투명성에 대한 과제, 프라이버시나 윤리적 문제에 관한 과제, 생성형 AI에 대한 과도한 의존이나 비판적 사고의 감소, 직업과 경력에 대한 영향, 사회적 불의와 불평등에 대한 기여에 우려의 목소리를 나타내었다.

이 밖에 잘못된 정보 생성, 기존 편향, 인간 상호 작용 부족, 프라이버시 문제 등을 증가시킬 수 있는 데이터 교육의 편향, 데이터 의존성, 맥락 이해 부족, 개인정보 보호 등의 어려움을 꼽은 연구도 있다[2].

생성형 AI는 재활용되는 지식 사이에서 새롭거나 창의적인 지식을 확인하기 어렵게 만들고, 잘못된 정보를 제공하는 허점을 드러낸다. 사람들이 무엇을 얼마나 많이 사용할 수 있는지에 따라, 다시 말해 프롬프트를 작성하는 능력에 따라 생성형 AI에 접근하는 정도도 크게 달라진다[1].

종합하면 생성형 AI를 교육에 활용하였을 때 우려되는 내용은 크게 두 가지로 정리할 수 있다. 생성형 AI가 지닌 알고리즘으로 인해 거짓 정보가 생성될 수 있으며, 프라이버시나 윤리적 문제가 야기된다. 다른 관점은 활용하는 인간과 관련이 있는데, 생성형 AI에 대한 이용자의 무분별한 의존이나 무조건적 흡수, 기술과 경험 차이에 의한 활용도의 차이 등을 우려되는 점으로 포함할 수 있다.

이처럼 기존의 연구에서 분석한 생성형 AI의 활용법과 우려되는 점은 다양하게 분석되었다. 하지만 국내 대학, 또는 문헌정보학과 재학생들의 상황과 경험 수준에서 분석된 결과는 기존 연구에서 찾을 수 없었다. 따라서 본 연구는 2023년을 살아가는 대학생들의 의견을 수렴하여 현재 우리가 생성형 AI를 도입하기 위해 문헌정보학 교육 시사점을 도출해보고자 한다.

Ⅲ. 연구설계와 방법론

3-1 연구설계

본 연구는 국내 A대학교 문헌정보학 전공 수업에서 챗GPT와 PlaygroundAI에 대한 이론 수업을 강의한 뒤 학생들이 직접 프로그램을 사용하게 하였다. 학습자들은 챗GPT를 활용하여 과제를 위한 블로그 글을 작성하고, 수업자료를 만들기 위해 PlaygroundAI를 활용하여 교수매체를 작성하였다. 실습 후 학생들은 느낀 바 그대로 성찰일지를 작성하였으며 연구자는 질적 분석을 수행하였다. 성찰일지의 질문에 대해 모든 학생들이 이해할 수 있도록 설명을 제공하였으며, 순수하게 연구에만 쓰인다는 사실을 충분히 설명하였다. 챗GPT 수업에 참여한 48명 가운데 자발적으로 성찰일지를 작성하고 연구분석에 기여할 수 있도록 동의한 47명의 성찰일지가 분석되었으며, PlaygroundAI를 활용한 학생 34명 가운데 연구에 참여 동의를 제출한 30명의 성찰일지만 분석 대상이 되었다.

총 77명이 작성한 성찰일지는 파일 형태로 LMS 시스템으로 수집되었으며, 연구자가 1차 코딩으로 개방코딩(Open Coding)하였다. 1차 코딩에서는 5개 문항에 대해 총 158개(챗GPT 관련 코드 94개, PlaygroundAI 관련 64개)의 코드가 도출되었다. 연구자가 연구보조원과의 합의를 통해 코드 가운데 유사한 개념끼리 범주화하여 각 문항에 대한 코드를 묶고 대-중-소의 차원으로 총 123개(챗GPT 관련 코드 67개, PlaygroundAI 관련 56개)를 구성하였다.

3-2 수업 설계 내용

2023학년도 1학기 ‘정보와 사회’라는 2학년 수업과 ‘정보와 매체’라는 3학년 수업에서 생성형AI에 대한 내용을 다루었다. ‘정보와 사회’는 정보사회를 이해하고 문제점을 분석하며 관련 기술을 학습하는 과목인데, 10주 차부터 정보사회에서 크게 활용되고 있는 기술을 소개한다. 학생들은 과제로 한 학기 동안 총 5건의 블로그 글을 작성한다. 1차시 수업은 인공지능이라는 기술을 설명하는 10주 차에 진행되었으며 마지막 블로그 글쓰기에서 활용할 수 있도록 진행하였다. 75분 수업 동안 생성형AI에 대한 이론과 무료 버전인 챗GPT 3.5 실습이 동시에 이루어졌다. 이론에서는 ① 챗GPT가 뭐길래, ② 챗GPT 작동 원리, ③ 좋은 프롬프트 쓰는 방법, ④ 챗GPT로 1분 만에 블로그 글쓰기, ⑤ 생각하기: 챗GPT와 함께 살기 순서로 관련 내용을 소개하였다. 챗GPT를 사용한 경험이 있는 학생이 거의 없어 프롬프트에 대해 상세히 소개하였다. 이론 수업 이후 연구자가 챗GPT를 활용하여 블로그를 작성하는 방법을 소개하였다. 학생들은 각자 실습을 통해 챗GPT에서 본인의 관심사에 맞는 블로그 주제를 선정하고, 내용을 작성하고, 대표 이미지와 디스크립션을 작성하는 방법을 직접 경험하였다.

‘정보와 매체’는 정보와 지식을 전달하는 수단으로서 정보 매체의 유형과 특징에 대해 이해하고, 직접 제작하는 실습을 아우르는 과목이다. 11주는 화상자료에 대한 이론을 배우고 실습하는 시간으로 계획되어 해당 차시에 ① 챗GPT부터 알아보자!, ② 챗GPT 작동 원리, ③ 좋은 프롬프트 쓰는 방법, ④ 그림 생성 AI 알고리즘과 PlaygroundAI 활용방법, ⑤ 생각하기: 챗GPT와 함께 실기 순서로 수업을 진행하였다. 특히 이미지 생성을 위한 프롬프트 작성을 위해 GAN(적대적 생성 신경망, Generative Adversarial Networks)모델과 확산모델(Diffusion Model)을 설명하여 생성방법에 대한 이해를 도왔다. 수업 후 학생들은 기말과제로 작성 중인 수업계획안을 바탕으로 학생들이 계획 중인 도서관 활용 수업에 필요한 이미지를 제작하였다.

연구자는 수업 후 연구의 취지를 설명하였으며, 참여에 동의하는 학생에 한해 성찰일지를 과제로 출제하였다. 대부분의 학생은 본인의 생각을 정리하고 분석 결과를 추후 연구와 문헌정보학 수업에 반영할 수 있도록 성찰일지를 작성하여 제출하였다.

Ⅳ. 분석결과

본 연구는 생성형 AI 수업을 듣고 프로그램으로 결과물을 제작해 본 학생들의 성찰일지를 분석하였다. 성찰일지의 내용은 ① 챗GPT와 PlaygroundAI 이용 시 어려웠던 점, ② 챗GPT와 PlaygroundAI 이용 시 어려웠던 점을 극복하기 위한 노력, ③ 챗GPT와 PlaygroundAI 관련 배운 내용을 적용할 수 있는 방법, ④ 챗GPT와 PlaygroundAI를 활용하면서 느낀 윤리적/법적인 불안이나 문제, ⑤ 생성형 AI와 관련하여 학과에서 배우고 싶은 부분으로 구성되었다.

4-1 챗GPT 이용 시 어려웠던 점

학생들이 챗GPT를 활용하면서 가장 어려웠던 점은 결과의 품질(44.1%), 질의형성(36.3%), 이용 경험(19.6%) 순이었다.

우선, 결과의 품질과 관련하여 세부 요소를 보면, 학생들이 경험한 가장 큰 어려움은 챗GPT가 신뢰도가 낮은 거짓 정보나 이야기를 제공한다는 점이었다. 총 15명(14.7%)이 결과물에 대해 신뢰를 하기 어렵다는 점을 지적하였고, 이어서 8명의 학생도 정확도(7.8%)에 대한 의심을 나타냈다. 제주도의 여행지에 대한 글에 다른 지역의 관광지를 예시로 들거나, 존재하지 않는 맛집을 소개하는 등 이용자가 쉽게 발견할 수 있는 거짓 정보가 많았다. 또한 결과물이 너무 광범위해서 일반적인 이야기(7명, 6.9%)나 학생들의 의도를 이해하지 못한 결과(5명, 4.9%), 그리고 프롬프트와 관련 없는 정보(4명, 3.9%)에 대한 지적도 15.7%나 되었다. 한글의 정확도가 낮다는 의견과 너무 간결한 정보가 제시되었다는 의견도 각각 3명(2.9%) 있었다.

이어서 프롬프트, 즉 챗GPT에게 질의를 작성하는 과정에서도 어려움을 겪은 학생이 많았다. 우선 상세한 내용을 설정하고, 관련한 조건을 생성하는 과정의 어려움을 토로하는 경우가 14명(13.7%)이나 되었다. 어휘력의 한계, 동음이의어 처리, 그리고 영어를 활용하여 질의를 형성하는 과정의 어려움은 10명(9.8%)이 언급하였다. 질문을 시작하는 방법에서 어려움을 겪은 학생은 9명(8.8%), 문장을 표현하거나 적절한 어투를 사용하는 데 어려움을 겪었다는 학생은 4명(3.9%) 존재하였다.

한글로 질문을 작성할 때 처리 시간이 길어진다는 의견이 7건(6.9%), 결과가 정확한지 이용자가 검증해야 하는 과정이 필요했다는 의견이 6건(5.9%) 도출되었다. 챗GPT가 설정된 조건을 무시하거나 오류를 일으킨다는 보고도 4건(3.9%) 있었으며, 무엇보다 이용자 스스로 새로운 인공지능을 어떻게 활용해야 할지 고민스럽거나 이용방법을 잘 모르는 경우도 3건(2.9%) 있었다.

4-2 챗GPT 이용 시 어려웠던 점을 극복하기 위한 노력

학생들은 챗GPT 이용 시 느꼈던 어려움을 해결하기 위해 프롬프트의 내용(76.0%)과 형식(4.2%)을 변경하는 노력을 기울였으며 추가적인 작업을 통해(19.8%) 문제를 해결하고자 노력하였다.

가장 큰 노력은 프롬프트의 내용을 변경하는 작업이었다. 가장 큰 노력을 기울인 부분이 주제에 대해 더 구체적이고 상세하게 질문을 작성하거나, 요소와 조건을 고려하며 육하원칙을 적용하는 경우로 총 24건, 즉 기울인 노력 가운데 1/4은 상세화 노력으로 나타났다. 기존의 질문을 여러 차례 수정했다는 건수도 20건(20.8%)에 달해 이런저런 방식으로 질문을 수정한 경우가 거의 과반에 이르렀다. 한국어 답변의 한계를 느낀 학생은 영어로 번역하는 노력을 기울였는데, 11건(11.5%)이 영어 번역으로 답변을 하였고, 답변 가운데 2건은 특정 번역툴(파파고, 디플)을 언급하기도 하였다. 결과의 범위를 축소하거나 확장한다는 답변은 6건(6.3%)이었으며, 문체, 맥락, 문장형식을 제공한다는 응답은 5건(5.2%)을 기록하였다. 중간에 대상, 키워드, 주제 등을 변경하는 경우(4건, 4.2%)와 하나의 맥락으로 유지하고, 짧은 문장을 사용하며, 문장 부호를 활용한 경우(3건, 3.1%)도 목격되었다.

이용자 스스로 추가적인 작업을 진행한 예도 다수 지적되었다. 이용자가 스스로 정보를 다시 검색하고, 검토하며, 검증하는 행동을 진행한 사례도 14건(14.6%) 보고되었으며, 수업자료를 활용하거나 학우와 또래학습을 진행한 경우도 4건(4.2%) 확인되었다. 챗GPT의 답변에 대해 출처를 요구했으나 출처 역시 확인되지 않은 경우도 1건 있었다.

프롬프트의 분량이나 포맷을 변경한 경우는 총 4건밖에 되지 않았다.

4-3 챗GPT 관련 배운 내용을 적용할 수 있는 방법

이번 수업에서 배운 내용을 내 생활이나 미래 업무에 어떻게 적용해 볼 수 있겠는가에 관한 질문에 과반이 넘는 학생들은 도서관 세팅에서의 활용(37건, 51.4%)에 대해 언급하였고, 일반적인 글쓰기(21건, 29.2%)와 대학 생활에서의 활용(14건, 19.4%) 순으로 응답하였다.

가장 많은 호응을 보인 도서관 업무에서의 활용에서는 도서관에서의 기획 업무와 자료 조사(14건, 19.4%)와 도서관에서의 정보 검색 업무(7건, 9.7%) 순으로 응답이 나타났다. 이어서 도서 분류와 자료 정리 업무 5건, 보고서 작성 업무 4건, 참고 서비스 3건, 데이터 분석과 큐레이션 업무 2건, 반복되는 루틴 2건 등으로 나타났다. 성찰일지를 제공한 47명의 학생 가운데 37명의 학생이 미래 업무에 배운 내용을 접목하여 응답한 점이 인상 깊다.

이번 수업에서 배운 내용을 내 생활이나 미래 업무에 어떻게 적용해 볼 수 있겠는가에 대한 질문에 과반이 넘는 학생들은 도서관 세팅에서의 활용(37건, 51.4%)에 대해 언급하였고, 일반적인 글쓰기(21건, 29.2%)와 대학 생활에서의 활용(14건, 19.4%) 순으로 응답하였다.

가장 많은 호응을 보인 도서관 업무에서의 활용에서는 도서관에서의 기획 업무와 자료 조사(14건, 19.4%)와 도서관에서의 정보 검색 업무(7건, 9.7%) 순으로 응답이 나타났다. 이어서 도서 분류와 자료 정리 업무 5건, 보고서 작성 업무 4건, 참고 서비스 3건, 데이터 분석과 큐레이션 업무 2건, 반복되는 루틴 2건 등으로 나타났다. 성찰일지를 제공한 47명의 학생 가운데 37명의 학생이 미래 업무에 배운 내용을 접목하여 응답한 점이 인상 깊다.

12건(16.7%)이 일반적인 글쓰기 과정에서 주제를 선정하고, 아이디어를 구체화하는 작업에 수업 내용을 접목할 수 있다고 응답하였다. 점심 식사 메뉴를 정하는 등 일상 속 선택이나 개인적인 고민 해결에 배운 내용을 적용할 수 있겠다는 의견이 5건(6.9%)이었으면 일반적인 글쓰기에 도움이 되겠다는 의견이 4건(5.6%) 보고되었다.

대학 생활에 대한 적용 응답이 가장 적었는데, 이 분류 가운데 프로그래밍을 학습하고, 오류를 검사하는 과정(7건, 9.7%)에서 도움이 되겠다는 의견이 가장 많았다. 면접이나 동아리 공지 글 또는 발표스크립트, 블로그, 자기소개서에 활용 가능하다는 의견이 3건씩(4.2%) 있었다. 외국어 학습에 이용할 수 있겠다는 의견도 1건 보고되었다.

4-4 챗GPT를 활용한 블로그를 작성하며 느낀 윤리적/법적인 불안이나 문제

학생들은 챗GPT를 작성하며 느낀 윤리적/법적인 불안이나 문제 90건을 보고하였다. 그 가운데 대부분이 결과에 대한 우려로 총 72건(80.0%)이 지적되었으며, 활용 상의 문제(11건, 12.2%), 시스템이나 이용자의 한계(7건, 7.8%) 순으로 문제가 전달되었다.

학생들이 가장 우려의 목소리를 높은 부분으로 결과물의 출처를 알 수 없음(22건, 24.4%)과 챗GPT가 어떻게 저작권을 해결하는지(18건, 20.0%)가 언급되었다. 과반에 가까운 학생들이 출처를 정확히 알 수 없거나 저작권에 대한 논란에 대해 문제라는 의식을 하고 있었다. 결과물에서 가짜 뉴스나 거짓 정보가 생성되는 경우(12건, 13.3%)와 표절이 발생하거나 소유권에 대한 시비가 일어나는 경우(10건, 11.1%)도 10%가 넘는 우려를 나타냈고, 기타 혐오나 편견을 학습하는 결과(4건 4.4%)와 고유성을 가지지 못하고 누군가의 글과 유사한 내용을 생성하는 문제와 오류가 발생하거나 정확하지 않은 문제도 각각 3건씩 지적되었다.

챗GPT의 활용상 문제는 가장 걱정되는 부분이 프라이버시 침해나 개인적인 질문을 악용하는 사례(6건, 6.7%)로 전해졌다. 이어 정치적으로나 사이버 범죄 등에 결과물이 악용될 수 있다는 의견도 4건(4.4%) 접수되었으며, 창작자에게 위협이 될 수 있다는 의견도 1건 있었다.

챗GPT가 최신 정보나 사람과 같은 센스가 부족해 정보를 제대로 제공하지 못하는 한계, 시스템 주석작업 시 Annotator 노동착취에 관련된 논란, 결과물을 다시 확인하고 재검증해야 하는 필요성 등에 대해 2건씩 지적이 있었다. 마지막으로 이용자 스스로 챗GPT에 대한 이해와 이용할 수 있는 능력이 필요하다는 의견이 1건 보고되었다.

4-5 챗GPT 관련하여 학과에서 배우고 싶은 부분

챗GPT와 관련하여 추후 학과에서 배우고 싶은 내용은 챗GPT 이용과 활용방안(53건, 75.7%)이 2/3를 넘었으며, 인공지능에 대한 일반적인 내용이 17건(24.3%) 보고되었다.

챗GPT 이용과 활용방안에 관한 내용으로 챗GPT를 이용할 때 효과적인 질문 방법이나 프롬프트 작성법에 대한 수요(20건, 28.6%)가 가장 많았으며, 분류나 콘텐츠 작성을 포함한 도서관 실무에서의 적용 방법(13건, 18.6%)도 요구가 많았다. 이외 9건은 기업활용방안(4), 실생활적용방법(3), 적용분야 어떤 것이 있는지(2)에 대해 요구하였다. 신뢰도를 평가하고 검증하는 방법과 가짜뉴스를 구별하고 오류를 줄이는 방법을 알고 싶은 요구도 각각 4건씩 도출되었다. 이밖에 프로그래밍이나 데이터베이스 구축과 관련하여 챗GPT를 어떻게 활용할 수 있는지에 대한 내용도 3번 언급되었다.

인공지능의 개발, 활용 및 영향에 관련된 윤리적 측면과 관련된 내용을 배우고 싶다는 의견과 인공지능 시스템의 구성과 동작 원리, 데이터 입력 방식이 각각 6건(8.6%)과 5건(7.1%) 언급되었다. 인공지능의 발전 가능성과 미래 전망, 인간과 인공지능의 공존 방법이 3건(4.3%), 현재 진행 중인 인공지능 연구 및 인간의 개입이 필요한 학문이 2건(2.9%), 그리고 다른 생성형 인공지능에 대한 내용이 1건(1.4%) 언급되어 학생들의 다양한 호기심을 엿볼 수 있었다.

4-6 PlaygroundAI 이용 시 어려웠던 점

PlaygroundAI 이용 시 어려웠던 점도 챗GPT 이용과 비슷한 응답이 접수되었다. 결과 품질에 대한 어려움 호소가 28건(46.7%)으로 거의 과반을 이루었으며 질의형성 19건(31.7%)과 이용 경험 13건(21.7%)의 어려움이 보고되었다.

가장 많은 학생은 PlaygroundAI가 이용자가 지적하는 구체적이고 명확한 부분이나 부위를 인지하지 못하여 프롬프트 상으로 변경할 수 없는 점(12건, 20.0%)을 가장 큰 어려움으로 꼽았다. 바지만 색상을 변경하라는 주문에 전체 의상의 색을 변경하거나, 얼굴에서 표정을 변경하려고 했으나 알아듣지 못하는 등 오브젝트의 각 명칭과 부위에 대한 이해가 부족하였다. 학생들은 PlaygroundAI가 이용자의 의도를 제대로 이해하지 못하는 현상(9건, 15.0%)과 관련 없거나 적합하지 않은 이미지를 생성하는 현상(6건, 10.0%)에도 어려움을 경험하였으며 동적 이미지를 생성하는데 제한이 있다는 의견도 1건 등록되었다.

질의형성에서 학생들이 가장 어려워한 부분은 질문이나 요청을 문장으로 구성하고 언어로 표현하는 과정(12건, 20.0%)에서 겪은 어려움이다. 사람들의 몸짓이나 특정 상황을 언어로 구현해야 한다는 점이 특히 어려웠다는 의견이 많았다. 이어서 이용자가 질문을 시작하기 위해 프롬프트를 작성하는 과정(5건, 8.3%)에 대한 어려움과 질문이나 요청에 대해 상세한 조건을 설정하는 과정(2건, 3.3%)에 대한 문제도 보고되었다.

PlaygroundAI를 경험하면서 느낀 어려움은 눈이 3개인 사람이나 부품이 이상한 위치에 달린 사물 등 그림 자체에서 발생하는 여러 오류(7건, 11.7%), 홈페이지가 영어로만 구현되어 이용이 쉽지 않은 점(4건, 6.7%), 그리고 소요 시간이 길게 걸리는 점과 AI 알고리즘을 이해해야 하는 불편함(각각 1건씩, 1.5%)이 지적되었다.

4-7 PlaygroundAI 이용 시 어려웠던 점을 극복하기 위한 노력

대부분의 노력은 내용 수정(30건, 52.6%)과 그림 수정과 필터사용(24건, 42.1%)이 대부분이었으며 이용자의 다른 노력도 3가지 보고되었다.

학생들이 가장 애쓴 부분은 프롬프트를 수정하여 조금 더 본인이 원하는 그림으로 변경해보려는 점이었다. 18건(31.0%)은 프롬프트를 상세하게 수정하려 애썼다고 보고했으며, 기존의 프롬프트 샘플을 확인하고 프롬프트 가이던스를 활용하는 노력이 5건(8.6%) 보고되었다. 과정에서 그림의 대상이나 주제를 변경하는 노력도 3건(5.2%) 있었다.

학생들은 PlaygroundAI에서 제공하는 다양한 옵션을 사용하기도 하였다. 필터나 모드를 수정했다는 의견이 8건(13.8%)으로 가장 많았으며 퀄리티&디테일(이미지의 품질과 디테일 정도 지정), Image to Image(샘플 이미지 제공)등의 기법을 사용하거나 문장의 길이를 짧게 하여 인공지능이 이해를 쉽게 할 수 있도록 안내하는 개선 작업이 각각 4건씩(6.9%) 보고되었다. 이 밖에도 Exclude From Image(이미지에서 제외할 요소 선정)와 배경을 제거하는 노력도 3건과 1건씩 보고되었다.

이외에 튜토리얼을 시청했다는 의견, 수업자료를 리뷰했다는 의견과 함께 다른 AI를 활용하고 싶다는 의견이 1건씩 조사되었다.

4-8 PlaygroundAI와 관련 배운 내용을 적용할 수 있는 방법

이미지를 생성하는 인공지능의 활용방안에 대해서는 챗GPT보다 다양한 의견이 도출되지는 않았다. 참여 학생은 특정 주제나 목적이 없이 다양한 종류의 이미지 생성에 대한 활용 의견을 거의 과반수만큼 선택하였다. 생각으로만 하고 있던 이미지를 형상화하거나 부족한 그림 실력을 보완할 수 있다는 의견이 8건(21.6%), 포스터/홍보물/카드뉴스 제작 등 홍보나 정보전달을 위한 이미지 제작은 6건(16.2%)이 언급되었다. 기타 시각화 아이디어를 얻거나 참고용 자료/ 배경화면을 만들 수 있겠다는 의견이 각각 2건( 5.4%)씩 있었다.

이어 대학 생활에 적용할 수 있다는 의견이 10건 나타났다. 대학에서의 교육이나 과제 수행에 적용하겠다는 의견이 5건(13.2%), 블로그나 SNS에 작성한다는 의견이 3건(7.9%), 공모전을 포함한 대외활동에 대한 의견이 2건(5.3%) 확인되었다.

도서관 업무에 적용할 수 있겠다는 의견이 9건 도출되었다. 기획(3건), 프로그램 운영(2건), 홍보(2건), 참고 서비스(1건), 도서관 업무 관련 이미지 생성이 필요한 경우 디자이너에게 작업 요청 시(1건) 등 다양한 분야에 적용될 수 있다는 의견이 발견되었다.

특이하게도, 현재 PlaygroundAI가 완벽하지 않아 본인이 기존에 사용하던 이미지 제작툴을 그대로 사용하겠다는 의견이 1건 보고되었다.

4-9 PlaygroundAI를 활용한 블로그를 작성하며 느낀 윤리적/법적인 불안이나 문제

PlaygroundAI를 사용하면서 이용자들이 느낀 윤리적/법적인 불안이나 문제도 챗GPT에 대한 우려와 비슷한 양상을 띠었다. 학생들은 결과에 대한 우려(39건, 75.0%)를 가장 많이 드러냈으며, 활용 상의 문제(7건, 13.5%)와 시스템의 한계(6건, 11.5%) 순으로 우려를 표현하였다.

결과물에 대한 우려를 살펴보면, 1/3에 이르는 학생들은 저작권이나 초상권에 대한 우려(16건, 30.8%)를 표현하였으며, 표절이나 소유 시비, 창작자의 권리 침해에 대한 우려도 큰 횟수(12건, 23.1%)로 나타났다. 또한, 출처를 알 수 없는 결과물(5건, 9.6%)이나 선정적이거나 폭력적인 그림(3건, 5.8%), 고유성이 결여된 그림(2건, 3.8%), 혐오 또는 편견을 학습한 결과에 대한 우려(1건, 1.9%)도 나타냈다.

활용 상의 문제는 이미지의 악용(5건, 9.6%)이 가장 우려되는 부분으로 꼽혔다. 학생들은 학교 폭력이나 괴롭힘의 도구로 활용되거나 학습대상이 된 작품의 창작자에게는 생계의 문제를 악화시키는 장치로 사용될 수 있다는 점에 경고등을 켰다. 기타 가품의 논란이 있을 수 있는 경우와 창작자들이 AI에 의존만 하는 경우가 각각 1건씩(1.9%) 지적되었다.

학생들은 법제도의 정비가 필요하다는 의견(5건, 9.6%)과 PlaygroundAI가 부적합한 그림을 완성한다는 점을 시스템의 한계로 꼽았다.

4-10 PlaygroundAI와 관련하여 학과에서 배우고 싶은 부분

PlaygroundAI에 대한 질문 가운데 PlaygroundAI와 관련하여 학과에서 배우고 싶은 부분에 대한 답변이 총 33건으로 가장 적은 수치를 기록하였다. PlaygroundAI 이용과 활용방안이 17건(51.5%), AI의 일반 내용에 대해 배우고 싶다는 의견이 16건(48.5%) 나타났다.

PlaygroundAI 이용과 활용방안에 대해 알고 싶다는 의견 가운데 가장 많은 수요를 나타낸 것은 챗GPT의 사례와 같이 프롬프트 작성법과 예시에 대한 정보(10건, 30.3%)가 가장 많았다. 이어 도서관 실무 적용 방법이 3건(9.1%), 다양한 활용 예시와 기업활용방안과 출판물생성 방법에 대한 의견이 2건씩(6.1%) 도출되었다.

AI의 일반 내용과 관련하여서는 이용자들은 인공지능의 저작권, 윤리, 원칙, 문제에 관한 내용에 관심(6건, 18.2%)을 가지고 있다. 다른 생성형 인공지능에 대한 관심(5건, 15.2%)과 인공지능의 작동 방식과 알고리즘에 대한 정보(4건, 12.1%)와 발전가능성(1건, 3.0%)에 대해서 배우고자 하는 의지가 있었다.

Ⅴ. 결론 및 제언

Chan과 Hu[8]의 연구에서는 학생들이 생성형 AI에 대한 지식과 사용 빈도가 양의 관계를 하고 있다는 사실을 밝혔다. 즉, 기술과 실습에 대한 경험이 학생들의 생성형 AI에 대한 이해와 수용을 향상시키는데 도움이 될 수 있음을 시사하였다. 본 연구는 인공지능 시대를 살아갈 학생들, 특히 문헌정보학을 공부하는 학생들의 성장을 위해 진행되었다. 학생들에게 생성형 AI에 대한 지식을 전달하는 교육을 제공 후 그들의 성장을 촉진하는 방안을 아래와 같이 종합하였다.

학생들은 생성형 AI를 이용하면서 느낀 어려움과 관련하여 챗GPT나 PlaygroundAI를 배우고 실습한 학생들은 결과물에 대한 신뢰성, 정확도, 의도에 맞는 정보 등에 대해 우려의 반응을 보였다. 거짓 이야기를 지어내는 신뢰도 부분에 대한 지적이 가장 많았는데, 이는 이미 선행연구에서 지적된 부분이다[2],[8]. 이를 해결하기 위해 앞으로의 교육은 출처의 서지사항과 유통 매체 등을 확인하고 필요할 때 보강하는 글쓰기 교육이 강화될 필요가 있다[3]. 더불어 생성형 AI가 작성한 결과가 질문의 의도에 맞게 작성되었는지를 확인하는 과정을 거쳐야 한다[7].

더불어 학생들은 질의형성 방법에 대한 어려움을 토로하였다. 생성형 AI는 질문 방식과 수준에 따라 결과물의 차이가 크므로 잘 질문하는 방법을 익히는 것이 중요하다[7]. 전통적인 온라인 정보 검색은 내용 생성을 위주로 작동하였다면, 생성형 AI는 질문 생성으로 그 중요성이 옮아가고 있어서 어느 정도 예상할 수 있는 결과라고 볼 수 있겠다. Chang은 학생들이 질문을 생성할 수 있도록 돕는 훈련으로 ‘핵심 질문의 설계 방법’을 제안한다. 핵심 질문을 생성하고, 제한적인 질문을 구체화하고, 오개념을 예측하는 방법 등을 교육에 적용해볼 수 있다. 다양한 층위에서 주제, 목적, 독자, 방법, 필자 등을 고려하여 질문을 생성할 수도 있다. Chang의 제안에 더하여, 프롬프트를 작성하는 방법은 기존에 검색을 위한 쿼리를 생성하던 문헌정보학의 교수법을 확대하여 적용할 수 있다. 그리고 문해력 가운데 문맥에 맞는 대화를 형성하는 리터러시 교육을 강화하여 부족한 부분을 보강할 수 있다.

생성형 AI의 결과를 향상시키기 위해 학생들은 대부분 프롬프트를 수정하거나 가이드를 활용하는 등의 노력을 기울였다. 특히 텍스트를 기반으로 하는 챗GPT의 문제를 해결하고자 수차례 질문을 수정하고 영어를 활용하거나 맥락을 추가로 제공하는 모습을 보였다. 이는 Chang[3]의 연구에서 언급되었듯이, 학생들은 새로운 시대의 글쓰기 능력 가운데 결과물을 메타적으로 읽는 능력이 필요하다는 내용과 일치한다. 인공지능 시대의 교육은 중간 산출물을 성취하고자 하는 목적과 맥락에 비교하고 얼마나 도달했는지에 대한 판단을 내리는 능력을 배양하는 교육을 강화할 필요가 있다. 더불어 생성형 AI의 결과물에 인간의 창의성이나 전문성을 더해야 한다[7]. 생성형 AI가 생성된 원리를 참고하면, 인공지능은 보조적인 역할을 수행할 수밖에 없다. 창조적인 인간의 수정작업을 거친 뒤에야 완성도를 높일 수 있음을 이해하고 전문성과 창의성을 극대화하는 노력을 기울여야 하겠다.

생성형 AI를 둘러싼 윤리적/법적 문제에 대해서는 학생들은 생성형 AI의 시스템이나 능력에 대한 내용(챗GPT 7.8%, PlaygroundAI 11.5%)보다는 생성형 AI를 통해 제작된 결과물에 대한 윤리적/법적 우려(챗GPT 80.0%, PlaygroundAI 75.0%)가 8배 이상 훨씬 높았다. 따라서 생성형 AI 수업 전에는 생성형 AI가 지닌 강점/특징을 소개하는 시간을 갖는 것 이외에도 다양한 우려점과 약점을 공유할 필요가 있다. 본 연구에서 도출된 가짜뉴스/거짓정보, 고유성 결여, 선정적/폭력적 성향의 작품, 오류/정확도 문제, 저작권/초상권 시비, 출처를 알지 못함, 표절/소유 시비, 창작자 권리 침해, 혐오/편견 학습 결과뿐만 아니라 선행연구에서 제안한 내용/데이터 중심 설계와 권력 관계, 이용자 행동의 악영향 등[10]이 포함될 수 있도록, 또는 학생들이 스스로 윤리적/법적 문제를 찾아보고 토론을 나눌 수 있는 시간을 가질 필요가 있다. 현재는 여러 국가가 인공지능과 관련한 법제화를 서두르고 있다. 법률은 인공지능이 고려해야 할 최소한의 가치와 규범을 성문화할 것이다. 하지만 인공지능이 가진 윤리적인 문제는 법적 프레임워크가 제한하는 범위보다 훨씬 개인과 사회의 모습을 변화시킬 것이다. 때문에 인류는 집단지성으로 윤리적인 문제를 발굴하고 해결에 협력하는 과정을 구성하여야 할 것이다.

학생들이 생성형 AI에 대해 미래 직업군에서 활용할 수 있을 것이라고 긍정적으로 답변하였으며, 이런 결과는 예비교사를 상대로 한 연구와 맥을 같이 한다[12]. 학생들은 인공지능을 능숙하게 다루기 위해 프롬프트 작성법이나 사회에서의 활용방안에 대해 궁금해하였다. 비록 본 논문에서는 예비사서들이 기술을 활용하는 경험에만 무게 중심을 두었으나, 인공지능 활용 효능감이 기술에 영향을 미친다는 연구[12]에 따라 배우고 싶은 부분 분석과 함께 효능감을 높일 수 있는 방법론도 추후 연구가 필요해 보인다.

본 연구는 초기 탐험적 연구로 여러 제한점을 가지고 있다. 표본의 크기가 상대적으로 작기 때문에 일반화의 제한이 있다. 또한, 수업의 난이도와 참여 정도에 따라 기술 경험에 대한 학생들의 개인적인 경험이 영향을 줄 수 있다[8]. 따라서 추후 연구에서는 정량적으로 의미 있는 샘플군의 의견을 청취하고, 시간 경과에 따라 학생들의 학업 수준이나 인식의 변화가 어떻게 이루어졌는지에 대한 조사가 필요하다. 본 연구 결과에서 도출된 생성형 AI의 부정적 우려를 최소화하고 고등교육에 최적화할 수 있는 방안에 대한 추가 연구도 필요하다. 무엇보다 생성형 AI를 통해 문헌정보학의 최신 연구 분야와 내용을 교수·학습할 수 있는 효과적인 방향에 대한 다양한 토론과 연구가 절실한 시점이다.

Acknowledgments

본 연구는 2019년도 동덕여자대학교 학술연구비 지원에 의하여 수행된 것임.

References

-

W. M. Lim, A. Gunasekara, J. L. Pallant, J. I. Pallant, and E. Pechenkina, “Generative AI and the Future of Education: Ragnarök or Reformation? A Paradoxical Perspective from Management Educators,” The International Journal of Management Education, Vol. 21, No. 2, 100790, July 2023.

[https://doi.org/10.1016/j.ijme.2023.100790]

-

D. Baidoo-Anu and L. Owusu Ansah, “Education in the Era of Generative Artificial Intelligence (AI): Understanding the Potential Benefits of ChatGPT in Promoting Teaching and Learning,” SSRN, 4337484, April 2023.

[https://doi.org/10.2139/ssrn.4337484]

-

S. Chang, “ChatGPT has Changed the Future of Writing Education - Focusing on the Response of Writing Education in the Era of Artificial Intelligence -,” Writing Research, Vol. 56, pp. 7-34, March 2023.

[https://doi.org/10.31565/korrow.2023..56.001]

- J. S. Kim, W. J. Yu, and S. J. An, How to Use ChatGPT, Paju: Wikibook, pp. 70-115, 304, 2023.

-

A. H.-C. Hwang, “Too Late to be Creative? AI-empowered Tools in Creative Processes,” in Proceedings of CHI EA ’22: Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems, New Orleans: LA, pp. 1-9, April 2022.

[https://doi.org/10.1145/3491101.3503549]

- Playground AI. Website [Internet]. Available: https://playgroundai.com/, .

- J. H. Yang and S. H. Yoon, Beyond ChatGPT to the Generative AI Era: Cases of Media/Content Generation Type AI Services and Ways to Securing Competitiveness, Korea Communications Agency, Naju, Media Issue & Trend Domestic Report Vol. 55, pp. 62-70, April 2023.

-

C. K. Y. Chan and W. Hu, “Students’ Voices on Generative AI: Perceptions, Benefits, and Challenges in Higher Education,” arXiv: 2305.00290, , April 2023.

[https://doi.org/10.48550/arXiv.2305.00290]

-

J. Qadir, “Engineering Education in the Era of ChatGPT: Promise and Pitfalls of Generative AI for Education,” in Proceedings of 2023 IEEE Global Engineering Education Conference (EDUCON), Salmiya, Kuwait, pp. 1-9, May 2023.

[https://doi.org/10.1109/EDUCON54358.2023.10125121]

-

H. Vartiainen and M. Tedre, “Using Artificial Intelligence in Craft Education: Crafting with Text-to-Image Generative Models,” Digital Creativity, Vol. 34, No. 1, pp. 1-21, February 2023.

[https://doi.org/10.1080/14626268.2023.2174557]

- OpenAI. Democratic Inputs to AI [Internet]. Available: https://openai.com/blog/democratic-inputs-to-ai, .

-

J. Yoon, S.-R. Her, and S.-J. Kang, “Analysis of the Effect of the AI Utilization Competency Enhancement Education Program on AI Understanding, AI Efficacy, and AI Utilization Perception Improvement among Pre-service Secondary Science Teachers,” Journal of the Korean Association for Science Education, Vol. 43, No. 2, pp. 99-110, April 2023.

[https://doi.org/10.14697/jkase.2023.43.2.99]

2011년:뉴욕주립대학교(버팔로) 대학원 (문헌정보학 석사)

2015년:플로리다주립대학교 대학원 (문헌정보학 박사)

2002년~2010년: LG상남도서관

2015년~현 재: 동덕여자대학교 문헌정보학전공 부교수

※관심분야:정보추구 행동(Information Behavior), 혁신과 사서의 리더십 (Innovation and librarians’ leadership) 등