TransMotion: 신체적 자기효능감 향상을 도와주는 머신러닝 기반의 발레체험 시스템에 관한 연구

Copyright ⓒ 2019 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 논문에서는 간접적 발레체험을 통해 움직임의 미적 체험을 제공하고 신체적 자기효능감 향상을 돕는 머신러닝 기반의 발레 동작 체험 시스템인 TransMotion을 제안한다. TransMotion은 머신러닝 기반으로 사용자의 포즈를 인식하고 그와 유사한 포즈를 지니는 발레 동작을 시각적으로 체험하게 제공하는 시스템이다. 제안하는 시스템은 개개인이 미처 인식하지 못했던 자신의 신체가 만들어 낼 수 있는 미적 가치를 경험하게 도와주며, 결과적으로 신체적 자기효능감을 향상시키는데 도움을 주는 것을 목표로 한다. 제안하는 시스템의 효과성 검증을 위해 2~30대 40명을 대상으로 실시한 실험에서, 본 시스템을 사용한 후, 참가자들이 인지하는 자신의 신체에 대한 신체적 자기효능감이 통계적으로 유의하게 상승함을 확인하였고, 아울러 심층 인터뷰를 통해 사용자들의 긍정적인 반응을 확인할 수 있었다. 본 연구는 무용 교육, 무용 치료의 도구, 신체를 활용한 유아용 엔터테인먼트 도구 등의 연구에 활용될 수 있다.

Abstract

In this paper, we propose TransMotion, a machine learning based indirect ballet experience system that provides aesthetic experience of movement and helps improve physical self-efficacy. TransMotion is a system that recognizes a user's pose based on machine learning and provides a similar ballet motion as an immersive visual experience. The proposed system aims to help the individual to experience the aesthetic values that he or she could not recognize, and consequently to improve the physical self-efficacy. In order to verify the efficacy of the proposed system, experiments were conducted on 40 participants in their 20’s or 30’s. We found that the physical self-efficacy perceived by participants was statistically significantly higher after using this system. In addition, we received various positive responses from the participants through in-depth interviews. This study can be applied to media arts, dance education, dance therapy, or children entertainment tools.

Keywords:

Machine learning, Ballet, Aesthetics of movement, Physical self-efficacy, Dance education키워드:

머신러닝, 발레, 움직임의 미학, 신체적 자기효능감, 무용교육Ⅰ. 서 론

인간의 물리적 주체인 몸에 대한 인식은 그 중요성 만큼이나 다양한 방향에서 논의되어왔다. 20세기 철학자 Friedrich Nietzsche는 몸을 인간의 삶 그 자체로 보았다. 몸을 통해 자신의 삶이 적극적으로 성장하고 변화 발전하기 때문에 삶의 다양함을 표현할 수 있다고 말하였다[1]. 몸의 현상학자 Maurice Ponty는 우리의 몸 때문에 외부 대상자들이 우리에게 존재할 수 있다고 하였다. 즉 인간 존재의 실체를 몸으로 보았다. 생각이 몸을 움직이게 하는 것이 아니라 몸으로 생각한다는‘체화된 의식’을 강조하였다[2]. 한편, Martin Heidegger는 “뻗쳐진 채 자기를 뻗음의 특수한 움직임이 있음을 우리가 현존하고 있는 생기라고 부른다.”고 하며 몸짓이 삶의 존재와 생기를 대변하고 더 나아가 자신의 자아를 형성하기 때문에 우리의 움직임은 매우 중요하다고 주장하였다[3].

무용은 인간의 의식과 신체가 총체적으로 구현된 인간이 표현할 수 있는 최고의 수단임과 동시에 가장 직접적인 인간의 발로라고 정의할 수 있다[4]. 21세기에 접어들며 무용 체험 과정에서 경험하게 되는 미적 가치의 교육적인 측면이 대두되었고 무용 체험의 중요성에 대한 인식이 확산되었다. 많은 사람들이 자신의 감정이나 사상을 몸으로 표현하는 훈련을 시작한 것이다. 무용 체험의 근본적 의미는 창작자 및 감상자가 미적 대상에서 미적 가치를 찾아 자신의 것으로 재구성하는 활동을 통해 미적 가치를 경험하는 것이라고 할 수 있다[5]. 즉 사람들은 무용 체험을 통해 몸의 주체성이 지닌 ‘체화된 의식’을 경험하며 더 나아가 자아 형성, 자존감, 창의력 등의 가치 함양을 실현할 수 있다.

한편, 최근의 가상/증강현실, 웨어러블 컴퓨팅, 빅데이터, 인공지능(AI) 등의 정보통신기술의 발전은 예술의 미적 가치를 경험하는 데 있어서 편리함, 확장성, 접근성 등을 높이고 새로운 미적 경험을 창출하는 등의 다양한 가능성을 내포하고 있다. 이러한 새로운 기술들을 토대로 미술과 음악 분야에서는 다양한 연구들이 진행되고 있지만, 무용 분야에서의 연구는 상대적으로 미비한 실정이다.

본 논문에서는 간접적 무용 체험을 통해 신체 움직임의 미적 체험을 제공하고 신체적 자기효능감 향상을 돕는 머신러닝(ML; machine learning) 기반의 발레 동작 체험 시스템인 TransMotion을 제안한다. TransMotion은 머신러닝 기반으로 사용자의 포즈를 인식하고 그와 유사한 발레 동작을 몰입적인 시각 경험으로 제공하는 시스템이다. 제안하는 시스템은 개개인이 미처 인식하지 못했던 자신의 신체가 만들어 낼 수 있는 미적 가치를 경험하게 도와주며 결과적으로 신체적 자기효능감을 향상시키는 데에 도움을 주는 것을 목표로 한다. 제안하는 시스템의 효과성 검증을 위해 2~30대 40명을 대상으로 실시한 실험에서, 본 시스템을 사용한 후, 참가자들이 인지하는 신체적 자기효능감이 통계적으로 유의하게 상승함을 확인하였으며, 아울러 심층 인터뷰 결과 사용자들의 구체적인 긍정적인 반응을 확인할 수 있었다. 본 연구는 미디어아트, 무용 교육, 무용 치료, 유아용 엔터테인먼트 도구 등의 연구에 활용될 수 있다.

Ⅱ. 관련 연구

2-1 신체 기반 미적 체험 작품 사례

센서 기술, 컴퓨터 비젼, 컴퓨터 그래픽스, AI, 로보틱스 등의 정보통신 기술의 발전은 무용을 포함한 다양한 예술 분야와 접목하여 새로운 예술적 가치를 만들어 내고 있다[6].

2016년 미디어아트 그룹 NOTA BENE Visual은 대화형 인쇄물 미디어아트를 제작하였다. 텍스트를 읽기 위해 공간으로 들어온 순간 인접해 있는 벽에 자신의 모습과 텍스트를 투영시켜 관람자들에게 제공하게 되며 정보공유에 대한 상호 연결성을 신체를 통해 인지시키기 위한 작업이었다[7]. 2012년 미디어 아티스트 Chris Milk는 신체를 투영하여 새로운 예술 언어를 만드는 미디어아트 작품을 선보였다. Kinect와 Unity3D을 활용하여 신체와 그림자 간의 상호작용을 유도하여 새로운 그림자 기반의 작품이 사용자에게 제공된다. 이를 통해 작가는 관람자들의 신체를 활용하여 탄생, 죽음, 수혈에 관한 스토리를 전달하고자 하였다[8]. 2012년 미디어 아티스트 Damial Franke는 무용수의 움직임을 Kinect을 통해 기록하고 무용수의 감정 및 움직임을 모레 느낌의 3D 렌더링으로 표현한 작품을 고안하였다. 댄서의 움직임이 마치 살아있는 모래에 투영된 효과를 느낄 수 있으며, 이는 신체가 다른 오브제 요소에 변환되어 새로운 미적 체험을 제공하는 데에 의의가 있다[9]. 이러한 작품들에서 작가들이 관객들에게 전달하고자 하는 메시지는 다르지만 신체의 움직임을 다른 오브제에 투영시켜 메시지를 전달하고자 한 점이 공통된 점이다. 관람자들은 신체적 인터랙션을 통해 작품의 의도를 보다 빠르게 체화하여 인지할 수 있다. 몸으로 체화된 미적 가치는 시각이나 청각으로 인지하는 미적 가치와 다른 영향을 지닌다. 신체적 경험인 미적 경험은 몸에 기반을 둔 촉각적이며 공감각적 체험이며 이 체험을 내적으로 의미화하는 과정이라고 말할 수 있다[10].

2-2 AI 기반 무용 분야 연구 사례

예술 창작 분야에서는 인공지능 기술 중에서도 데이터로부터 일반적인 규칙을 추론하는 귀납적 추론의 방식인 머신러닝 기술을 활발하게 활용하고 있다. 머신러닝이란 경험적 데이터를 기반으로 학습을 하고 예측을 수행하고 스스로의 성능을 향상시키는 시스템과 이를 위한 알고리즘을 연구하고 구축하는 기술을 뜻한다[11]. 이것은 Arthur Samuel이 “명시적으로 프로그램을 작성하지 않고 컴퓨터에 학습할 수 있는 능력을 부여하기 위한 연구 분야"라고 처음 정의하였다[12]. AI가 무용 분야에 적용된 사례는 다른 미술이나 음악 분야와 비교하였을 때 상대적으로 많지 않지만 머신러닝의 한 분야인 딥러닝(deep learning) 기술이 발전하면서 비교적 최근 들어 다양한 연구들이 진행되고 있다. 학습을 통해 안무나 동작을 생성해 내는 연구가 주를 이루며 포즈 기반의 이미지 검색 등의 다양한 사례로 확대되고 있다.

우선, 안무나 동작을 생성해 내기 위해 AI를 접목한 대표적인 사례로는 2016년 소프트웨어 회사인 Peltarion과 현대무용단인 The Lulu Art Group이 모션 캡처 디바이스인 키넥트를 사용하여 추출해낸 5시간 분량의 현대무용 동작을 딥러닝 기반으로 학습시켜 새로운 현대무용 동작을 생성한 연구가 있다. 자체적으로 개발한 Chor-rnn 알고리즘을 활용하여 48시간 동안 동작을 학습시켰고, 그 결과 기존 안무에서는 발견하지 못했던 새로운 안무를 제시하였다. 이를 통해 인공지능 기술을 안무 창작 분야에 활용할 수 있음을 검증할 수 있었고 창작자에게 영감을 제공할 수 있는 도구적 측면에서도 가능성을 시사하였다[13]. Georgia Tech에서는 가상의 댄스 파트너들과 함께 춤을 출 수 있는 돔 형태의 예술 시설과 가상의 에이전트 개발에 관한 연구인 Lumin AI에 대한 연구를 진행하였다. 이 가상의 에이전트는 인간과의 인터랙션을 통해 반응하고, 춤추고, 소통할 수 있었다. 이를 통해 인간의 표현력, 사회성, 유희성에 관한 연구를 진행하였다[14]. 한편, 2018년 UC Berkeley에서는 전문 댄서의 춤 영상에서 동작을 추출한 후 일반 사람들의 기본적인 몸 동작 동영상을 기반으로 마치 일반인이 전문 댄서처럼 춤을 추는 듯한 영상을 생성하는 AI 기반의 Everybody Dance Now 연구를 진행하였다. 이 연구에서는 자체 개발한 동작 합성 기술과 Face GAN 알고리즘을 통해 매끄러운 합성 기술을 선보였다. 사람들은 자신이 가지지 못한 춤사위를 간접적으로 체험해볼 수 있고 이를 통해 유희적인 요소를 경험할 수 있었다[15].

2018년 Google의 Creative Lab에서는 실시간으로 사용자의 포즈를 기반으로 유사한 포즈를 지니는 이미지를 검색할 수 있는 연구인 Move Mirror 프로젝트를 진행하였다[16]. Tensorflow.js 환경과 Google에서 개발한 PoseNet API를 활용하여 웹서비스를 개발하였다. PoseNet은 인간의 중요 신체 연결 지점 위치를 검출하여 이미지나 비디오에 존재하는 사람의 신체 포즈를 높은 정확도로 검출하게 도와주는 머신러닝 기반의 API 이다. 이러한 연구는 AI가 움직임을 기반으로 하는 새로운 서비스를 가능하게 한다는 면에서 의미가 있다.

2-3 신체적 자기효능감

신체적 자기효능감(Physical Self-Efficacy)은 어떤 결과를 얻고자 하는 행동을 성공적으로 실행해낼 수 있는 개인의 신념을 묘사하는 말로써 특히 구체적인 자신감을 의미한다. 하지만 연구자들마다 다양하게 정의하여 사용되고 있다. 신체적 자기효능감에 대한 대표적인 연구자인 Ryckman, Robbins, Thornton과 Cantrell은 신체적 자기효능감을 신체와 관련된 지각된 자신감으로써 특정 과제를 수행해 낼 수 있는 자신감으로 정의하였다[17]. 또한 이를 인지된 신체능력(perceived physical ability)과 신체적 자기표현 자신감(self-presentation confidence)으로 구분하였다. Bandura는 스포츠 활동 중에 초래되는 심리적 요소로, 구체적 상황에서 의도한 결과를 이끌어내기 위해 필요한 행위를 조직하고 수행할 수 있는 정도로 정의하였다[18]. Schunk은 개인이 신체를 통해 어떤 기술을 지니고 있느냐가 아니라 지니고 있는 기술을 어느 정도 행동으로 옮길 수 있는지에 대한 문제라고 정의하였다[19]. 마지막으로, Baumgardner는 개인이 어떤 능력에 대해 효율적으로 해낼 수 있다는 확신이라고 정의하였다. 즉 신체적 수행과 관련된 과제에 대해 개인이 지각한 자신의 능력 수준을 의미한다[20]. 본 연구에서는 신체적 자기효능감을 신체에 내재된 미적 가치를 인지하고 신체 움직임으로 자신의 감정, 생각 등을 표현할 수 있는 개인의 자신감을 의미하는 용어로 사용하였다.

본 논문에서 제안하는 TransMotion 시스템은 AI 기술을 활용하여 사용자의 신체적 자기효능감을 높이는 것을 목적으로 한다는 점에서 기존 사례들과 차별성을 갖는다. 인간 신체의 움직임이 만들어 낼 수 있는 가상의 미적 이미지를 자신의 몸에 투영하게 도와 사용자의 신체에 내재된 미적 가치를 스스로 발견할 수 있게 돕는 것이 특징이다.

Ⅲ. 머신러닝 기반의 발레체험 시스템

3-1 시스템 디자인

본 논문에서 제안하는 머신러닝 기반의 발레 체험 시스템 TransMotion의 연구 목적은 개개인의 신체 움직임에 내재된 미적 가치를 발견하게 도와줌으로써 신체적 자기효능감을 향상시키는 것이다. 이를 위하여 신체를 활용한 예술 활동 중 미학적으로 가장 체계적으로 정립된 분야인 발레를 활용하였다. 발레의 동작들은 고도로 정제된 아름다운 신체 움직임으로 이루어져 있고 그 분류와 의미가 매우 체계적으로 정리되어 있어 시스템 구현을 체계적으로 할 수 있게 도와주는 장점을 지닌다.

TransMotion은 비디오 카메라, 스크린, 인터넷 연결을 지닌 컴퓨터로 이루어진 시스템이다. 비디오 카메라는 사용자의 존재를 검출하고 포즈를 캡쳐하는 용도로 사용되어 지며, 컴퓨터는 사전에 만들어진 포즈 DB에서 현재 사용자의 포즈와 가장 유사한 포즈를 찾고 각 포즈와 연결된 비디오 클립을 사용자에게 보여주게 된다. 이때 사용자의 몰입감을 높이기 위해 전신 거울과 유사한 느낌을 생성할 수 있는 크기의 스크린을 사용한다.

시스템은 사용자의 사용 과정에 따라 네 단계로 구분되어진다 (표 1). 첫 번째 단계는 대기 단계(Idle stage)로서 지나가는 사용자의 관심을 끌기 위해 발레리나가 손을 흔들며 인사하는 동영상이 지속적으로 보여진다. 두 번째 단계는 사용자가 시스템을 사용하기 위해 카메라 앞으로 접근하는 단계로서 사용자의 초기 몰입감을 높이기 위해 사용자가 접근하면 스크린 속에서 손을 흔들던 발레리나도 사용자 앞으로 걸어나오는 동영상 클립으로 바뀌어 보여지게 된다 (User engagement stage). 세 번째 단계는 사용자 포즈 단계로서 (User pose stage), 사용자는 화면에서 ‘포즈를 취해보세요’ 라는 메시지를 전달받게 되고 화면은 발레리나 동영상에서 비디오 카메라를 통해서 사용자의 모습을 실시간으로 보여주는 화면으로 전환된다. 사용자의 포즈 이미지는 비디오 카메라로 3초 간격으로 캡쳐되며 포즈 분석을 통해 사용자의 포즈와 유사한 발레리나의 포즈가 사전에 제작된 발레 동작 DB에서 검출되게 되면 네 번째 단계로 넘어가게 된다. 마지막 네 번째 단계는 사용자 포즈로 시작하는 발레 동영상 클립을 보여주는 단계다 (Indirect ballet experience stage). 이 때 사용자의 포즈를 보여주고 있는 화면에서 발레 동영상으로의 전환은 Fade-in/Fade-out을 통해 자연스럽게 연결되게 되어, 사용자는 자신의 포즈가 발레 동작을 초래한 것 같은 경험을 하게 된다.

이러한 시각적 경험은 화면 속의 발레 주인공에 자신을 투영하여 마치 자신의 신체가 발레 동작을 수행한 것 같은 간접 체험을 일으키도록 의도되었다. TransMotion은 이를 통해 개개인이 자신의 신체 움직임에 내재한 미적 가치를 인식하고 신체적 자기효능감이 향상되는 것을 목적으로 한다.

3-2 시스템 프로토타입 구현

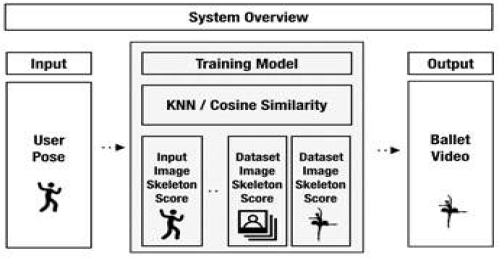

TransMotion 시스템의 본격적인 개발에 앞서 효과성을 검증하기 위하여 프로토타입을 구현하였다(그림 1). 프로토타입은 macOS 시스템에서 HTML, Javascript, Tensorflow.js로 이루어진 웹기반 환경으로 구현되었다.

주어진 이미지로부터 사람의 포즈를 검출하기 위하여 Google에서 개발한 머신러닝 기반의 PoseNet API를 활용하였다. PoseNet API는 주어진 이미지에 존재하는 사람의 신체 17개 주요 부분(무릎, 발목, 손목, 등)의 2차원 위치 정보를 실시간으로 알려준다. PoseNet API 는 실시간으로 사용자의 포즈 정보를 알기 위해서 사용될 뿐 아니라, 발레 영상들로부터 포즈 DB를 구축하기 위해서도 사용되었다.

기본 발레동작 40개를 대상으로 총 2880장의 발레 포즈 이미지가 포즈 학습을 위해 사용되었다. 사용된 이미지들은 모두 PoseNet API를 통해 34-dimension vector 정보로 바뀌어 해당 포즈 ID와 함께 저장되었다. 학습에 사용된 이미지들은 기본 발레 동작 사진 이미지를 수정하거나 관련 동영상에서 추출한 이미지들로 구성되었다.

포즈 분류는 머신러닝 알고리즘 중 k-Nearest Neighbor (k-NN) 알고리즘을 사용하여 이루어졌다. 주어진 사용자 포즈 이미지로 부터 PoseNet API를 통해 추출된 포즈 정보와 기존에 저장된 샘플들과의 근접도를 측정하게 위해 코사인 유사도(Cosine Similarity)를 사용하였으며, 가장 유사한 k 개의 샘플 중 다수에 해당하는 ID로 포즈를 분류하였다.

기본 발레동작 40개에 상응하는 발레 창작 동영상 클립 40개는 연구팀에서 자체 창작한 해당 발레 동작의 첫 포즈에서 시작하는 안무의 동작들로 총 20~30초의 길이로 촬영되었다. 즉, 사용자들에게는 자신의 포즈와 유사한 포즈로 시작해서 이루어지는 창작 발레 동작 동영상이 제공된다.

Ⅳ. 실험 방법

4-1 실험 참가자 및 실험 과정

본 논문에서 제안한 TransMotion 시스템이 사용자들의 신체적 자기효능감 향상에 미치는 효과성을 알아보기 위해 실험연구를 진행하였다. 실험은 본 실험과 추가 실험으로 구성되었다.

본 실험은 20대 대학생 및 대학원생 30명(남 14, 여 16)을 온라인으로 모집하여 실험을 진행하였다. 본 실험은 시스템을 사용하기 전의 사전 과업과 설문조사, 시스템 사용, 그리고 사후 과업과 설문조사로 이루어 졌다. 각 참가자들은 실험에 대해 간략히 안내를 받은 후 사전 과업을 먼저 수행하였다. 사전 과업을 위해 ‘내 자신을 몸으로 표현해보시오’라는 문구를 스크린 화면에 띄워 각 실험 참가자에게 전달하여 사전과업을 수행하도록 하였다. 실험 참여자들은 약 20초 동안 자신의 신체를 자유롭게 움직여 과업을 수행하도록 안내 받았고, 과업을 수행 후 사전 설문조사에 응답하였다. 사전 과업을 마친 참가자들은 본 논문에서 제안한 TransMotion 시스템을 약 5분 동안 자유롭게 사용하도록 안내 받았다. 사용자들은 멀리서 시스템을 향해 걸어오는 동작부터 시작하였으며, 스크린 앞에서 자유롭게 동작을 취하며 약 5분간 시스템을 사용하였다.

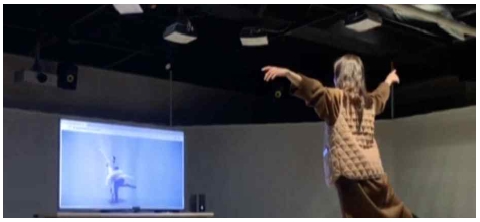

그림 2는 시스템을 사용하고 있는 실험 참여자의 모습을 보여준다. 스크린에는 사용자가 취한 포즈로부터 시작하는 발레 동영상이 보여진다. 실험에 참여한 참가자들은 5분 동안 시스템을 사용하면서 평균 8번의 시스템 프로세스 과정을 체험하였다. 참가자들은 시스템 사용 후에 시스템 사용 전과 같은 동작 창작 과업을 다시 수행하였고 사전 설문과 같은 설문 문항에 다시 응답하였다.

A participant using TransMotion in the experiment. A ballet video clip of which starting pose is similar to the user’s pose is shown.

신체의 움직임이 활발해지기까지에는 몸을 풀 수 있는 시간이 필요하다는 점을 고려하였을 때 본 실험은 시간 순서가 미치는 영향을 배제하지 못하는 제한점을 가지고 있다. 따라서 TransMotion 시스템의 발레 동작 간접 체험 인터랙션의 효과를 좀 더 알아보기 위하여 2~30대 10명(남 4, 여 6)에 대해 추가 실험과 심층 인터뷰를 실시하였다. 추가 실험에서 사용자들은 자신의 포즈에 상응하는 발레리나 창작 동영상이 나오는 TransMotion 시스템과 사용자에 포즈에 상응하지 않는 무작위의 발레리나 창작 동영상을 제공하는 시스템을 각 2분씩 사용하였다. 순서에 대한 영향을 상쇄하기 위하여 참가자의 반은 다른 반수의 참가자와 반대 순서로 두 시스템을 경험하였다. 참가자들은 각 시스템을 사용하는 2분 동안 평균 4번의 사용자의 시스템 프로세스를 체험하였다. 실험 후 진행된 심층 인터뷰에서는 1) 발레리나의 움직임이 내 몸에 투영되었다고 생각하는지, 2) 나의 신체는 발레리나와 같은 움직임을 표현할 수 있는지, 3) 나는 신체를 움직이는 활동에 자신이 있는지 등의 질문들에 대해 질의 응답하였다.

4-2 설문 측정 항목

본 연구에서 사용한 신체적 자기효능감과 관련된 측정항목은 Ryckman 등[17]이 개발한 신체적 자기효능감 척도(Physical Self-Efficacy Scale)와 문영과 오레지나[21]의 무용수행능력 평가 척도 연구를 활용하여 설계하였다. Rackman 등이 개발한 신체적 자기효능감 평가 척도의 구성은 스포츠 분야에서 신체의 기술적 요소 평가에 초점을 맞추어 인지된 신체능력 10개 문항과 신체적 자기표현 자신감 12문항, 총 22문항으로 이루어져 있다. 본 논문에서는 Rackmam 등이 개발한 신체적 자기효능감 평가 척도를 한국어판으로 번역한 검사지[22]를 기반으로 하여 보다 미적 가치를 포함하는 무용에 맞게 변형하기 위하여, 문영과 오레지나가 개발한 무용수행능력 평가 척도 중 신체를 기반한 미적 감정과 미적 직관을 확인할 수 있도록 신체능력 인지 부분을 재구성하였다. 두 연구의 평가 척도를 재구성하여 만든 평가 문항은 인지된 신체능력 8문항, 신체적 자기표현의 자신감 4문항으로 총 12문항으로 구성되었다. 각 문항은 ‘전혀 그렇지 않다’(1점)에서 ‘매우 그렇다’(7점)까지의 7점 리커트 척도로 구성되었다 (표 2). 설문 문항은 사전 과업 후와 시스템 사용 후 수행한 사후 과업후에 참가자들의 신체적 자기효능감을 측정하는데 사용되었다.

Ⅴ. 실험 결과

5-1 정량 분석 결과

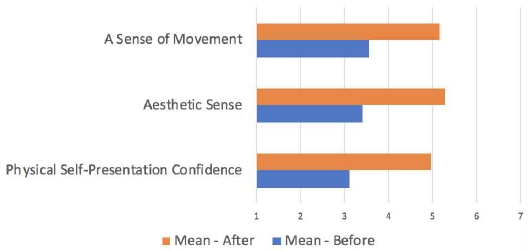

본 실험의 실험 결과 분석을 위해 SPSS 프로그램을 활용하여 대응표본 t-검정을 실시하였다. t-검정 결과 시스템의 사용전과 후에 측정한 신체적 자기효능감의 세 가지 하위 항목 (움직임 감각, 미적 감각, 신체적 자기표현 자신감) 모두에서 통계적으로 유의하게 (p<0.001) 차이가 나타났다. 즉, 실험참가자들은 시스템 사용 전에 비해 사용 후에 움직임 감각 (M=3.55 vs M=5.15), 미적 감각 (M=3.41 vs M=5.28), 신체적 자기표현 자신감 (M=3.12 vs M=4.97) 모두에서 더 높은 점수를 보고하였다 (표 3). 설문지 문항에 대한 신뢰도를 나타내는 Cronbach's α값은 0.893 이였다.

5-2 심층 인터뷰 결과

추가 실험과 심층 인터뷰를 통해 시스템의 발레 동작 간접 체험 인터랙션의 효과를 보다 깊게 알아보았다. 실험 참가자들 모두는 자신의 포즈에 상응하는 발레리나 동작이 나올 때와 무작위의 발레리나 동작이 나올 때를 구분할 수 있었고 상응하는 동작이 나올 때 훨씬 더 긍정적인 경험을 하였다고 보고하였다.

먼저 상응하는 동작이 나오는 시스템을 사용한 후에는 사용자들은 신체적 자신감이 커진 부분을 가장 많이 언급하였다.

내가 포즈를 취하고 나서 그와 비슷한 발레동작을 발레리나가 해주니 내가 하는 동작이 맞다고 응원 받는 기분이 들었다. (여 26세)

시스템을 3, 4번째 사용하면서 동작이 커지는 나의 모습을 발견할 수 있었다. (남 32세)

상상속의 나를 시각적으로 느낀 것 같아 상상이 실현된 느낌 조금 들어 신기했다. 내가 발레를 할 수 있고, 발레리나의 움직임이 내가 한 것과 같은 느낌이 들어 자신감이 들었다. (남 28세)

그 밖의 긍정적 의견으로는 많은 참가자들이 흥미롭고 재미있었으며, 교육적으로도 유용할 것이라는 의견을 주었다.

전문 발레리나로부터 세심하게 교육을 받는 느낌이 들었다 (여 28세)

기본적인 동작이라도 발레로 보여주니 앞에 선생님이 있는 것처럼 확실히 도움이 된 것 같다. 비전문가들에게 교육용으로도 좋고 엔터테인먼트 도구 가능성도 있다고 생각한다. (여 26세)

자신의 포즈와 상응하지 않는 무작위 발레 동영상을 경험한 사용자들은 대부분 별 흥미를 못 느끼거나 어떤 사용자들은 오히려 자신감이 감소하였다고 보고하기도 하였다.

그냥 동영상을 보는 느낌이었다. (남 23세)

자신감이 생긴 것 같진 않다. 오히려 ‘나는 저런 동작을 할 수 없어’라는 생각이 더 컸던 것 같다. (여 26세)

앞의 시스템을 통해 자신감을 조금 얻어서 포즈를 크게 취했는데, 전혀 다른 결과가 나오니 그 다음에 어떤 동작을 취해야할지 고민이 되었다. 즉 신체를 표현함에 있어 자신감이 오히려 감소된 느낌을 받았다. (여 26세)

Ⅵ. 논 의

실험결과에서 비록 2~5분 정도의 짧은 시간 동안 체험이었지만 참가자들의 신체적 자기효능감이 통계적으로 상당히 유의하게 상승한 점은 주목할 만하다. 순서 효과의 영향을 배제하기 위하여 추가로 실시한 실험과 심층 인터뷰에서도 참가자들의 반응은 예상보다 매우 긍정적으로 나왔다. 특히, 사용자의 포즈에 상응하는 발레리나 동작이 나올 때, ‘흥미롭고 재밌다’라는 반응과 함께 ‘나의 동작에 자신감이 생기고’ 더 나아가 ‘꿈꾸던 것이 실현된 것’ 같다는 반응은 자신을 발레리나의 신체 움직임에 투영할 수 있었다라는 것을 간접적으로 뒷받침한다고 할 수 있다. 비록, VR 체험처럼 자신이 완전히 다른 인간이나 존재가 되는 간접 경험을 제공하지는 못하지만, 나의 동작이 발레리나의 동작으로 연결되는 인터랙션만이라도 효과적으로 구현되었을 때 VR과 비슷한 간접경험을 줄 수 있다는 점을 암시한다는 측면에서 의미가 있다고 할 수 있다.

프로토타입을 통한 효과성 검증이 긍정적인 결과로 나오고 사용자 반응에서 재미와 교육적 가능성이 많이 언급되었다. 이는 향후 공공장소에서 재미와 더불어 교육적 가치를 지니는 콘텐츠로 발전시키거나, 새로운 발레 교육 시스템으로 발전시킬 수 있는 가능성을 보여준다는 측면에서 의미가 있다고 할 수 있다.

본 연구는 몇 가지 제한점을 지닌다. 우선 실험 참가자가 2~30대 학생으로 신체적 움직임이 둔화되는 더 높은 연령대로까지 일반화 시키기는 어렵다. 일반적으로 이런 인터랙티브 시스템은 나이가 어릴수록 더 흥미를 느끼고 몰입하는 경향이 있지만 역시 연령대가 더 어린 계층에서의 효과성도 별도로 평가되어야 한다. 두 번째로는 실험 참가자들의 시스템 사용 기간이 2~5분 정도에 지나지 않아 장기간 사용을 통해 신체적 자기효능감이 지속적으로 상승하는지, 흥미 유발효과가 감퇴하는지, 그리고 그것에 따라 교육적 효과가 감퇴되는지 여부 등은 확인하지 못하였다.

Ⅶ. 결 과

본 논문에서는 신체적 자기 효능감 향상을 도와주는 머신러닝 기반의 발레 간접 체험 시스템 TransMotion을 제안하였다. TransMotion은 사용자의 포즈 정보를 실시간으로 검출하고 사용자의 포즈를 발레 기본 동작 40개 중 하나로 분류하여 인식한 뒤 그 포즈로 시작하는 창작 발레 동작을 시각적으로 체험하도록 제공하는 인터랙티브 시스템이다. 사용자들이 본인의 포즈와 유사한 포즈로 시작하는 발레 동작의 창작 동영상을 시각적으로 상호작용적으로 경험함으로써 자신의 신체가 발레리나의 신체에 투영되는 체험을 하게 되고 그런 간접 경험을 통해 움직임 감각, 미적 감각, 신체적 자기 표현 자신감등을 향상시키는 것을 목적으로 한다.

제안하는 시스템의 효과성을 검증하기 위해 20대 30명을 대상으로 한 실험 연구 결과, 제안하는 시스템을 사용 후에 사용자들의 신체적 자기효능감의 하위 항목인 움직임 감각, 미적 감각, 자기 표현 자신감 모두가 통계적으로 유의하게 상승하였다. 순서 효과와 인터랙션의 효과를 알아보기 위해 2~30대 10명을 대상으로 실시한 추가 실험에서 사용자들은 순서와 상관없이 발레리나의 동영상이 자신과 인터랙션 할 때와 무작위로 나올 때를 분명히 구별할 수 있었고, 오직 인터랙션이 있다고 느낄 때 매우 긍정적 경험들을 보고하였다. 대부분의 사용자들은 흥미롭고, 움직임에 자신감이 생긴다고 보고하였고, 시스템의 교육적 가치도 자주 언급되었다.

본 연구는 신체 언어의 중요성이 증가하고 있는 시점에서 새로운 무용 교육 도구, 무용 치료 도구, 유아용 엔터테인먼트 도구 등의 연구에 응용될 수 있다. 특히, ‘아이들을 위한 무용 교육 도구, ‘아이들을 위한 신체를 활용한 게임’으로 발전시키면 더 효과적일 것 같다는 반응이 많았다는 점에 주목할 필요가 있다. 신체 발달기에 놓여 있는 유아의 경우 신체적 자기효능감 향상에서 더 큰 효과를 기대할 수 있다. 후속 연구에서는 앞선 연구의 한계점을 고려하여 이를 보완하고, 유아기에 초점이 맞춰진 디자인 가이드라인과 시스템 설계에 대한 연구가 필요하다. 또한 유아기의 아이들을 대상으로 보다 장기간의 체계적인 표본 실험을 실시하여 효과성 검증도 필요할 것이다.

Acknowledgments

본 연구 진행을 위해 프로토타입 개발에 도움을 준 박지현님에게 큰 감사를 표합니다. 본 논문은 동저자의 석사학위 논문을 바탕으로 작성되었습니다.

참고문헌

- N. R. Jung, “Nietzsche's body, art physiology and modern dance(XII)”, The DancePost Korea, Oct 2014, Available: http://www.dancepostkorea.com/nr/?r=dpk&c=7/11

- M. Ponty, “Phenomenology and Art”, Translated by B.N. Oh, pp 178, Sekwangsa Press ,1989

- M. Heidegger(1927), “Being and Time”, Translated by John Macquarie,Edward Robinson, SCM Press, p. 375, 1962

- Y. J. Oh, “The study of Aesthetic value in dance –art”, The Korea Journal of Physical Education, Vol 32, No. 1, pp 1077-1083, June 1993. .

- J. Dewey, “Art as Exprience”, New York Capricon book, Translated by G.P. Gutnam’s Sons, p 3, 1958

-

S. M. Shin , “A Study of the Convergence of Dance and Artificial Intelligence in William Forsythe’s Synchronous Objects for One Flat Thing, Reproduced ” KJAS, Vol., no. 16, pp. 53-75, 2017

[https://doi.org/10.20976/kjas.2017..16.003]

- NOTA BENE Visual, “In order to control” , 2016, Available:http://www.notabenevisual.com/#/works/in-order-to-control

- C. Milk, “The Treachert of Sanctuary”, 2012, Available: http://milk.co/treachery

- D. Franke, C. Kiefer, “Unnamed soundsclpture”, 2012 Available: http://www.onformative.com

-

S. Lee “The Importance of Body Sensation and Bodily Experience in the Cultural Artistic Education” Inha Univ Educational and Cultural ResearchInstitute, Vol 21, No 6, pp 349-369, 2015

[https://doi.org/10.24159/joec.2015.21.6.349]

- B. T. Jang “The Foundation and Nature of Artificial Intelligence Technology” , 4th World Forum on Humanities script, p 1, Oct 2016

-

A. Samuel, “Some Studies in Machine Learning Using the Game of Checkers” .IBM Journal of Research and Development , Vol 3 , No 3 ,pp 210-229, July 1959

[https://doi.org/10.1147/rd.33.0210]

- L. C. Friis, “Generative Choreography using Deep Learning”, Proceedings of 7th International Conference on Computational Creativity, Paris: France, July 2016

- M. Jacob, B. Magerko, “Interaction-based Authoring for Scalable Co-creative Agent”, Proceedings of the 6th International Conference on Computational Creativity, Park City: Utha, June 2015

- C. Chan,S. Ginosar, T. Zhou, A.A. Efros, “Everybody Dance Now”, UC Berkeley, Aug 2018, Available :https://carolineec.github.io/everybody_dance_now

- J. Friedhoff, I. Alvarado, “ Move Mirror: An AI Experiment with Pose Estimation in the Browser using TensorFlow.js”, Google Creative Lab, A Medium Corporation. July 2018,, Available: https://experiments.withgoogle.com/move-mirror

-

R. M. Ryckman , M. A. Robbins, B.Thornton, P. Cantrell, “ Development and validation of a physical self-efficacy scale”, Journal of Personality and Social Psychology, Vol 2, No 5, pp 891-900, 1982

[https://doi.org/10.1037/0022-3514.42.5.891]

-

A. Bandura,“Self-efficact: Toward a unifying Theory of behavioral change”, Psychological Review, Vol 84, pp 191-215, 1977

[https://doi.org/10.1037//0033-295X.84.2.191]

-

D. H. Schunk, A.R. Hanson, “ Peer models: Influence on Children’s self-efficact and achievemet”, Journal of Educational Psychology, Vol 77, pp 313-322, 1985

[https://doi.org/10.1037//0022-0663.77.3.313]

-

A. H. .Baumgardner, C. M. Kaufman, P. E.Levy, “Regulating affect interpersonally: When low esteem leads to greater enhancement”, Journal of Personality and Social Psychology, Vol 56, No 6, pp 907-921, June 1989

[https://doi.org/10.1037//0022-3514.56.6.907]

- Y, Moon , R. J. N, Oh, “Development of dance performance competence test”, Journal of the Korean Dance Education, Vol 23, No 1, pp 195-212, Feb 2012

- S. O. Hong, “ Effects of Exercise Participation on Physical Self-Effectiveness and Change of Gender Role Types” Ph,D, Busan University Graduate School, 1996.

저자소개

2017년: 숙명여자대학교 (무용학사/경영학사)

2019년: 서강대학교 대학원 (예술공학석사)

※관심분야:AI, 휴먼-컴퓨터 인터랙션 등

2000년: 연세대학교 (공학사-전자공학)

2002년: 연세대학교 대학원 (공학석사-전자공학)

2008년: 미국 메릴랜드대 대학원 (공학박사-컴퓨터공학)

2008년~2012년: 미국 Rhythm & Hues Studios

2012년~현재: 서강대학교 아트&테크놀로지 학과 교수

※관심분야: 크리에이티브 컴퓨팅, 휴먼-컴퓨터 인터랙션, 뉴미디어 등