3차원 가우시안 스플레팅의 동적 변형 및 시각화를 위한 PBD 통합 파이프라인 연구

Copyright ⓒ 2026 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구는 3D Gaussian Splatting(3D GS) 기반 포인트 클라우드 데이터를 활용, 동적 변형이 가능한 가상 객체의 효율적 제작을 위한 파이프라인을 제안한다. 3D GS 관련 기존 연구들은 고속 렌더링과 정적 재구성에 주안점을 두어 실제 제작 과정에서 요구되는 물리적 변형이나 상호작용 표현에는 한계가 있었다. 이에 본 연구에서는 가우시안 기반 렌더링 구조와 함께 위치 기반 다이나믹스(PBD)를 결합하여 고해상도 점군에서도 안정적인 변형을 구현하고자 하였다. 연구에서 제안하는 파이프라인은 원본 3D GS 포인트로부터 저해상도 프록시 메쉬를 생성하고, 해당 메쉬에 Vellum 기반 연성 시뮬레이션을 적용한 뒤, 결과 변형을 Point Deform 과정을 통해 전체 해상도의 가우시안 세트로 전달한다. 이러한 접근 방법은 제작의 효율성을 높이는 것은 물론, 유연하고 직관적인 형태 변형이 가능해짐에 따라 GS 기반 장면 제작과 인터랙티브 시각화 활용 범위의 확장 가능성 제고에 기여한다.

Abstract

This study proposes a pipeline that can be used to dynamically create deformable virtual objects using point cloud data based on 3D Gaussian splatting (3D GS). Existing 3D GS research primarily focuses on high-speed rendering and static reconstruction, offering limited support for the physical deformation and interactive behaviors encountered in practical content production. To address this limitation, we integrated a Gaussian-based rendering structure with position-based dynamics (PBD) to enable the stable deformation of high-resolution point clouds. The proposed pipeline generates a low-resolution proxy mesh from the original 3D GS points, applies Vellum-based soft-body simulation, and transfers the resulting deformation back to the full-resolution Gaussian set via a point deform process, thereby enhancing production efficiency and expanding the applicability of Gaussian-based scene creation and interactive visualization.

Keywords:

Point Cloud, Gaussian Splatting, Position-Based Dynamics, Physics-Based Simulation, Pipeline키워드:

포인트 클라우드, 가우시안 스플레팅, 위치 기반 다이나믹스, 물리 기반 시뮬레이션, 파이프라인Ⅰ. 서 론

3D Gaussian Splatting과 같은 고성능 점 기반 시각화 기법이 등장하면서, 복잡한 3D 장면을 수백만 개의 가우시안 분포로 표현하고도 100 fps 이상의 실시간 렌더링 성능을 달성할 수 있게 되었다[1]. 해당 기술은 딥러닝 기반의 NeRF와 비교하여 학습 효율과 표현력 모두에서 우수한 성능을 보이며, 실시간 장면 재현을 위한 대안적 프레임워크로 주목받고 있다. 그러나 대부분 점 기반 시각화 연구는 정적인 재현에 그치거나 사전 정의된 애니메이션 시퀀스를 반복 재생하는 방식에 머물러 있고, 실시간 상호작용에 기반한 물리적 장면 변형에는 한계를 보이고 있다. 특히 사용자가 직접 가상 객체에 힘을 가하거나, 중력, 파도, 탄성 등 다양한 물리 효과를 반영하여 장면의 구조적 변화를 실시간으로 유도하는 사례는 매우 드물다. 이러한 배경에서 본 연구의 목적은 점 기반 표현을 실시간 물리 시뮬레이션과 통합함으로써 사용자의 입력 혹은 환경 변화에 따라 장면이 연체처럼 유연하게 휘어지는 등 동적인 반응을 보일 수 있는 새로운 형태의 시각화를 구현하고자 한다.

이를 위해 상용 소프트바디 시뮬레이션 도구인 Houdini의 Vellum Cloth 모듈에 기반한 위치 기반 다이나믹스(PBD) 기법을 활용하여, 점 기반 장면의 탄성 변형을 구현하고자 했다. 이에 핵심적 기여는 정적인 데이터 구조를 갖는 3D GS 포맷과 물리 시뮬레이션 엔진 간 인터페이스를 효과적으로 구축하고, 시뮬레이션 결과를 점 기반 렌더링에 자연스럽게 반영할 수 있도록 파이프라인을 설계한 점이다. Xie 등의 연구에 의하면, 3D GS는 비구조적이고 시각적 표현에 특화된 반면, 물리 시뮬레이션은 대체적으로 구조화된 메쉬 또는 입자 기반 데이터가 필요하므로 양자를 효율적으로 연계할 수 있는 구조적 해법이 요구된다[2],[3]. 또한 Kerbl의 연구에 의하면, 실시간성을 확보하기 위해서는 시뮬레이션과 렌더링 양측 모두 고속 처리가 가능해야 하며, 이 과정에서 계산 복잡도를 제어하고 두 과정의 동기화를 유지하는 최적화 전략이 중요하다[1]. 선행 연구들을 반영하여 본 연구에서는 COLMAP 등으로 획득한 포토그래메트리 데이터로부터 포인트 클라우드를 생성하고 이를 3D GS 포맷으로 변환한 뒤, 물리 시뮬레이션을 적용한 후 그 결과를 Point Deform 방식으로 다시 렌더링 단계에 반영하는 일련의 통합 구조를 제안하였다. 이를 통해 정적인 장면도 물리 환경 변화에 따라 유기적으로 반응하여, 사용자는 가상 환경 내에서 실시간에 준하게 그 변형 과정을 관찰하고 조작할 수 있는 점 기반 인터랙티브 시각화를 경험할 수 있도록 하였다. 이러한 새로운 접근 방식은 다양한 디지털 콘텐츠, 인터랙티브 미디어, 교육 시뮬레이션 등 다양한 분야에서 새로운 표현의 응용 가능성을 확장하여 정적 재현 중심의 기존 점 기반 연구들이 동적 재현 콘텐츠로 그 영역을 확대해 나갈 것으로 기대한다.

Ⅱ. 선행 연구 분석

2-1 NeRF와 3D Gaussian Splatting

NeRF (Neural Radiance Field)는 복잡한 3D 장면의 새로운 시점 영상을 합성하는 기술로, 2020년 Mildenhall 등에 의해 처음 소개된 이후 3D 뷰 합성 분야의 혁신을 이끈 결과물이다[4],[5]. NeRF는 다수의 입력 이미지와 카메라 포즈로부터 신(Scene)의 연속적인 볼륨 밀도와 복사율 필드를 학습하며, 학습된 신경망을 통해 임의의 시점에서 해당 장면의 영상을 렌더링할 수 있다. NeRF의 등장은 사전 스캔 없이도 고품질의 디지털 트윈을 생성할 수 있는 가능성을 열어주었으나, 느린 최적화 속도와 높은 연산 비용으로 인해 VR/AR 등 실시간 응용에는 한계가 있었다. 이러한 제약을 극복하기 위해 수많은 변형 및 가속화 연구가 이어졌으며, 2023년 Kerbl 등은 3D GS를 통해 획기적인 속도 향상을 시연하였다[1],[6],[7]. 3D GS 기술은 장면을 구성하는 표면 공간 정보를 다수의 저차원 가우시안(일명 blob)으로 표현하고, 이들을 2D 스크린에 직접 스플랫(splat) 투영하여 합성하는 점 기반 렌더링 기법이다. 복셀(voxel)이나 삼각형 메쉬 대신 비정형 포인트 가우시안 분포를 사용함으로써, 복잡한 신경망 최적화 대신 확률적 분포로 장면을 표현하고 빠르게 이미지를 생성할 수 있다. Kerbl 등의 연구에 따르면, 3D GS는 수십 장의 사진으로부터 수백만 개의 가우시안을 최적화하여 기존 NeRF와 동등한 시각 품질의 3D 장면 재구성을 달성하면서도 수십 배 빠른 렌더링이 가능하다고 한다. 이후 다중 노출이나 동적 장면에 3D GS를 적용한 연구들도 등장하여 실시간으로 변화하는 장면의 렌더링까지 시도되고 있다.

이처럼 Gaussian Splatting 기법의 등장으로 고밀도 점 기반 표현이 다시 주목받고 있다. 하지만 한편으로 현재의 Gaussian Splatting 파이프라인은 포인트로 표현된 결과를 기존 콘텐츠 제작 워크플로우에 통합하기 어렵다는 지적이 있다. 예를 들어, 3D GS 결과는 수백만 개의 작은 점들로 이루어져 있기 때문에 이를 폴리곤 메쉬로 변환하여 일반적인 3D 소프트웨어에서 편집하거나 애니메이션을 적용하는 것이 지원되지 않는다. 또한 고품질 결과를 얻기 위해서는 수백만 개 이상의 가우시안 및 수GB에 달하는 데이터를 필요로 하여, GPU 메모리 등 자원을 크게 요구하며 이러한 점들은 표준 그래픽 API에서 직접 처리하기도 어렵다. 요컨대 3D GS 자체는 혁신적 렌더링 기법이지만, 그 산출물을 활용해 편집·시뮬레이션·렌더링 등 후속 작업을 진행할 수 있는 일관된 워크플로우가 부재한 상태다. 본 연구는 이러한 간극을 메우기 위해 3D GS 결과를 활용하여 시뮬레이션과 렌더링까지 아우르는 파이프라인을 구성하고자 한다.

2-2 포인트 기반 물리 시뮬레이션

NeRF와 3D GS 등이 시각적 재구성에 집중한 반면, 최근에는 점 또는 볼륨기반 표현에 물리 시뮬레이션을 통합하려는 시도도 이루어지고 있다. 2024년 Xie 등은 PhysGaussian이라는 기법을 통해, Gaussian으로 표현된 점들 자체에 뉴턴 역학에 따른 변형 및 응력(stress)을 부여함으로써 물리적으로 일관된 동적 장면을 생성하였다[2]. 이 방법은 재구성된 Gaussian 점들을 입자(particle)로 간주하여 MPM(Material Point Method) 기반의 연속체 역학 시뮬레이션을 수행함으로써, 겉보기 렌더링과 물리 시뮬레이션을 완전히 통합한 것이다. PhysGaussian은 모든 연산을 가우시안 입자 단위로 처리하기 때문에 별도의 메쉬 추출이나 보간 없이 "보이는 것을 그대로" 시뮬레이션할 수 있다는 장점이 있다. 다만 하단에서 언급하겠지만, 이처럼 전역적인 MPM 기반 접근은 각 입자를 독립적으로 제어하기보다는 전체 움직임의 안정성에 중점을 두기 때문에, 세부 구조나 국소적 변형 패턴을 표현하는 데에는 제약이 있다. 한편 Feng 등은 Gaussian Splashing이라는 통합 프레임워크를 제안하여 3D 가우시안과 입자 기반 시뮬레이션을 결합함으로써 다채로운 모션 생성과 렌더링을 시연하였다[3]. 특히 그림자 맵핑과 정반사(specular) 모델링을 결합하여 동적 유체 표면의 하이라이트를 사실적으로 묘사하는 등 렌더링 품질을 향상시켰다. 이를 바탕으로, 고정된 접시에 담긴 모형이 유체로 변하여 흐르고 접시와 상호작용하는 장면을 구현하는 등 새로운 표현 가능성을 확인하였다. 이와 같은 선행 연구들은 점 기반 표현에 물리 역학을 부여함으로써 동적인 시각화를 구현할 수 있음을 보여주었으나, 시뮬레이션 해상도나 표현 제어 면에서 개선 여지가 남아 있다. 본 연구에서는 외부 물리 엔진(PBD 솔버)을 활용하여 안정적이면서도 국소 제어가 가능한 변형 시뮬레이션을 구현하고, 이를 고해상도 3D GS 렌더링과 접목함으로써 기존 방법들이 보인 한계를 극복하고자 한다.

Ⅲ. 제안 파이프라인 구조

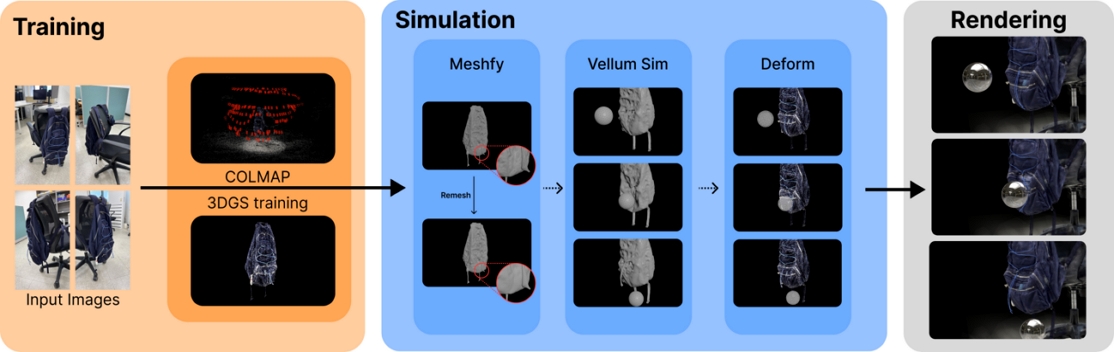

본 연구에서 제안하는 파이프라인은 크게 (a) 입력 데이터로부터 점들을 생성하는 복원 단계와 (b) 생성된 점들에 실시간 물리 시뮬레이션을 적용하는 동적 변화 단계로 구성된다. 그림 1은 전체 파이프라인의 구조를 개략적으로 나타낸 것이다.

그림 1 제안 파이프라인의 개략도 - 다중 뷰 영상으로부터 COLMAP을 통해 초기 카메라 파라미터와 점군을 획득하고, 3D GS기법으로 고속 렌더링 가능한 가우시안 표현을 최적화한다. 이후 장면의 가우시안 점들은 PBD(Vellum) 기반의 변형 시뮬레이션 모듈에 투입된다. 시뮬레이션 결과로 발생한 점들의 이동/변형은 Point Deform 절차를 통해 원래 고해상도 가우시안 점들에 적용되며, 최종적으로 변형된 가우시안 세트를 실시간으로 렌더링하여 사용자에게 출력한다.

3-1 COLMAP을 통한 3D 포인트 데이터 획득 및 Gaussian 변환

파이프라인의 전처리 단계에서는 COLMAP을 활용하여 입력 영상들로부터 카메라들의 자세 추정(camera pose estimation) 및 초기 sparse point cloud 복원을 수행한다. COLMAP은 구조-from-모션 알고리즘으로 다중 뷰에서 특징점을 매칭하여 내부, 외부 카메라 파라미터와 희소 점들을 산출한다[8]. 이때 획득된 점군은 장면의 대략적인 구조를 담고 있으며, Gaussian Splatting의 초기화에 활용된다. COLMAP 결과와 입력 영상들을 바탕으로 Kerbl 등의 3D Gaussian Splatting 최적화 방법에 따라 각 점을 초기 가우시안의 평균으로 설정하고, 각 가우시안의 크기/모양(공분산 행렬)과 색상을 반복(iterative) 최적화한다[1]. 이 과정에서 비등방성(anisotropic) 가우시안을 사용하여 장면 구조를 정확히 근사하고, 불필요한 영역의 가우시안은 제거하거나 병합하여 점 수를 적정 수준으로 제어한다. 결과적으로 수십만 개에서 수백만 개에 이르는 가우시안들이 장면을 표현하게 되며, 이는 GPU 기반의 가시성 중심 렌더링 알고리즘을 통해 실시간으로 2D 영상으로 합성(render-to-image)될 수 있다[1].

본 연구에서는 상기 단계까지는 Kerbl 등의 기존 기법을 준용하되, 이후 물리 시뮬레이션 적용을 위해 필요한 정보를 추가로 준비하였다. 우선 가우시안 점들의 위치, 반경, 밀도 등의 데이터를 시뮬레이터에 전달할 수 있도록 변환한다. 예를 들어 탄성 변형 시뮬레이션의 경우, 가우시안 분포의 겉면을 근사하는 메쉬를 생성하거나 점들을 얇은 표피(surface particles)로 간주하여 PBD 제약을 걸 수 있도록 준비를 한다. 또한 선행 연구 PhysGaussian에서 지적된 바와 같이[2], 가우시안이 지나치게 늘씬한 콩나물 모양(과도한 이방성)을 가지면 물리 시뮬레이션 시 정확도가 떨어질 수 있으므로, 필요한 경우 공분산에 약간의 regularization을 가하여 아주 극단적으로 늘어난 가우시안은 완화하였다.

3-2 Vellum 기반 변형(탄성) 시뮬레이션

본 파이프라인의 핵심은 Gaussian point cloud 형식의 시각 객체에 대해 연성(soft-body) 동역학 효과를 부여하고, 이를 기반으로 자연스러운 변형 애니메이션을 생성하는 데 있다. 그러나 3D GS 자체는 물리적 연결 구조를 갖지 않기 때문에, 직접적인 시뮬레이션 적용에 제약이 있다. 이를 해결하기 위해 다음과 같은 3단계 절차를 설계하였다:

- ① 3D GS point 분포의 겉면을 메쉬화하고

- ② 메쉬를 입력으로 Vellum 기반 PBD 시뮬레이션을 수행하며

- ③ 그 결과를 다시 원래 3D GS 점들에 Point Deform 방식으로 전파한다.

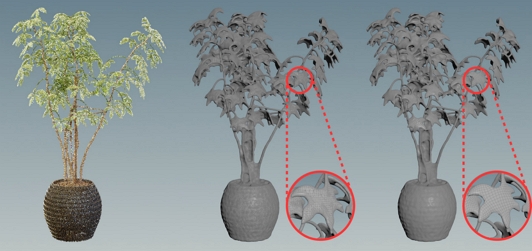

1단계: Gaussian 포인트 클라우드의 표면 메쉬화

우선, COLMAP을 통해 획득한 포인트 클라우드로부터 생성된 3D GS 점군은, 우선 입자 기반 볼륨화(VDB) 과정을 통해 Signed Distance Field(SDF) 형태로 변환되며, 이후 isosurface 추출(marching cubes 기반)을 통해 외피 메쉬가 생성된다. 이 단계는 비정형 점군을 연속적이고 시뮬레이션 가능한 표면 구조로 변환하는 과정으로, 이후 Vellum 기반의 탄성 시뮬레이션 입력으로 활용된다. 생성된 메쉬는 원본 객체의 주요 형상적 특성을 충실히 반영하며, 계산 효율을 위해 일정 수준의 표면 단순화(simplification)가 적용된다.

2단계: Vellum(PBD) 기반 탄성 시뮬레이션 수행

생성된 메쉬를 기반으로 Vellum에서 제공하는 Cloth 객체를 생성하고, 여기에 위치 기반 다이나믹스(Position-Based Dynamics, PBD) 방식의 제약 조건들을 부여한다. PBD는 물리 기반 힘을 직접 해석하지 않고, 각 입자의 위치를 제약 함수 Cj(x)를 만족하도록 반복 보정하는 방식이며, 다음과 같이 표현된다[9]-[11]:

| (1) |

여기서 는 시간 t에서의 입자 i의 위치, Δt는 시뮬레이션 시간 간격, Cj(x)는 물리 제약 함수(예: 거리 유지, 부피 보존 등), λj는 해당 제약의 라그랑주 승수이다. 특히 본 연구에서는 높은 stretching 계수와 함께 체적 보존 제약을 병행하여, Gaussian 객체의 형상이 급격히 무너지지 않으면서도 외력에 따른 자연스러운 움직임을 구현하였다.

3단계: Point Deform을 통한 Gaussian 변형 전달

Vellum 시뮬레이션의 결과는 메쉬 정점들의 시간에 따른 변위 벡터 로 표현되며, 이를 기반으로 원래의 Gaussian 점들에 대해 변형을 적용시킨다. 이 과정은 Elendt 메타볼 커널을 이용한 가중 평균 기반의 보간 방식으로 정의되며, 각 점 x의 최종 위치는 다음과 같이 계산된다.

| (2) |

여기서 는 각각 기준(rest) 및 변형된 래티스 포인트이고 는 정규화된 거리이다. 가중치 wi는 아래와 같은 Elendt 메타볼 함수로 정의된다.

| (3) |

이 방식은 Gaussian 각각의 위치를 주변 래티스 포인트들의 변위장을 부드럽게 보간하는 구조로, Gaussian 특유의 색상, 크기, transparency 등 속성은 유지한 채 공간적 이동만 반영된다. 결과적으로 Gaussian 포인트 기반의 장면이 마치 연성 재질처럼 상호작용하거나 충돌하는 장면을 재현할 수 있게 된다.

3-3 렌더링(Rendering)

본 연구의 최종 단계에서는 물리 기반 시뮬레이션을 통해 변형된 점 기반 데이터셋을 고품질 영상으로 변환하기 위한 가우시안 스플랫 렌더링(Gaussian Splat Rendering) 절차를 수행한다. 이 과정은 각 점이 보유한 위치, 방향, 크기, 색상, 불투명도, 조명 응답 계수 등의 속성을 기반으로, 명시적인 메쉬 없이도 시각적으로 일관된 2차원 이미지를 생성하는 데 목적이 있다.

렌더링을 위한 입력 점은 다양한 비정형 속성을 포함하며, 이들은 다음과 같은 수학적 변환을 거쳐 정규화된다.

스케일(크기): 로그 도메인에 저장된 스케일 벡터는 실수 스케일로 복원되며, 각 축별로 다음과 같이 변환된다:

| (4) |

불투명도(opacity): 시뮬레이션 혹은 학습 출력으로부터 얻은 불투명도 o는 시그모이드 함수로 정규화된다:

| (5) |

색상(Color): 각 점의 색상은 조명 반응을 묘사하기 위한 구면 조화(Spherical Harmonics, SH) DC 성분으로부터 추정되며[12], 다음과 같이 표현된다:

| (6) |

각 점의 고차원 조명 특성을 반영하기 위해 SH 계수는 R, G, B 채널별로 4×4 행렬로 저장되며, GPU에서 primvar 접근을 최소화하도록 구성된다.

이러한 SH 행렬은 쿼터니언 회전이 적용된 점에 대해서도 일관된 조명 반응을 유지하도록 한다.

정규화된 점들은 확률적 가중 투영 방식으로 2D 영상 공간에 누적된다. 각 점은 공분산 행렬(방향성 및 스케일 포함)에 기반한 타원형 커널(elliptical kernel)을 갖고, 렌더링 중 중첩되는 점들의 색과 밝기는 불투명도 α에 따라 다음과 같은 누적 규칙으로 혼합된다:

| (7) |

조명 모델은 SH 계수를 기반으로 시점(view direction) 의존적 반사 성분을 근사하며, 시야 각도에 따른 미세한 하이라이트의 움직임 및 반사 특성을 재현할 수 있다. 또한 반투명 객체의 경우, 그림자 계산은 선택적으로 비활성화하여 복잡한 투명광 효과나 발광 재질을 보다 효율적으로 표현한다.

최종적으로, 본 렌더링 파이프라인은 점 데이터 기반 시뮬레이션 결과(변형, 이동, 회전 등)를 시각적으로 정확히 반영하면서, 기존 메쉬 기반 렌더러와는 달리 표면을 명시적으로 생성하지 않고도 연속적이고 부드러운 렌더링 품질을 확보한다. 또한 GPU 기반 병렬 연산 구조와도 양립 가능하여 실시간 혹은 준실시간 환경에서도 안정적인 출력을 제공할 수 있다.

Ⅳ. 실험 및 결과

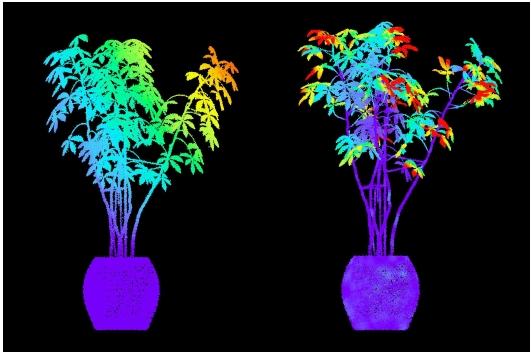

본 장에서는 제안한 파이프라인을 통해 구현한 탄성 변형 시뮬레이션의 성능과 시각적 결과를 평가한다. 실험에는 일반 PC(Ryzen 7950X CPU, NVIDIA RTX 4090 GPU)와 Houdini 기반의 프로토타입 환경을 사용하였으며, 3D GS 구현은 공개된 코드를 활용하고 물리 시뮬레이션 모듈과 연동하였다. 본 연구에서는 고정된 배경 지오메트리(의자 및 백팩) 위에 걸쳐 있는 천(가방 표면)이 중력과 구체 충돌체의 영향에 따라 변형되는 단일 장면을 구성하였다. 해당 장면은 3D GS로 약 100만 개 내외의 Gaussian 포인트로 재구성되었으며, 이를 기반으로 Vellum 기반 탄성 변형 시뮬레이션을 수행하였다.

표 3은 제안한 파이프라인의 Training, Gaussian 생성, 프록시 메쉬 구성, PBD 시뮬레이션 및 렌더링 단계별 설정과 성능을 요약한 것이다. 이를 통해 각 단계의 계산 비용과 처리 특성을 일관되게 분석하였다.

4-1 Vellum 기반 시뮬레이션

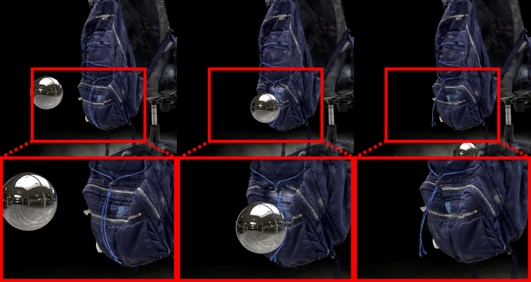

장면 A(Scene A)에서는 고정된 구조물(의자 및 백팩)에 걸쳐진 천(가방 표면)이 중력 및 외부 충격에 의해 변형되는 상황을 구현하였다. 천은 하나의 탄성체(Vellum Cloth)로 설정되었으며, 중력 작용에 따라 중앙부가 아래로 늘어지면서 지지 구조를 따라 주름이 형성되었다. 이후 강체 구체(rigid sphere)를 충돌시켜 동적 변형을 유도하였다. 구체는 천 표면에 낙하하거나 수평 방향으로 이동하며 접촉 지점에 힘을 가하였고, 이에 따라 천은 탄성 복원력과 마찰력에 의해 반응하였다. 천과 구조물 간의 충돌은 레퍼런스 메시 기반으로 처리되었으며, 메시의 변위에 따라 대응하는 가우시안 점들이 함께 이동하도록 구성하여 자연스러운 변형이 이루어졌다.

시뮬레이션은 저해상도 레퍼런스 메시 상에서 수행되었고, 결과는 Point Deform 기법을 통해 고해상도 3D GS 점군에 전달되었다. 이 과정에서 각 포인트는 메시의 변형을 따라가며, 시각적 속성은 그대로 유지되었다. 본 방식은 시뮬레이션 효율을 높이면서도 전체 형상의 변형 양상을 안정적으로 유지할 수 있는 장점을 가진다.

그림 3은 금속 구체 충돌에 따라 천이 처졌다가 복원되는 과정을 시각적으로 보여준다. 충돌 직후 탄성 변형이 발생하였으며, 이후 감쇠 진동(damped oscillation)을 통해 천이 점차 원래 형상으로 회복되는 모습이 관찰되었다. 일부 영역에서는 마찰이 거의 없는 상태에서 천이 구조물 위를 미끄러지듯 이동하는 움직임도 나타났다. 최종적으로 천은 초기 형태로 대부분 복원되었으며, 이러한 변형 및 회복 양상이 시뮬레이션 상에서도 현실감 있게 재현되었음을 확인하였다.

4-2 비교실험

본 연구에서는 PhysGaussian과 제안 기법 간의 공간적, 시간적 변형 차이를 정량적으로 분석하기 위해, 포인트 위치 P(t)로부터 유도한 속도(velocity), 가속도(acceleration), 속도 변동계수(cv_v) 등의 지표를 산출하였다. 먼저 프레임당 위치 변화로부터 속도는 다음의 후진 차분으로 계산하였다.

| (8) |

가속도는 가능한 경우 중앙차분을 통해 보다 안정적으로 추정하였다.

| (9) |

이후 각 포인트의 가속도 크기는

| (10) |

으로 계산하였다. 또한 프레임 내 포인트들의 국소적 속도 다양성(local motion diversity)을 정량화하기 위해, 속도 크기의 평균을 μv, 표준편차를 σv라 할 때 속도 변동계수(cv_v)를 다음과 같이 정의했다.

| (11) |

이는 프레임 내 포인트들의 속도가 얼마나 이질적이고 다양하게 분포하는지를 나타내는 지표로, 국소적 변형의 세밀함을 비교하는 데 유용하다.

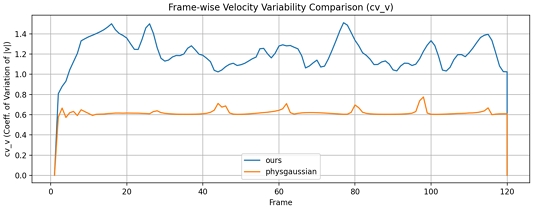

그림 4는 프레임별 cvv(t)값을 비교한 결과이다.

PhysGaussian은 시퀀스 전체에서 약 0.6 수준의 일정한 cv_v를 유지하며, 이는 포인트 간 속도 분포가 균일함을 의미한다. 즉, 대부분의 포인트가 전역적으로 비슷한 속도와 방향으로 움직이는 일관적인 움직임을 보였다.

반면 제안 기법은 1.0~1.5 수준의 높은 cv_v 값을 지속적으로 유지하였으며, 프레임마다 비선형적 변동이 발생하였다. 이는 유연한 구조(예: 옷감, 나뭇잎)가 외력, 지지 구조에 따라 서로 다른 속도 패턴을 가지며 국소적인 움직임을 보여준다는 것을 의미한다.

그림 5는 두 기법의 가속도 크기 (∥a(t)∥)를 시각화한 것이다. PhysGaussian에서는 가속도가 전체 포인트에 비교적 균일하게 분포하며, 외력이 작용하면 물체 전체가 하나의 통일된 질량체처럼 반응하는 모습을 보였다. 이로 인해 국소적인 영역에서의 개별적 변형 패턴을 표현하는 데에는 한계가 있다.

반면, 제안 기법은 충돌 지점이나 처짐이 크게 발생하는 영역에서 가속도가 높게 집중, 고정 구조나 지지부에서는 가속도가 거의 0에 가까운 값을 보였다. 이는 외력이 특정 위치에만 전달되어 부위별로 독립적인 변형이 발생함을 의미하며, PBD 기반 제약 방식이 지역적 조절(regional control)을 가능하게 함을 보여준다.

Ⅴ. 결 론

3D GS 기반의 포인트 클라우드 표현에 PBD 기반 연성 시뮬레이션을 통합한 파이프라인을 제안하였다. 이를 통해 점 기반 장면에서도 외부 충돌이나 중력에 반응하는 물리 기반의 탄성 변형을 보다 효과적으로 구현할 수 있게 되었다. 또한 저해상도 메쉬 상의 시뮬레이션 결과를 고해상도 점군에 효율적으로 전달할 수 있는 구조를 설계하였다. 연구 방법은 Vellum Cloth 기반의 변형 계산과 3D GS 기반 실시간 렌더링을 연계하였다, 이를 통해 사용자에게 직관적이고 현실감 있는 시각적 피드백을 제공이 가능해졌다.

이러한 가능성을 증명하기 위해서 실시한 사례 실험을 통해 제안했던 파이프라인이 형상 보존을 잘 유지하면서 연체 변형을 안정적으로 구현하고 있음이 확인되었다. PhysGaussian과의 비교 실험 결과에서는 제안한 기법이 전역 시뮬레이션에 비해 국소 영역의 미세한 변형을 더욱 정밀하게 표현할 수 있으며, 속도 및 가속도 기반의 지표에서도 높은 반응성을 나타냈다.

향후 본 파이프라인을 다양한 물리 시나리오(파괴, 유체 분산 등)에 확장하고, 입자 기반 기법의 적용 범위를 넓혀 점 기반 장면의 물리 표현력을 강화할 수 있는 후속 연구를 진행하고자 한다. 나아가 디지털 에셋 형태로 파이프라인을 공개하여 아티스트 커뮤니티와의 협업을 기반으로 실제 콘텐츠 제작 현장에서의 활용 가능성 또한 모색해 보고자 한다. 점 기반 렌더링과 물리 시뮬레이션의 융합이라는 새로운 관점과 방향성을 제시한 본 연구 결과를 바탕으로, 인터랙티브 디지털 콘텐츠 제작의 실용적 기반이 제공되기를 기대한다.

Acknowledgments

이 논문은 2024년도 중앙대학교 연구 장학기금 지원에 의한 것임.

References

-

B. Kerbl, G. Kopanas, T. Leimkühler, and G. Drettakis, “3D Gaussian Splatting for Real-Time Radiance Field Rendering,” ACM Transactions on Graphics, Vol. 42, No. 4, 139, pp. 1-14, July 2023.

[https://doi.org/10.1145/3592433]

-

T. Xie, Z. Zong, Y. Qiu, X. Li, Y. Feng, Y. Yang, and C. Jiang, “PhysGaussian: Physics-Integrated 3D Gaussians for Generative Dynamics,” in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle: WA, pp. 4389-4398, 2024.

[https://doi.org/10.1109/CVPR52733.2024.00420]

-

Y. Feng, X. Feng, Y. Shang, Y. Jiang, C. Yu, Z. Zong, ... and Y. Yang, “Gaussian Splashing: Unified Particles for Versatile Motion Synthesis and Rendering,” in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Nashville: TN, pp. 518-529, 2025.

[https://doi.org/10.1109/CVPR52734.2025.00057]

-

T. Müller, A. Evans, C. Schied, and A. Keller, “Instant Neural Graphics Primitives with a Multiresolution Hash Encoding,” ACM Transactions on Graphics, Vol. 41, No. 4, 102, pp. 1-15, 2022.

[https://doi.org/10.1145/3528223.3530127]

-

J. T. Barron, B. Mildenhall, M. Tancik, P. Hedman, R. Martin-Brualla, and P. P. Srinivasan, “Mip-NeRF: A Multiscale Representation for Anti-Aliasing Neural Radiance Fields,” in Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV), Montreal: Canada, pp. 5855-5864, 2021.

[https://doi.org/10.1109/ICCV48922.2021.00580]

-

G. Wu, T. Yi, J. Fang, L. Xie, X. Zhang, W. Wei, ... and X. Wang, “4D Gaussian Splatting for Real-Time Dynamic Scene Rendering,” in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle: WA, pp. 20310-20320, 2024.

[https://doi.org/10.1109/CVPR52733.2024.01920]

-

Z. Yang, X. Gao, W. Zhou, S. Jiao, Y. Zhang, and X. Jin, “Deformable 3D Gaussians for High-Fidelity Monocular Dynamic Scene Reconstruction,” in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle: WA, pp. 20331-20341, 2024.

[https://doi.org/10.1109/CVPR52733.2024.01922]

-

J. L. Schönberger and J.-M. Frahm, “Structure-from-Motion Revisited,” in Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas: NV, pp. 4104-4113, 2016.

[https://doi.org/10.1109/CVPR.2016.445]

-

M. Müller, B. Heidelberger, M. Teschner, and M. Gross, “Meshless Deformations Based on Shape Matching,” ACM Transactions Graphics (TOG), Vol. 24, No. 63, pp. 471-478, 2005.

[https://doi.org/10.1145/1073204.1073216]

-

M. Müller, B. Heidelberger, M. Hennix, and J. Ratcliff, “Position Based Dynamics,” Journal of Visual Communication and Image Representation, Vol. 18, No. 2, pp. 109-118, 2007.

[https://doi.org/10.1016/j.jvcir.2007.01.005]

-

M. Macklin, M. Müller, N. Chentanez, and T.-Y. Kim, “XPBD: Position-Based Simulation of Compliant Constrained Dynamics,” in Proceedings of the 9th International Conference on Motion in Games (MIG 2016), Burlingame: CA, pp. 49-54, 2016.

[https://doi.org/10.1145/2994258.2994272]

-

R. Ramamoorthi and P. Hanrahan, “An Efficient Representation for Irradiance Environment Maps,” in Proceedings of the 28th Annual Conference on Computer Graphics and Interactive Techniques (SIGGRAPH 2001), pp. 497-500, 2001.

[https://doi.org/10.1145/383259.383317]

저자소개

2024년:중앙대학교 예술공학부 (공학사)

2024년~현 재: 중앙대학교 첨단영상대학원 영상학과 석사과정

※관심분야:시각효과 파이프라인(VFX Pipeline), 컴퓨터 그래픽스(Computer Graphics), 물리 기반 시뮬레이션(Physics-Based Simulation), 게임 엔진(Game Engine), 3D 재구성(3D Reconstruction)

2002년:중앙대학교 기계설계학과 학사

2002년:중앙대학교 첨단영상대학원 컴퓨터 특수효과 영상 석사

2012년:중앙대학교 첨단영상대학원 예술공학 박사

2012년~2018년:덱스터 스튜디오 디지털휴먼 & VR 연구소장

2019년~현 재: 중앙대학교 예술공학대학 부교수

※관심분야:가상존재(Virtual Beings), 확장현실(eXtended Reality), 시각효과(VFX), 실감 미디어(Immersive Media)