인공지능 생성 콘텐츠의 기술적·사회적 신뢰 통합을 위한 탈중앙 계층적 신뢰 모델

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구는 생성형 인공지능의 확산으로 인한 디지털 콘텐츠의 신뢰 문제를 해결하기 위해 C2PA(Coalition for Content Provenance and Authenticity)의 기술적 신뢰 모델과 DIF CAWG(Creator Assertions Working Group)의 어설션(Assertion)을 상호운용성을 기반으로 확장하고 체계화한 새로운 신뢰 보증 프레임워크를 제안한다. C2PA는 무결성과 출처를 기술적으로 검증하지만, 창작자의 신원, 권리, 동의, 승인 등 사회적 맥락은 충분히 반영하지 못한다. 이를 보완하기 위해 본 연구는 DIF의 CAWG에서 논의 중인 어설션과 DID(Decentralized Identifier)/VC(Verifiable Credentials) 기반의 탈중앙 신뢰를 결합하여, 기술적, 사회적, 제도적, 평판적 신뢰를 포괄하는 계층적 모델을 설계하였다. 또한 언론, 교육, 예술, 정치, 의료, 학술 연구 등 다양한 시나리오를 통해 제안 모델의 개념적 적용 가능성을 검토하였다.

Abstract

This study proposes a new trust assurance framework to address the reliability challenges of digital content generated by generative artificial intelligence. The framework extends and systematizes the technical trust model of the Coalition for Content Provenance and Authenticity (C2PA) in conjunction with the assertions of the Decentralized Identity Foundation’s Creator Assertions Working Group (CAWG), which is designed with interoperability considerations. While C2PA verifies integrity and provenance, it does not sufficiently reflect the social context of authorship, such as identity, rights, consent, and endorsement. To address this issue, the proposed model integrates CAWG assertions with decentralized trust mechanisms based on decentralized identifiers (DIDs) and verifiable credentials (VCs), thereby constructing a hierarchical model encompassing technical, social, institutional, and reputational trust. Furthermore, by examining diverse application scenarios in journalism, education, the arts, politics, healthcare, and academic research, the study evaluates the conceptual applicability of the proposed model.

Keywords:

Content Authenticity, Generative AI, Technical Trust, Social Trust, Decentralized Trust키워드:

콘텐츠 진위성, 생성형 인공지능, 기술적 신뢰, 사회적 신뢰, 탈중앙 신뢰Ⅰ. 서 론

최근 생성형 인공지능(Generative AI)의 급속한 발전은 텍스트, 이미지, 오디오, 비디오 등 다양한 형태의 콘텐츠를 자동으로 생성할 수 있게 되었다. ChatGPT, Stable Diffusion, Midjourney, Sora 등의 모델이 대중적으로 확산되면서 콘텐츠 생산의 효율성과 창의성이 크게 향상되었다. 그러나 이러한 긍정적 효과에도 불구하고, 인공지능 생성물의 급속한 확산은 디지털 사회에서 콘텐츠의 진위 여부(authenticity)와 출처(provenance)에 대한 신뢰(trust)를 약화시키는 부정적인 결과를 초래하였다. 특히 딥페이크(deepfake), 허위 정보(disinformation), 저작권 불명확성(copyright ambiguity) 등은 콘텐츠 이용자뿐 아니라 사회 전반의 혼란을 야기하는 주요 원인으로 지적되고 있다[1].

인공지능이 생성한 콘텐츠는 전통적 콘텐츠와 달리 생성 주체와 의도, 권리 관계가 불투명하다는 특징을 보인다. 뉴스 기사, 교육 자료, 예술 작품 등에서 단순한 무결성 보장만으로는 충분하지 않다. 인공지능이 생성한 뉴스 기사나 이미지는 독자에게 신뢰적 착시를 줄 수 있으나, 그 출처와 생성 의도가 불분명하다면 사회적 혼란으로 이어질 수 있다[2]. 따라서 기술적 무결성 검증을 넘어, 사회적 맥락(social context)과 책임성(accountability)을 함께 보장할 수 있는 새로운 신뢰 보증체계(trust assurance framework)가 요구된다.

이러한 문제 상황에서 등장한 것이 C2PA(Coalition for Content Provenance and Authenticity)였다. C2PA는 디지털 콘텐츠에 “콘텐츠 크리덴셜(Content Credentials)” 메타데이터를 부착하여 생성·편집 이력을 추적하고 검증할 수 있도록 설계되었으며[3], 디지털 서명(digital signature), 해시 체인(hash chain), 구조화된 어설션과 매니페스트(Manifest)를 활용하여 콘텐츠의 변조 여부를 검증하고 생성 도구와 관련된 출처 정보를 기록하였다. 실제로 Google은 이를 자사 서비스에 도입하여 인공지능으로 생성된 이미지에 자동으로 “AI 생성”이라는 라벨을 부착하고, 사용자가 이미지의 출처와 변형 여부를 확인할 수 있도록 하였다[4]. 이러한 접근은 디지털 미디어 환경에서 투명성과 신뢰성을 제공했으며, 특히 언론 및 저널리즘 환경에서 중요한 의미를 지녔다.

그러나 C2PA가 제공하는 신뢰는 기술적 신뢰(technical trust)에 국한된다는 한계를 가진다. 콘텐츠의 변조 방지와 출처 추적은 가능했지만, 콘텐츠 제작의 의도(intent), 데이터 활용 동의(consent), 저작권 및 권리 관계(right)와 같은 사회적 맥락을 포괄하기에는 부족했다[5]. 예를 들어, 인공지능이 생성한 이미지를 C2PA로 추적할 수는 있었으나 연구용인지 상업용인지, 데이터 제공자의 동의가 있었는지 여부와 같은 중요한 사회적 의미를 포함하지 못했다. 또한 개방형 생태계에서는 메타데이터 누락, 호환성 문제, 사용자 도구의 불안전한 지원 등으로 인해 모든 신뢰 요구를 충족시키기에는 실무적 한계도 존재했다[5].

이러한 한계를 보완하기 위해 DIF(Decentralized Identity Foundation)[6]는 Creator Assertions Working Group (CAWG)[7]을 설립하였다. CAWG는 DIF 산하의 독립 그룹으로, C2PA와 직접 통합된 구조는 아니지만 상호운용성을 고려하여 C2PA 매니페스트와 결합 가능한 사회적 신뢰(social trust) 어설션을 정의하고 있다. 본 연구는 이러한 상호운용 가능성을 토대로, 구체적인 계층적 신뢰 프레임워크를 확장적으로 제안한다.

CAWG는 콘텐츠 생성자 또는 권리 보유자의 신원 및 관리 정보를 표현하는 신원 어설션(Identity Assertion), Exif(Exchangeable Image File Format), IPTC(International Press Telecommunications Council)등 기존 메타데이터를 안전하게 포함하는 메타데이터 어설션(Metadata Assertion), 인공지능 학습 및 데이터 마이닝 활용 여부를 규정하는 학습 및 데이터 마이닝 어설션(Training and Data Mining Assertion), 언론사, 학회 등 제3자 기관의 보증을 나타내는 승인 어설션(Endorsement Assertion)을 정의하였다. 이러한 어설션은 단순한 무결성 검증 및 출처 보장을 넘어, 콘텐츠의 신원, 활용 조건, 외부 보증과 같은 사회적 맥락을 구조적으로 반영하였다. 즉, C2PA가 제공한 “변조되지 않았다”는 기술적 신뢰에 더해, CAWG는 “특정 의도와 맥락 속에서 생성되었고, 특정 기관에 의해 보증되었다”는 사회적 신뢰를 보강하였다.

한편, 본 연구에서는 CAWG 내에서 논의되고 있으나 아직 표준화되지 않은 의도 어설션(Intent Assertion)을 확장적으로 제안한다. 이는 콘텐츠의 생성 목적(예: 교육, 연구, 상업, 풍자 등)을 명확히 기술하여 기존 어설션 체계를 보완하고, 기술적 신뢰와 사회적 신뢰를 아우르는 계층적 신뢰 모델의 완성을 지원한다.

결국 인공지능 생성물의 신뢰 문제는 기술적 무결성 검증만으로는 해결될 수 없다. 교육 환경에서는 “교육적 목적”, 저널리즘에서는 “언론사의 보증”, 예술에서는 “저작권 명시”, 데이터 학습에서는 “데이터 제공자의 동의”가 필수적이었다. 따라서 본 연구는 C2PA와 CAWG 어설션을 상호운용적으로 연계한 인공지능 생성물 신뢰 프레임워크를 제안한다. 이를 통해 첫째, 기술적 신뢰와 사회적 신뢰를 통합하는 계층적 신뢰 모델을 제시하여 이론적 기여를 하고, 둘째, C2PA 매니페스트와 CAWG 어설션의 통합 가능성을 DID/VC 기반 구조와 연계하여 표준적 기여를 도모하며, 셋째, 언론·교육·예술 등 다양한 적용 시나리오를 통해 실무적 기여를 추구한다. 본 연구는 기술적 신뢰에서 사회적 신뢰로 확장되는 새로운 콘텐츠 신뢰 패러다임을 제시한다. 특히 인공지능 생성물의 신뢰 보증을 위한 현실적 적용 가능성을 탐색한다.

본 논문의 구성은 다음과 같다. 2장에서는 C2PA와 DIF CAWG의 활동을 중심으로 관련 연구를 살펴보고, 기존 접근법의 한계점을 도출한다. 3장에서는 인공지능 생성물의 신뢰 문제를 구체적으로 정의하고, 기술적, 사회적 신뢰의 상호 보완 필요성을 논의한다. 4장에서는 C2PA와 CAWG 어설션을 DID/VC 기반 구조와 연계한 계층적 신뢰 보증 모델을 제안한다. 5장에서는 언론, 예술, 정치, 의료, 학술 연구 등 다양한 분야의 적용 시나리오를 통해 제안 모델의 실질적 타당성을 검증한다. 마지막으로 6장에서 연구 결과를 요약하고 향후 연구 과제를 제시한다.

Ⅱ. 관련 연구(Related Work)

2-1 C2PA

C2PA는 Adobe, Microsoft, BBC, Intel 등 글로벌 기업이 참여하는 국제 컨소시엄으로서 디지털 콘텐츠의 출처와 무결성을 검증하기 위한 콘텐츠 크리덴셜 표준을 정의하고 있다[3]. 이를 통해 게시자, 제작자, 소비자는 콘텐츠의 생성 및 편집 내역을 확인하며, 진위 여부까지 검증할 수 있다.

C2PA의 매니페스트는 콘텐츠의 신뢰성을 입증하는 핵심 단위로, 다양한 정보를 담는 어설션을 포함한다. 어설션은 작성자, 생성 도구, 편집 내역 등 콘텐츠 관련 정보를 구조화된 데이터(JSON, JSON-LD, CBOR 등)로 표현하며, 자동 검증, 상호운용성, 위변조 탐지를 가능하게 한다.

C2PA 매니페스트는 그림 1과 같이 세 가지 구성 요소로 구성된다. 어설션 저장소(Assertion Store)는 개별 어설션의 집합이고, 클레임(Claim)은 선택된 어설션과 그 무결성을 보장하는 해시와 함께 구성된 진술이다. 서명(Signature)은 클레임 전체를 서명한 블록으로, COSE 또는 CMS와 같은 표준 서명 컨테이너가 사용된다. 이를 통해 어설션, 클레임, 서명이 결합된 매니페스트는 검증 가능한 단위를 형성한다.

C2PA의 신뢰 모델은 PKI(Public-Key Infrastructure)에 기반한다. 콘텐츠 제작자는 매니페스트를 작성하고 자신의 개인키로 서명하며, 해당 인증서는 상위 기관을 거쳐 루트 인증기관까지 이어지는 신뢰 체인에 포함된다. 소비자는 매니페스트와 서명을 검증함으로써 어설션과 클레임이 위변조되지 않았음을 확인하고, 서명자가 신뢰할 수 있는 인증기관에 속해 있음을 검증할 수 있다. 결과적으로 C2PA는 PKI 기반의 기술적 신뢰를 보장하며, 이를 토대로 어설션과 클레임의 의미를 해석하여 논리적 신뢰로 확장되도록 설계되었다.

그러나 C2PA가 제공하는 이러한 기술적 신뢰는 주로 디지털 콘텐츠의 무결성과 출처를 보장하는 수준에 국한된다. 즉, 구조적·명시적 신뢰(Structural Trust)는 제공할 수 있지만, 콘텐츠 창작자의 실제 신원, 권리, 의도, 사회적 승인과 같은 맥락적 및 사회적 신뢰(Contextual and Social Trust)를 충분히 표현할 수 없다.

예를 들어, 발행자의 인증서를 통해 서명자의 신원을 확인할 수 있지만 실제 창작자가 누구인지는 드러나지 않는다. 또한 제3자 승인이나 조건부 허용(예: 비상업적 연구 목적만 허용)과 같은 세밀한 의도 표현은 제한된다. 또한 메타데이터가 Exif, IPTC 등 기존 표준에 의존하기 때문에 Web3 환경이나 소셜 미디어 계정 정보 등 새로운 형태의 맥락적 메타데이터를 포괄하기 어렵다.

2-2 CAWG(Creator Assertions Working Group)

C2PA가 제공하는 기술적 신뢰는 디지털 콘텐츠의 무결성과 출처를 보장하는 데 효과적이지만, 창작자의 신원, 권리, 의도와 같은 맥락적 및 사회적 신뢰를 충분히 담아내지 못하는 한계가 존재한다. 이러한 공백을 메우기 위해 DIF의 CAWG는 C2PA 매니페스트를 확장하는 다양한 활동을 전개하고 있다[7].

CAWG의 핵심 활동은 C2PA가 제공하는 구조적 신뢰(Structural Trust)를 보완하고 맥락적 신뢰(Contextual Trust)를 추가하는 것이다. 이를 통해 창작자가 자신의 콘텐츠와 관련된 신뢰 신호(trust signals)를 명시적으로 제시할 수 있도록 지원하며, C2PA와의 상호운용을 염두에 두고 있으나 독립적인 어설션 체계로 발전하고 있다[8].

- • 신원 어설션(Identity Assertion): DID(Decentralized Identifier)[9]와 VC(Verifiable Credentials)[10]에 기반하여 창작자의 신원을 표현하고 제작 주체를 명확히 한다.

- • 메타데이터 어설션(Metadata Assertion): Exif, IPTC, XMP 등 기존 메타데이터를 안전하게 포함하여 변조 가능성을 줄이고 무결성을 보장한다.

- • 학습 및 데이터 마이닝 어설션(Training and Data Mining Assertion): 콘텐츠의 인공지능 학습 데이터 마이닝 활용 가능 여부를 조건부로 명확히 기술한다.

- • 승인 어설션(Endorsement Assertion): 제3자의 승인과 지지를 기록하여 사회적 신뢰를 표현한다.

이러한 활동은 C2PA가 제공하지 못하는 창작자 권리, 의도, 승인 등 맥락적 요소를 보강함으로써, 콘텐츠 신뢰 모델을 기술적 신뢰에서 맥락적 및 사회적 신뢰로 확장하는 시도로 볼 수 있다. 나아가 CAWG는 프라이버시 보호, 신원 공개 범위의 유연성, 불필요한 콘텐츠 간 연계 방지, 외부 식별자(EIDR, ISNI 등)와의 연계 가능성까지 고려하며 진화하고 있다.

여기서 주목할 점은, CAWG가 C2PA의 공식 워킹그룹은 아니라는 것이다. CAWG는 DIF 산하의 별도 그룹으로, C2PA의 기술적 신뢰 모델과 직접적으로 통합되어 있지는 않다. 다만 상호운용성과 호환성을 고려하여 C2PA 매니페스트와 결합 가능한 확장적 구조를 논의하고 있다는 점에서 독립적이면서 보완적인 성격을 지닌다.

2-3 인공지능 생성 콘텐츠 신뢰성 관련 선행 연구

최근 생성형 인공지능의 확산으로 인해 콘텐츠의 진위, 출처, 저작권 및 책임성 확보에 대한 학술적 관심이 급격히 높아지고 있다. 기존 연구는 주로 기술적 검증 중심 접근과 메타데이터 기반 신뢰 관리로 구분된다.

워터마킹 기반 연구에서는 인공지능 생성 이미지나 텍스트에 식별 패턴을 삽입하여 생성 사실을 추적하는 방법이 제안되었다. Jiang et al.[11]은 워터마크를 통해 인공지능 이미지의 탐지 및 출처 추적이 가능함을 보였으나, 편집, 압축 등 후처리 공격에 취약하고 사회적 신뢰 요소를 반영하지 못했다. 유사하게, Google SynthID 및 Meta Invisible Watermark 기술은 생성 시점 식별에는 유용하지만, 위조, 재가공 콘텐츠에 대한 내성은 제한적이다[12].

C2PA 기반 연구는 암호학적 서명과 매니페스트를 결합하여 생성 및 편집 이력을 기록하여 기술적 무결성을 보장한다. Simmons et al.[13]은 방송 뉴스 콘텐츠의 진위 검증을 위해 C2PA 매니페스트와 워터마크를 통합하는 프로토타입을 제시했으나, 사회적 신뢰나 제도적 책임성은 다루지 않았다. 미 국방부의 2025 리포트[14] 역시 콘텐츠 크리덴셜 기반 신뢰 보증 프레임워크를 제시했지만, 구체적인 실증 데이터나 비교 분석은 없었다.

블록체인 및 NFT 기반 연구로는 Balan et al.[15]의 EKILA 시스템이 대표적이다. 이 연구는 생성형 인공지능 예술 작품의 기여자 식별과 NFT 권리 관리 기능을 결합하였으나, 블록체인에 의존하여 데이터 크기와 검증 비용이 높고, 창작자의 의도나 동의 표현을 지원하지 않는다.

SSI 및 DID/VC 기반 연구도 활발하다. Farhan et al.[16]은 SSI 기반 콘텐츠 출처 검증 모델을 제안했으며, DID/VC를 활용해 생성 주체를 인증하였다. 그러나 기술적 식별체계에 초점이 맞추어져 있으며, 사회적, 평판적 신뢰 계층에 대한 논의는 부족하다. Chang and Echizen[17]은 다중 에이전트 환경에서의 생성형 인공지능 출처 추적을 제시했으나, 표준화된 C2PA 구조와의 연계성은 미흡하다.

법적·제도적 장치는 저작권, 활용 동의, 상업적 이용 범위 등 여전히 불확실한 영역을 다룬다. EU는 2024년 제정된 AI Act에서 투명한 표기를 의무화를 규정하였으며 미국과 한국도 인공지능 생성물 표시, 저작권 보호, 책임성 강화에 관한 논의를 이어가고 있다. 이러한 제도는 책임성과 사회적 신뢰의 기반이 되지만, 국가별 차이와 국제적 합의의 부재가 한계로 지적된다.

이상의 연구들은 대부분 기술적 진위 검증에 집중하고 있으며, 의도, 동의, 책임성 등 사회적 신뢰 요인을 구조적으로 반영하지 못한다는 한계를 가진다. 이에 비해 본 연구는 C2PA 기반의 기술적 무결성 계층에 CAWG 어설션을 통합하고 거버넌스 및 신뢰 계층을 추가한 4계층 통합 신뢰 프레임워크를 제안한다. 이를 통해 기존 단일 축 접근(워터마킹 또는 블록체인 중심)과 달리, 인공지능 생성 콘텐츠의 기술적·사회적·제도적 신뢰성을 동시에 검증할 수 있는 체계를 제시한다.

Ⅲ. 문제 정의와 제안 모델

3-1 문제 정의(Problem Statement)

C2PA와 CAWG의 관계 또한 명확히 할 필요가 있다. C2PA는 기술적 무결성과 출처 검증을 중심으로 하는 표준화가 이루어지고 있는 반면, CAWG는 DIF 산하에서 사회적 신뢰 요소를 보완하기 위한 어설션 체계를 논의하는 별도 그룹이다. 따라서 CAWG는 C2PA와 공식적으로 결합된 구조는 아니지만, DIF 산하의 독립 그룹으로 C2PA와의 상호운용성을 고려한 보완적 성격을 지닌다.

오늘날 인공지능 기반 콘텐츠 생성 기술은 뉴스 기사, 이미지, 영상, 음성 등 다양한 디지털 산출물을 대량으로 생산하고 있다. 그러나 인공지능 생성물은 인간 창작물과 시각적으로 구별하기 어렵고, 생성 과정과 맥락이 불투명하기 때문에 진위 여부, 출처, 사회적 책임의 문제가 심화되고 있다. 예를 들어 인공지능이 작성한 기사나 이미지에서 실제 창작자의 신원과 의도가 드러나지 않아 저작권 분쟁이나 허위 정보 확산에 대한 책임을 명확히 하기 어려운 상황이 발생하고 있다. 이에 따라 허위 정보 유포, 저작권 침해, 의도적 조작 등 사회적 신뢰를 훼손하는 사례가 증가하면서, 디지털 생태계 전반에 걸친 심각한 위협으로 이어지고 있다.

이를 해결하기 위해 C2PA는 디지털 콘텐츠의 생성 및 편집 이력을 추적하고 무결성을 보장하는 콘텐츠 크리덴셜 표준을 제안하였다. 그러나 C2PA는 주로 기술적 신뢰에 집중하여 사회적 정체성, 권리, 승인, 인공지능 활용 여부 등 사회적 신뢰를 반영하지 못한다. 반대로 DIF 산하의 CAWG는 Identity, Metadata, Training and Data Mining, Endorsement 어설션을 통해 사회적 신뢰 요소를 표현할 수 있으나, C2PA의 기술적 신뢰 인프라와 직접 결합되지는 않는다.

따라서, 인공지능 생성물의 신뢰 확보를 위해서는 C2PA의 기술적 신뢰와 CAWG의 사회적 신뢰를 상호운용성 기반으로 확장하는 프레임워크가 필요하다. 더 나아가 C2PA는 전통적인 PKI 기반 신원 체계에 의존하는 반면, 글로벌 디지털 신원 생태계는 점차 DID/VC를 활용한 탈중앙 신뢰 모델로 전환하고 있다. 따라서 DID 및 VC를 연계하면 콘텐츠 생성자와 검증자가 탈중앙화된 신뢰 체계에서 상호운용성을 확보할 수 있으며, 이는 글로벌 차원의 신뢰 확장성과 지속 가능성을 보장한다.

3-2 제안 모델(Proposed Model)

본 연구는 인공지능 생성물의 신뢰 보장을 위해 C2PA 기반의 기술적 신뢰와 DIF의 CAWG 기반의 사회적 신뢰를 상호운용적으로 연결한다. 이를 위해 CAWG 어설션 세트에 더해, 기존 체계가 포괄하지 못했던 의도 어설션 및 동의 어설션을 추가로 제안하고, DID/VC 검증 구조와 결합한 다층적 신뢰 프레임워크를 설계한다.

먼저, CAWG가 정의한 신원(identity), 메타데이터(Metadata), 학습 및 데이터 마이닝(Training and Data Mining), 승인(Endorsement) 어설션은 C2PA가 제공하지 못하는 사회적 맥락을 보강한다. 그러나 기존 CAWG 어설션은 콘텐츠 생성 목적과 권리자 동의 여부라는 핵심 요소를 포괄하기 어렵다. 창작 의도는 뉴스, 교육, 예술, 정치 등 맥락에서 신뢰 판단의 기준이 되며 권리자의 동의 여부는 상업적 활용, 2차 가공, 재사용 등 법적 제도적 책임과 직접 연결된다. 따라서 본 연구는 의도 어설션과 동의 어설션을 추가함으로써, 기존 체계가 담지 못한 생성 맥락(Context of Creation)과 활용 조건(Context of Use)을 구조적으로 반영한다. 이를 통해 제안 모델은 C2PA와 CAWG의 보완적 관계를 기반으로 하여 인공지능 생성물의 전주기 신뢰 구조를 더욱 충실하게 체계화한다.

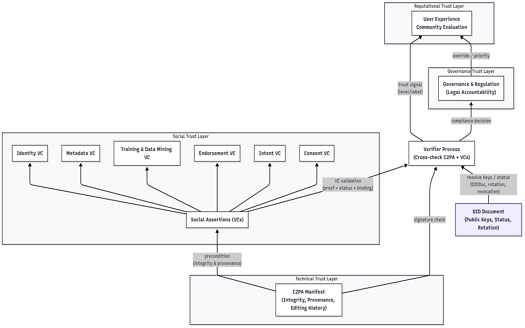

제안 모델은 네 가지 계층으로 구성된다. 첫째, 기술적 신뢰 계층은 C2PA의 매니페스트를 기반으로 콘텐츠의 무결성, 출처, 편집 이력을 보장한다. 둘째, 사회적 신뢰 계층은 CAWG의 신원 어설션, 메타데이터 어설션, 학습 및 데이터 마이닝 어설션, 승인 어설션과 함께, 본 연구에서 새롭게 제안한 의도 및 동의 어설션을 포함하여 창작 목적과 권리자 동의 여부를 구조적으로 표현한다. 셋째, 거버넌스 신뢰 계층은 국가 및 국제 제도와 규제와 연계해 법적 책임성과 제도적 보장을 제공한다. 넷째, 평판적 신뢰 계층은 이용자 경험, 커뮤니티 평가, 사회적 확산을 통해 보조적 신뢰 신호를 제공하며, 기술적·사회적 신뢰가 검증하기 어려운 인지적 신뢰를 보완한다. 평판적 신뢰는 단순한 주관적 인식이 아니라, 사용자 피드백 점수, 재사용·참조 빈도, 검증 성공률, 전문가 혹은 기관의 인증, 소셜 네트워크 내 긍정·부정 언급 비율 등으로 정량화될 수 있다.

각 계층은 독립적으로 신뢰 신호를 제공하지만, 검증 과정에서는 상호 보완적으로 작동한다. 기술적 신뢰는 무결성과 출처를 보장하는 최소 요건으로, 이를 충족하지 못하면 다른 신뢰 계층은 무의미하다. 기술적 무결성이 확보되더라도, 의도나 동의가 결여되면 콘텐츠는 제한된 신뢰 상태로 분류된다. 평판적 신뢰는 사회적 신뢰를 보완하는 지표로서, 기술적 검증이 완료되었더라도 평판이 낮은 경우 전체 신뢰 점수를 조정하여 경고 수준으로 분류된다. 반대로, 사회적 신뢰가 부족하더라도 평판적 신뢰가 높게 유지되는 경우, 평판적 신뢰 계층이 보정적 역할을 수행하여 전체 신뢰 수준을 일정 부분 상향 조정한다. 사회적 및 평판적 신뢰가 거버넌스 기준과 충돌할 경우 거버넌스 신뢰 계층이 최종 조정자 역할을 한다. 또한, 기술적 신뢰와 거버넌스 신뢰가 상충하는 경우 거버넌스 신뢰가 우선한다. 예를 들어, 기술적으로 무결성이 검증되었더라도 법적으로 불법 콘텐츠로 분류된다면 거버넌스 신뢰가 우선한다. 이러한 우선순위 규칙에 따라 검증자는 기술적 신뢰 확보 여부, 사회적‧평판적 신뢰 평가, 거버넌스 기준의 정합성을 순차적으로 확인해 일관된 결과를 얻도록 설계되었다. 결과적으로, 평판적 신뢰 계층은 실시간 사용자 경험과 사회적 피드백을 통해 신뢰 수준을 동적으로 조정함으로써, 기술적, 사회적 신뢰 모델의 정적 한계를 보완한다.

검증 과정에는 DID/VC 기반 구조를 적용한다. 각 어설션은 VC 형태로 발급되어 서명되며, 검증자는 C2PA 매니페스트와 함께 이를 교차 검증한다. 구체적으로, DID 문서의 공개키로 C2PA 서명을 검증하고, VC와 VP를 통해 사회적 신뢰 어설션을 확인한다. 이때 VC 내부에는 원본 콘텐츠의 해시(assetDigest)와 매니페스트의 해시(manifestDigest)를 포함해 교차 바인딩을 보장한다. 또한 민감한 맥락(예: 관리자 동의, 창작 의도)은 선택적 공개(Selective Disclosure)와 영지식 증명(ZKP: Zero-Knowledge Proof)을 통해 필요한 범위에서만 공개할 수 있어 보호와 신뢰 검증의 균형을 달성한다. 그림 2는 C2PA 기반의 기술적 신뢰 계층을 바탕으로 어설션 VC를 통한 사회적 신뢰 계층을 결합하고 그 위에 거버넌스 및 평판적 신뢰 계층을 배치한 다층적 신뢰 구조를 보여준다. 또한 DID 문서와 검증 프로세스를 통해 C2PA와 VC를 교차 검증하는 과정을 포함하여 전주기적이고 일관된 신뢰 검증 흐름을 표현한다.

본 연구의 차별성은 첫째, CAWG에서 논의 단계에 머물던 의도 어설션을 학문적으로 구조화하여 계층적 신뢰 모델 속에 체계적으로 반영한 점, 둘째, 기존에 제시되지 않았던 동의 어설션을 새롭게 도입하여 사회적 책임성을 강화한 점, 셋째, DID/VC 기반의 탈중앙 검증 구조와 결합하여 다층적 신뢰 보증 프레임워크를 확장적으로 설계한 점이다. 이를 통해 인공지능 생성물의 신뢰 보증을 위한 구체적이고 장기적인 적용 가능성을 탐색한다.

3-3 의도 및 동의 어설션 구조적 특성

본 연구에서 제안하는 의도 어설션과 동의 어설션은 기존 메타데이터 표준(IPTC, Exif, Schema.org 등)에서 정의된 “purpose”, “usageRights”, “creatorConsent” 등의 개념과 개념적 연속성을 갖지만, 표현 방식과 신뢰 보증 수준에서 명확히 차별화된다.

예를 들어 IPTC Photo Metadata Standard는 “Intellectual Genre”, “Usage Terms” 필드를 통해 콘텐츠의 일반적 사용 목적과 권리 조건을 기술할 수 있으나, 이는 단순한 선언적(declarative) 메타데이터 항목에 머문다. 반면 본 연구의 의도 어설션은 생성자의 목적(예: 교육, 연구, 풍자, 상업 등)을 구조화된 어설션 객체로 명시하고, 서명된 검증 가능한 자격 증명 형태로 발급되어 신뢰 가능한 진술로 확장된다.

유사하게, 동의 어설션은 Schema.org의 “usageInfo”나 “contentUsageTerms”와 유사하게 사용 조건을 설명하지만, 단순한 기술적 표현을 넘어 데이터 제공자 또는 권리자의 실제 동의 행위를 서명된 증거로 포함한다. 이를 통해 동의 어설션은 법적·윤리적 책임성을 수반하는 신뢰 가능한 검증 단위로 작동한다.

두 어설션은 상호 독립적이지만 기능적으로 긴밀하게 연계되어 있다. 의도 어설션이 생성 목적을 선언하는 선언적 계층이라면, 동의 어설션은 해당 목적이 정당하게 실행되었음을 증명하는 검증적 계층이다. 예컨대 “교육 목적”으로 발행된 콘텐츠는 학습 데이터 재사용 또는 공개 활용에 대한 동의 어설션이 함께 존재해야 완전한 신뢰 상태로 분류된다.

이와 같이, 본 연구의 의도, 동의 어설션은 기존 메타데이터 필드가 제공하지 못했던 맥락적 신뢰를 표현하는 확장 계층으로서, C2PA 매니페스트와 CAWG 어설션, 그리고 DID/VC 기반 신뢰 검증 구조를 연결하는 핵심 요소로 기능한다. 즉, 단순한 정보 기술(metadata description)을 넘어, 창작자 의도와 권리자 동의를 검증 가능한 신뢰 증거로 통합함으로써, 새로운 형태의 신뢰 보증 메커니즘을 제시한다.

3-4 기술 설계

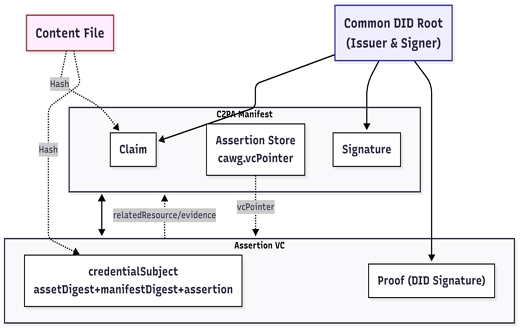

본 연구에서 제안하는 기술 설계는 CAWG 어설션을 VC로 발급하는 어설션 VC를 중심으로, C2PA 매니페스트와의 상호 참조(cross-reference) 및 DID 기반 일관성(DID-anchored consistency)을 결합한다.

본 연구에서 사회적 신뢰 및 맥락적 신뢰를 위해 정의한 신원, 의도, 동의, 승인, 학습 및 데이터 마이닝 어설션 모두 VC로 발급 가능하다. 어설션 VC는 VC 표준 구조를 확장하여 특화 타입(예: CAWGIntentCredential)을 정의하며 사회적 신뢰 요소를 credentialSubject 필드에 구조화하여 포함한다. 이 필드에는 원본 콘텐츠 파일의 해시(assetDigest)와 C2PA 매니페스트 해시(manifestDigest)를 기록하여 해당 VC가 특정 원본 콘텐츠와 매니페스트에 바인됨을 보장하며, 동시에 어설션의 구체적 내용(assertion)을 포함된다.

그러나 VC와 C2PA 매니페스트는 발급, 저장, 유통 경로가 달라 항상 함께 관리되지 않을 수 있다. 따라서 두 체계 간 연결성을 유지하기 위해 상호 참조 구조가 필요하다. 이를 위해 VC 내부에는 relatedResource 또는 evidence 필드를 정의하여 참조 대상 매니페스트의 해시와 URI를 기록하고, C2PA 어설션 저장소에는 cawg.vcPointer 어설션을 포함하여 특정 VC의 URL과 다이제스트를 명시한다. 이러한 상호 참조를 통해 VC 만 제시되거나 매니페스트만 유통되는 상황에서도 양자의 관계를 확인할 수 있으며, 교차 검증을 통해 신뢰 단절을 방지할 수 있다.

또한, 어설션 VC와 C2PA 간 신뢰 루트의 일관성을 확보하기 위해 DID 기반 서명자 일관성을 적용한다. 기본적으로, 어설션 VC의 발급자와 C2PA 매니페스트의 서명자가 동일한 경우 동일한 DID로 지정하여 동일한 주체임을 증명한다. 이를 통해 두 체계가 각각 독립적으로 서명되더라도 동일한 DID 문서 내 공개키로 검증할 수 있으며, DID 메소드가 제공하는 키 회전 및 해지 메커니즘을 적용함으로써 장기적인 검증 가능성을 확보할 수 있다. 다만 발급자와 서명자가 반드시 동일할 필요는 없으며, 예를 들어, 기자 개인이 매니페스트에 서명하고 언론사가 VC를 발급하는 경우처럼 주체가 상이하다면, 소속 증명 VC와 같은 별도의 증명서를 활용하여 DID간 신뢰 관계를 연결할 수 있다.

이와 같이 어설션 VC 발급, VC/C2PA 상호 참조, DID 기반 일관성 확보로 이어지는 설계는 기술적 신뢰와 사회적 신뢰를 통합하며, 독립적으로 관리되는 체계 간 상호운용성을 보장한다. 이를 통해 콘텐츠 신뢰 보증이 단일 기술 계층에 국한되지 않고, 다층적인 신뢰 모델에 기반하여 장기적이고 검증 가능한 구조로 확장될 수 있다. 그림 3은 C2PA와 어설션 VC 간의 기술적 연계를 보여준다.

Ⅳ. 개념적 적용 사례

4-1 적용 시나리오

본 연구는 제안한 신뢰 프레임워크의 실제 적용 가능성을 검증하기 위해 언론, 교육, 예술, 정치, 의료, 기업, 과학 연구 등 7가지 대표적 시나리오를 제시한다. 각 시나리오는 C2PA 기반의 기술적 신뢰, CAWG 어설션 기반의 사회적 신뢰, 그리고 본 연구에서 확장 제안한 의도·동의 어설션의 결합을 분석한다. 이를 통해 다양한 사회적 맥락에서 책임성과 신뢰성을 강화하는 구체적인 효과를 보여준다.

언론 기사의 진위 보장은 사회에서 중요한 과제이다. C2PA는 기사의 무결성과 출처를 디지털 서명과 해시 체인을 통해 기술적으로 보장한다. 그러나 독자는 단순한 무결성뿐 아니라 책임 주체와 편집 승인 과정을 확인하고자 한다. 이를 위해 CAWG의 신원 어설션은 기자를, 승인 어설션은 신문사의 편집 승인 사실을 기록한다. 학습 및 데이터 마이닝 어설션은 기사가 인공지능 학습에 임의로 재사용되지 않도록 허용 범위를 명시한다. 확장된 의도 어설션은 “기사의 목적이 보도”임을 구조적으로 표현하며, 동의 어설션은 기사 편집 및 배포 과정에서 기자와 편집국의 동의 여부를 명시한다. 이러한 통합은 저널리즘의 사회적 책임성을 강화한다.

교육 현장에서 인공지능 기반 이미지와 영상 생성이 보편화되고 있다. C2PA는 생성 도구, 편집 이력, 원본-변경 관계를 기술적으로 추적할 수 있도록 한다. 그러나 자료의 교육적 의도는 기술적 신뢰만으로는 충분히 표현되지 않는다. CAWG의 메타데이터 어설션은 사용된 모델과 학습 데이터의 출처를 기록한다. 여기에 의도 어설션은 해당 콘텐츠가 “교육 목적으로만 사용됨”을 명확히 하고, 동의 어설션은 자료의 상업적 재사용이나 2차 활용이 관리자의 동의 하에서만 이루어질 수 있음을 명시한다. 이 통합은 교육 콘텐츠의 출처 무결성과 활용 의도를 동시에 보장한다.

예술가가 인공지능을 활용해 작품을 제작하는 경우, 작품의 버전 이력과 원본-편집 관계를 보장한다. 그러나 작가의 권리, 저작 의도, 전시 승인 같은 사회적 맥락은 부족하다. 이를 위해 CAWG의 신원 어설션은 작가를 책임 주체로 기록하고, 승인 어설션은 미술관의 전시 승인 사실을 기록한다. 확장된 의도 어설션은 저작권 보호 및 전시 목적을 표현하며, 동의 어설션은 작품의 편집, 재가공, 재배포는 작가 동의가 있어야만 가능함을 명시한다. 이 융합은 예술 창작물의 권리와 전시 승인 과정을 투명하게 보장한다.

정당이나 정부 기관은 선거 홍보물이나 공공 캠페인 콘텐츠를 인공지능으로 제작할 수 있다. C2PA는 콘텐츠의 출처와 위변조 방지를 보장하지만, 사회적 신뢰 형성을 위해서는 정치적 책임성이 추가로 요구한다. CAWG의 신원 어설션은 정당 및 후보자의 신원을 명시하고, 의도 어설션은 “선거 홍보 목적”임을 밝힌다. 또한 승인 어설션은 선거관리기관과 같은 공적 기구의 검증을 포함한다. 이 융합은 정치적 책임성과 제도적 검증을 함께 확보한다.

병원이 환자 교육을 위해 인공지능 기반 인포그래픽을 제공하는 경우, C2PA는 자료의 생성 도구, 변조 여부, 출처를 보장한다. 그러나 환자 보호를 위해 의학적 신뢰와 오남용 방지가 필요하다. CAWG의 신원 어설션은 의료기관과 의사의 책임 주체를 명확히 하고, 메타데이터 어설션은 검증된 의료 데이터 사용을 기록한다. 의도 어설션은 해당 자료의 활용 목적이 “의료 상담 보조용”임을 명시한다. 이러한 융합은 환자 보호와 사회적 책임성을 강화한다.

기업이 인공지능을 보조적으로 활용하여 ESG 보고서를 작성하는 경우, C2PA는 보고서의 무결성과 작성 과정을 보장한다. 그러나 사회적 신뢰 확보를 위해서는 투명성 검증이 필요하다. CAWG의 신원 어설션은 기업 책임 주체를 명확히 하고, 승인 어설션은 제3자 감사기관의 검증을 기록한다. 또한 학습 및 데이터 마이닝 어설션은 민감한 ESG 데이터가 임의로 인공지능 학습에 활용되지 않도록 제한한다. 이러한 융합은 ESG 보고서의 무결성과 투명성을 보장하는 동시에 제3자 검증과 데이터 활용 동의를 통해 신뢰성을 높인다.

연구자가 인공지능을 활용해 실험 데이터를 시각화하는 경우, C2PA는 해당 이미지의 생성 과정의 무결성을 보장한다. 그러나 연구의 재현 가능성과 학문적 정당성은 기술적 신뢰만으로는 충분하지 않다. CAWG의 신원 어설션은 연구자를 책임 주체로 기록하고, 의도 어설션은 “재현 가능한 연구 데이터 기반임”을 명시한다. 승인 어설션은 학술 학회나 저널의 검증 사실을 포함하며, 메타데이터 어설션은 데이터셋과 알고리즘, 소프트웨어 환경을 기록한다. 이러한 융합은 연구 데이터의 무결성과 재현성을 보장하면서 학문적 정당성과 사회적 신뢰를 동시에 확보한다.

4-2 실험적 적용

본 절에서는 언론 기사 작성 과정에서 인공지능을 활용한 시나리오를 대상으로 단계별로 기술적 책임과 사회적 책임을 위한 C2PA 데이터 표준 라벨과 CAWG 확장 라벨을 함께 사용하여 생성/기록/서명/검증 과정을 상세하게 기술한다. 실험적 적용을 위해 본 연구에서는 언론 기사 작성 과정을 기자의 초안 작성 단계, 인공지능 보조 편집 단계, 편집부 승인과 기관 책임 부여 단계, 최종 발행과 재사용 정책의 설정 단계의 4단계로 구분한다.

초안 작성 단계에서 기자는 원고 초안을 생성하고 이를 C2PA의 어설션 저장소에 기록한다. c2pa.ingredients에 초안 텍스트 파일의 식별자, 포맷, 원본 텍스트의 해시를 포함하여 “무엇을 재료로 삼아 콘텐츠가 만들어졌는지”를 증거화한다. 동시에 c2pa.actions에는 “c2pa.created” 이벤트가 남겨져 생성 시간, 사용 툴(예: 편집기 버전), 디지털 소스 유형이 정규화된 값으로 기입된다. 의미적 메타데이터는 stds.schema-org/CreativeWork에 수록되며, 작성자 식별자는 기자의 DID로 표현되고 작성일과 제목이 함께 기록된다. 초안부터 사회적 책임 주체와 창작 의도를 명확히 하기 위해 CAWG의 신원 어설션(cawg:Identity)과 의도 어설션(cawg:Intent)이 추가된다. 신원 어설션은 기자의 DID, 이름, 소속, 역할(예: author)을 통해 책임 주체를 제도적으로 고정하고, 의도 어설션은 “보도 초안이며 외부 재사용을 제한한다”와 같은 목적 및 활용 범위를 명시해 독자에게 규범적 맥락을 제공한다. 클레임은 어설션을 참조하고 각 어설션의 해시를 고정하여 초안 시점에 확정된 진술 집합을 구조적으로 선언한다. 이어 COSE_Sign1 형식의 서명이 기자의 DID에 해당되는 개인키로 생성되어 클레임 전체를 서명하여, 초안 단계의 무결성과 출처, 책임 주체, 의도가 한 번에 확정된다. 검증자는 이 단계에서 초안 텍스트의 해시 일치 여부, 생성 행위의 존재와 시각, DID 기반 기자 신원의 해석 가능성, 그리고 의도 진술의 존재를 확인할 수 있다.

인공지능 보조 도구가 일부 문장을 보완하면, 수정된 텍스트에 대응하는 해시가 새롭게 산출되고, c2pa.actions에는 “c2pa.modified”이벤트가 추가되어 수정 시점, 개입 도구명, 적용 범위 혹은 파라미터가 기록된다. 이로써 “언제, 어떤 도구가, 어디를 수정했는가”가 행위 이력으로 투명하게 기록된다. 동시에 CreativeWork의 “dateModified”가 반영되어 의미적 메타데이터에도 최신 상태가 표현된다. 인공지능 개입의 재현 가능성과 책임성을 강화하기 위해 CAWG의 메타데이터 어설션(cawg:Metadata)이 새롭게 추가되는데, 여기에는 사용된 모델명, 학습 데이터셋 식별자, 실행 환경(OS, 프레임워크 등)이 정규화된 필드로 기술된다. 클레임은 v2 시점에 유효한 모든 어설션을 다시 참조하여, 특히 priorManifestHash를 통해 매니페스트 v1 내용 전체 해시를 바인딩하여 버전 간 연속성을 고정한다. 기자는 다시 COSE_Sign1 서명으로 매니페스트 v2 클레임을 확정하고 검증자는 v1 대비 변동 사항을 해시 비교로 추적할 수 있으며, 인공지능 개입의 사실, 시점, 도구 범위와 함께 모델, 데이터셋 환경이라는 재현성 메타데이터를 교차 확인할 수 있다. 이 단계에서 기술적 신뢰는 행위 이력과 해시 체인을 통해, 사회적 신뢰는 인공지능 사용의 투명 공개와 책임성(의도 유지 + 환경 공개)을 통해 동시에 강화된다.

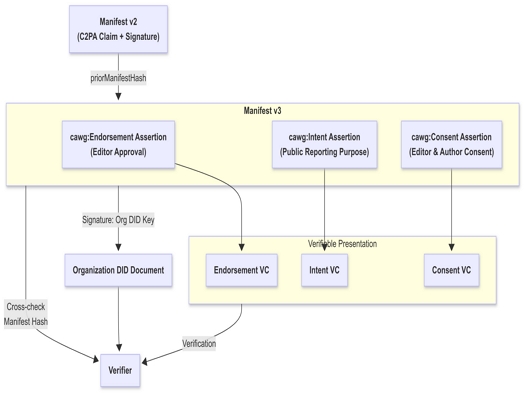

편집부 검토가 완료되면, 편집 승인 사실이 CAWG의 승인 어설션(cawg:Endorsement)으로 어설션 저장소에 추가된다. 이 진술에는 승인 주체인 신문사의 DID, 승인 유형과 시각, 담당 부서나 직함 같은 맥락 정보가 포함되어, “기관적 승인”을 제도적으로 표현한다. 더 나아가 의도 어설션(cawg:Intent)은 기사의 목적이 “공적 보도”임을 구조적으로 기록하며, 동의 어설션(cawg:Consent)은 기자와 편집부가 기사 배포 및 2차 활용에 동의했음을 명시한다. 이로써 v3 단계에서는 단순한 승인뿐 아니라 창작 의도와 동의 여부까지 제도적으로 고정된다.

또한 이 승인, 의도, 동의 어설션은 그림 4와 같이 어설션 VC로 발급되어 DID/VC 체계와 연계된다. 구체적으로 신문사는 편집부 승인 VC(Endorsement VC)와 배포 동의 VC(Consent VC)를 발급하고, 기자는 자신의 신원 VC를 보유한다. 검증자는 이들 VC를 VP로 제시받아, DID 기반 서명 검증을 수행하고, 동시에 C2PA 매니페스트 내 어설션과 교차 대조한다. 클레임은 매니페스트 v2와 동일한 방식으로 모든 유효 어설션의 해시를 고정하며, priorManifestHash는 매니페스트 v2 전체의 해시를 참조하여 체인을 지속한다.

매니페스트 v3의 서명은 기관 DID의 개인키로 서명하는 것이 바람직하며, 이를 통해 “이 기사는 편집부의 검증과 동의를 거쳐 공적 보도 목적으로 승인되었다.”는 사실이 기술적으로 확인된다. 검증자는 기관 DID 문서의 공개키로 COSE 서명을 검증하고, VP 내 포함된 VC와 매니페스트 해시를 교차 검증함으로써 기자 개인(DID)에서 신문사(기관 DID)로 책임 주체가 확장 승계되었음을 확인한다. 결과적으로, 무결성과 출처(기술적 신뢰)에 더해 의도, 동의, 승인이라는 사회적 신뢰 요소가 VC 발급을 통해 제도적으로 결속되며, 독자의 신뢰 판단을 질적으로 고도화한다.

최종 발행 시점에는 배포본이 확정되고, c2pa.actions에 발행 이벤트가 추가되어 발행 시각과 채널이 기록된다. 특히 사회적 책임을 정책으로 연결하기 위해 CAWG의 학습 및 데이터 마이닝 어설션(cawg:TrainingAndDataMining)이 포함되며, 이 진술은 “인공지능 학습 데이터로의 재사용 금지/허용 범위, 사유, 적용 조건”을 구조화된 필드로 명시한다. 이렇게 선언된 정책은 이후 플랫폼 단계의 집행 로직과 결합되어 자동으로 재학습을 차단하거나 접근 제한하는 근거로 활용될 수 있다. 매니페스트 v4의 클레임은 매니페스트 v3의 전체 해시를 priorManifestHash로 바인딩하여 체인을 닫고, 기관 DID의 개인키로 재서명함으로써 발행 책임과 정책 진술을 최종 확정한다. 검증자는 v1에서 v4까지 역추적 가능한 해시 체인과 각 단계의 서명 주체(기자에서 기관으로), 인공지능 개입의 투명성, 승인의 존재와 정책 진술의 정합성을 한 번에 확인할 수 있다. 그 결과 최종 산출물은 단순한 텍스트가 아니라, 생성, 수정, 승인, 발행, 정책에 이르는 전 과정을 암호학적으로 결속한 “전주기 신뢰 패키지”가 된다.

각 단계의 클레임이 서명으로 보호되면 그 안에는 해당 시점에 유효한 어설션 집합과 각 어설션의 해시가 고정되어 있다. COSE 서명 검증을 통해 무결성과 발행자 신원을 확정한 뒤, priorManifestHash를 따라 v4->v3->v2->v1로 체인을 역추적하여 어떤 변경도 중간에 삽입, 삭제되지 않았음을 확인한다. 이때 편집부 승인이나 정책같은 사회적 진술은, 필요에 따라 Verifiable Credentials (VC)으로도 병행 발급될 수 있다. 예컨대 신문사는 “편집부 승인 VC”를 발급하고, 기자는 자신의 신원 VC를 보유하며, 인공지능 플랫폼은 모델 환경에 관한 VC를 제공한다. 독자나 플랫폼 검증자는 이들 VC를 Verifiable Presentation (VP)으로 묶어 제시받고, VP에 포함된 매니페스트 해시 바인딩과 C2PA의 클레임 및 서명을 교차 대조함으로써, 암호학적 무결성과 제도적 승인, 책임, 정책을 동시 검증한다. 이 교차 결합은 신뢰의 단일 지점 실패를 줄이고, 동일 사실을 다중 신뢰 경로로 확인함으로써 검증의 견고성을 높인다.

Ⅴ. 결 론

본 연구는 인공지능이 생성하는 디지털 콘텐츠의 신뢰 문제를 해결하기 위해, C2PA의 기술적 신뢰 모델과 DIF CAWG 어설션 체계를 융합한 탈중앙 계층적 신뢰 프레임워크를 제안하였다. C2PA가 제공하는 무결성과 출처 중심의 기술적 신뢰를 기반으로, 본 연구는 CAWG에서 정의한 신원, 메타데이터, 학습 및 데이터 마이닝, 승인 어설션에 의도 및 동의 어설션을 추가로 구조화하여 사회적 신뢰를 강화하였다. 또한 DID/VC 기반 검증 구조를 통해 기술적·사회적·제도적·평판적 신뢰를 포괄하는 4계층 신뢰 모델을 설계하였다.

학문적 시사점으로 본 연구는 기술적 신뢰와 사회적 신뢰를 통합한 다층 신뢰 모델을 제시하여 기존 단일 신뢰 접근을 확장하였다. 둘째, 의도와 동의 어설션을 형식화하고, 이를 기존 메타데이터 표준과 비교하여 사회적 신뢰 표현의 구조적 근거를 마련하였다. 셋째, DID/VC와 선택적 공개·영지식증명 기술을 연계하여 “검증 가능한 신뢰 증거(Verifiable Trust Evidence)” 개념을 제시하였다.

실무적 시사점으로, 제안 모델은 언론·교육·예술·의료 등 다양한 생성형 콘텐츠 서비스에서 생성자의 책임성과 투명성을 보장하는 기술적 구조로서 활용될 수 있다. 또한 C2PA 매니페스트와 VC의 결합을 통해 위변조 방지, 출처 검증, 권리 관리, 사회적 책임 보증을 통합적으로 수행할 수 있어, 향후 국제 표준화 기반 신뢰 프레임워크로 발전할 가능성이 크다.

향후 연구 방향으로는 (1) 제안 모델의 프로토타입 구현 및 실증 성능 검증, (2) 이용자 피드백과 참조 데이터를 활용한 평판적 신뢰 계층의 정량 모델링, (3) 선택적 공개·영지식증명 기반의 프라이버시 보존형 검증 프로토타입의 개발, (4) C2PA와 DID/VC의 상호운용성 및 표준화 검증을 추진할 계획이다. 이를 통해 제안 프레임워크는 기술적·사회적 신뢰를 아우르는 통합형 신뢰 인프라로 발전할 수 있을 것이다.

결론적으로, 본 연구는 인공지능 생성물 신뢰 보증을 위한 초기 프레임워크로서 개념적·구조적 기여를 제공하며, 이는 완결된 해결책이라기보다 기술적·사회적·제도적 영역을 포괄하는 새로운 신뢰 패러다임을 구체화하기 위한 출발점으로 의의가 있다.

References

- National Security Agency (NSA) AI Security Center, Cybersecurity and Infrastructure Security Agency (CISA), and Federal Bureau of Investigation (FBI). CSI: AI Data Security: Best Practices for Securing Data Used to Train & Operate AI Systems [Internet]. Available: https://media.defense.gov/2025/May/22/2003720601/-1/-1/0/CSI_AI_DATA_SECURITY.PDF, .

-

M. Huschens, M. Briesch, D. Sobania, and F. Rothlauf, “Do You Trust ChatGPT? – Perceived Credibility of Human and AI-Generated Content,” arXiv:2309.02524, , September 2023.

[https://doi.org/10.48550/arXiv.2309.02524]

- Coalition for Content Provenance and Authenticity (C2PA). C2PA Technical Specification, Version 2.2 [Internet]. Available: https://c2pa.org/specifications/specifications/2.2/, .

- L. Richardson. How We’re Increasing Transparency for Gen AI Content with the C2PA [Internet]. Available: https://blog.google/technology/ai/google-gen-ai-content-transparency-c2pa/, .

- A. R. Locker, C. Heitzenrater, and T. C. Helmus. Overpromising on Digital Provenance and Security [Internet]. Available: https://www.rand.org/pubs/commentary/2025/06/overpromising-on-digital-provenance-and-security.html, .

- Decentralized Identity Foundation. Decentralized Identity Foundation (DIF) [Internet]. Available: https://identity.foundation, .

- Decentralized Identity Foundation. Creator Assertions Working Group [Internet]. Available: https://cawg.io, .

- Decentralized Identity Foundation. Creator Assertions Working Group Technical Specifications [Internet]. Available: https://cawg.io/specs/, .

- M. Sporny and D. Zagidulin. Decentralized Identifiers (DIDs) v1.1, W3C Working Draft [Internet]. Available: https://www.w3.org/TR/did-1.1/, .

- M. Sporny, T. Thibodeau Jr., I. Herman, G. Cohen, and M. B. Jones. Verifiable Credentials Data Model v2.0 W3C Recommendation [Internet]. Available: https://w3.org/TR/vc-data-model-2.0/, .

-

Z. Jiang, M. Guo, Y. Hu, and N. Z. Gong, “Watermark-Based Attribution of AI-Generated Content,” arXiv:2404.04254, , November 2024.

[https://doi.org/10.48550/arXiv.2404.04254]

-

J. Fairoze, G. Ortiz-Jimenez, M. Vecerik, S. Jha, and S. Gowal, “On the Difficulty of Constructing a Robust and Publicly-Detectable Watermark,” arXiv:2502.04901, , 2025.

[https://doi.org/10.48550/arXiv.2502.04901]

-

J. C. Simmons and J. M. Winograd, “Interoperable Provenance Authentication of Broadcast Media Using Open Standards – Based Metadata, Watermarking and Cryptography,” arXiv:2405.12336, , 2024.

[https://doi.org/10.48550/arXiv.2405.12336]

- U.S. Cybersecurity and Infrastructure Agency (CISA), Content Credentials: Strengthening Multimedia Integrity in the Generative AI Era, January 2025.

-

K. Balan, S. Agarwal, S. Jenni, A. Parsons, A. Gilbert, and J. Collomosse, “EKILA: Synthetic Media Provenance and Attribution for Generative Art,” arXiv:2304.04639, , April 2023.

[https://doi.org/10.48550/arXiv.2304.04639]

-

M. Farhan, U. Butt, R. B. Sulaiman, and M. Alraja, “Self-Sovereign Identities and Content Provenance: VeriTrust-A Blockchain-Based Framework for Fake News Detection,” Future Internet, Vol. 17, No. 10, 448, 2025.

[https://doi.org/10.3390/fi17100448]

-

C.-C. Chang and I. Echizen, “The Chronicles of Foundation AI for Forensics of Multi-Agent Provenance,” arXiv:2504.12612, , April 2025.

[https://doi.org/10.48550/arXiv.2504.12612]

저자소개

1986년:서강대학교 전자공학과(학사)

1988년:서강대학교 전자공학과(석사)

2005년:포항공과대학교 컴퓨터공학과 (박사)

1993년~2007년: KT BcN 본부 수석연구원

2007년~현 재: 동의대학교 게임공학과 교수

2019년~현 재: 동의대학교 블록체인기술연구소장

2025년~현 재: 디지털신원기술표준포럼 의장

※관심분야:탈중앙형 블록체인, 자기주권 신원, 자기주권 데이터, 인공지능, 설명가능 인공지능, 탈중앙 메타버스