의료 메타버스를 위한 실시간 상호작용이 가능한 볼륨 렌더링 시뮬레이션 시스템 연구

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

정밀 의료의 필요성이 높아지면서, 환자의 의료 영상을 실시간으로 상호작용하고 시뮬레이션 할 수 있는 고해상도 3차원 시각화 기술의 필요성이 커지고 있다. 본 연구는 Unreal Engine 기반의 시뮬레이션 시스템을 제안한다. 시스템은 환자의 CT(Computed Tomography) 의료 영상을 입자의 집합 형태로 렌더링한다. 시스템은 입자 속성을 파라미터로 정의하여 약물 확산 등의 다양한 시뮬레이션을 할 수 있다. 유닛 분할과 병렬 연산을 통해 110 FPS(Frame Per Second)를 달성하였다. 결과적으로 제안 시스템은 단면 시각화, 상호작용, 시뮬레이션의 실시간성을 안정적으로 지원한다. 이는 실제 임상시험 전 계획 수립, 의사결정시간 단축을 위한 보조도구의 기술 기반이 될 것을 기대한다.

Abstract

As the demand for precision medical care continues to grow, there is a parallel increase in the need for high-resolution three-dimensional visualization technology capable of simulating patient medical images and interacting with them in real time. This study proposes a simulation system based on Unreal Engine. The system renders the patient's computed tomography (CT) image in the form of a set of particles. Subsequently, various simulations, such as drug diffusion, are performed by defining particle properties as parameters. A speed of 110 frames per second (FPS) was achieved through unit division and parallel operations. The proposed system provides stable support for real-time cross-sectional visualization, interaction, and simulation. This technology is expected to serve as the basis for auxiliary tools. shortening decision-making duration by allowing planning before actual clinical trials.

Keywords:

Medical Metaverse, Real-Time Interaction, Simulation System, Unreal Engine, Volume Rendering키워드:

의료 메타버스, 실시간 상호작용, 시뮬레이션 시스템, 언리얼 엔진, 볼륨 렌더링Ⅰ. 서 론

정밀 의료와 개인 맞춤형 치료가 강조되면서[1], 환자 고유의 CT 영상을 실시간으로 탐색하고 시뮬레이션할 수 있는 고해상도 3차원 시각화 기술에 대한 요구가 증가하고 있다[2]. 최근에는 메타버스 기술이 의료 연구·교육 현장에 도입되면서, 가상 공간에서 환자 데이터를 시각화하고 다중 사용자가 동시에 상호작용을 할 수 있는 플랫폼의 필요성이 더욱 드러난다[3]. 이러한 환경에서 의료진은 해부학적 구조를 직관적으로 이해할 뿐만 아니라, 가상의 임상 시나리오를 실시간으로 변경·관찰하며 치료 전략을 검증할 수 있어야 한다[4].

그러나 현재 널리 사용되는 3D 볼륨 렌더링 기법인 Surface Rendering, Ray Marching, Point Based Volume Rendering은 대부분 정적 시각화에 집중되어 있다[5]. 먼저 Surface Rendering은 정확한 세분화가 선행되어야 하며, 내부 구조를 확인하기 어렵다. Ray Marching, Point Based Volume Rendering은 볼륨 전체를 직접 투영하기 때문에 깊이가 겹치는 조직이 서로를 가려 중요한 세부를 식별하기 어렵고[6], 대용량 데이터에서는 프레임이 저하된다. 특히 기존 방식들은 시각화를 중심으로 연구되어 동적 시뮬레이션과 결합하기에 구조적으로 제약이 많아, 약물 반응이나 병변 변화 같은 시뮬레이션은 실시간으로 표현에 어려움이 있다. 이에 고화질 실시간 볼륨 시각화 측면의 한계가 지적되어 오고 있다[7]. 더욱이 실시간 고화질 시뮬레이션 가능 의료 볼륨 시각화를 지원하는 볼륨 렌더링 기법은 연구가 미흡한 실정이다. 실제 임상시험 단계에서 활용하려면 사용자는 수백만 개 복셀을 프레임 손실 없이 관찰할 수 있음과 동시에 시뮬레이션을 위해 높은 자유도의 설정이 가능한 볼륨 렌더링 방법이 요구된다[8].

본 논문은 이러한 연구 공백을 해소하고자, 시뮬레이션 입자 시스템을 기반으로 한 실시간 상호 작용형 3D 볼륨 시각화 프레임워크를 제안한다. 제안 시스템은 CT영상의 DICOM(Digital Imaging and Communications in Medicine) 파일로부터 복셀 좌표 및 Intensity를 추출하여 입자로 변환한 뒤, 시뮬레이션 시스템을 활용하여 GPU(Graphics Processing Unit) 병렬연산을 통한 최적화와 속성 등을 관리한다. 이를 통해 Transfer Function, Threshold 등을 실시간 조정할 수 있으며, 입자 속성을 파라미터 형태로 정의해 약물 확산 등의 임상 시뮬레이션을 적용할 수 있다. 이는 향후 임상시험 시뮬레이션을 위한 플랫폼으로의 확장 가능성을 보여준다. 본 논문은 5개의 장으로 구성된다. 이는 서론, 기존 3D 렌더링 방법, Unit 기반 볼륨 렌더링 시뮬레이션 시스템, 실험 및 결과, 결론 및 향후 연구 순으로 진행된다.

Ⅱ. 기존 3D 렌더링 방법

2-1 의료용 3D 시각화 기술

CT의 영상은 수백 장까지의 2D 슬라이스를 생성하며, 임상의는 축(axial), 관(coronal), 시상(sagittal) 면에서 이 연속 영상을 차례로 판독한다. 이러한 방식은 높은 공간 해상도와 표준화된 의료영상 저장 전송장치 흐름 덕분에 여전히 임상 표준으로 사용된다. 그러나 복잡한 해부학적 관계를 직관적으로 이해하려면 사용자가 정신적으로 3차원 재구성을 수행해야 한다는 제한이 존재한다[9]. 이러한 한계를 극복하고자 Gabor T. Herman과 H. K. Liu는 CT 영상을 기반으로 한 3차원 렌더링 기법을 최초로 제안했고[10], 지금까지도 많은 연구들이 이어지고 있다.

Surface Rendering은 일정 강도를 기준으로 등면을 추출하고 이를 삼각형 메시로 변환하여 렌더링하는 기법이다[11]. Surface Rendering의 대표적인 방법은 Marching Cubes 알고리즘이다[12]. 이 알고리즘은 3차원 스칼라 필드를 격자로 나누고, 각 격자의 8개 꼭짓점에서의 스칼라값이 Threshold 값보다 큰지 작은지를 판단하여 256가지의 가능한 조합을 생성한다. 각 조합에 대해 미리 정의된 삼각형 패턴을 사용하여 등 면을 추출한다. 이 방법은 다면체를 활용하여 높은 프레임을 유지할 수 있지만, 정확한 세분화가 선행되어야 한다.

Ray marching 볼륨 렌더링은 복셀 필드를 세분화 없이 직접 시각화한다. 각 화면 픽셀에 대해 광선을 투사하고, 일정 간격으로 전진시키며 복셀 값을 샘플링한다. 샘플마다 전이 함수를 이용하여 색상과 불투명도를 계산하고 누적하여 최종 색상과 불투명도를 가진다. GPU에서는 3D 텍스처 룩업과 누적 연산을 셰이더에서 병렬 수행과 빈 공간 생략, 조기 광선 종료와 같은 기술을 사용하여 최적화할 수 있다[13]. Ray marching 볼륨 렌더링은 내부 장기를 세밀하게 표현할 수 있지만, 샘플 수 증가 시 연산량과 메모리 대역폭 요구가 크게 증가하는 한계를 가진다[14].

Point based Rendering은 복셀을 점으로 변환하여 렌더링하는 방법이다. 각 점은 (x, y, z) 형태의 좌표와 Intensity 등의 속성을 지니며 GPU를 통한 병렬 처리를 통해 최적화할 수 있다[15]. 이를 통해 수백만 개의 점을 병렬로 렌더링할 수 있다. 점의 개수에 따른 해상도를 상황에 따라 조절할 수 있으므로 성능-해상도 교환을 가진다. 다만, 점으로 이루어져 독립적으로 처리하기 좋으나, 주변 환경이나 전체 구조와의 관계를 잘 반영하지 못해, 최근에는 이러한 단점을 보완하기 위한 3D 세분화 기법들이 연구되고 있다[16],[17].

2-2 의료 영상 데이터 표준

의료영상에는 DICOM 표준이 사용된다. 이는 국제적으로 지정된 의료영상을 기록, 교환하기 위한 표준 양식이다. CT, MRI(Magnetic Resonance Imaging)와 같이 다양한 의료영상에서 사용된다[18]. DICOM 파일은 헤더와 픽셀 데이터의 두 부분으로 구성되며, 헤더에는 환자의 정보, 촬영 기기 설정과 같은 메타데이터가 포함된다. CT 영상은 수백 장의 슬라이스를 개별 DICOM 객체로 저장한다[19]. 촬영으로 나타나는 강도인 Intensity로 기록된다. 메타데이터를 이용하면 원본 영상을 영상 값을 물리적 HU(Hounsfield Unit) 단위로 복원할 수 있다[20].

Ⅲ. Unit 기반 볼륨 렌더링 시뮬레이션 시스템

3-1 프로세스 전체 흐름도

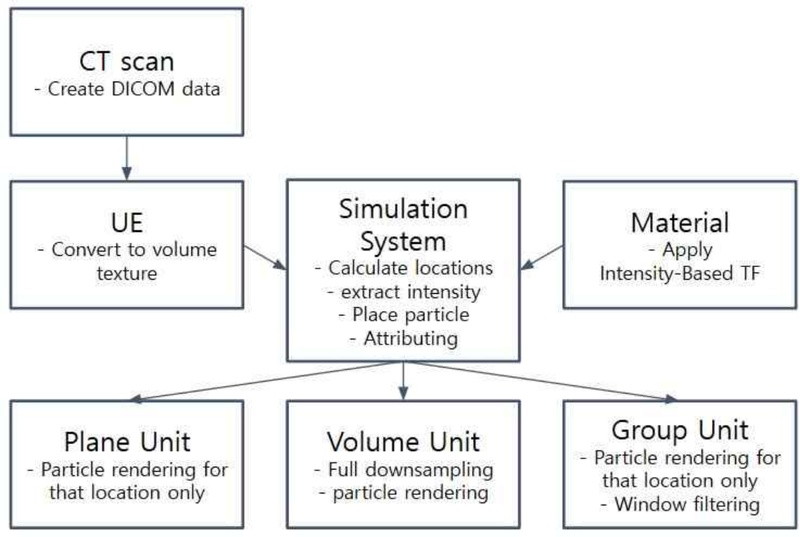

그림 1은 제안한 파이프라인이 CT 촬영부터 입자 기반 시각화까지 어떤 단계를 거쳐 구현되는지를 한눈에 보여준다. 흐름의 시작점은 흉부 CT 스캐너에서 생성된 DICOM 영상이다. 이 다중 슬라이스 영상은 Unreal Engine에서 Volume Texture 에셋으로 변환된다. Volume Texture 에셋은 시뮬레이션 시스템으로 전달되어 복셀 좌표계와 강도 값을 계산하는 연산 그래프에 연결하는 역할을 한다. 계산된 강도는 동시에 입자의 형태와 색상을 결정하는 머티리얼로 전달되어 강도 값을 1차원 Transfer Function이라는 값-색상을 매칭시키는 함수를 통해 각 입자의 색상과 불투명도를 결정한다.

시뮬레이션 시스템은 여러 Unit들을 묶어 하나 이상의 시뮬레이션을 정의하고, Unit은 Spawn, Update, Render 단계로 나뉘어 동작한다. 시뮬레이션 시스템은 입력된 위치, 색, 속성 정보를 이용해 입자를 생성하고 속성을 부여한 뒤, 목적별로 분리된 세 개의 GPU Unit에 분배한다. Volume Unit은 다운샘플링을 통해 저해상도로 렌더링하여 전역 윤곽을 제시하고, Plane Unit은 사용자가 지정한 평면 위에 고해상 단면을 표시한다. Group Unit은 국소 관심 영역만 입체적으로 시각화하며 약물 전달, 독성 반응과 같은 시뮬레이션을 중심적으로 관찰할 수 있다.

3-2 데이터 전처리

본 논문의 예시 입력 CT 영상은 CMB-LCA(Cancer Moonshot Biobank-Lung Cancer)의 512 × 512 × 114 해상도의 흉부 CT 영상을 선정하였다. 각 슬라이스는 16-bit 정수 DICOM 이미지로 저장되어 있으며, 픽셀 강도인 Intensity는 정규화된 HU으로 활용하였다.

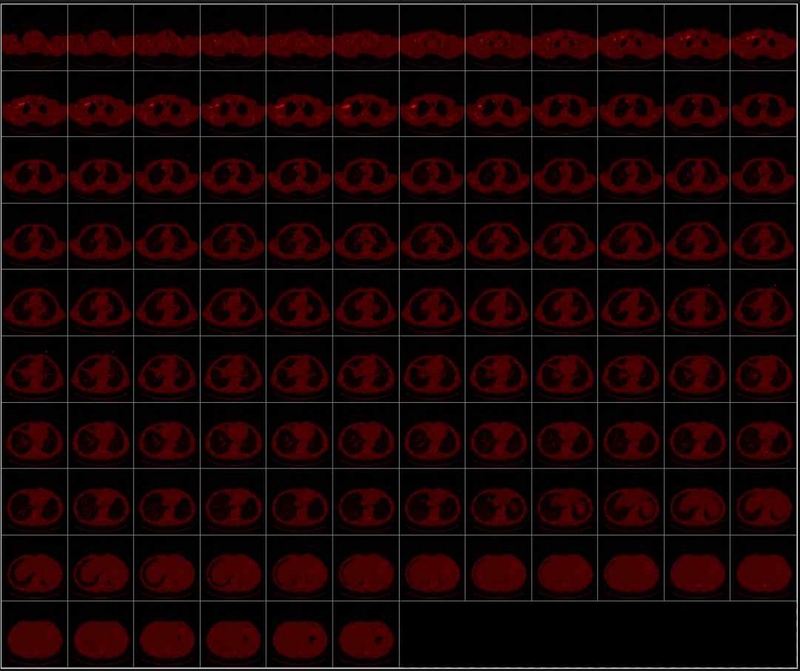

전처리는 슬라이스 정렬 단계에서 z 좌표를 기준으로 모든 DICOM 파일을 오름차순 정렬하여 원본 촬영 순서를 복원한다. 각 복셀값에 선형 변환식을 적용하여 HU 범위인 –1,024부터 3,071까지로 복원한 뒤 0과 1 사이의 숫자로 정규화하여 강도 값으로 사용하였다. 예시로 사용된 DICOM 이미지의 정규화된 3차원 배열은 총 29,884,416 복셀이다. DICOM 의료 영상은 Unreal Editor에서 Volume Texture 에셋으로 임포트하였다. 이는 그림 2와 같이 2차원 사진의 합으로 구성된다.

3-3 시뮬레이션 시스템 Unit

시뮬레이션 시스템에서 Unit이 입자를 생성할 때, 각 입자에 대한 번호, Execution Index(0 ≤ Exec < 𝑁𝑥, 𝑁𝑦, 𝑁𝑧)를 부여한다. 이를 3차원 좌표(i, j, k)로 변환하고, 월드 좌표로 변환한다. 각 입자의 인덱스 변환은 수식 (1)과 같다.

| (1) |

여기서 𝑁𝑥, 𝑁𝑦, 𝑁𝑧는 해당 Unit의 x축, y축, z축의 입자 개수를 의미하며 이는 해상도를 결정한다. 모든 Unit은 GPU를 이용한 병렬연산으로 최적화되었다.

Volume Unit은 원본 CT 영상의 전 영역을 낮은 밀도로 표시해 전체 해부학 윤곽을 지속적으로 제공하는 Unit이다. 입력된 512 × 512 × 114 볼륨 텍스처를 120³의 크기로 삼차원 평균 다운 샘플링한다. 예시에서는 1,641,600개의 입자를 생성하며, 이는 시스템의 한 Unit이 안정적으로 관리할 수 있는 입자 한계와 성능 최적화를 고려해 선정한 해상도이다.

Spawn 단계에서 시스템의 Execution Index를 수식(1)로 3차원 격자 좌표 (i, j, k)로 환산했다. 얻어진 (i, j, k)는 볼륨 중심 좌표 c와 복셀 해상도 Δ𝑥, Δ𝑦, Δ𝑧를 이용해 수식(2)를 통해 각 입자의 월드 좌표 p를 결정하게 된다.

| (2) |

각 입자는 Volume Texture에서 직접 조회한 HU 정규화 값을 보유한다. Update 단계에서 이 값이 1차원 전이 함수를 통해 색상과 불투명도가 계산된다. 사용자가 지정하는 Threshold 매개변수는 동일 단계에서 적용되며, 임곗값 미만의 입자에 대해 불투명도를 0으로 설정해 공기나 시각화가 필요하지 않은 부분을 표시하지 않게 한다.

전역 부분의 단면을 결정하는 파라미터인 PlaneCenter(a, b, c), PlaneNormal(d, e, f)는 평면의 중심점과 기울기를 결정하고, 중심점으로부터의 거리와 평면으로부터의 거리를 계산하여, 단면보다 거리가 먼 위치의 입자 불투명도를 0으로 하는 것으로 입자의 정보를 잃지 않으면서 단면을 관찰할 수 있게 된다.

Volume Unit은 시뮬레이션 시작 시 전체 해부학 맥락을 제시하고, 고해상도인 Plane Unit, Group Unit과 함께 결합하여 배경 단서를 제공한다. 전역 입자의 정보를 보관하고 연산하는 역할을 하며, 상호작용 일관성을 보장한다.

Plane Unit은 원본 CT 영상의 한 슬라이스를 원본 해상도까지 렌더링할 수 있으며, 선택 단면을 고화질로 시각화할 수 있도록 설계된 시각화 모듈이다. 크기는 512×512×1로 제한되며, 각 입자가 복셀 한 점을 1 : 1로 대응해 고화질 시각화를 가능하게 한다.

사용자는 Volume Unit과 동일한 두 개의 3차원 벡터인 PlaneCenter와 PlaneNormal라는 파라미터를 통해 평면의 중심 위치와 기울기를 정의한다. Spawn 단계에서 이 법선 벡터와 내부 직교벡터(u, v)를 계산해 512 × 512 격자를 평면 위에 배치한다. 결과적으로 입자 위치는 Volume Unit과 동일한 좌표계에서 계산된다. 평면이 회전, 이동하더라도 CT 볼륨과 정확히 일치한다.

각 입자는 월드 위치를 정규화시켜 Volume Texture의 좌표(i, j, k)로 변환한 뒤, 정규화 HU 값을 읽어 강도 속성에 저장한다. 업데이트 단계에서 이 강도 값은 전이 함수 텍스처를 통해 색상, 불투명도로 변환된다. 평면 전용 Threshold 매개변수는 별도로 노출돼, 사용자가 단면 내부의 특정 조직 범위만 강조하도록 강도를 필터링할 수 있다.

상호작용 흐름 PlaneCenter, PlaneNormal, Threshold는 모두 시뮬레이션 시스템 파라미터로 지정되어, 사전 설정 되거나 사용자 입력과 실시간 연동된다. 파라미터 변경 시 Spawn 단계를 다시 실행하지 않고도 시뮬레이션 단계에서 입자 위치, 색상을 재계산하므로, 평면 회전, 이동, 창 조정이 한 프레임 내에 반영된다.

Plane Unit은 고해상 단면을 통해 세부 해부학을 검토하거나, 필터링 시뮬레이션 결과를 평면 형태로 정밀 관찰할 때 활용된다. Volume Unit이 제공하는 전역 윤곽과 함께 사용되어 특정 단면을 고화질로 관찰할 수 있다.

Group Unit은 관심 영역(ROI, Region of Interest)을 입체로 고해상도로 시각화한다. ROI는 월드 공간 경계 상자로 정의된다. 120 × 120 × 120의 정육면체 입자 집합으로 구성되며, Volume Unit이 자세히 보여주지 못하는 영역을 복셀과 1:1 비율로 매칭하여 해당 영역 내의 모든 복셀을 렌더링한다.

Group Unit은 Spawn 단계에서 Execution Index를 (i, j, k)형태의 상대 좌표로 변환하고, 이를 월드 좌표에 매핑한다. ROI 크기와 위치가 변경되면 파라미터만 갱신해 동일 수식으로 즉시 재배치되므로, 다중 영역을 순환적으로 탐색할 때도 추가 생성 비용이 발생하지 않는다.

Group Unit에는 전역 Threshold 대신 HU 윈도우 파라미터가 존재한다. Update 단계에서 입자 강도가 윈도우 범위 밖이면 Visible Tag 속성을 0으로 설정해 렌더링을 차단한다. 범위 안의 입자만 전이 함수를 거쳐 색상을 설정한다. group Unit은 특정 장기, 종양 등 특정 부위를 고화질로 렌더링하기 위해 사용하기 위해 다음과 같이 윈도우를 설정한다. 윈도우는 윈도우의 상한 WH과 하한 WL을 통해 정의되며 윈도우의 중심은 WC로 정의된다. 이 때 WC = (WH + WL) / 2이다. 윈도의 폭 WW는 WW = WH - WL로 계산된다. 업데이트 단계에서 각 입자의 위치 좌표 P = (x, y, z)와 수식 (3)을 통해 렌더링 여부를 결정한다.

| (3) |

각 입자는 입자의 V의 값이 1일 때 렌더링 되고, 0일 때 렌더링 되지 않는다. 이를 통해 V가 필터링 역할을 수행한다.

Group Unit은 약물 전달, 약물 반응 등의 반응을 집중적으로 표현하기 위해 Toxicity, Size Factor 같은 사용자 정의 속성을 추가 보유한다. 시뮬레이션 단계에서 사용자 설정에 따른 입자 중심과 자극원 사이 거리, 시간 등을 이용해 속성이 갱신되며, 결과는 입자의 색상, 크기 변화 등으로 나타낼 수 있다. 이를 통해 ROI 내부에서만 동적 변화가 발생하도록 시뮬레이션 범위를 지정할 수 있다.

ROI와 HU 윈도우, 독성원 좌표, 강도 등은 모두 시뮬레이션 시스템 파라미터로 설정되어 연동할 수 있다. Volume Unit, Plane Unit이 제공하는 전역 배경과 세부 단면을 유지한 채, Group Unit이 선택 부위를 강조함으로써 다중 속성에 따른 시뮬레이션을 실시간으로 관찰, 실험할 수 있다.

3-4 입자 속성

본 시스템에서 속성은 CT 영상을 3D로 렌더링하기 위해 각 입자의 위치와 색상을 결정하는 역할과, 임상시험의 약물 반응과 같은 시뮬레이션을 위한 각 입자의 특징과 상황을 결정하는 역할을 한다. 시스템에서 하나의 입자는 위치 P, 정규화 강도 I, 가시성 태그 V, 약물 지수 T, 색상 C =(r, g, b), 스케일 s를 기본 속성으로 갖는다. P는 중심점으로부터 x축, y축, z축까지의 3차원 거리를 나타내는 벡터이며, 강도 H는 CT 촬영 시 측정되는 각 복셀의 밝기 강도이다. 이를 0과 1 사이의 값, I로 정규화해야 하며, 정규화는 수식 (4)와 같이 이루어진다.

| (4) |

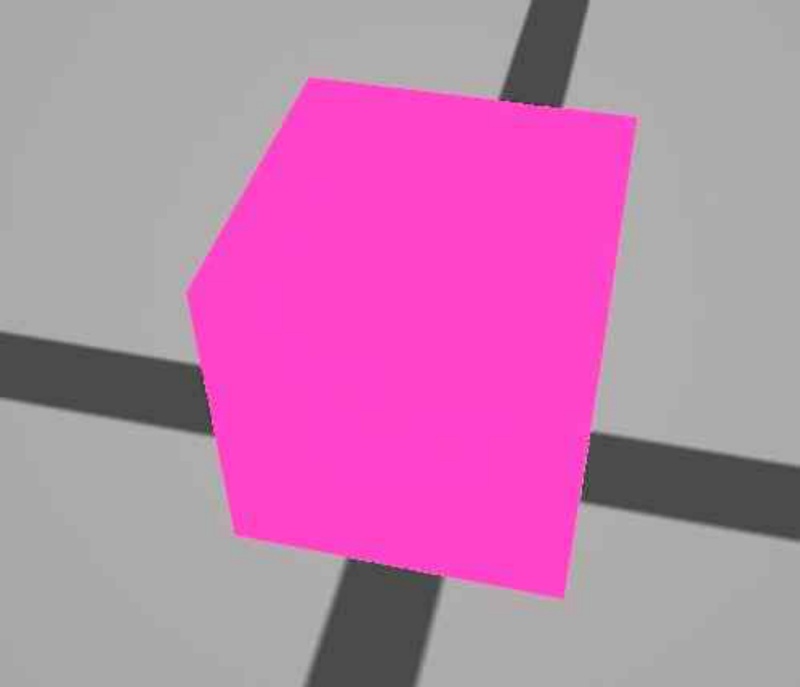

3-5 입자 Mesh, Texture

Plane Unit, Group Unit은 그림 3과 같은 1 × 1 × 1 크기의 정육면체 모양의 Mesh를 사용하여 렌더링 되고, Volume Unit은 Sprite Renderer를 통해 렌더링 된다. 이때, texture는 수식 (4)를 통해 계산된 I와 사전에 설정한 TF를 통해 각 입자의 색상을 결정하게 되고, 이는 수식 (5)와 같이 표현된다.

| (5) |

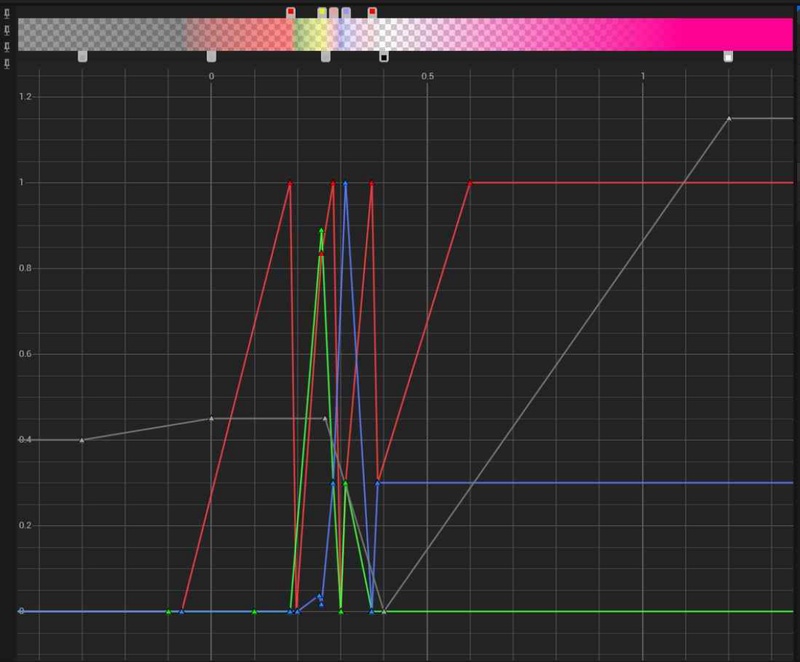

전이 함수는 Gradient Curves를 통해 그림 4와 같이 여러 색상의 혼합 강도로 정의할 수 있다. 그림 4의 예시와 같이, 빨강, 노랑, 파랑의 색상 강도의 범위를 그래프 형태로 선정하면 해당 색상의 합에 해당하는 색상이 해당 입자의 Intensity에 따라 정해진다.

Ⅳ. 실험 및 결과

4-1 CMB-LCA 데이터세트

본 연구에서는 시각화 및 시뮬레이션 검증용 원본 영상으로 CMB-LCA 컬렉션의 흉부 CT 하위세트를 사용하였다. CMB-LCA는 TCIA(The Cancer Imaging Archive)가 공개한 폐암 다중 모달 영상 자료로, 약 120 명의 환자에 대해 저선량 흉부 CT(1 mm 이하 슬라이스 간격), PET/CT 등 총 900여 건의 DICOM 시리즈를 포함한다. 모든 데이터는 HIPAA Safe-Harbor 기준으로 비식별화되었으며, Creative Commons Attribution 3.0 라이선스로 배포되어 연구·교육 목적으로 자유롭게 활용할 수 있다.

본 프레임워크의 성능 측정을 위한 예시로 1건의 CT 시리즈를 선택하였다. 해당 CT 시리즈의 크기와 해상도는 512 × 512 × 114 복셀, in-plane spacing 0.59 mm, slice thickness 1 mm이다. 해당 시리즈는 종괴, 혈관, 기관지가 동시에 포함되어 전이 함수 색상 매핑, 평면 절단, 약물 확산 시뮬레이션 등 다양한 시각 효과를 시험하기에 적합하다. 데이터 사용 시 준수한 윤리, 법적 사항은 다음과 같다. TCIA 제공 DICOM은 이미 익명화 처리되어 추가적인 개인 식별 정보가 존재하지 않는다. 연구 결과는 기술적 검증 목적이며 임상 진단, 치료 의사결정에 사용되지 않았다. 이와 같이 CMB-LCA의 고품질 공용 CT를 채택함으로써, 제안 시스템의 시각적 표현력과 GPU 처리 성능을 공개적으로 검증할 수 있는 조건에서 평가할 수 있었다.

4-2 실험 환경

실험은 표1과 같이 언리얼 엔진 버전 5.3.2 환경에서 진행되었으며, 다른 요소의 개입이 없도록 그림 5와 같이 기본적인 조명과 층만 있는 프로젝트에서 실험 후 성능을 측정하였다. 그래픽 카드는 GeForce RTX3090Ti, VRAM은 24 GB, OS(Operating System)는 Window10 환경에서 실험하였다.

4-3 시각화 결과

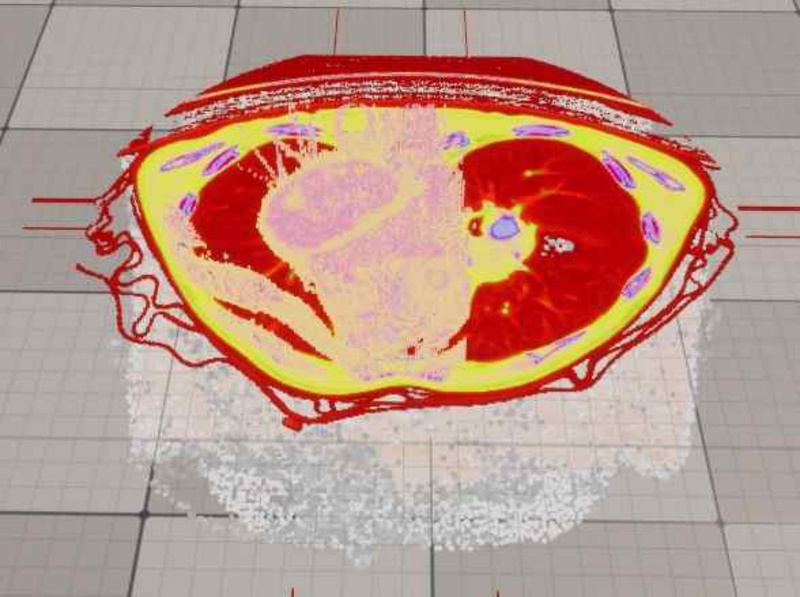

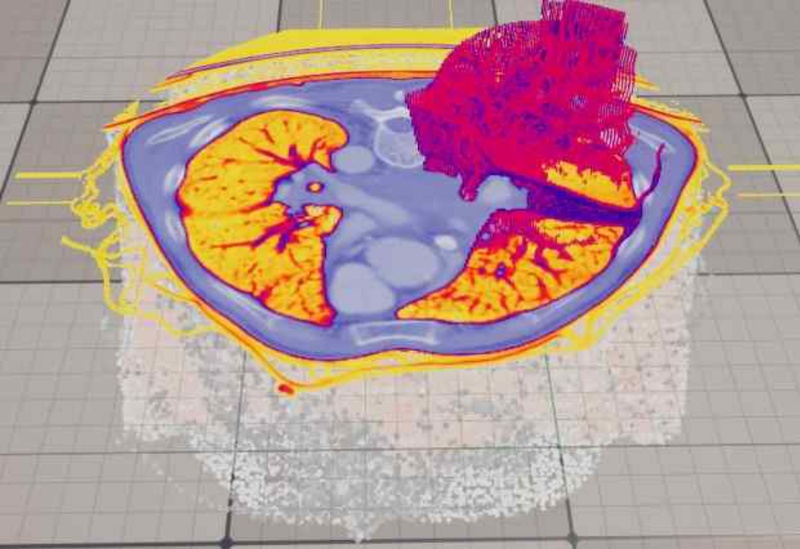

결과적으로 그림 6과 같이 환자의 CT 영상을 바탕으로 언리얼 엔진에서 3D 렌더링을 할 수 있게 된다.

전체적인 윤곽을 나타내는 Volume Unit과 고해상도로 단면을 보여주기 위한 Plane Unit, 국소 지역의 입체를 고해상도로 시각화한 Group Unit을 통해 하나의 객체로 렌더링한다.

그림 6은 TF와 Group Unit을 심장과 주위 혈관을 강조하여 설정한 것이며, 그림 7은 TF와 Group Unit을 폐와 그 주변을 강조하기 위해 설정한 것이다. 이와 같이 하나의 CT 영상을 통해 여러 장기, 조직 등을 설정 변경만으로 강조 대상을 바꿀 수 있다.

4-4 안정성, 최적화 결과

표 2는 동일 CT 영상을 기존 3D 렌더링 방법 중, Surface rendering에 속하는 Flying Edges, Ray Marching에 속하는 TBRaymarching, Point based Rendering에 속하는 Point Cloud를 통해 구현한 것과 본 연구의 기술을 통해 렌더링했을 때 관찰한 초당 프레임 수(FPS; Frame Per Second)와 VRAM 사용량(VRAM Usage)을 정리한 것이다. 또한 각 기법이 지원하는 단면 시각화(Slice Visualization), 사용자 상호작용(Interactivity), 시뮬레이션 연계(Simulation)를 가능(O)과 불가(X)로 표기하였다.

Flying Edges와 TBRaymarching은 모두 120 FPS를 달성했지만, Point Cloud 방식은 50~60 FPS에 머물렀다. 제안 방법은 세 개의 Unit을 동시에 사용한 상태에서도 110 FPS를 유지하였다. 가장 큰 VRAM을 소비한 것은 Flying Edges였고, 가장 적은 것은 TBRaymarching이었다. 본 연구의 시스템은 419 MB로, Point Cloud 보다는 작고, TBRay Marching 보다는 큰, 중간 수준의 사용량을 보였다.

Flying Edges는 Surface Rendering으로 물체의 표면만 렌더링하기 때문에 단면 시각화를 제공할 수 없었다. TBRay Marching는 사용자의 시선에서 반사된 빛의 반사 값을 적분하여, 누적 반사 값을 통해 렌더링하기 때문에 단면 시각화가 가능하다. Point Cloud는 점의 형태로 복셀을 렌더링하기 때문에 단면 시각화가 가능하다.

제안된 방법 또한 Point Cloud와 같은 Point based Rendering으로, 입자의 형태로 복셀을 전부 렌더링하기 때문에 단면 시각화가 가능하다. 본 논문에서 제안된 방법은 시뮬레이션 시스템에서 각 입자에 번호를 붙이고, 속성을 파라미터 형태로 관리하여 상호작용과 시뮬레이션이 가능해진다.

4-5 속성 부여, 시뮬레이션 예시

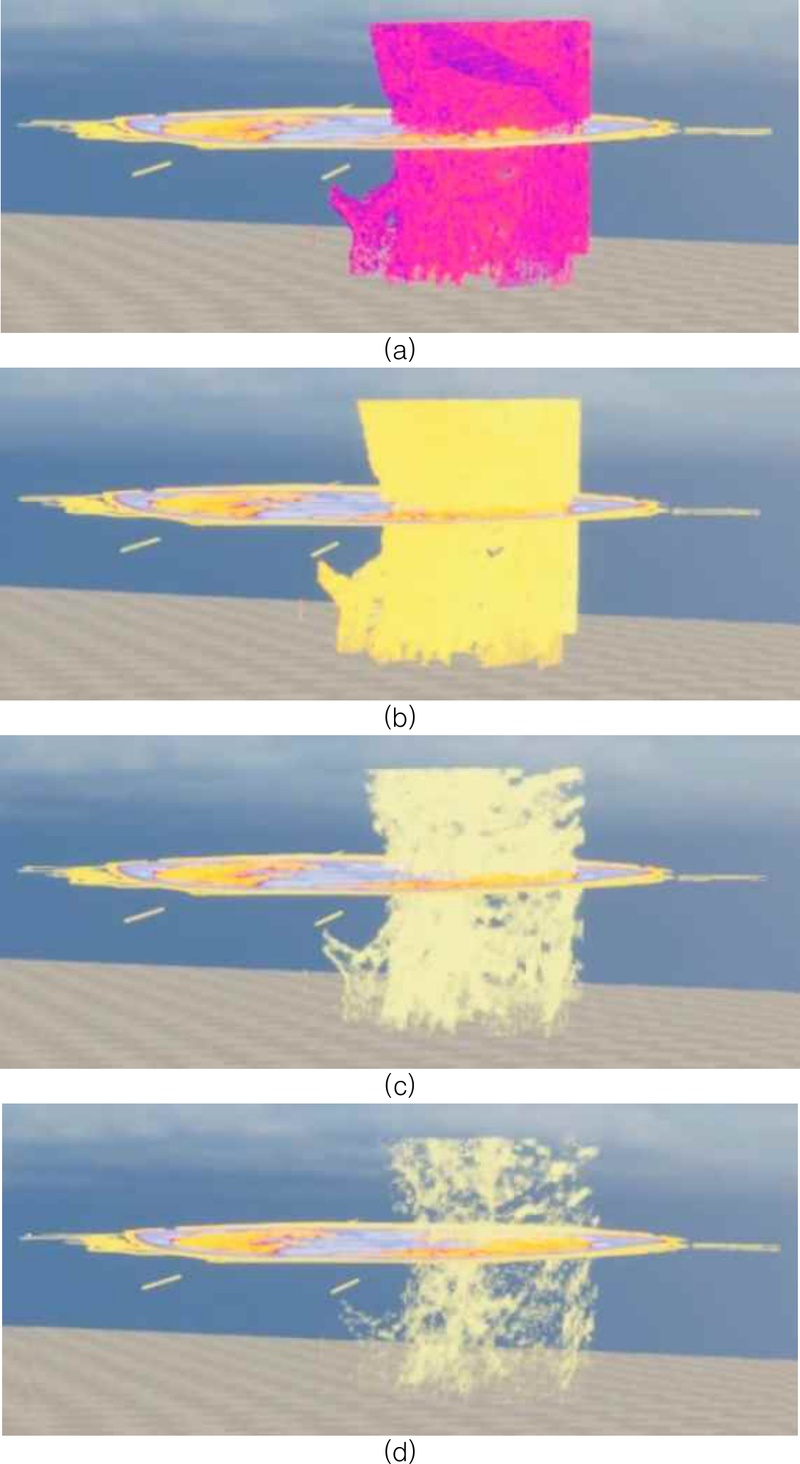

본 논문에서의 시뮬레이션은 약물 반응을 예시로 하였고, Group에 해당하는 영역에 시간이 지남에 따라 약물이 전파되면 각 입자의 약물 누적에 따라 입자의 색상과 크기가 변하도록 설정하였다. 그림 8의 (a)는 시뮬레이션을 보기 쉽게 하도록 Plane Unit과 Group Unit만 렌더링한 상태로, 약물 투여 전의 상태를 나타내고 있다. 각각의 입자는 수식 1에 의해 각 입자의 위치를 결정하고, 환자의 DICOM 영상을 3D 형태로 렌더링하게 된다. 이때, 수식 (3)을 통하여 사용자가 지정한 관심 영역에 따라 폐가 관심 영역으로 남아 있는 것을 확인할 수 있다.

Simulation of drug delivery in CT imaging, (a) state before injection, (b) color change due to drug diffusion after injection, (c) change in particle size over time due to drug accumulation, (d) particle disappearance over time due to drug accumulation

각각의 입자는 수식 4를 통해 정규화된 강도 값을 가지고, 수식 5에 의해 사전 설정한 TF에 따라 색상을 결정하게 된다. 그림 8의 (b)는 약물의 전파에 따른 입자의 색상 변화가 이루어지는 모습이다. 이는 약물 지수 T의 변화가 결정한다. 그림 8의 (c)와 (d)는 약물 누적에 따른 색상 변화, 입자 내부 약물 지수 T에 의한 입자의 크기 변화를 보여준다.

그림 8의 예시에서는 폐를 관심 영역으로 하여 약물 농도 파라미터의 변화에 따라 입자의 색상과 크기로 표현한 것이다. 관심 영역을 종양과 그 주변과 같은 영역으로 설정하고 실험한다면, 환자에 따라 다른 양상을 가지는 신체 구조와 병의 진행 정도에 상관없이 적용 가능하다. 이와 같이 그림 8의 시뮬레이션은 ROI 기반으로 타겟을 선정하고, 각 입자들의 파라미터를 속성으로 활용하여 입자 단위의 시뮬레이션을 할 수 있음을 보였다.

Ⅴ. 결론 및 향후 연구

본 연구는 의료용 CT 영상을 실시간, 상호작용 형태로 탐색하고 약물 반응과 같은 시뮬레이션까지 연결할 수 있는 점 기반 볼륨 렌더링 파이프라인을 제시하였다. 그래픽 카드 GeForceRTX3090Ti, VRAM은 24 GB, OS는 Window10 환경에서, 시뮬레이션 시스템을 활용해 수백만 개의 입자를 GPU 병렬연산과 Unit 기반 분할 방식을 통해 최적화하였다. Volume, Plane, Group 영역 세 가지 해상도를 동시에 렌더링하면서도 110 FPS의 프레임 속도를 유지하였다. 또한 각 입자의 위치, 약물 농도, 크기 등 속성을 파라미터 형태로 정의하였다. 약물 전파, 조직 손상 등의 시각화를 실시간 갱신할 수 있음을 보였다. 제안된 기법은 기존 기술인 Flying Edges, TBRaymarching과 근접한 렌더링 속도를 달성하면서 PointCloud 대비 높은 성능을 제공하였고, VRAM 사용량은 419 MB로 PointCloud보다 약 150 MB 절감되었다. 특히 기존 방법들이 지원하지 못하는 상호작용, 시뮬레이션 기능을 메타버스 상에서 구현했다는 점이 차별점이다. 이는 실제 임상시험 전 계획 수립, 의사결정시간 단축을 위한 보조도구의 기술 기반이 될 것을 기대한다.

다만, 본 연구의 한계로 Volume Unit은 Down sampling 되어 해상도가 높지 않고, 해상도 증가와 정밀한 시뮬레이션을 위한 입자의 개수 증가와 이에 따라오는 최적화가 과제로 남아있다. 향후 본 연구에 LOD, Nanite 등의 최적화 방법을 적용할 수 있을 것이다. 또한 실제 약리학적 모델의 시뮬레이션을 진행하고 비교하여 임상적 신뢰성을 확보할 필요가 있다.

Acknowledgments

이 논문은 과학기술정보통신부의 재원으로 정보통신기획평가원-대학ICT연구센터(ITRC)(IITP-2025-RS-2024-00437718, 기여율 50%)와 보건복지부의 재원으로 한국보건산업진흥원의 보건의료기술연구개발사업(RS-2025-24536036, 기여율 50%)의 지원을 받아 수행된 연구임.

References

-

W. Evans, E. M. Meslin, J. Kai, and N. Qureshi, “Precision Medicine—Are We There Yet? A Narrative Review of Precision Medicine’s Applicability in Primary Care,” Journal of Personalized Medicine, Vol. 14, No. 4, April 2024.

[https://doi.org/10.3390/jpm14040418]

-

Q. Li, H. Duan, X. Zhou, X. Sun, L. Tao, and X. Lu, “The Use of Metaverse in Medical Education: A Systematic Review,” Clinical Medicine, Vol. 25, 100315, 2025.

[https://doi.org/10.1016/j.clinme.2025.100315]

-

F. Pires, C. Costa, and P. Dias, “On the Use of Virtual Reality for Medical Imaging Visualization,” Journal of Digital Imaging, Vol. 34, pp. 1034-1048, July 2021.

[https://doi.org/10.1007/s10278-021-00480-z]

-

C. R. Koger, S. S. Hassan, J. Yuan, and Y. Ding, “Virtual Reality for Interactive Medical Analysis,” Frontiers in Virtual Reality, Vol. 3, 782854, February 2022.

[https://doi.org/10.3389/frvir.2022.782854]

-

L. Zhou, M. Fan, C. Hansen, C. R. Johnson, and D. Weiskopf, “A Review of Three-Dimensional Medical Image Visualization,” Health Data Science, Vol. 2022, 9840519, pp. 1-19, April 2022.

[https://doi.org/10.34133/2022/9840519]

-

C. Rezk-Salama and A. Kolb, “Opacity Peeling for Direct Volume Rendering,” Computer Graphics Forum, Vol. 25, No. 3, pp. 597-606, 2006.

[https://doi.org/10.1111/j.1467-8659.2006.00979.x]

-

J. Xu, G. Thevenon, T. Chabat, M. McCormick, F. Li, T. Birdsong, ... and S. Aylward, “Interactive, in-Browser Cinematic Volume Rendering of Medical Images,” Computer Methods in Biomechanics and Biomedical Engineering: Imaging & Visualization, Vol. 11, No. 4, pp. 1019-1026, 2023.

[https://doi.org/10.1080/21681163.2022.2145239]

-

H. Wang, T. Arulraj, A. Ippolito, and A. S. Popel, “From Virtual Patients to Digital Twins in Immuno-Oncology: Lessons Learned from Mechanistic Quantitative Systems Pharmacology Modeling,” npj Digital Medicine, Vol. 7, 189, pp. 1-10, 2024.

[https://doi.org/10.1038/s41746-024-01188-4]

-

L. W. Goldman, “Principles of CT: Multislice CT,” Journal of Nuclear Medicine Technology, Vol. 36, No. 2, pp. 57-68, June 2008.

[https://doi.org/10.2967/jnmt.107.044826]

-

W. E. Lorensen and H. E. Cline, “Marching Cubes: A High-Resolution 3D Surface Construction Algorithm,” ACM SIGGRAPH Computer Graphics, Vol. 21, No. 4, pp. 163-169, July 1987.

[https://doi.org/10.1145/37402.37422]

-

W. Schroeder, R. Maynard, and B. Geveci, “Flying Edges: A High-Performance Scalable Isocontouring Algorithm,” in Proceedings of the 2015 IEEE 5th Symposium on Large Data Analysis and Visualization (LDAV), Chicago: IL, pp. 33-40, October 2015.

[https://doi.org/10.1109/LDAV.2015.7348069]

-

J. Krüger and R. Westermann, “Acceleration Techniques for GPU-Based Volume Rendering,”in Proceedings of IEEE Visualization 2003, Seattle: WA, pp. 287-292, October 2003.

[https://doi.org/10.1109/VISUAL.2003.1250384]

-

P. Sundaresan, R. Antonova, and J. Bohg, “DiffCloud: Real-to-Sim from Point Clouds with Differentiable Simulation and Rendering of Deformable Objects,” in Proceedings of the2022 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), Kyoto: Japan, pp. 10828-10835, 2022.

[https://doi.org/10.1109/IROS47612.2022.9981101]

-

M. Schlüter, T. Kwasnitschka, A. Berstetter and J. Karstens, “Rendering Large Volume Datasets in Unreal Engine 5: A Survey,” arXiv:2504.07485, , April 2025.

[https://doi.org/10.48550/arXiv.2504.07485]

-

L. Ren, H. Pfister, and M. Zwicker, “Object Space EWA Surface Splatting: A Hardware Accelerated Approach to High Quality Point Rendering,” Computer Graphics Forum, Vol. 21, No. 3, pp. 461-470, September 2002.

[https://doi.org/10.1111/1467-8659.00606]

-

N.-V. Ho, T. Nguyen, G.-H. Diep, N. Le, and B.-S. Hua, “Point-Unet: A Context-Aware Point-Based Neural Network for Volumetric Segmentation,” in Proceedings of the 24th International Conference on Medical Image Computing and Computer-Assisted Intervention – MICCAI 2021, Strasbourg: France, pp. 644-655, 2021.

[https://doi.org/10.1007/978-3-030-87193-2_61]

-

G. T. Herman and H. K. Liu, “Display of Three-Dimensional Information in Computed Tomography,” Journal of Computer Assisted Tomography, Vol. 1, No. 1, pp. 155-160, January 1977.

[https://doi.org/10.1097/00004728-197701000-00018]

-

M. Larobina, “Thirty Years of the DICOM Standard,” Tomography, Vol. 9, No. 5, pp. 1829-1838, October 2023.

[https://doi.org/10.3390/tomography9050145]

-

M. Lo, E. Mariconti, S. Nakhaeizadeh, and R. M. Morgan, “Preparing Computed Tomography Images for Machine Learning in Forensic and Virtual Anthropology,” Forensic Science International: Synergy, Vol. 6, 100319, February 2023.

[https://doi.org/10.1016/j.fsisyn.2023.100319]

-

E. Benca, M. Amini, and D. H. Pahr, “Effect of CT Imaging on the Accuracy of the Finite Element Modelling in Bone,” European Radiology Experimental, Vol. 4, 51, September 2020.

[https://doi.org/10.1186/s41747-020-00180-3]

저자소개

2018년:전남대학교 응용생물공학부 분자생명공학과(농학사)

2024년~현 재: 전남대학교 지능정보융합학과 석사과정

※관심분야:시뮬레이션, 메타버스, 인공지능

2020년:전남대학교 컴퓨터정보통신공학과(공학사)

2023년:전남대학교 ICT융합시스템공학과(공학석사)

2023년~현 재: 전남대학교 지능전자컴퓨터공학과 박사과정

※관심분야:인공지능, 딥러닝 생성 모델, 메타버스, 네트워크

2019년:한국나사렛대학교 디지털콘텐츠학과(공학사)

2021년:전남대학교 ICT융합시스템학과(공학석사)

2021년~현 재: 전남대학교 박사과정(지능전자컴퓨터공학)

※관심분야:딥러닝, 인공지능

2002년:항공우주대학교 전자엔지니어링학(공학사)

2004년:한국과학기술원 정보통신공학(공학석사)

2011년:한국과학기술원 정보통신공학(공학박사)

2012년~2013년: 삼성전자 DMC연구소

2013년~현 재: 나사렛대학교 IT인공지능학부 교수

※관심분야:신호처리, 3D 음향, 디지털콘텐츠 등

1979년:서울 국립대학교 전자공학(공학사)

1981년:서울 국립대학교 전자공학(공학석사)

1985년:플로리다 대학(University of Florida) 전자공학(공학박사)

1982년~1985년: 대전 한국표준과학연구원 연구원

1990년~1997년: 한국전자통신연구원 연구원

1998년~현 재: KAIST 전자공학과 및 아스타나IT대학교 컴퓨터 및 데이터과학과 교수

※관심분야:음성 및 오디오 코딩, 음성 합성, 음성 변환, 노이즈 감소, VoIP

2001년:Computer Science from University of Utah, Salt Lake City, Utah, USA(공학사)

2005년:한국과학기술원 정보통신공학(공학석사)

2008년:한국과학기술원 정보통신공학(공학박사)

2005년~2008년: 한국전자통신연구원 IPTV 인프라 기술, 융·복합 방송/통신 분야 연구원

2009년~2012년: 나사렛대학교 멀티미디어학과 교수

2012년~현 재: 전남대학교 지능전자컴퓨터공학과 교수

※관심분야:QoS/QoE 예측/분석/관리, 모바일 미디어 처리/통신, 클라우드 컴퓨팅 디지털 미디어 및 네트워크 지능