디지털 문제은행에서 OCR 노이즈가 BERT 기반 문제 유형 분류 성능에 미치는 영향

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

최근 교육 현장에서 디지털 기반의 문제은행 시스템 활용이 확대되고 있으나, 시험지 이미지의 디지털화 과정에서 발생하는 OCR(Optical Character Recognition) 오류가 성능 저하의 주요 원인으로 지적된다. 본 연구는 중학교 영어 기출 문항을 대상으로, OCR 노이즈가 BERT 기반 문제 유형 분류 성능에 미치는 영향을 분석하였다. 대화, 독해, 문법, 어휘 네 유형의 500문항을 Noise1, Noise2, Noise3의 세 단계 노이즈 조건에서 평가한 결과, 노이즈 강도가 높을수록 정확도와 Macro-F1 점수가 전반적으로 하락했으며 특히 Noise3에서 저하가 두드러졌다. 정밀도(Precision)·재현율(Recall) 분석에서는 어휘 유형이 가장 취약했으며, 대화 유형은 상대적으로 안정적이었다. 혼동행렬 분석에서는 노이즈 증가에 따라 어휘→대화, 독해→대화 등 의미적으로 인접한 유형 간 오분류가 빈번해졌다. 이에 본 연구는 현장 적용을 위해 전처리(CER 모니터링·정규화·부분 삭제 보정), 사후 교정(post-OCR), 데이터 증강(노이즈 인식), 특성 추출(문장 경계·레이아웃 보강) 전략을 개략적으로 제시한다.

Abstract

While digital test banks are expanding in schools, exam digitization often degrades downstream performance due to optical character recognition (OCR) errors. We quantified OCR-noise impacts on a BERT-based classifier for Korean middle-school English items. Using 500 items across Conversation, Reading, Grammar, and Vocabulary, we evaluated three noise levels (Noise1–3). Accuracy and Macro-F1 declined monotonically with increasing noise, with the steepest drop at Noise3. Precision–Recall analysis showed that Vocabulary is most vulnerable and Conversation is comparatively robust. Confusion matrices revealed noise-amplified misclassification along semantically adjacent axes, especially Reading→Conversation and Vocabulary→Conversation. To mitigate these effects in practice, we recommend character error rate monitoring, whitespace/casing normalization, partial-deletion repair, post-OCR correction, noise-aware data augmentation, and feature reinforcement using sentence-boundary and layout cues. These measures provide a concise path to more reliable OCR–NLP pipelines for educational assessment.

Keywords:

OCR Noise, Question Type Classification, BERT, Educational Assessment Data, Noise Robustness키워드:

OCR 노이즈, 문제 유형 분류, 교육 평가 데이터, 노이즈 강건성Ⅰ. 서 론

최근 교육기술(EdTech; educational technology) 분야에서 광학 문자 인식(OCR; optical character recognition) 기술은 학습 자료를 디지털로 전환하고, 이후 검색·분류·태깅·난이도 분석 등과 같은 후처리를 자동화하는 기능으로 활용되고 있다. 기존에 OCR이 종이 문서를 전자 문서로 변환하거나 스캔한 PDF(portable document format) 검색을 지원하는 수준에 머물렀으나, 인공지능(AI; artificial intelligence)과 자연어처리(NLP; natural language processing)의 융합기술이 활용되면서 교육 콘텐츠는 점차 지능적이고 실시간적 학습 지원을 가능하게 하고 있다[1].

이러한 기술적 진보는 교육 현장에서 다양한 방식으로 활용되고 있다. 첫째, 학생이 스마트폰으로 촬영한 문제를 자동 인식해 풀이와 해설을 제공하는 서비스가 제공되고 있다. 한국의 QANDA는 촬영 이미지를 OCR로 텍스트화한 뒤 문제 검색, 유사도 매칭, 해설 생성을 수행하며[2], Photomath와 Socratic by Google 역시 수학식과 영어 문장을 실시간 인식해 풀이를 지원한다[3],[4]. 이처럼 복잡한 수학 기호, 영어 지문, 도표 등을 정확히 판독하는 OCR의 인식 정확도가 학습 지원의 품질을 결정짓는 핵심적인 요소이다.

둘째, 교육 기관과 학원은 출력물 형태의 교재와 시험지를 OCR로 변환해 검색·편집 가능한 데이터베이스를 구축하고, 이를 기반으로 문제 추천, 학습 진도 추적, 자동 요약·하이라이팅 등을 이용한 맞춤형 학습 기능을 확장하고 있다. 더 나아가 OCR과 자연어처리(NLP)를 결합해 문항 재구성, 학년별 난이도에 따른 문장 재작성, 자동 문제 생성 등의 고도화된 서비스 제공이 시도되고 있으며[5], 시험지를 촬영해 답안을 자동 인식·정오 비교하거나 언어적 패턴을 분석함으로써 채점 부담을 줄이고 실시간 피드백을 제공하는 평가 시스템도 도입되고 있다[6].

셋째, 텍스트 음성 변환(TTS; text-to-speech)과 결합을 통해 특수교육 및 학습 접근성이 개선하는 방식이다. 난독증이나 시각 장애가 있는 학습자는 인쇄 자료를 OCR로 텍스트화한 뒤 음성으로 제공해 학습할 수 있으며[7], 이는 읽기 어려움으로 인한 학습 격차를 완화하고 개인 맞춤형 지원으로의 확장을 가능하게 한다.

한편, 교육 현장에서 사용되는 복합기·스캐너·모바일 촬영 환경은 촬영 각도, 종이 구김, 그림자, 낮은 해상도, 필기 흔적 등으로 인해서 문자 오류율(CER; character error rate)을 유발하며, 이는 자료 처리·검색·분석 전반의 품질을 저하시키는 요인이 된다[8]. 이러한 OCR 노이즈는 추출 텍스트가 문항 유형 분류와 같은 자연어처리(NLP)기반 과업에 투입될 때 의미 왜곡, 유형 오분류, 문맥 단서 손실 등의 현상을 발생시키는 원인이 된다.

문장 경계 인식, 토큰화, 품사 태깅 등 기초 단계의 오차가 상위 과업으로 전파되는 오류 전파(error cascade) 현상이 관찰되었고[9], OCR 품질 저하가 문장 분할·개체명 인식(NER; named entity recognition)·의존 구문 분석·정보 검색 등 후속 작업의 성능을 낮춘다는 실증 결과도 제시되었다[10]. 더불어, 다양한 언어 환경에서 OCR 노이즈가 언어 모델 내부 표현을 왜곡하고 예측 안정성을 저하시킨다는 분석이 다양하게 연구되고 있다[11].

이러한 선행연구를 배경으로 본 연구에서는 교육 도메인에서 OCR 노이즈가 학습 지원 시스템 성능에 미치는 영향을 체계적으로 분석하고자 한다. 먼저, 중학교 영어 기출 문항을 대상으로 다단계 OCR 노이즈 환경을 구성하고, 대화·문법·독해·어휘 유형 분류 실험을 통해 성능 저하 양상을 정량 검증한다. 아울러 문맥 의존도가 높은 유형별 취약성을 규명함으로써, OCR 기반 에듀테크 시스템의 견고성과 신뢰성을 확보하고 점진적으로 성능을 개선할 수 있는 콘텐츠 개발을 위한 실질적 방향성을 제시하고자 한다.

Ⅱ. 선행연구 분석

2-1 교육 분야에서의 OCR 선행연구

광학 문자 인식(OCR)은 교육기술 분야에서 학습 자료를 디지털로 전환하고, 이후 데이터를 처리하는 과정을 자동화하는 핵심 기반 기술로 발전해 왔다. 초기에는 종이 문서를 전자 문서로 변환하거나 스캔한 PDF를 검색 가능한 텍스트로 만드는 수준에 머물렀으나, 인공지능(AI)과 자연어처리(NLP)의 결합으로 학습 자료 처리 전반의 지능화와 실시간 학습 지원이 가능해지는 방향으로 진화하고 있다[1].

이 같은 변화는 교육 콘텐츠를 운영하는 방식에도 변화를 가져오고 있다. 교육 기관과 학원은 시험지·교재를 OCR로 변환해 검색·편집 가능한 데이터베이스를 구축하고, 이를 토대로 문제 추천, 학습 진도 추적, 난이도 태깅, 자동 요약·하이라이팅 등 학습자 맞춤형 기능을 구현하고 있다. 이러한 데이터 인프라는 학습 분석(learning analytics)과 적응형 학습(adaptive learning)의 기반으로 활용되어, 교사가 학습자의 수준과 패턴을 정밀하게 파악하고 데이터 기반 피드백과 개인별 학습 경로를 설계하도록 지원한다[12],[13].

더 나아가 활용 영역은 콘텐츠 생성과 평가 자동화로 확장되고 있다. 독해 지문을 기반으로 단답형 문항을 자동 생성하는 접근이 제안되었고[5], 수기 답안을 OCR로 인식하여 자동 채점의 정확성과 채점 효율을 높이는 시스템도 연구되고 있다[6]. 아울러 시각적 제약이 있는 학습자를 위해 OCR과 텍스트 음성 변환(TTS)을 결합한 접근성 지원 체계가 제시되어 교육 참여 장벽을 낮추고 있다[7]. 이처럼, 최근 교육 분야에서 OCR은 단순 텍스트 추출을 넘어 학습 자료 관리, 개별화 지원, 자동 평가, 접근성 확대를 포괄하는 교육 생태계의 핵심 기술로 진화하고 있음을 알 수 있다.

2-2 OCR 오류가 자연어처리 기반 학습 지원 및 문제 분류 성능에 미치는 영향

앞서 살펴본 선행연구의 내용과 같이 OCR 기술은 교육 현장에서 학습자료를 디지털화하고 이를 기반으로 문제 추천, 난이도 태깅, 자동 평가와 같은 다양한 학습 지원서비스를 제공해왔다. 그러나 이러한 활용 수준은 인식 품질(recognition quality)이라는 근본적 한계에 의해 크게 좌우된다. 현장에서 사용되는 복합기, 스캐너, 모바일 촬영 장비 등은 촬영 각도, 종이 구김, 그림자, 해상도 저하, 필기 흔적 등으로 인해 인식 오류(CER)를 발생시키며, 이는 이후의 자연어처리(NLP) 기반 작업 전반에 직접적인 영향을 미친다[8].

선행연구에서 OCR 오류가 텍스트 전처리와 언어 이해 모델의 성능을 저하시킨다는 점을 실증적으로 제시하고 있다. Boros et al.는 OCR 노이즈가 문장 경계 인식과 이벤트 추출을 포함한 기초언어 처리단계에서 오류 전파(error cascade)를 유발한다는 점을 확인할 수 있다[9].

또한, Van Strien et al.는 OCR 품질 저하가 문장 분할, 개체명 인식(NER), 의존 구문 분석 등 후처리 작업의 정확도를 유의하게 감소시킨다고 분석했다[10]. Todorov and Colavizza의 연구는 다양한 언어 환경에서 OCR 노이즈가 언어 모델의 내부 표현을 왜곡하고 예측 안정성을 저하시킨다고 밝혔다[11]. 이러한 선행연구를 통해서 OCR 품질이 단순한 텍스트 추출 정확도를 넘어 언어 모델 기반 파이프라인 전체 성능을 결정하는 핵심 요인임을 확인할 수 있다.

최근, 선행연구들은 딥러닝 기반 임베딩 및 분류 모델의 취약성에 주목한다. Hu et al.의 연구는 OCR 품질 저하가 BERT(Bidirectional Encoder Representations from Transformers) 임베딩 표현력을 약화시키고, 결과적으로 문서 분류 정확도를 감소시킨다는 점을 정량적으로 검증하였다[14]. Pruthi et al.는 단어 단위의 철자 오류나 노이즈가 모델 입력에서 토큰화 및 의미 표현을 왜곡한다는 점을 지적하며, 강건성(robustness)을 강화하기 위한 전처리 및 학습 기법을 제안하였다[15].

또한 Gupta et al.는 OCR 노이즈를 포함한 텍스트에서 오류 보정 및 복원 프레임워크를 제안하여, 문제 생성 및 분류와 같은 자연어처리(NLP) 파이프라인의 성능을 개선할 수 있음을 실증하였다[16].

위와 같은 선행연구들을 통해서 OCR 인식 품질이 자연어처리(NLP)기반 학습 지원 시스템의 성능에 유의미한 영향을 미친다는 점을 일관되게 확인할 수 있다. OCR 노이즈는 문장 경계 인식·토큰화·품사 태깅 등 기초 전처리 단계의 오류를 상위 과업으로 연쇄 전파하고[9],[10], 언어 모델의 내부 표현을 왜곡해 예측 안정성을 낮추며[11], BERT 임베딩과 분류 정확도에도 직접적인 손실을 초래한다[14]. 따라서 문제 추천, 난이도 태깅, 자동 평가, 특히 문제 유형 분류처럼 미세한 의미 단서에 의존하는 고차 과업은 OCR 노이즈에 더욱 민감하게 된다.[8],[10],[11].

그럼에도 다수의 연구에서 일반 도메인 문서·뉴스·디지털 도서에 초점을 맞추어 왔고[9],[10],[14], 교육 도메인 특화의 문제 유형별 취약성을 체계적으로 검증한 사례는 드물다. 실제 교육 데이터는 시험지 촬영, 수기 응답, 표·도표·수식 등 복합 레이아웃 구성으로 인해 노이즈 양상이 상이하며[6], 이러한 차이가 분류 모델의 취약성을 어떻게 유발하는지에 대한 근거가 충분히 축적되지 않았다.

따라서 중학교 영어 시험에서 주로 사용되는 대화·문법·독해·어휘 문항을 대상으로 OCR 품질 저하가 분류 성능에 미치는 영향을 정량적으로 분석할 필요가 있다. 이러한 분석은 향후 OCR 기반 에듀테크 시스템의 강건성 확보와 모델 개선 전략을 수립하는 데 핵심적 근거를 제공할 것이다.

2-3 교육 도메인에서의 문제 유형 분류 연구 동향

문제 유형 분류는 교육 데이터 분석에서 문항 추천, 난이도 추정, 적응형 학습 경로 설계, 자동 평가 피드백을 정밀화하는 핵심 과업이다. 문항을 대화·문법·독해·어휘 등 기능 축으로 체계화하면 학습자의 취약 영역을 정밀 진단하고 개인화된 콘텐츠 제공이 가능해지며, 이러한 체계화는 기관 차원의 학습 분석과 적응형 학습 인프라를 뒷받침하는 표준화된 데이터 기반을 제공한다[12],[13].

방법론은 규칙·특징 기반 분류기인 서포트 벡터 머신 (SVM; support vector machine), 조건부 임의장(CRF; conditional random field)에서 합성곱 신경망(CNN; convolutional neural network)과 순환 신경망(RNN; recurrent neural network)으로 발전했으며, 다시 사전학습 언어모델(PLM; pre-trained language model) 중심으로 고도화되었다.

특히 BERT 계열 모델은 문맥 신호를 통합해 지문–선지 상호작용과 문법·어휘 단서의 미세 결합을 효과적으로 포착하며, 지시문·선택지·표/수식 등 이질적 요소가 공존하는 교육 문항의 특성에 적합하다[17]. 다만 사전학습 언어모델(PLM)은 입력 품질에 민감하므로, 디지털 원문 대비 스캔·촬영본(시험지 촬영, 수기 응답 등)에서는 성능 격차가 발생할 수 있어 데이터 출처와 노이즈 조건을 함께 고려한 해석이 요구된다[6],[11],[14].

본 연구는 중학교 영어 문항(대화·문법·독해·어휘)을 대상으로 다단계 노이즈 환경(Clean–Noise1–Noise2–Noise3)을 구성하고, BERT 기반 분류기를 이용하여 Accuracy, Precision, Recall, Macro-F1 및 혼동 행렬(confusion matrix)로 유형별 취약성과 오분류 패턴을 정량 분석한다. 이러한 방식으로 일반 도메인 중심 평가로 인해 발생하는 공백을 최소화하고, 시험지 촬영·수기 응답 등 교육 현장 특유의 노이즈 양상을 반영한 해석 틀을 제시한다. 본 논문의 3장에서는 데이터 셋 구성, 노이즈 레벨 정의, 모델 설정, 평가 절차를 구체적으로 제시하고자 한다.

Ⅲ. 연구 방법론

3-1 연구 설계 모델

본 연구는 2015–2020년 사이 발행된 중학교 영어 기출 문항 500개를 분석 대상으로 선정하였다. 각 문항은 원본 시험지 PDF/이미지로부터 지문(또는 대화문)과 선택지를 추출한 뒤, 불필요한 공백·특수 기호 정규화 등에 대한 최소 전처리를 적용해 문장 단위로 정제하였다. 최종 입력은 문항의 의미적 일관성을 유지하도록 문항 단위로 구성하였고, 문장 단위 정제는 가독성과 토큰화 안정성 확보를 위한 전처리 절차로만 활용하였다.

문항 유형 라벨은 교육청 해설서 및 교사용 지도서를 참조해 대화(Conversation)·독해(Reading)·문법(Grammar)·어휘(Vocabulary)의 네 범주로 부여하였다. 학습 파이프라인 내부에서의 클래스 인코딩은 인덱싱을 위한 기술적 편의를 고려해 고정 순서 ["Reading", "Grammar", "Vocabulary", "Conversation"]를 사용하였으며, 이는 평가·해석 단계의 의미 체계에는 영향을 미치지 않도록 하였다.

모델 입력은 klue/bert-base 계열의 WordPiece 토크나이저를 사용해 토큰화하였고, 최대 시퀀스 길이 128로 설정하였다. 이는 사전학습 언어 모델(PLM)의 입력 형식에 부합하고, 교육 문항의 평균 길이와 구성(지시문·보기·표/수식 등)을 고려한 설정이다. 사전학습 기반 표현 학습의 표준으로서 BERT의 문맥적 인코딩 능력[17]과, 한국어 언어이해 벤치마크로서 한국어 언어이해 평가 (KLUE; Korean Language Understanding Evaluation)가 제공하는 토크나이저/형태소 단위 표준화 관행[18]을 함께 반영하였다. 전처리와 라벨 인코딩은 Python 스크립트로 일괄처리하여 재현성을 확보할 수 있도록 설계하였다.

3-2 데이터셋 구축 및 분류 모델

실제 교육 현장에서 이루어지는 스캔·촬영(복합기, 스캐너, 모바일 기기)은 환경에 따라서 해상도 저하, 그림자(음영), 용지 구김, 필기 흔적 또는 원본 훼손 등의 현상으로 인해서 OCR 처리 과정에서 다양한 오류가 발생하게 된다[6]. 이러한 현장 노이즈는 결과적으로 전처리와 언어 모델 단계 전반에 걸쳐 성능 저하를 발생하게 된다[10].

본 연구에서는 현장 조건을 모사한 합성 노이즈를 구성해 노이즈 수준에 따른 분류 성능 변화를 정량적으로 비교하기 위해서, 노이즈 유형과 강도는 선행연구에 보고된 전형적 오류 양상과 실제 시험지 스캔본에서 관찰된 패턴을 함께 반영하여 데이터셋을 사용하도록 시험을 설계하였다.

본 연구에서는 현장 스캔 및 촬영 환경에서 빈발하는 텍스트 인식 오류를 네 가지 유형으로 정리한다. 각 유형은 교육 시험지의 텍스트 및 표와 기호가 혼재된 환경에서 자주 관찰되며, 이들 텍스트 인식 오류는 분류에 필요한 문법 구조와 형태 및 의미 단서를 약화시킬 수 있다 [6],[10].

첫째, 문자 치환(rn↔m, l↔1, 0↔o)과 같이 OCR 엔진이 시각적으로 유사한 글자쌍을 혼동하는 현상이 발생하며, 이러한 혼동으로 토큰화와 의미 표현이 왜곡될 수 있다[15].

둘째, 텍스트 인식 과정에서 단어 간 공백 누락으로 문장이 연속 문자열로 출력되면서 문장 분할·토큰화 오류를 크게 증폭시킬 수 있다[10].

셋째, OCR 과정에서 단어의 일부 또는 전체가 누락되어 의미 단서 소실로 이어지는 단어 삭제 오류가 발생할 수 있고, 다운스트림 성능 저하를 유발시킬 수 있다[8],[10].

넷째, 인식 불확실성으로 인해 문장의 대·소문자 패턴이 비정상적으로 변경되는 무작위 변환 현상으로 표면 단서가 약화될 수 있다[15].

본 연구는 노이즈 강도를 문자 오류율(CER)로 단계화하였다. CER은 문자 편집거리(치환·삽입·삭제)의 합을 원문 전체 문자 수로 정규화한 지표로, OCR 품질을 정량화하는 표준적 측도로 활용된다[10]. 실제 시험지 스캔본에서 측정한 오류 분포를 참조하여, 각 문항의 원본(Clean)과 세 단계의 노이즈 조건을 생성하였다.

구체적으로, Noise 1은 약 5% CER 수준으로 경미한 문자 치환과 공백 누락 오류를 반영한 저강도 조건이다. Noise 2는 약 10% CER 수준으로 문자 치환과 공백 누락에 더해 부분적 단어 삭제를 포함한 중강도 조건이다. Noise 3은 약 20% CER 수준으로 단어 삭제와 무작위 대소문자 변환까지 포함하여 고강도 수준의 노이즈 조건을 구현하였다.

이와 같이 정의한 세 단계의 노이즈 강도는 문항 단위로 일관되게 적용하였다. 재현성 확보를 위해 고정 시드와 동일 매개변수를 유지했다. 또한, 데이터 누수를 방지하고 공정 비교를 하기 위해 학습·검증 분할을 먼저 수행한 뒤 각 분할 내부에서 노이즈를 생성하였다. 따라서 노이즈 수준만을 독립변수로 두고 분류 성능 변화를 정량적으로 비교할 수 있는 실험 설계를 갖추었다[10].

본 연구는 교육 문항의 문맥 정보를 안정적으로 포착하기 위해, 사전 학습 언어 모델(PLM)기반의 BERT 분류기를 채택하였다. 구현은 AutoModelForSequenceClassification을 사용하고, 사전학습 가중치는 klue/bert-base를 적용하였다. BERT는 문맥 의존 표현을 효과적으로 학습하여 문항 지문·선택지에서 나타나는 미세한 의미 단서를 포착하는 데 적합하며[17], klue/bert-base는 한국어 일반 과제 성능과 토크나이저 호환성 측면에서 국내 표준 사전학습 언어모델(PLM) 계열로 널리 활용된다[18].

모델 구조는 BERT의 [CLS] 토큰 표현 위에 분류 헤드를 얹어 4개 클래스(대화·독해·문법·어휘)에 대한 확률을 산출하는 방식이다. 입력은 동일한 토크나이저로 전처리하여 일관성을 유지하며, 학습은 표준 설정을 따른다. 클래스 분포 불균형은 전체 분석에 영향을 주지 않는 범위에서 확인하되, 필요 시 클래스 가중치 적용을 검토한다.

데이터 분할은 층화(stratified) 80%/20%로 수행하여 유형별 분포를 보존했고, 랜덤 시드 42를 고정해 재현성을 확보하였다. 특히 사전학습 언어모델(PLM)이 입력 품질에 민감하다는 기존 관찰을 고려하여[11],[14], Clean–Noise1–Noise2–Noise3 모든 조건에서 토크나이저·하이퍼파라미터·학습 절차를 동일하게 유지했다. 이를 통해 노이즈 수준만을 독립변수로 두고, 각 조건에서의 성능 변화를 공정하게 비교할 수 있도록 설계하였다.

3-3 성능평가 지표

본 연구는 노이즈 수준 변화에 따른 분류 성능의 민감도를 일관되게 비교하기 위해, 네 가지 지표인 Accuracy(정확도), Precision(정밀도), Recall(재현율), Macro-F1 Score (Macro-F1 점수)를 사용하였다. 다중 클래스 설정에서는 각 지표를 클래스별(one-vs-rest)로 산출한 뒤 동일 가중치로 평균(macro average)하여 보고한다. 이는 클래스 분포가 완전히 균등하지 않은 상황에서도 소수 클래스의 성능 변화를 균형 있게 반영한다는 점에서 적합하다[18]. 보조 분석으로 혼동행렬을 통해 오분류 패턴을 해석한다.

| (1) |

정확도는 전체 표본 N 중 예측 가 정답 yi와 일치한 비율이다. 모델의 전반적 성능을 직관적으로 요약하는 장점이 있으나, 클래스 불균형이 존재할 경우 소수 클래스로의 성능 저하를 가려 보일 위험이 있어, 아래의 정밀도·재현율과 함께 해석한다.

| (2) |

정밀도는 모델이 k로 예측한 사례 중 실제로 k인 비율이다. 거짓양성(FP)이 늘면 급격히 하락한다.

교육 도메인 맥락에서는, 예를 들어 문법 문항을 어휘로 잘못 선언(predicted-as)하는 사례가 잦을수록 정밀도가 낮아지며, 이는 잘못된 유형별 피드백·추천의 위험과 직결된다.

| (3) |

재현율은 실제 k인 사례 중 모델이 올바르게 k로 포착한 비율이다. 거짓음성(FN)이 늘면 하락한다. 교육 도메인에서는 특정 유형을 놓치는 비율이 높으면, 해당 영역의 취약 진단과 개인화된 처방이 왜곡될 수 있다.

| (4) |

Macro-F1 점수는 클래스 수 C개에 대해 각 클래스의 F1을 동일 가중치로 평균한 값이다. 클래스별 정밀도·재현율의 조화평균을 평균한 지표로, 클래스 불균형이나 유형별 성능 격차를 균형 있게 반영한다.

동일한 데이터 분할·설정에서 독립 반복 3회 수행하여 평균±표준편차를 보고한다. 노이즈 단계 간 차이는 동일 설정의 반복 결과를 짝지어 대응표본 t-검정(𝑝<.01)으로 검증한다. 조건 간 토크나이저·하이퍼파라미터·학습 절차는 동일하게 유지하여, 노이즈 수준만이 성능 변화를 유발하도록 통제한다.

Ⅳ. 실험 결과

4-1 전체 성능

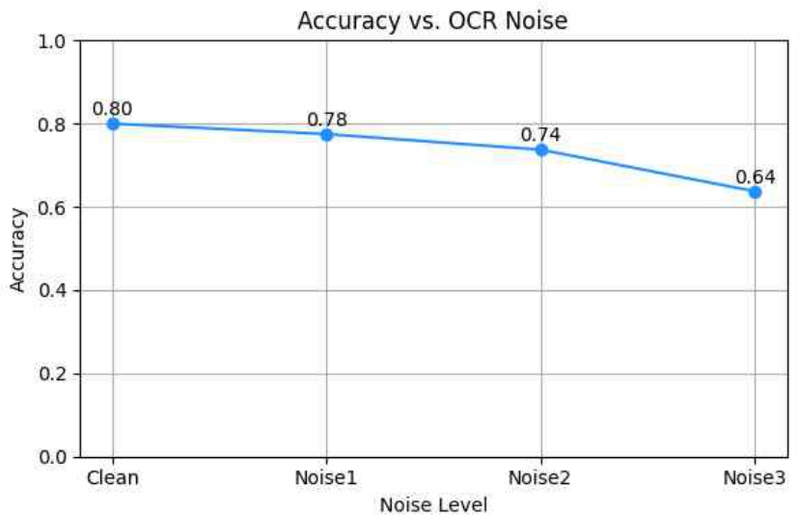

그림 1은 OCR 노이즈 수준별 분류기의 정확도(Accuracy) 변화를 보여준다. Clean 데이터셋에서는 정확도가 0.80으로 가장 높게 나타났으나, Noise1(0.78), Noise2(0.74), Noise3(0.64)로 진행될수록 점진적으로 감소하였다. 특히 Noise2에서 Noise3로의 전환 시 정확도 하락폭이 -0.10p으로 가장 크게 나타났으며, 3.2절에서 정의한 고강도 노이즈(≈20% CER)가 임계적으로 성능을 끌어내리는 구간임을 시사한다. 이는 토큰화 오류의 누적과 의미 단서 소실이 일정 강도를 넘어서면 모델의 예측 안정성이 급격히 흔들릴 수 있음을 의미한다.

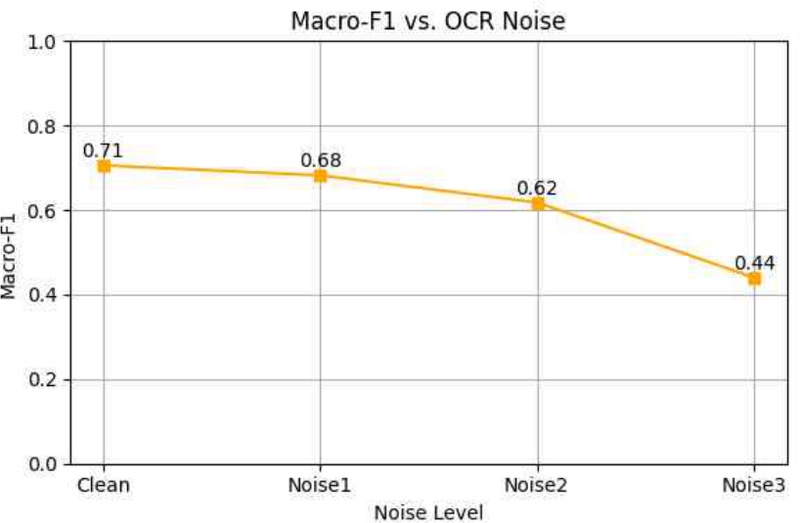

그림 2는 동일한 조건에서 측정된 Macro-F1 Score 변화를 나타낸다. Clean 데이터셋의 Macro-F1은 0.71로 측정되었으며, Noise1(0.68), Noise2(0.62), Noise3(0.44) 순으로 하락하였다. Macro-F1 Score의 감소폭은 Accuracy보다 전반적으로 크게 나타났는데, 이는 클래스 간 데이터 불균형 상황에서 특정 유형 문항의 성능 저하가 평균 성능에 더 직접적으로 반영되었기 때문이다. 이러한 경향은 OCR 품질 저하가 분절·토큰화·구문 해석 등 후속 태스크 전반의 성능을 약화시키고, BERT 표현 자체의 안정성에도 부정적 영향을 준다.

표 1은 지표를 종합한 결과다. ΔAcc는 이전 단계 대비 변화량으로 Clean→Noise1 (−0.02p), Noise1→Noise2 (−0.04p), Noise2→Noise3 (−0.10p), 고강도 구간에서 비선형적(가파른) 성능 저하가 확인된다. 최종적으로 Noise3에서 Accuracy는 −0.16p, Macro-F1은 −0.27p(Clean 대비) 하락했다. 이는 실제 교육 현장에서 저품질 스캔/촬영본 관리(CER 관리·공백 복원·레이아웃 정규화)와 오류 보정 전처리, 나아가 노이즈 내성(robustness)을 고려한 모델 설계가 필수적임을 뒷받침한다. 다음 절 4.2에서는 이러한 전체 추세가 유형별 정밀도(Precision)와 재현율(Recall)이 어떻게 나타나는지 구체적으로 점검한다.

4-2 유형별 Precision·Recall

표 2는 OCR 노이즈 수준(Clean, Noise1, Noise2, Noise3)에 따른 문제 유형별 정밀도(Precision)와 재현율(Recall)의 변화를 제시한다. 정밀도(Precision)는 특정 유형으로 예측된 문항 중 실제 해당 유형에 속하는 비율을, 재현율(Recall)은 실제 해당 유형의 문항 중 올바르게 예측된 비율을 의미한다. 따라서 정밀도(Precision)는 분류 결과의 신뢰도를, 재현율(Recall)은 실제 문항 포착 능력을 보여준다.

어휘(Vocabulary) 유형의 정밀도(Precision)는Clean (0.56)에서Noise3(0.25)까지 급격히 감소하였다.이는 어휘 문항을 예측할 때 오분류되는 비율이 크게 증가했음을 알 수 있다. 재현율(Recall) 또한 Clean(0.83)에서 Noise3(0.33)으로 지속적으로 하락하여, 실제 어휘 문항을 올바르게 식별하는 능력이 점차 저하되었다. 어휘 유형의 경우 철자·형태 등 짧은 표면형 단서에 크게 의존하는 특성상, 문자 치환·공백 누락·단어 삭제와 같은 문자 수준 노이즈가 들어오면 단서가 직접 약화되어 정밀도(Precision)와 재현율(Recall)이 동시에 하락한다. 전체 유형 중 어휘 유형은 가장 큰 하락폭을 보여 OCR 노이즈 환경에 가장 취약한 유형으로 확인된다.

대화(Conversation) 유형의 정밀도(Precision)는 Clean (0.84)에서 Noise3(0.72)로 점진적 감소를 보였고 재현율(Recall)은 Clean(0.95)에서 Noise3(0.90)으로 안정적으로 유지되었다. 대화 문항은 발화 간 연결, 화행 표지 등 분산된 문맥 단서가 풍부하고사전학습 언어모델(PLM)인 BERT가 이러한 문맥 신호를 통합해 유형을 판별하기 때문에 재현율(Recall)이 견조하게 유지된다. 반면 선택지/지시문 일부 왜곡으로 정밀도(Precision) 저하가 누적된다.

독해(Reading) 유형의 정밀도(Precision)은 Clean(0.83)에서 Noise3(0.80)까지 거의 변동이 없었다. 즉, 독해 문항으로 예측된 항목은 대체로 정확하게 분류되었다. 반면 재현율(Recall)은 Clean(0.50)에서 Noise3(0.40)으로 소폭 감소하여, 실제 독해 문항 중 일부가 인식되지 못하는 경향을 보였다. 이는 긴 지문, 표·수식 등 복합 레이아웃과 3.1절의 입력 길이 제한(128 토큰)이 결합되면서 핵심 단서 일부가 모델 입력에서 절단·왜곡되어 전체 포착 능력 재현율(Recall)이 제한되는 양상을 보인다.

문법(Grammar) 유형의 정밀도(Precision)은 Clean(0.86)에서 Noise3(0.78)으로 완만히 감소하였다. 재현율(Recall) 또한 Clean(0.93)에서 Noise3(0.79)로 점진적 하락을 보였으나, 전반적으로 두 지표 모두 비교적 높은 수준을 유지하였다. 이는 형태·구문 표지 등 규칙적 패턴이 많아 전반적으로 견조하나, 고강도 노이즈에서는 핵심 표지 손실로 정밀도(Precision)와 재현율(Recall)을 동시에 저해하는 양상이 관찰된다.

결론적으로 OCR 노이즈는 유형별로 상이한 민감도를 보인다. 어휘는 정밀도(Precision)와 재현율(Recall) 모두에서 가장 큰 폭으로 하락해 가장 민감하며, 대화는 문맥 신호의 완충 효과로 상대적으로 안정적이다. 독해와 문법은 중간 수준의 민감도를 보이되, 독해는 정밀도(Precision) 유지–재현율(Recall) 저하라는 비대칭이 뚜렷하다. 이러한 결과는 문자 수준 변형이 언어모델 입력을 교란하고[15], 문맥 신호를 통합하는사전학습 언어모델(PLM)이 상대적으로 강건하나 입력 품질에 민감하다는 기존 관찰과도 부합한다[17]. 다음 절4.3에서는 혼동행렬을 통해 유형 간 주요 오분류 경로를 시각화하고, 상기 해석을 사례 수준에서 검증한다.

4-3 오/분류 행렬 분석

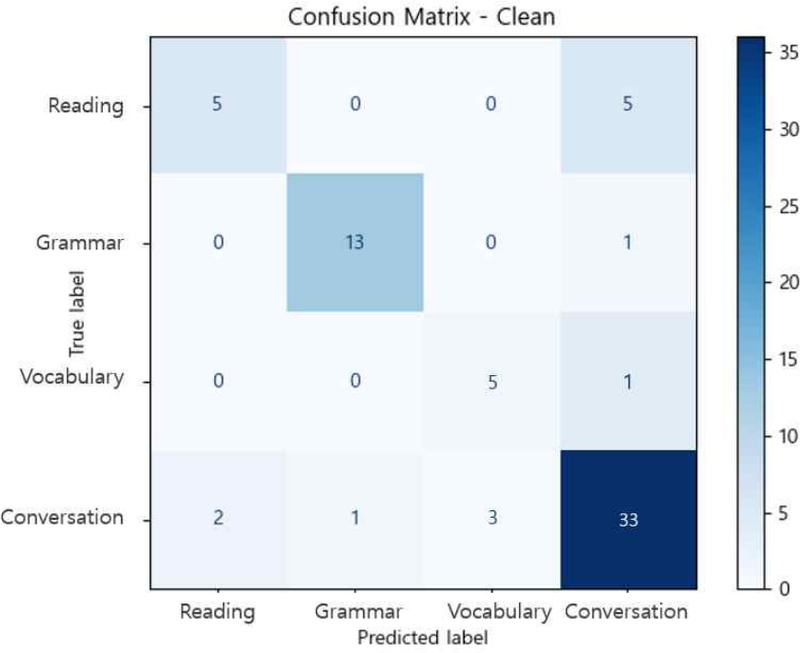

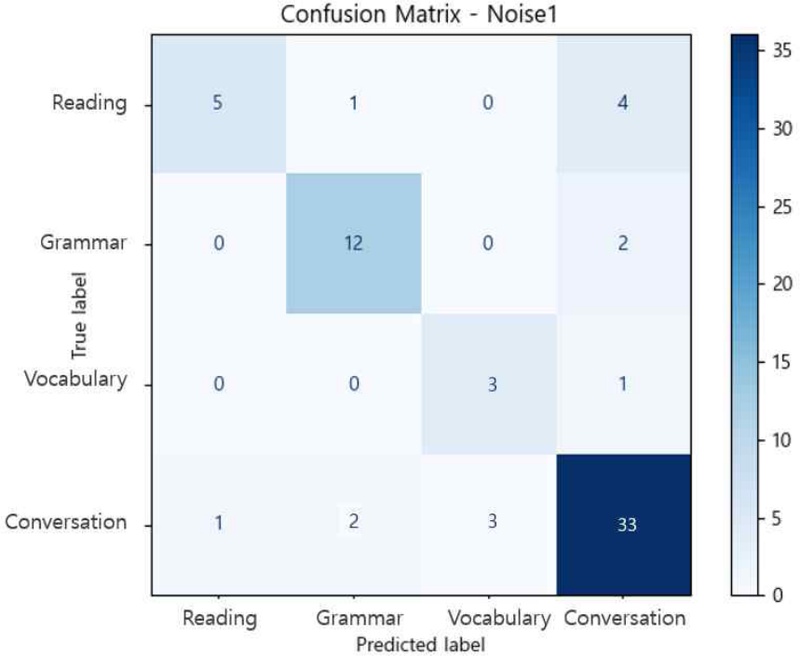

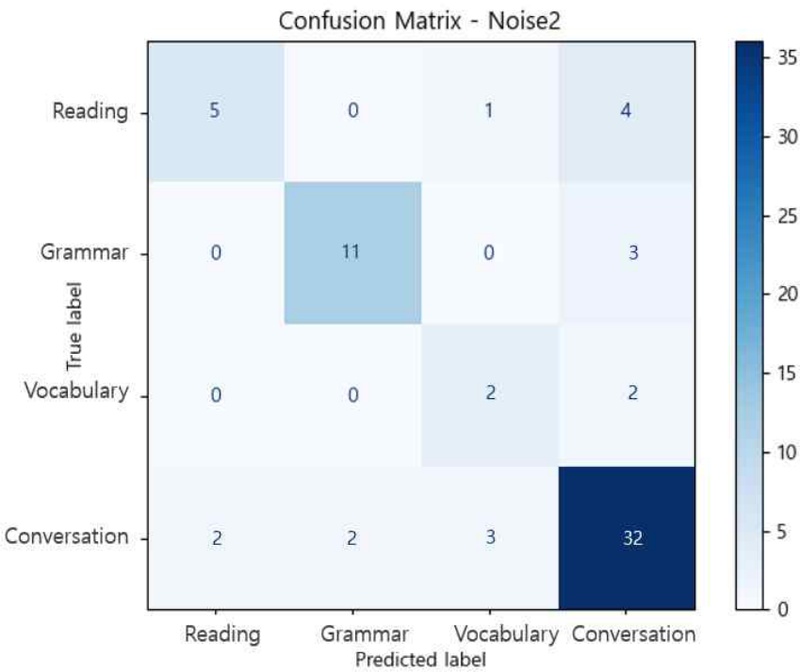

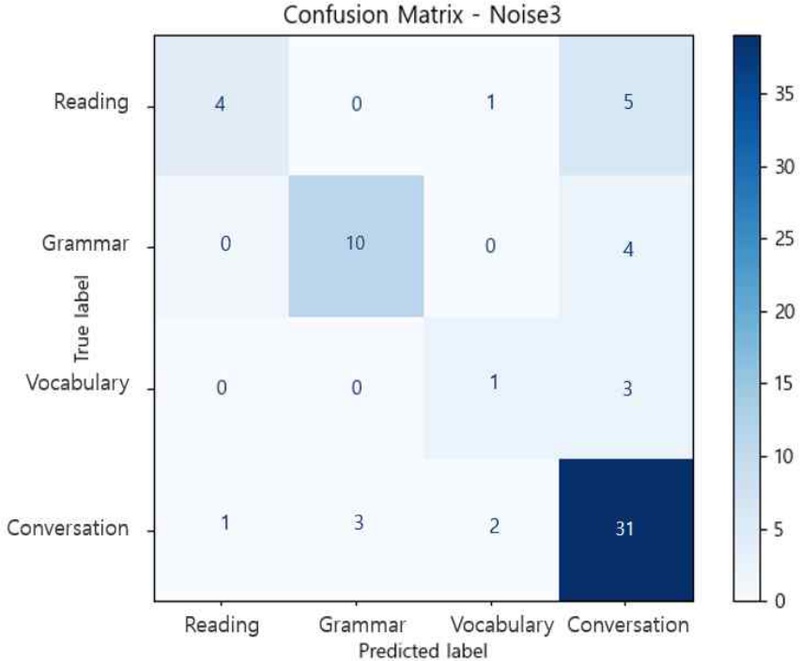

그림 3~6은 OCR 노이즈 수준(Clean, Noise1, Noise2, Noise3)에 따른 문제 유형별 혼동행렬(confusion matrix)을 나타낸다. 각 행은 실제 정답 레이블(True label), 각 열은 모델의 예측 레이블(Predicted label)을 의미한다. 행을 기준으로 해석하면 해당 유형의 재현율을, 열을 기준으로 보면 해당 예측 라벨의 정밀도를 파악할 수 있다. 또한 혼동행렬의 대각선 항목은 정분류(정확한 식별)를 나타내고 비대각선 항목은 오분류(어떤 유형을 무엇으로 잘못 보았는지)를 나타낸다. 대각선 값이 높을수록 해당 클래스의 분류 정확도가 높음을 보여준다. 아울러 네 가지 조건(Clean, Noise1, Noise2, Noise3)은 동일한 테스트 분할과 학습 설정에서 산출되었으므로, 노이즈 증가에 따라 어떤 혼동 축이 강화되는지를 단계적으로 비교할 수 있다.

그림 3은 노이즈가 없는 Clean 환경에서 전반적으로 안정적인 분류 양상을 보여주지만, 동시에 유형별로 상이한 혼동 경향도 확인된다.

먼저 대화(Conversation)는 정분류 비율이 가장 높아 네 유형 중 가장 명확하게 식별된다. 이는 발화 전환, 화행 표지, 인용부호·구두점 패턴 등 대화 특유의 문맥 단서가 풍부하여, 모델이 유형적 특성을 일관되게 포착한 결과로 해석된다. 문법(Grammar) 역시 비교적 안정적으로 분류되며, 형태소·기능어·어순과 같은 규칙적 형태·구문 표지가 기준선에서 신뢰할 만한 식별 단서로 작동한다. 반면 독해(Reading)는 대화와의 혼동 패턴이 눈에 띈다. 독해 지문에 대화체 표현이나 질의응답 구조가 포함될 경우, 모델이 담화 형태의 유사성에 반응해 대화로 예측하는 경향이 나타난다. 이는 4-2절에서 확인한 “정밀도는 유지되지만 재현율이 낮은” 독해의 특성과 맞물린다. 또한 어휘(Vocabulary)는 짧은 표면형 단서(철자·형태)에 대한 의존도가 높아, 지시문이나 선택지의 담화 표지가 상대적으로 도드라질 때 대화로 오분류되는 사례가 일부 관찰된다.

요약하면, Clean 환경에서 이미 두 개의 대표적 혼동 축이 형성된다: 독해(Reading)→대화(Conversation)(담화 형태 유사성)와 어휘(Vocabulary)→대화(Conversation)(표면형 단서 부족 시 담화 표지에 대한 편향)이다. 반대로 대화와 문법은 기준선에서 가장 견조한 유형으로 나타난다. 이 기본 패턴은 이후 노이즈가 도입될 때 어떤 오류가 확대될지에 대한 초기 지형을 제공하며, 4.2절의 결과인 대화의 높은 재현율, 독해의 낮은 재현율, 어휘의 전반적 취약성과 일관된 해석을 가능하게 한다.

그림 4는 Clean 환경에서 확인된 기본 패턴이 경미한 문자 치환과 공백 누락이 포함된 저강도 수준의 Noise 1 환경에서 어떻게 변형되는지를 보여준다. 이 환경에서는 전반적으로 정분류 비중은 유지되지만, 비대각선 오분류가 소폭 늘어나며, 주요 혼동 축이 드러나기 시작한다.

먼저 대화(Conversation)는 여전히 정분류 비율이 가장 높아 안정적인 유형으로 남는다. 다만 일부 대화 문항이 독해와 문법으로 오분류되어 비대각선 항목이 증가한다. 이는 공백 구두점·대소문자 손상으로 발화 경계 신호가 약화되면서, 짧은 서술문 묶음(독해)이나 규칙적 문장(문법)으로 재해석되기 때문이다. 다음으로 문법(Grammar)은 정분류와 정밀도가 감소하며, 소수의 문법 문항이 대화로 오분류된다. 간단한 예문 중심의 문법 문항은 공백·구두점 교란만으로도 담화체와 표면적으로 유사해 보일 수 있어, 대화 라벨로의 편향적 오분류가 관측되기 시작한다. 한편 독해(Reading)는 Clean에서 관찰된 독해(Reading)→대화(Conversation) 혼동 패턴이 그대로 지속된다. 독해 지문에 대화체 표현이나 질의응답 구조가 포함될 경우, 경미한 노이즈만으로도 문장 경계·담화 표지가 흐려져 대화로의 오분류 비율이 증가해 독해(Reading)→대화(Conversation) 혼동 축이 강화된다. 아울러, 일부 독해 문항은 문법으로도 오분류되어 보조 혼동 축이 병행해 나타난다. 이는 문장 단위 단서가 상대적으로 부각될 때 규칙 기반 해석이 개입한 결과로 볼 수 있다. 마지막으로 어휘(Vocabulary)는 대화로의 오분류가 계속된다. 특히, 철자 변화·부분 삭제로 핵심 표면형 단서가 약화되면서 모델이 주변 지시문/선택지의 담화를 더 크게 참조하게 되어 대화 라벨로 예측될 가능성이 높아진다.

요약하면, Noise1에서는 Clean에서 이미 관찰된 두 축은 독해(Reading)→대화(Conversation), 어휘(Vocabulary)→대화(Conversation) 점진적으로 강화된다. 또한 보조 축인 문법(Grammar)↔대화(Conversation)의 얕은 상호 혼동이 새롭게 확인된다. 결국, 초기 OCR 왜곡만으로도 담화 경계·분절 신호가 약화되고, 문자 수준 단서 손상으로 정밀도 저하와 재현율 저하가 동시에 진행될 기반이 형성된다.

그림 5는 Noise1에서 관찰된 비대각선 오분류 확산이 문자 치환과 공백 누락에 더해 부분 삭제가 포함된 중강도 수준의 Noise2 환경에서 한층 뚜렷하게 강화됨을 보여준다. 이 환경에서는 대각선 정분류 집중이 약화되고, Clean과 Noise1에서 확인된 주요 혼동 축의 오분류 빈도가 전반적으로 상승한다.

먼저 대화(Conversation)는 정분류 비중이 감소하며, 타 유형으로의 오분류가 늘어난다. 발화 경계·구두점·대소문자 교란이 누적되면서 대화 특유의 담화 표지가 희미해져, 그 결과 일부 문항이 짧은 서술문 묶음(독해) 혹은 규칙적 문장(문법)으로 재해석되기 쉬워지기 때문이다. 더 나아가, 단서가 단편 어구 수준으로 축소되면 어휘로의 오분류도 발생한다. 독해(Reading)는 여전히 대화로의 오분류가 이어지며, 일부 독해 문항은 어휘로도 오분류 된다. 긴 지문이 단편화 되거나 문장 경계가 흐려지면, 남은 짧은 단서가 담화형 신호로 잘못 해석되거나 표면형 어휘로 축소 인식되는 경향이 강해진다. 이로 인해 4.2절에서 확인한 정밀도 유지와 재현율 저하 패턴이 더욱 심화된다. 문법(Grammar)은 대화로의 오분류가 한층 두드러진다. 형태·구문 등 문법적 표식이 노이즈로 인해 훼손되면, 문장 규칙성이 약화되어 담화 중심 해석으로 흡수되기 쉽다. 그 결과, 문법 유형의 혼동행렬에서 정분류 대비 오분류 비중이 증가하고, Noise1 환경 대비 비대각선 항목의 분포가 넓게 확산된다. 한편 어휘(Vocabulary)는 대화로의 오분류가 지속적으로 관찰된다. 철자 변형·부분 삭제로 핵심 표면형 단서가 약화되면서 모델이 주변 지시문/선택지의 담화 신호에 더 의존하여 대화 라벨로 편향될 가능성이 높아진다.

요약하면, Noise2에서는 Clean과 Noise1 환경에서 이미관찰된 두 축인 독해(Reading)→대화(Conversation), 어휘(Vocabulary)→대화(Conversation)그리고 문법(Grammar)↔대화(Conversation)의 혼동 축이 동시에 강화된다. 이는 문장 경계·담화 표지의 약화와 표면형 단서의 소실이 결합하여, 의미적으로 인접한 유형 간 경계를 흐리게 만들기 때문이다. 결과적으로 4.1절에서 관찰된 정확도 하락과 Macro-F1 급락의 주요 원인이 오분류 분포의 확산임이 확인된다.

그림 6은 단어 삭제와 무작위 대소문자 변환까지 포함한 고강도 조건의 Noise3 환경에서 산출된 혼동행렬을 제시한다. 이 환경에서는 전 단계에서 관찰된 비대각선 항목의 분포가 비선형적으로 확대되며,문장 경계·구두점·대소문자 손상과 부분 삭제가 누적됨에 따라 유형 간 경계가 전반적으로 흐려진다.

먼저 대화(Conversation)는 네 유형 중 상대적으로 가장 견조하지만, 이전 단계 대비 정분류 비중이 감소하고 타유형으로의 오분류가 뚜렷해진다. 발화 표지와 문장 경계가 무너질수록 대화 고유의 담화 신호가 희석되어, 일부 대화 문항이 단편 어구 수준으로 인식되면서 어휘로 축소 분류되는 사례가 증가한다. 동시에 타유형 문항이 대화로 잘못 예측되는 역방향 오분류도 늘어나, 대화 유형의 정밀도와 재현율이 함께 낮아진다. 독해(Reading)는 대화로의 오분류가 가장 두드러진다. 이는 긴 지문이 단편화되고 구두점·접속 표지가 흐려지면서 일부 문장이 발화문처럼 인식되어 대화로 오분류 된다. 또한 일부 독해 문항은 문맥이 파편화되어 짧은 표면형 단서만 남는 결과, 어휘로 오분류 되기도한다. 이로써 4.2절에서 확인한 독해의 정밀도 유지와 재현율 저하라는 비대칭 패턴이 더욱 심화된다. 문법(Grammar)은 이전 단계 대비 정확도와 재현율이 추가로 하락한다. 형태·기능어·어순 등 문법 표지가 노이즈로 인해 약화되면서 규칙성이 희미해져 대화로의 오분류가 증가한다. 즉, 규칙 기반 문항이라도 표지 손상 시 문맥 중심 해석으로 전이되는 구조적 취약성이 드러난다. 어휘(Vocabulary)는 네 유형 중 정분류 비중과 정밀도가 최저로 나타난다. 짧고 독립적인 표면형이 치환·삭제에 취약하여 대화로의 오분류가 빈번하게 관찰된다. 그 결과, 어휘에서는 정분류 비중과 정밀도가 동시에 하락하는 전형적 취약 패턴이 재현된다.

종합하면, Noise3에서는 이전단계에서 이미 관찰된 두 주요 혼동 축 독해(Reading)→대화(Conversation), 어휘(Vocabulary)→대화(Conversation)이 강하게 확대되고, 문법(Grammar)↔대화(Conversation)의 보조 축도 뚜렷이 강화된다. 이러한 혼동 구조의 확산은 4.1절에서 관찰된 정확도 급락과 Macro-F1의 큰 하락을 직접적으로 설명한다.

Ⅴ. 결 론

본 연구는 중학교 영어 문항(대화·문법·독해·어휘) 500개를 대상으로, Clean–Noise1–Noise2–Noise3로 단계화한 OCR 노이즈 환경에서 BERT(klue/bert-base) 기반 문제 유형 분류기의 변화를 정량 평가했다. 그 결과, 정확도는 0.80→0.64, Macro-F1은 0.71→0.44로 하락했으며, 특히 Noise2→Noise3 구간에서 급격한 저하가 확인되었다(4.1절). 이는 인식 오류가 일정 임계를 넘어서면 토큰화와 문맥 해석이 급격히 불안정해질 수 있음을 시사한다.

유형별로 보면 어휘는 문자 수준 단서에 대한 의존도가 높아 정밀도·재현율이 모두 크게 감소했고, 대화는 풍부한 문맥 신호 덕분에 상대적으로 견고하게 되었다. 독해는 “정밀도 유지–재현율 저하”의 비대칭이 지속되었으며, 문법은 중간 수준의 안정성을 보였다(4.2절). 혼동행렬 분석에서는 독해→대화, 어휘→대화 기본 오분류 축으로, 노이즈가 강해질수록 문법↔대화의 보조 축이 확대되는 양상이 확인되었다(4.3절). 이 일관된 패턴은 교육 현장의 실제 스캔/촬영 조건에서 OCR 품질이 학습 지원 파이프라인 전반에 영향을 줄 수 있음을 실증적으로 보여주고 있다.

본 연구의 학술적 기여는 다음과 같다. (1) 교육 도메인에 특화된 다단계 CER 기반 노이즈 설계–평가 프로토콜을 제시해 일반 도메인 중심 논의를 보완했다. (2) 유형별 민감도 지도를 정량 지표와 혼동 구조로 함께 제시하여 후속 강건성 연구의 표적을 구체화했다. (3) 정확도와 함께 Macro-F1을 병기해 유형 불균형이 있는 교육 데이터에서 균형 성능을 평가하는 보고 관행을 제안했다.

이로써 실무적 함의도 분명하게 확인할 수 있다. 콘텐츠의 인입 단계에서는 CER 모니터링과 공백·대소문자 정규화, 부분 삭제 보정 같은 경량 전처리로 대표적 오분류 축을 완화할 수 있다. 모델 운용 단계에서는 노이즈 인식 데이터 증강, post-OCR 보정, 레이아웃·문장 경계 신호 보강을 적용해 고강도 노이즈 구간에서의 성능 하락을 완충할 수 있다. 배포·평가 단계에서는 본 연구와 유사한 다단계 노이즈 벤치마크를 표준 절차로 도입해 현장 성능의 하한선을 사전 점검하는 것이 바람직한 방식이다.

한편, 연구의 범위 제한도 있다. 표본 수가 500개로 제한되고, 노이즈가 합성 방식이며, 단일 PLM·고정 입력 길이(128 토큰)를 사용했다는 점에서 결과 해석의 일반화 가능성에 주의가 필요하다. 또한, OCR 엔진·기기·조명 조건에 따른 편차와 다언어·다문자 환경은 분석 대상에서 제외되었다. 이러한 제한은 결과 해석의 경계를 명확히 하면서, 동시에 후속 연구의 방향을 제시할 수 있다.

향후 연구에서는 (i) 다수 OCR 엔진·기기를 포함한 실측 파이프라인과 합성 노이즈를 병행하고, (ii) 유형별 사후 교정 사전과 레이아웃 인식을 접목한 전처리 체인을 비교 평가하며, (iii) 노이즈 인식 학습 전략을 체계화해 강건성을 정량 검증할 계획이다. 특히 이번 초기 단계(500개 표본)에서 확인한 가설과 오분류 축을 정교화하여, 5,000개 이상 표본으로 확장 검증하고 데이터–전처리–모델–평가를 통합한 노이즈-강건 파이프라인을 구축할 예정이다. 이를 통해 교육 도메인의 OCR-NLP 연계 시스템에서, 학술적으로는 강건성 평가의 준거 프레임을, 실무적으로는 문제은행·자동평가·개인화 추천 등 핵심 서비스의 신뢰 가능한 운용 기준을 제공하고자 한다.

Acknowledgments

본 연구는 과학기술정보통신부 및 정보통신기획평가원의 ‘메타버스 융합대학원’ 연구사업의 연구 결과로 수행되었음 (IITP-2025-RS-2024-00430997)

References

-

D. Deckker and S. Sumanasekara, “The Role of Artificial Intelligence in Education: Transforming Learning and Teaching,” EPRA International Journal of Research & Development (IJRD), Vol. 10, No. 3, pp. 5-15, March 2025.

[https://doi.org/10.36713/epra20429]

- Qanda. Official Service Description [Internet]. Available: http://qanda.ai, .

- Photomath. Official Website [Internet]. Available: https://photomath.com/, .

- Socratic by Google. Official Website [Internet]. Available: https://socratic.org/, .

-

Y. Huang and L. He, “Automatic Generation of Short Answer Questions for Reading Comprehension Assessment,” Natural Language Engineering, Vol. 22, No. 3, pp. 457-489, 2016.

[https://doi.org/10.1017/S1351324915000455]

-

N. T. Truong, H. T. Nguyen, N. T. Ly, T. Horie, and M. Nakagawa, “Content-Based Similarity For Automatic Scoring Of Handwritten Descriptive Answers,” in Proceedings of the 18th International Conference on Document Analysis and Recognition — ICDAR 2024, Athens: Greece, pp. 268-281, September 2024.

[https://doi.org/10.1007/978-3-031-70536-6_16]

-

A. Mathur, A. Pathare, P. Sharma, and S. Oak, “AI Based Reading System for Blind Using OCR,” in Proceedings of the 2019 3rd International Conference on Electronics, Communication and Aerospace Technology (ICECA), Coimbatore: India, pp. 39-42, June 2019.

[https://doi.org/10.1109/ICECA.2019.8822226]

-

A. Hamdi, E. L. Pontes, N. Sidère, M. Coustaty, and A. Doucet, “In-Depth Analysis of the Impact of OCR Errors on Named Entity Recognition and Linking,” Natural Language Engineering, Vol. 29, No. 2, pp. 425-448, 2023.

[https://doi.org/10.1017/S1351324922000110]

-

E. Boros, N. K. Nguyen, G. Lejeune, and A. Doucet, “Assessing the Impact of OCR Noise on Multilingual Event Detection over Digitised Documents,” International Journal on Digital Libraries, Vol. 23, pp. 241-266, September 2022.

[https://doi.org/10.1007/s00799-022-00325-2]

-

D. van Strien, K. Beelen, M. Coll Ardanuy, K. Hosseini, B. McGillivray, and G. Colavizza, “Assessing The Impact Of OCR Quality On Downstream NLP Tasks,” in Proceedings of the 12th International Conference on Agents and Artificial Intelligence (ICAART 2020), Valletta: Malta, pp. 484-496, 2020.

[https://doi.org/10.5220/0009169004840496]

-

K. Todorov and G. Colavizza, “An Assessment of the Impact of OCR Noise on Language Models,” in Proceedings of the 14th International Conference on Agents and Artificial Intelligence (ICAART 2022), pp. 674-683, 2022.

[https://doi.org/10.5220/0010945100003116]

-

R. Ferguson, “Learning Analytics: Drivers, Developments and Challenges,” International Journal of Technology Enhanced Learning, Vol. 4, No. 5/6, pp. 304-317, 2012.

[https://doi.org/10.1504/IJTEL.2012.051816]

-

G. Siemens, “Learning Analytics: The Emergence of a Discipline,” American Behavioral Scientist, Vol. 57, No. 10, pp. 1380-1400, 2013.

[https://doi.org/10.1177/0002764213498851]

- Y. Hu, M. Jiang, J. S. Downie, G. Worthey, R. C. Dubnicek, and T. Underwood, “Impact of OCR Quality on BERT Embeddings in the Domain Classification of Book Excerpts,” in Proceedings of CHR 2021: Computational Humanities Research Conference, Amsterdam: Netherlands, Vol. 2989, pp. 266-279, 2021.

-

D. Pruthi, B. Dhingra, and Z. C. Lipton, “Combating Adversarial Misspellings With Robust Word Recognition,” in Proceedings of the 57th Annual Meeting of the Association for Computational Linguistics (ACL 2019), Florence: Italy, pp. 5582-5591, July 2019.

[https://doi.org/10.18653/v1/P19-1561]

-

H. Gupta, L. Del Corro, S. Broscheit, J. Hoffart, and E. Brenner, “Unsupervised Multi-View Post-OCR Error Correction with Language Models,” in Proceedings of the 2021 Conference on Empirical Methods in Natural Language Processing (EMNLP 2021), Punta Cana: Dominican Republic (Online), pp. 8647-8652, November 2021.

[https://doi.org/10.18653/v1/2021.emnlp-main.680]

-

J. Devlin, M.-W. Chang, K. Lee, and K. Toutanova, “BERT: Pre-Training of Deep Bidirectional Transformers for Language Understanding,” in Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, Minneapolis: MN, pp. 4171-4186, June 2019.

[https://doi.org/10.18653/v1/N19-1423]

-

S. Park, J. Moon, S. Kim, W. I. Cho, J. Han, J. Park, ... and K. Cho, “KLUE: Korean Language Understanding Evaluation,” arXiv:2105.09680, , 2021.

[https://doi.org/10.48550/arXiv.2105.09680]

저자소개

2025년~현 재: 숭실대학교 메타버스 문화콘텐츠학과 석사과정

※관심분야:자연어처리, 교육용 인공지능

1999년:KAIST 수학과 학사

2001년:KAIST 응용수학과 석사

2007년:KAIST 전산학과 박사

2013년~현 재: 숭실대 글로벌미디어학부 교수

※관심분야:강화학습, 금융 IT