엔트로피 기반의 레이어 적응형 어텐션을 활용한 화자 검증 프레임워크

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

사전 학습된 음성 트랜스포머(PST)는 화자 검증 성능을 크게 향상시켰으나, 기존 접근은 고정된 레이어 결합이나 연산 비용이 큰 보조 스트림에 의존하는 한계가 있다. 본 논문은 ALAF와 DBTA 두 모듈로 구성된 화자 적응형 검증 프레임워크를 제안한다. ALAF는 발화마다 PST 레이어별 중요도를 동적으로 조정하여 안정적인 특징 추출을 수행하고, DBTA는 이를 스펙트럼 기반 특징과 함께 dilated TDNN 블록 내에서 융합하여 효율적인 정보 교환과 고품질 화자 임베딩을 달성한다. 제안된 구조는VoxCeleb 벤치마크의 다양한 조건에서 일관된 성능 향상을 보였다.

Abstract

Pre-trained speech transformers (PSTs) have advanced speaker verification (SV); nonetheless, most systems fuse transformer layers with fixed heuristics and attach auxiliary spectral streams at a considerable cost. We introduce a fully adaptive SV model comprising two synergistic modules. The adaptive layer-aware front-end (ALAF) applies utterance-specific attention to PST layers, and an entropy term regularizes the attention to remain both selective and stable. Subsequently, the dual-branch temporal aggregator merges the adaptive layer-aware front-end features with filter banks through shared dilated time delay neural network blocks that incorporate Res2Net-style channel splits and squeeze–excitation, thus enabling bidirectional feature exchange. These design choices yield speaker embeddings that fuse hierarchical and spectral cues, thus delivering consistent gains on VoxCeleb benchmarks across diverse channels and durations.

Keywords:

Speaker Verification, Speech Transformer, Self-Supervised Learning, Layer Fusion, Feature Extraction키워드:

화자 검증, 음성 트랜스포머, 자기지도학습, 레이어 표현 융합, 특징 추출Ⅰ. 서 론

화자 검증(SV; Speaker Verification)은 음성 기반 인증, 개인화 서비스, 그리고 포렌식 분석과 같은 다양한 응용 분야에서 점차 핵심 기술로 부상하고 있다[1]. SV의 주요 과제는 서로 다른 음향 환경, 채널 왜곡, 그리고 발화 길이 변화에도 불구하고 화자 특성을 안정적으로 구분해 낼 수 있는 표현을 효과적으로 추출하는 것이다[2]. 이러한 표현을 보다 효율적이고 일반화 가능하게 학습하기 위한 접근으로, 자기 지도 학습(self-supervised learning)이 주목받고 있다[3]. 최근 자기 지도 학습의 발전에 따라, 대규모 비정형 음성 데이터를 기반으로 정교한 음향 표현을 학습하는 사전학습 음성 트랜스포머(PST; Pretrained Speech Transformer)가 SV 시스템의 강력한 특징 추출기(front-end)로 주목받고 있다. 그 예로, Wav2vec 2.0, HuBERT, WavLM과 같은 모델은 트랜스포머 레이어 전반에 걸쳐 레이어 별 표현을 제공하여, 도메인 간 일반화 성능에서도 우수한 성과를 보여주고 있다[4]-[6].

그러나 PST의 레이어 별 표현을 SV 파이프라인에 통합하는 연구는 아직 초기 단계이며, 대부분 정적인 결합 방식이나 휴리스틱에 기반한 전략에 의존하고 있다[7]. 예를 들어, 전체 레이어 출력을 단순 가중 평균하거나, 얕은 층과 깊은 층의 특징을 고정된 가중치로 조합하는 방식이 일반적이다[8]. 이러한 방식은 구현이 간단하다는 장점이 있으나, 발화에 따라 달라지는 화자 특성, 음소 정보, 또는 음향 조건의 변화에 유연하게 대응하지 못한다는 한계를 지닌다. 이러한 한계를 해결하기 위한 또 다른 시도로, PST의 레이어 별 은닉 표현과 전통적인 스펙트럼 특징(예: 필터뱅크)을 함께 활용하는 이중 스트림 구조가 제안되었다[9]. 그러나, 대부분 모델 파라미터 수가 30~50%가량 증가하고, 두 스트림 간 정보 흐름이 비대칭적이라는 한계를 가진다[10],[11]. 즉, 보조 특징들이 효과적으로 상호작용하지 못한 채 각기 별도로 처리되는 경우가 많다[12].

이러한 문제를 해결하기 위해, 본 논문에서는 두 개의 상호 보완적인 구성 요소로 이루어진 경량화되고 화자에 유연하게 대응하는 화자 검증 시스템을 제안한다. 첫 번째 구성 요소인 ALAF (Adaptive Layer-Aware Front-End) 모듈은 각 발화에 따라 트랜스포머 레이어 간 표현을 균일하게 사용하지 않고, 발화 특성에 따라 레이어 별로 다른 중요도를 학습적으로 부여하는 동적 레이어 가중화 메커니즘을 도입하며, 마지막 레이어에서 추출한 전역 요약 벡터를 기준으로 레이어 가중치를 산출한다. 또한, 어텐션 분포가 지나치게 편향되거나 균일해지는 현상을 방지하기 위해 엔트로피 기반 정규화 항을 도입해 학습의 안정성을 확보한다. 두 번째 구성 요소인 DBTA (Dual-Branch Temporal Aggregator) 모듈은, ALAF에서 추출한 프레임 수준의 트랜스포머 출력 특징과 필터뱅크 기반의 음향 특징 간에 정보를 자연스럽게 주고받을 수 있도록 설계되었다. 이를 위해, Res2Net 구조를 활용한 공유형 TDNN (Time Delay Neural Network) 안에 게이트 방식의 특징 삽입(gated feature injection) 기법을 적용하여 양방향 상호작용을 가능하게 했다[13]. 이러한 두 모듈은 서로 보완적으로 작용하여, 모델의 복잡도나 파라미터 수를 늘리지 않으면서도 보다 풍부하고 정교한 화자 임베딩을 생성할 수 있도록 돕는다.

따라서, 본 연구는 기존 화자 검증 시스템이 가지는 두 가지 핵심 한계인 발화별 적응성 부족과 음향 정보 간 비효율적인 결합 구조를 해결하고자 한다.

Ⅱ. 관련 연구

2-1 PST의 각 레이어 출력 융합 방식

기존 대부분의 SV 시스템은 모델의 레이어 별 표현을 단순가중 평균하여, 하나의 고정된 벡터로 만든 후, 이를 TDNN 또는 ECAPA와 같은 후단(Backend) 모델에 입력하는 방식을 따른다[14],[15]. 이 접근은 구현이 간단하다는 장점이 있지만, 이와 같은 정적인 평균 방식은 각 발화의 음향 조건이나 화자 특성의 다양성에 적응하지 못한다는 근본적인 한계가 있다[8].

이를 보완하려는 시도로, 트랜스포머 레이어을 얕은 층과 깊은 층으로 구분한 후, 각 그룹 간의 중요도를 학습하는 어텐션 융합 모듈과 ECAPA 기반의 이중 스트림 구조에 적용하였다[9]. 아울러, 사전학습 모델의 다층 표현을 효율적으로 통합하는 어텐션 기반 후단 (MHFA)이나, 사전학습 표현과 전통 음향 특징을 결합하는 효율적 통합 특징 기법과 같은 최신 연구도 제안되었다[16],[17]. 그러나 이 방식도 여전히 발화에 따라 동적으로 변화하는 입력 특성을 반영하지 못하며, 레이어 가중치가 고정된 구조로 유지된다는 점에서 유연성 부족의 문제가 남아 있다.

이러한 흐름 속에서, 화자별·발화별 특성에 따라 트랜스포머 레이어의 정보를 능동적으로 선택하고 가중치를 조절할 수 있는 적응적 레이어 출력 융합 방식이 필요하다는 연구적 요구가 제기되고 있다.

2-2 트랜스포머 기반 표현의 정규화 및 다중 입력 처리 방식

PST의 레이어 간 중요도를 학습적으로 결정하는 어텐션 기반 구조는, 정보 선택의 유연성을 확보해준다는 장점이 있다[15],[18]. 하지만 동시에 학습이 불안정해질 수 있다는 단점도 존재하는데 예를 들어, 특정 레이어만 집중적으로 선택되거나, 반대로 모든 레이어에 동일한 가중치가 분산되어 어텐션 분포가 무의미해지는 경우가 발생한다[19]. 이러한 문제를 해결하기 위해, 자연어 처리 분야에서는 어텐션 분포의 과도한 집중이나 분산을 억제하기 위한 엔트로피 기반 정규화 기법이 사용되고 있다[20]. 이는 어텐션 학습의 안정성과 표현의 다양성을 동시에 확보할 수 있는 장점이 있다. 그러나 이 정규화 기법은 아직 화자 검증을 위한 트랜스포머 레이어 선택 문제에까지는 본격적으로 적용된 사례가 없는 상황이다.

동시에, 트랜스포머 기반 표현만으로는 정보의 다양성과 정밀함을 충분히 확보하기 어렵다는 점이 부각되며, 보조적인 음향 특징과의 융합 필요성도 제기되어 왔다. 즉, 전통적인 음향 특징인 Mel Filter를 보조 음향 특징으로 사용하여 트랜스포머 출력과 함께 사용되는 이중 스트림 구조가 제안되어 왔다. 그 예로, Dual-Branch ECAPA (DBE)나 Dual-Stream(DS)-TDNN과 같은 시스템은 두 종류의 입력 스트림을 병렬적으로 처리하여 보완적 정보를 활용하고자 하지만, 이러한 방식은 모델 크기가 크게 증가하거나 두 스트림 간 정보가 단방향으로만 흘러 다양한 음향 정보를 효과적으로 활용하지 못하는 한계가 있다[9]. 이에 따라 트랜스포머 기반 표현과 전통적인 음향 특징 간의 정보를 상호 보완적으로 융합할 수 있으면서도, 시간축 정렬과 경계 효과를 안정적으로 처리할 수 있는 구조적 설계가 요구된다.

나아가, 이러한 복합 구조가 실용적인 SV 시스템으로 적용되기 위해서는 모델 전체의 경량성과 계산 효율성까지 함께 고려되어야 한다[1]. 단순히 표현력의 향상에 그치지 않고, 실제 응용 가능한 시스템 수준에서의 제약 조건을 충족시키는 방향으로 연구가 진화할 필요가 있다.

이처럼, PST 레이어 표현의 융합을 다룬 선행 연구들은 존재하나, 대부분은 발화별 변이에 적응하지 못하는 정적 가중 평균 방식이나, 적응적 어텐션 융합임에도 가중치 분포의 과집중·과분산을 억제하는 안정화 제어를 포함하지 않는 방식에 머무르고 있다[21]. 따라서 적응성과 안정성을 동시에 보장할 수 있는 통합적 설계가 여전히 필요하다.

Ⅲ. 방법론

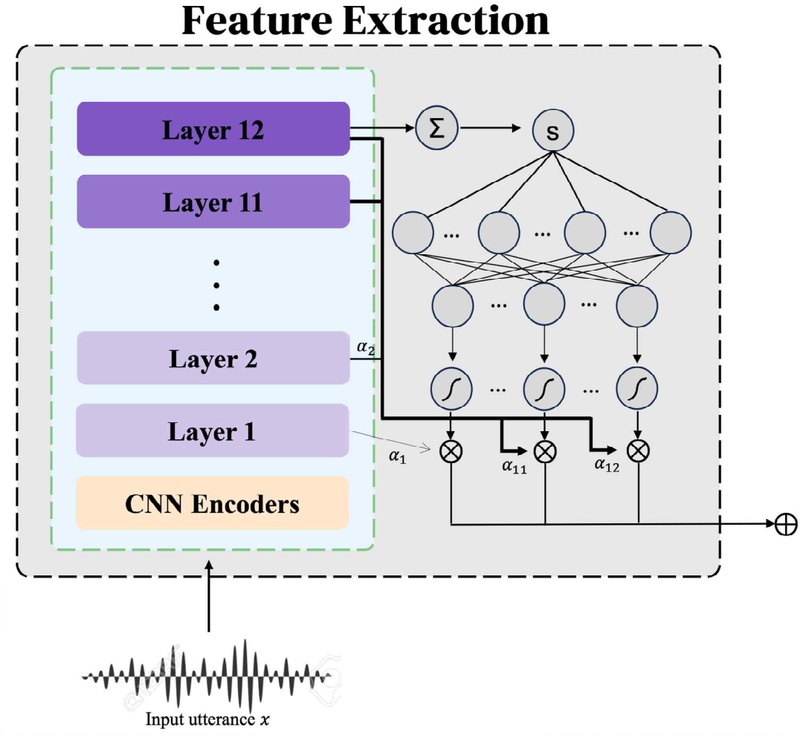

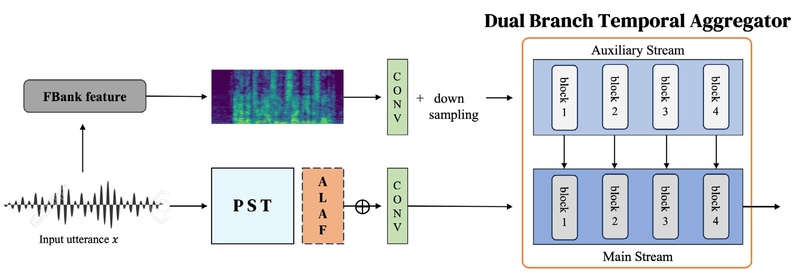

그림 1은 제안하는 전체 화자 검증 시스템의 아키텍처 구조를 도식화한 그림이다. 본 시스템은 두 개의 입력 스트림인 PST 기반 입력과 필터뱅크(FilterBank) 기반 입력을 병렬적으로 처리하며, 각 스트림은 독립적인 전처리 및 통합 모듈을 거쳐 시간 축 기반의 특징 통합기로 전달된다. 여기서 필터뱅크란, 음성 신호의 스펙트럼을 Mel 스케일 대역폭에 따라 분해한 후 에너지 값을 추출한 특징으로, 음성인식 및 화자 검증 시스템에서 널리 사용되는 대표적인 음향 특징이다. 그리고, PST 출력 경로에는 본 논문에서 새롭게 제안하는 ALAF (Adaptive Layer-Aware Front-End)모듈이 적용된다.

Overall architecture of the proposed speaker verification framework. FBank-based input stream; Bottom: PST + ALAF stream. Both branches are merged via DBTA to produce speaker embeddings

3-1 화자 정보 강조를 위한 Transformer 레이어 선택 모듈

화자의 입력 발화인 x는 16kHz로 샘플링된 raw waveform이며, 그대로 PST에 입력된다. 사용한 PST는 WavLM-Base의 구조를 따르며, 다음과 같은 세 가지 구성 요소를 갖는다.

- • 트랜스포머 레이어 수 L : 12

- • 은닉 차원(hidden dimension) C : 768

- • 상대적 위치 인코딩(relative position encoding)

이 모델은 레이어 별 은닉 표현 {h1, ..., h L}을 출력하며, 각 hL∈RT×C이다. 기존 방법들은 레이어 간 정보를 조합할 때 학습 가능한 고정 가중치를 사용하지만, 이는 발화에 따른 적응이 불가능하다는 한계를 지닌다.

그림 2는 본 연구에서 개발한 입력 발화에 따라 트랜스포머 레이어 별 출력을 동적으로 통합할 수 있는 ALAF 모듈의 구조이다. 이는 PST로부터 레이어 별 표현을 받아, 입력 발화 특성에 맞게 가중 결합하는 모듈이다.

ALAF 모듈은 마지막 레이어인 12번째 레이어의 출력을 기반으로, 시간 평균 풀링(temporal average pooling)을 적용하여 전역 요약 벡터(global summary vector) s를 생성한다. 이 벡터는 발화 전체의 정보를 요약한 형태로, 이후 레이어 가중치 계산의 기준으로 사용된다. 해당 과정은 다음 수식으로 표현된다:

| (1) |

이때, 마지막 레이어의 출력을 사용하는 이유는, WavLM의 마지막 레이어의 출력 h12는 중간 레이어에 비해 화자 특성 및 언어 정보를 보다 효과적으로 포착하기 때문이다[5].

이후 요약 벡터 s는 두 층으로 구성된 Feed forward 네트워크 g(⊙)를 통해 레이어 별 어텐션 가중치인 α로 변환된다.

| (2) |

여기서 g(⊙)는 ReLU (Rectified Linear Unit) 활성화를 포함한 두 개 의 선형 레이어로 구성된 경량화된 MLP (Multi Layer Perceptron) 구조이며, 은닉 표현 크기는 128로 설정된다. 계산된 어텐션 가중치는 발화 별로 달라지며, 이를 활용해 프레임 단위의 융합 표현 z(t)을 생성한다.

| (3) |

또한, 레이어 사이에 정보가 중복되거나 어텐션 분포가 과도하게 집중 또는 분산되는 현상을 방지하기 위해, ALAF 모듈에는 엔트로피 기반 정규화 항이 추가된다.

ALAF 모듈은 전체 설계에서 세 가지 핵심 요소를 바탕으로 표현력과 입력 적응성을 동시에 확보한다. 첫째, 입력 발화별로 PST의 레이어 중요도를 동적으로 조정하는 레이어 가중치 메커니즘을 통해, 다양한 발화 조건에 최적화된 정보 조합이 가능하다. 둘째, 어텐션 분포의 편향이나 과도한 분산을 방지하기 위해 엔트로피 기반의 정규화 항을 추가하여, 학습 안정성과 정보 다양성을 함께 확보한다. 셋째, 레이어 가중치를 계산하는 데 사용되는 MLP 구조는 매우 경량화되어 있어 전체 모델 복잡도에 거의 영향을 주지 않으면서도 효과적인 조절을 가능하게 한다.

3-2 레이어 어텐션 정규화

앞서 소개한 ALAF 모듈에서는 입력 발화에 따라 PST 레이어 간 상대적 중요도를 조절하는 동적 어텐션 가중치 벡터 α를 사용하였다. 이러한 유연한 가중치 조절 방식은 표현력을 향상시키는 데 기여하지만, 동시에 학습 과정에서 두 가지 측면에서 불안정성을 초래할 수 있다. 첫째, 모든 레이어에 유사한 가중치가 부여되면, 최종 출력이 단순 평균과 유사해져 선택적인 정보 융합의 효과가 사라진다. 둘째, 소수의 레이어에만 지나치게 가중치가 집중되면, 모델이 해당 레이어에 과적합되거나 나머지 레이어의 보완 정보를 충분히 활용하지 못할 수 있다. 이러한 문제를 완화하고, 실질적으로 선택적인 정보 융합이 가능하도록 유도하기 위해, 본 연구에서는 레이어 어텐션 정규화(Layer Attention Regularization) 기법을 도입하였다.

이 정규화 항은 다음과 같다.

| (4) |

여기서 λ는 정규화 강도를 조절하는 하이퍼파라미터이며, 0.001로 고정하여 사용하였다. 이 항은 보다 희소하면서도 균형 잡힌 레이어 선택을 유도하기 위해서 어텐션 분포 α에 엔트로피 기반의 제약 조건을 부여한다. 이 정규화 항은 분포가 지나치게 평탄하거나 특정 레이어에만 과도하게 집중되는 현상을 억제함으로써, 학습 과정에서 보다 선택적이고 정보 중심적인 레이어 융합을 가능하게 한다.

여기서, Lent > 0은 정규화 강도를 조절하는 하이퍼파라미터로, 레이어 선택 과정의 불확실성을 적절히 제한하는 역할을 한다. 다음으로, 전체 손실 함수에 포함되어 주요 분류 손실 값과 함께 최적화되며, PST의 파라미터가 갱신되는 두 번째 미세조정 단계에서만 적용된다. 이를 통해 학습의 안정성과 수렴 특성을 유지하면서도 효과적인 레이어 선택이 이루어질 수 있도록 한다.

3-3 2 Stage 화자 임베딩 분류 모듈

본 절에서는 ALAF 모듈에서 추출된 프레임 수준의 음향 표현과 기존의 스펙트럼 기반 음행 특징을 결합하여 화자 임베딩을 생성하는 DBTA (Dual-Branch Temporal Aggregation) 모듈을 제안한다. DBTA 모듈은 메인 스트림(main stream)과 보조 스트림(auxiliary stream)으로 구성되며, 병렬 구조를 기반으로 시간 정렬 후 두 경로 간의 정보가 순차적으로 결합된다.

먼저, 메인 스트림은 ALAF 모듈로부터 전달된 프레임 수준 특징 Z∈RTa×C,을 입력받아, 1×1 컨볼루션을 통해 채널 수를 C에 맞춰 투영한다. 이는 이후 병합 연산에서 차원 정합을 유지하기 위한 사전 처리 단계이다. 보조 스트림은 입력 음성을 바탕으로 추출된 필터뱅크 행렬 B∈RF×Tb를 입력으로 사용한다. 이 또한 동일한 1×1 컨볼루션 연산 통해 채널 수 C로 맞추며, 이후 시간 축 기준으로 스트라이드 2를 갖는 1D 컨볼루션을 수행하여 다운샘플링한다. 이 연산은 시간 해상도가 높은 스펙트럼 입력의 과도한 정보 밀도를 조절함과 동시에, 연산량을 절반 수준으로 줄여 계산 효율성을 확보하는 역할을 한다. 다만 다운샘플링으로 인해 메인 스트림과 보조 스트림 간 시퀀스 길이 Ta = Tb가 달라질 수 있다. 이를 해결하기 위해, 짧은 시퀀스에는 원형 패딩(circular padding)을 적용하여 두 시퀀스 길이를 동일하게 맞춘다. 원형 패딩은 시퀀스의 끝부분을 시작으로 되돌려 채워 넣는 방식으로, 일반적인 zero-padding에 비해 정보의 연속성을 유지하면서 손실을 방지할 수 있다.

정렬이 완료된 두 스트림은 이후 각각 4개의 팽창형 TDNN (dilated TDNN) 블록을 거치며, 시간 문맥을 확장하게 된다. 각 블록은 커널 크기 3을 사용하며, 팽창 계수는 {1, 2, 3, 1}로 설정된다. 이 블록들은 Res2Net 구조를 기반으로 채널 분할 연산을 수행하고, SE (Squeeze-and-Excitation)모듈을 결합하여 주파수 영역 정보의 선택적 증폭이 가능하도록 설계된다. SE 모듈은 전역 평균 풀링으로 채널 통계를 squeeze한 뒤, 게이팅(두 개의 FC와 시그모이드)으로 채중요도를 excite하여 채널별 특징을 재가중한다[22]. 따라서, k번째 블록의 출력은 각각 로 표현된다.

이후 두 스트림의 특징 맵을 FGU (Feature Gating Unit)를 통해 융합된다. FGU는 채널 공식 방식의 어텐션 모듈로, 입력된 두 스트림의 특징을 결합 및 합산한 후, 비선형 게이트 함수를 통해 보조 스트림의 보완 정보를 메인 스트림에 주입한다. 구체적으로, k번째 블록의 출력 과 를연결한 후 1D 컨볼루션과 시그모이드 함수를 통과시켜 게이팅 마스크 gk를 생성한다.

| (5) |

이 마스크를 활용해 보조 정보의 주입을 조절하며, 최종 출력 는 다음과 같이 계산된다.

| (6) |

이 구조는 정보의 단방향적 결합이 아니라, 데이터 기반으로 결정된 비율에 따라 양방향 특성을 융합함으로써 시간적-공간적 정밀도를 확보하여 s∈R2×3C을 생성한다. 첫 번째 TDNN 블록은 이 벡터를 차원 d=256의 화자 임베딩 e∈Rd으로 매핑한다.

4개의 TDNN 블록 중 두 번째, 세 번째, 네 번째 블록의 출력은 채널 방향으로 연결된 후, 평균 및 분산 기반의 통계적 풀링(mean-variance pooling)을 적용하여 시퀀스 독립적인 벡터 s∈R2×3C를 생성한다. k 번째 블록의 출력은 주로 저수준 특징을 포함하므로 제외된다. 마지막으로, 이 벡터는 Fully connected (FC)레이어을 통해 차원 d=256의 최종 화자 임베딩 e∈Rd으로 투영된다.

이처럼 DBTA 모듈은 PST의 고차원 음향 표현과 전통적인 스펙트럼 기반 특징을 하나의 통합된 프레임워크 내에서 상호보완적으로 융합함으로써, 다양한 음향 환경 및 도메인 변화에 강인한 화자 표현을 효과적으로 학습할 수 있도록 하였다.

V. 실험 설계

4-1 데이터 및 전처리

모든 학습과 평가는 NVIDIA H100 PCIe GPU에서 수행하였으며, 구현은 PyTorch 2.6.0 버전을 기반으로 진행하였다. 본 연구의 실험 설계는 WavLM 논문에서 제시된 화자 검증 실험 조건을 기준으로 최대한 일관되게 재현하는 것을 목표로 하였다. 학습에는 VoxCeleb2 데이터셋을 사용하며, 약 1,090,000개의 발화와 5,994명의 화자로 구성되어 있다[5],[23]. 평가는 VoxCeleb1 테스트 리스트에 기반하며, 환경 조건에 따라 세 가지 하위 평가 세트로 구분된다[24]: (1) 동일 채널 기반의 Vox1-O(original), (2) 서로 다른 채널 조합을 포함하는 Vox1-E(extended), (3) 발화 길이나 잡음 조건 등에서 높은 난이도를 가지는 Vox1-H(hard). 이 외에 정규화 목적의 S-Norm 코호트는 VoxCeleb2 dev에서 평가 화자와 겹치지 않도록 300개 발화를 무작위로 추출하여 구성하였다.

모든 오디오 입력은 16kHz 단일 채널(mono)로 리샘플링되며, 각 발화로부터 3초 길이의 음성 구간을 무작위로 잘라 사용한다. 만약 원본 파형 길이가 3초에 미치지 못할 경우, 신호의 마지막 부분을 앞부분으로 되돌려 감싸는 원형 래핑(circular wrapping) 방식으로 부족한 부분을 보완한다. 이는 시간 연속성을 유지하면서도 패딩으로 인한 정보 왜곡을 최소화하기 위한 처리 방식이다.

모델의 일반화 성능을 향상시키기 위해, 전체 데이터 중 약 60% 확률로 다양한 데이터 증강 기법을 적용하였다. 구체적으로는 다음 세 가지 중 하나를 무작위로 선택하여 적용한다:

(i) MUSAN 데이터셋으로부터 샘플링된 잡음을 0~20 dB SNR (Signal-to-Noise Ratio)범위 내에서 가산하는 가산 잡음 추가, (ii) 실제 방의 반향 특성을 모사한 RIR (Room Impulse Response)을 이용한 잔향 추가, (iii) 음성 속도를 0.9배 또는 1.1배로 변형하는 속도 왜곡 등이 적용된다. 이러한 증강 전략은 WavLM 실험 환경에서도 사용된 방식이며, 모델이 다양한 환경 조건에 견고하도록 학습되도록 한다.

전처리의 마지막 단계에서는, 증강이 적용된 파형을 25ms 프레임 크기와 10ms 홉 크기로 분할한 뒤, 80차원의 Mel-spectrogram으로 변환한다. 이후 로그 스케일로 변환하여 음성 에너지의 동적 범위를 조정하고, 스펙트럼 특징의 분포를 안정화시킨다. 이렇게 생성된 Mel-spectrogram은ALAF 및 DBTA 모듈의 입력으로 사용되며, 특히 DBTA에서는 보조 스트림의 초기 입력으로 활용되어 주파수 기반의 전통적인 음향 정보를 보완적으로 제공한다. 전술한 전처리 과정은 학습 중 실시간으로 처리된다.

4-2 평가 설정

평가 단계에서는 ALAF가 결합된 PST 프론트엔드와 DBTA Backend를 통해 각 시험 발화로부터 256차원 화자 임베딩을 추출한다. 연산 자원의 효율적 활용을 위해, 스펙트로그램 생성과 같은 전처리 작업은 GPU 대신 CPU에서 수행되며, 이는 GPU 메모리 점유를 최소화하고 추론 처리의 병렬성을 높이기 위함이다. 추출된 임베딩 간 유사도 평가는 코사인 유사도를 기반으로 수행되며, 이후 신뢰도 보정을 위해 적응형 대칭 정규화(adaptive symmetric score normalization, S-Norm)가 적용된다. S-Norm에는 학습 데이터로부터 추출한 300개 발화로 구성된 코호트가 사용되며, 평가 화자와의 중복은 배제하였다.

성능 평가는 화자 검증 분야의 표준 지표인 EER (Equal Error Rate)과 MinDCF (minimum Detection Cost Function)을 기준으로 수행된다. EER은 False Acceptance Rate와 False Rejection Rate가 일치하는 시점의 오류율로, 시스템의 전반적인 균형 성능을 직관적으로 나타낸다. MinDCF는 실제 응용에서의 오류 비용을 반영한 정량적 지표로, 사전 확률과 오류 비용 조건 하에서 검출 비용의 최소값을 계산한다.

Ⅴ. 실험 결과

본 절에서는 먼저 표 1의 결과를 바탕으로 제안 기법의 성능 향상 폭과 그 요인을 분석한 뒤, 표 2를 통해 PST 모델 종류에 따른 성능 차이를 확인한다. 이를 통해 ALAF와 DBTA의 개별 기여도를 간접적으로 검증하고, WavLM 기반 설정의 타당성을 정량적으로 평가한다.

Effect of layer-fusion strategy and back-end classifier architecture on performance (WavLM-base front-end)

표 1은 제안한 ALAF + DBTA 시스템의 화자 검증 성능을 기존 접근 방식들과 비교한 결과를 보여준다. 비교 대상은 PST 모델로 WavLM을 사용하되, 레이어 융합 방식과 Backend 구조(ECAPA-TDNN 또는 단순 TDNN block 기반)를 달리한 시스템들이다. 평가는 VoxCeleb1의 세 가지 조건(Vox1-O, E, H)에서 EER(%) 및 MinDCF를 기준으로 수행되며, 두 지표 모두 낮을수록 우수한 성능을 의미한다.

5-1 주요 성능 비교

표 1은 동일한 PST 모델(WavLM Base)을 기반으로 다양한 레이어 융합 방식과 후단 분류기 구조를 적용했을 때의 성능을 비교한 결과이다. 제안한 ALAF + DBTA 프레임워크는 세 가지 평가 조건(VoxCeleb1-O, E, H) 모두에서 기존 시스템 대비 가장 우수한 성능을 나타냈으며, 특히 어려운 조건일수록 더욱 뚜렷한 성능 차이를 보였다.

이러한 두 모듈의 결합은 기존 시스템 대비 일관된 오류율 감소를 이끌며, 복잡한 음향 조건에서도 높은 분별력을 유지할 수 있음을 보여준다. 특히, 고정 융합 방식이나 단일 경로 기반 후단 구조로는 확보하기 어려운 표현 유연성과 적응성이 전체적인 성능 향상에 기여한 것으로 해석된다.

5-2 PST 모델 일반화 성능 검증 실험

표 2는 제안한 ALAF + DBTA 프레임워크의 일반화 성능을 검증하기 위해, 서로 다른 PST 모델을 Frontend로 설정한 ablation 실험을 수행한 결과이다. 실험에는 Wav2Vec2 Base, HuBERT Base 두 가지 모델을 사용하였으며, 각각 동일한 Backend 설정 하에서 “Weighted Sum + ECAPA-TDNN” 방식과 제안하는 “ALAF + DBTA” 방식을 비교하였다. 두 PST 모델 모두에서 ALAF + DBTA 구조는 기존 방식 대비 전 평가 조건에서 일관된 성능 향상을 보였다.

이와 같은 추세는 모든 데이터셋에서 동일한 경향을 보였으며, 이는 제안한 ALAF + DBTA 구조가 특정 PST 모델에 종속되지 않고 다양한 음향 표현에 대해 범용적으로 성능을 향상시킬 수 있음을 시사한다. ALAF는 발화 특성에 기반하여 레이어 별 정보를 가중 결합하고, DBTA는 다중 스트림의 시간 정보를 적응적으로 융합함으로써 다양한 환경 조건에서도 보다 정교하고 강인한 화자 표현을 가능하게 한다.

이러한 결과는 제안하는 방법론이 특정 화자 검증 모델에 상관없이 유연하게 결합이 가능하며, 실질적인 응용 환경에서도 널리 활용될 수 있는 실용적 이점을 가짐을 뒷받침한다.

Ⅵ. 결 론

본 논문에서는 트랜스포머 기반 화자 검증 시스템의 성능을 향상시키기 위한 새로운 경량 구조인 ALAF (Adaptive Layer-Aware Front-End)와 DBTA (Dual-Branch Temporal Aggregator)를 제안하였다. 기존 화자 검증 시스템은 고정된 레이어 융합 방식 및 비효율적인 정보 결합 구조에 의존하고 있어 발화 특성과 환경 변화에 충분히 적응하지 못한다는 한계를 갖고 있었던 반면, 본 연구의 프레임워크는 발화 특성에 따라 트랜스포머 레이어별 중요도를 동적으로 조절하고, 보조 음향 특징과의 상호작용을 유연하게 구성함으로써 보다 풍부하고 정교한 화자 임베딩을 생성할 수 있도록 설계되었다.

실험 결과, 제안한 ALAF + DBTA 구조는 WavLM, HuBERT, Wav2Vec2 등 다양한 PST 기반 시스템에 일관되게 적용 가능하며, 모든 평가 조건(VoxCeleb1-O, E, H)에서 기존 구조 대비 EER과 MinDCF를 안정적으로 감소시키는 성능 개선을 입증하였다. 특히 고정 가중치 방식이나 단일 스트림 구조가 성능 한계를 보이는 어려운 조건인 Vox1-H 데이터셋에서도 제안 방식은 상대적으로 높은 분별력과 견고성을 유지하였다.

또한 ablation 실험을 통해 ALAF 및 DBTA 각 모듈의 개별적 기여도를 정량적으로 확인하였으며, 두 모듈의 결합이 모델의 복잡도를 증가시키지 않으면서도 실질적인 성능 향상에 기여함을 확인하였다. 이는 제안 방식이 단지 실험적 성능 개선에 그치는 것이 아니라, 실제 응용 가능한 화자 검증 시스템으로서의 실용성과 확장성까지도 확보하고 있음을 의미한다.

향후 연구에서는 본 구조를 온라인 화자 인식 시나리오 또는 도메인 적응 환경에 적용하는 확장 가능성에 대해 탐색할 수 있으며, 경량 디바이스나 실시간 처리 조건에서도 효율적으로 동작할 수 있도록 연산 최적화에 대한 추가 연구도 병행될 예정이다.

Acknowledgments

본 연구는 2025년 강남대학교 교내연구비 지원에 의해 수행되었음

References

-

E. Variani, X. Lei, E. Mcdermott, I. L. Moreno, and J. González-Domínguez, “Deep Neural Networks for Small Footprint Text-Dependent Speaker Verification,” in Proceeding of IEEE International Conference Acoustics, Speech and Signal Processing(ICASSP), Florence: Italy, pp. 4052-4056, May 2014.

[https://doi.org/10.1109/ICASSP.2014.6854363]

-

S. Novoselov, G. Lavrentyeva, A. Avdeeva, V. Volokhov, N. Khmelev, A. Akulov, and P. Leonteva, “On the Robustness of Wav2vec 2.0 Based Speaker Recognition Systems,” in Proceeding of Interspeech, Dublin: Ireland, pp. 3177-3181, August 2023.

[https://doi.org/10.21437/Interspeech.2023-881]

- V. Miara. Self-Supervised Learning for Speaker Verification Seminar [Internet]. Available: https://www.lre.epita.fr/dload/seminar/2024-01-10.seminar.victor-miara.pdf, .

-

W.-N. Hsu, B. Bolte, Y.-H. H. Tsai, K. Lakhotia, R. Salakhutdinov, and A. Mohamed, “HuBERT: Self-Supervised Speech Representation Learning By Masked Prediction of Hidden Units,” IEEE/ACM Transactions on Audio, Speech, and Language Processing, Vol. 29, pp. 3451-3460, 2021.

[https://doi.org/10.1109/TASLP.2021.3122291]

-

S. Chen, C. Wang, Z. Chen, Y. Wu, S. Liu, and Z. Chen, “WavLM: Large-Scale Self-Supervised Pre-Training for Full-Stack Speech Processing,” IEEE Journal of Selected Topics in Signal Processing, Vol. 16, No. 6, pp. 1505-1518, 2022.

[https://doi.org/10.1109/JSTSP.2022.3188113]

-

B. Maji, R. Guha, A. Routray, S. Nasreen, and D. Majumdar, “Investigation of Layer-Wise Speech Representations in Self-Supervised Learning Models: A Cross-Lingual Study in Detecting Depression,” in Proceeding of Interspeech, Kos: Greece, pp. 3020-3024, September 2024.

[https://doi.org/10.21437/Interspeech.2024-1737]

-

J. S. Kim, H. J. Park, W. Shin, and S. W. Han, “Universal Pooling Method of Multi-Layer Features from Pretrained Models for Speaker Verification,” arXiv:2409.07770, , September 2024.

[https://doi.org/10.48550/arXiv.2409.07770]

-

S. Peng, W. Guo, H. Wu, Z. Li, and J. Zhang, “Fine-Tune Pre-Trained Models with Multi-Level Feature Fusion for Speaker Verification,” in Proceeding of Interspeech, Stockholm: Sweden, pp. 2110-2114, September 2024.

[https://doi.org/10.21437/Interspeech.2024-260]

-

J. Yao, C. Liang, Z. Peng, B. Zhang, and X.-L. Zhang, “Branch-ECAPA-TDNN: A Parallel Branch Architecture to Capture Local and Global Features for Speaker Verification,” in Proceeding of Interspeech, Dublin: Ireland, pp. 1943-1947, August 2023.

[https://doi.org/10.21437/Interspeech.2023-402]

-

Z. Aldeneh, T. Higuchi, J.-W. Jung, S. Seto, T. Likhomanenko, S. Shum, ... and B.-J. Theobald, “Can You Removea the Downstream Model for Speaker Recognition with Self-Supervised Speech Features?,” in Proceeding of Interspeech, Kos: Greece, September 2024.

[https://doi.org/10.21437/Interspeech.2024-1212]

-

M. Sang and J. H. L. Hansen, “Efficient Adapter Tuning of Pre-Trained Speech Models for Automatic Speaker Verification,” arXiv:2403.00293, , March 2024.

[https://doi.org/10.48550/arXiv.2403.00293]

-

S.-H. Gao, M.-M. Cheng, K. Zhao, X.-Y. Zhang, M.-H. Yang, and P. Torr, “Res2Net: A New Multi-Scale Backbone Architecture,” IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 43, No. 2, pp. 652-662, February 2021.

[https://doi.org/10.1109/TPAMI.2019.2938758]

-

Z. Fan, M. Li, S. Zhou, and B. Xu, “Exploring Wav2vec2.0 on Speaker Verification and Language Identification,” in Proceeding of Interspeech, Brno: Czech Republic, pp. 1509-1513, August-September 2021.

[https://doi.org/10.21437/Interspeech.2021-1280]

-

J. Peng, O. Plchot, T. Stafylakis, L. Mosner, L. Burget, and J. Cernocky, “An Attention-Based Backend Allowing Efficient Fine-Tuning of Transformer Models for Speaker Verification,” arXiv:2210.01273, , October 2022.

[https://doi.org/10.48550/arXiv.2210.01273]

-

F. Xie, D. Zhang, and C. Liu, “Global–Local Self-Attention Based Transformer for Speaker Verification,” Applied Sciences, Vol. 12, No. 19, 10154, October 2022.

[https://doi.org/10.3390/app121910154]

-

J. Peng, O. Plchot, T. Stafylakis, L. M. L. Burget, and J. Černocký, “An Attention-Based Backend Allowing Efficient Fine-Tuning of Transformer Models for Speaker Verification,” in Proceeding of the IEEE Spoken Language Technology Workshop (SLT), Doha: Qatar, pp. 555-562, January 2023.

[https://doi.org/10.1109/SLT54892.2023.10022775]

-

Y. Li, W. Guan, H. Huang, S. Miao, Q. Su, L. Li, and Q. Hong, “Efficient Integrated Features Based on Pre-Trained Models for Speaker Verification,” in Proceeding of Interspeech, Kos, Greece, pp. 2140-2144, September 2024.

[https://doi.org/10.21437/Interspeech.2024-1889]

-

S. Zhai, T. Likhomanenko, E. Littwin, D. Busbridge, J. Ramapuram, Y. Zhang, ... and J. M. Susskind, “Stabilizing Transformer Training by Preventing Attention Entropy Collapse,” in Proceeding of the 40th International Conference on Machine Learning(ICML), Honolulu: Hawaii, pp. 40770-40803, July 2023.

[https://doi.org/10.48550/arXiv.2303.06296]

-

G. Attanasio, D. Nozza, D. Hovy, and E. Baralis, “Entropy-Based Attention Regularization Frees Unintended Bias Mitigation from Lists,” in Proceeding of the Findings of the Association for Computational Linguistics: ACL 2022, Dublin: Ireland, pp. 1105-1119, May 2022.

[https://doi.org/10.48550/arXiv.2203.09192]

-

Y. Li, J. Gan, X. Lin, Y. Qiu, H. Zhan, and H. Tian, “DS-TDNN: Dual-Stream Time-Delay Neural Network with Global-Aware Filter for Speaker Verification,” IEEE/ACM Transactions on Audio, Speech, and Language Processing, Vol. 32, pp. 2814-2827, 2024.

[https://doi.org/10.1109/TASLP.2024.3352459]

-

G. M. Correia, V. Niculae, and A. F. T. Martins, “Adaptively Sparse Transformers,” in Proceedings of the 2019 Conference on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing (EMNLP-IJCNLP), Hong Kong: China, pp. 2174-2184, November 2019.

[https://doi.org/10.18653/v1/D19-1223]

-

J. Hu, L. Shen, and G. Sun, “Squeeze-and-Excitation Networks,” in Proceeding of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Salt Lake City: UT, pp. 7132-7141, June 2018.

[https://doi.org/10.1109/CVPR.2018.00745]

-

J. S. Chung, A. Nagrani, and A. Zisserman, “VoxCeleb2: Deep Speaker Recognition,” in Proceeding of Interspeech, Hyderabad: India, pp. 1086-1090, September 2018.

[https://doi.org/10.21437/Interspeech.2018-1929]

-

A. Nagrani, J. S. Chung, and A. Zisserman, “VoxCeleb: A Large-Scale Speaker Identification Dataset,” in Proceeding of Interspeech, Stockholm: Sweden, pp. 2616-2620, August 2017.

[https://doi.org/10.21437/Interspeech.2017-950]

저자소개

2021년~현 재: 강남대학교 인공지능융합공학부 학사과정

※관심분야:Speech Recognition, Multi-modal, LLM

2020년:KAIST 경영공학 (공학박사-IT경영)

2020년~현 재: 강남대학교 인공지능융합공학부 부교수

※관심분야:머신러닝 기반 의사결정, Multi-modal Learning