제조사별 담관 스텐트 분류를 위한 최적 딥러닝 모델 파인튜닝 전략

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

암 치료 성과 향상으로 환자 생존률이 증가함에 따라 담관 스텐트 재시술이 늘고 있다. 재시술 시 제조사별 스텐트 분류는 시술 계획에 영향을 주는 핵심 사안이다. 스텐트는 각 제조사에 따라 설계가 다양하여 환자에게 기삽입 스텐트 식별은 어려운 문제이다. 이를 위해 딥러닝 기반 분석이 활용되고 있으나, 신규 스텐트 설계가 지속적으로 도입되면서 매번 전면 재학습을 수행하기에는 시간·연산 비용이 과도하다. 본 연구는 담관 스텐트 이미지 분류를 대상으로 최적 파인튜닝 전략을 제안하고, 에폭 수와 입력 해상도를 핵심 변수로 실험을 수행하였다. 종합하면, EfficientNet-B0를 1024 해상도에서 200에폭으로 파인튜닝한 설정이 최적임을 나타낸다.

Abstract

Improvements in cancer therapy have increased patient survival, leading to a rise in biliary stent reinterventions. During reintervention, classifying the implanted stent by manufacturer is crucial for procedural planning. However, designs vary widely across vendors, making the identification of previously implanted stents challenging. Deep learning-based analyses are being adopted. However, the continued introduction of new stent designs makes each successive training prohibitively time consuming and computationally expensive. This study focuses on biliary stent image classification and proposes an optimal fine-tuning strategy. We conduct experiments that treat the number of training epochs and the input resolution as key variables. Taken together, the study's findings indicate that fine-tuning EfficientNet-B0 at 1024 input resolution for 200 epochs is the optimal configuration in practice.

Keywords:

Deep Learning, Computer Vision, Medical Image Analysis, Stent Image Classification, Fine-Tuning키워드:

딥러닝, 컴퓨터 비전, 의료 이미지 분석, 스텐트 이미지 분류, 파인튜닝Ⅰ. 서 론

자가팽창형 금속 스텐트는 담즙 배출 장애를 유발하는 담도 협착 문제를 해결하기 위해 임상적으로 사용된다[1]-[3]. 이때 사용하는 금속 스텐트는 각 제조사별로 구조 및 설계가 다양하며[4] 이에 따른 특징이 존재한다[5]-[7]. 실제 임상에서 시술 목적에 맞게 제조사별 스텐트를 다중으로 삽입하는 경우가 많고, 치료 기간의 연장으로 재시술 빈도도 증가하고 있다. 이에 따라 기존 삽입 스텐트의 정확한 식별은 시술 계획과 합병증 예방을 위해 필수적이나, 제조사별 디자인의 이질성으로 인해 시술 전 영상만으로 구분하기에는 실무상 제약이 존재한다.

최근 딥러닝 기술의 발전에 따라 합성곱 신경망(Convolutional Neural Network, CNN)[8]은 픽셀간의 지역적인 관계성을 모델링하여, 의료영상 분류·검출·분할 등 다양한 컴퓨터 비전 작업에서 우수한 성능을 보여 왔다[9]-[11]. 일부 연구에서는 OCT(Optical Coherence Tomography)영상에서 스텐트의 스트럿을 인식하는 작업을 수행하였다. 이는 딥러닝 기술을 기반으로 스텐트 이미지를 분석하는 것이 적용 가능함을 시사한다.

담관 스텐트 시술 전후에는 방사선 투시 또는 단순 방사선 영상 촬영이 진행되어 스텐트를 포함한 이미지 데이터가 확보된다. 이를 활용하여 제조사별 스텐트를 분류하는 과정을 임상 과정에 포함하게 되면, 시술과정에서 의료진의 의사결정에 도움이 된다. 이러한 프로세스에서 고려해야 하는 점은 실제 임상에서는 제조사들의 기술개발에 따라 신규 스텐트가 지속적으로 도입되기 때문에 모델의 주기적 갱신이 필요하다는 점이다. 매번 모델을 처음부터 재학습하게 되면 연산비용에 대한 부담이 존재한다. 의료 데이터는 외부 반출 규제가 매우 엄격하고 승인 절차도 장기간 소요되므로, 클라우드 등 외부 대규모 컴퓨팅 자원 활용이 사실상 제한된다. 이에 따라 내부 컴퓨팅 환경에서 학습을 수행해야 하며, 자원 제약을 고려해야 한다.

하지만 재학습 과정에 컴퓨팅 자원의 제약만 고려할 수는 없다. 담관 스텐트를 포함한 X-ray 이미지에서 스텐트가 차지하는 영역은 굉장히 작고, 명확하지 않아 의료분야 종사자가 아닌 경우 스텐트의 위치를 식별하는 것은 어렵다. 따라서 컴퓨팅 자원 제약에 따라 저해상도로 적은 에폭으로 학습할 경우 스텐트 인식 성능은 현저히 떨어질 것이다. 이러한 점에서 컴퓨팅 자원만을 고려하는 것이 아닌 담관 스텐트 이미지의 특성까지 고려한 재학습 전략이 필요하다.

본 연구는 전북대학교 연구팀이 구축한 제조사별 담관 스텐트 데이터셋을 기반으로, 신규 클래스가 순차적으로 추가되는 임상 시나리오를 가정하여 ResNet[12], EfficientNet[13], DeiT[14]를 활용한 파인튜닝 기반 재학습의 최적 전략을 탐색한다. 목표는 스텐트 인식 성능을 유지하면서 필요한 학습 횟수를 최소화하는 실용적 최적점을 규명하는 것이다. 이를 위해 데이터셋의 통계적 분포와 시각적 특성을 분석해 스텐트 인식에 결정적으로 작용하는 요인으로 입력 해상도를 설정하고, 동일한 해상도 조건에서 에폭 수를 체계적으로 조정하여 성능 변화를 비교한다. 또한 스텐트의 세부적인 정보의 양에 따른 성능 비교를 위해 입력 해상도를 단계적으로 변경하는 실험을 병행하여, 성능과 연산 비용 간의 균형을 정량적으로 평가한다.

본 논문의 구성은 다음과 같다. 2장에서는 의료영상 분야 딥러닝 및 스텐트 탐지 선행 연구를 정리하고, 3장에서는 사용한 데이터셋과 파인튜닝 전략을 기술한다. 4장에서는 제조사별 담관 스텐트 데이터셋 기반 파인튜닝 에폭별, 입력 이미지 해상도별 실험 비교·분석을 제시하며, 5장에서는 연구 결과를 종합하여 결론을 제시한다.

Ⅱ. 관련 연구

2-1 의료영상 분야 딥러닝 모델 연구

의료영상 분석 분야는 병변 검출·분할·분류·추적 등 핵심 과제를 해결하기 위해 합성곱 신경망(CNN)과 순환 신경망, 최근의 트랜스포머 구조까지 폭넓게 도입해 왔다. Shen et al.[15]은 AlexNet[16], VGG[17], GoogLeNet[18], ResNet, U‑Net[19], LSTM[20] 사례를 정리하며 영상 전처리 이후 병변 탐지·분할·추적이 단계적으로 고도화되고 있음을 보고하였다. 이어 ImageNet 사전학습 가중치를 활용해 완전 연결층만 파인튜닝하는 전이학습으로 암·망막질환·CT/MRI 분류에서 기존 머신러닝을 능가하는 85% 정확도를 달성한 사례가 소개되었다. 학습 데이터 부족 문제를 다룬 Kim et al.[21]은 회전·확대·CutMix[22]·GAN[23] 생성 등 증강 기법을 U‑Net, DenseNet[24], Inception‑v3[25] 등에 적용해 2~10% 정확도를 향상시킨 사례를 제시하였다. 또 Shinohara et al.[26]는 혈관 초음파 영상에서 U‑Net 기반모델의 이미지 분할로 혈관 벽·내막을 고정밀로 추출하였으며, Chen et al.[27]은 100편 이상의 연구를 분석해 ResNet, EfficientNet 기반 폐렴·뇌출혈 분류, nnU‑Net[28], TransUNet[29]·Swin‑UNet[30] 기반 장기·종양 분할, Faster R‑CNN[31]·YOLO[32]·RetinaNet[33] 기반 병변 검출, VoxelMorph[34] 기반 영상 등록 등의 최근 연구 방향을 정리하였다.

Kim et al.[35]은 유방·망막·피부·신경계 데이터를 대상으로 VGG, ResNet, DenseNet, EfficientNet을 ImageNet 초기화 후 파인튜닝하여 최대 20%의 정확도 향상을 확인하였다. Sistaninejhad et al.[36]은 폐렴·COVID‑19 사례에서 AlexNet부터 EfficientNet까지 비교해 90~98% 정확도를 기록하고, EfficientNet의 파라미터 효율을 강조하였다. Tang et al.[37]은 AlexNet이 일부 과제에서 ResNet 대비 짧은 학습 시간과 85~95% 성능을 동시에 달성한 사례를 제시했으며, Bamber et al.[38]은 얕은 5‑층 합성곱 신경망으로도 MRI 기반 알츠하이머 분류 정확도 96.75%를 달성해 경량 모델의 가능성을 보여주었다. 종합하면, 의료영상 딥러닝 연구는 전이학습·데이터 증강 전략을 결합해 성능을 지속적으로 향상시키고 있으며, 임상 적용 사례도 꾸준히 확대되고 있다.

2-2 딥러닝 기반 스텐트 탐지 연구

머신러닝 기술 이전 Guo et al.[39]은 관심영역, 시드포인트 탐지, 영역 확장 순으로 구성된 3단계 알고리즘으로 PCI이후 IVOCT영상에서 스텐트를 자동으로 탐지하는 연구를 진행하였다. 이는 슬라이스 단위로 89.3%의 accuracy와 86.5%의 sensivity 나타냈다. 이는 전통적인 신호처리 방법에 기반한 접근이다.

이후 의료영상에서 스텐트를 탐지하는데 머신러닝과 딥러닝 기술을 활용하는 다양한 연구가 제안되었다. Yang et al.[40]는 OCT(Optical Coherence Tomography)영상에서 스텐트를 인식하기 위한 ResNet과 U-Net 기반 딥러닝 모델을 제안하였다. ResNet이 이미지의 특징을 추출하는 인코더의 역할을 수행하고 U-Net기반의 디코더가 이를 복원하여 근접한 프레임간의 공간적인 유사성을 고려한다.

Jeon et al.[41]은 관상동맥 CT 조영 검사시, 초해상도를 적용하여 노이즈를 개선한 CT 이미지의 스텐트 구조 및 내강을 분석하였다. Gharaibeh et al.[42]은 석회화 관상동맥 OCT 영상 164건을 대상으로 랜덤 포레스트, 그래디언트 부스팅, 로지스틱 회귀 모델을 비교하여 스텐트 불충분 확장 예측의 가능성을 제시하였다.

Aldea et al.[43]은 관상동맥 OCT영상에서 스텐트의 유무를 자동으로 판단하기 위해 딥러닝 기반 이진 분류기를 설계하였다. 이는 전, 후처리 단계로 관상동맥 내강 분할에 결합한 파이프라으로 구현되었고, 슬라이스 단위에서 94% accuracy, 96.4% precision, 94%의 F1-score을 달성하였다.

기존의 스텐트 관련 딥러닝 연구는 대부분 CT·OCT 영상에서 스트럿을 검출·분할하는 데 집중되어 있어, 스텐트 설계가 바뀔 때마다 전체 모델을 다시 학습해야 하는 번거로움이 있다. 반면 유방암·망막병증·뇌질환 등 다른 의료영상 분류 분야에서는 합성곱 신경망, Transformer 백본을 소량 데이터에 파인튜닝해 일관된 고성능을 얻는 전략이 이미 자리 잡았고[35],[36],[38] OCT‑기반 스텐트 탐지에서도 90% 이상의 정밀도가 보고되었다[41],[42],[44]. 그러나 신규 스텐트가 지속적으로 추가될 때 최소한의 연산·시간 비용으로 모델을 갱신하는 파인튜닝 방법은 아직 제시된 바 없다. 본 연구는 이러한 점에서 스텐트 분류에 적합한 파인튜닝 방법을 찾고자 한다.

Ⅲ. 딥러닝 모델 기반 스텐트 데이터셋 파인튜닝

3-1 제조사별 담관 스텐트 데이터셋 분석

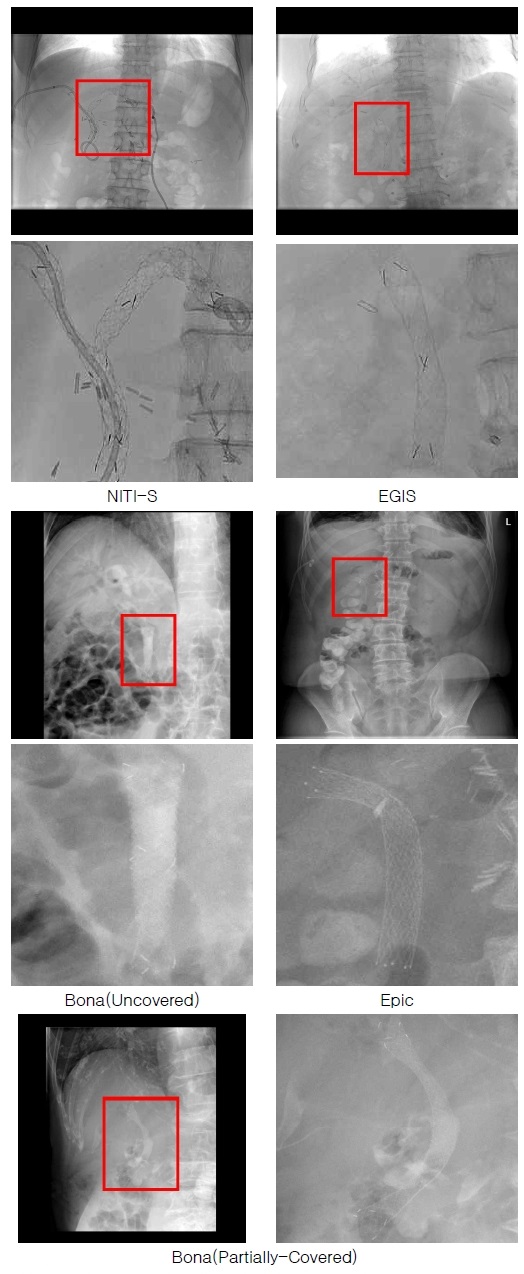

전북대학교 연구팀은 흉부 X‑ray 영상 중 담관 스텐트가 명확하게 포함된 프레임만 선별하여 전용 데이터셋을 구축하였다. 그림 1은 이 데이터셋에 포함된 Bona Uncovered, Bona Partially‑Covered, Epic, EGIS, NITI‑S의 다섯 제조사별 스텐트 이미지를 같은 시각화한 예시이다. 총 432장의 이미지가 확보되었으며, 클래스별 상세 수량은 표 1에 제시하였다. 데이터셋의 원본 해상도는 대다수 (1024,1024) 이상의 고해상도이다.

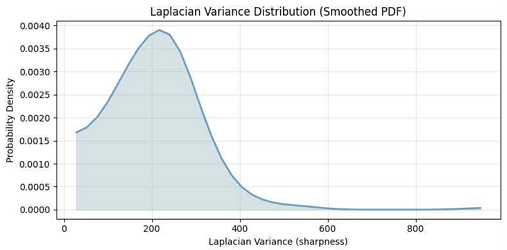

데이터 특성을 정량적으로 검토하기 위해, 각 영상에 2차 미분 필터인 라플라시안(∇2I) 을 합성곱 형태로 적용하여 얻은 응답 행렬의 분산(Variance of Laplacian)을 계산한 뒤, 이를 정규화 히스토그램으로 표현하고 Gaussian σ = 2로 평활화하여 그림 2에 나타냈다. 일반적인 자연 이미지나 고대비 CT 슬라이스는 라플라시안 분산이 500 이상까지 분포하는 데 반해, 본 연구의 X‑ray 스텐트 영상은 200 전후에 대부분의 값이 집중되어 있었다. 이는 스텐트 데이터셋의 경계와 질감의 고주파 성분이 상대적으로 약화된, 즉 전반적으로 블러가 존재하는 이미지임을 의미한다. 그림 1에서도 확인되듯 배경 장기 음영과 스텐트 메쉬가 겹치면서 윤곽선이 완전히 명확하지 않게 표현되는 것을 알 수 있다.

요약하면, 본 데이터셋은 제조사별 클래스가 균형 있게 구성되어 있고, 원본 해상도는 충분히 높으나, 라플라시안 분산 지표로 보았을 때 자연 사진 대비 상대적으로 흐릿한 경계를 가진 이미지가 주를 이룬다. 따라서 스텐트를 식별하고 이를 제조사별로 구분하는 것은 난이도가 높음을 알 수 있다.

3-2 담관 스텐트 이미지 분류 딥러닝 모델

담관 스텐트 이미지를 분류하기 위한 딥러닝 모델로 합성곱 신경망 계열의 EfficientNetB0, ReNet-50d을 활용하였다. 또한 Self-Attention을 기반으로 이미지 분류에 높은 성능을 보이는 transformer 계열 모델 중 DeiT를 사용했다. 사용한 각 모델의 학습 파라미터수는 표 2와 같다.

EfficientNet은 모델의 레이어수, 채널 수, 입력 데이터 사이즈를 적절하게 조합하여 최적의 스케일링을 통해 높은 성능을 나타낸 모델이다. 이 중 B0모델은 가장 경량 모델로 제한된 연산 자원 환경에서 사용하기 적절하다.

ResNet-50d는 잔차 연결 블록을 통해 초기 입력값의 그래디언트가 유실되지 않게 설계하여 이전의 합성곱 신경망의 레이어수의 한계를 끌어올린 모델이다. 이중 ResNet-50d 모델은 초기 합성곱 레이어의 커널 사이즈를 증대시켜 이전 ResNet 모델에 비해 더 큰 수용장(Receptive field)을 활용하여 학습한다.

DeiT모델은 transformer 기반의 모델로 ViT 구조를 기반으로 한다. ViT와의 차이점은 합성곱 신경망 대형 모델을 지식 증류하여 학습하여 기존의 ViT에 비해 성능이 크게 개선되었다는 점이다. 실험에서 사용한 DeiT-B 모델은 표준 모델로 컴퓨터 비전 다양한 분야에서 사용된다.

본 연구는 합성곱 신경망 기반의 모델과 transformer 아키텍쳐 모델 모두 실험에 활용하였다. 또한 표 2와 같이 초소형 모델부터 대형 모델까지 사용하여 모델 크기, 구조별 성능을 다각도로 검증할 수 있도록 비교군을 구성하였다.

3-3 담관 스텐트 이미지 분류에 적합한 파인튜닝 전략

일반적으로 컴퓨터 비전의 전이학습은 대용량 데이터셋에서 사전학습하고, 이를 특수한 도메인 데이터에 파인튜닝하는 과정을 거친다. 이때 파인튜닝 하는 방법은 모델의 전체 가중치를 재학습하거나, 이미지의 특징을 추출하는 레이어는 그대로 두고, 분류기만 클래스 수에 맞추어 학습하는 방법이 존재한다. 최근 LoRA[47]와 같은 기법은 가중치에 저차원 행렬을 더하여 딥러닝 모델을 효율적으로 학습하는 방법이 사용되기도 한다.

담관 스텐트와 같은 의료 분야에서도 특수한 영역의 데이터는 생성과정이 복잡하고, 이를 레이블링하는 과정은 전문 의료인력을 필요로 한다. 따라서 데이터 수량은 일반적인 이미지 분류 데이터셋에 비해 현저히 적다. 한정된 데이터 수량으로 최대의 성능을 달성하려면 모델 전체 가중치를 활용하여 파인튜닝하는 전이학습 방법론을 사용하는 것이 적절하다[48],[49].

하지만 모델 전체 가중치를 활용하여 파인튜닝하는 경우 학습 시간이 크게 소요되기 때문에 적절한 학습용 딥러닝 모델 선택과 이에 대한 학습횟수인 에폭의 설정이 필요하다. 새로운 담관 스텐트는 지속적으로 추가되기 때문에, 매번 모델 전체를 높은 학습횟수로 파인튜닝하면 시간적 비용과 연산자원이 낭비된다. 따라서 적절한 딥러닝 모델과 이에 대한 파인튜닝 학습 횟수를 정하는 것이 중요하다.

또한 담관 스텐트는 그림1과 같이 X-ray 이미지상에서 굉장히 작은 영역을 차지하며, 그림 2가 나타내는 바와 같이 이미지의 전반적인 흐림이 심하여 스텐트와 나머지 영역간의 명확한 구분이 어렵다. 이러한 특성을 가지는 데이터의 학습에서는 입력 이미지의 해상도가 중요한 역할을 한다. 다운 샘플링을 통해 낮은 해상도의 이미지를 딥러닝 모델의 입력으로 사용할 경우 이미지상에서 스텐트에 대한 정보가 더 줄어드므로 각 제조사별 담관 스텐트의 특징을 구분하는 것의 난이도가 더 높아진다. 하지만 고해상도 이미지를 그대로 입력으로 사용할 경우 전처리 과정에서 시간적인 비용이 낭비되고, 과도한 연산자원을 필요하게 되어 적절한 타협점이 필요하다.

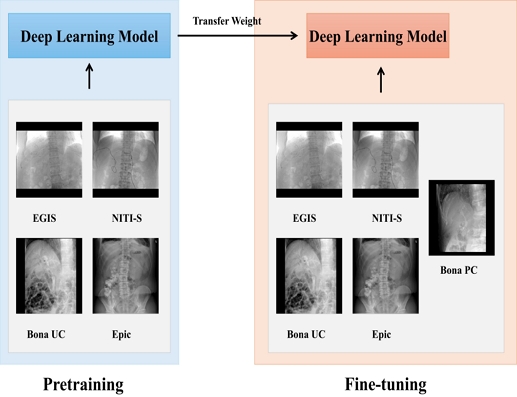

따라서 담관 스텐트 이미지 분류에서 고려해야 할 핵심 변수는 파인튜닝 에폭 수, 입력 해상도의 두 가지로 정리할 수 있다. 모델 선택은 표현력과 파라미터 규모에 따른 성능–연산량의 균형에 직접적인 영향을 주며, 에폭 수는 수렴 안정성과 과적합 위험, 학습 시간 사이의 트레이드오프를 좌우한다. 해상도는 스텐트의 미세 구조(와이어 패턴, 마커 등) 보존과 메모리·연산 비용을 동시에 결정하는 요소다. 각 변수의 세부 값은 예비 실험을 통해 탐색하였으며, 이에 따른 전체 파인튜닝 프로세스는 그림 3과 같다.

Ⅳ. 실험결과 및 분석

4-1 실험 환경 및 개요

실험의 목적은 신규 담관 스텐트가 추가되었을 때 이를 포함한 데이터셋을 최적으로 파인튜닝하는 딥러닝 모델, 학습 횟수 그리고 입력 이미지 해상도를 찾는 것이다.

사전학습은 본 논문의 실험 이전에 ImageNet -1k와 담관 스텐트 데이터셋(신규 클래스 미포함)에서 진행되었다. 본 논문의 실험은 신규 클래스인 Bona Partially-Covered가 포함된 제조사별 담관 스텐트 데이터셋에서 파인튜닝 전략을 검증한다. 모든 실험은 5-fold 교차 검증으로 진행되었으며, 표 5, 표 6, 표 7의 수치는 평균과 표준편차로 나타내었다. 각 fold별 데이터 수량은 표 4와 같다.

학습한 모델은 EfficientNetB0. ResNet -50d, DeiT-B 모델이다. 학습과 관련된 구체적인 설정은 표 3과 같다. 모든 모델의 학습 및 추론은 Nvidia-A100 단일 GPU에서 진행되었다.

파인튜닝 학습 에폭은 200, 300, 400, 500으로 비교하여 실험하였다. 입력 이미지의 해상도는 (224,224), (512,512), (1024,1024), (1536,1536)으로 비교하였다.

4-2 분류 성능 평가 방법

본 연구에서는 모델의 분류 성능을 정량화하기 위해 Accuracy, Precision, Recall, 그리고 F1‑score 네 가지 지표를 사용하였다. 분류 결과는 네 가지 경우로 구분된다. 먼저 True Positive(TP)는 실제 양성 표본을 모델이 양성으로 올바르게 판단한 경우이며, True Negative(TN)는 실제 음성을 음성으로 맞히는 상황을 의미한다. 반대로 False Positive(FP)는 음성 표본을 잘못해 양성으로 예측한 경우, False Negative(FN)는 양성 표본을 음성으로 놓친 경우에 해당한다.

Accuracy는 전체 예측 건수 가운데 TP와 TN, 즉 정답으로 간주되는 케이스가 차지하는 비율로 정의된다. Precision은 모델이 양성이라 판정한 표본 중 실제로 양성인 비율을 나타내며, Recall은 실제 양성 표본 가운데 모델이 양성으로 잡아낸 비율을 가리킨다. 두 지표는 상호 보완적이므로, 이를 하나의 값으로 요약하기 위해 조화 평균인 F1‑score를 사용하였다.

본 연구의 데이터는 제조사별 표본 수가 차이가 있어 단순 Accuracy만으로는 성능이 과대평가될 가능성이 있다. 이에 Precision과 Recall을 함께 제시하고, 두 지표의 조화 평균인 F1-score를 추가로 산출해 위양성·위음성으로 인한 임상적 위험을 균형 있게 반영하였다. 네 지표를 종합적으로 보고함으로써 모델의 스텐트분류 성능과 향후 개선 방향을 보다 명확히 평가하였다.

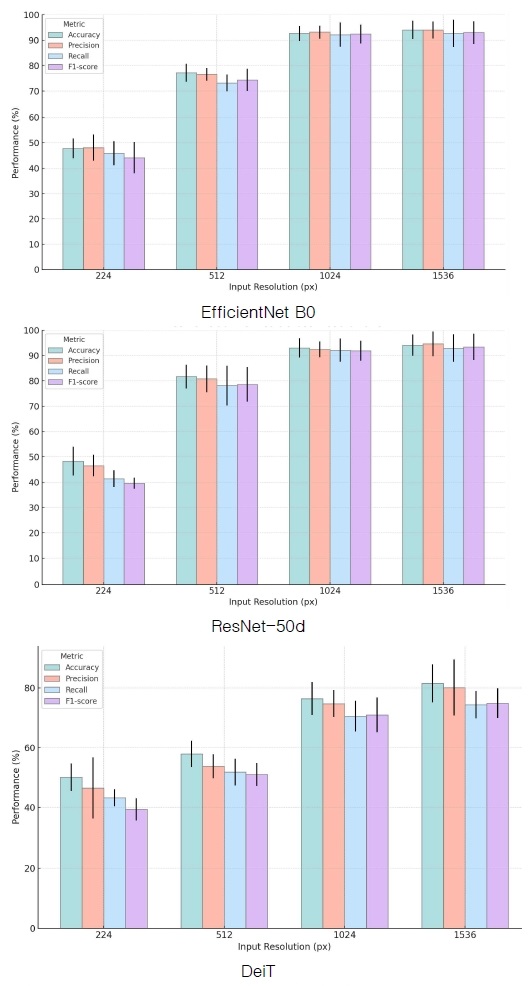

4-3 모델별 해상도 성능 비교

입력 이미지의 해상도에 따른 딥러닝 모델간의 성능을 비교하기 위해 실험을 진행했다. 모든 실험에서 사전학습한 모델 가중치를 로드하였다. 학습 에폭은 200으로 모두 동일하게 설정하였으며, 학습과 관련된 하이퍼파라미터는 모두 동일하게 사용하였다. 데이터셋은 대부분 (1024,1024)의 고해상도 이므로 이보다 낮은 해상도를 입력으로 사용할 때는 다운 샘플링하였고, (1536,1536) 해상도를 입력으로 설정할 때는 일부 이미지를 업샘플링하였다.

실험결과는 그림 4와 같으며 검은색 선은 표준편차를 나타낸다. 실험에 사용한 모델들은 사전학습 가중치를 사용하였음에도 불구하고, 입력 이미지의 가로, 세로가 224인 경우 정확도를 포함한 모든 지표가 50% 미만의 낮은 수치를 기록하였다. (512,512) 해상도에서는 EfficientNet, ResNet, DeiT 모델이 각각 77.20±3.48, 81.71±4.69, 57.87±4.41의 정확도를 나타냈으며, (1024,1024) 해상도에서는 92.66±2.94, 92.95±3.78, 76.43 ± 5.49, (1536,1536) 해상도에서는 94.01±3.55%, 94.09±4.19, 81.50±6.33의 정확도를 기록하였다.

(224,224) 해상도에서 (512,512)로 상승할 경우 모든 성능 지표는 급격하게 상승하였고, (1024,1024) 해상도보다 커질 경우 소폭 상승하는 것으로 확인하였다.

성능 지표상 (1536,1536) 해상도를 사용하는 것이 가장 적절하다. 하지만 이는 초고해상도 이미지에 대한 전처리 과정과 이를 모델이 학습하는 시간적, 연산적 비용이 많이 소모되므로 성능 지표가 수렴하는 (1024,1024) 해상도를 선택하는 것이 적절하다고 볼 수 있다.

4-3 파인튜닝 학습횟수별 분류 성능 비교

신규 스텐트가 포함된 데이터셋에서 학습 횟수에 따른 성능지표를 모델별로 비교하였다. 공정한 비교를 위해 해상도는 모두 (1536,1536) 해상도로 설정하였고, 학습 하이퍼파라미터는 모두 동일하게 유지하였다. Efficientbetb0, ResNet-50d, DeiT 모델별 실험 결과는 각각 표 5, 표 6, 표 7과 같다.

먼저 모델별로 비교하였을 때 transformer 기반 모델인 DeiT는 가장 낮은 성능을 보였다. EfficientNet B0 모델은 가장 적은 학습 파라미터를 가지지만 DeiT에 비해 13.14% 높은 accuracy를 기록하며 가장 우수한 분류 성능 지표를 보였다.

이러한 실험결과는 학습 데이터의 특징에 기인한 것으로 해석한다. 실험에 사용한 제조사별 담관 스텐트 데이터셋은 432장의 소량이며, 각 스텐트를 구분하는 난이도는 매우 어렵다. 따라서 학습 과정에서 합성곱 필터를 활용하여 픽셀간의 지역적인 관계성을 모델링하는 합성곱 신경망 계열의 모델이 이미지를 Self-Attention 기반으로 전역적으로 학습하는 transformer 계열의 모델 보다 우수한 것으로 해석한다.

다음으로 에폭별로 비교하였을 때, 100 에폭과 200 에폭간의 accuracy 격차는 표 4, 표 5, 표 6에서 각각 +0.21%, +2.4%,+1.15%로 상승한다. 하지만 200, 300 에폭간의 accuracy 차이를 비교하면 ResNet과 EfficientNet의 경우 하락하고, DeiT는 소폭 상승한다. 이후 300, 400, 500 에폭과 200 에폭간의 차이는 EfficientNet(1.25%)을 제외하고 0.7% 이하의 작은 차이를 보인다. 따라서 각 에폭간의 성능 지표 비교 결과 200 에폭의 학습이 제조사별 담관 스텐트 분류 파인튜닝에 적절하다고 볼 수 있다.

4-4 Saliency map 결과 비교

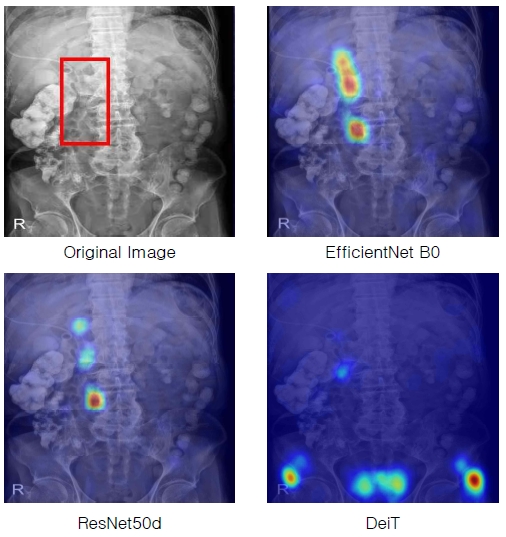

분류 성능의 정량적인 분석과 더불어 제조사별 스텐트 분류의 모델 판단근거를 시각화하기 위하여 Grad-CAM과 attention-map의 두가지 방법을 활용하였다. 그림 5는 EfficientNet, ResNet, DeiT 모델의 saliency map을 시각화한 결과이다.

시각화 결과 EfficientNet의 활성화 영역이 스텐트의 위치를 가장 정확하게 나타내는 것을 확인하였다. ResNet의 Grad-CAM 결과 또한 스텐트 영역에 활성화 되었다. 하지만 DeiT의 attention-map은 스텐트 영역을 나타내지 못한다. 시각화 결과는 각 딥러닝 모델의 분류 성능과 비슷한 경향성을 보인다. 이는 분류 모델의 판단 근거가 실제로 스텐트영역의 특징에 기반한다는 것으로 해석할 수 있다.

Ⅴ. 결 론

본 연구는 신규 스텐트가 지속적으로 추가되는 임상 환경에서 제조사별 담관 스텐트 분류 모델을 재학습하는 최적 파인튜닝 방법을 실험적으로 찾고자 하였다. 최근 항암 치료 발전으로 스텐트를 삽입후 재수술 하는 과정이 증가하였다. 이에 따라 사전에 삽입된 스텐트를 식별하는 것은 임상에서 중요한 문제로 부상하였다. 이에 따라 딥러닝 기술을 활용하여 스텐트를 식별하는 방법들이 연구되었다. 하지만 신규 디자인의 스텐트가 도입될때 마다 재학습하는 것은 많은 시간적, 연산적 비용을 낭비하기 때문에 최적의 파인튜닝 전략을 통해 효율적으로 재학습해야 하는 것이 필요하다.

데이터셋에 대한 분석을 통해 파인튜닝 에폭과 더불어 해상도를 중요한 요소로 고려하여 실험을 진행하였다. 본 실험을 위한 데이터셋은 전북대학교 병원 연구팀이 수집하였다. 데이터셋은 432장의 제조사별 담관 스텐트 이미지로 구성되어있고 총 5개 클래스가 있다. EfficientNetB0, ResNet-50d, DeiT모델을 베이스라인으로 실험하였다.

1) 해상도 실험결과, (1536,1536)이 가장 높은 성능 지표를 나타냈으나, 연산 자원을 많이 필요로 하기 때문에 (1024,1024) 해상도로 설정하는 것이 적절한 것으로 확인했다.

2) 모델 분류 성능 지표 결과 EfficientNetB0가 가장 적은 학습 파라미터만으로 95.36%의 가장 높은 accuracy를 보였으며, DeiT는 가장 많은 학습 파라미터를 사용하면서도 가장 낮은 82.20%의 accuracy를 나타냈다. 이는 합성곱 필터를 활용하여 픽셀간의 지역적인 관계성을 적절하게 모델링하는 CNN 계열 모델이 스텐트 분류에 적합함을 나타낸다.

3) 파인튜닝 에폭 비교 실험 결과 100 에폭에서 200 에폭으로 학습 횟수를 증가시키면 EfficientNet, Resnet, DeiT 의 accuracy가 각각 +0.21%, +2.4%, +1.15%로 상승하지만, 200 에폭에서 이후부터는 상승폭이 미미한 것으로 확인하였다. 이를 200 에폭으로 학습하는 것이 가장 효율적인 것으로 해석한다.

본 연구는 제조사별 담관 스텐트 이미지의 파인튜닝을 진행하는 경우 EfficientNet B0 모델이 가장 높은 성능을 나타냄을 확인하였고, (1024,1024) 해상도로 200 에폭동안 학습하는 것이 가장 효율적임을 확인하였다. 이를 통해 추후 실제 임상에서 다양한 담관 스텐트 설계가 도입되어도 최적의 재학습이 가능할 것으로 기대한다.

Acknowledgments

본 연구는 보건복지부의 재원으로 한국보건산업진흥원의 보건의료기술연구개발사업 지원(과제고유번호: RS-2025-19252970,50)과 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원-지역지능화혁신인재양성사업의 지원(IITP-2025-RS-2022-00156287,50)과 광주광역시가 공동 지원한 ‘인공지능 중심 산업융합 집적단지 조성사업’으로 지원을 받아 수행된 연구 결과임.

References

-

J. Lammer, K. A. Hausegger, F. Flückiger, F. W. Winkelbauer, R. Wildling, G. E. Klein, ... and L. Havelec, “Common Bile Duct Obstruction Due to Malignancy: Treatment with Plastic versus Metal Stents,” Journal of Radiology, Vol. 201, No. 1, pp. 167-172, 1996.

[https://doi.org/10.1148/radiology.201.1.8816539]

-

B. H. Lee, D. H. Choe, J. H. Lee, K. H. Kim, and S. Y.Chin, “Metallic Stents in Malignant Biliary Obstruction: Prospective Long-Term Clinical Results,” AJR. American Journal of Ronetgenology, Vol. 168, No. 3, pp. 741-745, 1997.

[https://doi.org/10.2214/ajr.168.3.9057527]

-

A. A. Indar, D. N. Lobo, A. D. Gilliam, R. Gregson, I. Davidson, S. Whittaker, ... and I. J. Beckingham, “Percutaneous Biliary Metal Wall Stenting in Malignant Obstructive Jaundice,” European Journal of Gastroenterology & Hepatology, Vol. 15, No. 8, pp. 915-919, 2003.

[https://doi.org/10.1097/00042737-200308000-00013]

-

H. Isayama, Y. Nakai, T. Itoi, I. Yasuda, H. Kawakami, S. Ryozawa, ... and K. Inui, “Clinical Practice Guidelines for Safe Performance of Endoscopic Ultrasound/Ultrasonography -Guided Biliary Drainage: 2018,” Journal of Hepato‐Biliary‐Pancreatic Sciences, Vol. 26, No. 7, pp. 249-269, 2019.

[https://doi.org/10.1002/jhbp.631]

-

Y. Nakai, T. Sato, R. Hakuta, K. Ishigaki, K. Saito, T. Saito, ... and K. Koike, “Long-Term Outcomes of a Long, Partially Covered Metal Stent for EUS-Guided Hepaticogastrostomy in Patients with Malignant Biliary Obstruction (with Video),” Gastrointestinal Endoscopy, Vol. 92, No. 3, pp. 623-631, 2020.

[https://doi.org/10.1016/j.gie.2020.03.3856]

-

Y. Nakai, H. Isayama, N. Yamamoto, S. Matsubara, Y. Ito, N. Sasahira, ... and K. Koike, “Safety and Effectiveness of a Long, Partially Covered Metal Stent for Endoscopic Ultrasound-Guided Hepaticogastrostomy in Patients with Malignant Biliary Obstruction,“ Endoscopy, Vol. 48, No. 12, pp. 1125-1128, 2016.

[https://doi.org/10.1055/s-0042-116595]

-

Y. Lecun, L. Bottou, Y. Bengio, and P. Haffner, “Gradient-Based Learning Applied to Document Recognition,” in Proceedings of the IEEE, Vol. 86, No. 11, pp. 2278-2324, 1998.

[https://doi.org/10.1109/5.726791]

-

Y. LeCun, Y. Bengio, and G. Hinton, “Deep Learning,” Nature, Vol. 521, pp. 436-444, 2015.

[https://doi.org/10.1038/nature14539]

-

A. Voulodimos, N. Doulamis, A. Doulamis, and E. Protopapadakis, “Deep Learning for Computer Vision: A Brief Review,” Computational Intelligence and Neuroscience, 2018.

[https://doi.org/10.1155/2018/7068349]

-

E. J. Topol, “High-Performance Medicine: The Convergence of Human and Artificial Intelligence,” Nature Medicine, Vol.25, pp.44-56, 2019.

[https://doi.org/10.1038/s41591-018-0300-7]

-

K. He, X. Zhang, S. Ren, and J. Sun, “Deep Residual Learning for Image Recognition,” in Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas: NV, pp. 770-778, 2016.

[https://doi.org/10.1109/CVPR.2016.90]

- M. Tan and Q. Le, “Efficientnet: Rethinking Model Scaling for Convolutional Neural Networks,” in Proceedings of the 36th International Conference on Machine Learning, 2019.

- A. Dosovitskiy, L. Beyer, A. Kolesnikov, D. Weissenborn, X. Zhai, T. Unterthiner, ... and N. Houlsby, “An Image Is Worth 16×16 Words: Transformers for Image Recognition at Scale,” in Proceedings of the International Conference on Learning Representations (ICLR), 2021.

-

D. Shen, G. Wu, and H.-I. Suk, “Deep Learning in Medical Image Analysis,” Annual Review of Biomedical Engineering, Vol. 19, pp. 221-248, 2017.

[https://doi.org/10.1146/annurev-bioeng-071516-044442]

- A. Krizhevsky, I. Sutskever, and G. E. Hinton, “ImageNet Classification with Deep Convolutional Neural Networks,” in Proceedings of Advances in Neural Information Processing Systems, Vol. 25, 2012.

-

K. Simonyan and A. Zisserman, “Very Deep Convolutional Networks for Large-Scale Image Recognition,” arXiv:1409.1556, , 2014.

[https://doi.org/10.48550/arXiv.1409.1556]

-

C. Szegedy, W. Liu, Y. Jia, P. Sermanet, S. Reed, D. Anguelov, ... and A. Rabinovich, “Going Deeper with Convolutions,” in Proceedings of 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Boston: MA, pp. 1-9, 2015.

[https://doi.org/10.1109/CVPR.2015.7298594]

-

O. Ronneberger, P. Fischer, and T. Brox, “U-Net: Convolutional Networks for Biomedical Image Segmentation.” in Proceedings of the 18th International Conference on Medical Image Computing and Computer-Assisted Intervention (MICCAI), Munich: Germany, pp. 234-241, 2015.

[https://doi.org/10.1007/978-3-319-24574-4_28]

-

S. Hochreiter and J. Schmidhuber, “Long Short-Term Memory,” Neural Computation, Vol. 9, No. 8, pp. 1735-1780, 1997.

[https://doi.org/10.1162/neco.1997.9.8.1735]

-

M. Kim and H.-J. Bae, “Data Augmentation Techniques for Deep Learning-Based Medical Image Analysis, Journal of the Korean Society of Radiology, Vol. 81, No. 6, pp.1290-1304, 2020.

[https://doi.org/10.3348/jksr.2020.0158]

-

S. Yun, D. Han, S. Chun, S. J. Oh, Y. Yoo, and J. Choe, “Cutmix: Regularization Strategy to Train Strong Classifiers with Localizable Features,” in Proceedings of the IEEE/CVF International Conference on Computer Vision, Seoul, pp. 6022-6031, 2019.

[https://doi.org/10.1109/ICCV.2019.00612]

-

I. Goodfellow, J. Pouget-Abadie, M. Mirza, B. Xu, D. Warde-Farley, S. Ozair, ... and Y. Bengio, “Generative Adversarial Networks,” Communications of the ACM, Vol. 63, No. 11, pp.139-144, 2020.

[https://doi.org/10.1145/3422622]

-

G. Huang, Z. Liu, L. Van Der Maaten, and K. Q. Weinberger, “Densely Connected Convolutional Networks,” in Proceeding of 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu: HI, pp. 2261-2269, 2017.

[https://doi.org/10.1109/CVPR.2017.243]

-

C. Szegedy, V. Vanhoucke, S. Ioffe, J. Shlens, and Z. Wojna, “Rethinking the Inception Architecture for Computer Vision,” in Proceeding of 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas: NV, pp. 2818-2826, 2016.

[https://doi.org/10.1109/CVPR.2016.308]

-

H. Shinohara, S. Kodera, K. Ninomiya, M. Nakamoto, S. Katsushika, A. Saito, ... and I. Komuro, “Automatic Detection of Vessel Structure by Deep Learning Using Intravascular Ultrasound Images of the Coronary Arteries,” PLoS One, Vol. 16, No. 8, 2021.

[https://doi.org/10.1371/journal.pone.0255577]

-

X. Chen, X. Wang, K. Zhang, K.-M. Fung, T. C. Thai, K. Moore, ... and Y. Qiu, “Recent Advances and Clinical Applications of Deep Learning in Medical Image Analysis,” Medical Image Analysis, Vol. 79, 102444, 2002.

[https://doi.org/10.1016/j.media.2022.102444]

-

F. Isensee, P. F. Jaeger, S. A. A. Kohl, J. Petersen, and K. H. Maier-Hein, “nnU-Net: A Self-Configuring Method for Deep Learning-Based Biomedical Image Segmentation,” Nature Methods, Vol. 18, pp. 203-211, 2021.

[https://doi.org/10.1038/s41592-020-01008-z]

-

J. Chen, Y. Lu, Q. Yu, X. Luo, E. Adeli, Y. Wang, ... and Y. Zhou, “TransUNet: Transformers Make Strong Encoders for Medical Image Segmentation,” arXiv:2102.04306, , 2021.

[https://doi.org/10.48550/arXiv.2102.04306]

- H. Cao, Y. Wang, J. Chen, D. Jiang, X. Zhang, Q. Tian, and M. Wang, “Swin UNet: UNet-Like Pure Transformer for Medical Image Segmentation,” in Proceedings of the Computer Vision (ECCV) Workshops, Tel Aviv: Israel, pp. 183-192, 2021.

- S. Ren, K. He, R. Girshick, and J. Sun, “Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks,” Neural Information Processing Systems, Vol. 28, pp. 91-99, 2015.

-

J. Redmon, S. Divvala, R. Girshick, and A. Farhadi, “You Only Look Once: Unified, Real-Time Object Detection,” in Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas: NV, pp. 779-788, 2016.

[https://doi.org/10.1109/CVPR.2016.91]

- T.-Y. Lin, P. Goyal, R. Girshick, K. He, and P. Dollár, “Focal Loss for Dense Object Detection,” in Proceedings of the IEEE International Conference on Computer Vision (ICCV), pp. 2980-2988, 2017.

-

G. Balakrishnan, A. Zhao, M. R. Sabuncu, J. Guttag, and A. V. Dalca, “VoxelMorph: A Learning Framework for Deformable Medical Image Registration,” IEEE Transactions on Medical Imaging, Vol. 38, No. 8, pp. 1788-1800, 2019

[https://doi.org/10.1109/TMI.2019.2897538]

-

H. E. Kim, A. Cosa-Linan, N. Santhanam, M. Jannesari, M. E. Maros, and T. Ganslandt, “Transfer Learning for Medical Image Classification: A Literature Review,” BMC Medical Imaging, Vol. 22, 69, 2022.

[https://doi.org/10.1186/s12880-022-00793-7]

-

B. Sistaninejhad, H. Rasi, and P. Nayeri, “A Review Paper about Deep Learning for Medical Image Analysis,” Computational and Mathematical Methods in Medicine, Vol. 2023, No. 1, 7091301, 2023.

[https://doi.org/10.1155/2023/7091301]

-

W. Tang, J. Sun, S. Wang, and Y. Zhang, “Review of AlexNet for Medical Image Classification,” arXiv:2311.08655, , 2023.

[https://doi.org/10.48550/arXiv.2311.08655]

-

S. S. Bamber and T. Vishvakarma, “Medical Image Classification for Alzheimer’s Using a Deep Learning Approach,” Journal of Engineering and Applied Science, Vol. 70, 54, 2023.

[https://doi.org/10.1186/s44147-023-00211-x]

-

Y. Guo, S. Ren, H. Jia, B. Yu, and F. Dong, “An Automatic Stent Detection for Intravascular Optical Coherence Tomographic,” in Proceeding of the 2020 39th Chinese Control Conference (CCC), Shenyang: China, pp. 2844-2849, 2020.

[https://doi.org/10.23919/CCC50068.2020.9189570]

-

G. Yang, E. Mehanna, C. Li, H. Zhu, C. He, F. Lu, ... and Z. Wang, “Stent Detection with Very Thick Tissue Coverage in Intravascular OCT,” Biomedical Optics Express, Vol. 12, No. 12, pp. 7500-7516, 2021.

[https://doi.org/10.1364/BOE.444336]

-

S.-H. Jeon, D.-H. Koh, P.-H. Jeon, S. M. Koh, and C. Otgonbaata, “Diagnostic Value of Coronary Stent Images Enhanced with an Ultra-High-Resolution Deep-Learning Algorithm During Coronary CT Angiography,” Journal of Korean Society of Computed Tomographic Technology, Vol. 26, No. 1, pp. 25-36.

[https://doi.org/10.31320/JKSCT.2024.26.1.25]

-

Y. Gharaibeh, J. Lee, V. N. Zimin, C. Kolluru, L. A. P. Dallan, G. T. R. Pereira, ... and D. L. Wilson, “Prediction of Stent Under-Expansion in Calcified Coronary Arteries Using Machine Learning on Intravascular Optical Coherence Tomography Images,” Journal of Scientific Reports, Vol. 13, 18110, 2023.

[https://doi.org/10.1038/s41598-023-44610-9]

-

G.-D. Aldea, D.-I. Stoian, A.-B. Gheorghiţă, L.-H. Onea, D.-M. Olinic, C. Homorodean, ... and L.-M. Itu “Deep Learning based Coronary Stent Detection and Residual Stenosis Assessment in Optical Coherence Tomography,” in Proceeding of the 2022 IEEE 20th International Power Electronics and Motion Control Conference (PEMC), Brasov: Romania, pp. 261-267, 2022.

[https://doi.org/10.1109/PEMC51159.2022.9962848]

-

J. Lee, J. N. Kim, Y. Gharaibeh, V. N. Zimin, L. A. P. Dallan, G. T. R. Pereira, ... and D. L. Wilson, “OCTOPUS–Optical Coherence Tomography Plaque and Stent Analysis Software,” Heliyon, Vol. 9, No. 2, 2023.

[https://doi.org/10.1016/j.heliyon.2023.e13396]

-

E. D. Cubuk, B. Zoph, J. Shlens, and Q. V. Le, “Randaugment: Practical Automated Data Augmentation with a Reduced Search Space,” in Proceedings of 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW), Seattle: WA, pp. 3008-3017, 2020.

[https://doi.org/10.1109/CVPRW50498.2020.00359]

-

H. Zhang, M. Cisse, Y. N. Dauphin, and D. Lopez-Paz, “Mixup: Beyond Empirical Risk Minimization.” arXiv:1710.09412, , 2017.

[https://doi.org/10.48550/arXiv.1710.09412]

-

E. J. Hu, Y. Shen, P. Wallis, Z. Allen-Zhu, Y. Li, S. Wang, ... and W. Chen, “Lora: Low-Rank Adaptation of Large Language Models,” arXiv:2106.09685, , 2021.

[https://doi.org/10.48550/arXiv.2106.09685]

-

C. Matsoukas, J. F. Haslum, M. Sorkhei, M. Söderberg, and K. Smith, “What Makes Transfer Learning Work for Medical Images: Feature Reuse & Other Factors,” in Proceedings of 2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), New Orleans: LA, pp. 9215-9224, 2022.

[https://doi.org/10.1109/CVPR52688.2022.00901]

-

M. Baharoon, W. Qureshi, J. Ouyang, Y. Xu, A. Aljouie, and W. Peng, “Evaluating General Purpose Vision Foundation Models for Medical Image Analysis: An Experimental Study of DINOv2 on Radiology Benchmarks,” arXiv:2312.02366, , 2023.

[https://doi.org/10.48550/arXiv.2312.02366]

저자소개

2022년:전남대학교 (공학사)

2025년:전남대학교 (공학석사)

2025년~현 재: 전남대학교 지능전자컴퓨터공학과 박사과정

※관심분야:딥러닝, 컴퓨터비전, 의료영상분석

2018년:전남대학교 대학원 (공학석사)

2023년:전남대학교 대학원 (공학박사)

2024년~현 재: 전남대학교산학협력단 박사후연구원

※관심분야:디지털 신호처리, 영상 처리, 머신러닝, 딥러닝

2025년:전남대학교 대학원 (공학석사)

2012년~현 재: ㈜필립스코리아

※관심분야:의료영상 분석, 의료인공지능

2022년:전북대학교 (의학사)

2023년:전북대학교 (의학석사)

2023년~현 재: 전북대학교병원 영상의학과 전공의

※관심분야:인터벤션영상의학, 심혈관영상의학

1987년:전북대학교 (의학사)

1990년:전북대학교 (의학석사)

2000년:원광대학교 (의학박사)

1991년~현 재: 전북대학교병원 영상의학과 교수

※관심분야:인터벤션영상의학, 심혈관영상의학

2018년:전남대학교 (공학사)

2025년:전남대학교 대학원 (공학박사 – 컴퓨터공학)

2025년~현 재: ㈜에이아이시드, 기업부설연구소, 연구소장

※관심분야:센서 시스템, 신호처리, 의생명공학, 딥러닝

2021년 5월-2023년 10월: (주)동네티콘 CTO

2023년~현 재: ㈜에이아이시드 프로덕트 엔지니어

※관심분야:머신러닝, DevOps, MLOps

1986년:서울대학교 (공학사)

1988년:서울대학교 대학원 (공학석사)

1994년:서울대학교 대학원 (공학박사)

1995년~현 재: 전남대학교 전자컴퓨터공학과 교수

※관심분야:디지털 신호처리, 영상 처리, 음성 신호처리, 머신러닝, 딥러닝

2008년:전북대학교 (의학사)

2014년:전북대학교 (의학석사)

2018년:전북대학교 (의학박사)

2023년~현 재: 분당서울대학교병원 영상의학과 부교수

※관심분야:의료인공지능, 영상유도하 소작술