VR 환경의 복합 조작 과제에서 가상 객체 조작 기법 소개 및 분석

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구에서는 VR 환경에서 복잡한 물체 조작을 수행하기 위한 3D 객체 조작 기법(GazeRayHand와 GazeRayHand2)을 소개하고 성능 분석하였다. 기존 연구는 단순한 물체 조작 중심의 연구로 이루어졌지만, 본 연구에서는 조립과 재배치와 같은 현실적이고 복잡한 과정을 포함하여 새로운 물체 조작 기법의 적용 가능성을 평가하였다. 비교 실험에서는 네 가지 최신 시선-손 입력 기반 기법을 활용하였다. 실험 결과, GazeRayHand 및 GazeRayHand2 기법은 Gaze&Pinch 대비 불필요한 움직임을 줄이고 직관성과 사용성을 향상하는 데 있어 유의미한 성능 향상을 보였다. 반면, Modified Gaze Beam Guided 기법은 강제적 상호작용 단계로 인해 가장 낮은 성능을 나타냈다. 본 연구 결과는 복잡한 VR 조작 시나리오에서 GazeRayHand 기법의 효율성과 직관성을 입증하며, 향후 몰입하는 환경에서의 상호작용 설계에 유용한 시사점을 제공한다.

Abstract

In this study, we investigate the performance of the GazeRayHand and GazeRayHand2 techniques for 3D object manipulation during complex tasks in Virtual Reality (VR) environments. Whereas previous research has primarily focused on simple or isolated tasks, our study explores more realistic and practical applications, including assembly and rearrangement scenarios. The results indicate that both GazeRayHand and GazeRayHand2 significantly outperform the Gaze&Pinch technique, demonstrating reduced unnecessary movement and enhanced intuitiveness and usability. In contrast, the Modified Gaze Beam Guided technique yielded the least effective performance, largely owing to its dependence on mandatory interaction steps. These findings suggest that the GazeRayHand approaches offer effective and user-friendly solutions for complex object manipulation in VR, with the potential to inform the design of more intuitive interaction systems in immersive environments.

Keywords:

Virtual Reality, 3D Object Manipulation, GazeRay, Complex Manipulation Task, HCI키워드:

가상환경, 3D 객체 조작, 시선 광선, 복합 조작 과제, 인간-컴퓨터 상호작용Ⅰ. 서 론

VR(Virtual Reality) 시스템에서 원거리 객체 조작은 중요한 과제 중 하나이다. 연구자들은 가상환경에서 사용자의 손이 닿지 않는 영역까지 도달할 수 있도록 다양한 원격 포인팅 기법과 인터페이스 설계를 지속해서 제안하고 있다[1]. 이러한 연구의 연장선으로 VR 환경의 물체 조작 기술은 근거리 조작의 한계를 넘어 가상의 팔을 확장[2]하거나, 사용자의 시선이나 컨트롤러 방향을 기준으로 발사되는 광선[3]을 이용한 원거리 조작 방식이 제안되고 있다. 하지만, 기존의 객체 조작 기법들은 충분한 효율성과 정확성을 제공하기 어렵다는 한계[3]가 있어 최근 연구들은 시선 입력과 손 입력을 통합한 조작 기법을 활발히 제안하고 있다.

그중 선행 연구[4]에서는 시선 기반 선택과 손 기반 조작을 통합한 방식인 GazeRayHand기법을 제안하였으며, 원거리 객체에 대한 이동 및 회전 조작을 가능하게 하는 기술을 제안하였다. 시선 광선과 손 위치의 상대적 관계를 활용하여 방향 및 속도를 직관적으로 제어할 수 있도록 설계하였으며, 기존 Gaze&Pinch[5] 및 Modified Gaze Beam Guided[6] 기반 기법과 비교하여 불필요한 조작거리는 줄이고 직관성을 높이는 효과를 확인하였다.

하지만, 선행 연구[4]에서는 정량적 성능을 평가하기 위해 구조화된 과제를 활용하였으나, 이는 연속적인 조작 과정을 포괄하기에는 제약이 있었다. 따라서, 본 논문에서는 이를 현실적이고 복합적인 조작 과제에 적용함으로써 실사용 환경에서의 가능성과 한계를 탐색하고자 한다. 선행 연구[4]에서 제안된 두 가지 시선-손 조합 조작 기법(GazeRayHand 및 GazeRayHand2)을 대상으로, 기존의 Gaze&Pinch[5] 및 Modified Gaze Beam Guided[6] 기법과 비교 실험을 수행하였다. 특히, 가려진 환경 및 다수 객체의 장거리 조작이 포함된 복잡한 과제를 설계하여, 각 기법의 직관성, 효율성, 사용성 등을 현실적인 조건에서 정량적으로 평가하였다.

Ⅱ. 관련 연구 분석

2-1 VR에서의 원격 객체 조작 기술의 발전

VR 환경에서의 객체 조작 기술은 virtual hand[7], ray casting[8], Go-Go interaction[2], HOMER[3] 등의 전통적인 기법을 중심으로 발전해 왔다. 이는 근거리에서 물체를 조작하는 한계를 뛰어넘기 위해서 가상의 팔을 확장[2] 시키거나 가상의 광선을 쏴서 원거리의 물체를 조작[3]하는 방법을 제시하였다.

이후로는 물체 조작의 효율성과 정확성을 향상하기 위해 다양한 연구들이 진행되었다. 공간을 축소하여 물체를 조작하는 기법[9]-[11] 들이 제안되면서 원격 객체 조작의 효율성이 향상되었다. Stoakley 등[9]은 World-In-Miniature 인터페이스를 제안하였다. 이 미니어처는 사용자가 위치한 가상 공간과 같지만, 축소된 상태로 사용자 근처에 배치된다. 이를 통해 사용자는 미니어처 속 객체를 조작함으로써, 실제 크기의 원거리 객체를 조작할 수 있게 된다. 그러나 가상 객체의 크기를 줄이면, 세밀한 조작이 어려워질 수 있다. 미니어처 상의 작은 기하학적 오류가, 실제 크기의 객체에서는 더 큰 오류로 증폭될 수 있기 때문이다. 또한 미니어처가 항상 사용자 앞에 위치하기 때문에, 때로는 실제 크기의 VR 환경을 가릴 수 있다는 문제가 있다. 이러한 문제를 해결하기 위해, Scaled-World Grab[10] 기법이 제안되었다. 이 방법은 사용자가 객체를 선택할 때 가상 세계 전체를 자동으로 축소하고, 객체 조작을 마치고 놓을 때 다시 원래 크기로 복원한다.

정확한 물체 조작을 위한 hand-velocity 기반 기법[12],[13]도 시도되었다. Frees 등이 제시한 PRISM(Precise and Rapid Interaction through Scaled Manipulation)[12] 은 사용자가 손 움직임 속도에 따라 축소된 위치 및 방향 조작을 통해 세밀한 객체 조작을 수행할 수 있다. 이러한 제스처 기반 인터페이스는 사용자의 육체적 피로도를 늘리기 쉬워(Gorilla Arm problem)[14] 이러한 한계도 지속해서 논의되고 있다.

2-2 시선과 손의 입력 방식

시선 기반 객체 조작은 가상현실이 아닌 환경에서도 연구됐다. 시선 입력은 빠르고[15],[16] 자연스러운 지시 기능을 제공하지만, 정확성 부족, 선택 확정의 어려움 그리고 시선을 주시하는 것만으로도 비의도적인 입력이 발생하는 Midas Touch 문제[17] 등이 한계로 지적됐다. 이러한 문제를 해결하기 위해, 기존 연구들은 주로 시선으로 선택하고, 손으로 조작한다는 원칙에 따라 시선 입력을 다른 입력과 결합하는 방식을 제안해왔다[18]-[20]. 예를 들면, Pfeufer 등이 제안한 Gaze-touch[18]는 사용자가 시선으로 선택한 대상을 상호작용을 할 수 있는 표면 위의 멀티 터치 제스처 형태로 조작할 수 있게 했다.

최근 상용화된 HMD(Head Mounted Display)에는 시선 추적 센서가 탑재되는 추세이며, 시선 입력은 빠르고 효율적인 선택 기능으로 그 가능성은 초기 연구[21]뿐 아니라, 최신의 연구[22]를 통해서도 입증되고 있다. Lystbæk 등[22]은 VR 환경에서 시선 기반 입력이 손 입력에 비해 객체를 더 빠르게 획득할 수 있도록 하며, 직접 조작이 어려운 원거리 객체와의 상호작용에 유리하다는 점을 보고하였다. 이러한 흐름에 따라 원격 객체 조작의 한계를 극복하기 위해 시선 기반 입력과 손 입력을 결합한 다양한 기술[4]-[6],[23]-[26] 들이 VR 환경에서도 활발히 연구되고 있다.

많은 연구에서 손가락 두 개를 맞대는 제스처(핀치)로 시선으로 선택된 대상을 선택하는 방식[5],[6],[23]을 사용하고 있다. Pfeuffer 등[5]은 이러한 방식이 제스처 기반 입력에 비해 원거리 상호작용이 가능하고, 컨트롤러에 비해 별도의 물리적 장치를 휴대할 필요가 없다는 장점이 있음을 지적하였다. Mutasim 등[23]은 핀치를 통한 입력이 버튼 클릭의 합리적인 대안이 될 수 있음을 밝혔다.

한편, 핀치 외에도 시선과 손의 위치 또는 광선을 이용한 선택 방식도 연구되고 있으며[24]-[26], 이러한 방식은 핀치 없이도 자연스러운 시선-손 통합 인터페이스 설계로 이어지고 있다. Lystbæk 등[24]은 사용자가 시선으로 바라보는 객체 위에 손을 시선 광선 상에 위치시킴으로써 객체를 선택하는 기법을 제안하였다. 사용자 실험 결과, 이 방법은 손만 사용하는 조작 방식이나 Gaze&Pinch[5] 기법보다 더 빠르고 오류가 적은 성능을 보였다. 또한 Jeong 등[26]은 객체 이동을 위한 GazeHand 기법을 제안하였다. 이 기법은 먼저 사용자가 응시하는 객체를 향해 시선 광선을 생성한 뒤, 가상 손을 해당 객체 근처에 배치한다. GazeHand 기법은 시선과 손 입력을 동시에 받아들여, 객체를 잡은 이후에는 시선과 손을 동시에 사용한 조작을 가능하게 한다.

2-3 복잡한 조작 환경에서의 기존 연구의 한계

최근까지의 시선-손 입력 기반 조작 연구들은 주로 단일 객체 선택[25] 또는 단순한 이동·회전 과제에 집중되어 있으며, 복잡한 조작 과제나 현실적인 작업 시나리오에 대한 적용 가능성은 상대적으로 작게 다루어져 왔다[27]. 또한, 가려진 객체나 깊이 방향으로의 이동과 같은 복잡한 상호작용 상황에서는 기존 기법들이 정확성이나 사용자의 피로도 측면에서 한계를 보이며, 기존 연구들은 주로 측면 또는 전후 방향 이동과 단순한 조작 환경에서만 평가됐다[5]. 선행 연구[4]에서도 가려진 환경과 다양한 크기의 물체 조작에 대한 적용 가능성은 향후 연구 과제로 제시되고 있으며, 본 연구 역시 이러한 복잡한 상호작용 상황에서의 시선-손 입력 기법의 효과를 검증하는 데 목적이 있다.

Ⅲ. 실험 설계

3-1 실험 조건

본 연구는 객체를 조작하는데 시선과 손의 상호작용을 이용하는 4개의 기법을 비교하고자 한다. 기존에 존재하던 Gaze&Pinch, Modified Gaze Beam Guided 그리고 선행 연구에서의 기법들을 복잡한 상호작용 상황에서 비교하고자 한다.

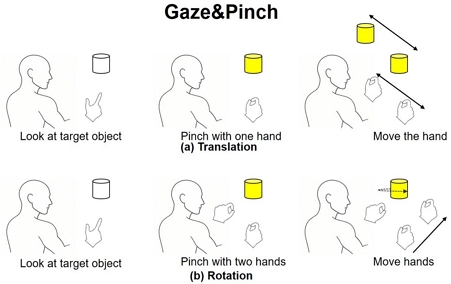

Gaze&Pinch[5] 방식은 시선 입력만을 이용하여 객체를 선택한다. 사용자는 원하는 객체를 바라보아 시선 포인터를 해당 객체에 위치시키고, 손으로 핀치 제스처를 수행하여 객체를 선택한다. 선택된 객체는 GazeRayHand 기법과 같게 색상이 노란색으로 변하여 선택이 완료되었음을 나타낸다. 선택 이후, 핀치 한 손의 움직임이 객체의 이동을 유도하며, 핀치가 해제될 때까지 손의 이동 방향으로 객체가 함께 이동한다(그림 1 (a)). 핀치가 해제되면 이동이 중단되고, 객체는 원래 색상으로 복귀한다. Gaze&Pinch 기법은 객체 회전을 위한 별도의 입력 모드를 제공한다. 회전 모드에서는 사용자가 객체를 바라본 상태에서 두 손으로 핀치 제스처를 수행하여 선택을 완료한다. 이후 두 손을 이용한 상호작용을 통해 회전 동작을 수행하게 되며, 핀치가 해제되면 회전도 중단된다(그림 1 (b)).

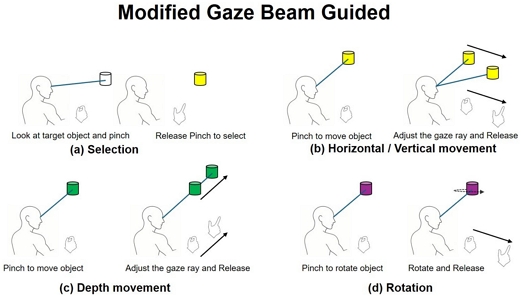

Gaze Beam Guided[6] 기법은 사용자가 핀치 제스처를 하고 해제할 때, 현재 시선 광선이 가리키고 있는 객체를 선택하는 방식이다. 처음에는 사용자 이마에서 응시 지점까지 이어지는 보이지 않는 시선인 광선이 사용된다. 사용자가 핀치 제스처를 하면 광선이 시각적으로 나타나며, 이후에는 핀치한 손으로 광선의 끝점을 조작할 수 있게 된다. 손을 상/하/좌/우로 움직이면, 광선의 끝점도 같은 방향으로 움직인다.

사용자가 핀치를 해제하면 광선 끝점에 있는 객체가 선택되고, 광선은 다시 보이지 않게 되며 시선에 의해 제어된다 (그림 2 (a)). 선택된 객체는 노란색으로 변해, 조작 대상으로 지정되었음을 표시한다.

이 기법의 객체 이동은 두 단계로 나뉘며, 사용자에게 수평/수직 방향 이동과 깊이 이동을 별도로 조작할 수 있도록 설계되어 있다. 첫 번째 단계에서는 수평 및 수직 이동을 수행한다. 사용자가 핀치 제스처를 다시 하면, 선택된 객체가 사용자의 응시 지점으로 즉시 이동하며 광선이 다시 보이게 되고 핀치한 손으로 광선을 다시 조작할 수 있다(그림 2 (b)). 이때 객체는 광선 끝점에 연결되며, 손을 움직여 끝점을 이동시키면 객체도 함께 이동한다. 핀치를 해제하면 첫 번째 단계가 완료되고, 광선은 여전히 보이는 상태로 고정된다. 객체는 초록색으로 변한다. 그다음 핀치 제스처는 깊이 방향 이동을 위한 두 번째 단계를 시작한다. 손을 앞으로 또는 뒤로 움직이면 고정된 광선을 따라 객체가 멀어지거나 가까워진다(그림 2 (c)). 깊이 이동의 속도는 Gaze&Pinch 기법과 같은 방식으로 조절된다. 핀치를 해제하면 두 번째 이동 단계가 완료되며, 객체는 보라색으로 변한다.

기존의 Gaze Beam Guided 기법은 객체 회전 기능을 제공하지 않았지만, 이번 연구에서는 다른 기법과 비교할 수 있도록 회전 기능을 추가하여 Modified Gaze Beam Guided로 명명하였다. 원래 기법은 핀치 제스처를 반복적으로 사용하는 방식이므로, 회전 단계도 핀치 제스처로 시작하게 구성했다. 두 번째 이동 단계 이후, 고정된 광선은 계속 표시되며 회전의 기준선으로 사용된다. 사용자는 핀치한 손을 상/하/좌/우 방향으로 움직여 객체를 회전시킬 수 있다. 회전 속도는 GazeRayHand의 회전 속도와 같게 제어된다(그림 2 (d)). 핀치 제스처를 해제하면 모든 조작 단계가 종료되며, 광선은 다시 보이지 않게 되고 객체는 원래 색상으로 복귀한다.

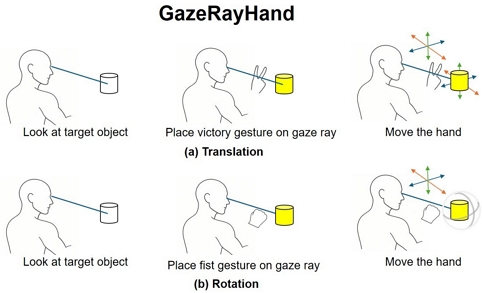

GazeRayHand[4] 기법은 사용자가 시선을 이용해 객체를 선택한 후, 손의 위치와 제스처에 따라 객체를 이동하거나 회전시키는 방식이다. 사용자는 V 제스처(검지와 중지 펴기)를 통해 이동 모드로 진입하며, 손의 상대적 움직임 방향(위/아래/좌/우/앞/뒤)에 따라 객체가 같은 방향으로 이동한다(그림 3 (a)). 주먹 제스처(모든 손가락을 쥐기)를 통해 회전 모드로 진입하며, 손의 움직임에 따라 객체가 해당 방향으로 회전한다. 손과 시선 광선 간의 거리에 따라 이동 및 회전 속도가 달라지고, 일정 거리 이상 이동한 경우에만 조작이 시작된다(그림 3 (b)). 손을 펼치는 제스처로 조작을 종료하면 객체는 원래 색상으로 복귀하고 시선 광선이 다시 갱신된다.

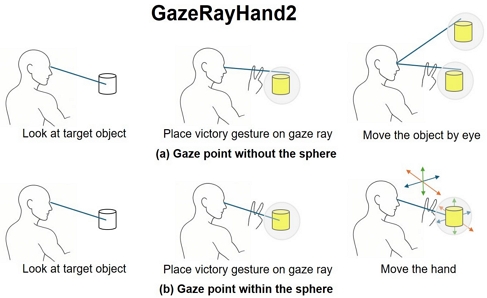

GazeRayHand2[4] 기법은 선택된 객체 주위에 반투명한 흰색 구체를 생성하고, 사용자의 시선 위치에 따라 객체를 이동시키는 기능을 추가한 방식이다. 사용자가 객체를 선택하면, 해당 객체의 경계 영역보다 20% 큰 반경의 구체가 생성된다. 시선이 구체 외부로 벗어나면 시선을 따라 객체가 이동하며(그림 4 (a)), 사용자의 시선이 구체 내부에 위치하면 기존과 같은 손 기반 조작이 가능하다(그림 4 (b)). 이때 객체와 함께 구체 위치도 함께 갱신되어 이후 손 기반 조작에 활용된다.

3-2 실험 디자인

본 연구에서는 조립 과제, 재배치 과제, 두 가지 객체 조작 과제를 설계하였다.

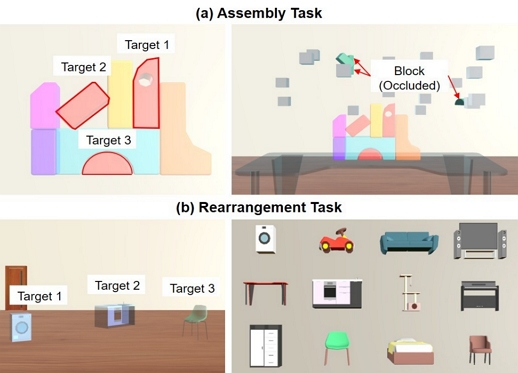

조립 과제에서는 참가자들이 세 개의 블록을 각각의 목표 지점에 맞추어 배치해야 했다(그림 5 (a)). 이 블록들은 다양한 형태를 가지고 있으며, 일부는 다른 큐브들에 의해 전부 또는 부분적으로 가려져 있었다. 이러한 가려진 환경을 만들기 위해 20개의 회색 큐브가 방해 요소로 추가되었으며, 모든 객체는 가로 3m, 세로 1.5m 범위에서, 깊이 3m~5m 사이에 무작위로 배치되었다. 블록들은 30°에서 150° 사이의 무작위 회전 상태로 배치되었다. 전체 조립 모델은 참가자에서 1.5m 떨어진 테이블 위에 위치하였고, 목표 지점들은 반투명 빨간색 블록으로 표시되었다. 만약 참가자가 조작한 블록과 목표 블록 간 회전 차이가 5° 이하이고 위치 차이가 0.05m 이하일 경우, 해당 목표 블록은 사라지며 더 이상 조작할 수 없어진다. 모든 블록을 정확히 정렬하면 조립 과제가 완료된다.

재배치 과제에서는 세 개의 가상 가구를 각 목표 위치에 맞추어 배치하는 과제였다(그림 5 (b)). 이 과제는 조립 과제보다 더 넓은 작업 공간에서 이루어졌으며, 더 먼 거리까지 물체를 이동시키는 조작이 요구되었다. 초기 상태에서 12개의 가상 가구들이 2m 간격의 4×3 그리드 형태로, 참가자에서 4m 떨어진 곳에 배치되었다. 목표 지점들은 반투명한 형태로 표현되었다. 참가자들은 물체의 각도, 깊이, 방향을 목표 지점과 일치시키는 작업을 수행해야 한다. 목표의 위치는 참가자 기준 시야에서 첫 번째 목표는 -60°~-20°, 두 번째는 -20°~20°, 세 번째는 20°~60° 범위에서 무작위로 배치되었다. 깊이는 3m~6m 범위에서 무작위로 정해졌으며, 방향 각도는 30°~150° 범위였다. 실험마다 세 개의 목표는 무작위로 선택되어 그리드 위에 배치되었다. 조작된 가구와 목표 간 위치 차이가 0.1m 이하이고 방향 차이가 10° 이하일 경우, 해당 목표는 사라지고 더 이상 조작할 수 없게 되었다. 가구 크기가 크기 때문에 허용 오차 기준이 더 크게 설정되었다. 모든 가구가 목표에 정확히 정렬되면 재배치 과제가 완료된다.

3-3 실험 참가자와 개발환경

본 연구에서는 12명의 참가자가 참여했다. 참가자 중 5명은 남성, 7명은 여성이었고, 나이는 21살과 29살 사이로 평균 연령은 24.75세였다. 모두 오른손잡이였고 VR을 한 달에 한 번 사용하는 사람이 4명, 사용해 본 경험이 없는 사람이 6명으로 대부분이 VR 인터페이스에 경험이 적었다.

사용한 하드웨어로는 Tobii Eye tracker를 포함한 HTC Vive Pro HMD[28]를 사용하였고 HMD는 3.8GHz AMD Ryzen 7 5800X 8-Core, 32GB of RAM, 그리고 NVIDIA GeForce RTX 3060 그래픽카드를 가진 컴퓨터와 연결되었다. 소프트웨어는 유니티 게임엔진 2020.3.37f1에서 C#으로 개발되었다. 핸드 트래킹 정보를 알기 위해서 Vive Hand Tracking SDK 1.0.0[29]을 사용하였다.

3-4 실험 과정 및 평가항목

참가자들은 실험 의도와 절차를 읽고 동의서를 작성한 후, 설문을 작성한다. 그리고 참가자를 의자에 앉힌 후, 사용하기 선호하는 손을 선택 후 해당 손만 사용한다. HMD와 eye tracker를 쓰고 준비가 완료되면 실험 조건별로세 개의 큐브(가로 0.5m)를 이동 및 회전시키는 연습을 진행하였다. 큐브들은 참가자로부터 3.5m 떨어지고 1m 높이에 배치되었다. 모두 완료된 후, 본 실험 과제를 수행하였다. 네 가지 실험 조건의 순서는 Balanced Latin Square design을 이용해 균형 있게 배치하였다. 실험에서 조건별로 다음과 같은 객관적 측정 지표를 수집하였다.

- 1. 총 조작 시간(초): 주어진 조건에서 하나의 과제를 완료하는 데 걸린 총 시간

- 2. 대략적인 조작 시간(초): 객체와 목표를 회전 10° 이하, 이동 거리 0.1m 이하로 대략 맞추는 데 걸린 시간

- 3. 정밀 조작 시간(초): 대략적인 조작 이후부터 객체 조작을 최종 완료하기까지 걸린 시간

- 4. 총 이동 거리(m): 조작 중 객체가 이동한 누적 거리

- 5. 총 회전 각도(도): 조작 중 객체가 회전한 누적 각도

- 6. 총 손 이동 거리(m): 조작 중 참가자의 손이 이동한 누적 거리(Gaze&Pinch 방식에서는 객체 회전에 양손을 사용하므로, 양손 이동 거리 합산)

- 7. 총 손 회전량(도): 조작 중 참가자의 손이 회전한 누적 각도(Gaze&Pinch 방식에서는 양손 회전량 합산)

4개의 각각의 실험을 진행한 후 참가자들은 다음 설문들을 수행하였다. Borg Category-Ratio 10 (Borg CR10)[30],[31], System Usability Scale (SUS)[32], NASA Task Load Index (NASA-TLX)[33], 그리고 단축형 User Experience Questionnaire(UEQ-S)[34]. 이후, 참가자들은 네 가지 조건에 대한 선호도를 1점(선호)에서 4점(비선호)까지 순위를 매겼다. 전체 실험은 개인당 80분 정도 실행되었으며, 실험 참가자는 10,000원의 보상이 지급되었다.

Ⅳ. 실험 결과

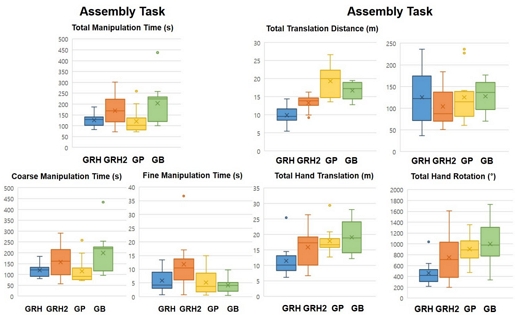

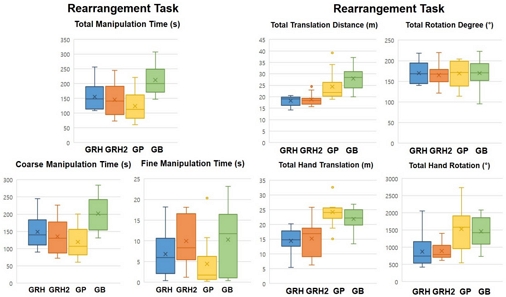

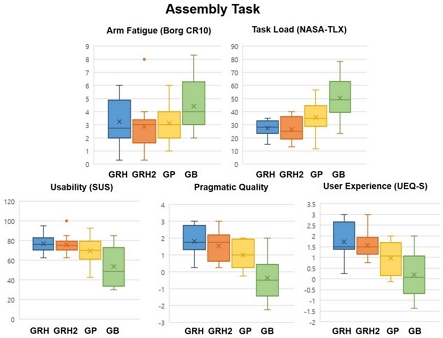

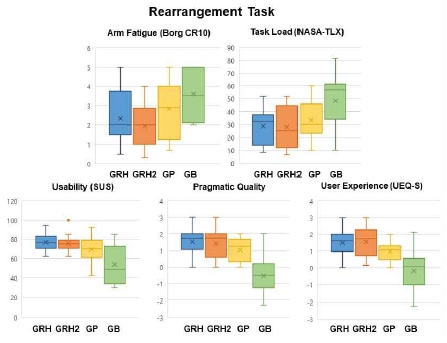

Shapiro-Wilk 검정 결과, 총 조작 시간, 대략적인 조작 시간, 정밀 조작 시간, 총 이동 거리, 총 회전 각도, 총 손 이동 거리 등의 객관적 지표가 정규분포를 따르지 않는 것으로 나타났으며, Borg CR10, NASA-TLX, SUS, UEQ-S 등의 주관적 지표는 서열 척도임을 확인하였다. 따라서 네 가지 실험 조건 간 차이를 분석하기 위해 Friedman 검정(유의수준 α = 0.05)을 수행하였고, 사후 비교는 Bonferroni 보정을 적용한 Wilcoxon signed-rank 검정(α = 0.05/6 = 0.0083) 을 사용하였다. 분석 결과는 조립 과제와 재배치 과제에 대해 통합하여 보고하였다. 본문에서는 네 가지 기법을 각각 GRH (GazeRayHand), GRH2 (GazeRayHand2), GP (Gaze & Pinch), GB (Modified Gaze Beam Guided) 의 약어로 표기하였다. 그림 6~그림 9에 각 실험에 관한 결과 그래프를 도식화하였으며, 평균값을 X, 이상치를 o로 표기하였다.

4-1 객관적인 평가

객관적인 평가는 표 1, 표 2에 나누어 요약되어 있다. Friedman 검정 경과, 재배치과제의 정밀 조작 시간과 두 과제에서의 객체 회전을 제외한 모든 측정 항목에서 네 가지 조건 간 유의미한 차이가 나타났다.

총 조작 시간(Total Time): 조립 과제에서는 GB 조건이 GP 조건보다 유의미하게 더 오래 걸렸다(Z = -2.746, p < .006). 반면 다른 조건 간 비교에서는 유의미한 차이가 나타나지 않았다. 재배치 과제에서는 GB 조건이 GRH2 조건(Z = -2.667, p = .008) 및 GRH 조건(Z = -2.667, p = .008)보다 유의미하게 더 느렸으며, 나머지 조건 간 비교에서는 유의미한 차이가 없었다.

대략적인 조작 시간(Coarse Time): 조립 과제에서 GP 조건이 GB 조건보다 유의미하게 더 빠르게 수행되었다(Z = -2.476, p = .006). 그 외의 비교에서는 유의미한 차이가 나타나지 않았다. 재배치 과제에서는 GB 조건이 GRH2 조건(Z = -2.667, p = .008) 및 GP 조건(Z = -2.667, p = .008)보다 더 느렸으며, 나머지 조건 간 비교에서는 유의미한 차이가 없었다.

정밀 조작 시간(Fine Time): 조립 과제에서 GB 조건이 GRH2 조건보다 유의미하게 더 빠르게 수행되었다(Z = -2.824, p = .005). 다른 조건 간 비교에서는 유의미한 차이가 없었고, 재배치 과제에서는 네 가지 조건 간 모두 유의미한 차이가 나타나지 않았다.

총 이동 거리(Total Translation Distance): 조립 과제에서 GRH 조건이 GRH2(Z = -2.667, p = .008), GP(Z = -3.059, p = .002), GB(Z = -2.981, p = .003) 조건보다 유의미하게 더 적은 이동 거리를 보였다. 또한 GRH2 조건은 GP(Z = -2.746, p = .006), GB(Z = -2.746, p = .006) 조건보다 이동 거리가 적었다. GP와 GB 조건 간에는 유의미한 차이가 없었다. 재배치 과제에서도 유사한 경향을 보였으며, GRH 조건이 GP(Z = -2.824, p = .005), GB(Z = -3.059, p = .002) 조건보다 이동 거리가 적었고, GRH2 조건은 GB 조건보다 적었다(Z = -2.981, p = .003). 나머지 비교에서는 유의미한 차이가 없었다.

총 손 이동 거리(Total Hand Translation): 조립 과제에서 GRH 조건이 GRH2(Z = -2.746, p = .006), GP(Z = -3.059, p = .002), GB(Z = -3.059, p = .002) 조건보다 유의미하게 적은 손 이동 거리를 나타냈다. 다른 비교에서는 유의미한 차이가 없었다. 재배치 과제에서도 GRH 조건이 GP(Z = -3.059, p = .002), GB(Z = -2.981, p = .003) 조건보다 손 이동 거리가 적었고, GRH2 조건 역시 GP 조건보다 적은 이동 거리를 보였다(Z = -3.059, p = .003). 나머지 조건 간 비교에서는 유의미한 차이가 없었다.

총 손 회전량 (Total Hand Rotation): 조립 과제에서는 GRH 조건이 GP(Z = -2.903, p = .004), GB(Z = -2.903, p = .004) 조건보다 유의미하게 적은 손 회전량을 나타냈다. 나머지 비교에서는 유의미한 차이가 없었다. 재배치 과제에서도 GRH 조건이 GP(Z = -2.824, p = .005), GB(Z = -3.059, p = .002) 조건보다 적었으며, GRH2 조건 역시 GP(Z = -2.746, p = .006), GB(Z = -2.824, p = .005) 조건보다 유의미하게 적은 손 회전량을 보였다. 나머지 비교에서는 유의미한 차이가 나타나지 않았다.

4-2 주관적인 평가

참가자의 주관적 평가 결과는 표 3, 표 4 그리고 표 5에 나누어 요약되어 있다. Friedman 검정 결과, 재배치 과제의 작업 부하를 제외한 모든 측정 항목에서 네 가지 조건 간 유의미한 차이가 나타났다.

팔 피로도(Borg CR10): 조립 과제에서는 네 가지 조건 간 유의미한 차이가 나타나지 않았다. 반면, 재배치 과제에서는 GRH2 조건이 GB 조건보다 팔 피로도가 유의미하게 낮았다(Z=-2.692, p=.007). 나머지 조건 간 비교에서는 유의미한 차이가 나타나지 않았다.

작업 부하(NASA-TLX): 조립 과제에서는 GB 조건이 GRH 조건(Z=-2.667, p=.008) 및 GRH2 조건(Z=-2.716, p=.007)보다 유의미하게 더 높은 작업 부하를 보였다. 그러나 GRH와 GRH2(Z=-0.045, p=.964), GRH와 GP(Z=-1.609, p=.108), GRH2와 GP(Z=-1.804, p=.071), GP와 GB(Z=-1.778, p=.075) 간 비교에서는 유의미한 차이가 나타나지 않았다. 재배치 과제에서는 네 가지 조건 간 유의미한 차이가 나타나지 않았다.

시스템 사용성(SUS): 조립 과제에서 GB 조건이 GRH 조건(Z=-2.802, p=.005) 및 GP 조건(Z=-2.788, p=.005)보다 유의미하게 낮은 사용성을 보였다. 다른 비교에서는 유의미한 차이가 없었다. 재배치 과제에서도 GRH 조건, GRH2 조건, GP 조건이 GB 조건보다 유의미하게 더 높은 사용성을 보였다(GRH-GB: Z=-2.787, p=.005; GRH2-GB: Z=-2.866, p=.004; GP-GB: Z=-2.759, p=.006). 그러나 나머지 비교에서는 유의미한 차이가 없었다.

사용자 경험(UEQ-S): 기능적 품질의 경우, 조립 과제에서 GRH, GRH2, GP 조건이 GB 조건보다 유의미하게 더 높은 점수를 보였다(GRH-GB: Z=-3.062, p=.002; GRH2-GB: Z=-2.814, p=.005; GP-GB: Z=-2.71, p=.007). 이러한 경향은 재배치 과제에서도 동일하게 나타났다(GRH-GB: Z=-2.941, p=.003; GRH2-GB: Z=-2.934, p=.003; GP-GB: Z=-2.748, p=.006). 그러나 두 과제 모두에서 GRH와 GRH2(조립 과제: Z=-0.513, p=.608; 재배치 과제: Z=-0.418, p=.676), GRH와 GP(조립 과제: Z=-2.004, p=.045; 재배치 과제: Z=-1.34, p=.18), GRH2와 GP(조립 과제: Z=-1.378, p=.168; 재배치 과제: Z=-1.021, p=.307) 조건 간 비교에서는 유의미한 차이가 없었다.

전체 사용자 경험: 조립 과제에서 GRH 조건(Z=-2.904, p=.004), GRH2 조건(Z=-2.803, p=.005)이 GB 조건보다 유의미하게 더 높은 사용자 경험을 보였다. 하지만 GRH와 GRH2(Z=-0.445, p=.656), GRH와 GP(Z=-1.87, p=.061), GRH2와 GP(Z=-1.691, p=.091), GP와 GB(Z=-2.492, p=.013) 조건 간 비교에서는 유의미한 차이가 없었다. 흥미롭게도 재배치 과제에서도 유사한 경향이 나타났으며, GRH 조건(Z=-2.986, p=.003), GRH2 조건(Z=-2.982, p=.003)이 GB 조건보다 더 높은 사용자 경험을 보였다. 그러나 GRH와 GRH2(Z=-0.562, p=.574), GRH와 GP(Z=-1.471, p=.141), GRH2와 GP(Z=-1.61, p=.107), GP와 GB(Z=-2.631, p=.009) 조건 간 비교에서는 유의미한 차이가 없었다.

선호도(Preference): 참가자들은 네 가지 조건을 선호도 순으로 평가하였다. 그 결과는 표 5에 요약되어 있으며, 조립 과제에서는 GB 조건이 GRH 조건(Z=-3.1, p=.002), GRH2 조건(Z=-2.901, p=.004)보다 유의미하게 덜 선호되었다. 반면 GRH와 GRH2(Z=-0.247, p=.805), GRH와 GP(Z=-0.717, p=.473), GRH2와 GP(Z=-0.855, p=.392), GP와 GB(Z=-2.305, p=.021) 간 비교에서는 유의미한 차이가 나타나지 않았다. 재배치 과제에서는 네 가지 조건 간 유의미한 차이가 나타나지 않았다.

Ⅴ. 결 론

본 연구에서는 VR 환경에서 객체 조작 기술인 GazeRayHand와 GazeRayHand2가 단순한 객체 조작 과제뿐만 아니라 복잡하고 현실적인 과제에도 효과적으로 활용될 수 있음을 확인하였다. GazeRayHand 및 GazeRayHand2는 Gaze&Pinch와 유사한 수준의 객관적·주관적 성능을 보였으며, 불필요한 이동을 유의미하게 줄이고, 이동 및 회전의 방향과 속도를 직관성과 사용성으로 제어할 수 있는 장점을 확인하였다. 특히 GazeRayHand는 정밀성과 안정성 측면에서, GazeRayHand2는 빠른 시선 이동 기능을 통해 장거리 조작에 적합한 특성을 나타냈다. 이러한 시선 입력과 손 입력의 결합을 자유롭게 시각적 객체와 상호작용을 하는 VR 환경에서 탐구한 결과, 본 연구는 VR 상호작용 개념을 확장할 수 있으며, 이를 통해 현실 세계처럼 자연스럽게 사용할 수 있으면서도 새로운 형태의 3D 인터랙션과 경험으로 이어질 수 있음을 보여주었다.

Acknowledgments

이 논문은 과학기술정보통신부의 재원으로 정보통신기획평가원 지역지능화혁신인재양성사업의 지원(IITP-2025-RS-2022-00156287)과 인공지능융합혁신인재양성사업 연구 결과로 수행되었음(IITP-2023-RS-2023-00256629).

References

- M. R. Mine, Virtual Environment Interaction Techniques, University of North Carolina, Chapel Hill, NC, Technical Report, 1995.

-

I. Poupyrev, M. Billinghurst, S. Weghorst, and T. Ichikawa, “The Go-Go Interaction Technique: Non-Linear Mapping for Direct Manipulation in VR,” in Proceedings of the 9th Annual ACM Symposium on User Interface Software and Technology (UIST ’96), Seattle: WA, pp. 79-80, November 1996.

[https://doi.org/10.1145/237091.237102]

-

D. A. Bowman and L. F. Hodges, “An Evaluation of Techniques for Grabbing and Manipulating Remote Objects in Immersive Virtual Environments,” in Proceedings of the 1997 Symposium on Interactive 3D Graphics (SI3D ’97), Providence: RI, pp. 35-ff, April 1997.

[https://doi.org/10.1145/253284.253301]

-

S. Kang, J. Jeong, S.-H. Kim, H.-J. Yang, G. A. Lee, and S. Kim, “GazeRayHand: Combining Gaze Ray and Hand Interaction for Distant Object Manipulation,” Applied Sciences, Vol. 15, No. 13, 7065, July 2025.

[https://doi.org/10.3390/app15137065]

-

K. Pfeuffer, B. Mayer, D. Mardanbegi, and H. Gellersen, “Gaze + Pinch Interaction in Virtual Reality,” in Proceedings of the 5th Symposium on Spatial User Interaction (SUI ’17), Brighton: UK, pp. 99-108, October 2017.

[https://doi.org/10.1145/3131277.3132180]

-

Y. Bao, J. Wang, Z. Wang, and F. Lu, “Exploring 3D Interaction with Gaze Guidance in Augmented Reality,” in Proceedings of the 2023 IEEE Conference Virtual Reality and 3D User Interfaces (VR), Shanghai: China, pp. 22-32, 2023.

[https://doi.org/10.1109/VR55154.2023.00018]

-

I. Poupyrev, T. Ichikawa, S. Weghorst, and M. Billinghurst, “Egocentric Object Manipulation in Virtual Environments: Empirical Evaluation of Interaction Techniques,” Computer Graphics Forum, Vol. 17, No. 3, pp. 41-52, 1998.

[https://doi.org/10.1111/1467-8659.00252]

-

K. Hinckley, R. Pausch, J. C. Goble, and N. F. Kassell, “A Survey of Design Issues in Spatial Input,” in Proceedings of the 7th Annual ACM Symposium on User Interface Software and Technology (UIST ’94), Marina del Rey: CA, pp. 213-222, November 1994.

[https://doi.org/10.1145/192426.192501]

-

R. Stoakley, M. J. Conway, and R. Pausch, “Virtual Reality on a WIM: Interactive Worlds in Miniature,” in Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI ’95), Denver: CO, pp. 265-272, May 1995.

[https://doi.org/10.1145/223904.223938]

-

M. R. Mine, F. P. Brooks, and C. H. Sequin, “Moving Objects in Space: Exploiting Proprioception in Virtual-Environment Interaction,” in Proceedings of the 24th Annual Conference on Computer Graphics and Interactive Techniques (SIGGRAPH ’97), Los Angeles, CA, pp. 19-26, August 1997.

[https://doi.org/10.1145/258734.258747]

-

J. S. Pierce, B. C. Stearns, and R. Pausch, “Voodoo Dolls: Seamless Interaction at Multiple Scales in Virtual Environments,” in Proceedings of the 1999 Symposium on Interactive 3D Graphics (I3D ’99), Atlanta: GA, pp. 141-145, April 1999.

[https://doi.org/10.1145/300523.300540]

-

S. Frees and G. D. Kessler, “Precise and Rapid Interaction through Scaled Manipulation in Immersive Virtual Environments,” in Proceedings of IEEE Virtual Reality 2005 (VR 2005), Bonn: Germany, pp. 99-106, March 2005.

[https://doi.org/10.1109/VR.2005.1492759]

-

C. Wilkes and D. A. Bowman, “Advantages of Velocity-Based Scaling for Distant 3D Manipulation,” in Proceedings of the 2008 ACM Symposium on Virtual Reality Software and Technology (VRST ’08), Bordeaux: France, pp. 23-29, October 2008.

[https://doi.org/10.1145/1450579.1450585]

-

S. Jang, W. Stuerzlinger, S. Ambike, and K. Ramani, “Modeling Cumulative Arm Fatigue In Mid-Air Interaction Based On Perceived Exertion And Kinetics Of Arm Motion,” in Proceedings of the 2017 CHI Conference on Human Factors in Computing Systems (CHI ’17), Denver: CO, pp. 3328-3339, May 2017.

[https://doi.org/10.1145/3025453.3025523]

-

L. E. Sibert and R. J. K. Jacob, “Evaluation of Eye Gaze Interaction,” in Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI ’00), The Hague: Netherlands, pp. 281-288, April 2000.

[https://doi.org/10.1145/332040.332445]

-

C. Ware and H. H. Mikaelian, “An Evaluation of an Eye Tracker as a Device for Computer Input,” in Proceedings of the SIGCHI/GI Conference on Human Factors in Computing Systems and Graphics Interface (CHI ’87), Toronto: Canada, pp. 183-188, April 1987.

[https://doi.org/10.1145/29933.275627]

-

R. J. K. Jacob, “What You Look at is What You Get: Eye Movement-Based Interaction Techniques,” in Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI ’90), Seattle: WA, pp. 11-18, April 1990.

[https://doi.org/10.1145/97243.97246]

-

K. Pfeuffer, J. Alexander, M. K. Chong, and H. Gellersen, “Gaze-Touch: Combining Gaze with Multi-Touch for Interaction on the Same Surface,” in Proceedings of the 27th Annual ACM Symposium on User Interface Software and Technology (UIST ’14), Honolulu: HI, pp. 509-518, October 2014.

[https://doi.org/10.1145/2642918.2647397]

-

S. Stellmach, S. Stober, A. Nürnberger, and R. Dachselt, “Designing Gaze-Supported Multimodal Interactions for the Exploration of Large Image Collections,” in Proceedings of the 1st Conference on Novel Gaze-Controlled Applications (NGCA ’11), Karlskrona: Sweden, 1, pp. 1-8, August 2011.

[https://doi.org/10.1145/1983302.1983303]

-

E. Velloso, J. Turner, J. Alexander, A. Bulling, and H. Gellersen, “An Empirical Investigation of Gaze Selection in Mid-Air Gestural 3D Manipulation,” in Proceedings of Human-Computer Interaction – INTERACT 2015, 15th IFIP TC 13 International Conference, Bamberg: Germany, pp. 315-330, 2015.

[https://doi.org/10.1007/978-3-319-22668-2_25]

-

V. Tanriverdi and R. J. K. Jacob, “Interacting with Eye Movements in Virtual Environments,” in Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI ’00), The Hague: Netherlands, pp. 265-272, April 2000.

[https://doi.org/10.1145/332040.332443]

-

M. N. Lystbæk, T. Mikkelsen, R. Krisztandl, E. J. Gonzalez, M. Gonzalez-Franco, H. Gellersen, and K. Pfeuffer, “Hands-on, Hands-off: Gaze-Assisted Bimanual 3D Interaction,” in Proceedings of the 37th Annual ACM Symposium on User Interface Software and Technology (UIST ’24), Pittsburgh: PA, USA, 80, pp. 1-12, October 2024.

[https://doi.org/10.1145/3654777.3676331]

-

A. K. Mutasim, A. U. Batmaz, and W. Stuerzlinger, “Pinch, Click, or Dwell: Comparing Different Selection Techniques for Eye-Gaze-Based Pointing in Virtual Reality,” in Proceedings of the ACM Symposium on Eye Tracking Research and Applications (ETRA ’21 Short Papers), Stuttgart: Germany, 15, pp. 1-7, May 2021.

[https://doi.org/10.1145/3448018.3457998]

-

M. N. Lystbæk, P. Rosenberg, K. Pfeuffer, J. E. Grønbæk, and H. Gellersen, “Gaze-Hand Alignment: Combining Eye Gaze And Mid-Air Pointing For Interacting With Menus In Augmented Reality,” Proceedings of the ACM on Human-Computer Interaction (PACMHCI), Vol. 6, No. ETRA, 145, pp. 1-18, May 2022.

[https://doi.org/10.1145/3530886]

-

U. Wagner, M. N. Lystbæk, P. Manakhov, J. E. S. Grønbæk, K. Pfeuffer, and H. Gellersen, “A Fitts’ Law Study of Gaze-Hand Alignment for Selection in 3D User Interfaces,” in Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems (CHI ’23), Hamburg: Germany, 252, pp. 1-15, April 2023.

[https://doi.org/10.1145/3544548.3581423]

-

J. Jeong, S.-H. Kim, H.-J. Yang, G. A. Lee, and S. Kim, “GazeHand: A Gaze-Driven Virtual Hand Interface,” IEEE Access, Vol. 11, pp. 133703-133716, December 2023.

[https://doi.org/10.1109/ACCESS.2023.3337372]

-

D. Yu, X. Lu, R. Shi, H.-N. Liang, T. Dingler, E. Velloso, and J. Goncalves, “Gaze-Supported 3D Object Manipulation In Virtual Reality,” in Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems (CHI ’21), Yokohama: Japan, 734, pp. 1-13, May 2021.

[https://doi.org/10.1145/3411764.3445343]

- Htc Vive. Vive Pro Eye Overview [Internet]. Available: https://www.vive.com/kr/product/vive-pro-eye/overview/, .

- Vive Developer. (2021) Tracking Overview - Introduction. [Internet]. Available: https://hub.vive.com/storage/tracking/overview/introduction.html, .

-

S. Jang, W. Stuerzlinger, S. Ambike, and K. Ramani, “Modeling Cumulative Arm Fatigue in Mid-Air Interaction Based on Perceived Exertion and Kinetics of Arm Motion,” in Proceedings of the 2017 CHI Conference on Human Factors in Computing Systems (CHI ’17), Denver: CO, pp. 3328-3339, May 2017.

[https://doi.org/10.1145/3025453.3025523]

-

G. A. Borg, “Psychophysical Bases of Perceived Exertion,” Medicine & Science in Sports & Exercise, Vol. 14, No. 5, pp. 377-381, 1982.

[https://doi.org/10.1249/00005768-198205000-00012]

-

P. W. Jordan, B. Thomas, I. L. McClelland, and B. Weerdmeester, Usability Evaluation in Industry, Boca Raton, Fl: CRC Press, 1996.

[https://doi.org/10.1201/9781498710411]

-

S. G. Hart and L. E. Staveland, “Development of NASA-TLX (Task Load Index): Results of Empirical and Theoretical Research,” Advances in Psychology, Vol. 52, pp. 139-183, 1988.

[https://doi.org/10.1016/S0166-4115(08)62386-9]

-

M. Schrepp, A. Hinderks, and J. Thomaschewski, “Design and Evaluation of a Short Version of the User Experience Questionnaire (UEQ-S),” International Journal of Interactive Multimedia and Artificial Intelligence, Vol. 4, No. 6, pp. 103-108, 2017.

[https://doi.org/10.9781/ijimai.2017.09.001]

저자소개

2024년:전남대학교 학사

2025년:전남대학교 대학원 (공학석사 - 인공지능융합)

2025년~현 재: 전남대학교 인공지능융합학과 석사과정

※관심분야:증강/가상현실, 인간-컴퓨터 상호작용

2024년:전남대학교 학사

2025년:전남대학교 대학원 (공학석사 - 인공지능융합)

2024년~현 재: 전남대학교 인공지능융합학과 석사과정

※관심분야:증강/가상현실, 인간-컴퓨터 상호작용

2009년:University of Tasmania 학사

2011년:University of Tasmania 석사

2016년:University of Canterbury 박사

2016년~2020년: University of South Australia 박사 후 연구원

2017년~2020년: Swinburne University of Technology 박사 후 연구원

2020년~2021년: 한국과학기술연구원 박사 후 연구원

2021년~2025년: 전남대학교 인공지능학부 조교수

2025년~현 재: 전남대학교 인공지능학부 부교수

※관심분야:증강/가상현실, 인간-컴퓨터 상호작용