창의적 글쓰기에 대한 GPT 기반 자동 평가의 신뢰성과 한계

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구는 생성형 인공지능이 생성한 텍스트에 대한 자동 평가에서, 점수 산출뿐 아니라 평가 근거 설명의 정합성에 초점을 맞추어 대형 언어 모델의 평가 신뢰성과 한계를 실증적으로 검토하고자 하였다. GPT-4로 생성된 창의적 글쓰기 텍스트 100편을 대상으로, GPT-4o와 GPT-3.5의 자동 평가 결과를 인간 전문가 평가와 비교하였다. 문법성과 흥미성을 기준으로 평균 점수, 점수 분포, 평가자 간 일치도, 정합성을 분석하였다. 분석 결과, 두 LLM은 전반적으로 인간보다 높은 점수를 부여하는 경향이 있었으며, 문법성에서는 4점 집중 경향이 두드러졌고 흥미성에서는 비교적 인간이 더 고르게 점수를 부여하였다. 정합성 분석에서는 문법성 평가에서 비교적 일관된 근거 설명이 관찰된 반면, 흥미성에서는 점수와 설명 간의 정합성이 낮게 나타났다. 이러한 결과는 LLM이 문법성과 같은 객관적 기준에서는 일정 수준의 신뢰성을 보이나, 흥미성과 같이 주관적 해석이 요구되는 영역에서는 여전히 인간 전문가의 개입이 필요함을 시사한다.

Abstract

This study investigated the reliability and limitations of large language models (LLMs) in the automated evaluation of AI-generated texts, focusing on assigned scores and the alignment between scores and rationale explanations. GPT-4o and GPT-3.5 were used to evaluate 100 creative texts generated by GPT-4, and the results were compared to those of human experts. Based on grammaticality and likability, the study analyzed the mean scores, score distributions, inter-annotator agreement (IAA), and score–rationale alignment. Both LLMs assigned higher scores than the experts, with the grammaticality scores clustered at 4; the likability scores provided by experts, however, were more evenly distributed. IAA was higher for grammaticality than for likability. In terms of alignment, the LLMs provided relatively consistent and logically grounded explanations for grammaticality but their explanations for likability require subjective interpretation. These results show that LLMs have the potential to evaluate objective aspects of writing reliably, but human judgment remains necessary for subjective evaluations.

Keywords:

Automated Writing Assessment, Evaluation Reliability, Evaluation Rationale, Large Language Models, Model Comparison Analysis키워드:

자동 글쓰기 평가, 평가 신뢰성, 평가 근거 설명, 대형 언어 모델, 모델 비교 분석Ⅰ. 서 론

인공지능(Artificial Intelligence)의 눈부신 발전은 단순한 정보 처리에서 벗어나, 이제는 창의적 사고와 판단을 요구하는 언어 생성 영역까지 그 가능성을 확장하고 있다[1],[2]. 특히 OpenAI의 GPT, Google의 Gemini, Anthropic의 Claude와 같은 최신 대규모 언어 모델(Large Language Models, LLMs)은 인간 언어의 문맥을 이해하고 설득력 있는 텍스트를 생성하는 능력을 바탕으로, 콘텐츠 요약을 포함한 콘텐츠 제작, 교육, 커뮤니케이션, 신문 기사 작성 등 다양한 분야에서 인간 전문가의 작업을 효과적으로 보조하는 도구로 활용되고 있다[3]-[7]. 이처럼 LLM의 활용 범위가 확대되면서, 실제로 AI가 생성한 다양한 글이 사회 전반에 빠르게 확산되고 있다.

또한 LLM은 단지 글을 생성하는 수준을 넘어, 문법성, 응집성, 내용의 타당성 등과 같은 언어적 품질 요소를 스스로 평가하고 판단하는 기능까지 수행하며, 자동 글쓰기 평가(Automated Writing Assessment)의 새로운 가능성을 제시한다[8],[9]. 이처럼 점수를 매기고 설명을 제공하는 기능이 확장되면서, LLM은 단순한 생성 도구를 넘어 평가의 주체로 기능할 수 있는 가능성을 보여주고 있다. 특히 글쓰기 평가와 같은 과제에서는 모델이 생성한 텍스트에 대한 점수뿐 아니라 그 판단의 근거와 언어적 설명, 즉 평가 근거 설명(rationale)이 함께 제시되면서, 평가 결과에 대한 설명의 타당성과 신뢰성이 중요한 평가 요소로 떠오르고 있다[9],[10].

기존 연구들은 자동 평가 시스템의 정량적 점수 산출 정확성이나 언어적 유창성, 문법 오류 탐지 등에 집중해 왔다[11],[12]. 그러나 자동 평가가 인간 평가자를 대체하거나 보완하는 수단으로 기능하기 위해서는 단순한 점수뿐 아니라,해당 점수를 뒷받침하는 평가 근거 설명이 논리적으로 타당하고 평가 기준에 부합하는지를 함께 고려해야 한다. 최근에는 이러한 정합성이 평가 신뢰도의 핵심 요소로 주목받고 있음에도 불구하고, LLM이 생성하는 평가 근거의 질과 정합성을 체계적으로 분석한 연구는 여전히 부족하다[9],[10],[13]. 특히, 평가 근거가 신뢰할 수 없는 경우, 모델이 산출한 점수가 아무리 높더라도 그 결과를 실제 평가 현장이나 의사결정 과정에서 활용하기 어렵다는 한계가 존재한다[10],[14].

최근에서야 일부 연구들은 평가 점수에 대한 설명의 논리성, 평가 기준과의 정합성, 설명 방식의 일관성 등에 주목하며, LLM이 단순한 점수 부여를 넘어 평가자로서 기능할 수 있는지를 탐색하기 시작했다[9],[10],[15]. 특히 창의적 글쓰기와 같이 평가 기준이 주관적이고 다차원적인 과제에서는 단순한 수치보다도 설명의 질이 평가 결과의 신뢰성과 활용 가능성에 더욱 큰 영향을 미친다 [13],[16]. 하지만 일각에서는 모델이 생성하는 설명이 그럴듯해 보이지만 실제로는 판단 기준을 오해하거나 부적절하게 일반화하는 경우도 존재하며, “그럴듯하지만 틀린 평가”는 인간 사용자가 오류를 인지하고 교정하기 어렵게 만든다는 우려도 제기되고 있다[17],[18].

이에 본 연구는 GPT-4로 생성된 창의적 글쓰기 텍스트 100편을 대상으로, GPT-4o와 GPT-3.5 두 가지 언어 모델이 생성한 평가 결과를 분석함으로써, 자동 글쓰기 평가 시스템의 신뢰성과 설명 가능성을 다각도로 탐색하고자 한다. 본 연구의 차별점은 다음과 같다. 첫째, 인간 평가자와 모델이 생성한 평가 점수를 비교하고 모델의 평가 근거 설명 자체의 논리성과 일관성을 중심으로 분석을 진행한다. 둘째, 문법성과 흥미성라는 다른 성격의 평가 기준을 적용하여, LLM이 정량적 언어 판단뿐 아니라 정성적 감성 평가까지 수행할 수 있는지를 살펴본다. 셋째, GPT 계열 모델들이 텍스트를 평가하는 과정에서 드러나는 평가 근거 설명의 오류 유형과 한계, 각 모델의 평가 특징과 상이점, 그리고 LLM 기반 자동 평가 시스템의 현장 적용 가능성과 개선 방향을 논의한다.

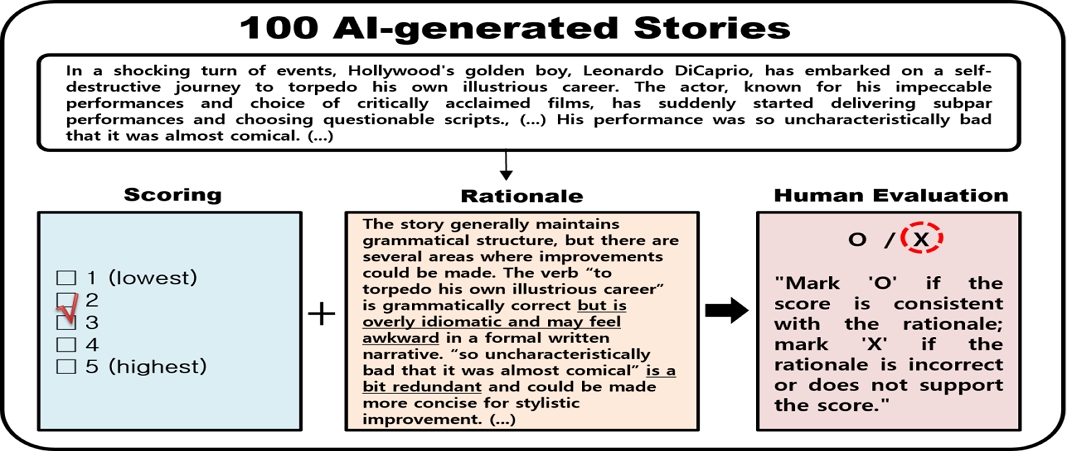

그림 1은 본 연구의 LLM 기반 평가 프레임워크를 시각적으로 나타낸 것으로, LLM이 창의적 글에 대해 5점 척도의 점수를 부여하고, 그 판단에 대한 평가 근거 설명을 함께 생성하는 전체 과정을 보여준다. 이 평가 구조는 단순 점수 산출을 넘어서, 점수와 설명 간의 정합성과 일관성까지 분석 대상으로 포함시킨다는 점에서, LLM을 평가자로 활용하는 연구 설계의 핵심을 시각적으로 요약해준다.

본 연구는 궁극적으로 AI로 생성된 텍스트 평가에서 GPT 기반 LLM이 평가 도구의 역할을 어느 수준까지 수행할 수 있는지를 확인하고, 향후 인간 평가자와의 병행 및 보완을 통해 더욱 신뢰할 수 있는 AI 평가 시스템을 구축하는 데 필요한 실증적 기반을 마련하는 데 목적이 있다. 이를 위해 인간 평가자와 LLM의 평가 점수를 비교하고, 나아가 LLM이 제시한 평가 근거 설명이 실제 점수와 논리적으로 일치하는지를 분석함으로써, LLM 기반 자동 평가의 신뢰성과 한계를 다각도로 고찰하고자 한다. 이러한 분석은 향후 인간 평가자와 AI 간의 병행 및 상호보완적 평가 시스템 구축을 위한 기초 자료로 기여할 수 있을 것이다.

Ⅱ. 관련 연구

2-1 대규모 언어 모델

대규모 언어 모델(Large Language Models, LLMs)은 자연어 처리(Natural Language Processing, NLP) 분야에 혁신적인 변화를 가져오며, 다양한 언어 과제를 수행할 수 있는 범용성과 적응성을 갖춘 기술로 주목받고 있다[19]. 트랜스포머(Transformer) 아키텍처의 도입 이후, OpenAI의 GPT-1은 약 1억 1,700만 개의 파라미터로 구성되어 사전 학습(pretraining)과 전이 학습(transfer learning)을 통해 자연어 생성의 기초를 확립하였다[19].

이후 등장한 BERT(Bidirectional Encoder Representations from Transformers)는 트랜스포머 인코더 구조를 기반으로 문맥 정보를 양방향으로 처리하며, 마스킹된 토큰을 예측하는 방식(Masked Language Modeling)과 문장 간 관계를 학습하는 Next Sentence Prediction 기법을 활용함으로써 문장의 의미를 보다 정밀하게 이해하는 능력을 크게 향상시켰다[20],[21]. RoBERTa는 더 많은 학습 데이터와 긴 학습 시간, 하이퍼파라미터 최적화를 통해 BERT의 성능을 극대화하였고[22], ALBERT는 파라미터 공유와 임베딩 분해를 통해 경량화 모델임에도 높은 성능을 보여주었다[23].

15억 개 파라미터로 구성된 GPT-2는 트랜스포머 아키텍처를 기반으로 장문 생성에서 뛰어난 일관성을 보였으며, 파인튜닝 없이 다양한 자연어 처리 과제에 적용 가능한 제로샷 수행 능력을 보여주었다[24]. 이후 BART는 디노이징 오토인코더 기반 인코더-디코더 구조를 활용하여 요약, 번역, 질의응답 등에서 강력한 성능을 보였다[25]. T5는 모든 NLP 과제를 텍스트-텍스트 변환 문제로 통일함으로써 전이 학습의 효율성과 범용성을 극대화하였다[26].

GPT-3는 1,750억 개의 파라미터로 구성되어 명시적인 fine-tuning 없이도 다양한 자연어 생성 작업에서 인간에 가까운 성능을 보였고, GPT-3.5는 RLHF(Human Feedback 기반 강화학습)를 통해 대화의 안정성과 일관성을 높인 것으로 평가받는다[27],[28]. GPT-4는 멀티모달 입력 기능과 긴 문맥 처리 능력을 갖추었으며, 문제 해결 및 추론 능력에서 기존 모델들을 능가하는 성능을 입증하였다[29]. 최근 발표된 GPT-4o는 실시간 상호작용이 가능한 멀티모달 모델로, 텍스트, 이미지, 음성을 통합적으로 처리할 수 있으며 반응 속도와 정확성 면에서 기존 GPT 계열을 뛰어넘는 성능을 보이고 있다[30].

본 연구에서는 이러한 LLM 중 GPT-4를 활용하여 AI 글쓰기 샘플을 생성한 후, GPT-4o, GPT-3.5와 같은 폐쇄형 언어모델들을 통해 해당 글에 대한 평가 점수와 평가 근거(rationale)를 수집하고, 그 정확성을 비교 및 분석하였다. 특히 각 모델이 동일한 텍스트에 대해 평가 기준을 적용하며, 평가 점수와 근거 설명 간의 정합성을 분석함으로써, LLM의 평가 기능이 실제 평가 도구로서 적용될 수 있는 가능성을 고찰하였다. 이를 통해 LLM 기반 자동 평가 시스템의 한계와 가능성을 진단하고, 향후 신뢰성 있는 AI 평가 도구 개발을 위한 기초 자료를 제공하고자 한다.

2-2 LLM 기반 글쓰기 자동 채점과 평가 근거 설명

대형 언어 모델(LLM)을 활용한 자동 글쓰기 채점(Automated Essay Scoring, AES)은 기존의 표면적 언어 특성에 기반한 점수 산출 방식에서 벗어나, 평가의 이유와 설명을 함께 제시하는 방향으로 진화하고 있다[14]. GPT 계열을 포함한 최신 LLM은 단순히 점수를 예측하는 것을 넘어서, 해당 점수를 정당화하는 평가 근거(rationale)를 자연어로 생성함으로써 평가의 투명성과 신뢰성을 강화하는 데 기여하고 있다[15],[31].

그러나 최신 모델이라 하더라도 평가 근거(rationale)의 품질은 항목에 따라 편차를 보이며, 특히 내용(content)이나 표현(expression)과 같이 추상적이고 주관성이 개입될 수 있는 평가 영역에서는 논리적 정합성이 결여되거나 과신(overconfidence)된 설명이 생성되는 경우가 많았다[15],[29]. 이러한 문제를 해결하기 위한 접근으로는 항목별 특화 프롬프트 설계가 제안되었으며, 평가 항목(fluency, usefulness, elaboration 등)을 명시적으로 구분하여 프롬프트에 반영할 경우 모델이 보다 정교한 rationale을 생성할 수 있는 것으로 나타났다[9],[10],[31],[32].

다차원적 평가 기준을 적용한 프레임워크에서는 점수와 설명을 분리 생성하거나 순차적으로 생성하도록 유도함으로써 평가 일관성과 설명 정합성이 개선되었다[11],[33]. 특히 Chain-of-Thought(CoT) 기반 프롬프트는 LLM이 단계적으로 판단 근거를 구축하도록 돕는 방식으로, rationale의 질적 수준을 향상시키는 데 효과적이었다[33],[34].

점수 예측 성능을 높이기 위한 또 다른 방법으로는 글의 언어학적 특성을 프롬프트에 통합하는 전략이 있다. 문장 길이, 어휘 다양성, 문법적 복잡도 등 정량적 언어 특성을 명시적으로 제시할 경우, 모델은 이를 근거로 점수 및 설명을 더 일관되게 생성할 수 있었으며, 이는 특히 zero-shot 상황에서도 유효하게 작동하였다[16],[33].

한편, 단순 점수 예측을 넘어 학습자에게 유의미한 피드백을 제공하는 형성평가(formative assessment) 목적의 평가 프롬프트도 주목받고 있다. 점수와 피드백을 동시 생성하도록 유도한 실험에서는 설명의 질이 향상되었고, 학습자 중심의 평가에서 LLM이 평가자 역할을 일부 수행할 수 있음을 시사하였다[33].

이러한 흐름은 Rubric 기반 다중 특성 평가 상황에서도 일관되게 나타나며, 글쓰기 유형과 평가 항목에 따라 모델이 제시하는 rationale의 구조와 질이 다르게 나타난다는 점에서, LLM 기반 AES의 실질적 신뢰도를 판단할 때 rationale 분석이 핵심 지표가 됨을 보여준다[14],[35].

이처럼 자동 글쓰기 채점에서 LLM이 제공하는 평가 근거는 단순한 부가적 설명을 넘어, 평가의 정당성과 일관성을 입증하는 중요한 지표가 되고 있다. 그러나 기존 연구는 주로 점수 예측 성능이나 설명의 유창성에 치우친 경향이 있다. 본 연구는 이러한 한계를 보완하고자, LLM이 생성한 평가 근거 설명의 신뢰성을 인간 평가자 3명이 정합성(O/X) 평가를 통해 검증하였다. 이를 바탕으로, AI가 실제 평가에서 신뢰성 있는 도구로 활용될 수 있는지, 그리고 LLM 기반 평가 시스템의 강점과 한계를 다각도로 분석한다. 특히 문법성과 흥미성이라는 성격이 다른 두 평가 항목을 중심으로, LLM이 객관적·주관적 평가 모두에서 어느 정도 역할을 할 수 있는지 실증적으로 검토한다는 점에서 의의가 있다. 이를 통해 자동 글쓰기 평가에서 평가 근거 설명의 질이 신뢰성과 투명성에 미치는 영향, 그리고 LLM 활용의 실제 가능성과 한계에 대해 논의하고자 한다.

Ⅲ. 데이터 실험 설계 연구방법

3-1 데이터 구성

본 연구에서 사용한 글쓰기 데이터는 창의적 글쓰기 능력 평가의 타당성을 확보하기 위해, 다양한 주제와 스타일의 글쓰기를 자극하는 프롬프트를 포함하도록 구성하였다. 실험에 활용된 100개 프롬프트는 Kaggle에 공개된 “WritingPrompts” 데이터셋에서 임의로 선정하였으며, 중복 또는 유사 주제가 포함되지 않도록 선정 과정에서 검토하였다 [36]. 해당 데이터셋은 표 1에 제시된 설명과 같이WP(Writing Prompt), CW(Constrained Writing), EU(Established Universe), TT(Theme Thursday) 등 다양한 유형을 포함하고 있다[37]. 또한, 다양한 장르(예: 판타지, 일상, 추리, 감정 표현 등)가 폭넓게 포함될 수 있도록 선정 과정에서 검토하였다. 최종적으로 확보된 프롬프트 100개는 모두 영어로 작성되었으며, 프롬프트별 창의적 글은 OpenAI GPT-4 API를 활용해 약 400단어 이내의 영어 글로 자동 생성하였다.

AI 기반 글쓰기는 OpenAI GPT-4 API를 활용하여 자동 생성되었다. GPT-4는 표 1과 같이 주어진 프롬프트 글쓰기 유형에 따라 각기 다른 스타일의 이야기를 생성하도록 지시되었으며, 글의 분량은 약 400단어 이내로 제한되었다. 모델에게 제공된 시스템 프롬프트는 다음과 같이 구성되었다.

“총 100개의 서로 다른 주제를 바탕으로 100개의 프롬프트가 제공되었으며, 각 항목에 따라 창의적인 글을 작성하는 과제가 주어졌다. 프롬프트는 [WP], [CW], [TT], [PM], [IP] 등 다양한 유형으로 구분되며, 각 유형의 특성에 맞는 창작 방식이 요구된다. 예를 들어, 특정 제약이나 스타일이 명시된 경우 해당 조건을 반영하여 글을 구성해야 한다. 다음과 같은 유형에 속하지 않는 프롬프트의 경우에는 자유로운 창작이 가능하지만, 기본적으로 독창적인 이야기 형식을 유지해야 한다. 생성된 글은 400단어를 초과하지 않도록 하고, 각 문장은 마침표(.)로 끝나는 등 문장 구조와 주제 반영에 유의하여 작성해야 한다.”

3-2 평가 기준 및 절차

본 연구는 창의적 글쓰기 평가에서의 신뢰성과 타당성을 확보하기 위하여, Chiang의 선행 연구를 바탕으로 평가 기준을 활용하여 구성하였으며, 총 두 가지 항목에 대해 평가를 실시하였다. 구체적으로는, 선행 연구에서 제시한 네 가지 평가 항목 중 인간 평가자 사이의 일치도가 가장 높은(객관적인) ‘문법성(grammaticality)’과, 일치도가 가장 낮고 평가자의 개별적 판단이 크게 영향을 미치는(주관적인) ‘흥미성(likability)’의 극점을 비교 대상으로 삼아, 인간 평가자 및 LLM 평가 모두에서 두 기준이 갖는 차이와 특성을 집중적으로 분석하기 위함이다 [38]. 표 2와 같이, 평가 항목은 문법성(grammaticality), 흥미성(likability)으로 구성되며, 각 항목은 5점 리커트(Likert) 척도를 기준으로 하여 점수별로 명확한 판단 기준을 제공하도록 설계되었다 [38].

문법성(grammaticality) 항목은 문장 내 문법적 오류의 존재 여부와 문장의 구조적 정확성을 중심으로 평가되었다. 1점은 문법적 오류가 빈번하고 의미 해독이 어려운 경우, 2점은 오류가 흐름을 방해하되 부분적으로 이해할 수 있는 경우에 해당한다. 3점은 의미 전달에는 지장이 없으나 오류가 다소 존재하는 상태, 4점은 대체로 정확하나 문장 부호나 어색한 표현 등 사소한 문제가 있는 경우이며, 5점은 문법적 오류가 전혀 없고 문장이 명확하고 자연스럽게 구성된 경우로 판단되었다.

흥미성(likability) 항목은 텍스트가 독자에게 얼마나 흥미롭고 몰입감 있게 다가오는지를 평가하였다. 1점은 전혀 흥미를 유발하지 못하며 감정적 연결이 결여된 경우, 2점은 약간의 흥미 요소는 있으나 서사적 깊이가 부족한 경우로 간주된다. 3점은 부분적으로 흥미로운 지점을 포함하나 전체적인 몰입도가 평균 수준에 그치는 경우, 4점은 대체로 흥미를 유지하며 독자의 관심을 끄는 경우, 5점은 독창성과 정서적 반응을 동시에 유발하며 강한 인상을 남긴 경우로 판단된다.

이러한 5점 척도 기준은 정성적 평가뿐 아니라, 각 점수에 수반된 평가 설명(rationale)의 타당성을 분석하는 데에도 함께 활용되었으며, 인간 평가자의 점수와 비교하여 각 모델의 평가 역량을 다각도로 검토하는 데 중요한 기초 지표로 작용하였다. 각 점수별 평가 기준과 예시는 표 2에 제시하였다.

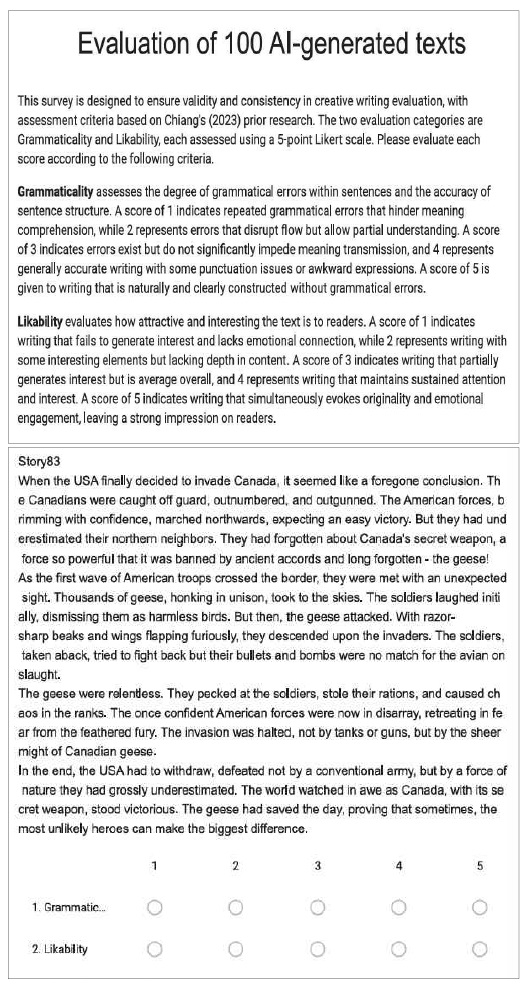

인간 평가는 영어영문학 전공 석사학위 이상 소지자 3인이 각 100개의 텍스트에 대해 문법성, 흥미성 항목별로 5점 척도 점수를 부여하도록 하였다. 평가는 그림 2와 같이 Google Forms 온라인 설문 도구를 통해 진행되었으며, 평가 과정에서 각 평가자는 다른 평가자의 결과를 알 수 없도록 블라인드 평가가 이루어졌다. 최종적으로 3명의 평가자 기반의 신뢰도(Inter-Annotator Agreement)를 산출해 평가 결과의 신뢰성과 타당성을 정량적으로 분석하였다.

본 연구에서는 GPT-4o 및 GPT-3.5의 두 가지 대형 언어 모델(LLMs)을 활용하여, GPT-4로 생성된 창의적 글쓰기 텍스트 100편에 대해 자동 평가를 수행하였다. 본 연구에서는 현재 연구 및 실제 활용 현장에서 가장 널리 사용되고 있는 GPT 계열을 대표 LLM으로 선정하였다. 최근 Gemini, Claude 등 다양한 LLM이 등장하고 있으나, GPT 계열은 국·내외 연구 및 산업계에서 표준 벤치마크로 가장 폭넓게 활용되고 있어 본 연구의 평가 모델로 선정하였다. 각 모델은 문법성(Grammaticality), 흥미성(Likability)의 두 가지 항목에 대해 1점에서 5점까지의 점수(scoring)를 부여하였으며, 동시에 각 점수에 대한 평가 근거 설명(rationale)을 함께 생성하였다. 이와 같은 설명은 모델이 평가를 수행한 이유를 언어적으로 명시한 것으로, 단순한 수치 산출을 넘어서 LLM의 내부 판단 근거와 추론 논리를 분석하는 데 중점을 두었다. 평가에 사용된 프롬프트는 다음과 같다.

“문법성(grammaticality) 평가는 이야기 텍스트의 문장 구조, 시제 일치, 맞춤법, 문장 부호 등 언어적 정확성에 중점을 두어 이루어진다. 평가자는 글의 전반적인 문법적 완성도를 고려하여 1점에서 5점 사이의 점수를 부여한다. 1점은 문법적 오류가 매우 빈번하여 읽기가 어렵고 의미를 해석하기 힘든 경우에 해당한다. 2점은 자주 발생하는 문법 오류로 인해 읽기의 흐름이 방해받으나, 일부 내용은 이해가 가능한 경우로 판단한다. 3점은 다소의 문법적 문제는 존재하지만, 전체적인 의미 전달에는 큰 장애가 없는 상태를 의미한다. 4점은 전반적으로 문법적으로 정확하나, 문장 부호나 드물게 나타나는 어색한 표현 등 경미한 오류만이 관찰되는 경우에 해당한다. 5점은 문법적 오류가 전혀 없으며, 모든 문장이 명확하고 자연스럽게 구성된 경우로 평가한다. 평가자는 자신이 부여한 점수에 대한 이유를 구체적이고 논리적인 설명으로 10문장 내외로 기술해야 한다.

흥미성(likability) 평가는 이야기의 창의성, 몰입도, 표현력 등 독자의 관심과 감정적 반응을 유발하는 정도를 중심으로 이루어진다. 평가자는 작품이 얼마나 흥미롭고, 독자의 몰입을 유도하는지에 따라 1점에서 5점까지 점수를 부여한다. 1점은 이야기가 전혀 흥미를 유발하지 못하고, 독자의 관심이나 감정적 참여를 이끌지 못한 경우에 해당한다. 2점은 약간의 흥미 요소는 있으나 전체적으로 평범하고 몰입도가 부족한 경우로 간주한다. 3점은 부분적으로 흥미롭거나 독자의 관심을 끄는 요소가 있으나, 전반적으로는 평균적인 인상을 주는 경우이다. 4점은 이야기의 흐름이나 표현력이 대체로 독자의 관심을 지속적으로 끌며, 몰입을 유도하는 경우이다. 5점은 이야기 자체가 매우 흥미로우며, 독자에게 강렬한 인상과 감정적 반응을 남기는 경우로 평가한다. 평가자는 부여한 점수의 근거를 구체적이고 논리적인 설명으로 10문장 내외로 상세히 작성해야 한다.”

정합성 평가는 영어영문학과 박사학위를 소지한 교육자 3인으로, AI로 생성된 텍스트 100개가 수록된 워드 파일과 함께, 텍스트의 번호, 모델이 제시한 문법성(grammaticality) 및 흥미성(likability) 점수(1–5점), 그리고 해당 점수에 대한 서술형 평가 근거가 포함된 엑셀 파일을 제공받았다. 평가는 각 텍스트의 글을 읽고, 해당 점수와 근거가 논리적으로 일치하는지 여부에 따라 모델 엑셀 파일의 평가 컬럼에 ‘O’(일치) 또는 ‘X’(불일치)를 직접 기입하는 방식으로 이루어졌다.

또한, 텍스트별로 전문가 3인의 평가 결과 중 과반수(O 혹은 X)가 나온 값을 최종 결과로 산정하였다. 즉, 한 텍스트에 대해 O가 2개 또는 3개일 경우 최종 결과는 O, X가 2개 또는 3개일 경우 최종 결과는 X로 결정하였다. O와 X의 빈도 분석을 통해, 언어모델의 평가 근거가 실제 점수와 얼마나 논리적으로 일치하는지에 대한 정합성을 정량적으로 평가하였다.

Ⅳ. 연구 결과

4-1 측정 지표

본 연구의 정량적 평가는 평균 (Mean), 표준편차 (Standard Deviation)를 구하였다. 평균은 창의성 평가에서 도출된 점수들의 중심 경향을 나타내는 지표로, 각 텍스트에 부여된 점수의 총합을 텍스트의 전체 수로 나누어 산출된다. 이는 각 텍스트의 점수를 합산한 후 텍스트의 총 개수로 나눈 값으로 계산된다. μ는 평균, 𝑁은 텍스트의 총 개수, xi는 각 텍스트의 점수를 의미한다. 평균 점수가 높다는 것은 해당 글쓰기가 전반적으로 긍정적인 평가를 받았음을 의미하며, 반대로 평균 점수가 낮으면 전반적인 평가 결과가 부정적이었음을 보여준다 [39].

| (1) |

표준편차는 점수들이 평균을 중심으로 얼마나 흩어져 있는지를 나타내며, 평가 결과의 변동성과 일관성을 판단하는 데 중요한 기준이 된다. σ는 표준편차, n은 점수의 총 개수, 은 평균점수 xi 각 점수를 의미한다. 표준편차가 낮을수록 점수들이 평균값 주변에 밀집되어 있다는 것을 뜻하며, 높을수록 점수의 분산이 크고 다양하게 퍼져 있음을 보여준다 [40].

| (2) |

상호 평가자 일치도(Inter-Annotator Agreement, IAA)는 다수의 평가자들이 동일 항목에 대해 부여한 점수의 일관성을 나타내는 지표로, 평가 과정의 신뢰성과 객관성을 정량적으로 평가하는 데 활용된다. 여기서 각 기호는 관측된 불일치도(Do), 기대 불일치도(De), 평가자 수(n), 항목의 인덱스(c), 범주의 수(𝑘), c와 𝑘 사이의 평가 차이를 제곱한 값(), 범주 𝑘의 비율(pk), 범주 𝑘에 속한 항목 수(nk)를 포함한다. IAA의 값은 0에서 1 사이로 계산되며, 1에 가까울수록 평가자 간 점수 부여가 일치함을, 0에 가까울수록 일치도가 낮음을 의미한다 [41].

| (3) |

| (4) |

| (5) |

4-2 주요 결과

본 연구에서는 GPT-4o와 GPT-3.5 두 종류의 대형 언어 모델(LLM)을 활용하여, GPT-4가 생성한 창의적 영어 글쓰기 텍스트 100편에 대한 자동 평가를 실시하고, 그 결과를 인간 전문가 3명의 평가와 비교하였다. 인간 평가자는 문법성(grammaticality)과 흥미성(likability) 두 항목에 대해 점수를 부여하였으며, LLM은 동일한 항목에 점수와 함께 각 점수의 근거(rationale)를 서술형으로 생성하도록 설계되었다.

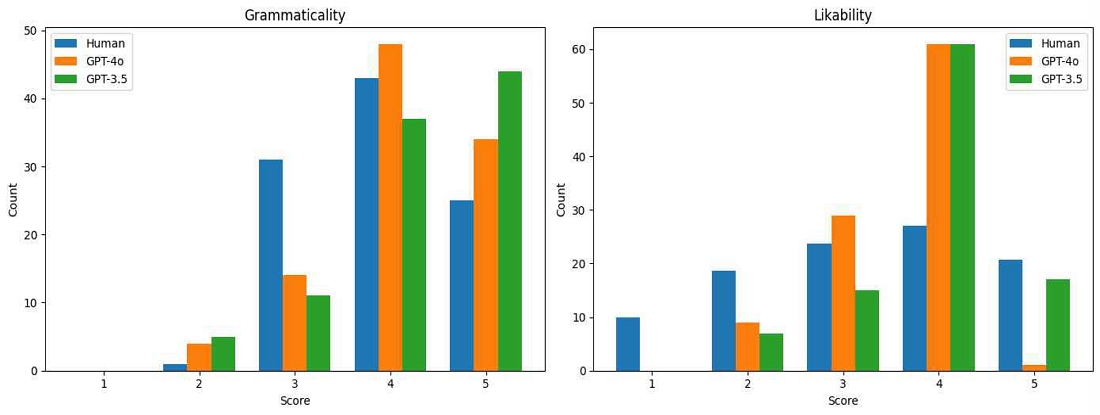

각 평가 항목별 평균과 표준편차는 표 3에 나타냈고, 인간 평가자 간의 상호 일치도(Inter-Annotator Agreement, IAA)는 표 4에 제시하였다. 점수별 빈도 분포는 인간 평가자의 경우 3인이 각각 독립적으로 평가한 점수를 기준으로 점수별 평균을 산출하였으며, LLM의 경우 각 텍스트에 대해 1회의 평가 결과를 집계하였다. 이 결과는 표 5와 같이 제시하였다. 또한, 평가 점수의 빈도 분포를 시각화한 결과는 그림 3에 나타내었다. 또한, LLM이 생성한 평가 근거 설명이 실제 점수와 논리적으로 일치하는지 여부를 분석하기 위해, 인간 평가자 3인을 대상으로 정합성(O/X) 평가를 실시하였다. 각 텍스트별로 점수와 근거 설명이 논리적으로 일치한다고 판단될 경우 ‘O’, 불일치할 경우 ‘X’로 표기하였으며, 표 6과 같이 그 결과를 제시하였다. 이때 각 텍스트별로 3인의 평가 결과 중 과반수 기준으로 최종 정합성 결과를 산출하였다.

먼저 문법성(grammaticality) 항목에 대한 평가 결과, LLM과 인간 평가자 간 점수 부여 경향과 분포에서 차이가 나타났다. 표 3과 같이 GPT-4o와 GPT-3.5는 각각 평균 4.12(SD=0.79), 4.11(SD=1.11)를 기록하였다. 반면, 인간 평가자 평균은 3.92(SD=0.77)로 다소 낮은 수치를 보였다. 이는 두 LLM 모두 문법성 판단에서 실제 인간 평가자보다 더 관대한 평가를 내렸음을 시사한다. 한편, 표 4와 같이 인간 평가자 간의 상호 일치도(Inter-Annotator Agreement, IAA)는 문법성 항목에서 0.69(75%)로 비교적 높은 수준을 기록하였다. 이는 문법성 평가에서 전문가들 사이에 판단 기준이 일관되게 적용되고 있음을 보여준다. 즉, 문법성 평가는 객관적 기준이 비교적 명확하게 작동하는 영역임을 시사한다.

점수 분포 역시 표 5와 그림 3과 같이 GPT-3.5의 경우 5점이 44건, 4점이 37건으로 전체의 81%가 상위 점수(4-5점)에 집중되어 있었다. GPT-4o 역시 4점(48건), 5점(34건)으로 상위 점수 비율이 82%에 달했다. 반면, 인간 평가자는 4점(43건)과 3점(31건)에 가장 많이 분포하였고, 5점(25건)의 빈도는 LLM에 비해 상대적으로 적었다. 이러한 결과는 LLM이 인간 평가자보다 전반적으로 높은 점수를 부여하며, 점수 분포도 상위 점수에 집중되는 경향이 강함을 보여준다. 1점과 2점은 모든 평가에서 거의 부여되지 않았는데, 이는 실험에 사용된 텍스트들이 최소한의 문법적 완성도를 갖추고 있었기 때문으로 해석할 수 있다.

흥미성(likability) 항목의 평가 결과 역시 LLM과 인간 평가자 간에 점수 부여 및 분포에서 차이가 나타났다. 표 3과 같이, GPT-3.5는 흥미성 평균 3.88(SD=0.77), GPT-4o는 3.54(SD=0.67)의 점수를 보였다. 이는 인간 평가자의 평균 점수 3.30(SD=1.27)보다 각각 0.58점, 0.24점 높은 수치로, LLM이 전반적으로 인간 평가자에 비해 흥미성도 더 높게 평가하는 경향을 보여준다. 특히 GPT-3.5는 모든 모델 중 흥미성 점수가 가장 높았다. 한편, 표 4와 같이 인간 평가자 간의 상호 일치도(Inter-Annotator Agreement, IAA)는 흥미성 항목에서 0.34(32%)로, 현저히 낮은 수치를 기록했다. 이는 흥미성 평가가 인간 평가자들 사이에서도 매우 주관적으로 이루어지며, 일관성 있는 기준이 적용되기 어려운 영역임을 시사한다.

점수 분포 역시 표 5와 그림 3과 같이 GPT-3.5와 GPT-4o 모두 4점에 점수가 몰려 있으며, 각각 61건, 29건으로 전체 평가의 과반수 이상이 4점에 집중되어 있다. 반면 인간 평가자는 3점(27건), 4점(27건), 5점(20.7건 평균)에 점수가 상대적으로 고르게 분포하였다. 또한 LLM은 5점 부여가 극히 적은 반면, 인간 평가자의 경우 5점에 대한 평가 빈도가 비교적 높았다. 이러한 분포는 LLM이 흥미성 항목에서도 전반적으로 중간점수 및 4점 점수에 집중하는 경향이 있음을 보여준다.

전체적으로 본 연구에서 분석한 문법성(grammaticality)과 흥미성(likability) 두 평가 항목 모두에서, GPT 계열 LLM(GPT-4o, GPT-3.5)은 인간 평가자 3인에 비해 상대적으로 더 높은 점수를 부여하는 경향이 나타났다. 특히 문법성 항목의 평균 점수는 세 집단 모두에서 흥미성 항목보다 높게 나타나 AI가 생성한 텍스트가 문법적 완성도를 반영하고 있음을 보여준다.

또한, 인간 평가자 간의 일치도(IAA) 문법성 항목에서 0.69(75%)로 비교적 높은 수준을 보인 반면, 흥미성 항목에서는 0.34(32%)로 현저히 낮았다. 이러한 결과는 문법성 평가는 객관적이고 일관된 기준이 적용되는 반면, 흥미성 평가는 평가자 간 주관적 편차가 크고 일관성 확보가 어렵다는 점을 의미한다. 더불어, 표 5와 그림 3에서 볼 수 있듯 문법성 점수 분포에서는 1점이 전혀 부여되지 않았고, 2점도 극히 드물었다. 이는 GPT-4로 생성된 텍스트가 전반적으로 문법적 오류 없이 안정적인 품질을 보이고 있음을 시사한다.

반면, 흥미성 점수 분포에서는 1점과 2점이 상대적으로 더빈번하게 나타났으며, LLM의 경우 5점의 비율이 문법성에 비해 뚜렷하게 감소하였다. 이 같은 분포는 LLM이 흥미성 측면에서는 완전히 만족스럽지 못하거나, 평가자들의 해석에 따라 저평가될 수 있음을 의미한다. 요약하면, LLM 기반 자동 평가는 문법성과 같은 객관적 기준에서는 신뢰성 있는 도구로서 활용 가능성이 높으나, 흥미성처럼 주관적 평가가 필요한 영역에서는 인간 평가자와의 일치도 및 평가의 다양성 측면에서 여전히 한계가 있음을 알 수 있다.

마지막으로, 평가 근거 설명의 정합성(O/X) 결과는 표 6과 같이, 문법성과 흥미성 두 항목에서 모두 GPT-3.5가 GPT-4o보다 더 높은 일치도를 보였다. 문법성 항목에서는 GPT-4o가 63%(O=63, X=37), GPT-3.5가 87%(O=87, X=13)의 정합성 비율을 기록하였다. 반면 흥미성 항목에서는 GPT-4o가 59%(O=59, X=41), GPT-3.5가 68%(O=68, X=32)로 두 모델 모두 정합성 비율이 다소 낮아졌다. 이는 문법성과 같은 객관적 평가 기준에서는 LLM이 더 일관성 있는 근거 설명을 제시할 수 있지만, 흥미성과 같이 주관적 판단이 요구되는 항목에서는 평가 근거와 점수 간 일치도가 상대적으로 약화함을 시사한다.

모델별 설명 방식에서도 뚜렷한 차이가 나타났다. GPT-4o는 평가 기준에 충실하려는 경향이 강하게 나타나, 어순 오류, 관사 누락, 반복 표현, 주어-동사 불일치 등 문법적 세부 요소를 꼼꼼히 지적하고, 문장 구조와 문체 흐름까지 체계적으로 분석하는 구조화된 평가 근거를 자주 제공했다. 그러나 이러한 세분화된 분석으로 인해 설명이 장황하게 늘어지는 경향도 관찰되었으며, 일부 경우에는 평가자의 핵심 판단을 명확하게 드러내지 못하는 한계가 있었다. 반면 GPT-3.5는 감정적 공감, 흥미 유발 요소, 서사 메시지의 전달력 등 독자 관점의 효과에 초점을 맞춘 간결하고 일관된 설명을 제시하는 경우가 많았지만, 정확성에서 떨어졌다.

항목별 O/X 분포를 보면, 문법성과 같은 객관적 평가 기준에서는 두 모델 모두 ‘O’의 비율이 높게 나타났지만, 흥미성과 같은 주관적 기준에서는 ‘X’의 비율이 상대적으로 높게 나타났다. 이러한 결과는 문법성의 경우 평가자 간 평가의 일관성이 높고 명확한 오류 기준에 따라 논리적 설명을 제공하기 쉬운 반면, 흥미성 항목은 평가자의 경험, 취향, 감정적 반응에 따라 평가 기준 자체가 다양하게 해석될 수 있기 때문으로 해석할 수 있다. 즉, 객관적 평가 기준에서는 LLM의 근거 설명이 점수와 일관되게 제시될 가능성이 높지만, 주관적 평가 기준에서는 모델이 논리적 일관성을 유지하는 데 한계가 있음을 알 수 있다.

이처럼 GPT-4o와 GPT-3.5 모두 동일한 텍스트에 대해 문법성과 흥미성 항목 각각에서 점수와 근거를 체계적으로 제시함으로써, 단순한 점수 산출을 넘어 평가의 논리적 정당성과 설명 가능성을 확보하려는 시도가 이루어졌음을 알 수 있다. 이러한 설명형 평가 근거는 AI 기반 글쓰기 자동 평가 및 피드백 시스템에서 평가 결과의 신뢰성과 해석 가능성을 크게 높일 수 있는 중요한 자원이며, 실제 교육 및 평가 현장에서 피드백의 질과 신뢰도를 동시에 강화하는 데 효과적으로 활용될 수 있을 것으로 기대된다.

4-3 사례 연구

본 절에서는 앞선 정량적 분석 결과를 바탕으로, GPT-4로 생성된 창의적 글쓰기 텍스트 100편에 대해 GPT-4o, GPT-3.5의 두 가지 대형 언어 모델(LLMs)이 수행한 평가 중 항목별로 두드러진 강점과 약점이 드러난 사례들을 중심으로 정성적 분석을 진행한다. 각 모델은 문법성(grammaticality), 흥미성(likability)을 포함한 평가 기준에 대해 1점부터 5점까지 점수를 부여하고, 해당 점수의 판단 근거를 평가 근거 설명의 형태로 제시하였다. 본 사례 연구는 이러한 평가 근거 설명이 각 항목의 특성과 얼마나 잘 연결되는지를 분석하고, 각 모델의 판단 방식에서 나타나는 서술적 강점과 논리적 한계를 구체적으로 검토한다. 이를 통해 LLM 평가의 신뢰성과 한계에 대한 실제적 이해를 바탕으로, 향후 평가 일관성 확보의 가능성을 탐색하고, 대형 언어 모델을 평가 도구로 활용할 수 있는 실질적 방안을 제시하고자 한다.

본 연구에서 확인된 LLM 기반 평가의 가장 뚜렷한 강점은 문법성(grammaticality) 항목에서의 높은 신뢰성과 일관된 평가 결과에 있다.

표 7의 사례는 GPT-4o가 문법성(grammaticality)을 평가할 때 명확하고 구체적인 평가 근거 설명을 제시하는지를 잘 보여준다. 해당 글에 대해 GPT-4o는 3점을 부여하였으며, 단순한 총평이 아닌 다수의 문장 오류를 항목별로 지적하며 점수의 이유를 설득력 있게 설명하였다. 특히 “Cold-play”를 “legendary singer”(“singer” 대신 “band”)로 표현한 오류를 실제 지식 기반에서 수정해야 할 어휘 선택 오류로 지적하고, “reading someone's minds”와 같은 복수형-단수형 혼용, 시제 불일치(“gives” 대신 “gave”), 구두점 누락, 비격식 표현 등 문법 전반의 세부 요소를 체계적으로 분석하였다. 이처럼 문법 항목에 대한 LLM의 설명은 단지 오류 유무를 판별하는 데 그치지 않고, 오류의 종류와 수정을 위한 대안을 함께 제시함으로써, 평가자의 판단 기준이 단순 수치가 아닌 설명 기반 정당성을 확보하고 있음을 보여준다.

또한, 전반적인 의미 전달은 가능하지만, 문법적 일관성이 서사 흐름에 영향을 미친다는 점에서 중간 점수인 3점을 부여한 판단 역시 논리적 타당성이 확보된다.

이 사례는 LLM이 문법성 항목에서 오류를 분명히 포착하고 명확하게 기술할 수 있는 능력을 지니고 있으며, 평가 근거 설명 또한 평가 점수와 정합적으로 연결되어 있음을 보여주는 대표적 예시라 할 수 있다. 특히 자동 평가 시스템의 관점에서 볼 때, LLM은 평가자의 주관적 판단이 개입되기 쉬운 문법 오류 탐지에 있어 일관된 기준과 정형화된 언어 지식을 기반으로 한 신뢰도 높은 판단을 지속적으로 제공할 수 있다는 점에서 매우 유용하다. LLM은 학습된 언어 규범과 예외 패턴에 따라 오류를 체계적으로 식별하고, 구체적이고 재현 가능한 설명을 덧붙일 수 있다는 점에서 자동화의 효율성과 신뢰성을 동시에 확보할 수 있다. 또한 평가 설명의 수준 역시 단순 오류 지적에 그치지 않고, 수정을 위한 대안 제시, 문장 흐름에 미치는 영향 분석, 서사 전개와의 연계성까지 언급함으로써 평가 결과를 보다 투명하게 해석할 수 있도록 돕는다. 이러한 특성은 평가 대상이 대규모일 때 특히 강점을 가지며, 교육 현장이나 자동 채점 시스템에서 인간 평가자의 부담을 덜고 보조 도구로 활용될 수 있는 가능성을 높인다. 결과적으로 문법성 항목에 대한 LLM 기반 자동 평가는 평가 효율성과 설명 가능성, 반복성과 신뢰성을 모두 충족시키는 강력한 대안으로 기능할 수 있다.

LLM 기반 자동 평가는 일정 수준 이상의 언어 이해 능력과 문장 생성 능력을 바탕으로 정형화된 평가 기준에 따라 비교적 일관된 판단을 제공할 수 있다는 점에서 실용적 장점을 지닌다. 그러나 실제 평가 상황에 적용하기에는 다음과 같은 구조적 제약과 신뢰성의 문제가 확인되었다.

표 8은 GPT-3.5가 흥미성(likability) 항목에서 창의적인 서사 구성을 가진 글에 대해 2점을 부여한 사례로, 평가 점수와 평가 근거 설명 간의 정합성에 일정한 불일치가 드러나는 사례로 해석될 수 있다. 해당 글은 마법이 사용자마다 다르게 발현된다는 독창적인 설정을 기반으로, 감정의 복잡성과 개성의 표현을 은유적으로 구현한 서사로 구성되어 있다.

글 전반에 걸쳐 등장인물의 감정과 정체성이 마법의 기원으로 비유되어 제시되며, 이는 정서적 상상력을 유도하는 서사적 장치로 평가될 수 있다. 그러나 GPT-3.5는 이 글에 대해 “흥미 요소 부족”, “정서적 연결 미흡”, "지속적인 관심 유발 실패" 등을 주요 근거로 제시하며 낮은 점수를 부여하였다. 이러한 평가는 부분적으로는 반복 표현이나 서사 전개 부족에 대한 타당한 지적을 포함하고 있으나, 글이 전달하는 감성적 주제와 은유적 표현, 그리고 세계관 구축을 통한 창의적 서사 구조에 대한 고려는 부족한 것으로 보인다. 예를 들어, “이야기가 정보 전달문처럼 느껴진다”거나 “등장인물이나 플롯이 부재하다”는 평가 설명은, 의도적으로 정형화된 서사보다 서정적 묘사에 초점을 둔 문체의 특성을 제대로 반영하지 못한 해석으로 볼 수 있다. 또한 독자의 감정적 공감을 유도하기 위한 문장의 정서적 표현이나 상징성에 대해 평가 설명이 피상적인 언어적 반복에만 초점을 두고 있어, 평가 기준이 요구하는 다양성과 복합성을 충분히 반영하지 못하고 있음을 보여준다.

결과적으로 GPT-3.5는 창의성과 감정 중심 서사와 같은 정성적 요소에 대한 해석과 판단에서 일정 수준의 한계를 드러냈으며, 이는 흥미성과 같은 주관적 평가 항목에서 모델의 판단이 인간 독자의 감성적 반응을 정밀하게 모사하기에는 여전히 미흡함을 시사한다. 이 사례는 향후 LLM 기반 평가 시스템이 정서적, 서사적 깊이를 보다 세밀하게 파악할 수 있도록 학습 설계와 설명 생성 방식을 개선할 필요가 있음을 보여주는 중요한 단초로 해석될 수 있다. 궁극적으로 인간 평가자와의 협업을 통해 감성적 의미를 보완하는 방향으로 평가 시스템을 구축하는 것이 바람직할 것이다.

Ⅴ. 결 론

본 연구는 생성형 인공지능의 활용이 확산됨에 따라, 자동 생성 텍스트에 대한 신뢰 가능한 평가 기준의 필요성이 제기되고 있다는 인식에서 출발하였다. 이를 위해 GPT-4o와 GPT-3.5 등 최신 대형 언어 모델(LLM)을 활용하여, GPT-4가 생성한 창의적 영어 글쓰기 텍스트 100편에 대해 문법성(grammaticality)과 흥미성(likability) 항목으로 자동 평가를 수행하고, 그 결과를 인간 전문가 3명의 평가와 정량적으로 비교 및 분석하였다. 평가 항목별 평균, 표준편차, 인간 평가자 간 일치도(IAA), 그리고 LLM이 생성한 평가 근거(rationale) 정합성을 종합적으로 분석함으로써, LLM 기반 자동 평가의 신뢰성과 한계, 실질적 적용 가능성을 다면적으로 탐색하였다.

연구 결과, 두 LLM은 인간 평가자에 비해 문법성 및 흥미성 항목 모두에서 전반적으로 더 높은 점수를 부여하는 경향을 보였다. 문법성 항목에서는 AI가 생성한 텍스트의 문법적 완성도가 높게 유지되었고, 인간 평가자 간 일치도 또한 높게 나타났다. LLM의 자동 평가는 반복성과 신뢰성, 구체적인 오류 설명 등에서 강점을 보였으며, 실제 사례에서도 어휘, 시제, 어순 등 다양한 문법적 오류를 체계적으로 지적하고 평가 근거를 논리적으로 제시하는 등 평가의 일관성과 설명 가능성을 크게 높였다. 정합성 분석에서는, GPT-3.5가 GPT-4o보다 평가 근거 설명 간의 논리적 일치도가 더 높게 나타났으며, 두 모델 모두 문법성과 같이 객관적 기준에서는 정합성이 높았으나, 흥미성과 같이 주관적 기준에서는 점수와 근거 간 일치도가 상대적으로 낮아지는 경향을 보였다.

반면, 흥미성 항목에서는 점수 분산이 크고 인간 평가자 간 일치도 매우 낮았으며, LLM 또한 점수와 평가 근거 설명의 일치도에서 한계를 드러냈다. 사례분석 결과, GPT-3.5 등 LLM은 감정적 공감, 창의적 세계관 등 인간 평가자의 정성적 해석을 충분히 반영하지 못하는 경우가 있었으며, 이는 주관적 평가 항목에서 LLM이 신뢰성 있게 평가를 수행하기에는 아직 보완이 필요함을 시사한다.

실험 결과를 종합하면, LLM 기반 자동 평가는 문법성 등 객관적 평가 기준에서는 신뢰성과 효율성을 갖춘 평가 보조 도구로 활용 가능성이 높으나, 흥미성 등 주관적 평가 기준에서는 인간 평가자의 해석과 협업이 여전히 필수적임을 알 수 있다. 특히 점수와 평가 근거 설명의 정합성을 실증적으로 확인함으로써, LLM 평가의 한계와 신뢰성을 모두 구체적으로 진단할 수 있었다.

또한, 본 연구에서는 흥미성 등 주관적·정서적 평가 항목에서 일관성이 낮게 나타나는 한계가 드러났다. 이는 평가 기준을 명확히 제시하더라도, 창의성 및 감성 평가에는 불가피하게 개인차가 개입될 수밖에 없다는 평가 신뢰성의 본질적 한계임을 시사한다. 또한, 평가 대상 LLM을 GPT 계열로 한정했기 때문에 Gemini, Claude 등 다양한 최신 모델을 포함한 비교 및 분석이 이루어지지 못한 점, 인간 평가자가 수치만을 제공한 점 등도 본 연구의 한계로 남는다. 아울러, 분석에 사용된 글쓰기 데이터의 양이 제한적이었으므로, 향후에는 더 방대한 규모의 글쓰기 샘플과 다양한 장르를 포함한 연구가 이루어질 필요가 있다.

향후 연구에서는 다양한 LLM(Gemini, Claude, Perplexity 등)을 포함한 폭넓은 평가 비교, 더욱 세분화된 평가 기준 도입, 그리고 인간 평가자의 설명형 평가 근거 수집 및 분석이 요구된다. 또한, 최근 AI 글쓰기, AI 기자 등 AI가 실제로 생산하는 다양한 유형의 텍스트가 사회적으로 빠르게 확산되고 있음을 고려할 때, AI 글쓰기에 대한 평가 방식 또한 한층 다양화될 필요가 있다. 평가의 신뢰성(robustness)과 윤리적 측면(ethics)까지 포괄하는 실증 연구와 실질적으로 교육 및 미디어 현장에서 활용 가능한 자동 피드백 및 평가 시스템 개발이 미래 연구의 중요한 과제로 남을 것이다.

따라서 향후 글쓰기 평가 체계는 대형 언어 모델의 효율성과 인간 평가자의 전문성을 상호보완적으로 결합하는 방식으로 설계되어야 하며, 평가 항목별 정합성 기준 정교화, 설명 품질 향상, 인간 및 AI 협력 구조 설계 등 후속 연구가 지속적으로 요구된다. 이러한 방향은 인간의 창의성과 해석 능력, 그리고 LLM의 객관성과 일관성을 결합하여 더욱 신뢰도 높은 평가 환경을 구축하는 데 기여할 수 있을 것이다.

Acknowledgments

본 연구는 2025년도 한국연구재단의 지원에 의하여 이루어진 연구(NRF-2025S1A5B5A17014769)로서, 관계 부처에 감사드립니다.

References

-

J. Vinothkumar and A. Karunamurthy, “Recent Advancements in Artificial Intelligence Technology: Trends and Implications,” Quing: International Journal of Multidisciplinary Scientific Research and Development, Vol. 2, No. 1, pp. 1-11, 2023.

[https://doi.org/10.54368/qijmsrd.2.1.0003]

-

J. G. Meyer, R. J. Urbanowicz, P. C. N. Martin, K. O’Connor, R. Li, P.-C. Peng, T. J. Bright, ... and J. H. Moore, “ChatGPT and Large Language Models in Academia: Opportunities and Challenges,” BioData Mining, Vol. 16, 20, pp. 1-11, July 2023.

[https://doi.org/10.1186/s13040-023-00339-9]

-

M. M. Mijwil, K. K. Hiran, R. Doshi, M. Dadhich, A.-H. Al-Mistarehi, and I. Bala, “ChatGPT and the Future of Academic Integrity in the Artificial Intelligence Era: A New Frontier,” Al-Salam Journal for Engineering and Technology, Vol. 2, No. 2, pp. 116-127, April 2023.

[https://doi.org/10.55145/ajest.2023.02.02.015]

-

OpenAI, J. Achiam, S. Adler, S. Agarwal, L. Ahmad, I. Akkaya, ... and B. Zoph, “GPT-4 Technical Report,” arXiv:2303.08774v6, , March 2024.

[https://doi.org/10.48550/arXiv.2303.08774]

-

D. Kevian, U. Syed, X. Guo, A. Havens, G. Dullerud, P.Seiler, ... and B. Hu, “Capabilities of Large Language Models in Control Engineering: A Benchmark Study on GPT-4, Claude 3 Opus, and Gemini 1.0 Ultra,” arXiv:2404.036474v1, , April 2024.

[https://doi.org/10.48550/arxiv.2404.03647]

-

S. Yoon and Y. Shin, “A Study on Automatic Metrics for Korean Text Abstractive Summarization,” The Transactions of the Korea Information Processing Society, Vol. 13, No. 12, pp. 691-699, 2024.

[https://doi.org/10.3745/TKIPS.2024.13.12.691]

-

L.-Z. Quan, “The Impact of News Written by AI Reporters on News Credibility: A Comparison Experiment between Human and AI Reporters,” Journal of Korea Contents Association, Vol. 24, No. 3, pp. 168-179, 2024.

[https://doi.org/10.5392/JKCA.2024.24.03.168]

-

K. Taghipour and H. T. Ng, “A Neural Approach to Automated Essay Scoring,” in Proceedings of the 2016 Conference on Empirical Methods in Natural Language Processing (EMNLP), Austin: TX, pp. 1882-1891, 2016.

[https://doi.org/10.18653/v1/D16-1193]

-

S. Chu, J. Kim, B. Wong, and M. Yi, “Rationale Behind Essay Scores: Enhancing S-LLM's Multi-Trait Essay Scoring with Rationale Generated by LLMs,” arXiv:2410.14202, , 2024.

[https://doi.org/10.48550/arXiv.2410.14202]

-

X. Tang, H. Chen, D. Lin, and K. Li, “Harnessing LLMs for Multi-Dimensional Writing Assessment: Reliability and Alignment with Human Judgments,” Heliyon, Vol. 10, No. 14, 2024.

[https://doi.org/10.1016/j.heliyon.2024.e34262]

-

C. Xiao, W. Ma, Q. Song, S. X. Xu, K. Zhang, Y. Wang, and Q. Fu, “Human-AI Collaborative Essay Scoring: A Dual-Process Framework with LLMs,” in Proceedings of the 15th International Learning Analytics and Knowledge Conference, Dublin: Ireland, pp. 293-305, March 2025.

[https://doi.org/10.1145/3706468.3706507]

-

A. Kundu and D. Barbosa, “Are Large Language Models Good Essay Graders?,” arXiv:2409.13120, , 2024.

[https://doi.org/10.48550/arXiv.2409.13120]

-

M. Carlson, A. Pack, and J. Escalante, “Utilizing OpenAI’s GPT-4 for Written Feedback,” TESOL Journal, Vol. 15, No. 2, e759, 2023.

[https://doi.org/10.1002/tesj.759]

-

A. Pack, A. Barrett, and J. Escalante, “Large Language Models and Automated Essay Scoring of English Language Learner Writing: Insights into Validity and Reliability,” Computers and Education: Artificial Intelligence, Vol. 6, 100234, 2024.

[https://doi.org/10.1016/j.caeai.2024.100234]

-

F. Yavuz, Ö. Çelik, and G. Yavaş Çelik, “Utilizing Large Language Models for EFL Essay Grading: An Examination of Reliability and Validity in Rubric‐Based Assessments,” British Journal of Educational Technology, Vol. 56, No. 1, pp. 150-166, 2025.

[https://doi.org/10.1111/bjet.13494]

-

M. Stahl, L. Biermann, A. Nehring, and H. Wachsmuth, “Exploring LLM Prompting Strategies for Joint Essay Scoring and Feedback Generation,” arXiv:2404.15845, , 2024.

[https://doi.org/10.48550/arXiv.2404.15845]

-

M. Turpin, J. Michael, E. Perez, and S. R. Bowman, “Language Models Don't Always Say What They Think: Unfaithful Explanations in Chain-of-Thought Prompting,” arXiv:2305.04388, , 2023.

[https://doi.org/10.48550/arXiv.2305.04388]

-

M. Pafla, K. Larson, and M. Hancock, “Unraveling the Dilemma of AI Errors: Exploring the Effectiveness of Human and Machine Explanations for Large Language Models,” in Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems, Honolulu: HI, pp. 1-20, May 2024.

[https://doi.org/10.1145/3613904.3642934]

- A. Radford, K. Narasimhan, T. Salimans, and I. Sutskever. Improving Language Understanding by Generative Pre-Training [Internet]. Available: https://cdn.openai.com/research-covers/language-unsupervised/language_understanding_paper.pdf, .

-

S. Han, D. Baek, and H. Lee, “Effective News Summarization through High Cohesion Clustering with Noise Filtering and Second-Half Summary,” Journal of Digital Contents Society, Vol. 25, No. 8, pp. 2165-2174, August 2024.

[https://doi.org/10.9728/dcs.2024.25.8.2165]

-

J. Devlin, M.-W. Chang, K. Lee, and K. Toutanova, “BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding,” in Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, Minneapolis: MN, pp. 4171-4186, June 2019.

[https://doi.org/10.18653/v1/N19-1423]

-

Y. Liu, M. Ott, N. Goyal, J. Du, M. Joshi, D. Chen, ... and V. Stoyanov, “RoBERTa: A Robustly Optimized BERT Pretraining Approach,” arXiv:1907.11692v1, , July 2019.

[https://doi.org/10.48550/arXiv.1907.11692]

-

Z. Lan, M. Chen, S. Goodman, K. Gimpel, P. Sharma, and R. Soricut, “ALBERT: A Lite BERT for Self-Supervised Learning of Language Representations,” arXiv:1909.11942v6, , February 2020.

[https://doi.org/10.48550/arXiv.1909.11942]

- A. Radford, J. Wu, R. Child, D. Luan, D. Amodei, and I. Sutskever. Language Models Are Unsupervised Multitask Learners [Internet]. Available: https://cdn.openai.com/better-language-models/language_models_are_unsupervised_multitask_learners.pdf, .

-

M. Lewis, Y. Liu, N. Goyal, M. Ghazvininejad, A. Mohamed, O. Levy, ... and L. Zettlemoyer, “BART: Denoising Sequence-to-Sequence Pre-Training for Natural Language Generation, Translation, and Comprehension,” in Proceedings of the 58th Annual Meeting of the Association for Computational Linguistics, pp. 7871-7880, July 2020.

[https://doi.org/10.18653/v1/2020.acl-main.703]

- C. Raffel, N. Shazeer, A. Roberts, K. Lee, S. Narang, M. Matena, ... and P. J. Liu, “Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer,” Journal of Machine Learning Research, Vol. 21, No. 140, pp. 1-67, January 2020.

- S. Kublik and S. Saboo, GPT-3: The Ultimate Guide to Building NLP Products with OpenAI API, Birmingham, UK: Packt Publishing, 2022.

-

J. Ye, X. Chen, N. Xu, C. Zu, Z. Shao, S. Liu, ... and X. Huang, “A Comprehensive Capability Analysis of GPT-3 and GPT-3.5 Series Models,” arXiv:2303.10420v2, , December 2023.

[https://doi.org/10.48550/arxiv.2303.10420]

-

E. Y. Chang, “Examining GPT-4’s Capabilities and Enhancement with SocraSynth,” in Proceedings of the 2023 International Conference on Computational Science and Computational Intelligence (CSCI), Las Vegas: NV, pp. 7-14, December 2023.

[https://doi.org/10.1109/CSCI62032.2023.00009]

-

R. Islam and O. M. Moushi, “GPT-4o: The Cutting-Edge Advancement in Multimodal LLM,” TechRxiv, April 2024.

[https://doi.org/10.36227/techrxiv.171986596.65533294/v1]

-

H. Do, S. Ryu, and G. G. Lee, “Teach-to-Reason with Scoring: Self-Explainable Rationale-Driven Multi-Trait Essay Scoring,” arXiv:2502.20748, , February 2025.

[https://doi.org/10.48550/arXiv.2502.20748]

-

S. Kim and D. Oh, “Evaluating Creativity: Can LLMs Be Good Evaluators in Creative Writing Tasks?,” Applied Sciences, Vol. 15, No. 6, 2971, March 2025.

[https://doi.org/10.3390/app15062971]

-

S. Chu, J. Kim, B. Wong, and M. Yi, “Rationale Behind Essay Scores: Enhancing SLLM’s Multi-Trait Essay Scoring with Rationable Generated by LLMs,” arXiv:2410.14202, , 2024.

[https://doi.org/10.48550/arXiv.2410.14202]

-

G. G. Lee, E. Latif, X. Wu, N. Liu, and X. Zhai, “Applying Large Language Models and Chain-of-Thought for Automatic Scoring,” Computers and Education: Artificial Intelligence, Vol. 6, 100213, 2024.

[https://doi.org/10.1016/j.caeai.2024.100213]

-

Z. J. Hou, A. Ciuba, and X. L. Li, “Improve LLM-based Automatic Essay Scoring with Linguistic Features,” arXiv:2502.09497, , February 2024.

[https://doi.org/10.48550/arXiv.2502.09497]

- Kaggle. Writing Prompts [Internet]. Available: http://www.kaggle.com/datasets/ratthachat/writing-prompts/, .

- Reddit. How to Tag Prompts [Internet]. Available: https://www.reddit.com/r/WritingPrompts/wiki/how_to_tag_prompts/, .

-

C.-H. Chiang and H.-Y. Lee, “Can Large Language Models Be an Alternative to Human Evaluations?,” in Proceedings of the 61st Annual Meeting of the Association for Computational Linguistics, Toronto: Canada, pp. 15607-15631, July 2023.

[https://doi.org/10.18653/v1/2023.acl-long.870]

- J. A. Rice, Mathematical Statistics and Data Analysis, 3rd ed. Boston, MA: Cengage Learning, 2006.

-

D. K. Lee, J. In, and S. Lee, “Standard Deviation and Standard Error of the Mean,” Korean Journal of Anesthesiology, Vol. 68, No. 3, pp. 220-223, 2015.

[https://doi.org/10.4097/kjae.2015.68.3.220]

- K. Krippendorff, Content Analysis: An Introduction to Its Methodology, 3rd ed. Thousand Oaks, CA: Sage, 2011.

저자소개

2021년:경북대학교 대학원 영어영문학과 (석사)

2025년:경북대학교 대학원 영어영문학과 (박사)

2021년~2025년: 경북대학교 영어영문학과 박사

2025년~현 재: 부산외국어대학교 영어학부 강의초빙교수

※관심분야:영어교육, 인공지능 교육, 디지털인문학, 의료데이터 분석, 프롬프트 엔지니어링, 자연어처리, 교육데이터 마이닝 등