인공지능 기반 게임 특징 식별 가능성에 관한 연구: 공포와 폭력성 구분을 중심으로

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

매년 기하급수적으로 증가하는 게임 콘텐츠 출시에 따라, 인력 기반의 게임물 등급분류 및 사후관리에는 현실적인 한계가 존재한다. 본 연구는 이에 대한 해결 방안으로 인공지능을 활용한 자동 분류의 실현 가능성을 실증하며, 특히 ‘공포’와 ‘폭력성’ 요소에 주목했다. 다중 인스턴스 학습(MIL) 프레임워크를 사용하여 94개의 게임 플레이 영상 데이터셋으로 모델을 학습시켰다. 핵심 목표는 인공지능이 사람의 개입 없이 이러한 추상적 개념들을 자율적으로 학습하고 구분하며, 사람이 해석 가능한 결과를 도출할 수 있는지 검증하는 것이다. 연구 결과, 정량적 평가에서 모델은 약 96.5%의 분류 정확도를 달성했으며, 나아가 임베딩 시각화 기반의 정성적 평가에서는 ‘공포’와 ‘폭력성’이 유의미하게 군집을 형성하는 경향성을 확인하였다. 이를 통해 인공지능 기반 게임 등급분류의 가능성을 확인했다.

Abstract

The exponential increase in annual game releases presents practical limitations for human-based game rating and management. This study investigates the feasibility of automated classification using artificial intelligence (AI), with a specific focus on ‘horror’ and ‘violence.’ We trained a model on a dataset of 94 gameplay videos using a multiple instance learning framework. The objective was to verify whether an AI could autonomously learn and distinguish these concepts without human intervention and produce human-interpretable results. In a quantitative evaluation, the model achieved a classification accuracy of approximately 96.5%. Furthermore, a qualitative evaluation based on embedding visualization confirmed a significant tendency for ‘horror’ and ‘violence’ to form distinct clusters. These results validated the potential for an effective and interpretable AI-driven system for game classification.

Keywords:

Game Rating Classifications, ArtificiaI Intelligence, Explainable Artificial Intelligence, Fear, Violence키워드:

게임물 등급분류, 인공지능, 설명 가능한 인공지능, 공포, 폭력Ⅰ. 서 론

1-1 연구배경

게임, 영화, 웹툰 등 디지털 콘텐츠의 양이 기하급수적으로 증가함에 따라, 콘텐츠의 적절한 유통과 이용자 보호를 위한 콘텐츠 등급 체계의 중요성도 전 세계적으로 더욱 부각되고 있다. 각 나라들은 문화적 특성과 사회적 가치를 반영하여 다양한 콘텐츠 등급분류 체계를 법제화해 운영하고 있다. 대표적으로 영화 분야에서는 영국의 BBFC(British Board of Film Classification), 미국의 MPAA(Motion Picture Association of America), 한국의 영상물등급위원회가 활동하고 있다. 게임 분야에서는 유럽의 PEGI(Pan European Game Information), 미국의 ESRB(Entertainment Software Rating Board), 그리고 한국의 게임물관리위원회(이하 게관위, GRAC)와 게임콘텐츠등급분류위원회(이하 GCRB) 등이 각자의 기준에 따라 등급분류 업무를 수행하고 있다.

매년 전 세계적으로 출시되는 게임의 수가 급증함에 따라 게임 등급분류 수요도 크게 증가하고 있다. 따라서 많은 게임 플랫폼들은 등급분류 심사를 간소화하고 게임 개발사 자율적으로 등급을 분류할 수 있는 체계를 마련하고 있다. 특히, 구글플레이스토어(Google Play Store) 등 글로벌 대형 플랫폼을 통한 자체 등급분류 건수는 전체 등급분류 중에서도 압도적인 비중을 차지한다. 2024년 게관위에서 발간한 「2024 게임물 등급분류 및 사후관리 연감」에 따르면, 2023년 한 해 동안 국내에서 등급분류된 게임물은 총 893,986건에 달한다. 이 중 게관위가 직접 등급분류한 건수는 618건(전체의 약 0.07%), 게임콘텐츠등급분류위원회(GCRB)가 처리한 건수는 약 0.03%에 불과한 반면, 구글, 애플 등 자체등급분류사업자가 처리한 건수는 893,064건으로 전체의 99.9%에 달한다[1].

따라서 게관위에서는 자체등급분류사업자들의 등급분류제도와 함께 등급분류를 받은 게임물의 정상 유통 여부를 상시 점검하고, 불법 게임물에 대한 경찰의 단속을 기술적으로 지원하는 사후관리 업무도 함께 수행하고 있다. 게관위의 사후관리정책은 「게임산업진흥에 관한 법률」 제18조 및 시행령 제11조의2(사후관리업무)를 근거로 조사관리팀(게임제공업 담당), 온라인대응팀(PC·온라인 게임물 담당) 등 여러 부서가 사후관리 업무에 투입되고 있다[2]. 2023년을 기준으로 게관위에서 모니터링 후 조치 완료한 건수는 총 242,812건으로 2022년 대비 148% 증가한 수치이다[1].

1-2 연구의 필요성

PC 기반 온라인 게임 판매 플랫폼인 스팀(Steam)의 차트 분석 사이트인 SteamDB에 따르면 스팀에는 2024년 한 해에만 약 18,736개의 게임이 출시되었다[3]. 또한 구글 플레이스토어(Google Play Store)에는 2025년 상반기 기준 244,875개의 게임이 서비스 중이다. 이와 같이 전 세계적으로 게임 콘텐츠 출시량이 폭발적으로 증가하고 있다[4].

이처럼 방대한 양의 게임 콘텐츠를 기존처럼 사람이 수작업으로 직접 모니터링하는 방식은 이미 한계에 도달했다. 이에 따라 인공지능(AI; Artificial Intelligence)을 활용한 자동화 대규모·모니터링 체계의 필요성이 부각되고 있다. 인공지능(AI) 기반 모니터링 체계의 구현 가능성을 검토하기 위해서는 인공지능(AI)이 사람이 설정한 등급분류 기준에 근거해 콘텐츠의 특성을 인식하고 분류할 수 있는지에 대한 연구가 필요하다.

이에 본 연구에서는 게임 콘텐츠의 ‘공포’와 ‘폭력성’ 표현을 중심으로 AI가 해당 요소들을 정량적·정성적으로 구분해낼 수 있는 가능성을 탐색하고자 한다.

게임물관리위원회 등급분류규정 제2장 제2절 제9조(폭력성 및 공포 기준)에 따르면, 게임 내 폭력성 및 공포 요소는 다음과 같은 기준에 따라 판단된다. 무기 표현의 사실성, 선혈 표현의 사실성, 신체훼손의 정도와 사실성, 폭력성의 강도, 그리고 사용자 간 대결의 결과에 따른 손실 정도를 종합적으로 고려하여 등급을 결정한다[5]. 한편 일본의 등급분류기관인 CERO의 윤리규정 별첨 2에서는 표현을 크게 성 표현, 폭력 표현, 반사회적 행위 표현, 언어·사상 관련 표현으로 분류하고 있다. 이 중 폭력 표현은 출혈, 신체 분리 또는 결손 묘사, 시체 묘사, 살상 행위, 공포 그리고 대전 격투 및 싸움 묘사 여부를 주요 기준으로 삼고 있다[6].

등급분류기관의 판단 기준에 따르면 ‘공포’와 ‘폭력성’은 유사한 기준으로 평가되지만, 최종 등급은 다르게 부여되는 경우가 많아 서로 구분 가능한 독립적 요소로 간주할 수 있다. 따라서 본 연구는 게임물관리위원회의 등급 기준에 따라 정의된 게임의 ‘공포’와 ‘폭력성’ 표현을 딥러닝 모델이 구분할 수 있는지를 검토하고, 각 표현이 임베딩(embedding) 과정에서 의미 있는 군집(Cluster)을 형성하는지 분석한다. 이를 통해 AI의 분류 결과가 실제로 사람이 해석 가능한 수준의 구조를 가지는지 확인하는 것을 연구의 주요 목표로 한다.

Ⅱ. 본 론

연구 목표를 효과적으로 달성하기 위해, 본 연구는 다음과 같은 절차를 통해 수행된다.

먼저, 분석 대상 게임을 선정하기 위한 기준을 설정하고, 해당 게임으로부터 영상 데이터를 수집하여 그 분포를 설명한다. 이어서 연구에 사용된 핵심 기술 용어들을 정의하고, 데이터 전처리, 모델 학습 및 평가에 이르는 전체 연구 과정을 구체적으로 기술하여 연구의 재현성과 신뢰도를 확보하고자 한다.

2-1 관련 선행 연구

관련 선행 연구들을 살펴보면 영상 분석을 위해 인공지능을 활용한 다양한 접근법이 시도 되었다는 것을 알 수 있다. ‘신뢰할 수 있는 인공지능을 이용한 영상 내 폭력성 탐지에 대한 체계적 동향 분석 연구’에 따르면, 공간적 특징을 분석하는 합성곱 신경망(CNN; Convolutional Neural Network)과 시간적 흐름을 파악하는 순환 신경망(RNN; Recurrent Neural Network)을 결합하는 등 다양한 딥러닝 모델이 활용되고 있었다[7]. 또한, ‘폭력성 탐지: 시리어스 게이밍 접근법’ 연구에서는 게임 GTA-V의 게임 플레이 영상 데이터를 3D-CNN 모델로 학습시키는 '시리어스 게이밍' 접근법을 제시하기도 했다[8]. 하지만 대부분 단일 요소 분석에 집중했으며, 본 연구처럼 게임 콘텐츠 내 ‘공포’와 ‘폭력성’의 차이를 구분하고 공식 등급분류 기준에 적용하려는 연구는 아직 없었다.

2-2 연구 대상 선정

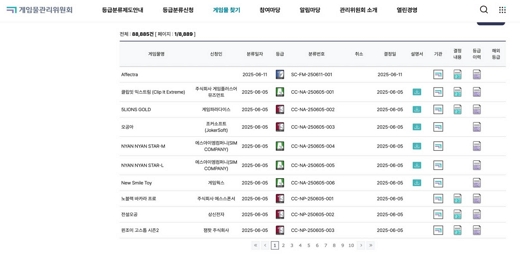

선정 기준은 게임물관리위원회 홈페이지에서 제공하는 등급분류결정 확인 정보를 기반으로 설정했다. 등급분류결정 확인 메뉴에서는 그림 1과 같이 게임물명, 신청인, 연령 등급, 결정내용 등 상세 정보를 제공한다[9].

GRAC's classification decision menu*This figure includes Korean because the menu supports only Korean

결정 내용 메뉴에서는 등급분류가 완료된 각 게임의 게임물등급분류 결정서를 제공한다. 여기에는 결정 등급, 등급 결정 사유, 내용정보표시사항 등이 포함되어 있다. 내용정보표시사항에는 그림 2와 같이 게임 내 ‘선정성’, ‘폭력성’, ‘공포’, ‘언어의 부적절성’, ‘약물’, ‘범죄’, ‘사행성’의 7대 요소의 포함 여부를 ‘유(有)’ 또는 ‘무(無)’로 명시하고 있다.

Example of game classification decision*This figure includes Korean because the menu supports only Korean

게관위의 등급분류결정 확인 정보와 게임물등급분류 결정서를 기반으로 변인 통제를 위한 선정 기준(Criteria C1~C5)을 설정했다.

C1. 게임물관리위원회(GRAC) 또는 게임콘텐츠등급분류위원회(GCRB)로부터 게임물등급결정을 받은 게임물로 한정한다.

C2. 분석 플랫폼의 일관성을 위해 ‘PC/온라인’ 및 ‘모바일’ 플랫폼으로 출시된 게임으로 한정한다.

C3. 내용정보표시사항 항목 중 ‘공포’ 또는 ‘폭력성’ 단일 항목만 ‘유(有)’로 결정되고, 나머지(선정성, 약물, 언어, 사행성 등) 항목은 모두 ‘무(無)’로 결정된 게임. 이는 ‘공포’와 ‘폭력성’을 제외한 다른 변수가 모델 학습에 미치는 영향을 통제하기 위한 목적이다.

C4. ‘공포’와 ‘폭력성’ 각 범주 내에서 전체이용가, 12세이용가, 15세이용가, 청소년 이용불가 등급을 받은 게임 표본 수의 균형을 확보한다.

C5. 스팀, 구글플레이스토어, 애플앱스토어와 같은 오픈마켓에서 서비스를 운영 중인 게임으로, 게임 플레이 영상 데이터 확보가 가능한 게임으로 한정한다.

C1 ~ C5 선정 기준에 따라 ‘공포’만 ‘유(有)’인 게임 46개, ‘폭력성’만 ‘유(有)’인 게임 48개, 총 94개 게임을 최종 연구 대상으로 선정했다. 최종 연구 대상 리스트는 표 2와 같다.

위와 같이 선정한 94개 게임들은 아래의 기준(Standard S1~S2)을 참고하여 게임 플레이 영상을 수집했다.

S1. 게임 플레이 영상 내 인게임 소리를 반드시 포함한다. 게임물관리위원회 등급분류규정 제2장에 따르면, 공포감을 유발하는 음향 효과 등 사운드 역시 폭력성 및 공포 항목의 심의 대상에 포함되기 때문이다[5].

S2. 플레이 영상 내 인게임 소리를 제외한 모든 소리(플레이어 코멘터리 음성 등)는 미포함한다. 이는 게임 외 요소가 모델의 결정에 미치는 영향을 통제하기 위함이다.

2-3 수집 데이터 설명

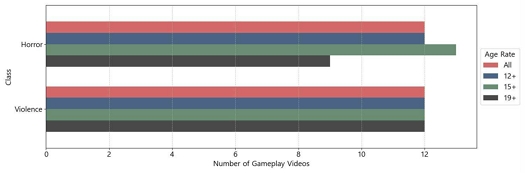

2-2의 선정 기준 C4에 따라 표본의 균형을 확보하고자, 연령 등급별 분포를 전체이용가(‘공포’ 12개, ‘폭력성’ 12개), 12세 이용가(‘공포’ 12개, ‘폭력성’ 12개), 15세 이용가(‘공포’ 13개, ‘폭력성’ 12개), 청소년이용불가(‘공포’ 9개, ‘폭력성’ 12개)로 구성하여 특정 연령 등급의 데이터가 편중되는 것을 최소화했다. 확보한 데이터의 분포는 그림 3과 같다.

2-4 용어 정리

연구 방법을 설명하기 전 본 연구의 이해를 돕기 위해 핵심 기술 용어를 아래와 같이 정리했다. 용어는 기본적인 딥러닝 개념에서 시작하여 데이터 처리, 학습 방법론, 그리고 구체적인 모델 아키텍처로 확장되는 순서로 정렬했다.

- - 딥러닝(Deep Learning): 여러 계층으로 구성된 인공신경망을 사용하여 데이터로부터 계층적인 특징을 학습하는 머신러닝의 한 분야이다[10].

- - 벡터(Vector): 크기와 방향을 모두 가지는 수학적 객체. 딥러닝에서는 데이터를 수치적으로 표현하는 배열 형태로 사용된다[11].

- - 임베딩(Embedding): 자연어, 이미지 등 사람이 사용하는 정보를 컴퓨터가 처리할 수 있도록 숫자 벡터로 변환하는 과정 또는 그 결과물 자체이다[12].

- - 역전파(Backpropagation): 신경망의 예측값과 실제값 사이의 오차를 출력층에서부터 입력층 방향으로 역으로 전파하며 각 계층의 가중치를 점진적으로 조정하는 알고리즘이다[13].

- - 과적합(Overfitting): 머신러닝 모델이 훈련 데이터에만 지나치게 최적화되어, 새로운 데이터에 대한 일반화 성능이 저하되는 현상이다[10].

- - 모달리티(Modality): 데이터를 인식하고 표현하는 방식. 인공지능 분야에서는 시각(이미지, 비디오), 청각(음성), 텍스트 등과 같이 서로 다른 종류의 데이터 스트림을 의미한다[14].

- - 전이 학습(Transfer Learning): 특정 작업을 위해 학습된 모델을 초기 가중치로 사용하여, 다른 작업에 대한 모델을 학습시키는 방법론이다[15].

- - 미세 조정(Fine-tuning): 사전에 대규모 데이터셋으로 학습된 모델을 가져와, 특정 목표 데이터셋에 맞게 가중치 전체 또는 일부를 재학습하여 모델의 성능을 최적화하는 과정이다[16].

- - 평균 제곱 오차(MSE; Mean Squared Error): 예측값과 실제값 간의 차이를 제곱하여 평균을 낸 값이다[17].

- - 자기지도학습(SSL; Self-Supervised Learning): 별도의 레이블이 없는 데이터 자체에서 의사 레이블을 생성하여 이를 감독 신호로 활용하는 학습 방식이다[18].

- - STFT (Short-Time Fourier Transform): 시간에 따라 주파수 특성이 변하는 비정상 신호를 분석하기 위해, 짧은 시간 구간으로 신호를 나누어 각 구간에 대해 푸리에 변환을 적용하는 기법이다[19].

- - 멜 스펙트로그램(Mel Spectrogram): STFT를 통해 얻은 스펙트로그램의 주파수 축을 인간의 청각 시스템이 인지하는 방식과 유사한 멜 스케일(Mel scale)로 변환한 표현이다[20].

- - 셀프 어텐션(Self-Attention): 트랜스포머의 핵심 메커니즘으로, 입력 시퀀스 내의 각 요소들이 다른 모든 요소들과의 가중치를 계산하여, 어떤 요소에 더 집중할지 결정하는 방식이다[21].

- - 튜블릿 임베딩(Tublet Embedding): 비디오 트랜스포머에서 시공간적 특징을 추출하기 위한 임베딩 방식. 시간 축을 따라 연속된 이미지 패치들의 묶음인 튜블릿을 하나의 토큰으로 변환하여 모델의 입력으로 사용한다[22].

- - VideoMAE (Video Masked Autoencoders): 영상을 위한 자기 지도 학습 모델로, 튜브 형식으로 90-95%의 토큰을 마스킹하여 자기지도 영상 학습을 통해 데이터를 효율적으로 학습할 수 있도록 한다[23].

- - AST (Audio Spectrogram Transformer): 오디오의 멜 스펙트로그램을 이미지처럼 간주하여 트랜스포머 모델에 직접 입력하는 방식의 오디오 분류 모델이다[24].

- - ViViT (Video Vision Transformer): 비디오 데이터를 순수한 트랜스포머 구조로 처리하기 위해 제안된 모델. 비디오를 시공간적 튜블릿으로 분할하고, 이를 토큰으로 입력받아 비디오 분류를 수행한다[22].

- - 다중 인스턴스 학습(MIL; Multiple Instance Learning): 개별 인스턴스가 아닌 인스턴스의 집합인 Bag 단위로 레이블이 부여된 데이터를 학습하는 지도 학습의 한 형태이다[25].

- - 백(Bag): MIL의 기본 데이터 단위로, 여러 개별 인스턴스들의 집합. 개별 인스턴스가 아닌 전체에 대해 단일 레이블이 할당되는 것이 특징이다[26].

- - 스태킹 앙상블(Stacking Ensemble): 여러 다른 모델(base models)의 예측 결과를 입력으로 받아, 이를 학습하는 상위 모델(meta-model)을 통해 최종 예측을 수행하는 앙상블 기법이다[27].

2-5 연구 방법

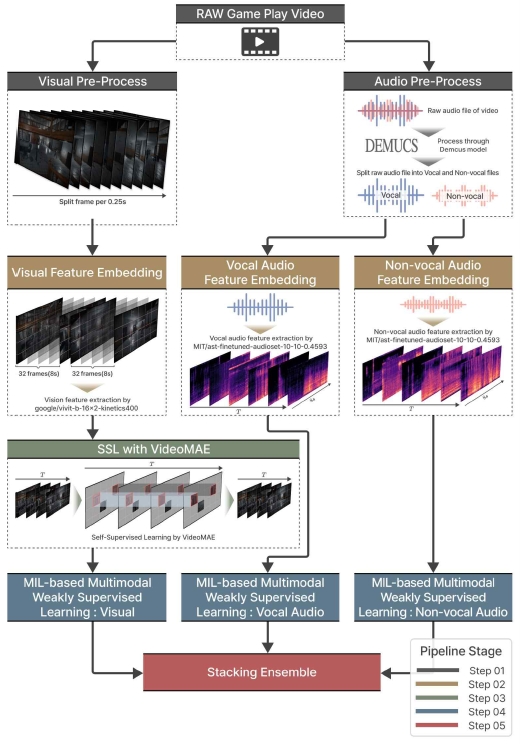

앞선, ‘2-2 연구 대상 선정’ 문단에서 기술한 방법처럼 게임 플레이 영상을 수집하여 연구를 진행했다. 영상은 시각 데이터와 소리 데이터로 구분된다. 본 연구에서 시각 데이터는 Visual으로, 소리 데이터는 Audio로 정의한다. 머신러닝 모델이 게임 내 ‘공포’와 ‘폭력성’을 구분하고, 사람이 해석할 수 있는 결과가 나올 수 있는지 여부를 검증한다. 연구 과정은 크게 데이터 전처리, 데이터 증강 및 임베딩, Visual 자기지도학습, MIL 기반 멀티모달 약지도 학습 분류 모델 설계, 모델 앙상블 및 성능 평가의 총 5단계로 구성된다.

94개 게임 플레이 영상에서 ‘공포’와 ‘폭력성’이라는 레이블만 존재하는 약지도 데이터의 한계가 있다. 이를 극복하기 위해 딥러닝 아키텍처인 ViViT와 AST 모델을 이용하여 영상에서 Visual과 Audio의 각 모달리티의 특징을 추출하여 시공간적 맥락과 장기 의존성을 효과적으로 학습하고자 하였다. 또한 모델의 성능을 극대화하기 위해 개별 학습된 모델의 추론 결과를 결합하는 스태킹 앙상블 기법을 사용했다.

1-1.Visual 데이터 전처리: 수집된 94개의 게임 플레이 영상은 720p에서 1080p, 초당 프레임은 24fps에서 60fps 등으로 다양하다. 고해상도 영상을 그대로 사용할 경우 과도한 연산 비용이 발생할 수 있다. 데이터별로 해상도와 조건이 다를 경우 모델 성능에 영향을 미칠 수 있기에 효율적인 학습 환경을 추구하기 위해 Visual 데이터에서는 다음과 같은 전처리 과정을 수행했다. 원본 게임 영상을 가로 360 픽셀, 세로 203픽셀의 해상도로 다운스케일링 후 0.25초 간격(초당 4프레임)으로 png 이미지 파일로 저장했다.

1-2.Audio 데이터 전처리: 게임 플레이 영상의 Audio 내에는 배경음악, 효과음, 대화 등 모든 청각적 요소가 혼합되어 있다. 따라서 이러한 요소들이 혼합된 원본 오디오는 모델이 ‘공포’와 ‘폭력성’에 관련된 핵심적인 특징을 학습하는 데 방해가 될 수 있다. 이러한 문제를 방지하기 위해 Audio에서는 다음과 같은 전처리 과정을 수행했다. Meta AI(구 Facebook AI Research) 연구팀이 개발한 Demucs 모델을 이용하여 음성(인게임 대사)과 비음성(배경음, 효과음 등)으로 음원을 분리한 후 개별 wav 파일로 저장했다[28].

2-1.데이터 증강: 학습 데이터가 부족한 경우 모델의 과적합이 발생할 수 있다. 데이터 전처리 과정을 통해 확보한 전체 이미지 데이터는 399,709개이지만 이 중 ‘공포’와 ‘폭력성’이 포함된 이미지의 수는 이보다 더 적을 가능성이 높아 데이터 증강을 진행했다. 데이터 증강 시 ‘공포’와 ‘폭력성’은 톤앤무드(Tone & Mood)가 달라질 경우 학습 성능이 저하될 수 있음을 유의해야 한다. 따라서 밝기, 대비, 채도, 색조 조절과 같은 색상 조절 기반의 기법은 제외하고 데이터 증강을 진행했다.

2-2.임베딩: 모델이 학습할 수 있는 데이터 형태로 변환하기 위해 임베딩을 진행했다. 임베딩 시 영상 데이터가 가지고 있는 시공간적 특성을 반영하기 위해 본 연구에서는 각 Visual과 Audio 데이터는 다음과 같은 과정으로 임베딩을 진행했다.

2-2-1. Visual 임베딩: Visual 데이터는 google/vivit-b-16x2-kinetics400 사전 학습 ViViT 모델을 이용했다[22]. 데이터 전처리 과정을 통해 변환된 이미지 중 32개 프레임(8초 분량)을 하나의 클립으로 묶었다. 32개인 이유는 모델의 입력 요구사항이 32 프레임이기 때문이다. 이후, 32개 프레임으로 구성된 클립을 모델에 입력하여 영상의 시공간적 특징을 나타내는 출력값을 추출하고, 이를 NumPy 배열로 저장했다.

2-2-2. Audio 임베딩: Audio 데이터는 AudioSet 데이터셋을 기반으로 파인튜닝된 MIT/ast-finetuned-audioset-10-10-0.4593 AST 모델을 이용하여 임베딩을 진행했다[29]. 각 음성과 비음성 파일을 8초 간격으로 균등하게 분절한 클립으로 묶었다. 8초 간격으로 분절한 이유는 임베딩된 Visual의 시간 단위와 통일하기 위함이다. 분절된 Audio 데이터는 AST 모델의 전처리기를 통과 후 멜 스펙트로그램으로 변환된다. 이후, 모델의 출력값에서 음성 클립의 특징을 요약하는 정보를 추출해 NumPy 배열로 저장했다.

본 연구에서 사용하는 ViViT 모델은 google/vivit-b-16x2-kinetics400 모델로 kinetics400 데이터셋을 이용하여 사전학습이 완료된 모델이다. 해당 데이터셋은 YouTube에서 수집한 악기 연주와 같은 사람의 활동 등의 영상 데이터로 구성되어 있어 본 연구에서 사용하는 게임 플레이 영상과는 도메인 격차가 존재한다. 이를 해소하고 게임 도메인에 특화된 시각적 표현력을 확보하기 위해, VideoMAE 프레임워크를 이용한 SSL을 진행했다. 32 프레임의 Visual 데이터 클립을 튜블릿으로 토큰화한 후 전체 튜블릿의 90% 비율로 무작위 마스킹을 했다. 이후 마스킹된 부분을 모델이 스스로 원본 픽셀 값을 재구성하도록 학습하며, 이 과정에서 재구성된 픽셀과 원본 픽셀 간의 MSE를 최소화했다. 이렇게 SSL을 완료하면 게임 플레이 영상 도메인에 특화된 가중치가 생성되며 pth 파일로 저장된다.

3단계를 통해 얻은 가중치 기반의 ViViT 모델과 AudioSet으로 파인튜닝된 AST 모델은 각각 8초 분량의 Visual, Audio(음성, 비음성) 클립(인스턴스)을 입력받아 해당 인스턴스가 특정 클래스에 속할 확률을 추론한다. 이 과정은 MIL 프레임워크를 기반으로 지도학습 파인튜닝을 진행했다. 개별 게임 플레이 영상은 MIL에서 하나의 Bag에 해당한다. Bag에 대한 ‘공포’ 및 ‘폭력성’에 대한 최종 추론 결과를 위해서는 해당 게임에 속한 모든 인스턴스들의 결과를 하나의 Bag 단위의 추론을 거쳐 통합하는 과정이 필요하다. 본 연구에서는 어텐션 기반 집계 방식을 사용하여 모델이 스스로 각 인스턴스의 중요도를 학습하여, 최종 추론 결과에 더 큰 영향을 미치는 핵심 인스턴스에 더 높은 가중치를 부여하도록 한다. 또한 집계된 Bag 단위 추론 결과와 실제 게임의 ‘공포’ 및 ‘폭력성’을 비교하여 손실을 계산한다. 본 연구에서는 이진 분류에 적합한 Binary Cross-Entropy 함수를 사용하고, 손실값을 최소화하는 방향으로 모델의 가중치를 조정하는 역전파 과정이 반복된다. 이후 각 모델들의 가중치는 pth 파일로 저장된다. 이러한 MIL 기반 파인튜닝 과정을 통해, 모델은 어떤 종류의 시청각적 특성들이 ‘공포’ 또는 ‘폭력성’이라는 레이블과 강한 연관성을 갖는지 스스로 학습하게 된다.

5-1.모델 앙상블: 각 모달리티별 모델의 학습 결과를 결합하여 전체 모델의 성능 향상을 시도했다. 본 연구에서는 각 모달리티별 모델의 추론 결과를 융합하기 위한 기법으로 스태킹 앙상블 기법을 채택했다.

5-2.성능 평가: 개발된 모델의 성능을 평가하기 위해, 본 연구에서는 분류 모델 평가에 널리 사용되는 표준적인 지표들을 채택했다. 평가는 크게 두 가지 수준에서 이루어진다. 첫째는 실제 레이블이 존재하는 개별 게임의 전체 단위, 즉 Bag 수준에서 정량적 평가이고, 둘째는 모델의 내부 작동 방식을 이해하고 해석 가능성을 탐색하기 위한 영상 클립 단위, 즉 인스턴스 수준에서의 정성적 분석이다. 상세한 내용은 이어지는 Ⅲ. 연구 결과에서 설명할 예정이다.

Ⅲ. 연구 결과

본 장에서는 제안된 MIL 기반의 멀티모달 분류 모델의 성능을 다각적으로 평가하고 그 결과를 분석한다. 평가는 총 4단계에 걸쳐 진행된다. 첫째, 각 모달리티(시각, 음성, 비음성)를 독립적으로 학습시킨 개별 모델의 성능을 요약하고 정량적으로 평가한다. 둘째, 이들 개별 모델을 융합한 앙상블 모델의 성능을 다양한 시나리오에 따라 정량적으로 비교 평가한다. 셋째, 개별 모델의 정량적 평가 결과가 지닌 한계점을 분석한다. 마지막으로, 해석 가능성을 탐색하기 위해 UMAP(Uniform Manifold Approximation and Projection) 임베딩 시각화를 활용한 인스턴스 단위의 정성적 분석을 수행한다.

3-1 개별 모달리티 모델의 학습 환경 및 정량 평가 요약

본 연구에서 제안하는 모델의 학습 및 평가는 NVIDIA A100-40GB GPU(Graphics Processing Unit) 환경에서 수행되었다. 연구의 재현성 확보를 위해 모든 개별 모델 학습에 공통된 하이퍼파라미터를 적용했다. 학습률(Learning Rate)은 1e−5로 설정하였으며, 전체 훈련 데이터셋을 30회 반복 학습(30 Epochs)했다. 모델의 일반화 성능을 신뢰도 높게 검증하기 위해, 전체 94개의 게임 플레이 영상 데이터 중 75%를 훈련 데이터셋으로, 25%를 평가 데이터셋으로 분리했다. 이때 데이터 분할 과정에서 발생할 수 있는 편향을 최소화하고자, 각 데이터의 클래스(‘공포’, ‘폭력성’)와 연령 등급 비율이 원본 데이터셋과 동일하게 유지되도록 계층적 분할 방식을 사용했다. 이는 평가 결과의 객관성을 확보하고 모델이 특정 유형의 데이터에 과적합되는 것을 방지하는 데 기여한다. 더 명확한 연구 결과 도출을 위해, 연구 방법에서 정의한 세 가지 데이터 모달리티에 기반한 개별 모델을 아래와 같이 정의한다.

- - 시각 모달리티 모델(Visual Modality Model): 게임 플레이 영상의 시각적 정보를 처리하는 모델.

- - 음성 모달리티 모델(Vocal Modality Model): 음원 분리를 통해 추출된 인게임 대사 등 음성 정보를 처리하는 모델.

- - 비음성 모달리티 모델(Non-vocal Audio Modality Model): 음원 분리를 통해 추출된 배경음악 및 효과음을 처리하는 모델.

각 개별 모달리티 모델의 평가 지표로는 전체 분류의 정확성을 나타내는 정확도(Accuracy)와, 모델이 ‘공포’와 ‘폭력성’으로 추론한 결과가 얼마나 신뢰할 수 있는지를 나타내는 정밀도(Precision)를 사용했다. 각 지표의 계산식은 아래와 같다.

| (1) |

| (2) |

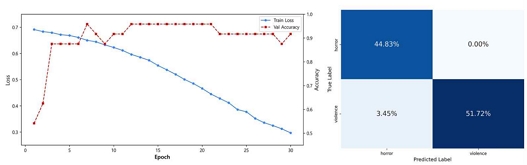

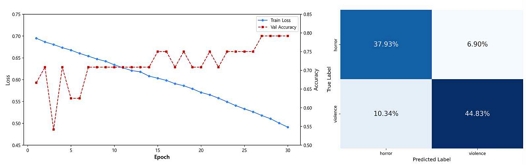

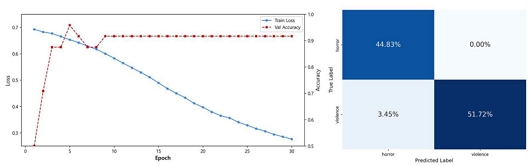

여기서 TP는 True Positive, TN은 True Negative, FP는 False Positive, FN은 False Negative를 의미한다. 평가 데이터셋에 대한 각 개별 모달리티 모델의 Bag 단위(게임 전체 단위) 분류 성능은 그림 5, 그림 6, 그림 7과 같다.

그림 5, 그림 6, 그림 7은 몇 가지 중요한 점을 시사한다.

첫째, 시각 모달리티 모델과 비음성 모달리티 모델의 정확도는 약 96.5%, 정밀도 약 92.8%로 동일한 성능을 기록했다. 이는 본 연구에 있어 시각적 단서(예: 전투 장면, 어두운 배경)와 비음성 청각적 단서(예: 폭발음, 긴장감을 고조시키는 배경음악)가 매우 높은 정보적 상관관계를 가지며, 각각이 독립적으로도 충분한 변별력을 제공함을 의미한다.

둘째, 음성 모달리티 모델의 정확도는 약 82.8%로 다른 두 모델에 비해 낮은 성능을 보였다. 이는 게임 내 대사와 같은 음성 정보만으로는 ‘공포’와 ‘폭력성’을 구분하는 데 한계가 있음을 나타낸다.

3-2 Bag 단위 정량 평가: 앙상블 모델 성능 비교

개별 모달리티 모델의 성능을 기반으로, 각 모델의 추론 결과를 결합하여 더 높은 성능을 달성하고자 스태킹 앙상블 기법을 적용했다. 이 접근법의 핵심 가정은 서로 다른 모달리티에서 추출된 정보가 상호 보완적으로 작용하여 단일 모델의 한계를 극복할 수 있다는 점이다. 이를 검증하기 위해, 각 모달리티별 모델의 추론 결과에 다양한 가중치를 부여하여 융합하는 시나리오별 성능을 비교 분석했다. 그 결과는 표 3과 같다.

표 3의 결과는 앙상블의 일반적인 기대와는 반대되는 결과를 보여준다. 가장 두드러진 점은 어떠한 앙상블 조합도 개별 시각 모달리티 모델이나 비음성 모달리티 모델의 성능(정확도 0.9655)에 근접하지 못했다는 것이다. 오히려 세 모달리티를 모두 결합한 모든 시나리오에서 정확도는 0.931으로 하락했으며, 정밀도 역시 0.8667로 감소했다. 이러한 성능 저하의 원인을 파악하기 위해 각 모델의 기여도를 분석해 볼 수 있다. 모든 성능 저하 시나리오의 공통점은 상대적으로 성능이 낮은 음성 모달리티 모델이 앙상블에 포함되었다는 점이다. 이는 음성 모달리티 모델의 추론 결과가 단순히 정보력이 부족한 것을 넘어, 스태킹 앙상블의 상위 모델에 유용한 보완 신호가 아닌 오히려 잡음(noise)으로 작용했음을 시사한다.

3-3 정량적 평가 한계점

3-1과 3-2에서 제시된 정량적 평가 결과는 몇 가지 한계점을 내포한다. 이러한 한계점을 명확히 인지하는 것은 본 연구의 결과를 올바르게 해석하고 향후 연구 방향을 설정하는 데 필수적이다.

첫째, 낮은 성능의 모달리티 모델이 미치는 부정적인 영향이다. 3-1에서 음성 모달리티 모델은 시각 모달리티 모델이나 비음성 모달리티 모델에 비해 낮은 성능을 보였다. 3-2의 앙상블 평가 결과, 음성 모달리티 모델을 결합했을 때 전체 성능이 단일 모달리티 모델보다 하락하는 현상이 발생했다. 즉, 앙상블 모델이 음성 모달리티 모델의 부정확한 추론에 과도하게 영향을 받아 전체적인 판별 능력이 저하된 것이다.

둘째, 평가 지표의 변별력이 부족한 현상이다. 시각 모달리티 모델과 비음성 모달리티 모델의 정확도와 정밀도가 소수점 넷째 자리까지 동일하게 나타났으며, 대부분의 앙상블 시나리오 역시 가중치 변화에 관계없이 동일한 결과가 도출되었다.

이러한 두 가지 현상의 원인은 데이터 수 부족에 있다. 머신러닝 및 딥러닝 모델, 특히 복잡한 멀티모달 앙상블 모델이 일반화된 성능을 확보하고 미세한 성능 차이를 보이기 위해서는 대규모의 학습 및 검증 데이터가 필수적이다. 현재 연구에 사용된 데이터셋의 규모는 모델이 각 모달리티의 특징을 충분히 학습하고, 평가 과정에서 그 성능 차이를 유의미하게 드러내기에는 부족하다. 따라서 현재의 정량적 수치는 제한된 데이터 환경에서의 결과로 해석해야 하며, 향후 더 많은 데이터를 확보하여 모델의 성능을 재검증하고 개선하는 작업이 필요하다.

3-4 UMAP 임베딩 시각화 기반 인스턴스 단위 정성 평가

앞선 정량 평가는 모델의 성능을 수치적으로 보여주었지만, 모델이 결정을 내리는 기준을 설명하지는 못한다. 특히 앙상블 모델의 성능이 예상과 달리 저하되는 등 정량적 결과만으로는 해석이 불분명한 지점이 존재한다. 따라서 모델의 신뢰성을 확보하고 내부 작동 원리에 대한 통찰을 얻기 위해서는 인스턴스(8초 클립) 단위의 정성적 분석이 필수적이다. 이는 모델이 단순히 통계적 패턴에 의존하는 블랙박스가 아니라, 타당한 근거를 바탕으로 작동하는지를 검증하며 모델 결과에 대한 사람의 해석 가능성을 확인하는 과정이다.

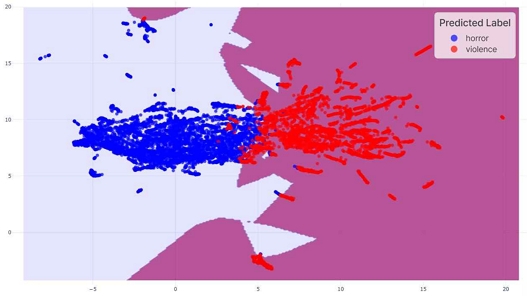

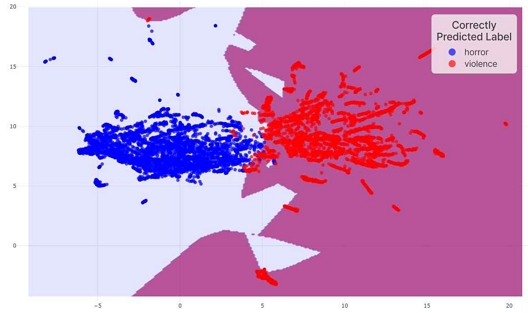

이러한 해석 가능성을 위해, 본 연구에서는 비선형 차원 축소 기법인 UMAP으로 모델이 학습한 고차원 임베딩 공간을 시각화했다. UMAP은 각 8초 클립 인스턴스를 표현하는 복잡한 고차원 벡터(본 연구의 Visual 임베딩 데이터는 768차원)를 사람이 직관적으로 인지할 수 있는 2차원으로 투영한다. 이 시각화를 통해 데이터의 구조, 클래스(‘공포’, ‘폭력성’) 간의 군집 형성 여부, 그리고 모델의 오분류 경향과 같은 복합적인 패턴을 시각적으로 파악할 수 있다.

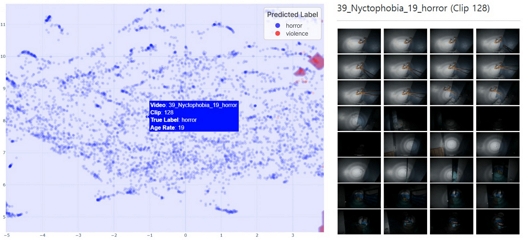

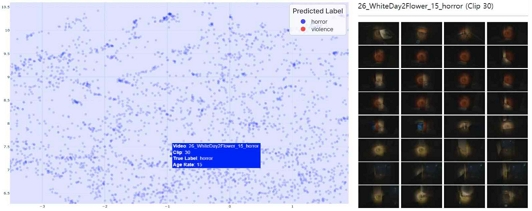

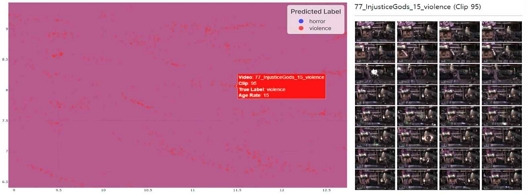

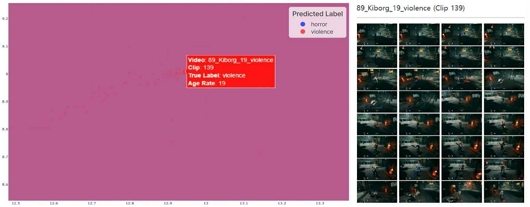

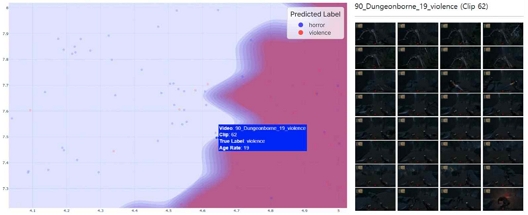

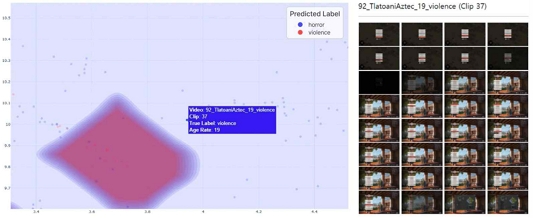

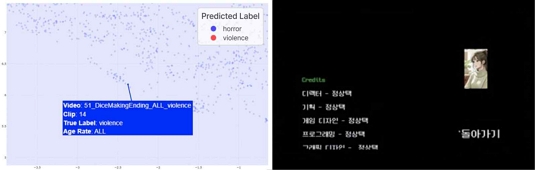

인스턴스 단위 정성 평가는 정량적 평가에서 가장 정확도가 높았던 시각 모달리티 모델 결과를 기준으로 임베딩 시각화를 수행한 후 그 결과를 분석했다. 그림 8은 시각 모달리티 모델이 학습한 모든 인스턴스의 임베딩 벡터를 2차원으로 시각화한 결과이다. 각 점은 개별 인스턴스를 의미하며, 붉은색은 ‘폭력성’, 푸른색은 ‘공포’로 분류된 인스턴스를 나타낸다. UMAP에서 나타나는 경계선은 모델이 학습한 결정 경계(Decision Boundary)를 의미한다. 시각화된 결정 경계는 실제 모델이 768차원 공간에서 학습한 복잡한 초평면 자체가 아닌 2차원적 근사치이다. 따라서 768차원 공간에서는 ‘폭력성’ 클래스 경계에 올바르게 위치하여 정확하게 분류된 인스턴스라 할지라도, UMAP에 의해 2차원으로 투영되는 과정에서 발생하는 왜곡으로 인해 시각화된 ‘공포’ 영역에 위치할 수 있다.

임베딩 시각화 결과인 그림 8과 그림 9에서 가장 먼저 관찰되는 특징은 ‘공포’와 ‘폭력성’ 클래스가 비교적 명확히 구분되어 두 개의 군집을 형성하고 있다는 점이다. 이는 시각 모달리티 모델이 두 클래스를 구분하는 시각적 특징들을 학습하여, 임베딩 공간상에서 이들을 분리해 냈음을 시사한다.

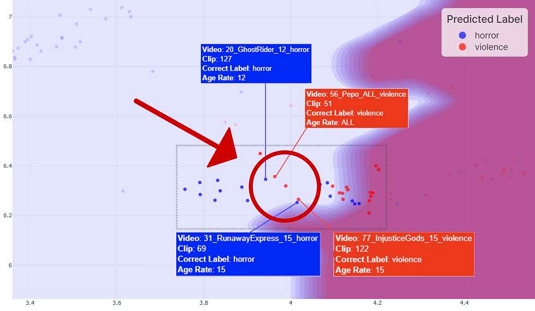

그림 10은 두 클래스의 경계 영역, 즉 경합 지점이 어떻게 형성되는지 구체적인 사례를 통해 보여준다. 이 그림은 ‘공포’로 정분류된 20_GhostRider_12_horror의 클립 127 인스턴스와 31_RunawayExpress_15_horror의 클립 69 인스턴스, 그리고 ‘폭력성’으로 정분류된 56_Pepo_ALL_violence의 클립 51 인스턴스와 77_InjusticeGods_15_violence의 클립 122 인스턴스를 함께 보여준다. 주목할 점은 4개 인스턴스가 결정 경계 부근에 서로 근접한 위치에 모여 있다는 점이다. 이는 해당 클립들이 정분류되기는 했지만, 그 시각적 특징이 어느 한쪽 클래스에 명확히 속하기보다는 ‘공포’와 ‘폭력성’의 특징을 모두 포함하고 있을 가능성을 시사한다.

3-5 인스턴스 단위 정성 평가 사례

앞선 3-4의 UMAP 임베딩 시각화 기반 인스턴스 단위 정성 평가는 시각 모달리티 모델이 학습한 ‘공포’와 ‘폭력성’ 클래스가 임베딩 공간상에서 거시적으로 구분되는 군집을 형성함을 보여주었다. 그러나 거시적 분석만으로는 모델이 구체적으로 어떤 시각적 특징을 기반으로 판단을 내리는지, 즉 모델의 내부 작동 논리를 온전히 설명할 수 없다. 모델의 분류 결과에 대한 신뢰성과 해석 가능성을 확보하기 위해서는, 개별 인스턴스(8초 단위 클립)에 대한 모델의 판단을 심층적으로 분석하는 정성 평가를 진행했다. 대표적인 인스턴스 사례 분석을 통해 ‘공포’와 ‘폭력성’을 구분하기 위해 모델이 학습한 특징이 무엇인지 분석하고자 한다. 이 과정은 모델이 단순히 데이터의 표면적 패턴을 암기한 블랙박스가 아니라, 사람이 이해하고 해석할 수 있는 논리적 근거를 바탕으로 작동하는지를 검증하는 것이다. 이를 통해 본 연구의 핵심 목표인 인공지능 결과에 대한 사람의 해석 가능성을 확인하고자 한다.

직접적인 위협 요소가 없어도 어두운 조명, 인물의 부재, 음산한 장소 등 분위기 중심의 환경적 시각 특징을 통해 ‘공포’에 해당하는 인스턴스를 정확하게 분류했다.

선혈이나 신체 훼손이 없더라도 캐릭터 간의 명백한 타격/피격 등 행위 중심의 시각 특징을 통해 ‘폭력성’에 해당하는 인스턴스를 정확하게 분류했다.

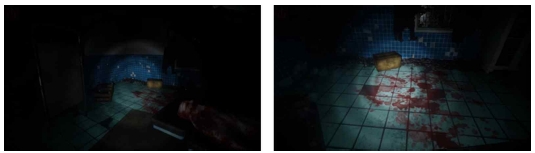

‘폭력성’만 있는 게임 플레이 영상임에도, 특정 구간에 아무런 행위가 없고 어두운 분위기만 존재할 경우, 이를 ‘공포’로 오분류하는 결과가 도출되었다.

정성 분석을 종합하면, 모델은 각기 다른 시각적 특징을 통해 ‘공포’와 ‘폭력성’을 구분하는 것으로 나타났다. ‘폭력성’은 캐릭터 간의 타격/피격과 같은 동적인 행위를 핵심 특징으로 학습한 반면, ‘공포’는 어두운 톤앤무드나 인물이 없는 공간과 같은 정적인 분위기를 주요 단서로 학습했다. 특히, ‘폭력성’ 게임의 클립이라도 직접적인 액션이 없고 화면이 어두우면, 모델은 시각적 분위기를 우선시하여 이를 ‘공포’로 판단하는 경향이 있음을 시사한다.

Ⅳ. 결 론

본 장에서는 연구 결과를 바탕으로 연구의 시사점을 심층적으로 분석하고, 내재된 한계점을 비판적으로 고찰한다.

마지막으로, 이러한 한계점을 극복하고 연구를 더욱 발전시키기 위한 구체적이고 전략적인 후속 연구 방향을 제안한다.

4-1 시사점

본 연구의 첫 번째 시사점은, MIL 프레임워크를 통해 인공지능이 사람의 직접적인 개입이나 명시적인 정답이 없어도 게임 전체(Bag)에 부여된 ‘공포’ 또는 ‘폭력성’이라는 레이블만으로 데이터 내 특징을 스스로 학습하고 구분할 수 있음을 정량적으로 입증했다는 점이다. 특히 시각 모달리티 모델은 96.55%의 정확도를 기록했으며, 이는 MIL 프레임워크가 전투 장면이나 어두운 배경 등 시각적 요소들을 ‘공포’와 ‘폭력성’을 구분하는 특징으로 학습했음을 의미한다.

결론적으로, MIL 기반 학습을 통해 인공지능이 막대한 양의 게임 데이터 속에서도 ‘공포’와 ‘폭력성’이라는 추상적 개념을 구성하는 시청각적 특징을 스스로 식별하고 학습할 수 있음을 시사한다.

정량적 수치만으로는 모델의 내부 작동 방식 전반을 이해하기 어렵기 때문에, 시각 모달리티 모델이 학습한 고차원 임베딩 벡터를 UMAP을 통해 2차원으로 시각화하는 정성적 분석을 수행하였다. 그 결과, ‘공포’와 ‘폭력성’으로 분류된 각 인스턴스(8초 분량 클립)들이 군집을 형성하였다. 이는 모델이 레이블을 암기하는 수준을 넘어, 두 개념을 구분하는 유의미한 시각적 특징들을 학습하여 데이터를 구조화했음을 시사한다.

또한, 각 군집의 중심부에서 멀어질수록 각 클래스의 특징이 더 강하게 드러나는 장면들이 분포하는 경향도 확인되었다. 예를 들어, ‘공포’ 군집의 가장 외곽에는 정성적 분석상 뚜렷한 공포 장면들이 위치했고, ‘폭력성’ 군집의 외곽에는 직접적인 폭력 장면들이 위치하였다. 이는 모델이 단순히 두 개념을 이분법적으로 나누는 것을 넘어, 임베딩 공간상 거리와 위치를 통해 ‘공포’와 ‘폭력성’의 강도와 같은 특성의 정도까지 표현하고 있음을 시사한다.

결론적으로, 군집 형성과 군집 내 의미 있는 분포는 인공지능의 분류 결과가 사람에게 해석 가능한 구조를 형성하고 있음을 나타낸다.

4-2 한계점

본 연구의 첫 번째 한계는 연구에 사용된 학습 데이터의 규모에 있다. 선별된 총 94개의 게임은 MIL 모델의 초기 성능을 검증하는 데는 적합하였으나, 이는 게관위가 진행하는 모니터링 대상 게임의 극히 일부에 불과하다. 딥러닝 모델의 성능과 일반화 가능성은 데이터의 양과 다양성에 의존한다. 따라서 학습 데이터에 포함되지 않은 새로운 장르, 독특한 아트 스타일, 비전형적인 게임 메커니즘을 가진 게임에 대해서도 동일한 성능을 보일 것이라고 보장하기 어렵다. 결론적으로 본 모델이 게관위의 포괄적인 등급분류 기준 전체를 완전히 학습했다고 판단하기에는 무리가 있다.

또한 본 연구의 모델은 클립이 ‘공포’ 또는 ‘폭력성’인지 분류할 수는 있지만, 어떤 시청각적 요소 때문에 그러한 판단을 내렸는지를 구체적으로 설명하지는 못한다. 예를 들어 ‘공포’ 군집 내부에도 갑자기 튀어나오는(Jump Scare), 음산한 분위기(Atmospheric), 신체 훼손(Gore) 공포 등과 같은 하위 유형들이 존재할 수 있음에도, 현재 모델은 이러한 개념들을 명시적으로 구분하지 않는다. 따라서 모델의 판단 근거를 보다 세밀하게 이해하기 위해서는 추가적인 연구가 필요하다.

그림 23의 ‘Dice Making Ending’(클립14)은 단순 엔딩 크레딧 장면임에도 불구하고 ‘공포’로 분류되었다. 이 오분류 사례는 현재 모델이 게임 플레이 영상에 대한 맥락적 이해에 한계가 있음을 보여준다. 모델이 장면 흐름의 맥락을 온전히 반영하지 못하는 문제는 추가 연구가 필요하다.

Representative scene from 'Dice Making Ending' (clip 14) misclassified as ‘horror’*This figure includes Korean because the study is based on gameplay footage recorded from games officially serviced in South Korea.

마지막으로 앙상블 모델의 성능 저하를 야기한 음성 모달리티 모델의 낮은 성능은 본 연구의 주요 기술적 한계 중 하나이다. 게임 내 대사와 같은 음성 정보가, 순수한 음향적 특징만으로는 ‘공포’와 ‘폭력성’을 구분하는데 제한적인데 그 원인은 두 가지로 추정된다. 첫째, 동일한 단어나 비명이라도 게임의 전후 맥락에 따라 그 의미(두려움, 놀람, 환희 등)가 달라질 수 있는데, 현재의 AST 모델은 음향 패턴은 잘 인식하나, 발화의 의미나 맥락은 인식하지 못하기 때문이다. 둘째, 본 연구에서 사용된 AST 모델은 오디오 이벤트를 탐지하는 데는 강점이 있지만, 자연어 처리 기능은 없다. 즉, 발화된 단어의 의미를 이해하지 못하고 소리의 패턴만을 학습하기 때문에 제한적일 수밖에 없다. 따라서 향후 자연어 처리를 포함하는 멀티모달 융합 연구도 필요하다.

4-3 향후 연구 방향

앞서 4-2에서 논의된 한계점들을 기반으로 본 연구를 확장하고 심화시키기 위해 다음의 3가지 연구 방향이 필요하다.

본 연구보다 많은 수의 게임 데이터를 확보하여, 게임의 장르, 아트 스타일, 플랫폼 등의 다양성을 포함하는 대규모 학습 데이터셋을 구축해야 한다. 이는 모델의 강건성과 일반화 성능 향상에 기여할 것이다.

‘공포’와 ‘폭력성’ 내에서도 다양한 하위 유형이 존재할 수 있으므로, K-평균 군집화(K-Means Clustering)와 같은 비지도 학습 기법을 활용해 하위 개념을 도출하고 분석할 필요가 있다. 이를 통해 임베딩 공간을 더 깊이 이해하고, 해석 가능성을 높일 수 있다.

음성 모달리티 모델의 잠재력을 최대한 활용하기 위해서는 기존의 AST를 넘어 자연어 처리 기술을 통합해야 한다. 음성을 텍스트로 변환(STT)한 뒤, 이를 자연어 처리로 추가 분석하는 방식을 고려할 수 있다. 이후 시각 및 비음성 모달리티 모델과 융합해 멀티모달 모델 간의 시너지를 높일 수 있을 것으로 기대한다.

References

- Game Rating and Administration Committee. 2024 Game Rating and Post-Management Yearbook [Internet]. Available: https://www.grac.or.kr/Board/CaseBookView.aspx?cbid=20&type=view, .

- Game Rating and Administration Committee. Post-Management Policy [Internet]. Available: https://www.grac.or.kr/Institution/StaticPds01.aspx, .

- SteamDB. Games Released on Steam in 2024 [Internet]. Available: https://steamdb.info/stats/releases/, .

- 42matters. Google Play Statistics and Trends 2025 [Internet]. Available: https://42matters.com/google-play-statistics-and-trends, .

- Game Rating and Administration Committee, “Rating Classification Regulations of the Game Rating and Administration Committee,” Korea Law Information Center, 2021.

- Computer Entertainment Rating Organization. CERO's Rating System [Internet]. Available: https://www.cero.gr.jp/publics/index/17/, .

-

P. Negre, R. S. Alonso, J. Prieto, C. N. Dang, and J. M. Corchado, “Systematic Mapping Study on Violence Detection in Video by Means of Trustworthy Artificial Intelligence,” SSRN, March 2024.

[https://doi.org/10.2139/ssrn.4757631]

-

D. Elzinga, S. Ruessink, G. Cascavilla, D. Tamburri, F. Leotta, M. Mecella, and W.-J. Van Den Heuvel, “Violence Detection: A Serious-Gaming Approach,” in Proceedings of the 21st International Conference on Security and Cryptography (SECRYPT 2024), pp. 163-174, 2024.

[https://doi.org/10.5220/0012762300003767]

- Game Rating and Administration Committee. Rating Classification Statistics [Internet]. Available: https://www.grac.or.kr/Statistics/GameStatistics.aspx, .

- I. Goodfellow, Y. Bengio, and A. Courville, Deep Learning, Cambridge, MA: MIT Press, 2016.

- G. Strang, Introduction to Linear Algebra, 5th ed. Wellesley, MA: Wellesley-Cambridge Press, 2016.

-

T. Mikolov, K. Chen, G. Corrado, and J. Dean, “Efficient Estimation of Word Representations in Vector Space,” arXiv:1301.3781, , January 2013.

[https://doi.org/10.48550/arXiv.1301.3781]

-

D. E. Rumelhart, G. E. Hinton, and R. J. Williams, “Learning Representations by Back-Propagating Errors,” Nature, Vol. 323, pp. 533-536, October 1986.

[https://doi.org/10.1038/323533a0]

- Viso.ai. Modality: The Multi-Dimensional Language of Computer Vision [Internet]. Available: https://viso.ai/computer-vision/modality/, .

-

S. J. Pan and Q. Yang, “A Survey on Transfer Learning,” IEEE Transactions on Knowledge and Data Engineering, Vol. 22, No. 10, pp. 1345-1359, October 2010.

[https://doi.org/10.1109/TKDE.2009.191]

-

H. Touvron, L. Martin, K. Stone, P. Albert, A. Almahairi, Y. Babaei, ... and T. Scialom, “Llama 2: Open Foundation and Fine-Tuned Chat Models,” arXiv:2307.09288, , July 2023.

[https://doi.org/10.48550/arXiv.2307.09288]

- C. M. Bishop, Pattern Recognition and Machine Learning, New York, NY: Springer, 2006.

-

R. Balestriero, M. Ibrahim, V. Sobal, A. Morcos, S. Shekhar, T. Goldstein, ... and M. Goldblum, “A Cookbook of Self-Supervised Learning,” arXiv:2304.12210, , April 2023.

[https://doi.org/10.48550/arXiv.2304.12210]

-

J. B. Allen and L. R. Rabiner, “A Unified Approach to Short-Time Fourier Analysis and Synthesis,” Proceedings of the IEEE, Vol. 65, No. 11, pp. 1558-1564, November 1977.

[https://doi.org/10.1109/PROC.1977.10770]

-

S. S. Stevens, J. Volkmann, and E. B. Newman, “A Scale for the Measurement of the Psychological Magnitude of Pitch,” The Journal of the Acoustical Society of America, Vol. 8, No. 3, pp. 185-190, January 1937.

[https://doi.org/10.1121/1.1915893]

- A. Vaswani, N. Shazeer, N. Parmar, J. Uszkoreit, L. Jones, A. N. Gomez, ... and I. Polosukhin, “Attention Is All You Need,” Advances in Neural Information Processing Systems Vol. 30, pp. 5998-6008, 2017.

-

A. Arnab, M. Dehghani, G. Heigold, C. Sun, M. Lučić, and C. Schmid, “ViViT: A Video Vision Transformer,” arXiv:2103.15691, , March 2021.

[https://doi.org/10.48550/arXiv.2103.15691]

- J. H. Kim and W. S. Park, “Sexual Content Detection Using VideoMAE,” in Proceedings of the Korea Next Generation Computing Society Spring Conference, pp. 119-121, June 2023.

-

Y. Gong, Y.-A. Chung, and J. Glass, “AST: Audio Spectrogram Transformer,” in Proc. Interspeech 2021, pp. 571-575, 2021.

[https://doi.org/10.21437/Interspeech.2021-698]

-

J. Amores, “Multiple Instance Classification: Review, Taxonomy and Comparative Study,” Artificial Intelligence, Vol. 201, pp. 81-105, August 2013.

[https://doi.org/10.1016/j.artint.2013.06.003]

-

T. G. Dietterich, R. H. Lathrop, and T. Lozano-Pérez, “Solving the Multiple-Instance Problem with Axis-Parallel Rectangles,” Artificial Intelligence, Vol. 89, No. 1-2, pp. 31-71, January 1997.

[https://doi.org/10.1016/S0004-3702(96)00034-3]

-

D. H. Wolpert, “Stacked Generalization,” Neural Networks, Vol. 5, No. 2, pp. 241-259, 1992.

[https://doi.org/10.1016/S0893-6080(05)80023-1]

-

S. Rouard, F. Massa, and A. Défossez, “Hybrid Transformers for Music Source Separation,” in Proceedings of the ICASSP 2023 - 2023 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), pp. 1-5, June 2023.

[https://doi.org/10.1109/ICASSP49357.2023.10096956]

- MIT. AST-Finetuned-Audioset-10-10-0.4593 [Internet]. Available: https://huggingface.co/MIT/ast-finetuned-audioset-10-10-0.4593, .

저자소개

2025년 2월:명지대학교 인공지능·소프트웨어 융합대학 디지털콘텐츠디자인학과 (공학사)

2025년~현 재: 명지대학교 인공지능·소프트웨어 융합대학 디지털콘텐츠디자인 전공 석사과정

※관심분야:인공지능(Artificial Intelligence), 서비스 기획(Service Planning), 데이터 분석(Data Analysis)

2023년 2월:명지대학교 인공지능·소프트웨어 융합대학 디지털콘텐츠디자인학과 (공학사)

2025년~현 재: 명지대학교 인공지능·소프트웨어융합대학 디지털콘텐츠디자인 전공 석사과정

※관심분야:게임 콘텐츠(Game Content), 게임 서비스(Game Service), 게임BM(Game Business Model), 사용자 데이터 분석(User Data Analysis)

2023년 2월:명지대학교 인공지능·소프트웨어 융합대학 디지털콘텐츠디자인학과 (공학사)

2023년~현 재: 명지대학교 인공지능·소프트웨어융합대학 디지털콘텐츠디자인 전공 석사과정

※관심분야:게임 시나리오(Game Scenario), 게임 콘텐츠 디자인(Game Contents Design)

2023년 2월:명지대학교 인공지능·소프트웨어 융합대학 디지털콘텐츠디자인학과 (공학사)

2023년~현 재: 명지대학교 인공지능·소프트웨어융합대학 디지털콘텐츠디자인 전공 석사과정

※관심분야:디지털 마케팅(Digital Marketing), 마케팅 전략(Marketing Strategy), 유저 유입 전략(User Acquisition Strategy)

2005년:명지대학교 산업디자인학과 (미술학사)

2007년:명지대학교 산업디자인학 (미술학석사)

2007년~2009년: 넥슨 모바일(현 넥슨코리아)

2009년~2011년, 2015년~2018년: 네시삼십삼분

2012년~2013년: CJ E&M 게임사업부분(현 넷마블)

2013년~2014년: 바른손 E&A

2018년~현 재: 명지대학교 인공지능·소프트웨어융합대학 디지털콘텐츠디자인학과 조교수

※관심분야:게임 콘텐츠(Game Content), 게임 서비스(Game Service), 게임BM(Game Business Model), UX(User Experience), 사용자 데이터 분석(User Data Analaysis) 등