애니메이션 형식으로서의 너패니메이션에 관한 담론

Copyright ⓒ 2023 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구의 목적은 NeRF 기반의 너패니메이션이 지닌 미학적 정체성과 산업적 영향력에 대해 전통적인 애니메이션과의 비교적인 관점에서 살펴보는 것이다. 너패니메이션은 3D 캐릭터 생성과 상호작용적인 처리 기술 등을 토대로 구현된다. 그리고 누구나 스마트단말기를 이용한 촬영만으로 언제 어디서나 애니메이션 이미지를 제작할 수 있는 새로운 패러다임의 애니메이션 형식이다. 또한, 초실감 플랫폼에서 구현되는 너패니메이션에서는 제작과 소비의 경계가 사라지고 누구나 애니메이터이자 감독이 될 수 있다. 그러므로 너패니메이션을 표현적 수단으로 활용하는 행위자는 자신의 외형과 움직임에서 나타나는 고유특징이 반영된 캐릭터와 애니메이션을 매개로 관객과 상호작용적인 소통을 하며 자신의 페르소나를 형성할 수 있다. 이처럼 너패니메이션은 애니메이션 형식으로서 지닌 조형적 잠재력이 매우 크다고 할 수 있다. 그리고 그러한 너패니메이션의 미학적 힘은 애니메이션 산업의 영역 확장에 이바지할 뿐만 아니라, 향후 애니메이션 산업 생태계의 발전과 진화에 긍정적인 영향력을 미칠 것으로 기대할 수 있다.

Abstract

This study aims to comprehensively examine the aesthetic identity and industrial impact of NeRF-based Nerfanimation (NeRF+Animation) in comparison to traditional animation. Nerfanimation leverages 3D character creation and interactive processing technologies, representing a novel animation paradigm that enables anyone to create animated content effortlessly using a smart device. In this hyper-realistic platform of Nerfanimation, the conventional boundaries between production and consumption blur, empowering individuals to assume the roles of both animator and director. As a result, creators utilizing Nerfanimation as a means of expression can develop their distinctive persona through interactive engagement with the audience, as manifested in characters and animations that authentically convey their unique attributes and movements. Consequently, Nerfanimation exhibits substantial potential for shaping the future of animation as an art form. Furthermore, the aesthetic impact of Nerfanimation is poised to not only contribute to the growth of the animation industry but also exert a positive influence on the continued development and evolution of the animation industry ecosystem.

Keywords:

NeRF, Nerfanimation, 3D Characters, 3D Animation, 3D Reconstruction키워드:

너프, 너패니메이션, 3D 캐릭터, 3D 애니메이션, 3D 복원Ⅰ. 서 론

1-1 연구 배경 및 목적

한국콘텐츠진흥원은 ‘문화’, ‘저작권’, ‘관광’, ‘스포츠’ 분야별 총 41개 세부 과제로 구성된 ‘2023년 문화체육관광 연구개발사업’의 선정 절차를 연초부터 진행했다. 본 사업의 세부 과제 중 애니메이션 산업 분야와 직접적인 관련성이 있는 연구 주제는 ‘메타버스 캐릭터 IP 확보 기술 개발을 위한 NeRF(Neural Radiance Fields) 기반 초실감 공연자 캐릭터 생성 기술 개발 및 실증’이라고 할 수 있다[1]. 이 지원 과제의 추진 목적은 NeRF 기반의 대화형 초실감 공연자 3D 캐릭터 생성과 상호작용 처리 기술의 개발을 통해 공연자가 언제 어디서나 스마트단말기의 카메라를 이용해 공연자의 고유특징이 반영된 3D 캐릭터를 메타버스(metaverse) 등 초실감 공간에서 생성하고 더 나아가 그러한 캐릭터를 매개로 관객과 실시간 상호작용이 가능한 시범서비스를 구축하는 것이다[2].

여기서 위 과제의 목적이 비록 NeRF 기반 기술 개발을 통한 공연산업 분야의 확대에 중점을 두고 있기는 하지만 과제 수행을 통해 산출될 기술 개발의 성과가 애니메이션 스토리텔링의 핵심적인 요소라고 할 수 있는 캐릭터와 움직임을 생성하고 처리하는 것과 직접적인 관련성이 있다는 점을 주목해야만 한다. 그리고 본 연구에서는 그러한 NeRF 기반의 기술적 성과가 새로운 차원의 애니메이션 형식이 출현할 수 있는 기술적 환경을 지원할 뿐만 아니라, 애니메이션 산업 생태계 전반에 미치는 영향이 매우 클 것으로 전제하고 관련된 주제에 대해 다각적으로 논의해보려고 한다. 또한, NeRF 기반의 ‘실시간 초실감 3D 캐릭터 애니메이션’을 핵심적인 기반 기술의 용어와 관련 기술 개발 내용 등을 반영하여 ‘너패니메이션(Nerfanimation, NeRF+Animation)’이라고 지칭하고자 한다.

애니메이션 산업의 발전은 제작의 효율성과 제작비 절감을 위한 기술의 개발과 장치의 발명을 통해 거듭되었으며, 그 과정에서 애니메이션의 형식과 미학이 진화하는 모습을 보여주었다. 특히, 디지털 기술과의 융합은 애니메이션의 영역을 인접 산업 분야로 확장하는 데에 기여하고 있기도 하다. 실제로, 2000년대 초반 ‘모션 캡처(Motion Capture)’ 기술이 출현하자 애니메이션 산업 현장에서는 모션 캡처 기술을 ‘사탄(Satan)’으로 지칭하며 애니메이터들의 일자리를 빼앗을 혐오스러운 기술로 바라보는 부정적인 분위기가 산업 전반으로 확산하기도 했다[3]. 그러나 산업적으로 모션 캡처 기술의 출현은 애니메이터의 몰락이 아닌 실사 영화, 게임 산업 분야 등으로 애니메이션 산업의 영역을 빠르게 넓히는 촉진제의 역할을 해주었다.

이와 같은 사실에 비추어 볼 때, 너패니메이션 기술이 가져올 새로운 애니메이션의 세계 또한 충분히 눈여겨 볼만하다. 그러므로 본 연구의 목적은 그와 같은 너패니메이션의 미학적 정체성과 산업적 영향력에 관해 다각적으로 살펴봄으로써, 너패니메이션이 여러 애니메이션 형식 중 하나로서 지닌 가치와 중요성을 다양한 시각에서 제시하는 것이다.

1-2 연구범위 및 방법

너패니메이션은 관련 기술의 개발 기간을 고려할 때 향후 2~3년 후에나 애니메이션 산업 현장에서 상용화될 수 있을 것으로 예상한다. 그러므로 본 연구에서는 너패니메이션에 대한 기술적 분석보다는 실제 너패니메이션이 지닌 미학적 정체성, 그리고 산업적 잠재력과 영향력에 관해 중점적으로 논의하고자 한다.

먼저, 너패니메이션의 기술적 배경에 관한 논의를 진행하고자 한다. 이를 위해 NeRF 관련 연구 동향 및 기술 현황을 살펴보고 너패니메이션 기술 개발 내용 전반에 대한 이해를 돕고자 한다. 이와 같은 선행적인 접근을 통해 본 논문에서 중점적으로 다루고자 하는 NeRF 기반 애니메이션 스토리텔링의 과정과 형식에 관한 연구 시각을 좀 더 넓힐 수 있을 것으로 기대한다. 또한, 너패니메이션 기술이 실제로 애니메이션 미학과 산업에 어떠한 영향을 미칠 수 있는지에 대한 담론적인 토대를 마련할 수 있을 것이며 방법론적으로 크게 세 가지 관점에서 논의를 진행하고자 한다.

첫 번째, 너패니메이션을 애니메이션이라고 할 수 있는가? 이 질문에 대해 기존 애니메이션의 개념적 정의에 관한 문헌 연구를 토대로 접근하고자 한다. 이를 통해 너패니메이션에서 나타날 수 있는 미학적 형식을 전통적인 애니메이션과 비교 분석해봄으로써 애니메이션으로서 너패니메이션이 지닌 미학적 정체성에 관해 살펴보고자 한다.

두 번째, 너패니메이션의 미학적 본질과 특징에 대해 접근함으로써 궁극적으로는 너패니메이션이 지닌 고유의 애니메이션 미학을 살펴보고자 한다. 너패니메이션은 기존의 애니메이션과 마찬가지로 본질적으로 시각화 자료이지만, 동시에 상호작용적인 의미체계를 갖는 차별적인 형식적 특징을 보여줄 것이다. 그러므로, 이러한 논의를 통해 너패니메이션이 하나의 애니메이션 형식으로서 지닌 미학적 차별성을 살펴보는 기회가 될 것이다.

세 번째, 너패니메이션의 출현이 기존 애니메이션 산업 생태계에 미치게 될 산업적 변화와 흐름을 다각적으로 살펴보고자 한다. 실제로 형식적인 시각에서 볼 때 너패니메이션은 제작과 소비 주체 모두에게 전통적인 애니메이션에서 경험할 수 없는 다른 차원의 조형적, 정서적 접근을 가능하게 할 것이다. 그러므로 너패니메이션에 관한 산업적 관점에서의 접근은 너패니메이션이 지닌 산업적 확장성과 잠재력을 살펴보는 유의미한 논의라고 볼 수 있다.

Ⅱ. NeRF 및 너패니메이션 기술에 대한 이해

2-1 NeRF 관련 연구 및 기술 동향

최근 딥러닝(Deep Learning)을 이용한 3D 복원(reconstruction) 기술이 크게 주목받고 있으며 대표적인 기술이 바로 NeRF라고 할 수 있다. NeRF는 딥러닝을 사용해 가상 시점을 생성하는 기술로서 다수의 다시점 영상과 카메라의 위치, 방향 정보를 이용해 새로운 시점의 영상을 출력한다[4]. 즉, NeRF는 신경 네트워크를 사용해 입력된 2D 이미지의 컬렉션을 기반으로 사실적인 3D 장면을 표현하고 렌더링한다.

NeRF 기술은 2020년 ECCV(European Conference on Computer Vision)에서 소개되면서 3D 비전(Vision) 분야의 발전에 자극제가 되었다[5]. 그러나 NeRF가 획기적인 기술이긴 했으나 여러 단점으로 인해 상용화에는 어려움이 있었다. 이러한 이유로 인해 NeRF 관련 연구의 대부분은 주로 다음과 같은 NeRF의 단점들을 개선하는 것에 초점을 맞춰 진행되고 있다.

첫 번째, NeRF의 학습과 렌더링을 위한 소요 시간으로 인해서 실시간 사용이 어렵다. 두 번째, 많은 학습 데이터가 요구된다. 세 번째, 학습된 표현은 다른 장면이나 객체에 일반화되지 않는다. 즉, 하나의 물체 이미지를 생성하기 위해 해당하는 모델을 학습해야만 한다. 네 번째, 정적인 물체에 대해서만 학습할 수 있고 움직임이 있을 때는 노이즈가 많이 발생할 수 있다. 다섯 번째, 같은 환경에서 촬영한 다양한 이미지를 학습할 때 좋은 성능을 보여주며, 여러 환경에서 촬영한 물체의 경우는 학습이 어렵다. 끝으로, 이미지를 촬영한 카메라의 파라미터(parameters), 즉 초점거리(focal length), 주점(principal point) 등과 같은 다양한 정보가 필요하다는 것이다[6]. NeRF의 이러한 단점들은 학습과 렌더링의 속도, 3D 복원 이미지의 질적인 문제로 나눌 수 있다. 그리고 수많은 논문이 NeRF의 그와 같은 단점과 문제점들을 개선하기 위해 발표됐다. 실제로, 프랭크 델러트(Frank Dellaert)가 정리한 NeRF 관련 연구논문과 학술발표 자료들을 살펴보더라도 대부분이 위에서 언급된 NeRF의 단점을 개선하는 것에 집중되어 있다[7]. 예를 들어, NeRF의 다소 느린 학습 및 렌더링 시간의 개선을 위해 장면을 희소 복셀 옥트리(sparse voxel octree)로 구성하여 렌더링 속도를 10배로 높이거나[8], 경계가 없는 장면을 처리하기 위해 별도의 NeRF로 배경을 모델링 하는 것을 제안하거나[9], 체적 적분(volume integral)을 직접 학습하도록 하여 렌더링 속도를 크게 높이거나[10], 메타 학습(meta learning)을 사용하여 더 빠른 훈련을 위한 좋은 가중치 초기화(weight initialization)를 찾도록 하는 것이다[11].

2022년 엔비디아(www.envidia.co.kr)는 1,000배 이상으로 속도를 높인 인스턴트(instant) NeRF를 공개했다. 엔비디아 리서치는 인공지능(AI)을 사용해 실제 세계에서 빛이 어떻게 작용하는지를 파악하여 다양한 각도에서 촬영한 소수의 2D 이미지로 3D 장면을 재구성하는 인버스 렌더링(inverse rendering) 작업을 즉시 수행할 수 있는 기술 모델을 개발한 것이다. 이 모델을 통해 수십 장의 사진과 촬영한 카메라 각도의 데이터를 단 몇 초 만에 학습하고 그 결과를 기반으로 3D 장면을 수십 밀리초 내에 렌더링할 수 있게 된 것이다[12].

엔비디아의 그래픽 연구 부문 부사장 데이비드 룹커(David Luebke)는 인스턴트 NeRF의 기술적 우수성에 관해 다음과 같이 설명하고 있다. 다각형 메쉬(polygonal meshes)와 같은 기존 3D 표현이 벡터 이미지와 유사하다면, NeRF는 비트맵 이미지와 같은 것이다. 그리고 NeRF는 물체나 장면에서 빛이 방사(radiate)되는 방식을 조밀하게 포착하는 것이다. 이러한 기술적 의미에서 인스턴트 NeRF는 2D 사진에서 디지털카메라와 JPEG 압축 기술을 통해 3D 캡처와 공유의 속도, 용이성, 도달 범위가 크게 확장한 것과 마찬가지로 3D 분야에 매우 중요한 기술이라고 할 수 있다[13].

인스턴트 NeRF는 타임 매거진(Time Magazine)이 선정한 2022년 최고의 발명품으로 사진, 3D 그래픽 및 가상 세계의 미래를 보여주는 것이기도 하다. 실제로, 2023년 초 엔비디아는 인스턴트 NeRF 소프트웨어를 업데이트했는데, 이것은 VR(Virtual Reality) 공간에서 인스턴트 NeRF를 탐색하고 3D 제작 단계를 지원하도록 했다[14]. 그리고 최근에는 엔비디아 리서치와 존스홉킨스대학교 공동 연구팀이 신경망을 사용해 예술, 게임 개발, 로보틱스 및 산업용 디지털 트윈 등에서 3D 장면을 재구성하는 새로운 인공지능 모델 ‘뉴럴란젤로(Neuralangelo)’를 개발했다[15].

이처럼 NeRF 기술은 3D에서 VR 공간으로 빠른 발전을 거듭하고 있으나 여전히 정지된 3D 이미지에 머물러 있다. 그러므로 실시간으로 초실감 3D 캐릭터를 생성하고, 동시에 상호작용적인 애니메이션을 가능하게 하는 너패니메이션 기술의 개발은 그 자체로 산업적 가치와 중요성이 매우 크다고 할 수 있다.

2-2 너패니메이션 기술

너패니메이션은 행위자 중심의 애니메이션 과정이자 하나의 애니메이션 형식이라고 할 수 있다. 그것은 행위자가 스마트단말기의 카메라로 자신의 외형과 동작을 촬영하면서부터 실시간적인 너패니메이션이 시작되기 때문이다. 다시 말하면, 행위자의 퍼포먼스(performance)는 기술적 프로세스에 따라 3D 캐릭터로 생성되고 실시간 상호작용 형식의 애니메이션 이미지로 나타날 수 있기 때문이다.

이러한 사실에 비추어 볼 때, 너패니메이션에서 행위자의 의미와 역할은 감독이자 애니메이터로 거듭날 수 있는 것이다. 즉, 행위자는 너패니메이션 기술이 지원하는 가상의 상호작용적인 환경 속에서 자신만의 조형적 이미지를 매개로 하여 자신이 의도하는 미학적 영감이나 정서적 욕구를 자유롭게 표현하거나 페르소나(persona)를 만들어가면서 너패니메이션 전반의 행위 주체가 되는 것이다. 이러한 관점에서 보면 너패니메이션은 행위자가 상상하는 모든 것을 표현할 수 있는 환상적인 애니메이션 형식이다. 그리고 다음과 같은 NeRF 관련 기술들이 총체적으로 개발될 때 비로소 구현될 수 있을 것이다[2].

표 1에서와 같이 너패니메이션은 행위자의 3D 캐릭터 생성과 실시간 상호작용 처리 기술 개발을 통해 하나의 애니메이션 형식으로서 접근될 수 있을 것이다. 특히, NeRF 기반 기술의 핵심적인 키워드는 ‘3D 캐릭터’와 ‘상호작용’이라고 할 수 있다. 여기서 상호작용은 둘 이상의 활동적인 독립체에 의해 나타날 수 있는 대화와 같은 형식의 순환적인 과정을 의미한다[16]. 그와 같은 상호작용은 임의적인(random) 애니메이션 스토리텔링의 창작을 가능하게 할 수 있다. 다시 말하면, 행위자는 실시간적으로 초실감 공간에서 만들어지는 3D 캐릭터, 언어적·비언어적 요소를 포함하는 애니메이션 이미지를 매개로 자기가 추구하는 페르소나를 표현하고 관객과 소통하는 즐거움을 느낄 수 있는 것이다.

Ⅲ. 너패니메이션에 관한 담론

3-1 너패니메이션의 미학적 정체성

‘생명력을 불어넣는다(to give life to)’라는 어원적 의미를 담고 있는 애니메이션의 개념에서 알 수 있듯이 애니메이션이란 근본적으로 무생물인 캐릭터에게 생명력을 불어넣는 과정 자체를 말하는 것이다[17]. 먼저, ‘메타모포시스(metamorphosis)’는 애니메이션의 어원적 의미를 조형적으로 구현하는 미학적 표현 양식이라고 할 수 있다. 애니메이션에서의 메타모포시스는 조형적 이미지를 구성하는 선의 전개, 형태의 변화, 대상과 환경의 조작을 통해 하나의 이미지가 다른 이미지로 바뀌는 것을 의미한다. 세르게이 에이젠슈타인(Sergei Eisenstein)은 애니메이션의 캐릭터나 조형적 이미지가 태고의 원형질처럼 자연스럽게 표현되는 것을 보고 메타모포시스를 우리가 원하는 무엇이든지 진화적으로 구현할 수 있는 ‘전능한, 무한한 힘(omnipotence)’이라고 설명했다[18]. 실제로, 메타모포시스는 애니메이션 작품의 스토리텔링을 구성하는 여러 이미지의 연결 과정을 정당화하고, 형상과 물체의 변화가 필연적인 것처럼 자연스럽게 보여준다[19]. 그러나 메타모포시스를 통한 애니메이션의 유동적인 형상만으로 애니메이션의 용어적 개념에 부합하는 ‘생명력의 환영(illusion of life)’이 구현됐다고는 할 수 없다. 다시 말하면, 애니메이션의 개념적 관점에서 ‘움직임의 환영(illusion of movement)’만으로 애니메이션이 완전하게 구현됐다고 볼 수 없는 것이다. 그것은 단순히 움직임의 환영만을 통해서 캐릭터의 생명력을 느끼게 해주는 개성이나 성격 등이 효과적으로 표현될 수 있는 것이 아니기 때문이다[20]. 그리고 이와 같은 논의의 대상을 물리적 형태가 현실에서와 같이 유지될 수 있는 3D 컴퓨터 애니메이션으로까지 확대하여 접근하게 되면 메타모포시스의 미학적 영향력은 훨씬 줄어들게 된다. 마찬가지로, 메타모포시스 관점에서의 시각은 3D라는 형식을 공유하고 조형적 이미지가 거의 유사하게 표현될 수 있는 너패니메이션의 미학적 정체성을 논의하기 위한 미학적 배경으로도 적절하지 않다.

애니메이션의 정의를 위해 가장 보편적으로 인용되는 노먼 맥라렌(Norman Mclaren)의 관점에서 보면, 애니메이션은 본질적으로 움직이는 그림의 예술이기보다는 그려진 움직임의 예술이다. 그리고 각 프레임 위에서 일어나는 것보다는 각 프레임 사이에서 일어나는 것이 훨씬 중요하다. 그러므로 애니메이션은 각 프레임 사이의 보이지 않는 공간을 조작하는 예술이라고 할 수 있다[17]. 즉, 애니메이션 캐릭터의 생명력은 캐릭터가 표현하는 구체적인 행동의 ‘타이밍(timing)’을 조작하는 것으로부터 시작된다고 볼 수 있다. 그러므로 이와 같은 애니메이션의 개념적 관점에서 너패니메이션이 애니메이션 미학의 범주 속에 포함될 수 있는가를 살펴보는 것은 애니메이션 형식으로서 너패니메이션의 미학적 정체성을 탐색하는 의미 있는 작업이라고 할 수 있다.

너패니메이션의 조형적 재료는 기본적으로 스마트단말기를 통해 촬영되는 실사 동작이라고 할 수 있다. 애니메이션의 개념적 정의에 따르면 정지된 사물이나 인형, 사람의 동작 등 조형적인 형태의 모든 것들이 애니메이션의 재료가 될 수 있다. 그리고 무엇보다 중요한 점은 그러한 조형적 요소들에 생동감을 부여하는 애니메이션 기법의 적용이다[21]. 이러한 논의의 관점에서 너패니메이션에서의 애니메이션 기법이란 너패니메이션의 기술적 구현과정이라고 할 수 있다.

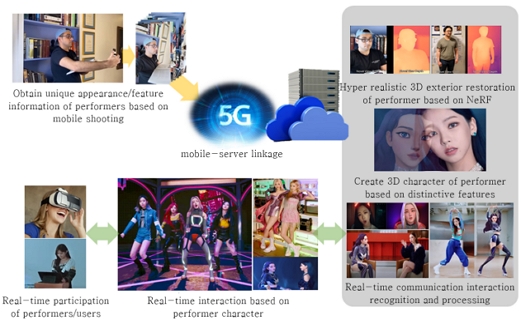

NeRF 기반 관련 기술 개발에 따른 너패니메이션의 제작과 소비는 그림 1과 같은 과정을 통해 실시간적으로 이루어질 것이다[2]. 그리고 3D 캐릭터 애니메이션 제작에서 일반적으로 필요로 하는 레이아웃(layout), 모델링(modeling), 텍스처링(texturing), 리깅(rigging), 애니메이션(animation), 렌더링(rendering) 등의 작업 과정이 기술 융합적인 너패니메이션 시스템을 기반으로 자동화되는 것이다. 이러한 너패니메이션의 구현과정에서 행위자가 생산하는 실사 동작은 애니메이션의 재료라고 볼 수 있다. 그러한 재료로서의 실사 동작은 NeRF와 인공지능 영상 분석 기반의 3D 복원 기술을 통해 또 다른 차원의 상호작용적인 3D 캐릭터 애니메이션으로 나타나게 되는 것이다.

너패니메이션에 대한 이러한 접근 시각을 전통적인 애니메이션 제작과정과 비교해보면 너패니메이션의 구현 단계에서는 애니메이터의 직무와 역할이 사라지고 그 부분은 NeRF 관련 기술로 대체가 되는 것이다. 물론, 애니메이션 제작 형식의 근본적인 변화로 인해서 너패니메이션을 하나의 애니메이션 형식으로 바라보는 시각에 대해 논쟁의 소지가 있을 수 있다. 그러나 너패니메이션 과정에서 행위자의 고유특징이 반영된 3D 캐릭터가 생성되고 캐릭터의 애니메이션 동작이 구현된다는 사실을 주목해야만 한다. 너패니메이션은 기본적으로 행위자의 실사 동작에서 나타나는 고유특징을 두각화하여 실시간 상호작용적인 3D 애니메이션으로 표현하는 형식이다. 즉, ‘키 프레임 애니메이션(key frame animation)’ 제작기법을 기반으로 하는 표현 양식과 미학적 특징이 너패니메이션 기술을 통해 구현되는 것이다. 그러므로 너패니메이션에서 나타나는 3D 캐릭터의 동작은 전통적인 애니메이션 캐릭터와 마찬가지로 인식적 가독성이 뛰어나고 움직임의 역동성이 효과적으로 표현될 수 있다. 다시 말하면, 단조로울 수 있는 실사 동작을 역동적인 상승과 하강, 변화와 전환으로 구현함으로써, 관객이 3D 캐릭터의 구체적인 행동을 통해 개성이나 성격, 심리적 상태나 분위기 등을 쉽게 이해할 수 있도록 돕게 되는 것이다[22]. 또한, 애니메이터가 추구하는 예술적 감성이나 경향이 다양하게 드러나는 전통적인 애니메이션과 마찬가지로 너패니메이션에서도 행위자의 미학적 성향이나 정서적 욕구가 다채롭게 나타날 수 있다. 이처럼 전통적인 애니메이션의 미학적 정체성을 상당 부분 공유하는 너패니메이션은 애니메이션 산업의 새로운 영역을 확장하기 위한 형식적 토대로서 매우 유용하다고 할 수 있다.

3-2 너패니메이션의 미학적 차별성

너패니메이션은 행위자의 외형과 실사 동작을 분석하고 그에 따라 고유의 특징을 두드러지게 표현하는 기술적 기반을 통해 3D 캐릭터를 생성하고 애니메이션을 보여주게 된다. 이러한 점에서 너패니메이션의 기술적 형식은 사물의 본질을 선택적으로 표현하여 빠른 노출 속에서도 대상을 쉽게 인식할 수 있도록 하는 캐리커처의 형식과 매우 유사하다고 할 수 있다.

캐리커처는 쉽게 식별할 수 있는 시각적 유사함을 보여주기 위해 사람이나 동물, 사물의 본질을 과장하거나 왜곡하는 초상화라고 볼 수 있다[23]. 이러한 논의는 월트 디즈니(Walt Disney)가 애니메이션의 현실성을 구현하기 위해 방법론적으로 사실적인 것의 캐리커처를 원했던 사실과 밀접한 관련이 있다[24]. 즉, 그림 1과 같이 너패니메이션의 구현과정을 통해 나타나게 되는 3D 캐릭터와 애니메이션 또한 월트가 기대했던 것과 마찬가지로 실사의 본질적인 부분을 선택적으로 표현한 결과라고 할 수 있다.

우리가 경험하게 될 너패니메이션의 이미지는 그 재료가 실사 동작이라고 할지라도 기존의 애니메이션과 마찬가지로 실재적인 것은 아니다. 그러나 그것은 그림 1에서 볼 수 있듯이, 현실의 원본을 단순히 재현한 가짜가 아닌 관객이 사실적으로 인식할 수 있는 하이퍼 리얼리티(hyper-reality)를 담고 있는 3D 이미지이다. 이처럼 너패니메이션이 지닌 하이퍼 리얼리티는 움베르토 에코(Umberto Eco)가 디즈니의 테마파크를 묘사하며 설명했듯이 ‘완전하게 실제(completely real)’이면서 동시에 ‘완전하게 가짜(completely fake)라는 미학적 본질과 특징을 지니고 있다[25].

너패니메이션의 하이퍼 리얼리티에 대한 논의와 관련하여 장 보드리야르(Jean Baudrillard)의 철학은 유용한 이론적 배경으로 활용될 수 있다. 그에 따르면 이미지는 실재를 반영하고 있으나 동시에 실재와 아무런 관련이 없는 시뮬라크르(simulacre)이며, 시뮬라크르는 실재보다 더 실재적인 것으로써 현실에 존재하는 것과는 아무런 상관이 없는 것이다[26]. 이러한 관점에서 보면 너패니메이션 이미지가 보여주는 하이퍼 리얼리티는 단순히 현실을 재현한 가짜가 아닌 관객이 경험하고 수용할 수 있는 또 다른 차원의 리얼리티라고 할 수 있다[27].

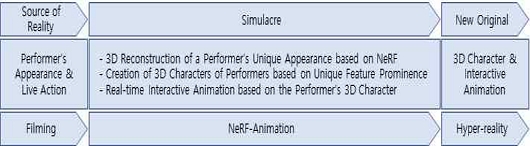

너패니메이션의 구현과정은 그림 2와 같이 현실의 원본이라고 할 수 있는 행위자의 외형과 실사 동작이 여러 기술적 단계를 거치며 3D 캐릭터로 생성되고 상호작용적인 애니메이션으로 구현되는 것이다. 여기서 너패니메이션 기술은 실사 동작을 3D 애니메이션 형태로 복원하는 것만을 목적으로 하는 것이 아니라, 실사 동작의 구체적이며 역동적인 이미지를 3D 캐릭터를 통해 구현함으로써 관객이 실재감과 생동감을 느낄 수 있도록 하는 것이다. 그리고 그와 같은 너패니메이션의 기술적 과정에서 현실의 실사 이미지는 3D 형태로 복원과 생성 단계를 거치며 현실의 원본은 더 이상 존재하지 않게 되는 것이다. 또한, 너패니메이션에서는 실시간적으로 3D 캐릭터가 생성되고 상호작용적으로 애니메이션이 구현되면서 연쇄적인 복제가 거듭하게 된다. 관객은 그와 같은 3D 애니메이션을 연속적으로 경험하면서 눈에 보이는 이미지를 실재와 구분되는 새로운 원본으로 인식하게 된다. 그러므로 너패니메이션 이미지는 더 이상 복제할 원본이 없는 파생적인 실재로서 고유의 하이퍼 리얼리티를 지니게 되는 것이다. 그리고 너패니메이션을 바라보는 관객은 그것의 원본이 되는 실사 동작과 비교하기보다는 3D 캐릭터의 구체적인 행동이 보여주는 소통적 의미체계에 몰입하며 공감하게 될 것이다.

특히, 너패니메이션의 하이퍼 리얼리티는 실사 동작의 생산 주체라고 할 수 있는 행위자가 추구하는 미학적 경향과 예술적 영감, 장르, 주제와 내용 등에 따라서 표현 양식의 범위가 매우 폭넓게 나타날 수 있다. 그리고 너패니메이션의 구현과정에서 행위자가 표현하는 구체적인 행동의 방식과 유형은 하이퍼 리얼리티를 내포하는 너패니메이션 고유의 ‘환영적인 행동(illusionistic action)’이며 그 자체로 생명력을 내포하게 된다. 또한, 그러한 환영적인 행동은 절대적 기준에 의해 정형화된 형태로 표현될 수 없을 뿐만 아니라, 너패니메이션의 미학적 경향과 차별성을 가늠하는 중요한 척도로써 활용될 수 있을 것이다[28].

3-3 너패니메이션의 산업적 영향력

최근 싱가포르에서 개발된 애니메이션 제작 소프트웨어 ‘카카니(CACANi)’를 통해 2D 애니메이션의 작화를 자동으로 그리는 것이 가능해졌다. 즉, 카카니는 애니메이터가 애니메이션의 원화를 그리기만 하면 동화를 자동으로 생성해주는 것이다. <캡틴 츠바사(キャプテン翼)>(2018), <불꽃 소방대(炎炎ノ消防隊)>(2019) 등이 애니메이션 제작과정에서 카카니 소프트웨어를 부분적으로 활용한 작품들이다. 캐릭터 움직임의 타이밍을 조작하거나 복잡한 움직임의 애니메이션은 애니메이터가 직접 진행해야만 했다. 이러한 사실을 통해 애니메이션 제작에 인공지능이 도입되더라도 단순한 움직임이나 반복되는 움직임의 표현 정도에 국한될 것으로 전망하고 있다[29]. 그러나 전 세계 2D 애니메이션 산업의 강국인 일본에서 제작비 절감과 전문 인력 부족에 대한 대책으로 카카니와 같은 소프트웨어를 활용하고 있다는 사실은 너패니메이션 기술이 3D 애니메이션 산업에서 긍정적으로 이용될 가능성을 충분히 짐작하게 한다. 특히, 너패니메이션의 경우에는 카카니와 달리 애니메이션 제작 지원 소프트웨어이기보다는 또 다른 형식의 3D 애니메이션을 제작하는 플랫폼 혹은 시스템으로 바라보는 것이 적당할 것이다. 그러므로 너패니메이션은 그 자체로 산업적 영역을 창출할 수 있는 잠재력을 지니고 있다고 볼 수 있다.

키 프레임 애니메이션과 모션 캡처 애니메이션의 차이를 비교해보면 향후 너패니메이션을 통해 경험할 수 있는 미학적 특징을 직간접적으로 알 수 있을 것이다. 먼저, 전통적인 캐릭터 애니메이션에서는 키 프레임 애니메이션을 통해 캐릭터의 움직임이 과장되거나 왜곡되게 표현됨으로써 현실의 본질적 특징을 선택적으로 강화하고 캐릭터가 보여주는 행동의 목적성과 의미를 효과적으로 보여준다. 다시 말하면, 캐릭터의 과장된 움직임과 표정, 몸짓 등은 캐릭터의 성격과 개성을 강조하여 캐릭터 자체의 생명력과 현실감을 보여주고자 하는 미학적 기법이라고 할 수 있다[30].

반면에, 모션 캡처 기술이 활용된 작품에서 나타나는 캐릭터의 움직임은 키 프레임 애니메이션과 비교해 볼 때 좀 더 부드럽고 자연스러운 느낌을 보여준다. 키 프레임 애니메이션에서는 동작을 과장되고 재미있게 표현하기 위해 특정 부분의 프레임에서 움직임의 왜곡이 극대화되는 반복적인 양식을 보여준다. 그러나 <몬스터 하우스(Monster House)>[34]에서와 같이 모션 캡처 애니메이션의 캐릭터는 실사 동작의 데이터를 적용해 표현함으로써 특정의 패턴 없이 움직임들이 연결되어 나타난다는 사실을 알 수 있다. 그러므로 모션 캡처 데이터 기반의 동작을 키 프레임 애니메이션 제작기법의 애니메이션 연기처럼 표현할 수 있는 기술이 개발된다면 산업 현장에서의 선호도는 매우 높을 것으로 예상된다[32]. 이러한 논의의 관점에서 너패니메이션은 그러한 요구에 부응할수 있는 실제적인 대안이 될 수도 있다.

특히, 너패니메이션 기술 개발을 통한 애니메이션 저작 도구의 대중적 보급으로 인해 기존 애니메이션 산업의 생태계와는 달리 제작과 소비 주체의 경계가 사라지는 새로운 애니메이션 창작산업이 출현할 수 있다. 우리는 이미 프로튜어(Proteur, Professional+Amateur) 중심의 UCC(User Created Contents)를 통한 영상 제작 분야의 저변 확대가 1인 미디어 산업으로 발전한 것을 지켜본 바가 있다. 이와 마찬가지로, 애니메이션 산업 생태계의 소비 주체였던 일반 대중까지도 너패니메이션의 대중화에 직접적으로 참여하게 된다면 머지않아 전통적인 애니메이션 산업과 공존하는 너패니메이션 산업 생태계가 안정적으로 구축될 수 있을 것이다. 이러한 논의의 관점에서 볼 때, 너패니메이션은 태생적으로 플랫폼 기반의 산업 생태계를 조성할 것이다. 그러므로 플랫폼 기반의 문화콘텐츠 산업 대부분이 그러하듯이 너패니메이션의 출현은 표현 양식, 장르, 주제와 소재, 내용의 다양성으로 이어질 뿐만 아니라, 여러 산업과의 융합적 시도와 접근으로 나타날 것이다. 또한, 행위자의 페르소나를 형성할 수 있는 너패니메이션의 형식적 장점은 너패니메이션 창작자를 대상으로 하는 다중 채널 네트워크(MCN, Multi Channel Network) 산업과의 융합 모델로 발전할 수 있을 것이다. 이처럼 향후 너패니메이션의 상용화는 여러 산업과의 융합적 접근을 통해 애니메이션의 산업적 영역을 확장하고 산업 생태계의 구조적 변화에 크게 영향을 미칠 것으로 보인다.

Ⅳ. 결 론

본 연구에서는 NeRF 기반의 너패니메이션이 지닌 미학적 정체성과 산업적 영향력에 대해 다각적으로 살펴봤다. 그리고 다양한 시각의 논의를 통해 너패니메이션이 새로운 패러다임의 애니메이션 형식으로서 애니메이션 산업 생태계 전반에 미치는 영향이 매우 클 것으로 내다봤다. 또한, 초실감 플랫폼을 기반으로 제작과 소비의 경계를 넘나들 수 있는 너패니메이션은 애니메이션의 전통적 미학을 토대로 하면서도 그것이 지닌 산업적 팽창력과 확장성을 통해 애니메이션 산업의 새로운 도약을 이끌 것으로 생각한다.

특히, 너패니메이션은 언제 어디서나 카메라를 이용해 자신을 촬영하는 것만으로도 초실감 공간 속에서 애니메이션을 구현할 수 있다. 그리고 행위자의 외형과 실사 동작의 고유특징을 두각화 하는 기술이 매우 중요하게 적용되기 때문에 그 어떤 창작 형식보다도 타인과의 실시간 소통을 통해 자신의 페르소나를 효과적으로 형성할 수가 있다. 너패니메이션의 이러한 장점은 애니메이션 산업의 시공간적 혁신을 이끌 뿐만 아니라, 산업적 변화와 시대적 흐름에 부응하는 대안적인 산업 모델로 충분히 주목받을 수 있을 것이다.

향후 본 연구성과를 토대로 너패니메이션의 미학적 활용성에 관한 다각적인 후속 연구를 진행함으로써, 너패니메이션 산업의 활성화에 기여할 수 있는 실용적인 연구성과를 산출하는 것이 바람직할 것이다. 그와 같은 연구성과는 애니메이션 산업 분야가 전통적인 소비 플랫폼이라고 할 수 있는 TV나 극장을 벗어나 메타버스와 같은 초현실적 가상 세계로까지 소비와 창작 영역을 확장하는 데에 중요한 토대가 될 수 있다고 확신한다.

References

- Korea Creative Content Agency, 2023 Culture, Sports and Tourism Research and Development Project Promotion Plan Preview, 2023-0036, January 2023

- Korea Creative Content Agency. New Planning Tasks for the 2023 Culture, Sports and Tourism Research and Development Project Internet Pre-announcement and Opinion Collection Information [Internet]. Available: https://www.kocca.kr/kocca/bbs/view/B0000137/2001549.do?menuNo=204201, .

- Game Developer. Exorcising Satan’s Rotoscope: Motion Capture from an Animator’s Perspective [Internet]. Available: https://www.gamedeveloper.com/, .

- H. M. Han, I. Y. Chun, and S. S. Hwang, “Improvement of NeRF(Neural Radiance Field) Using Depth Information,” in Proceedings of 2021 Autumn Annual Conference of IEIE(The Institute of Electronics and Information Engineers), Incheon, pp. 329-332, November 2021.

-

B. Mildenhall, P. P. Srinivasan, M. Tancik, J. T. Barron, R. Ramamoorthi, and R. Ng, “NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis,” in Proceedings of the 16th European Conference on Computer Vision (ECCV 2020), Glasgow, UK, pp. 405-421, August 2020.

[https://doi.org/10.1007/978-3-030-58452-8_24]

- Everyone's Research Institute, Introduces NeRF's Shortcomings and Follow-up Research [Internet]. Available: https://modulabs.co.kr/blog/nerf-followup/, .

- Frank Dellaert. NeRF Explosion 2020 [Internet]. Available: https://dellaert.github.io/NeRF/, .

- L. Liu, J. Gu, K. Z. Lin, T.-S. Chua, and C. Theobalt, “Neural Sparse Voxel Fields,” in Proceedings of the 34th Annual Conference on Neural Information Processing Systems (NeurIPS 2020), Online, pp. 15651-15663, December 2020.

-

K. Zhang, G. Riegler, N. Snavely, and V. Koltun, “NeRF++: Analyzing and Improving Neural Radiance Fields,” arXiv:2010.07492, , October 2020.

[https://doi.org/10.48550/arXiv.2010.07492]

- SCI(Stanford Computational Imaging Lab). Automatic Integration (CVPR 2021) [Internet]. Available: https://www.computationalimaging.org/publications/automatic-integration/, .

-

M. Tancik, B. Mildenhall, T. Wang, D. Schmidt, P. P. Srinivasan, J. T. Barron, and R. Ng, “Learned Initializations for Optimizing Coordinate-Based Neural Representations,” in Proceedings of 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Nashville: TN, pp. 2845-2854, June 2021.

[https://doi.org/10.1109/CVPR46437.2021.00287]

- Blueframe. Converting 2D Photos into 3D Scenes, NVIDIA Neural Rendering Model ‘Instant NeRF’ Released [Internet]. Available: https://blueframe.co.kr/, .

- Nvidia Korea. 'Instant NeRF' Converts 2D Photos into 3D Scenes in the Blink of an Eye [Internet]. Available: https://blogs.nvidia.co.kr/2022/03/30/instant-nerf-research-3d-ai/, .

- Korea Benchmark. NVIDIA Announces Instant NeRF Software Update [Internet]. Available: https://kbench.com/?q=node/240873, .

- AI Times. NVIDIA-Johns Hopkins University Develops New AI Model ‘Neuralangelo’ that Reconstructs 3D Scenes from 2D Video Clips [Internet]. Available: https://www.aitimes.kr/, .

- C. Crawford, Chris Crawford on Interactive Storytelling, Berkeley, CA: New Riders, 2005.

- C. Solomon, Animation: Notes on a Definition, in The Art of the Animated Image: An Anthology, Los Angeles, CA: The American Film Institute, pp. 9-12, 1987.

- S. Eisenstein, Eisenstein on Disney, London, UK: Seagull Books, pp. 21-22, 1986.

- P. Wells, Understanding Animation, Abingdon, UK: Routledge, pp. 123-124, 1998.

- R. Williams, The Animator’s Survival Kit, London, UK: Faber and Faber Limited, p. 13, 2001.

- M. Furniss, Art in Motion: Animation Aesthetics, London, UK: John Libbey, p. 5, 1998.

- T. Barr, Acting for the Camera, translated by S. G. Lee and H. Y. Kim, Seoul: Jipmundang, pp. 21-22, 2001.

- H.-Y. Kim and D.-I. Oh, “Research on the Cartoon-Style Character of the Smartphone App Game: Focus on Perceptual Superiority of the Character,” The Korean Journal of Animation, Vol. 8, No. 4, pp. 24-42, December 2012.

- F. Thomas and O. Johnston, The Illusion of Life, New York, NY: Disney Editions, pp. 65-66, 1995.

- P. Wells, Understanding Animation, Abingdon, UK: Routledge, p. 25, 1998.

- H. Kim, “Korean Hyperrealism in 1970s-1980s: The Line between What is ‘Real’ and What is ‘Virtual’, Reading It by the Theory of Jean Baudrillard,” Art History Forum, No. 31, pp. 169-196, December 2010.

- K. H. Lee, “Digital Images and Hyper-Reality of Television Documentaries: Special Image Analysis of ‘Noodle Road’,” The Journal of Literature and Film, Vol. 11, No. 1, pp. 107-128, April 2010.

-

D.-I. Oh, “A Study on Education Methodology for Character Animation’s Effective Acting and Directing,” Journal of Digital Contents Society, Vol. 21, No. 8, pp. 1431-1441, August 2020.

[https://doi.org/10.9728/dcs.2020.21.8.1431]

- AI Times. With the Development of AI, which Job will Remain in the Future, Animator? [Internet]. Available: https://www.aitimes.com/news/articleView.html?idxno=120785, .

-

D.-I. Oh, “A Study on the Essence and Aesthetic Differentiation of the Animation Character Acting,” The Korean Journal of Animation, Vol. 15, No. 4, pp. 243-271, December 2019.

[https://doi.org/10.51467/ASKO.2019.12.15.4.243]

- G. Kenan, Monster House, Vancouver, Canada: Sony Pictures Imageworks, 2006.

-

M. Yoo and K. Park, “Comparison of the Character Movements from Key-Frame and Motion Capture Animation,” The Journal of Korea Contents Association, Vol. 8, No. 9, pp. 74-83, September 2008.

[https://doi.org/10.5392/JKCA.2008.8.9.074]

저자소개

1998년:중앙대학교 연극학과(이론연출) 학사

2001년:중앙대학교 대학원 연극학석사

2013년:사우스웨일즈대학교 대학원 PhD (영상 분야)

2011년~2013년: ㈜브로콜리엔터테인먼트 대표이사

2013년~현 재: 선문대학교 영상예술학과 교수

※관심분야:애니메이션, 영상기획 및 제작 등