로보어드바이저의 페르소나와 대화 설계 전략이 사용자 경험에 미치는 영향: 투자 손실 상황에서 정중함과 책임 귀인을 중심으로

Copyright ⓒ 2023 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

이 연구는 주식투자 서비스의 인공지능 에이전트인 로보어드바이저의 디자인 방식에 따른 사용자 경험 효과를 검증한 실험 연구이다. 분석 결과, 투자 손실 상황에서 로보어드바이저 페르소나의 정중함과 손실 책임의 사용자 귀인에 따라, 지각된 능력, 신뢰, 지속사용의도가 높아졌다. 이 결과는 서비스 앱 에이전트 디자인에서 흔히 채택하고 있는 친근한 페르소나가 투자 손실 상황에서는 효과적이지 않음을 확인하였다. 또한 로보어드바이저가 투자 손실에 대한 사과 전략보다 사용자에게 책임을 귀인하고 후속 결정을 제안하는 방어 전략을 취했을 때 더 좋은 사용자 경험 효과를 가져올 수 있음을 밝혔다.

Abstract

In this study, we examined robo-advisor user experience in stock investment services. Particularly, we investigated the effects of the formality level (less vs. more formal) of the agent persona and the attribution of responsibility in conversations (imposed on the user vs. on the artificial intelligence agent) on the perceived intelligence, trust, and intentions of users to continue using the service, particularly in investment loss situations. The experimental study, wherein participants interacted with a chatbot-based prototype, demonstrated that the users' perceived intelligence and trust were significantly higher when the robo-advisor persona was more formal, or when it shifted responsibility to users rather than their counterparts. This indicates that current friendly personas in the financial service app agent design may need to be more formal. In addition, investment losses can be better handled by imposing responsibilities on the users, suggesting follow-up decisions rather than sending apologies.

Keywords:

Robo-Advisor, User Experience, Transparency of Explanation, Attribution, Agency Persona키워드:

로보어드바이저, 사용자 경험, 설명 투명성, 책임 귀인, 에이전트 페르소나Ⅰ. 서 론

이 연구는 금융 분야의 인공지능(AI) 에이전트인 ‘로보어드바이저(Robo-Advisor)’를 어떻게 설계해야 투자 손실 상황에서 더 효과적인 사용자 경험(UX)을 제공할 수 있는지를 탐색하고 검증하는 것을 목적으로 한다. 코로나19 팬데믹 기간에 주식 투자 신규 참여자가 증가하면서, 스마트폰 모바일 트레이싱 시스템 (Mobile Trading System, MTS) 어플리케이션의 사용자가 크게 늘어났다. 금융업계는 젊은 세대의 투자 심리장벽, 비용장벽을 낮추기 위해 AI를 활용한 투자 자문 및 일임 서비스인 로보어드바이저 서비스를 적극적으로 확대하고 있다.

로보어드바이저는 머신러닝, 딥러닝 기술을 접목해 전문가 투자 자문 및 자산 관리 상담 역할을 수행한다. 장점은 인건비가 들지 않아 자문 수수료가 낮고, 소액 투자도 가능해져 신규 고객의 진입 장벽을 낮추어 주며, 투자자 성향에 맞춘 개인화가 용이하다. 로보어드바이저의 글로벌 시장 규모는 2021년 1.4조 달러를 돌파하였고, 2026년까지 연평균 15% 성장할 것으로 예상된다[1]. 현재, 국내 금융사의 로보어드바이저는 주로 챗봇 형태로 사용자와 인터랙션하며, 주로 사람 또는 동물 캐릭터 에이전트로 디자인되고 있다.

로보어드바이저는 사용자의 자산을 관리하는 금융 서비스 에이전트이므로, 투자 손실 상황이 발생할 수 있으며 이러한 부정적 경험 상황이 다른 AI 에이전트 설계와는 다른 맥락적 요인이다. 즉, 기대 손실이 상대적으로 작은, 미디어 콘텐츠 추천 AI 에이전트나 서비스 로봇과는 다른 관점에서 인공지능 에이전트의 대화 설계를 연구해야 한다. 사용자에게 투자 손실이 발생한 경우 부정적 경험 상황에 대한 설계 전략이 반드시 필요하다. 그러나, 국내 로보어드바이저 관련 연구는 아직 법적, 정책적 연구가 주를 이루고 있으며, HCI 분야에서는 로보어드바이저를 주제로 삼은 연구가 적어 손실 상황을 전제해야 하는 금융 서비스 실무에서 참고할 자료가 부족한 상황이다. 투자 손실 상황은 사용자가 이탈할 수 있는 고객 관리 사이클 기간으로, 로보어드바이저 에이전트의 페르소나 특성과 대화 전략에 대한 심층적 연구와 실무적 적용이 특히 중요하다.

로보어드바이저의 주요 과업 맥락은 크게 투자 시작 단계인 포트폴리오 설계와 변경, 그리고 투자 관리 상담 단계인 수익 실현과 투자 손실 상황으로 구분할 수 있는데, 이 논문은 2022년 이후 인플레이션과 금리 인상으로 인해 주가가 하락하고 대부분의 투자자들이 투자 손실을 경험하고 있는 현실을 고려하여, 투자 손실 상황에 초점을 두었다.

로보어드바이저의 포트폴리오 설계 단계와 투자 손실 단계 간에 에이전트 페르소나와 대화 설계 전략에 따라 사용자 경험의 차이가 있는지는 아직 연구 결과가 많이 축적되어 있지 않다[2]. 투자 손실 상황에서 로보어드바이저의 커뮤니케이션 전략은 크게 부인(denial)과 사과(apology)로 구분되는데, 어느 전략이 더 효과적인지는 아직 논쟁의 여지가 있다. 로보어드바이저의 손실 커뮤니케이션을 디자인할 때 부인보다 사과 전략이 효과적으로 나타난 연구도 있지만[3], 사과 전략은 사용자에게 AI 기술에 결함이 있는 듯한 인상을 줄 수 있으며, 장기적으로 로보어드바이저에 대한 신뢰를 저하시킬 수 있다. 인공지능 알고리즘의 무결성 위반에 대해 AI 에이전트가 사과하기보다 부인하였을 때, 사용자가 더 높은 수준의 신뢰를 보이는 경향도 확인되었다[4],[5].

또한, 로보어드바이저는 사용자들과 상담 역할을 원활하게 수행하기 위해 페르소나를 설정하여 외모와 성격을 디자인하게 된다. 대표적인 유형으로는 친근한 동물 캐릭터(사례: 카카오뱅크의 카카오프렌즈, 신한은행의 몰리 등), 로봇 캐릭터(사례: 우리은행의 우리로보알파), 인간형(사례: 현대카드 Henry) 등이 있다. 이 가운데 동물 캐릭터 페르소나 유형은 젊은 고객층에게 친근감을 소구하여 다수의 로보어드바이저에서 활용되고 있지만, 인간형 이미지와 정중함(formality)의 사무형 성격이 조합된 페르소나 유형이 금융 서비스의 신뢰와 지속적 이용 의도에 가장 긍정적인 영향을 주는 것으로 밝혀졌다[6].

이 논문의 핵심 연구 문제는 로보어드바이저 에이전트 설계시, '페르소나'와 '대화전략'이 투자 경험이 적은 2030 세대의 금융 서비스 경험에 어떻게 영향을 미치는지 검증하는 것이다. 구체적인 연구 문제는 1) 투자 손실 상황에서 로보어드바이저의 페르소나가 정중한 경우와 친근한 경우 중 어느 것이 더 좋은 사용자 경험을 결정하는가, 2) 투자 손실 상황에서 로보어드바이저가 손실의 책임 귀인을 본인(인공지능)에게 있다고 사과하는 전략과 사용자에게 있다고 방어하는 전략 중에 어느 것이 더 최적의 사용자 경험을 갖는가이다.

Ⅱ. 이론적 배경

2-1 인공지능 에이전트와 페르소나

UX 분야 사용자 중심 디자인(User Centered Design, UCD)의 주요 방법론 중 하나인 페르소나(persona)는 특정 목표를 공유하는 가상의 인물로 표현된 모델을 의미한다[7]. 로보어드바이저의 경우, 인공지능 에이전트를 가상의 인물 또는 캐릭터로 설정하는데, 에이전트의 외형뿐 아니라 말투와 같은 커뮤니케이션 스타일을 포함하는 개성(personality)과 인상(impression)을 다면적으로 설계하는 과정을 수반한다.

인공지능 에이전트에 페르소나를 적용하는 것은 원활한 인간-인공지능의 상호작용을 위해 사용자에게 AI 에이전트의 사회적 존재를 인지적으로 부각시키기 위함이다. 자동화 알고리즘 시스템에 대한 사용자의 기대가 높을 경우, 신뢰 위반 상황에서 인간 어드바이저에 비해 AI 어드바이저에 훨씬 더 큰 실망감을 느끼는 경향이 있다[8]. CASA(Computers are Social Actors) 패러다임에 의하면, 투자 자문 에이전트에 페르소나를 부여할 경우 사람을 대할 때와 유사한 상호작용을 할 수 있으며, 사람 직원이 해오던 투자 자문 업무를 기계가 대체하는 것에서 발생하는 부자연스러움을 덜어줄 수 있다.

인공지능 에이전트의 시각적 의인화 요소가 강화될 경우 지속적 사용 의도에 긍정적인 영향을 미치며, 챗봇 에이전트의 정체성을 명확하게 인식하도록 디자인할 경우 사용자로 하여금 챗봇에 대한 신뢰와 서비스 이용의도를 높이는 긍정적인 영향을 미친다[7],[9]-[12].

2-1 로보어드바이저의 책임 귀인과 신뢰

에이전트의 추천에 따른 결정 후 기대하지 않은 결과가 나타날 경우, 사용자들은 인공지능의 능력을 부정적으로 인식하게 될 수 있기 때문에, 이를 회복하기 위한 신뢰 회복 전략이 중요하다. 신뢰 회복과 관련된 위기 커뮤니케이션 이론(Situational Crisis Communication Theory, SCCT)에서는 사과나 보상을 지불하는 '수용적 전략'과 오류나 실수에 대해 부인하는 '방어적 전략'의 개념을 제시한다[13].

로봇을 포함한 대부분의 AI 에이전트 관련 선행연구에서는 수용적 전략이 신뢰 회복에 긍정적인 영향을 주는 것으로 나타났다. 인공지능을 탑재한 대화형 에이전트와 사람 간의 언어적 상호작용에서 에이전트의 사과표현이 좌절감을 감소시키며 사용자가 게임을 하던 중 오류 상황을 겪었을 때 에이전트가 사과를 포함한 공손한 메시지를 제공할 때 더 오래 게임을 사용하는 경향을 보였다[14],[15]. 로보어드바이저의 경우에도 투자 손실 커뮤니케이션을 디자인할 때 부인보다 사과 전략이 효과적이라는 실험 결과가 있다[3].

금융 서비스 연구에서 신뢰는 주요 변인으로 고려됐으며, 특히 비대면 거래가 주로 진행되는 모바일 환경에서는 불확실성이 더욱 커져 사용자의 불안감이 증대되므로 신뢰의 중요성이 더욱 강조된다. 신뢰는 사용자와 서비스 제공자 사이의 문제 해결 및 상호 관계의 안정성에 긍정적인 영향을 주는 핵심 요인이며, 미래에 대한 불확실성 위험 인식을 감소시켜 준다[16]-[18].

실제 금융 투자 서비스 가입 시 투자자는 모든 투자 손실의 책임이 본인에게 있음에 동의하고 계좌를 개설하므로, 서비스 제공자는 투자 손실에 대해 사과하지 않는 것이 원칙이다. 로보어드바이저의 투자 포트폴리오 설계는 사용자가 초기 설정한 투자 성향이나 관심 종목에 따라 결정되므로 손실에 대한 책임을 사용자 설정으로 귀인할 수도 있다. 책임 귀인의 관점에서 보았을 때 사과와 같은 수용적 전략은 오류에 대한 책임을 시스템에 귀인하는 것으로 이는 AI 알고리즘의 결함을 인정하는 것으로 인식될 수 있다. 결함을 인정하는 것은 에이전트 능력에 대한 신뢰를 저하시킬 가능성이 있다.

Ⅲ. 연구 방법

3-1 연구 가설

이 연구의 목적은 로보어드바이저를 통한 투자 서비스 이용 상황에서 에이전트의 페르소나 유형과 책임 귀인 전략에 따라 사용자 경험에 유의한 차이가 나타나는지 검증하는 것이다. 투자 설계 단계와 달리, 투자 손실 상황에서는 로보어드바이저의 페르소나 유형과 신뢰 유지 전략이 달라질 수 있기 때문에 다음과 같은 가설을 설정하였다.

첫째, 로보어드바이저 서비스에서 페르소나 유형에 따라 사용자 경험이 유의하게 달라지는지 검증하고자 하였다. 투자 포트폴리오 설계에 대한 안내와 이익 실현의 상황에서는 최근 금융업계가 선호하는 동물 캐릭터의 '친근한' 페르소나를 접목한 에이전트가 사용자 경험에 긍정적 영향을 줄 수 있으나, 투자 손실 상황에서는 전문가 인간형 이미지와 사무형 대화 방식의 조합인 '정중한' 페르소나 유형이 사용자 경험에 긍정적 영향을 줄 것으로 가설을 설정하였다.

가설 1. '투자 손실' 상황에서 로보어드바이저의 페르소나는 친근할 때보다 정중할 때 사용자 경험에 긍정적 영향을 미칠 것이다.

둘째, 투자 손실 상황에서 사용자와 에이전트 중 누구에게 책임을 귀인하는 것이 사용자 경험에 더욱 효과적인지 검증하고자 하였다. 일반적인 인공지능 에이전트에 관한 연구에서는 에이전트에게 책임을 귀인하여 사용자에게 사과하는 전략이 효과적이라고 나타나고 있으나, 신뢰가 매우 중요한 금융 서비스에서는 에이전트 책임 귀인은 로보어드바이저에 대한 인지된 능력과 신뢰에 부정적인 영향을 줄 것으로 가설을 설정하였다.

가설 2. 투자 손실 상황에서 손실의 책임을 에이전트에 귀인할 때 사용자 경험에 부정적인 영향을 미칠 것이다.

3-2 변인

로보어드바이저 에이전트의 페르소나와 책임 귀인에 따른 사용자 경험을 측정하기 위해 다음과 같은 종속 변인을 설정하였다. 모든 변인은 리커트(Likert)형 7점 척도 (1점 = 전혀 그렇지 않다, 7점 = 매우 그렇다)로 측정하였다.

페르소나, 설명의 투명 수준, 책임 귀인에 따라 에이전트의 능력을 다르게 평가하는지 검증하기 위해 지각된 능력을 종속 변인으로 설정하였다. 이 연구에서는 선행연구의 문항을 활용하여 '나는 이 에이전트가 유능하게 느껴진다.', '이 에이전트는 금융 투자를 수행하는데 필요한 능력을 갖추고 있다고 생각한다.'의 2개 문항으로 지각된 능력을 측정하였다[19],[20].

3-3 실험 설계와 처치물

실험은 2 × 2 피험자 내 설계(within-subject design)로 디자인되었다. 실험에 사용한 가상의 로보어드바이저 프로토타입은 실제 주식투자 MTS 서비스에서 채택하고 있는 챗봇 형태로 제작하였다. 챗봇 인터랙션은 페르소나의 외형과 말투가 드러나기 쉬운 인터페이스이며, 에이전트와 사용자간 커뮤니케이션 상황에서 책임 귀인도 설정하기 용이하다. 에이전트 프로토타입은 Adobe XD로 제작하였으며 실제 로보어드바이저 서비스에서 제공되는 가입 및 투자 성향, 투자금 설정 등의 초기 설정은 이미 완료한 상태로 간주하여 제작하였다.

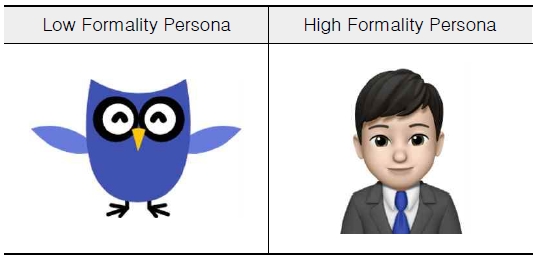

실험 별 구체적인 시나리오 및 독립 변인은 다음과 같다. 독립변인 수준별 조작화는 상용화된 로보어드바이저 사례를 참고하여 설계하였다. 정중한 페르소나는 인간형 이미지와 사무형 대화 방식으로 디자인하였다. 친근한 페르소나는 KB증권와 카카오페이의 상용화 사례를 참조하여 동물형 이미지와 캐주얼한 대화 방식을 적용하였다.

친근한 페르소나로 설정한 동물 캐릭터는 금융사 서비스에서 강아지, 곰, 토끼 등을 활용하고 있어, 중복되지 않으면서 재물과 관련된 동물인 부엉이 외관으로 설정하였다. 젊은 층에 친근하게 다가가기 위한 ‘발랄하고 친근한’ 성격의 캐주얼한 대화체를 구사하도록 하여, “반가워! 난 너의 주식 투자를 도와줄 아올이야^^ 지난번에 설정해준 투자성향(집중형)과 투자금액(100만원)에 따라 너에게 딱 맞는 종목으로 투자를 진행할거야~!”로 설계하였다.

정중한 페르소나는 AI 챗봇 캐릭터인 대신증권의 벤자민, 현대카드의 헨리의 사례를 참조하여 인간의 외관으로 디자인하였고, ‘이성적이고 신중한 성격의 사무형 대화체를 구사하도록 설정하였다. 대화체는 “반갑습니다 고객님. 저는 고객님의 주식 투자에 도움드릴 Ashton입니다. 지난번 고객님께서 설정해주신 투자성향(집중형)과 투자금액(100만원)에 따라 가장 적절한 포트폴리오를 설계해 투자를 진행할 예정입니다.”로 설계하였다.

책임귀인은 에이전트에게 귀인할 경우는 사과 전략으로, 사용자에게 귀인할 경우는 방어 전략으로 설정하고 메시지를 작성하였다. 에이전트의 책임 귀인 메시지는 “신흥국 부분에서 –24.2% 손실이 발생하여 투자금 25만원을 잃었습니다. 최근 브라질 국가체제의 불안으로 많은 투자자들의 브라질 기업의 주식을 매도하고 있습니다. 신흥국주식은 비교적 저평가되어 있지만 국가체제에 대한 불안이슈가 존재합니다. 시장을 미리 예측하지 못해 고객님의 자산에 손실을 입힌 점 깊이 사과드립니다.”로 작성하였다.

사용자 책임 귀인 메시지는 “신흥국 부분에서 -24.2% 손실이 발생하여 투자금 25만원을 잃었습니다. 최근 브라질 국가체제의 불안으로 많은 투자자들의 브라질 기업의 주식을 매도하고 있습니다. 신흥국주식은 비교적 저평가되어 있지만 국가체제에 대한 불안이슈가 존재합니다. 고객님이 설정하신 투자성향은 '집중형'으로 수익을 최우선으로 하고 있습니다. 투자의 리스크를 줄이고 싶으시다면 고객님의 투자성향을 변경해주세요. [변경하러 가기]”로 작성하였다.

3-4 실험 절차

실험은 코로나19 상황으로 인해 비대면으로 진행되었다. 본실험 전 에이전트의 페르소나와 책임 귀인 조작이 적절하게 이루어졌는지 확인하기 위해 예비 실험을 시행하였다. 예비 실험과 본실험 모두 20대와 30대를 참가 대상으로 하였다. 예비 실험은 미리 제작된 프로토타입의 화면을 정지 이미지(still image)로 추출하여 온라인 설문을 통해 페르소나 조작이 적절하게 이루어졌는지 확인하였다. 본실험도 온라인으로 참여 신청, 개인정보보호 동의, 실험 사이트 초대, 실험 진행과 설문 작성의 순서로 진행하였다. 참가자들은 두 개의 독립변수를 결합하여 구성한 4개 유형의 프로토타입 처치물을 체험한 후 로보어드바이저의 지각된 능력, 신뢰, 지속 사용 의도 정도를 측정하는 설문에 응답하고 자유응답식 추가 답변을 기술하였다.

3-5 실험 참가자

이 연구는 주식투자 경험이 많지 않고, MTS 환경에 익숙하며, 인공지능 챗봇 인터랙션에 친숙한 20~30대 성인을 대상으로 실험 참가자를 모집하였다. 조작화 검증을 위한 예비 실험에는 33명(남자 9명, 여자 24명)이 참여하였으며 평균 연령은 31.0세 (sd = 3.48)였다. 본 실험에는 68명(남자 34명, 여자 34명)이 참여하였으며 평균 연령은 32.2세 (sd = 3.60)였다.

Ⅳ. 실험 결과

4-1 조작화 검증

예비 실험을 통해 에이전트의 페르소나, 그리고 책임 귀인의 조작화 검증을 실시하였다. 페르소나는 정중(High Formality), 친근(Low Formality)으로 조작하였고 실험 참가자는 각 페르소나가 적용된 에이전트의 외관과 대화체를 본 후 에이전트 성격에 관한 설문에 응답하였다. 설문 문항은 '에이전트 A 또는 B의 성격이 어떻게 느껴지나요?'를 리커트형 7점 척도(1 = 정중하지 않다, 7 = 상당히 정중하다)로 측정하였다.

책임 귀인은 투자 손실 상황에서 '에이전트 본인에게 책임을 묻는 유형'과 '사용자에게 책임을 묻는 유형'으로 조작하였고 실험 참가자는 각 유형에 따른 대화 내용을 본 후 '에이전트가 투자 손실의 책임을 누구에게 물고 있는 것 같습니까?' 문항을 리커트형 7점 척도(1 = 에이전트 본인에게 책임을 물었다, 7 = 사용자(나)에게 책임을 물었다)로 측정하였다.

각 독립변인 조작에 따른 응답이 유의한 차이를 보이는지 검증하고자 대응표본 t-검정을 실시하였다. 분석 결과, 두 에이전트 페르소나 프로토타입간에 정중함 인식의 정도에 유의한 차이가 확인되었다(t = -9.82, p < .001). 책임 귀인을 본인에게 돌리는 에이전트(m = 2.12, sd = .89)와 사용자에게 돌리는 에이전트(m = 6.06, sd = .97)간에도 유의한 차이가 나타나 실험 처치물의 조작화가 적절한 것으로 판정되었다(t = -16.27, p < .001).

4-2 설문 문항 신뢰도 검증

실험에 사용된 설문 문항의 신뢰도를 검증하기 위해 사회과학과 HCI 분야 통계분석에서 가장 널리 활용되고 있는 Cronbach's α 계수를 통한 신뢰도 분석을 진행하였다. 각 변인에 대한 Cronbach's α 계수를 산출한 결과, 지각된 능력(α = .95), 신뢰(α = .95), 지속사용의도(α = .97)에 대하여 변인의 Cronbach's α 값이 0.7 이상으로 신뢰성이 검증되었다.

4-3 본실험 분석 결과

투자금 손실 안내 시나리오에서 에이전트의 페르소나(High Formality - Low Formality)와 손실 책임 귀인(에이전트 - 사용자)에 따른 지각된 능력, 신뢰, 지속 사용 의도의 주효과와 상호작용 효과를 알아보기 위해 이원배치 반복측정 분산분석(Two-way repeated measure ANOVA)을 실시하였다. 각 조건별 평균값은 아래표와 같다.

페르소나와 책임 귀인이 로보어드바이저 능력에 대한 사용자 인식에 미치는 영향에 대해 이원 반복측정 분산분석을 실시한 결과, 페르소나 수준에 따른 주효과가 유의하게 나타났다[F(1, 67) = 5.27, p < .05, η2 = .07]. 정중한 에이전트(m = 4.03, sd = 1.55)는 친근한 에이전트(m = 3.62, sd = 1.66)보다 지각된 능력이 유의하게 높았다. 책임 귀인의 주효과 또한 유의하게 나타났다[F(1, 67) = 25.51, p < .001, η2 = .28]. 사용자에게 손실의 책임을 귀인했을 때(m = 4.14, sd = 1.54) 에이전트에게 손실의 책임을 귀인할때(m = 3.51, sd = 1.64)보다 지각된 능력이 유의하게 높았다. 페르소나와 책임 귀인의 상호작용 효과는 유의하지 않았다.

페르소나와 책임 귀인이 신뢰에 미치는 영향에 대해 이원 반복측정 분산분석을 실시한 결과, 페르소나 수준에 따른 유의한 주효과가 나타났다[F(1, 67) = 5.04, p < .05, η2 = .07]. 정중한 에이전트(m = 3.79, sd = 1.57)는 친근한 에이전트(m = 3.43, sd = 1.71)보다 로보어드바이저에 대한 신뢰가 유의하게 높았다. 책임 귀인의 주효과도 유의하게 나타났다[F(1, 67) = 14.34, p < .001, η2 = .18]. 사용자에게 손실의 책임을 귀인했을 때(m = 3.88, sd = 1.62) 에이전트에게 손실의 책임을 귀인할때(m = 3.35, sd = 1.64)보다 신뢰가 유의하게 높았다. 페르소나와 책임 귀인의 상호작용 효과는 나타나지 않았다.

페르소나와 책임 귀인이 지속 사용 의도에 미치는 영향에 대해 이원 반복측정 분산분석을 실시한 결과, 페르소나에 따른 유의한 주효과는 나타나지 않았다. 하지만 책임 귀인에 따른 주효과는 유의한 것으로 나타났다[F(1, 67) = 6.51, p < .05, η2 = .09]. 사용자에게 손실의 책임을 귀인했을 때(m = 3.70, sd = 1.71)가 에이전트에게 손실의 책임을 귀인할때(m = 3.34, sd = 1.76)보다 지속 사용 의도가 유의하게 높았다. 페르소나와 책임 귀인의 상호작용 효과는 유의하지 않았다.

Ⅴ. 결 론

이 연구는 로보어드바이저 에이전트의 페르소나 설계에서 정중함 전략과 대화 설계에서의 책임 귀인 전략이 사용자 경험에 주는 효과를 검증하였다. 총 68명의 20~30대 참가자를 모집하여 두 독립변인 ‘페르소나 전략(신중함 vs. 친근함)’, ‘책임 귀인(로보어드바이저, vs. 사용자)’에 따른 종속변수(지각된 능력, 신뢰, 지속 사용 의도)를 측정하고, 이에 대한 이원 반복측정 분산분석 실험을 진행하였다.

페르소나 전략의 효과 분석 결과, 로보어드바이저 에이전트의 페르소나가 정중할 때 지각된 능력과 신뢰가 유의하게 높았다. 많은 금융사 로보어드바이저가 친근한 페르소나를 에이전트 설계 전략으로 채택하고 동물 캐릭터 스타일로 디자인하고 있는 현실을 감안하면, 이에 대한 반증 효과를 증명하는 실증적 연구 사례라 할 수 있다. 실험 후 참가자가 작성한 자유 기술 답변을 통해 금융 서비스 로보어드바이저에 대한 사용자 기대가 쇼핑, 상담 등 다른 서비스 영역에서와는 다른 특수성을 갖는 것을 확인할 수 있었다. 참가자의 10% 이상이 언급한 주요 답변 내용은 다음과 같다. 친근한 페르소나의 에이전트 평가 시 "너무 가벼운 느낌은 안 들었으면 좋겠다.", "재미로 투자하는 사람은 없다.", "거부감이 들고 사기꾼 같다."와 같은 응답과 정중한 페르소나의 에이전트 평가 시 "좀 더 전문적인 느낌이 든다.", "어투가 딱딱해서 신뢰가 가는 것 같다." 등의 응답이 제시되었다.

사용자가 전문가에게 자산 운용과 투자를 위임하는 서비스에서는 신중하고 정중한 전문가 페르소나를 선호하는 것으로 유추된다. 금융 서비스에서 친근한 페르소나가 친밀성 지각은 높이지만, 친밀성이 로보어드바이저에 대한 능력, 신뢰 지각과 지속사용의도에는 영향을 주지 않는 것이 확인되었다.

대화 설계 전략의 분석 결과, 로보어드바이저의 책임 귀인에 따른 사용자 경험 측정 시 유의한 차이가 있었다. 기존 연구 결과와는 달리 손실의 책임을 사용자에게 귀인할 때가 에이전트에게 귀인할 때보다 로보어드바이저에 대한 능력과 신뢰 지각이 더 높았다. 또한, 해당 로보어드바이저 서비스를 지속사용할 의도도 높았다. 참가자의 10% 이상이 언급한 주요 답변 내용은 다음과 같다. "죄송하다고 하는 전문가에게 믿고 맡길 수가 없다.", "서비스를 사용하기에 불안하다.", "사과 문구가 서비스 성능이 좋지 못함을 인정하는 것 같다."와 같은 부정적 반응이 나타났다. 사용자에게 책임을 귀인하여 초기 설정한 투자 성향의 변경을 제안한 전략에 대해서는 "투자 성향을 변경하면 손실이 그나마 해결될 것 같다.", "내가 투자 집중형을 선택해서 손실이 난 것을 알고 난 후 에이전트를 너무 부정적으로 생각했던 것이 미안해졌다."와 같은 의견이 나타났다.

기존 연구에서 대화형 에이전트의 오류 회복을 위한 커뮤니케이션 전략으로 사과 전략이 긍정적인 것으로 밝혀졌지만[15],[24], 로보어드바이저의 투자 손실 상황에서는 반대의 결과가 도출될 수 있음을 확인한 것이 이 연구의 또 다른 의의이다. 즉, 이는 사용자의 자산과 관련된 신뢰 손실 상황에서 겸손한 사과나 위로보다는, 로보어드바이저에 대한 신뢰 유지가 더 중요함을 시사한다.

실무적 함의점은 다음과 같다. 현재 금융업계에서 젊은 층을 공략하기 위해 귀여운 외관과 친근한 캐릭터를 자사의 챗봇 에이전트나 마스코트 페르소나로 설정하고 디자인하고 있다. 하지만 고객의 자산을 운용하고 투자를 실행하는 로보어드바이저 서비스에는 친근한 에이전트보다 정중한 에이전트가 더 나은 사용자 경험을 제공할 수 있음을 이 연구를 통해 확인하였다.

한계점과 후속 연구 제안은 다음과 같다. 첫째, 실험 참가자를 투자 경험이 중년층에 비해 상대적으로 적은 20~30대로 한정하였는데, 개인별 금융 투자 지식 정도나 투자 기간에 대한 구분 없이 선정했다는 점이다. 같은 연령대라도 투자 경험 기간과 투자 지식 정도에 따라 로보어드바이저에 대한 기대나 신뢰, 그리고 사용자 경험이 달라질 수 있어, 후속 연구에서는 투자 경험 기간과 투자 지식수준을 고려하여 실험 집단을 설계하는 것이 바람직하다.

로보어드바이저 프로토타입 디자인에서 실제 사용 방식과 정확하게 일치하지 않는 한계가 있었다. 챗봇 인터페이스로 실험 조건을 설정하였는데, 미리 세팅된 순서대로만 대화가 진행되도록 하였기 때문에, 실제 서비스의 로보어드바이저처럼 개인화된 양방향 소통이 이루어지지 않았다. 에이전트와의 개인화된 양방향 소통이 장기간 가능하다면 친밀성, 신뢰, 능력 등이 다르게 인식될 수 있다. 일회성에 그치는 실험 연구 설계보다는 참가자가 일주일 이상의 충분한 기간 동안 로보어드바이저를 체험할 수 있도록, 실제 작동 가능한 챗봇 프로토타입을 제작하고 이를 활용하는 중장기적 연구가 필요하다.

또한, 후속 연구에서는 로보어드바이저에 투자를 일임하는 상황에서 포트폴리오 설계 및 투자 결과 안내 단계에서 설명의 투명성이 사용자 경험에 미치는 효과를 조사하는 것을 제안한다. 로보어드바이저는 인공지능 알고리즘이기 때문에 결과에 대한 과정의 투명성과 사용자의 이해를 높이는 것이 중요하다. 설명가능성(Explainability)은 그 격차를 줄이는 주요 요소로, OECD에서도 인공지능 활용 가이드라인으로 ‘설명가능성’ 원칙을 제안하고 있다[25]. 최근에는 정보량이 많은 서비스에서 UX 글쓰기(UX Writing) 스타일도 매우 중요한 전략으로 등장하고 있어[26], 로보어드바이저에 이를 적용한 후속 연구가 필요하다.

References

- Statistica. Digital Market Insights: Robo-Advisors-Worldwide [Internet]. Available: https://www.statista.com/outlook/dmo/fintech/digital-investment/robo-advisors/worldwide

- J. Pak, Effect of Agent Persona and Conversation Strategies on User Experience by Robo-Advisor Specific Task: Transparency of Explanations and Attribution of Responsibility, Master's Thesis, Yonsei University, Seoul, 2022.

- K. Baek, A Study on the Trust Recovery Strategy of AI Agents According to the Automation Level of Robo-Advisor. Master's Thesis. Yonsei University, Seoul, 2021.

-

P. Kim, D. L. Ferrin, C. D. Cooper, and K. T. Dirks, “Removing the Shadow of Suspicion: The Effects of Apology Versus Denial for Repairing Competence- Versus Integrity-Based Trust Violations,” Journal of Applied Psychology, Vol. 89 No. 1, pp. 104-118, 2004.

[https://doi.org/10.1037/0021-9010.89.1.104]

-

D. L. Ferrin, P. H. Kim, C. D. Cooper, and K. T. Dirks, “Silence Speaks Volumes: The Effectiveness of Reticence in Comparison to Apology and Denial for Responding to Integrity- and Competence-Based Trust Violations,” Journal of Applied Psychology, Vol. 92, No. 4, pp. 893-908, 2007.

[https://doi.org/10.1037/0021-9010.92.4.893]

-

S. Lee and J. Youn, “A Convergence Study on Chatbot Persona and User Experience of Financial Service - Focused on Loan Service” The Korean Society of Science & Art, Vol. 37, No. 4, pp. 257-267, 2019.

[https://doi.org/10.17548/ksaf.2019.09.30.257]

- R. Batish, Voicebot and Chatbot Design, Packt Publishing, p. 157, 2018.

-

P. Madhavan, D. A. Wiegmann, and F. C. Lacson, “Automation Failures on Tasks Easily Performed by Operators Undermine Trust in Automated Aids,” Human Factors, Vol. 48, No. 2, pp. 241-256, 2006.

[https://doi.org/10.1518/001872006777724408]

-

J. N. Bailenson, N. Yee, D. Merget, and R. Schroeder, “The Effect of Behavioral Realism and Form Realism of Real-Time Avatar Faces on Verbal Disclosure, Nonverbal Disclosure, Emotion Recognition, and Copresence in Dyadic Interaction,” PRESENCE: Teleoperators and Virtual Environments, Vol. 15, No. 4, pp. 359-372, August 2006.

[https://doi.org/10.1162/pres.15.4.359]

-

J. Park and J. Joo, “A Behavioral Economic Approach to Increase Users’ Intention to Continue to Use the Voice Recognition Speakers: Anthropomorphism,” Society of Design Convergence, Vol. 17, No. 3, pp. 41-53, 2018.

[https://doi.org/10.31678/SDC.70.3]

-

C. Nass, E. Y. Kim, and E. J. Lee, “When My Face is the Interface: An Experimental Comparison of Interacting with One's Own Face or Someone Else's Face,” in Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (CHI '98), ACM Press, pp. 148-154, January 1998.

[https://doi.org/10.1145/274644.274667]

-

T. J. Hess, M. Fuller, and D. E. Campbell, “Designing Interfaces with Social Presence: Using Vividness and Extraversion to Create Social Recommendation Agents,” Journal of the Association for Information Systems, Vol. 10, No. 12, pp. 889-919, 2009.

[https://doi.org/10.17705/1jais.00216]

-

W. T. Coombs, “Protecting Organization Reputations During a Crisis: The Development and Application of Situational Crisis Communication Theory,” Corporate Reputation Review, Vol. 10, pp. 163-176, 2007.

[https://doi.org/10.1057/palgrave.crr.1550049]

- J. Kim, The Effect of Apologetic Error Recovery Strategies in Conversational Agent and Mood States on User Frustration, Master's Thesis, Yonsei University, 2016.

-

R. W. Picard, “Toward Computers That Recognize and Respond to User Emotion,” IBM Systems Journal, Vol. 39, No. 3.4, pp. 705-719, 2000.

[https://doi.org/10.1147/sj.393.0705]

-

R. M. Morgan and S. D. Hunt, “The Commitment-Trust Theory of Relationship Marketing,” The Journal of Marketing, Vol. 58, No. 3, pp. 20-38, July 1994.

[https://doi.org/10.1177/002224299405800302]

-

P. M. Doney and J. P. Cannon, “An Examination of the Nature of Trust in Buyer Seller Relationships,” Journal of Marketing, Vol. 61, No. 4, pp. 35-51, April 1997.

[https://doi.org/10.1177/002224299706100203]

- J. C. Park, H. Y. Oh, and S. J. Hong. “The Investigating of Psychological Mechanism in the ‘Service Quality-Customer Satisfaction’ Relation.” Journal of Consumer Studies, Vol. 22, No. 2, pp. 179-202, 2011.

- W. B. Choi, The Effect of Conversational Agent’s Error Message Strategy and Anthropomorphism on Error Recovery, Master's Thesis, Seoul National University, Seoul, 2020.

-

A. Weiss and C. Bartneck, “Meta Analysis of the Usage of the Godspeed Questionnaire Series,” in Proceedings of 2015 24th IEEE International Symposium on Robot and Human Interactive Communication, pp. 381-388, November 2015.

[https://doi.org/10.1109/ROMAN.2015.7333568]

-

F. D. Davis, “Perceived Usefulness, Perceived Ease of Use, and User Acceptance of Information Technology,” MIS Quarterly, Vol. 13, No. 3, pp. 319-340, September 1989.

[https://doi.org/10.2307/249008]

-

J. Lee, K. Baek, S. Lee, H. Kang, C. Park, and J. Kim, “Design and Verification of Service Hopping to Promote the Intent of Continuous Use of AI Robo-Advisor,” Journal of Digital Contents Society, Vol. 22, No. 3, pp. 463-473, March 2021.

[https://doi.org/10.9728/dcs.2021.22.3.463]

-

S. Jeon and Y. Lee, “A Study on Expression of Chatbot Brand Character Considering the Brand Fit and Interpersonal Relationship: Focus on Distribution Sector,” Journal of Brand Design Association of Korea, Vol. 17, No. 1, pp. 169-180, 2019.

[https://doi.org/10.18852/bdak.2019.17.1.169]

- K. Na, Effect of the Robot's Response on the User Experience in the Error Situation of the Home Robot According to User Recognition: Focusing on the Attribution and Approach, Master's Thesis, Yonsei University, Seoul, 2022.

- OECD. OECD AI Principles Overview [Internet]. Available: https://oecd.ai/en/ai-principles

2022년:연세대학교 정보대학원(UX 석사)

2014년~2022년: 티비허브

2022년~현 재: LG유플러스

※관심분야:UX 디자인(UX Design), 핀테크(Fin-tech), AI(Artificial Intelligence) 등

1995년:연세대학교(신문방송학 석사)

2002년:뉴욕주립대학 (커뮤니케이션학 박사)

2002년~2006년: Rensselaer Polytechnic Institute 조교수

2006년~2009년: 광운대학교 미디어영상학부 디지털미디어트랙 부교수

2016년~2017년: University of Michigan 방문교수

2009년~현 재: 연세대학교 정보대학원 UX트랙 교수

※관심분야:AI 에이전트 대화 설계, 모빌리티 UX, CX 경영 전략

2019년:서울대학교 융합과학기술대학원(공학박사 - HCI)

2019년~2019년: 서울대학교 융합과학기술대학원 연구원

2019년~2020년: 카네기멜론대학교(Carnegie MellonUniversity) HCII 박사후연구원

2022년~현 재: 연세대학교 정보대학원 UX트랙 교수

※관심분야:인공지능, HCI, 챗봇 사용자 경험