모바일 커머스 환경에서 Virtualgraph 콘텐츠에 대한 사용자 아이트래킹 연구

Copyright ⓒ 2021 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 연구는 Virtualgraph 콘텐츠와 일반 이미지의 시각적 주의를 비교하기 위해 아이트래킹 연구를 진행하였다. 이를 위해 총 26명의 실험 참가자를 대상으로 Virtualgraph 콘텐츠를 보여주는 실험그룹과 일반 이미지를 보여주는 대조그룹을 구성하여 실험을 진행하였다. 모바일 쇼핑 환경에서 상품 이미지 영역과 상품 설명 영역을 AOI(Area of Interest)로 설정하였다. Virtualgraph 샘플과 일반 이미지 샘플을 실험그룹과 대조그룹에게 노출하였다. 이미지 영역의 Total Duration(TD)와 Number of Fixations(NF)의 AOI, 그리고 상품 설명 영역의 Total Duration(TD)와 Number of Fixations(NF)의 AOI를 분석하였다. 실험결과, 이미지 영역의 TD와 NF, 상품 설명 영역의 NF는 실험그룹과 대조그룹 간에 유의미한 차이가 없었지만 상품 설명 영역의 TD는 유의미한 차이가 있는 것으로 분석되었다.

Abstract

This study conducted an eye tracking study to compare the visual attention of Virtualgraph content and still images. To this end, an experiment was conducted with a total of 26 subjects consisting of an experiment group showing Virtualgraph contents and a control group showing still images. In the mobile shopping environment, the product image area and product description area were set as AOI (Area of Interest). Virtualgraph samples and still image samples were exposed to the experimental and control groups. The AOI of Total Duration (TD) and Number of Fixations (NF) in the image area, and the AOI of Total Duration (TD) and Number of Fixations (NF) in the product description area were analyzed. As a result of the experiment, there was no significant difference in the TD and NF in the image area and the NF in the product description area between the experimental group and the control group, but there was a significant difference in the TD in the product description area.

Keywords:

Reality-Based Closed-Loop 3D, Virtualgraph, Eye Tracking, Visual Attention, Area of Interest키워드:

실사기반 폐 루프 3D 콘텐츠, 버추얼그래프, 아이트래킹, 시각적 주의, 관심영역Ⅰ. 서 론

최근 몇 년간 모바일 커머스 시장은 지속적으로 확장되고 있다. 한국정보화진흥원[7]의 '2020 인터넷이용실태조사'에 따르면 국내 가구 99.7%가 인터넷 접속이 가능한데, 모바일 인터넷을 활용한 접속이 99.9%로 조사되었다. 국내 전체 가구 중 94.9%가 스마트폰을 보유하였고 10대의 스마트폰 이용률 99.3%, 20대 99.6%, 30대 99.7%, 40대 99.2%, 50대 99.0, 60대 90.8%, 70세 이상 39.4% 로 30대가 가장 높은 스마트폰 이용률을 보였다. 또한 만 12세 이상 인터넷이용자의 69.9%가 인터넷쇼핑을 이용하는데 모바일 기기를 이용한 인터넷 쇼핑이 65.4%, 컴퓨터(PC)는 46.1%로 조사되었다. 인터넷 쇼핑 이용자는 월 평균 5회의 인터넷 쇼핑과 평균 구매금액 166,780원으로 분석되었으며, 인터넷 쇼핑의 주요 품목은 의류/신발/스포츠용품/액세서리 81.8%, 식재료/음식 51.7%, 생활/주방용품 43.8%, 도서/잡지/신문 43.7%, 건강관련 제품 41.9%, 영화/문화공연 41.3%, 화장품 38.1%, 교환권 35.2%, 여행상품 33.8%, 영화/동영상/이미지 28.2%, 음악 26.0%, 이모티콘 25.4% 순으로 조사되었다.

통계청[8]의 2020년 온라인쇼핑동향조사에 따르면 온라인 쇼핑 거래액 총 15조 9,946억원 중 모바일 쇼핑 거래액 11조 1,488억원으로 분석되었다. 모바일 쇼핑의 주요 이용 거래는 음식서비스 2조 1,988억원, 음식료품 2조 157억원, 가전/전자/통신기기 1조 9,465억원, 의복 1조 5,629억원, 생활용품 1조 3,994억원 순으로 분석되었다. 전체 온라인 쇼핑 중 모바일 비중도 2019년 65.7%에서 2020년 69.7%로 4% 증가된 것으로 조사되었다.

이와 같이 모바일 기기의 높은 보급률과 모바일 쇼핑 거래액이 증가함에 따라 언제 어디서든지 손쉽게 상품을 구매할 수 있는 새로운 소비 트렌드가 형성되었고 자연스럽게 모바일에서 보는 모바일 커머스 어플리케이션 UI와 상품 이미지에 대해서 관심을 갖게 되면서 사용자의 행태 연구에 대해서도 연구가 시작되었다.

그러나 모바일 커머스 환경에서 사용자의 시선이동에 관한 연구는 부족하였다. 특히 모바일 커머스 환경에서 보여주는 상품 이미지가 2D로 보여지는지, 3D로 보여지는지에 따라 사용자의 시선 이동에 차이가 있는지를 확인한 연구는 찾기 어려웠다. 사용자의 시선이 콘텐츠 유형에 따라 상품에 집중하는지, 상품설명에 집중하는지에 대한 연구는 모바일 커머스 환경에서 소비자의 상품 구매 유도를 위한 전략을 설계할 때 중요한 단서가 되므로 본 연구는 중요하다고 할 수 있다.

본 연구에서는 모바일 커머스 환경에서 보여지는 이미지가 3D형태인 Virtualgraph 콘텐츠로 보여질 때와 일반 2D 이미지로 보여질 때 사용자에게 시각적으로 어떻게 받아들여지는지를 연구하였다. 그리고 기존의 시각적 주의 연구와 아이트래킹에 관한 연구에 대해 문헌연구하고 아이트래킹 실험결과를 바탕으로 결론 및 향후 연구에 대해 논의한다.

Ⅱ. 이 론 적 배 경

2-1 Virtualgraph 콘텐츠

가상현실 콘텐츠에 소비자 관심이 높아지면서 다양한 형태의 가상현실 콘텐츠 개발 연구가 진행되었다[3, 5, 12].

그 중, J. Park[9, 10]은 기술적 한계로 시각, 청각, 촉각 경험만 제공하는 기존 VR 콘텐츠에서 진보하여 미각과 후각에 대한 상상을 유도하여 오감 경험을 제공하여 보다 풍부한 VR 콘텐츠 경험을 제공할 수 있는 콘텐츠 제작 방법에 대해서 연구하면서 Virtualgraph 컨셉을 제안하였다. Virtualgraph는 VR내에서 사용자에게 몰입감 높은 콘텐츠 경험을 제공하기 위해 고안된 콘텐츠로써 VR 내에서 사용자에게 몰입감 높은 콘텐츠 경험을 제공한다. 여기서 Virtualgraph는 Virtual(가상의‧실제의)과 Graph(그리다)의 합성어이다. 가상의 것을 가장 실제로 그리다 라는 의미이다.

J. Park[9]에 따르면 Virtualgraph는 사진과 동영상보다 Telepresence 와 Attitude 가 높으며, 일반 사진보다 사람들의 상상을 유도할 수 있는 환기성 효과가 높은 것으로 분석되었다. 또한 Virtualgraph로 제작된 상품을 실험 참가자들에게 보여주고 일반 사진과 비교하는 실험을 했을 때, Virtualgraph를 본 실험 참가자들은 일반 사진의 고정된 화면만 보는 것보다 자유롭게 다양한 앵글을 볼 수 있고, 이미지가 아니라 눈앞에 실제 상품이 있는 것 같다고 했으며, 상품을 생생하고 자세하게 볼 수 있는 것으로 분석되었다. 다시 말해 Virtualgraph는 일반 이미지 보다 상품에 대한 많은 정보를 제공한다고 할 수 있다[9].

J. Park 연구에 의하면 Virtualgraph를 본 실험 참가자들은 Virtualgraph의 시각적인 효과 부분에 특히 집중하는 것으로 분석되었다. 본 연구에서는 Virtualgraph를 본 실험 참가자들의 시각적 주의를 집중적으로 분석하여 일반 이미지와 어떠한 차이점이 있는지 알아내어 Virtualgraph에 대해 더욱 심층적인 이해를 하였다.

2-2 아이트래킹 연구

눈동자 움직임 추적 연구로 불리는 아이트래킹 연구는 실험 참가자가 어떤 대상을 볼 때 안구 움직임을 추적하여 실험 참가자가 어디를, 얼마나, 어떻게 보는 연구로써 실험 참가자가 어떤 대상에 시각적인 주의를 하고 있는지 직접 측정하는 연구이다[4]. 아이트래킹 연구를 위해서는 아이트래커 라는 장비가 필요한데 아이트래커는 실험 참가자의 각막에 적외선을 비추고 각막의 반사를 일으켜 동공의 위치를 감지하는 장비이다. 아이트래킹 연구는 인지과학, HCI, 심리학, 마케팅, 의학 등에서 널리 사용되고 있다.

아이트래킹 연구에서 사용하는 분석방법에는 실험 참가자의 시선 움직임 경로를 추적하는 Scan Path 방법이 있다. 시선 흐름의 순서를 원과 선을 이어서 표시하고 시선이 머무른 정도를 원의 크기로 나타내주는 방법이며, AOI(Area of Interest)와 같이 이미지 내에서 특정한 영역을 지정하고 해당 영역에 실험 참가자의 시선 정보를 나타내주는 방법이 있다. AOI 분석 방법을 이용하여 영역별로 중요도 및 우선순위 등을 구별할 수 있다. 또한 실험 참가자들의 시선 정보를 시각적으로 표현하는 Heat Map과 Focus Map 분석 방법이 있다.

아이트래킹 연구와 관련해서 지금까지 다양한 분야에서 연구가 진행되었다. Goldber and Kotval[4] 연구에서는 실험 참가자의 Number of fixations이 많으면 시선 대상에 비효율적인 탐색을 하는 경향이 있다고 했으며, Just and Carpenter[6] 연구에서는 실험 참가자가 어떤 대상에 대해 Fixation duration이 길면 길수록 대상에 대한 정보 추출이 어려운 경우이거나 어떤 형태로든 실험 참가자의 주위를 사로잡는다고 하였다. 그리고 Byrne et al[2]는 타깃에 대한 Time to first fixation은 어떤 객체나 영역에 더 빠른 time to first fixation은 더 나은 시선을 끄는 요소들이 존재하기 때문이라고 해석하였으며 AOI에 더 많은 시선을 둔 경우 좀 더 주목할 만하고 중요한 것으로 인식하는 것으로 조사되었다[11].

본 연구에서는 Virtualgraph와 일반 이미지를 실험그룹과 대조그룹으로 설정하고 AOI(Area of Interest) 연구방법을 채택하여 연구를 진행하였다. 그룹 간 대상에 대한 응시 지속 시간(Fixation Duration), 응시 횟수(Fixation Count)를 측정하여 비교 분석하였다.

응시 지속 시간(Fixation Duration)은 어느 한 곳에 상대적으로 움직임 없이 정보를 얻어내는 시간을 말하며 임의로 설정한 AOI 영역 중에서 전체 평균을 분석하는 것을 말한다. 응시 횟수(Fixation Count)는 어떤 콘텐츠가 사람들의 주의를 끌었는지, 얼마나 흥미로웠는지, 문장이 난해했는지 등을 알 수 있다.

Ⅲ. 실 험 설 계

3-1 실험 참가자 구성

본 연구를 위해 서울 연세대학교에서 대학생과 대학원생 총 26명이 실험에 참여하였다. 실험 참가자는 남자 17명(65.4%), 여자 9명(34.6%)이며, 연령대는 21~25세 9명(34.6%), 26~30세 12명(46.2%), 31~35세 3명(11.5%), 36~40세 2명으로(7.7%) 구성하였다. 아래 Table 1은 인구통계학적 사항을 나타낸다.

모바일 커머스에서 상품을 구매해본 경험이 있는지에 대한 질문으로 1명을 제외한 25명(96.2%)이 모바일에서 상품을 구매해 본 경험이 있다고 하였고 한 달에 1~3번 구매한다는 비율이 20명(76.9%)으로 가장 많았다.

또한 모바일 쇼핑몰에서 상품 이미지를 중요하게 생각하는지에 대한 질문으로 1명을 제외한 25명(96.2%)이 상품 이미지를 중요하게 생각한다고 답하였으며, 상품 설명을 많이 참고하는지에 대한 질문에는 23명(88.5%)이 그렇다고 답하였다.

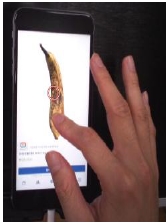

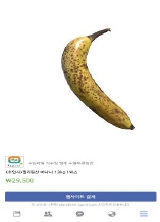

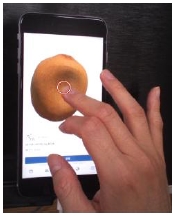

3-2 실험 자극물

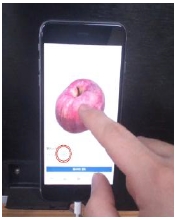

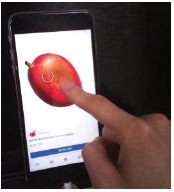

실험을 위해 다음 Table 2와 같이 Virtualgraph 샘플과 일반 이미지 샘플을 제작하였다. 실험 참가자는 모바일 커머스 환경에서 과일을 주문하는 과정을 가정하여 샘플을 제작하였다. 과일은 귤, 바나나, 키위, 사과, 망고 총 5개로 구성하였다. Virtualgraph샘플 제작을 위해 각 과일을 Photogrammetry 방식으로 3D 스캔한 후 Unity 소프트웨어에서 객체를 불러들여 각 과일의 표면을 누르면 과일 표면이 변형하는 상호작용 효과를 삽입하였다. 또한 Apple의 iPhone 7+ 디바이스의 Force Touch 기능을 사용하여 과일 표면을 일정한 힘으로 누르면 실제 과일의 표면이 뭉개지는 것처럼 사용자의 힘에 맞게 과일 표면도 함께 변형되는 효과를 삽입하였다. 대조그룹의 일반 이미지 같은 경우 과일의 다른 각도에서 촬영한 5장의 사진을 실험 참가자들에게 노출하였다. 사용자는 좌, 우 슬라이드로 사진을 넘기면서 과일의 다른 각도의 사진을 볼 수 있게 하였다.

3-3 실험 절차

실험 참가자들에게 실험 전 실험에 대해서 충분한 설명을 하고 실험그룹과 대조그룹으로 무작위로 설정하고 실험을 진행하였다. 실험 참가자들은 Tobii Pro Glasses 2 모바일 아이트래커를 착용하고 책상에 앉아서 거치대에 설치된 스마트폰을 바라보았고 아이트래커 캘리브레이션 절차를 마친 후 실험자의 안내에 따라 스마트폰에 설치된 소프트웨어를 실행시켰다. 실험 참가자가 스마트폰에 설치된 소프트웨어의 시작 버튼을 클릭하면 5개의 과일에 대한 실험 지시문이 표시되고 지시문을 모두 읽고 하단의 다음 버튼을 누르면 과일 이미지가 30초간 화면에 나타난다. 30초 후엔 자동으로 다음 과일에 대한 지시문으로 넘어가고 5개의 과일을 모두 본 후에는 인구통계학적인 내용을 입력한다. 실험 참가자가 스마트폰을 보는 동안 아이트래커는 실험 참가자가 어디를 얼마나 보는지 녹화를 한다. 실험 종료 후에는 실험 참가자들에게 사례금으로 5,000원을 제공하였다. 녹화된 아이트래킹 데이터는 아이트래킹 분석 소프트웨어인 Tobii Pro Lab 1.98 버전으로 분석을 진행하였다.

Ⅳ. 실험 결과 및 분석

4-1 AOI(Area of Interest) 통계 분석

실험 결과는 Table 3과 Table 4와 같다. Table 3은 상품 노출 영역인 이미지와 상품 설명하는 영역 상품 설명을 AOI로 설정한 Total Duration(TD)에 대한 결과이다.

Table 4는 같은 영역을 AOI로 설정한 Number of Fixations(NF) 결과를 나타낸다.

Table 3과 Table 4의 결과는 26명의 모든 실험 참가자가 5개의 상품을 본 결과에 대한 평균을 나타낸다.

4-2 그룹 간 T-test 통계 분석 결과

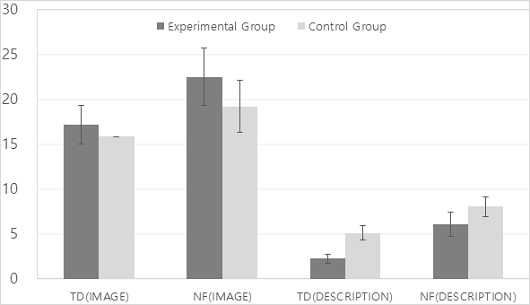

Figure 1은 그룹 간 Total Duration(TD)과 Number of Fixations(NF) 비교 결과를 막대그래프로 표시하였고 Table 5는 이를 정리한 결과이다.

아래 Table 5는 실험그룹과 대조그룹의 이미지 영역의 AOI와 상품 설명 영역의 AOI를 그룹 간 Total Duration(TD)과 Number of Fixations(NF)를 비교하여 T-test 분석을 진행한 결과를 나타낸다.

실험그룹의 이미지 AOI의 TD의 평균은 17.19(7.83)초, 대조그룹의 이미지 AOI는 15.82(5.70)초이고 실험그룹의 이미지 영역의 NF의 평균은 22.5(11.38)번, 대조그룹은 19.18(10.50)번으로 분석되었다. T-test 결과 실험그룹과 대조그룹의 이미지에 대한 TD와 NF 모두 유의미한 차이가 발견되지는 않았다.

마찬가지로 상품 설명의 TD와 NF를 분석한 결과 실험그룹의 TD 평균은 2.22(1.81)초이고 대조그룹은 5.07(2.87)초로 분석되었으며 실험그룹의 NF 평균은 6.03(4.84)번, 대조그룹은 8.05(3.95)번으로 분석되었다. 그룹 간 T-test 분석 결과 TD에서 유의한 차이(t=-3.02, p<.01)가 있는 것으로 분석되었지만 NF에서는 유의한 차이는 발견되지 않았다.

Ⅴ. 결론 및 향후 연구

본 연구에서는 Virtualgraph와 일반 이미지의 시각적 주의를 비교하기 위해 아이트래킹 연구를 진행하였다. 이를 위해 총 26명의 실험 참가자를 대상으로 Virtualgraph를 보여주는 실험그룹과 일반 이미지를 보여주는 대조그룹으로 분류하고 실험을 진행하였다. 모바일 쇼핑몰 화면에 상품이 보이는 이미지 영역과 상품을 설명하는 상품 설명 영역을 AOI로 설정하여 Virtualgraph 샘플과 일반 이미지 샘플을 제작하여 실험 참가자들에게 노출했으며, 이미지 영역의 Total Duration(TD)와 Number of Fixations(NF)의 AOI, 그리고 상품 설명의 영역의 Total Duration(TD)와 Number of Fixations(NF)의 AOI를 분석하였다.

이미지 영역의 실험그룹과 대조그룹 간에는 유의미한 차이점은 발견되지 않았다. 상품 설명 영역의 Total Duration(TD)과 Number of Fixations(NF)의 AOI 분석에서는 실험그룹의 Total Duration(TD)의 평균이 대조그룹보다 높고, 유의미한 차이(t=3.02, p<.01)가 있었던 반면에 Number of Fixations(NF)에서는 유의미한 차이를 발견할 수 없었다.

상품 설명 AOI에서 Total Duration(TD)이 일반 이미지를 본 대조그룹이 Virtualgraph본 실험그룹보다 높다는 것은 일반 이미지를 본 실험 참가자들이 Virtualgraph 보다 상품 설명 부분에 더 오랫동안 주시했다는 의미이다. 이 의미는 일반 이미지를 본 실험 참가자들이 상품 설명에서 정보 추출을 더욱 많이 시도했으며 이것은 Virtualgraph에서는 일반 이미지 보다 상대적으로 이미지 영역에서 정보를 많이 얻지만, 일반 이미지는 이미지에서 정보를 얻는 것보다 상품 설명 부분에서 정보를 많이 얻는 것을 의미로 해석할 수 있다. 또한 Virtualgraph을 통해 직관적으로 상품에 대해 직접 체험하여 상품에 대한 특징을 파악하는 것으로도 해석할 수 있다.

본 연구는 Virtualgraph의 시각적 주의 연구에 대한 토대를 마련했다는 점에서 의의가 있다고 할 수 있다. 향후 연구에서는 VR 환경에서 쇼핑몰 환경을 구성하고 Virtualgraph를 전시하여 사용자들의 시각적 주의가 어떻게 일어나는지, Virtualgraph에 대한 몰입감과 콘텐츠와의 상호작용에 대해 어떠한 영향을 미치는지 연구를 확장할 수 있을 것이다.

Acknowledgments

본 연구는 순천향대학교 학술연구비 지원으로 수행하였음.

References

- Albert, W. "Do web users actually look at ads? A case study of banner ads and eye-tracking technology." Proceedings of the 11th Annual Conference of the Usability Professionals’ Association. 2002.

-

Byrne, Michael D., et al. "Eye tracking the visual search of click-down menus," Proceedings of the SIGCHI conference on Human Factors in Computing Systems. pp. 402–409, May 1999.

[https://doi.org/10.1145/302979.303118]

-

Eun-Su Lim, Sung-Yi Yun, Yong-Suk Ko, Ha-Young Jung, Hong-Sub Choi, "Implementation of a Low-cost Virtual Reality System Using Smart Phone", Journal of Digital Contents Society, Vol. 19, No. 7, pp. 1237-1244, 2018.

[https://doi.org/10.9728/dcs.2018.19.7.1237]

-

Goldberg, Joseph H., and Xerxes P. Kotval. "Computer interface evaluation using eye movements: methods and constructs," International journal of industrial ergonomics, Vol. 24, No. 6, pp. 631-645, 1999.

[https://doi.org/10.1016/S0169-8141(98)00068-7]

-

Jiyoung Kang. "A Study on the Relationship between Hand Interaction and Immersion in Social VR Environment", Journal of Digital Contents Society, Vol. 22, No. 2, pp. 263-269, 2021.

[https://doi.org/10.9728/dcs.2021.22.2.263]

-

Just, Marcel Adam, and Patricia A. Carpenter. "Eye fixations and cognitive processes," Cognitive psychology Vol. 8, No. 4, pp. 441-480, 1976.

[https://doi.org/10.1016/0010-0285(76)90015-3]

- Ministry of Science and ICT & National Information Society Agency, Internet Use Survey, Nationally Approved Statistics No. 12005, 2020.

- National Statistical Office, Online Shopping Trend Survey, Press Release, Service Industry Trend Division, Economic Trend Statistical Commissioner, 2020.

-

Park, Jiseob, et al. "The influence of media type and length of time delay on user attitude: Effects of product-focused virtual reality," Computers in Human Behavior, Vol. 101, pp. 466-473, 2019.

[https://doi.org/10.1016/j.chb.2018.08.054]

-

Park, Jiseob, Junho Choi, and Cheul Rhee. "Futuristic VR image presentation technique for better mobile commerce effectiveness." Virtual Reality, Vol. 25, No. 2, pp. 341-356, 2021.

[https://doi.org/10.1007/s10055-020-00459-1]

-

Poole, Alex, Linden J. Ball, and Peter Phillips. "In search of salience: A response-time and eye-movement analysis of bookmark recognition." People and computers XVIII—Design for life. Springer, London, pp. 363-378, 2005.

[https://doi.org/10.1007/1-84628-062-1_23]

-

Tae-Hun Hwang, Jin Heon Kim. "Development of Emotion Analysis Platform for Quantitative Evaluation of VR Media Content", Journal of Digital Contents Society, Vol. 19, No. 10, pp. 1877-1892, 2018.

[https://doi.org/10.9728/dcs.2018.19.10.1887]

저자소개

2010년 : 아주대학교 e비즈니스학 전공 (학사)

2014년 : 아주대학교 경영정보학 전공 (석사)

2019년 : 연세대학교 정보시스템학 전공 (박사)

2020년~현 재: 부산가톨릭대학교 경영정보학과 조교수

※관심분야 : 메타버스, 가상현실, 증강현실, 인간-컴퓨터 상호작용, VR 디지털 치료제

2010년 : 연세대학교 문헌정보학 전공 (학사)

2014년 : 연세대학교 지식서비스보안 전공 (석사)

2018년 : 연세대학교 디지털 경영 전공 (박사)

2021년~현 재: 호서대학교 경영대학 경영학부 조교수

※관심분야 : Blockchain, Fintech, Digital Marketing, Big data & Social Network Analysis, VR

1997년 : Virginia Commonwealth University (U.S.A), Information System (학사)

2003년 : 연세대학교 경영학과 (석사)

2013년 : 연세대학교 정보시스템 (박사)

2015년~2019년: 순천향대학교 IT금융경영학과 조교수

2021년~현 재: 순천향대학교 경제금융학과 조교수

※관심분야 : Blockchain, 분산원장기술(DLT), Fintech, U-health, Digital currency, E-Payment, 가상 현실. M-Business