키포인트 기반의 시각적 지역 특징을 이용한 평면 물체 인식: 비교 분석

Copyright ⓒ 2020 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 논문은 키포인트 기반의 시각적 지역 특징을 이용해 평면 물체를 인식할 때 어떤 점들을 고려해야하는지에 대한 비교 분석을 제시한다. 실제 응용에서 나타날 수 있는 평면 물체 인식에 대한 다양한 시나리오를 고려한 데이터베이스를 이용하여 지역 특징 추출 알고리즘, 매칭 및 정제 알고리즘, 호모그라피 계산 알고리즘을 달리하면서 각 조합에 따른 인식의 정확도 및 전체 연산 속도를 비교 분석한다. 본 논문에서 비교 분석한 결과는 키포인트 기반의 시각적 지역 특징을 이용해 평면 물체를 인식해야 하는 컴퓨터비전이나 로봇비전 응용을 개발할 때에 좋은 참고자료로 활용가능하며 특히, 증강현실이나 동시적 위치 추정 및 지도 작성과 같이 지역 특징의 매칭과 호모그라피의 계산을 토대로 카메라의 3차원 자세를 추정해야하는 응용 등에서 높은 가치가 기대된다.

Abstract

This paper presents a comparative analysis of what factors should be considered when recognizing a planar object using keypoint-based visual local features. Using a database that considers various scenarios for planar object recognition that may appear in real-world applications, we compare and analyze the recognition accuracy and overall computation time while differently from the local feature extraction algorithm, matching and refinement algorithm, and homography calculation algorithm. The comparative analysis presented in this paper can be used as a good reference when developing computer vision or robot vision applications that need to recognize planar objects using keypoint-based visual local features. In particular, it is expected to be useful when developing applications that require estimating the three-dimensional posture of a camera based on matching local features and calculating homography, such as augmented reality or simultaneous localization and mapping.

Keywords:

Planar Object Recognition, Visual Local Features, Local Features, Keypoint Detection, Keypoint Description키워드:

평면 물체 인식, 시각적 지역 특징, 지역 특징, 키포인트 검출, 키포인트 기술Ⅰ. 서 론

평면 물체를 빠르고 정확하게 인식하는 것은 컴퓨터비전이나 로봇비전 응용에 있어서 매우 중요한 기술 중 하나이다. 특히, 평면 물체 인식의 범위를 대상 평면 물체의 위치와 크기를 추정하는 단계를 넘어 대상 평면 물체와 이를 포착하고 있는 카메라 사이의 3차원 자세 추정까지로 확장한다면 해당 기술을 증강현실(augmented reality, AR) 응용이나 동시적 위치 추정 및 지도 작성(simultaneous localization and mapping, SLAM) 응용 등에도 활용 가능하다. 이를 위해서는 대상 평면 물체만을 포함하고 있는 등록 이미지와 대상 평면 물체와 함께 방해 요소로 작용하는 배경이나 다른 물체들을 함께 포착하고 있는 실시간 이미지 사이의 호모그라피(homography) 계산이 필수적이다.

평면 물체 인식에 있어서 호모그라피의 계산은 대상 평면 물체와 이를 포착하고 있는 카메라 사이의 3차원 자세 추정을 가능하게 하여 단순히 위치와 크기만을 추정하는 것보다 훨씬 많은 활용가능성을 열어준다. 뿐만 아니라 계산된 호모그라피는 평면 물체 인식의 수락(accept)과 거부(reject) 사이의 의사결정(decision making)에 대한 결정적 판단근거로 활용가능하다. 등록 이미지와 실시간 이미지 사이의 호모그라피를 계산하기 위해서는 최소 4쌍의 위치 관련성(correspondence)이 요구되며, 이는 두 이미지 사이에서 추출된 키포인트 기반의 시각적 지역 특징(keypoint-based visual local features)의 매칭(matching)에 기초한다.

실시간 이미지의 복잡한 배경(cluttered background)과 대상 평면 물체의 가려짐 현상(occlusion)을 극복하기 위해 시각적 지역 특징에 대한 연구가 활발히 진행되어왔다. 시각적 지역 특징은 이미지의 전역을 표현하는 대신에 여러 개의 국소 지역을 찾아서 표현하기 위해 사용되는 특징이다. 이 중에서도 키포인트 기반의 시각적 지역 특징이 가장 많이 쓰이고 있으며, 이는 여러 가지 변화에도 반복성(repeatability)이 높은 키포인트를 검출(detection)한 후에 이를 중심으로 한 국소 지역을 기술(description)하는 순으로 이뤄진다[1,2]. 여러 개의 국소 지역을 사용하므로 가려짐 현상이나 복잡한 배경에 강인할 뿐만 아니라 시점이나 조명에 따른 변화에도 덜 민감한 장점을 가진다. 평면 물체 인식에 있어서 어떤 키포인트 기반의 시각적 지역 특징을 선택하느냐는 인식의 성패를 결정할 만큼 중요한 문제이다.

키포인트 기반의 시각적 지역 특징에 대한 비교 분석에 관한 연구[3]는 최근까지도 진행되고 있지만 대부분이 카툰 이미지 등의 단순한 이미지 사이의 매칭을 통한 특징 자체에 대한 성능 비교에만 초점을 맞추고 있을 뿐 이를 실제 현실 세계에서 나타날 수 있는 평면 물체 인식 시나리오에 적용하였을 때 어떤 결과로 이어지는 지에 대한 비교 분석 연구는 부족한 실정이다. 본 논문에서는 최근 평면 물체 추적을 위한 벤치마킹 목적으로 제작된 데이터베이스[4]를 활용하여 평면 물체 인식 문제에서 키포인트 기반의 시각적 지역 특징을 선택할 때 어떤 점들을 고려해야하는지에 대한 비교 분석 실험을 수행한다. 본 논문에서는 평면 물체 인식의 범위를 대상 평면 물체와 이를 포착하고 있는 카메라 사이의 3차원 자세 추정까지로 정의하고, 앞으로 키포인트 기반의 시각적 지역 특징을 줄여서 지역 특징이라 부른다.

본 논문은 다음과 같이 구성된다. 2장에서는 지역 특징에 대해 추출하는 방식에 따라 두 가지로 나누어 살펴보고, 3장에서는 추출된 지역 특징을 이용하여 평면 물체를 인식하는 과정에 대해 기술한다. 4장에서는 지역 특징의 선택이 평면 물체 인식의 결과에 어떤 영향을 끼치는 지에 대한 비교 분석 실험과 그 결과를 제시한다. 마지막으로 5장에서 결론을 맺고 향후 연구 방향을 모색한다.

Ⅱ. 지역 특징

2-1 경사도 기반 특징

SIFT[5]는 현재까지 가장 성공한 지역 특징으로 인정받고 있으며, 수많은 상용 어플리케이션에서 활용되면서 그 성능을 입증하고 있다. SIFT는 크기 공간(scale space)에서 지역 극값(local extrema)을 찾고, 해당 영역의 크기와 방향(orientation) 을 정규화(normalization) 한 후 여러 개의 격자 내에서 각각 경사도(gradient)의 분포(histogram)를 계산한 후, 하나의 벡터(vector)로 표현하는 절차를 통해 지역 특징을 추출된다. 따라서 SIFT에 의해 추출된 지역 특징은 크기와 방향의 변화에 불변(invariant)한 성질을 가진다. SIFT는 높은 반복성과 매칭 신뢰도 때문에 널리 이용되고 있지만, 경사도를 계산하는 데 있어서 연산 량이 크다는 단점이 있다. SIFT의 연산을 근사하여 연산속도를 대폭 향상시킨 SURF[6] 등이 개발되었지만, 이 또한 계산력이 부족한 모바일 환경에서는 큰 연산 량으로 인하여 사용이 제한적이다.

2-2 이진 특징

경사도 기반 특징의 무거운 연산 량을 해결하기 위한 방법으로 이진 특징이 연구되어 왔다. 이진 특징은 단순히 두 픽셀 쌍들의 밝기 값 비교를 통해 키포인트 검출하고 기술한다. FAST[7]는 이웃하는 모든 픽셀보다 어둡거나 밝은 점을 키포인트로 검출한다. 키포인트가 아닌 픽셀들 중 대부분의 픽셀은 한두 번의 비교를 거쳐 걸러지기 때문에 매우 빠르게 전체에 대한 계산이 가능하다. BRIEF[8]는 2진 체계 기술자(descriptor)로써, 미리 정해놓은 일련의 픽셀 쌍의 밝기 값 비교를 통해 0과 1로만 이루어진 비트 스트링(bit strings)을 결과로 반환한다. ORB[9]는 FAST 키포인트와 BRIEF 기술자에 방향 변화에 불변한 성질을 추가한 특징이다. 그밖에 비교대상인 픽셀 쌍을 대체하여 가우시안 커널(Gaussian kernel)을 통과한 두 영역으로 확장한 BRISK[10] 등이 연구되어 오고 있다. 일반적으로 이진 특징은 경사도 기반 특징에 비해 다양한 변화에 약한 단점을 보이지만 최대 10배 이상의 빠른 연산 량을 자랑한다. 뿐만 아니라 이진 특징은 최종 특징 벡터가 0과 1로만 이루어져 있기 때문에 경사도 기반 특징보다 훨씬 적은 메모리로 표현이 가능하며, 해밍 거리(Hamming distance)의 장점을 이용할 수 있어서 특징들 사이의 유사도를 빠르게 계산할 수 있는 부가적인 장점을 지닌다.

Ⅲ. 평면 물체 인식 과정

3-1 지역 특징 추출

지역 특징은 이미지에서 키포인트를 검출한 후, 해당 키포인트의 위치와 크기 정보로 생성한 이미지 조각(patch)에 대해 키포인트 기술자를 이용해 고차원의 벡터로 기술하는 과정을 통해 추출된다. 지역 특징에 회전 변화에 불변한 속성을 부여하기 위해 기술되기 전 방향 정보를 할당한다. 하나의 지역 특징은 키포인트와 고차원의 벡터의 조합이며, 키포인트는 위치, 크기, 방향 등의 속성을 가진다.

등록 이미지는 대상 평면 물체만을 포함하고 있거나 대상 평면 물체의 경계가 주어지기 때문에 이를 이용해 대상 평면 물체 영역에서만 지역 특징을 추출할 수 있다. 이 과정은 오프라인에서 한번만 수행되며, 추출된 지역 특징은 실시간 이미지에서 추출할 지역 특징과의 매칭을 위해 키포인트의 위치와 고차원의 벡터를 메모리에 저장한다. 실시간 이미지에서는 대상 평면 물체가 어디에 어떻게 놓여있는지 모르기 때문에 이미지의 전체 영역에서 지역 특징을 추출한다.

3-2 지역 특징 매칭 및 정제

등록 이미지에서 추출한 지역 특징과 실시간 이미지에서 추출한 지역 특징 사이의 매칭을 수행한다. 지역 특징이 가진 고차원의 벡터 사이에 계산된 거리가 가장 가까운 지역 특징끼리 매칭된다. 일반적으로 경사도 기반 특징은 유클리디안 거리(Euclidean distance), 이진 특징은 해밍 거리를 거리를 측정하는 계량(metric)으로 정의한다.

실시간 이미지는 대상 평면 물체와 함께 방해 요소로 작용하는 배경이나 다른 물체들을 함께 포착하고 있기 때문에 매칭 결과에는 이상치(outlier)라고 부르는 잘못된 매칭을 포함한다. 이상치는 인식을 방해하는 요소로 작용하기 때문에 이를 최소화하기 위한 정제(refinement)과정을 거친다. 정제 방법으로는 최근린 거리 비율(nearest neighbor distance ratio, NNDR)과 양방향 매칭(bi-directional matching) 등이 있다[2,5]. NNDR은 거리가 가장 가까운 지역 특징과의 거리 대비 두 번째로 가까운 지역 특징과의 거리의 비율이 특정 값보다 작은 매칭만 취하고 그렇지 않은 매칭은 걸러내는 방식이다. 양방향 매칭은 등록 이미지에서 추출된 지역 특징과 실시간 이미지에서 추출된 지역 특징을 양방향으로 매칭한 후, 서로 주고받은 매칭만 취하고 그렇지 않은 매칭은 걸러내는 방식이다.

3-3 호모그라피 계산 및 인식 여부 판단

매칭된 지역 특징들이 가진 키포인트의 위치 쌍들을 이용하여 등록 이미지와 실시간 이미지 사이의 위치 관련성들을 만들어 낼 수 있으며, 최소 4쌍의 위치 관련성이 있다면 대상 평면 물체 내에 존재하는 2차원 좌표가 등록 이미지 상에서 실시간 이미지 상으로 변환되는 호모그라피의 계산이 가능하다. 4쌍 이상의 위치 관련성이 없다면 그 즉시 인식을 거부할 수 있다.

호모그라피는 모든 위치 관련성에 대한 최소 자승법(leaste squares method)으로도 계산 가능하지만 매칭 후 정제과정을 거쳤다고 할지라도 위치 관련성에는 이상치가 존재할 수 있기 때문에 이상치를 제거하면서 호모그라피를 계산하는 알고리즘인 RANSAC[11]을 이용한다면 보다 정확한 호모그라피의 계산이 가능하다. 매칭된 지역 특징의 키포인트의 위치 쌍뿐만 아니라 매칭된 지역 특징 사이의 거리를 추가로 활용한다면 매칭 점수가 높은 위치 관련성에 샘플링의 우선권을 주는 방법인 PROSAC[12]을 이용하여 호모그라피의 계산 속도를 높일 수 있다.

3×3 행렬로 표현되는 호모그라피의 좌 상단 2×2 부분 행렬을 이용해 호모그라피의 유효성을 판단한다. 유효하지 않은 호모그라피는 뒤집힘(reflection), 뒤틀림(twist), 오목(concave) 현상을 포함한다. 유효하지 않은 호모그라피에 대해서는 인식을 거부한다. RANSAC과 PROSAC은 호모그라피를 계산하는 과정에서 이상치를 모두 걸러주고 정상치(inlier)만 남기는데 최종 정상치의 개수를 인식 여부를 판단하는 데에 추가 근거로 활용할 수 있다.

Ⅳ. 실험 및 비교 분석

4-1 데이터베이스

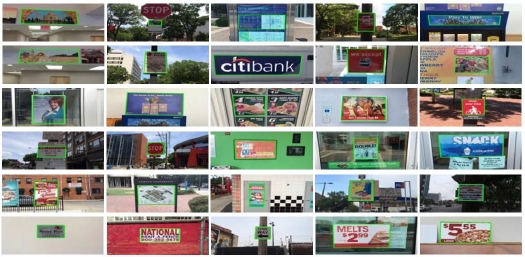

평면 물체 인식 문제에서 지역 특징을 선택할 때 어떤 점들을 고려해야하는지에 대한 비교 분석 실험을 수행하기 위해 최근 평면 물체 추적을 위한 벤치마킹 목적으로 제작된 데이터베이스[4]를 활용한다. 해당 데이터베이스는 그림 1과 같이 30개의 평면 물체를 대상으로 각 물체마다 크기 변화(scale change), 회전(rotation), 원근 왜곡(perspective distortion), 흐려짐(motion blur), 가려짐(occlusion), 사라짐(out-of-view), 무제약 환경(unconstrained) 등의 7가지 서로 다른 변화요소를 고려하여 촬영한 영상을 포함한다. 따라서 전체 210개의 영상으로 구성되며, 각각의 영상은 501개의 프레임으로 구성된다. 첫 번째 프레임을 등록 이미지로 사용하고 나머지 500개의 프레임을 실시간 이미지로 사용한다. 영상과 함께 매 프레임 마다 평면 물체의 네 모서리 좌표가 주석으로 달려있다. 해당 좌표를 활용하면 등록 이미지에서는 대상 평면 물체 영역에서만 지역 특징을 추출할 수 있고, 실시간 이미지에서는 계산한 호모그라피를 이용해 등록 이미지의 대상 평면 물체 영역을 변환한 네 모서리 좌표와 비교하여 인식의 성공여부를 판단한다.

4-2 구현

실험을 위해 4-1절에서 설명한 데이터베이스를 대상으로 3장에서 설명한 평면 물체 인식 과정을 구현하였다. 모든 구현은 OpenCV 4.4.0[13]을 이용하였다.

3-1절의 지역 특징 추출을 위한 알고리즘으로는 SIFT, SURF, BRISK, ORB를 포함하였으며, ORB의 첫 번째 파라미터만 100,000으로 변경하였다. 이는 포함한 알고리즘 중 ORB만 검출할 키포인트를 제한하고 있어서 나머지 알고리즘과 동등하게 가능한 모든 키포인트를 검출하도록 하기 위함이다. 3-2절의 특징 매칭을 위해 SIFT와 SURF는 유클리디안 거리를 위한 NORM_L2를 인자로, BRISK와 ORB는 해밍 거리를 위한 NORM_HAMMING을 인자로 생성된 BFMatcher 클래스의 객체를 사용하였다. 매칭된 결과를 정제하기 위해 NNDR과 양방향 매칭을 각각 구현하였다. NNDR은 BFMatcher 클래스의 knnMatch 함수를 이용하여 구현하였으며, 양방향 매칭은 매칭을 양방향으로 수행하여 서로 주고받은 매칭만을 최종 매칭으로 결정하는 방식으로 구현하였다. 3-3절의 호모그라피 계산을 위해 findHomography 함수를 이용하였으며 호모그라피 계산 방법으로는 RANSAC과 PROSAC을 포함하였다. PROSAC을 위해 findHomography 함수를 수행하기 전에 매칭 결과를 매칭된 지역 특징 사이의 거리의 역순으로 정렬하는 과정을 추가하였다.

4-3 지역 특징의 규모 및 사이즈 비교

첫 번째 실험으로 지역 특징의 사이즈 및 규모 비교를 위한 실험을 수행하였으며, 그 결과를 표 1에 정리하였다. 지역 특징의 규모를 측정하기 위해 평면 물체 추적 벤치마킹 데이터베이스에 포함된 모든 프레임을 대상으로 특징을 추출하였다. 평균 추출된 특징의 수는 ORB, SURF, BRISK, SIFT 순으로 많았으며, ORB가 다른 특징에 비해 약 2.6~3.8배 많은 특징이 추출되었다. 차원의 크기는 BRISK, ORB, SIFT, SURF 순으로 크지만 이진 특징인 BRISK와 ORB가 비트 스트링으로 저장되는 특징과, 4바이트 실수 값이 1바이트로 양자화되어 저장되는 SIFT의 특징으로 인해 메모리 사용량은 SURF, SIFT, BRISK, ORB 순으로 많았다. SURF가 ORB보다 8배 많은 메모리를 요구하였다.

4-4 평면 물체 인식 정확도 및 속도 비교

평면 물체 인식의 정확도 및 속도 비교를 위해 지역 특징 추출 알고리즘과 매칭 및 정제 알고리즘, 호모그라피 계산 알고리즘을 달리하면서 평면 물체 추적 벤치마킹 데이터베이스에 존재하는 모든 실시간 이미지에 대해 인식을 수행하였다. 각 실시간 이미지 마다 계산된 호모그라피를 이용하여 등록 이미지에 주석으로 달린 네 모서리 좌표를 변환한 좌표와 실시간 이미지에 주석으로 달린 네 모서리 좌표와의 평균 픽셀 오차가 5픽셀 이하인 경우에는 성공으로 간주하였다. 인식을 거부한 이미지에 대해서는 실패로 간주하였으며, 모든 실시간 이미지에 대한 평균 성공률을 정확도로 정의하였다. 속도 비교를 위해 실시간 이미지를 인식하는 데 걸리는 평균 시간을 측정하였다. 모든 실험은 i7-6700 (3.40GHz) CPU와 16.0GB RAM이 장착된 PC에서 수행되었다.

지역 특징 추출 알고리즘과 매칭 및 정제 알고리즘, 호모그라피 계산 알고리즘에 따른 평면 물체 인식의 정확도 및 속도 비교 결과를 표 2에 정리하였다. 어떤 지역 특징을 사용하더라도 매칭의 이상치를 제거하지 않는다면 터무니없이 낮은 정확도를 보였다(NNDR+RANSAC). 배경이나 다른 물체들에서 추출된 지역 특징의 매칭 결과가 잘못된 호모그라피의 계산으로 이어지기 때문이다. SURF를 제외하고는 정제 알고리즘 없이 PROSAC만으로도 준수한 정확도를 보였으며, 특히 이진 특징인 BRISK와 ORB는 PROSAC만으로도 최고치에 가까운 정확도를 보였다. NNDR과 양방향 매칭 등의 정제 알고리즘은 이진 특징인 BRISK와 ORB 보다는 경사도 기반 특징인 SIFT와 SURF에 더 많은 영향을 끼치는 것을 확인하였다. NNDR이나 양방향 매칭 등의 정제 알고리즘을 사용했을 때에 SIFT와 SURF는 PROSAC보다 RANSAC이 더 높은 정확도를 보였으며, BRISK와 ORB는 RANSAC보다 PROSAC이 더 높은 정확도를 보였다. 지역 특징 별 정제 알고리즘과 호모그라피 계산 알고리즘의 가장 좋은 조합은 SIFT는 NNDR + RANSAC, SURF는 양방향 매칭 + RANSAC, BRISK와 ORB는 양방향 매칭 + PROSAC으로 나타났다. 그 때의 정확도 순은 SIFT, SURF, BRISK, ORB 순으로 나타났으며, SIFT가 나머지 세 지역 특징에 비해 약 5% 정도 더 높은 정확도를 보였으며, 나머지 세 지역 특징은 서로 1% 미만의 차이를 보였다.

속도는 지역 특징 자체만을 놓고 보면 ORB, BRISK, SIFT, SURF 순으로 빠르게 추출되지만 4-3절에서 언급한 바와 같이 ORB가 다른 특징에 비해 2.6~3.8배 많은 특징을 추출하기 때문에 그에 비례하게 매칭 및 정제 시간이 증가하면서 전체 연산에 있어서는 BRISK가 가장 빠른 속도를 보였다. 알려진 바와 다르게 SIFT가 SURF보다 빠르게 추출되는 점은 구현의 최적화로 인한 것으로 추정한다. 정제 알고리즘 중에서는 양방향 매칭이 가능 많은 연산 시간을 필요로 하였으며, 호모그라피 계산 알고리즘 중에서는 PROSAC 보다 RANSAC이 더 많은 연산 시간을 필요로 하였다. 모든 지역 특징에서 NNDR + PROSAC 조합이 속도 대비 정확도가 가장 높게 나타났다.

Ⅴ. 결 론

본 논문에서는 키포인트 기반의 시각적 지역 특징을 이용해 평면 물체를 인식할 때 어떤 점들을 고려해야하는지에 대한 비교 분석 실험을 수행하였다. 실제 현실 세계에서 나타날 수 있는 평면 물체 인식 시나리오를 고려하기 위해 최근 평면 물체 추적을 위한 벤치마킹 목적으로 제작된 데이터베이스를 이용하여 실험을 수행하였다.

실험을 통해 정제 알고리즘은 이진 특징 보다는 경사도 기반 특징에 더 많은 영향을 끼치는 것을 확인할 수 있었으며, 정제 알고리즘을 사용했을 때에 경상도 기반 특징은 RANSAC을, 이진 특징은 PROSAC을 이용하는 것이 더 높은 정확도를 도출할 수 있었다. SIFT는 NNDR + RANSAC, SURF는 양방향 매칭 + RANSAC, BRISK와 ORB는 양방향 매칭 + PROSAC 조합에서 가장 높은 정확도를 보였다. 각 지역 특징 별 가장 높은 정확도를 보이는 조합에서는 SIFT가 나머지 세 지역 특징에 비해 약 5% 정도 더 높은 정확도를 보였다. 속도는 가장 빠르게 지역 특징을 추출하는 ORB가 많은 특징 수로 인해 전체 연산에 있어서는 BRISK가 가장 빠른 속도를 보였다. 모든 지역 특징에서 NNDR + PROSAC 조합이 속도 대비 정확도가 가장 높게 나타났다.

본 논문에서 비교 분석한 결과는 키포인트 기반의 시각적 지역 특징을 이용해 평면 물체를 인식해야하는 컴퓨터비전이나 로봇비전 응용을 개발할 때에 좋은 참고자료가 되리라 판단한다. 특히, AR이나 SLAM과 같이 지역 특징의 매칭과 호모그라피의 계산을 토대로 카메라의 3차원 자세를 추정해야하는 응용 등에서 그 활용가치고 높다고 판단한다.

다양한 조합에 따른 평면 물체 인식의 정확도와 함께 전체 연산속도를 제시하였지만 속도 대비 정확도를 올리는 노력이나 실시간 연산을 위한 최적화 기법은 적용하지 않았다. 추출되는 지역 특징의 수를 제한하기만 해도 매칭과 호모그라피 계산 부분에서 많은 속도 이득을 취할 수 있을 것으로 판단된다. 그밖에 최적화 기법을 연구한다면 더욱 효율적인 평면 물체 인식이 가능할 것으로 기대된다.

Acknowledgments

이 성과는 2020년도 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원(NRF-2018R1C1B5046098)을 받아 수행된 연구임.

참고문헌

-

K. Mikolajczyk and C. Schmid, “Scale & affine invariant interest point detectors,” International journal of computer vision, Vol. 60, No. 1, pp. 63-86, Oct 2004.

[https://doi.org/10.1023/B:VISI.0000027790.02288.f2]

-

K. Mikolajczyk and C. Schmid, “A performance evaluation of local descriptors,” IEEE transactions on pattern analysis and machine intelligence, Vol. 27, No. 10, pp. 1615-1630, Oct 2005.

[https://doi.org/10.1109/TPAMI.2005.188]

-

S. A. K. Tareen and Z. Saleem, “A comparative analysis of SIFT, SURF, KAZE, AKAZE, ORB, and BRISK,” in Proceeding of International conference on computing, mathematics and engineering technologies, Sukkur, Pakistan, pp. 1-10, 2018.

[https://doi.org/10.1109/ICOMET.2018.8346440]

-

P. Liang, Y. Wu, H. Lu, L. Wang, and C. Liao, “Planar object tracking in the wild: A benchmark”, in Proceeding of IEEE International Conference on Robotics and Automation, Brisbane, Australia, pp. 651-658, 2018.

[https://doi.org/10.1109/ICRA.2018.8461037]

-

D. G. Lowe, “Distinctive Image Features from Scale-Invariant Keypoints,” International Journal of Computer Vision, Vol. 60, No. 2, pp. 91-110, November 2004.

[https://doi.org/10.1023/B:VISI.0000029664.99615.94]

-

H. Bay, A. Ess, T. Tuytelaars, and L. V. Gool, “Speeded-up robust features (SURF),” Computer Vision and Image Understanding, Vol. 110, No. 3, pp. 346-359, June 2008.

[https://doi.org/10.1016/j.cviu.2007.09.014]

-

E. Rosten and T. Drummond, “Machine Learning for High-Speed Corner Detection,” in Proceeding of European Conference on Computer Vision, Graz, Austria, pp. 430-443, 2006.

[https://doi.org/10.1007/11744023_34]

-

M. Calonder, V. Lepetit, C. Strecha, and P. Fua, “BRIEF: Binary Robust Independent Elementary Features,” in Proceeding of European Conference on Computer Vision, Crete, Greece, pp. 778-792, 2010.

[https://doi.org/10.1007/978-3-642-15561-1_56]

-

E. Rublee, V. Rabaud, K. Konolige, and G.R. Bradski, “ORB: an Efficient Alternative to SIFT or SURF,” in Proceeding of International Conference on Computer Vision, Barcelona, Spain, pp. 2564-2571, 2011.

[https://doi.org/10.1109/ICCV.2011.6126544]

-

S. Leutenegger, M. Chli, and R.Y. Siegwart, “BRISK: Binary Robust invariant scalable keypoints,” in Proceeding of International Conference on Computer Vision, Barcelona, Spain, pp. 2548-2555, 2011.

[https://doi.org/10.1109/ICCV.2011.6126542]

-

M. A. Fischler and R. C. Bolles, “Random sample consensus: a paradigm for model fitting with applications to image analysis and automated cartography,” Communications of the ACM, Vol. 24, No. 6, pp. 381-395, June, 1981.

[https://doi.org/10.1145/358669.358692]

- O. Chum and J. Matas, “Matching with PROSAC-Progressive Sample Consensus,” in Proceeding of IEEE Conference on Computer Vision and Pattern Recognition, San Diego, CA, pp. 220-226, 2005.

- https://opencv.org/opencv-4-4-0/

저자소개

2012년 : 한국과학기술원 (공학석사)

2017년 : 한국과학기술원 (공학박사)

2018년~현 재: 경상대학교 컴퓨터과학과 조교수

※관심분야:증강현실(Augmented Reality), 컴퓨터비전(Computer Vision) 등