데이터 불균형 환경의 고속 SMT 공정을 위한 YOLOv8 기반 피듀셜 마크 실시간 정밀 결함 탐지

Copyright ⓒ 2026 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 논문은 고속 SMT 제조 환경에서 필수적인 피듀셜 마크의 초정밀 결함 탐지를 위한 경량화 딥러닝 프레임워크를 제안한다. 제조 공정의 수율을 저해하는 데이터 불균형과 미세 결함 문제를 해결하는 것은 무결점 제조(Zero Defect Manufacturing) 실현을 위한 핵심 과제이다. 이를 위해 본 연구에서는 22,471 장의 정밀 어노테이션 데이터셋을 구축하고 Mosaic 증강 기법을 적용하여 데이터 분포를 보정하였으며, 실시간 처리에 최적화된 YOLOv8n 모델을 학습시켰다. 실험 결과, 제안된 모델은 mAP [IoU=0.5:0.95] 0.941과 정밀도 0.968을 기록하여 고해상도 입력 환경에서 정교한 위치 추정 성능을 확보하였다. 또한, 일반 산업용 PC 환경에서도 0.045 초의 추론 속도를 달성하여 고가의 서버 없이도 실시간 전수 검사가 가능함을 확인하였다. 본 연구는 저비용 고효율의 자동화 검사 솔루션을 제시함으로써, 공정 지연을 최소화하고 수동 재작업 비용을 획기적으로 절감하는 데 기여한다.

Abstract

This paper proposes a lightweight deep-learning framework for the ultra-precision defect detection of fiducial marks, which is essential in high-speed surface mount technology manufacturing environments. Addressing data imbalance and minute defects is a critical challenge for realizing zero-defect manufacturing, as it directly affects production yield. Thus, we constructed a comprehensive dataset of 22,471 precision-annotated images, applied Mosaic augmentation to balance data distribution, and trained a You only look once version 8 nano model optimized for real-time processing. Experimental results show that the proposed model achieved an mAP [IoU = 0.5:0.95] of 0.941 and a precision of 0.968, thus affording precise localization in high-resolution input environments. Furthermore, the system achieved a rapid inference speed of 0.045 s in a standard industrial PC environment, thereby confirming the feasibility of real-time inspection without expensive server infrastructure. This study presents a low-cost, high-efficiency automated inspection solution that can significantly minimize process latency and reduce manual rework costs.

Keywords:

Deep Learning, Object Detection, Computer Vision, Data Augmentation, Real-Time Inference키워드:

딥러닝, 객체 탐지, 컴퓨터 비전, 데이터 증강, 실시간 추론Ⅰ. 서 론

표면 실장 기술(SMT)은 전자 부품을 인쇄 회로 기판(PCB) 표면에 직접 실장하거나 배치하여 전자 회로를 생산하는 방식이다. PCB는 전자 부품들을 연결하기 위한 전기적 라인, 트랙, 경로뿐만 아니라, 자동화 장비가 정확한 위치를 인식하기 위한 배치 기준점(fiducial mark)을 포함하는 기판이다. 이 경로들은 전기가 한 부품에서 다른 부품으로 전도되도록 하는 구리 소재로 적층된 기판에 의해 연결된다. SMT 공정 중 부품을 고정하기 위한 솔더 페이스트 프린팅(solder paste printing)은 미세 간격 부품 조립에 있어 가장 까다로운 공정으로 꼽힌다.

반도체 업계 보고[1] 및 선행 연구[2]에 따르면, 전체 SMT 공정 결함의 약 60~70%가 솔더 페이스트 프린팅 단계에서 발생한다. 이러한 결함은 스퀴지 압력, 솔더의 물성, PCB와 스텐실(stencil) 간의 정렬 정확도 등 다양한 요인에 기인한다. 이 요인 중 하나인 정렬 과정을 수행하기 위해 SMT 장비는 PCB상의 피듀셜 마크를 인식하여 좌표를 보정한다. 이에 대해 국제 표준[3]에는 자동화 설비의 비전 시스템이 피듀셜 마크를 정확히 식별할 수 있도록, 마크가 기판 소재와 명확한 대비를 이루고 산화되지 않은 평탄한 표면을 유지할 것을 규정하고 있다. 그러나 제조 및 보관 과정에서 발생하는 마크의 표면 결함은 이러한 표준 요건을 저해하여 장비의 오인식 및 정렬 실패를 유발한다[4]. 따라서 SMT 조립 과정의 수율을 높이기 위해서는 공정의 가장 초기 단계인 기판 투입 시점에서 피듀셜 마크의 결함을 사전에 검출하는 것이 필수적이다.

이에 본 논문에서는 SMT 공정의 정밀도를 보장하기 위해 피듀셜 마크의 다양한 결함 유형을 정의하고, 객체 탐지 알고리즘인 YOLO(You Only Look Once)를 활용하여 이를 실시간으로 자동 탐지하는 모델을 만드는 것을 목표로 한다[5]. 본 논문의 주요 연구 내용은 다음과 같다.

RQ 1: 물리적인 데이터 확보가 제한된 상황에서, 도메인 특화된 데이터 증강 기법은 모델의 운용 안정성을 얼마나 향상시킬 수 있는가?

RQ 2: 제한된 데이터 환경에서 경량화 모델(YOLOv8n)이 산업 현장이 요구하는 초정밀 탐지 성능을 달성할 수 있는가?

본 논문의 구성은 다음과 같다. 2장에서는 SMT 공정의 데이터 불균형 문제와 객체 탐지 모델의 기술적 배경을 고찰하고, 실시간 검사를 위한 모델 선정 근거를 제시한다. 3장에서는 제안하는 결함 탐지 시스템의 전체 아키텍처를 소개하며, 정밀 데이터셋 구축 과정, Mosaic 증강 전략, 그리고 YOLOv8n 기반의 네트워크 설계 및 학습 환경을 상세히 기술한다. 4장에서는 모델의 학습 역학 및 정량적 성능 지표를 분석하고, 하드웨어 및 소프트웨어 최적화에 따른 실시간 추론 속도를 검증한다. 마지막으로 5장에서는 본 연구의 성과를 요약하고 향후 연구 방향을 제시하며 결론을 맺는다.

Ⅱ. 관련 연구

2-1 SMT 공정의 무결점 제조와 딥러닝 도입

무결점 제조(zero defect manufacturing, ZDM)는 Industry 4.0의 핵심 패러다임으로, 생산 공정에서 결함을 사전에 예측하고 방지하는 것을 목표로 한다[6]. 표면 실장 기술(SMT) 공정에서 피듀셜 마크 인식은 이러한 무결점 제조를 위한 첫 단계이자, PCB 정렬 정밀도를 결정짓는 중요한 요소이다[4]. 국제 표준(IPC)은 자동화 장비가 이를 식별할 수 있도록 엄격한 기준을 제시하고 있으나[3], 실제 제조 현장에서는 조명 변화, 산화 등 다양한 환경 변수로 인해 인식이 실패하는 경우가 발생한다. 최근 연구자들은 이러한 문제를 해결하기 위해 딥러닝을 도입하고 있다. 초기에는 오토인코더, 단순 CNN(convolutional neural network)을 활용하여 결함 유무를 분류했으나[2], 이는 결함의 정확한 위치를 파악하지 못한다는 한계가 있었다. 또한, 제조 데이터 특성상 정상 데이터는 풍부하지만 결함 데이터는 극도로 부족한 클래스 불균형(class imbalance) 문제가 존재하여, 모델이 소수 클래스인 결함을 학습하는 데 어려움을 겪고 있다[7]. 이를 해결하기 위해 최근에는 Mosaic와 같은 고급 데이터 증강 기법을 통해 데이터 분포를 보정하고 모델의 운용 안정성을 높이는 연구가 주목받고 있다[8].

2-2 객체 탐지 모델의 기술적 분류 및 특징

딥러닝 기반 객체 탐지(object detection) 모델은 탐지 파이프라인의 구성 방식에 따라 2단계(2-stage)와 1단계(1-stage) 모델로 구분된다[5].

2단계 탐지 모델은 인간의 선택적 주의(selective attention) 기제와 유사하게, ‘어디를 볼 것인가(Where)’를 먼저 결정한 후 ‘무엇인가(What)’를 판단하는 순차적인 방식을 따른다. 1단계에서 RPN(region proposal network)이 입력 이미지에서 물체가 존재할 가능성이 높은 후보 영역(region of interest, RoI)을 먼저 추출한다. 그 후 2단계에서 추출된 후보 영역에 대해서만 심층 신경망을 통해 정밀하게 클래스를 분류하고 위치 좌표를 보정한다. 이러한 과정을 통해 높은 정확도를 보장하지만, 두 개의 네트워크를 직렬로 통과해야 하는 구조적 병목 현상으로 인해 연산 속도가 느리다는 한계가 존재한다[9].

1단계 탐지 모델은 영역 제안 과정을 제거하고, 입력 이미지를 단일 신경망(single shot)에 통과시켜 객체의 위치와 종류를 동시에 예측하는 방식이다. 이미지를 S×S 그리드(grid)로 나누고, 각 그리드 셀에서 바운딩 박스와 클래스 확률을 한 번의 연산으로 산출한다. 즉, 탐지 문제를 하나의 회귀(regression) 문제로 재정의하여 파이프라인을 단순화했다. 이 방식은 비약적인 추론 속도를 제공하여 실시간 처리에 최적화되어 있으나, 초기 모델은 배경(background)과 객체의 클래스 불균형 문제로 인해 소형 객체 탐지 성능이 2단계 모델에 비해 낮다는 단점이 있었다. 하지만 최신 모델들은 깊은 층(deep layer)에서 추출한 의미론적 특징과 얕은 층(shallow layer)에서 추출한 고해상도 공간(spatial) 특징을 결합하는 기술인 다중 스케일 특징 융합(multi-scale feature fusion) 기술을 도입하여 이러한 정밀도 한계를 극복하고 있다[10].

2단계 탐지 모델의 표준인 Faster region-based convolutional neural network은 영역 제안(region proposal)과 객체 분류(classification) 및 위치 정제(bounding box regression) 과정을 순차적으로 수행하는 구조를 갖는다[11]. 이는 1단계에서 ‘어디를 볼 것인가’를 먼저 결정하고, 2단계에서 ‘그것이 무엇이며 정확한 위치는 어디인가’를 판별하는 것으로, 인간 시각의 선택적 주의(selective attention) 기제를 딥러닝 모델 구조에 효과적으로 구현한 형태라 할 수 있다. 이미지 전체 그리드를 대상으로 객체의 유무와 클래스를 동시에 예측해야 하는 1단계 모델(SSD, YOLO)과 달리, 2단계 모델은 선별된 후보 영역에 대해 “이곳에 객체가 확실히 존재하는가?”라는 보다 집중된 문제를 해결한다. 이러한 구조적 특성 덕분에 Faster R-CNN은 속도보다 탐지의 정확도와 신뢰도가 최우선시되는 도메인에서 표준 모델로 채택되어 왔다[12]-[14]. 그러나 이러한 높은 정확도의 이면에는 상대적으로 느린 추론 속도라는 한계가 존재한다. Faster R-CNN의 원저 논문[11]은 VGG-16 백본 기준 약 198 ms (컨볼루션 141 ms+RPN 10 ms+RoI 처리 47 ms)의 처리 시간을 보고하고 있다. 비록 하드웨어의 발전으로 절대적인 시간은 단축되었으나, RPN 연산과 RoI 처리 과정이 반드시 순차적으로 발생해야 하는 직렬 처리 파이프라인의 구조적 병목은 여전히 존재한다. 즉, 두 단계의 연산 시간을 합산해야만 최종 결과가 도출되는 한계로 인해, 실시간성이 요구되는 공정 시스템에서는 적용에 제약이 따른다.

초기 1단계 탐지 모델 대표인 SSD 모델은 Faster R-CNN의 속도 한계를 극복하기 위해 등장한 초기 1단계 탐지 모델이다[15]. SSD는 탐지 작업을 단일 신경망의 순방향 통과(single pass) 내에서 하나의 회귀 문제로 처리한다. 이는 Faster R-CNN의 RPN과 같은 별도의 영역 제안 단계를 완전히 제거 했음을 의미한다. SSD는 300×300 입력(SSD300) 모델이 Nvidia Titan X GPU에서 59 FPS를 달성했다고 보고했다. 이는 프레임당 추론 시간이 약 16.9 ms에 불과함을 의미한다. 이는 Faster R-CNN의 198 ms 대비 10배 이상 빠른 속도이며, 본 연구의 저지연 목표를 충족시키는 수치이다[15]. 이러한 특징 때문에 실시간 영상 처리가 필수적인 다양한 분야에서 널리 활용된다[16]-[19]. 하지만 SSD는 작은 객체 탐지 성능 및 지역화 정확도가 2단계 모델에 비해 떨어지는 구조적 한계를 가졌다[9].

Faster R-CNN(정확하지만 느림)과 SSD(빠르지만 작은 객체에 취약함)의 한계를 모두 극복하기 위해, 본 연구는 최신 1단계 SOTA(state-of-the-art) 아키텍처인 YOLOv8 을 최종 모델로 선정했다. YOLOv8은 n(nano), s(small), m(medium), l(large), x(extra-large) 등 다양한 스케일의 모델을 제공한다[20]. 이 중 YOLOv8n은 가장 적은 파라미터를 가지며 가장 빠른 모델이다. 이는 본 연구의 저지연 실시간 검사 요구사항에 가장 직접적으로 부합하는 선택이다. YOLOv8은 공식적으로 anchor-free split ultralytics head를 채택했다[21]. anchor-free 방식은 SSD나 초기 YOLO 모델처럼 사전에 정의된 앵커 박스를 필요로 하지 않는다[22]. 비교 벤치마크에서 YOLOv8 모델은 97 FPS의 속도를 기록했다[10]. 이는 프레임당 추론 시간이 10.3 ms 임을 의미한다. 또한 결함 및 소형 객체 탐지의 여러 적용 사례를 통해 정확도 한계를 크게 개선했다는 것을 입증했다[23]-[25]. 종합적으로, YOLOv8n은 10.3 ms의 초고속 추론을 달성하면서도, 표면 결함 및 작은 객체 탐지에서 SSD를 능가하는 높은 정확도를 입증했다. 이는 YOLOv8n이 본 연구의 제약 조건(저지연, 미세 결함 탐지)을 모두 만족시키는 속도와 정확도 사이의 최적 균형을 제공하는 모델임을 뒷받침한다.

본 연구에서 최신 YOLO 모델 대신 YOLOv8n을 최종 모델로 선정한 것은 고속 SMT 생산 라인의 takt time(공정 소요 시간)을 준수하기 위한 전략적 선택이다. 전수 검사 시스템의 특성상 모델의 파라미터 증가에 따른 미세한 추론 지연도 전체 공정 효율을 저하시키는 병목 현상이 될 수 있다. YOLOv8n은 경량 아키텍처 구조를 통해 0.045s의 저지연 성능을 보장하면서도 공정 요구 정밀도를 충분히 충족한다. 이는 고가의 연산 자원에 의존하지 않고 실제 제조 현장의 산업용 PC 환경에서도 안정적인 전수 검사를 가능하게 하는 실용적 관점에서의 최적화 결과이다.

Ⅲ. 연구 방법

3-1 전체 시스템 아키텍처

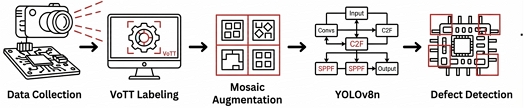

본 연구에서 제안하는 SMT 피듀셜 마크 결함 탐지 시스템의 전체 프로세스는 그림 1과 같다. 시스템은 크게 데이터 수집 및 정밀 라벨링, 데이터 증강을 통한 불균형 해소, 그리고 YOLOv8n 기반의 모델 학습 및 추론의 3단계 파이프라인으로 구성된다. 먼저, SMT 공정 라인에서 수집된 원본 이미지는 VoTT를 통해 비정상 객체의 위치 정보가 픽셀 단위로 정밀하게 어노테이션(annotation)한다. 수집된 데이터는 정상 클래스에 편향되어 있으므로, 학습 단계에서 Mosaic 및 Mixup 증강 기법을 적용하여 데이터 분포를 보정한다. 최종적으로 학습된 모델은 실시간 추론을 위해 FP16(half precision) 기반의 최적화 엔진에 탑재되어, 5가지 유형의 결함을 실시간으로 탐지한다.

3-2 데이터셋 구축 및 클래스 정의

본 연구에서는 Microsoft의 오픈소스 도구인 VoTT (Visual Object Tagging Tool)[26]를 사용하여 데이터셋을 구축하였다. VoTT는 로컬 파일 시스템을 완벽하게 지원하여 제조 데이터의 보안성을 유지할 수 있으며[27], 이미지 내 객체의 경계 상자(bounding box)를 픽셀 단위로 미세 조정할 수 있어 본 연구가 목표로 하는 초정밀 라벨링 작업에 최적화된 도구이다[28]. 구축된 데이터셋은 총 12,000 장의 이미지로 구성되었다.

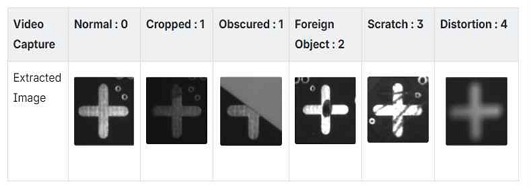

SMT 현장에서 가장 많이 나타나는 데이터 유형인 정상, 잘림, 이물질, 스크래치, 왜곡의 5가지 클래스로 확장 정의하였다. 이를 위해 본 연구에서는 그림 2와 같이 각 클래스의 실제 결함 이미지와 함께, 판별 기준을 명시한 표를 통합하여 정의하였다. 구체적인 분류 기준은 다음과 같다.

• 정상(normal): 십자가 형태가 온전하고 표면이 깨끗하며, 가려짐이 없는 상태.

• 잘림(cropped): 피듀셜 마크가 이미지 경계(boundary)에 걸쳐 있어 전체 형태의 일부만 나타나는 상태.

• 이물질(foreign object): 먼지, 잔여물 등이 마크 위를 덮어 형태를 가리고 있는 상태(경계면이 아닌 내부 가림).

• 스크래치(scratch): 마크 표면에 긁힘이나 손상이 발생하여 픽셀값이 불규칙하게 변화한 상태.

• 왜곡(distortion): 물리적 충격이나 인쇄 오류로 인해 십자가의 종횡비가 무너지거나 찌그러진 상태 혹은 카메라가 흐리게 보이는 상태.

데이터셋은 표 1과 같이 구성되었다.

3-3 데이터 불균형 해소를 위한 증강 전략

제조 현장 데이터의 고질적인 문제인 클래스 불균형과 데이터 희소성 문제를 해결하기 위해, 본 연구에서는 Mosaic 증강 기법을 본 도메인에 최적화된 학습 전략으로 채택하였다. Mosaic은 범용적인 기법이나, 고해상도 이미지 대비 결함 객체의 크기가 매우 작고 발생 빈도가 낮은 SMT 공정 특성상 단일 배치 내 객체 노출 밀도를 기하학적으로 4배 높여 학습 효율을 높일 수 있다. 특히 이미지 생성 기반 기법에서 발생할 수 있는 픽셀 단위의 엣지 왜곡 없이 정밀한 형상 정보를 보존할 수 있다는 점이 전략적 채택의 핵심 근거이다[8]. Mosaic 기법은 4장의 서로 다른 학습 이미지를 무작위로 이미지 일부 영역 추출 및 재배치하여 하나의 새로운 이미지로 합성하는 방식이다. 이는 모델이 한 번의 학습 단계(iteration)에서 다양한 스케일과 배경을 가진 객체를 동시에 학습하게 하여 일반화 성능을 높인다. 또한, 작은 객체(small object)가 전체 이미지에서 차지하는 비율을 상대적으로 높여줌으로써, 소수 클래스인 소형 결함의 탐지 성능을 강화하는 데 기여한다[7]. 본 연구에서는 Mosaic 외에도 HSV 색상 변환, 좌우 반전(flip) 등을 복합적으로 적용하여 데이터의 다양성을 확보하였다[29]. 이런 증강을 통해 학습 데이터 20,706 장, 검증 데이터 1,765 장의 데이터를 확보했다. 데이터 증강은 그림 3과 같이 진행되었다.

3-4 YOLOv8n 네트워크 설계 및 학습 전략

본 연구에서는 SMT 공정의 저지연 요구사항과 미세 결함 탐지 정확도를 동시에 만족하기 위해, YOLOv8 시리즈 중 연산량이 가장 적은 YOLOv8n(nano) 모델을 선정하였다[20]. YOLOv8n의 아키텍처는 크게 백본(backbone), 넥(neck), 헤드(head)로 구성된다. 특히 백본에는 기존 구조를 개선한 C2f(cross stage partial with 2 fusion) 모듈이 적용되었다. 이 모듈은 입력 정보를 여러 갈래로 나누어 처리한 뒤 다시 병합하는 구조를 통해, 신경망이 깊어질수록 발생할 수 있는 학습 정보의 소실을 최소화한다[30]. 덕분에 경량 모델임에도 불구하고 피듀셜 마크의 뚜렷한 경계선과 같은 미세한 형상 정보를 디테일하게 학습할 수 있다. 또한, 사전에 정의된 앵커 박스 없이 객체의 중심점을 예측하는 anchor-free 메커니즘과 분류(classification) 및 회귀(regression)를 분리한 Decoupled Head 구조를 채택하여[21], 비정형 결함에 대한 유연한 탐지 성능을 확보함과 동시에 프레임당 약 10.3 ms의 초고속 실시간 추론 속도를 달성하였다[10].

본 연구의 실험은 Intel Xeon Gold 6138 CPU와 NVIDIA RTX A5000 (24 GB) GPU 환경에서 수행되었다. 데이터의 학습 효율을 극대화하기 위해, 32비트 부동소수점 연산 대비 메모리 사용량을 절반으로 줄이면서도 연산 속도를 가속화하는 혼합 정밀도(mixed precision, AMP) 기술을 적용하였다[31]. 또한, 반복적인 디스크 I/O 병목을 제거하기 위해 학습 데이터를 ram에 캐싱(ram caching)하는 방식을 채택하여 데이터 로딩 속도를 최적화하였다[32]. 데이터셋은 학습(20,706 장)과 검증(1,765 장)으로 분할되었으며, 미세 결함의 엣지 정보를 보존하기 위해 입력 해상도를 1280x1280으로 설정하고 배치 크기를 46으로 조정하였다. 최적화 도구로는 기본 값인 SGD (stochastic gradient descent)를 사용하였으며, 과적합 제어를 위해 가중치 감쇠(weight decay)는 0.0005로 설정하였다[32]. 학습률은 초기 0.003에서 시작하여, 학습 후반부로 갈수록 급격한 변동 없이 안정적인 최적점으로 수렴하도록 유도하는 코사인 어닐링(cosine annealing) 스케줄러를 적용하였다[32]. 모델의 운용 안정성 확보를 위해 자동화된 데이터 증강 기법인 RandAugment를 도입하였다[29]. 또한 학습 초기에는 Mosaic 증강을 적용하여 소형 객체 탐지 성능을 높이되[8], 정밀한 미세 조정을 위해 마지막 10 Epoch 구간에서는 이를 비활성화(close Mosaic)하는 전략을 취하였다[32]. 학습은 총 100 Epoch 동안 진행하되, 15 Epoch 이상 성능 개선이 없을 경우 조기 종료(early stopping)하여 불필요한 연산과 과적합을 방지하였다[32].

Ⅳ. 실험 결과

4-1 학습 및 손실 함수 수렴 분석

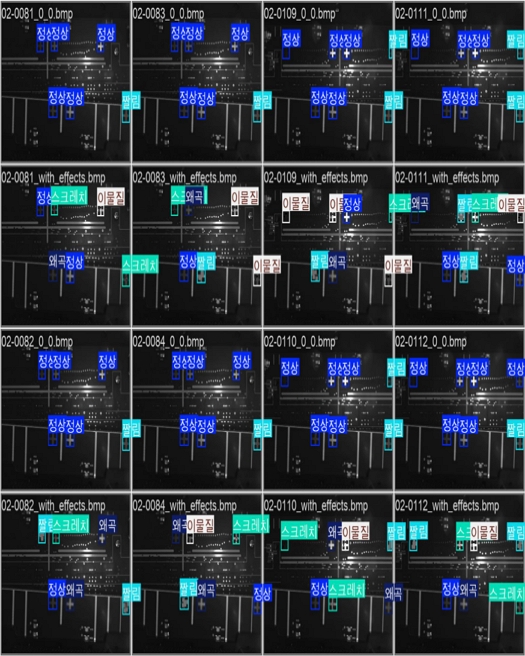

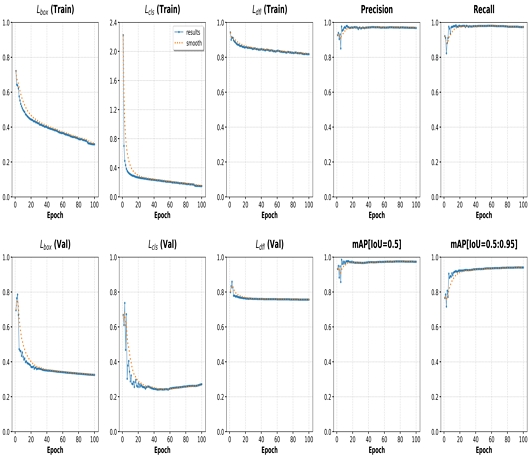

YOLOv8n 모델의 학습 안정성과 수렴 속도를 검증하기 위해 100 epoch 동안의 손실(loss) 및 성능 지표 변화를 정밀 추적하였다. 그림 4의 학습 곡선과 로그 데이터를 분석한 결과, 모델은 학습 초기 단계에서 매우 빠른 최적화 양상을 보였다. 구체적으로 객체의 위치 오차를 나타내는 박스 위치 손실은 학습 1 epoch 시점의 0.721에서 학습이 종료되는 100 epoch 시점에는 0.301로 약 58.2% 감소하였다. 객체의 종류를 판별하는 분류 오차인 분류 손실 또한 초기 2.222에서 최종 0.150으로 급격히 줄어들며, 모델이 5가지 결함 클래스(정상, 잘림, 이물질, 스크래치, 왜곡)의 시각적 특징을 명확히 구분하게 되었음을 확인하였다. 특히 주목할 점은 mAP [IoU=0.5] 지표의 변화 추이이다. 해당 지표는 학습 시작 불과 6 epoch 만에 0.985에 도달했는데, 이는 모델이 학습 초기에 이미 피듀셜 마크의 전반적인 형태와 위치 정보(global context)를 완벽에 가깝게 포착했음을 의미한다. 이후 90 Epoch까지 미세한 진동을 보이며 최적화되다가, Mosaic 증강이 비활성화되는 마지막 10 Epoch 구간(close Mosaic)에서 성능이 안정적으로 수렴하며 최종 0.973을 기록하였다[32]. 이는 과적합(overfitting) 징후 없이 모델이 일반화된 성능을 확보했음을 시사한다. 이러한 수렴 특성은 본 연구에서 제안한 학습 전략들의 단계적 적용에 기인한다. 우선 Mosaic 및 Mixup 증강은 학습 초기 단계에서 데이터의 다양성을 확보하여, 불과 6 epoch 만에 mAP[IoU=0.5]가 0.985에 도달하는 빠른 수렴 성능을 이끌어냈다. 이후 학습 후반부(90 epoch 이후)에 적용된 close Mosaic 전략은 인위적 변형이 제거된 실제 공정 데이터의 특징에 모델이 정밀하게 적응하도록 유도하였으며, 이를 통해 mAP[IoU=0.5:0.95]를 최종 0.941까지 향상 및 안정화시켰다. 이는 각 증강 기법의 유기적 결합이 SMT 결함 탐지의 정확도와 신뢰도 향상에 기여하고 있음을 보여준다.

4-2 성능 평가 및 결함 탐지 결과

테스트 데이터셋을 기반으로 측정한 최종 성능 지표는 표 2와 같다. 본 연구에서는 단순한 탐지 성공 여부를 넘어, 제조 공정이 요구하는 초정밀도를 검증하기 위해 두 가지 기준의 mAP를 측정하였다. 첫째, mAP[IoU=0.5]는 0.973을 기록하였다. 이는 예측된 바운딩 박스와 실제 정답이 50% 이상 겹칠 때를 정답으로 간주하는 기준으로, 모델이 결함 객체를 놓치지 않고 찾아내는 기본 탐지 능력이 탁월함을 정량적으로 보여준다. 둘째, 더욱 엄격한 기준인 mAP[IoU=0.5:0.95]는 0.941(94.1 %)이라는 높은 수치를 달성하였다. 이 지표는 IoU 임계값을 0.5에서 0.95까지 0.05 단위로 높여가며 평균을 낸 것으로, 수치가 높을수록 모델이 예측한 박스가 실제 결함의 위치와 픽셀 단위로 정확하게 일치한다는 것을 의미한다[33]. 이는 본 연구의 핵심 목표인 SMT 공정에서 요구되는 정밀한 위치 탐지 성능을 충분히 만족함을 시사한다. 또한, 오검출(false positive)을 제어하는 정밀도(precision)는 0.968, 미검출(false negative)을 방지하는 재현율(recall)은 0.973으로 측정되었다. 제조 현장에서는 불량을 놓치는 것과 정상을 불량으로 오판하는 것 모두 비용 손실로 이어지는데, 본 모델은 두 지표 간의 균형을 높은 수준에서 유지하여 현장 적용성을 확보하였다.

4-3 실시간 추론 최적화 및 시스템 효율성 분석

본 연구는 고속 SMT 라인의 타임(takt time)을 준수하기 위해, 모델의 경량화뿐만 아니라 시스템 차원의 추론 속도 최적화에 중점을 두었다. 이를 검증하기 위해 소프트웨어 가속 기술 적용 전후의 성능을 비교하고, 시스템 오버헤드 및 하드웨어 환경에 따른 처리 속도를 정량적으로 분석하였다.

YOLOv8n 모델의 추론 속도를 극대화하기 위해 AMP (Automatic Mixed Precision)와 Layer Fusion 기술을 적용하였다. AMP는 연산 정밀도를 기존 FP32(32-bit Floating Point)에서 FP16(16-bit)으로 낮추어 처리하는 기술이다. 이는 모델의 정확도 손실을 최소화하면서도 메모리 대역폭 사용량을 절반으로 줄이고, NVIDIA Tensor Core의 연산 효율을 극대화하여 추론 속도를 가속화한다[31]. Layer Fusion는 연속된 연산 레이어인 합성곱, 배치 정규화, 활성화 함수를 하나의 커널로 융합하는 기법이다. 이를 통해 GPU 커널 실행 횟수와 메모리 접근 오버헤드를 줄여 연산 효율을 높였다[34]. 이러한 최적화를 적용한 결과, RTX A5000 환경 기준 순수 예측 시간(prediction time)은 이미지당 평균 0.079 초로 안정화되었다.

실제 공정 적용 시 전체 처리 시간을 단축하기 위해 시스템 단계별 소요 시간을 분석하였다(표 3). 총 352개의 테스트 이미지를 처리한 결과, 평균 총 처리 시간은 0.184 초로 측정되었다. 그러나 세부 분석 결과, 순수 모델 추론 시간은 0.079 초(42.9%)에 불과했으며, 나머지 약 57%의 시간은 디버깅을 위한 결과 이미지 그리기(draw, 0.053초)와 파일 저장(save, 0.024 초) 등 I/O 오버헤드에서 기인함을 확인하였다. 따라서 실제 양산 라인에서는 이러한 시각화 및 저장 프로세스를 제거하거나 비동기(asynchronous) 방식으로 처리할 수 있다. 이 경우 총 처리 시간은 0.107 초 수준으로 즉시 단축 가능하며, 이는 실시간 전수 검사를 수행하기에 충분한 성능이다.

4-4 하드웨어 환경별 성능 비교

다양한 현장 도입 시나리오를 고려하여 하드웨어 구성에 따른 추론 성능을 비교 분석하였다. 표 4의 결과와 같이, 고성능 서버인 RTX A5000 환경에서는 이미지당 약 0.095 초의 순수 추론 시간을 보인 반면, 메모리 오버클럭이 적용된 RTX 2080 SUPER 시스템에서는 이미지당 약 0.045 초의 순수 추론 시간으로 가장 빠른 처리 속도를 기록하였다. 이는 경량화된 모델의 실시간 추론에서는 GPU의 연산 능력뿐만 아니라, 데이터를 GPU로 빠르게 전송하는 CPU 성능과 시스템 메모리의 대역폭이 전체 성능을 결정짓는 중요한 병목 지점(bottleneck)임을 시사한다. 즉, 본 시스템은 고가의 서버급 GPU 없이도, 최적화된 PC 환경에서 충분히 22 FPS 이상의 실시간 성능을 발휘할 수 있어 비용 효율성이 우수함을 입증하였다[10]. 이러한 하드웨어별 성능 비교 결과는 제안된 모델이 특정 고성능 컴퓨팅 자원에 의존하지 않고, 사양이 다른 다양한 산업용 환경에서도 일관된 실시간 탐지 성능을 유지함을 보여준다. 이는 본 시스템의 범용성과 실제 제조 현장 도입 시의 일반화 성능을 뒷받침하는 근거가 된다.

4-5 학습 전략에 따른 단계별 정량적 기여도 분석

제안된 Mosaic, Mixup, close Mosaic 전략의 개별 기여도를 규명하기 위해 100 epoch의 학습 로그를 분석하였다. 학습 시작 후 1 epoch에서 mAP[IoU=0.5] 지표는 이미 0.932를 달성하였으며, 6 epoch 만에 0.985로 조기 수렴하였다. 이는 Mosaic 기법이 단일 배치 내 결함 객체 노출 밀도를 높여 데이터 불균형 환경에서도 핵심 특징을 신속히 학습시켰음을 입증한다. 7 epoch부터 90 epoch까지 mAP[IoU= 0.5:0.95]가 0.881에서 0.940까지 꾸준히 우상향하였다. 이는 Mixup 증강이 데이터의 다양성을 확보하여 모델의 성능을 높였음을 의미한다. Mosaic 증강이 비활성화되는 91 epoch 이후 학습 박스 위치 손실이 0.313에서 0.301로 추가 하락하며 안정화되었다. 인위적 왜곡을 제거함으로써 모델이 실제 PCB 기판의 미세 엣지 정보에 최적화되었고, 이를 통해 mAP[IoU=0.5:0.95] 0.941을 완성하였다.

Ⅴ. 결 론

5-1 산업용 자동화 검사에서의 효용성 및 신뢰도

본 연구의 실험 결과는 제안된 YOLOv8n 모델이 저해상도 SMT PCB 이미지에서도 5가지 유형의 결함을 정확하게 감지(detection), 위치 파악(localization) 및 분류(classification)할 수 있음을 보여준다. 모델은 각 결함에 대해 높은 확률 점수(probability score)를 제공하며, 이는 실제 제조 현장에서 작업자의 의사결정을 보조하는 근거가 된다. 기존의 산업용 제조 라인에서는 1차 자동 광학 검사(AOI) 후 불합격된 PCB를 작업자가 디지털 현미경으로 재검사하는 과정이 필수적이었다[35]. 본 연구에서 달성한 0.968의 정밀도(precision)는 이러한 수동 재작업의 빈도를 줄이고, 작업자가 결함의 종류와 위치를 사전에 인지한 상태에서 효율적인 조치를 취할 수 있도록 돕는다. 또한, 혼동 행렬 분석 결과 대부분의 결함이 정확하게 분류되었으며, 분류가 까다로운 왜곡이나 미세한 스크래치에 대해서도 0.90 이상의 높은 신뢰도를 유지하였다. 이는 본 시스템이 단순한 불량 판별을 넘어, 공정 상의 잠재적 결함 원인을 추적하는 데에도 기여할 수 있음을 시사한다.

5-2 경량 모델의 성능 우위와 현장 적용성

선행 연구에서 Faster R-CNN(ResNet 백본)과 같은 2단계 탐지 모델은 높은 정확도를 보이지만, 약 2,350만 개의 많은 파라미터와 느린 처리 속도로 인해 고속 생산 라인에 도입하기에는 제약이 있었다[9],[11]. 반면, 본 연구에서 제안한 모델은 약 300만 개(3.2M) 수준의 극도로 적은 파라미터만으로도 mAP 0.941의 고정밀 성능을 달성하였다. 특히, 0.079 초(RTX A5000)에서 최대 0.045 초(RTX 2080 Super)에 이르는 추론 속도는 고가의 하드웨어 증설 없이도 기존 생산 라인의 타임(takt time) 내에서 전수 검사가 가능함을 의미한다. 또한, 저해상도 이미지(1280 px)에서도 강건한 탐지 성능을 유지한다는 점은 고가의 광학 장비 교체 없이도 다양한 산업 현장에 즉시 적용 가능한 비용 효율적인 솔루션임을 입증한다.

5-3 데이터 증강 전략과 모델의 일반화 능력

본 연구의 비교 실험 결과는 데이터 증강 기법의 전략적 조합이 모델의 일반화 성능을 극대화함을 보여준다. 특히 Mosaic 증강은 소규모 데이터셋 환경에서도 모델이 과적합(overfitting)되지 않고 스퍼(spur)나 미세 이물질과 같이 탐지하기 어려운 결함 패턴을 학습하는 데 결정적인 역할을 수행하였다[8]. 또한, 학습 후반부에 Mosaic를 비활성화하는 전략(close Mosaic)은 모델이 인위적인 변형이 아닌 실제 공정 데이터의 분포에 정밀하게 적응하도록 유도하여 mAP [IoU=0.5:0.95] 지표를 최종 0.941까지 끌어올리는 데 기여하였다[32]. 이는 단순히 최신 모델을 사용하는 것을 넘어, 제조 데이터의 특성에 맞는 최적화된 학습 파이프라인 설계가 성능 향상의 핵심 요인임을 시사한다.

5-4 종합 결론 및 향후 연구 방향

본 논문에서는 SMT 제조 공정의 생산성을 저해하는 피듀셜 마크 인식 오류 문제를 해결하기 위해, 딥러닝 기반의 실시간 결함 탐지 프레임워크를 제안하였다. 이상적인 제조 공정은 결함이 발생한 후 이를 수정하는 것이 아니라, 공정 내에서 품질을 실시간으로 보증하고 결함의 원인을 즉각적으로 파악하여 예방하는 무결점 제조(zero defect manufacturing) 패러다임을 지향해야 한다. 본 연구에서 제안한 시스템은 이러한 패러다임 전환을 위한 핵심 기술로서, 제조 데이터의 고질적인 불균형 문제를 Mosaic 증강 기법으로 극복하고 경량화된 YOLOv8n 모델을 통해 실시간 검사 환경을 구현하였다.

실험 결과, 제안된 모델은 저해상도 이미지와 다양한 조명 환경에서도 mAP [IoU=0.5:0.95] 0.941, 정밀도 0.968의 탁월한 성능을 달성하여 5가지 유형의 결함을 효과적으로 분류하였다. 특히, 고가의 서버급 GPU가 아닌 일반적인 산업용 PC 환경(RTX 2080 SUPER)에서도 0.045 초(22 FPS)의 고속 추론이 가능함을 입증하였다. 이는 본 시스템이 별도의 고비용 하드웨어 증설 없이도 기존 생산 라인에 즉시 도입 가능한 비용 효율적인 솔루션임을 의미하며, 이를 통해 공정 자동화율을 높이고 수동 재작업 비용을 획기적으로 절감할 수 있을 것으로 기대된다.

본 연구의 성과에도 불구하고, 바운딩 박스(bounding box) 회귀 방식의 구조적 특성상 픽셀 단위의 극한 정밀도(pixel-level precision)를 완벽하게 보장하는 데에는 일부 기술적 한계가 존재하였다. 특히 결함 객체가 이미지 경계에 걸쳐 있는 경우 미세한 위치 오차가 발생할 수 있음을 확인하였다. 따라서 향후 연구에서는 이러한 한계를 극복하기 위해 객체의 윤곽을 픽셀 단위로 예측하는 인스턴스 분할(instance segmentation) 모델이나 중심점을 추적하는 키포인트 탐지(keypoint detection) 기법으로의 고도화를 진행할 계획이다. 아울러, 현재의 단일 레이어 검사를 넘어 다층 기판(multi-layered PCB)이나 다양한 표면 재질에 대한 일반화 성능을 검증하고, TensorRT와 같은 엣지 컴퓨팅 최적화 기술을 적용하여 스마트 팩토리 환경에서의 활용성을 더욱 확장해 나갈 것이다. 또한 본 연구는 통제된 제조 환경을 전제로 하여 데이터 분포 변화나 외부 노이즈에 대한 학술적 의미의 강건성(robustness) 검증에는 한계가 존재한다. 하드웨어 범용성을 통해 실무적 안정성을 소명하였으나, 향후 연구에서는 다양한 변칙적 환경 데이터를 포함한 OOD(out-of-distribution) 성능 평가를 통해 모델의 일반화 능력을 더욱 정밀하게 고도화할 계획이다.

Acknowledgments

본 연구는 2025년도 과학기술정보통신부 및 정보통신기획평가원의 SW중심대학지원사업의 연구 결과로 수행되었습니다.

References

- N. Manickam, Investigation of Pre and Post Reflow Solder Paste Depositions Using Theoretical, Simulated and Experimental Techniques, Ph.D. Dissertation, University of Technology Sydney, Sydney, Australia, July 2017.

-

D. Burr, “Solder Paste Inspection: Process Control For Defect Reduction,” in Proceedings of International Test Conference, Washington, DC, pp. 1036-1044, November 1997.

[https://doi.org/10.1109/TEST.1997.639726]

- IPC, Generic Requirements for Surface Mount Design and Land Pattern Standard, IPC, Technical Document IPC-7351B, pp. 1-102, June 2010.

-

R. P. Prasad, Surface Mount Technology: Principles and Practice, 2nd ed. Boston, MA: Springer, 1997.

[https://doi.org/10.1007/978-1-4615-4084-7]

-

J. Redmon, S. Divvala, R. Girshick, and A. Farhadi, “You Only Look Once: Unified, Real-Time Object Detection,” in Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas: NV, pp. 779-788, June 2016.

[https://doi.org/10.1109/CVPR.2016.91]

- T. Pyzdek and P. A. Keller, The Six Sigma Handbook, 5th ed. New York, NY: McGraw-Hill Education, 2018.

- N. Crasto, “Class Imbalance in Object Detection: An Experimental Diagnosis and Study of Mitigation Strategies,” arXiv:2403.07113, , 2024. https://arxiv.org/abs/2403.07113

- Ruman. YOLO Data Augmentation Explained: Turbocharge Your Object Detection Model [Internet]. Available: https://rumn.medium.com/yolo-data-augmentation-explained-turbocharge-your-object-detection-model-94c33278303a, .

- J. Hui. Object Detection: Speed and Accuracy Comparison (Faster R-CNN, R-FCN, SSD, FPN, RetinaNet and YOLOv3) [Internet]. Available: https://jonathan-hui.medium.com/object-detection-speed-and-accuracy-comparison-faster-r-cnn-r-fcn-ssd-and-yolo-5425656ae359, .

- ReadyTensor AI. Comparing YOLOv8, SSD, and Faster R-CNN for Real-Time Object Detection [Internet]. Available: https://app.readytensor.ai/publications/comparing-yolov8-ssd-and-fasterrcnn-for-realtime-object-detection-IbA4gAvuaYW8, .

- S. Ren, K. He, R. Girshick, and J. Sun, “Faster R-CNN: Towards Real-Time Object Detection With Region Proposal Networks,” in Proceedings of the 29th International Conference on Neural Information Processing Systems (NIPS), Montreal, Canada, pp. 91-99, December 2015.

-

W. A. Shobaki and M. Milanova, “A Comparative Study of YOLO, SSD, Faster R-CNN, and More for Optimized Eye-Gaze Writing,” Sci, Vol. 7, No. 2, pp. 47-55, April 2025.

[https://doi.org/10.3390/sci7020047]

-

Y. Su, D. Li, and X. Chen, “Lung Nodule Detection Based on Faster R-CNN Framework,” Computer Methods and Programs Biomedicine, Vol. 200, 105866, March 2021.

[https://doi.org/10.1016/j.cmpb.2020.105866]

-

H. Jiang and E. Learned-Miller, “Face Detection With The Faster R-CNN,” in Proceedings of the 12th IEEE International Conference on Automatic Face & Gesture Recognition (FG), Washington, DC, pp. 650-657, May 2017.

[https://doi.org/10.1109/FG.2017.82]

-

Q. Liu, L. Dong, Z. Zeng, W. Zhu, Y. Zhu, and C. Meng, “SSD with Multi-Scale Feature Fusion and Attention Mechanism,” Scientific Reports, Vol. 13, No. 1, pp. 21544-21551, December 2023.

[https://doi.org/10.1038/s41598-023-41373-1]

-

S. Kanimozhi, G. Gayathri, and T. Mala, “Multiple Real-Time Object Identification Using Single Shot Multi-Box Detection,” in Proceedings of 2019 International Conference on Computational Intelligence in Data Science (ICCIDS), Chennai, India, pp. 1-5, February 2019.

[https://doi.org/10.1109/ICCIDS.2019.8862041]

-

A. Kumar and S. Srivastava, “Object Detection System Based on Convolution Neural Networks Using Single Shot Multi-Box Detector,” Procedia Computer Science, Vol. 171, pp. 2610-2617, 2020.

[https://doi.org/10.1016/j.procs.2020.04.283]

-

M. Ali, C. Keller, and M. Huang, “Fruits Detections Using Single Shot MultiBox Detector,” in Proceedings of the 5th ACM International Symposium on Blockchain and Secure Critical Infrastructure (BSCI '23), Melbourne, Australia, pp. 140-144, June 2023.

[https://doi.org/10.1145/3594556.3594619]

-

A. Kolekar and V. Dalal, “Barcode Detection and Classification Using SSD (Single Shot Multibox Detector) Deep Learning Algorithm,” in Proceedings of the 3rd International Conference on Advances in Science & Technology (ICAST), Mumbai, India, pp. 1-5, October 2020.

[https://doi.org/10.2139/ssrn.3568499]

- M. Yaseen. What Is YOLOv8: An In-Depth Exploration of the Internal Features of the Next-Generation Object Detector [Internet]. Available: https://arxiv.org/html/2408.15857v1, .

-

M. Kang, C.-M. Ting, F. F. Ting, and R. C.-W. Phan, “BGF-YOLO: Enhanced YOLOv8 with Multiscale Attentional Feature Fusion for Brain Tumor Detection,” in Proceedings of the 27th International Conference on Medical Image Computing and Computer-Assisted Intervention - MICCAI 2024, Marrakesh, Morocco, pp. 35-45, October 2024.

[https://doi.org/10.1007/978-3-031-72111-3_4]

- B. Khalili and A. W. Smyth. SOD-YOLOv8 - Enhancing YOLOv8 for Small Object Detection in Traffic Scenes [Internet]. Available: https://arxiv.org/html/2408.04786v1, .

-

W. C. Shia and T. H. Ku, “Enhancing Microcalcification Detection in Mammography with YOLO-v8 Performance and Clinical Implications,” Diagnostics, Vol. 14, No. 24, pp. 2875-2882, December 2024.

[https://doi.org/10.3390/diagnostics14242875]

-

H. Lan, H. Zhu, R. Luo, Q. Ren, and C. Chen, “PCB Defect Detection Algorithm of Improved YOLOv8,” in Proceedings of the 8th International Conference on Image, Vision and Computing (ICIVC), Dalian, China, pp. 178-183, 2023.

[https://doi.org/10.1109/ICIVC58118.2023.10270049]

-

H. Wang, X. Guo, S. Zhang, G. Li, Q. Zhao, and Z. Wang, “Detection and Recognition of Foreign Objects in Pu-erh Sun-Dried Green Tea Using an Improved YOLOv8 Based on Deep Learning,” PLoS One, Vol. 20, No. 1, pp. e0312112-e0312118, January 2025.

[https://doi.org/10.1371/journal.pone.0312112]

- Microsoft VoTT. Visual Object Tagging Tool [Internet]. Available: https://github.com/microsoft/VoTT, .

- Microsoft. Label Images for Object Detection Using VoTT [Internet]. Available: https://learn.microsoft.com/en-us/dotnet/machine-learning/how-to-guides/label-images-for-object-detection-using-vott, .

- UnitLab. 7 Top Open-Source Image Annotation Tools in 2026 – Pros & Cons [Internet]. Available: https://blog.unitlab.ai/7-top-open-source-image-annotation-tools-of-2024-reviewed/, .

-

E. D. Cubuk, B. Zoph, J. Shlens, and Q. V. Le, “RandAugment: Practical Automated Data Augmentation with a Reduced Search Space,” arXiv:1909.13719, , 2019.

[https://doi.org/10.1109/CVPRW50498.2020.00359]

-

X. Li, Y. Chen, X. Liu, Z. Qin, J. Wan, and Q. Yan, “RCF-YOLOv8: A Multi-Scale Attention and Adaptive Feature Fusion Method for Object Detection in Forward-Looking Sonar Images,” Remote Sensing, Vol. 17, No. 19, pp. 3288-3296, September 2025.

[https://doi.org/10.3390/rs17193288]

- NVIDIA Developer. Automatic Mixed Precision [Internet]. Available: https://developer.nvidia.com/automatic-mixed-precision, .

- Ultralytics Docs. Tips for Best Training Results [Internet]. Available: https://docs.ultralytics.com/yolov5/tutorials/tips_for_best_training_results/, .

- DataCamp. YOLO Object Detection Explained [Internet]. Available: https://www.datacamp.com/blog/yolo-object-detection-explained, .

- M. Jeon. Quantization: Go Faster with ReLu YOLOv8-QAT X2 Speed Up on Your Jetson Orin Nano 3 [Internet]. Available: https://medium.com/@MaroJEON/quantization-go-faster-with-relu-yolov8-qat-x2-speed-up-on-your-jetson-orin-nano-3-4d4733c9e435, .

-

A. Bhattacharya and S. G. Cloutier, “End-to-End Deep Learning Framework for Printed Circuit Board Manufacturing Defect Classification,” Scientific Reports, Vol. 12, No. 1, pp. 12559-12567, July 2022.

[https://doi.org/10.1038/s41598-022-16302-3]

저자소개

2025년: 주식회사 씽크윈텍(인턴십)

2023년∼현 재: 선문대학교 컴퓨터공학부 학사과정

※관심분야:인공지능, 가상현실, 실시간 의사 결정 시스템, 뇌공학 등

2024년: 삼정KPMG (인턴십)

2024년∼2025년: 주식회사 Acai Block

2025년: 주식회사 씽크윈텍(인턴십)

2023년∼현 재: 선문대학교 컴퓨터공학부 학사과정

※관심분야:Web 개발, 데이터 분석 등

1998년:선문대학교 전자계산학과 (이학사)

2002년:선문대학교 대학원 전자계산학과 (이학석사)

2010년:The CSE Department of the Univ. of Texas at Arlington (공학박사)

2011년: DGIST 로봇시스템 연구부 선임연구원

2012년∼현 재: 선문대학교 컴퓨터공학과 교수

2021년∼현 재: BK21+ 바이오 빅데이터기반 충남 스마트클린 전문인력양성사업단

※관심분야:실시간 의사결정시스템, 자율컴퓨팅, 휴먼케어 시스템, 바이오 빅데이터 분석 등 초거대 데이터 기반 인공지능 활용분야 등

2009년:건국대학교 (학사)

2012년:네바다 대학교 라스베이거스(UNLV) 컴퓨터공학 (석사)

2018년:네바다 대학교 라스베이거스(UNLV) 컴퓨터공학 (박사)

2018년∼2020년: 위스콘신 대학교 화이트워터 (UW-Whitewater) 컴퓨터공학과 조교수

2020년∼2021년: 그랜드 밸리 주립 대학교(GVSU) 컴퓨터정보시스템학부 조교수

2021년∼현 재: 선문대학교 컴퓨터공학부 부교수

※관심분야:모바일 헬스, 빅데이터, 데이터 사이언스, 웹 서비스 등