딥페이크 및 가짜 뉴스 정보 왜곡에 대한 대응 방안: 영상 진위 검증을 통한 신뢰성 확보

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

AI 생성 콘텐츠, 특히 딥페이크 영상과 가짜 뉴스로 인한 정보 왜곡 문제에 대응하기 위해 메타데이터 및 전자서명을 사용한 영상 진위 검증 시스템을 제안한다. 원본 영상으로부터 세그먼트 단위 해시와 Merkle root를 생성하고, 이를 핵심 메타데이터와 암호학적 해시를 결합하여 신뢰 키로 서명한 뒤 검증 서버에 저장한다. 영상 재생 시 사용자 인터페이스를 통해 위조 여부를 실시간 확인할 수 있다. 실험 결과, 실제 딥페이크 사례 환경에서 판별 정확도를 약 21.5% 포인트 향상시키고 반응시간을 평균 1.6초 ± 0.4 단축하였다. 또한 ROC-AUC는 0.641로 나타나 무작위 수준을 유의하게 상회하였다. 이러한 결과는 제안 체계가 무결성 보장을 넘어 사용자 신뢰를 강화하고, 딥페이크 대응 및 안전한 영상 정보 유통 구조를 위한 기반 인프라로서 의의를 가진다.

Abstract

This study proposes a video-authenticity verification system using metadata and digital signatures to mitigate information distortion from artificial intelligence-generated content such as deepfakes and fake news. The framework generates segment-level hashes and a Merkle root from the original video, combines them with core metadata and cryptographic hashes, and signs the resulting trust key before storing it on a verification server. During playback, users can verify the authenticity in real time based on an intuitive interface displaying verification status. Experiments under deepfake scenarios show that the system improved detection accuracy by approximately 21.5 percentage points and reduced the average response time by 1.6 ± 0.4 s. The receiver operating characteristic-area under the curve of 0.641 exceeded random performance results, thus confirming that the proposed framework ensures content integrity and enhances user trust. These results show the potential of the proposed system as a foundational infrastructure for secure video information distribution and reliable deepfake countermeasures.

Keywords:

Metadata, Deepfake Detection, Information Authenticity, Provenance, Interoperability키워드:

메타데이터, 딥페이크 탐지, 정보 진위성, 출처 증명, 상호운용성Ⅰ. 서 론

최근 생성형 인공지능의 발전은 영상 합성 기술의 혁신을 이끌었으며, 특히 딥페이크 기술은 사회적 파급력과 위험성을 동시에 지니고 있다. 실제와 거의 구분이 어려운 합성 영상을 통해 정치적 조작, 범죄, 허위정보 유포가 확산되면서, 영상 기반 정보의 신뢰도는 심각하게 흔들리고 있다. 기존 대응은 주로 AI 탐지 모델을 활용하는 방식으로, 프레임 불연속성이나 얼굴 특징 등을 분석해 합성 여부를 식별한다. 그러나 이러한 접근은 대규모 연산 자원을 요구하여 실시간성이 부족하고, 특정 데이터셋 편향으로 인한 일반화 한계가 있으며, 기술 발전 속도를 따라잡기 어려운 구조적 제약이 존재한다. 결국 단순 탐지 위주의 대응은 기술 추격전에 머무를 수밖에 없다. 이에 본 연구는 콘텐츠 생성 및 유통 과정에서의 출처 증명을 중심으로 하는 대안을 제시한다. 구체적으로 영상 메타데이터의 해시값과 전자서명을 활용하여 원본성을 검증하고, 그 결과를 사용자 인터페이스를 통해 직관적으로 제공하는 시스템을 설계 및 구현하였다.

본 논문의 기여는 메타데이터를 촬영 시점에서 자동으로 추출하고 이를 해시화한 뒤 전자서명과 결합하여 위조 및 변조를 방지하는 통합 구조를 제안한 데 있으며, 나아가 저장과 검증 과정 전반에 투명성 로그를 도입함으로써 추적성과 감사 가능성을 동시에 확보하였다. 또한 검증 결과를 사용자에게 제공하는 과정에서 각 상태를 직관적으로 구분할 수 있는 UI (user interface) 마크를 설계하여 인지적 신뢰성을 높였고, 이를 단순한 기술적 성능 검증에 그치지 않고 실제 사용자 신뢰 형성 효과까지 분석함으로써 기술적 및 사회적 측면을 아우르는 다층적 평가를 수행하였다. 이러한 일련의 시도는 영상 콘텐츠의 무결성 보장과 신뢰 기반 검증 체계 구축을 위한 새로운 가능성을 열어주며, 향후 디지털 정보 환경에서 보다 실질적이고 지속 가능한 대응 전략을 마련하는 데 기초가 될 것이다.

본 논문은 2장에서는 관련 연구에 관해서 설명하고, 3장에서는 시스템 제안 배경과 필요성을 상세히 기술한다. 4장에서는 기술적 성능 분석에 대해 설명한다. 마지막으로 제5장에서는 결론에 대해 서술하였다.

Ⅱ. 관련 연구

2-1 딥페이크 생성 / 탐지 개관

딥페이크 생성 기술은 초기의 GAN 및 VAE 기반 합성에서 시작하여, 최근에는 확산 모델 및 멀티모달 생성 방식으로 진화하고 있다. 예를 들어 GAN / StyleGAN 시리즈는 얼굴 특성 조정, 얼굴 스왑, 얼굴 재연 등의 영역에서 탁월한 사실성을 보여주고 있으며[1], Diffusion 기반 모델은 정제된 세부 묘사와 표현 다양성에서 한계를 크게 줄이고 있다[2]. 탐지 기술 측면에서는 CNN 및 RNN, Transformer 기반 모델들이 프레임 간 불연속성, 얼굴 특징의 왜곡, 눈 깜빡임, 음성과 영상의 동기화 불일치 등 다양한 특징을 학습함으로써 합성 여부를 판별해 왔다[3]. 그러나 이러한 접근들은 다음과 같은 한계점을 가진다. 먼저, 새로운 생성 방식에 대해 일반화가 약하다. 학습한 데이터셋 외 변환이나 편집이 가해진 경우 탐지율이 크게 낮아지는 경우가 많다[4]. 또한, 저해상도, 압축, 코덱 변환 등의 품질 저하에 매우 민감하여, 실제 SNS (social network service) / 메신저 공유 환경에서는 탐지 정확도가 하락한다[5]. 마지막으로, 연산 비용과 실시간 처리의 제약, 특히 모바일이나 스트리밍 환경에서의 적용에서 어려움이 지적된다[6].

2-2 영상 조작 기술 고도화와 검증 필요성

영상 조작 기술은 전통적 합성에서부터 인공지능 기반 합성으로 발전하면서 신뢰 검증의 필요성을 점점 더 부각시켰다. 1990년대 후반과 2000년대 초반에는 크로마키, 포아송 블렌딩과 같은 전통적 기법이 활용되었고, 이는 주로 배경 합성이나 간단한 객체 제거에 국한되었다. 이후 2010년대 GAN 기반 합성, Face2Face, DeepFaceLab과 같은 툴이 등장하면서 전문가가 아닌 일반 사용자도 고품질 합성을 구현할 수 있게 되었다. 이러한 변화가 탐지 연구에 새로운 과제를 제시한다고 분석하며, 특히 단순한 시각적 위조가 아니라 오디오와 비디오 동기화, 다중 변환 조합 등 복합적 편집이 가능해지면서 기존 탐지 모델의 취약성이 심화되었다고 지적한다[7]. 또한, 다양한 미디어 포맷과 변환 조건에서 탐지율이 급격히 떨어지는 문제를 실험적으로 확인하며, 현실적인 콘텐츠 유통 환경을 고려하지 않은 실험 설계가 주요 원인임을 제시한다[8]. 따라서 연구 초점은 단순 탐지 성능의 향상에서 나아가, 다양한 변환 조건을 체계적으로 고려한 강건 검증 기준을 마련하는 데 있다. 본 논문은 이 같은 맥락에서 실험의 객관성을 고려하여 코덱 변환, 해상도 변경, 비트레이트 조정, 필터 적용 등 현실적 시나리오를 반영한 다수의 변환 조건을 설계하고, 각 조건별 검증율 곡선을 제시함으로써 시스템의 성능을 다각도로 평가하였다. 또한, 지각 해시와 같은 경량 유사성 판정 기법을 보조적으로 결합하여 경미한 편집이나 재인코딩과 같이 원본과의 미세한 차이가 발생하는 경우에는 허용 가능한 수준의 유사성 정책을 적용하였다. 이를 통해 불필요한 오탐을 줄이면서도 실질적인 신뢰성을 유지할 수 있는 검증 구조를 제안한다.

2-3 디지털 콘텐츠 출처 검증을 위한 기술적 흐름

딥페이크 탐지의 기술적 한계가 분명해짐에 따라, 출처 증명을 중심으로 한 대응 체계를 구축하고 있다. 대표적으로 Adobe, Microsoft, BBC 등이 참여하는 C2PA (coalition for content provenance and authenticity)는 콘텐츠 제작 단계에서부터 메타데이터와 전자서명을 삽입하고, 유통 전 과정에서 변경 이력을 추적할 수 있는 Content credentials 표준을 마련하였다[9]. 이는 탐지 위주의 사후적 대응을 넘어, 생성 단계에서부터 신뢰를 확보하려는 국제적 흐름의 일환이다. 그러나 이러한 표준은 실제 적용에 있어 몇 가지 제약이 존재한다. 먼저, 플랫폼이나 소셜미디어 업로드 과정에서 메타데이터가 제거되거나 변형되는 사례가 빈번해, 출처 정보가 유실될 수 있다. 또한, 표준이 제공하는 메타데이터 속성이 충분히 상세하지 않거나, 서명자와 검증자 간 신뢰가 명확히 확립되지 않은 경우 제도적 효과가 제한적이다. 마지막으로 국제 표준을 실제 워크플로우에 적용하기 위해서는 인프라 도입 비용과 기존 제작 및 유통 체계 변경이라는 부담이 따른다. 최근 연구와 산업계의 논의에서는 C2PA 표준을 단일 기술로 한정하지 않고, 투명성 로그, TEE (trusted execution environment) / SE (secure element) 기반 키 인증 등과 연계하여 상호운용성을 강화하는 방향이 제시되고 있다. 투명성 로그는 모든 검증 이벤트를 삭제 불가능한 구조로 기록하여 감사 가능성을 확보하며, TEE / SE 기반 키 인증은 콘텐츠 생성 장치 자체가 신뢰할 수 있는 환경에서 서명을 수행했음을 보증한다. 이러한 요소들은 C2PA의 메타데이터와 서명 구조를 보완하며, 장기적으로는 국제 표준 간 상호운용성의 기준선으로 논의되고 있다. 본 논문은 이러한 국제적 표준화 흐름과 연계하여, 메타데이터 해시값과 전자서명을 기반으로 한 경량 검증 구조를 설계하고자 한다. 특히 투명성 로그를 도입해 저장 및 검증 전 과정을 추적 가능하게 하고, 사용자 인터페이스에서는 원본 및 경고의 2가지 검증 마크를 제공하여 신뢰 여부를 직관적으로 전달한다. 이를 통해 단순 기술적 성능 평가에 그치지 않고 사용자 신뢰 형성 효과까지 함께 고려하는 이중적 분석 체계를 제시함으로써, C2PA를 비롯한 국제 표준과의 상호운용성, 그리고 실제 플랫폼 적용 가능성을 동시에 확보하고자 한다.

Ⅲ. 시스템 아키텍처 설계 및 기술적 구현 방법

딥페이크와 가짜뉴스의 확산은 정보 생태계 전반의 신뢰 기반을 위협하는 구조적 문제로 부상하였다. 기존 AI 탐지 모델은 정밀도가 지속적으로 향상되고 있음에도 불구하고, 새로운 합성 기법이 등장할 때마다 추격전의 한계를 드러낸다. 이러한 한계를 보완하기 위해 본 연구는 영상의 생성부터 최종 소비까지 전 주기를 포괄하는 파이프라인 기반 진위 검증 체계를 제안한다. 본 시스템은 단순한 탐지 기술을 넘어, 최소한의 데이터만을 검증에 활용하고, 민감정보를 배제하여 보안성과 프라이버시 원칙을 강화한다. 또한 표준화된 포맷과 API 기반 구조를 채택하여 다양한 플랫폼 및 기관 환경과의 상호운용성을 내재화하였다. 이를 통해 실제 배포 및 확산 과정에서의 적용 가능성을 높이고, 사용자 친화적 인터페이스를 통해 검증 결과를 직관적으로 제공한다. 궁극적으로, 본 연구는 합성 탐지의 불확실성을 줄이고, 디지털 콘텐츠의 신뢰 회복에 기여할 수 있는 실질적이고 확장 가능한 대안을 제시하고자 한다.

3-1 파이프라인 구조와 동작 절차

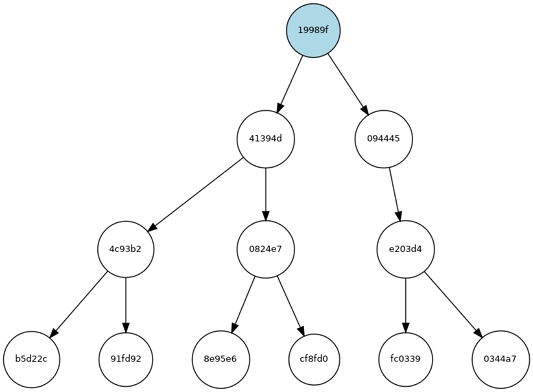

본 연구에서 제안하는 검증 체계는 입력, 처리, 저장, 출력의 네 단계로 구성된 파이프라인을 중심으로 설계되었다. 각 단계는 단순한 무결성 검증을 넘어, 보안 및 프라이버시 보장과 상호운용성 확대를 목표로 한다. 또한, 실험적 구현에서는 데이터베이스 기반 운영을 통해 성능을 확인하였고, 장기적으로는 거버넌스 및 감사 체계로 확장 가능성을 모색하였다. 먼저, 입력 단계에서 사용자는 전용 촬영 애플리케이션을 통해 원본 영상을 촬영하며, 데이터는 세그먼트 단위로 분할된다. 각 세그먼트는 SHA-256 해시로 변환되고, 해시값들은 그림 1과 표 1처럼 Merkle 트리로 집계되어 최종적으로 Merkle root가 산출된다.

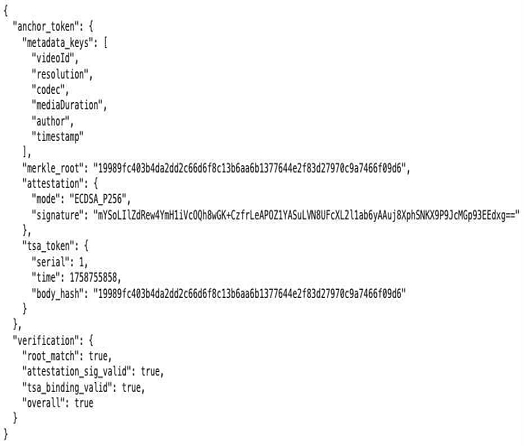

이를 통해 대용량 영상 전체를 직접 처리하지 않고도 세그먼트 단위에서 무결성을 효율적으로 검증할 수 있다. 동시에 촬영 시점의 메타데이터는 표준화 과정을 거쳐 JSON (javascript object notation) 구조로 직렬화된다. 이는 다양한 플랫폼 간 상호운용성을 보장하며, 후속 단계에서 포맷 불일치로 인한 오류를 방지한다. 처리 단계에서는 입력 단계에서 생성된 Merkle root와 핵심 메타데이터는 결합되어 서명된다. 본 시스템은 장치의 TEE기반 키 활용을 원칙으로 하며, 이는 하드웨어 레벨에서 키 보호와 안전한 연산을 수행하여 보안성을 높인다. 그러나 실제 배포 환경에서는 모든 디바이스가 TEE를 지원하지 않는 경우가 존재하므로, 이러한 제약을 보완하기 위해 소프트웨어 키 서명인 ECDSA (elliptic curve digital signature algorithm) / HMAC (hash-based message authentication code) 그리고 Mock Attestation 절차를 병행하였다. 소프트웨어 키는 TEE나 SE와 같은 하드웨어 보안 모듈이 없는 환경에서 소프트웨어적으로 생성된 개인키를 이용하여 Merkle Root와 핵심 메타데이터를 전자서명함으로써, 해당 영상이 실제 원본 영상임을 증명하는 절차를 수행한다. 개인키는 시스템 내에서 암호화된 형태로 안전하게 저장된다. 이러한 구조를 통해 하드웨어 기반 보안이 제공되지 않는 환경에서도 일정 수준의 출처 인증과 데이터 무결성 보장을 실현할 수 있다. 추가적으로, 서명된 데이터에는 신뢰할 수 있는 타임스탬프가 결합된다. 이는 TSA (time stamping authority)가 발급한 시점 서명을 통해 특정 시각에 데이터가 존재했음을 입증하는 절차로, 생성 시점이 명확히 기록되어 이후 검증 과정에서 위조 및 변조 여부와 시간적 정합성을 동시에 확인할 수 있다. 이러한 구조는 단순한 해시 기반 무결성 확인을 넘어, 데이터의 출처 인증 기능까지 수행한다는 점에서 의의가 있다. 구체적으로는, 입력 메타데이터가 세그먼트 단위로 SHA-256 해싱되고, 이 해시들을 집약하여 Merkle root가 산출된다. 이후 소프트웨어 키는 Merkle root와 핵심 메타데이터를 묶어 Attestation 서명을 수행하며, 이 서명된 바디 해시가 TSA로 전달되어 시각 및 시리얼 정보와 함께 새로운 토큰으로 확정된다. 최종적으로, 장치 서명과 TSA 시점 서명이 결합된 결과물이 Anchor trust JSON 토큰으로 번들링되어 저장 및 배포된다. 검증자는 이 토큰을 수신하면 Merkle root를 재계산하고, 서명 및 시점 바인딩 검증을 수행하여 데이터의 무결성과 출처를 동시에 확인한다. 따라서 본 연구의 처리 단계는 단일 기능인 무결성 검증에 머무르지 않고, 소프트웨어 키 서명과 Mock attestation 및 TSA 시점 서명을 유기적으로 결합함으로써 출처 신뢰를 체계적으로 구현한다. 이러한 통합적 구조는 향후 실제 플랫폼 환경에서 표준화된 출처 인증 체계로 발전할 수 있는 토대를 제공한다. 저장 단계에서는 생성된 Merkle root, 서명 데이터, 핵심 메타데이터는 중앙 데이터베이스에 저장되며, 동시에 검증 이력은 투명성 로그에도 기록되어 외부 검증자가 감사 증명을 통해 변조 여부를 확인할 수 있다. 실험적 구현에서는 빠른 조회와 비교를 위해 관계형 데이터베이스 기반 구조를 활용하였으며, 확장 시에는 블록체인 원장 기록을 결합해 분산 거버넌스와 장기적 신뢰성을 확보할 수 있다. 특히, 본 연구에서는 저장 단계에서 단순한 데이터 보관을 넘어, Anchor trust JSON 토큰을 함께 생성하고 이를 출력하도록 설계하였다. 이 토큰에는 그림 2처럼 입력 단계에서 생성된 Merkle root, 장치 서명, TSA의 시점 서명 정보가 모두 포함되며, 검증자는 이를 기반으로 루트 일치 여부, 장치 서명 무결성, TSA 시점 바인딩, 전체 종합 검증 결과를 즉시 확인할 수 있다. 또한, 장기적인 운영 환경에서 신뢰성을 보장하기 위해 키 회전 및 키 폐기 정책을 병행하였다. 키 회전은 주기적으로 새로운 키 쌍을 발급하여 기존 키를 점진적으로 대체하는 절차로, 장기간 동일 키 사용으로 인한 보안 약화를 방지한다. 반면 키 폐기는 침해 가능성이 있거나 만료된 키를 더 이상 검증 체계에서 인정하지 않도록 하는 절차를 의미한다. 이 두 정책을 결합하면, 공격자가 과거 유출된 키를 이용하여 위조 데이터를 생성하더라도 검증 체계에서 신뢰하지 않게 되어 안전성이 크게 향상된다. 더 나아가, 이러한 키 관리 절차는 국제 표준인 PKI (public key infrastructure) 운영 모델과 정합성을 가지며, 실제 플랫폼 환경에서의 실효성을 확보할 수 있다. 마지막으로 출력 단계에서는 기존의 영상 소비 환경에서 일반 사용자들이 원본 영상과 인공지능을 통해 합성된 영상을 시각적으로 구별하는 데 한계가 존재하였다. 실제로 동일한 장면을 원본 영상과 AI 합성 영상으로 병치하여 제시할 경우, 비전문가 혹은 일반 이용자는 두 영상 중 어느 것이 원본인지 판단하기 어려운 사례가 빈번하게 발생하였다.

예를 들어 그림 3과 같이 애견카페에서 촬영된 원본 영상에는 강아지의 모습이 담겨 있었으나, 그림 4의 AI 합성 영상에서는 동일한 장소에서 고양이의 모습이 삽입되어 이용자 입장에서는 해당 장소가 애견카페인지 혹은 고양이 카페인지 혼선을 줄 수 있다. 이와 같은 문제는 영상의 사실성과 맥락에 대한 신뢰도를 저하시켜, 정보 소비자에게 잘못된 인식을 심어줄 수 있는 위험을 내포한다. 이러한 인지적 한계를 극복하기 위해 본 연구에서 원본 영상에는 사용자 인터페이스에 초록색의 방패 모양의 인증 아이콘을 삽입하는 방식을 채택하였다. 구체적으로, 그림 5와 같이 원본 영상으로 판정된 경우에는 우측 상단에 초록색 방패 아이콘이 표시되며, 이는 변형되지 않은 원본 영상임을 직관적으로 나타낸다. 반대로, 그림 6과 같이 서버에 저장된 해시값과 불일치가 발생하여 위변조 또는 AI 합성 가능성이 있는 영상은 노란색으로 경고 아이콘이 표출되도록 설계하였다. 초록색은 보안성과 신뢰를, 노란색은 주의 혹은 경고하는 신호로써, 국제적으로 통용되는 시각적 기호 체계와 부합한다. 이러한 색상 기반의 상태 구분은 사용자가 별도의 전문지식 없이도 즉시 영상의 진위 상태를 인지할 수 있도록 돕는다. 또한, 사용자가 영상을 재생할 때 세그먼트 단위 해시를 실시간으로 재계산하고 서버에 저장된 원본 값과 비교하는데 일치할 경우 초록색 방패 아이콘이 활성화되며, 불일치 시 노란색 경고 아이콘으로 대체된다. 따라서 아이콘의 색상 변화는 단순한 UI 요소가 아니라, 실질적 데이터 검증 절차의 결과를 시각적으로 매핑한 것이라 할 수 있다.

이와 같은 시스템은 딥페이크 및 합성 영상의 확산으로 인한 사회적 혼란을 완화하는 효과를 기대할 수 있다. 특히 영상 소비자가 직관적이고 즉각적으로 진위 여부를 파악함으로써, 정보 신뢰성 제고에 기여할 수 있다. 나아가 아이콘 클릭 시 QR 코드, 팝오버 UI를 통해 상세 검증 근거를 열람할 수 있게 설계하여, 투명한 근거 데이터를 제공한다. 이로써 신뢰성 검증이 단순 기술적 기능에 그치지 않고, 사용자 경험 차원에서도 효과적으로 확산될 수 있다.

3-2 보안 및 프라이버시 보호 원칙

본 시스템의 설계는 콘텐츠 진위 검증뿐만 아니라, 보안성과 프라이버시 보호를 동시에 충족하는 데 초점을 두었다. 이는 장기적으로 사용자 신뢰를 확보할 수 있는 제도적인 정당성을 제공하기 위함이다. 먼저, 키 관리는 디바이스의 하드웨어 보호 영역인 TEE / SE에서 생성 및 보관되며, 외부에 노출되지 않는다. 이와 같은 구조는 비밀키가 외부 메모리나 응용 계층으로 유출될 가능성을 원천 차단하며, 원격 검증을 통해 해당 키가 신뢰할 수 있는 장치 내에서 생성 및 운용되었음을 증명할 수 있다. 이러한 절차는 메타데이터 서명 값의 신뢰 근거로 작동하여, 단순 무결성 검증을 넘어 출처 보증을 가능하게 한다. 다만, 모든 기기가 하드웨어 보안 모듈을 탑재하지는 않기 때문에, TEE 활용이 불가능한 환경에서는 소프트웨어 키를 사용하도록 하였다. 이 경우에도 주기적인 키 회전 및 키 폐기 정책을 강제 적용함으로써, 장기간 동일 키 사용으로 인한 보안 취약성을 완화한다. 다음으로 개인정보 최소화 원칙을 철저히 준수한다. 수집되는 메타데이터는 콘텐츠 검증과 직접적으로 관련된 항목에 한정되며, 개인을 직접 식별할 수 있는 요소는 최대한 배제된다. 특히 위성 항법 장치 (GPS; global positioning system) 정보는 사용자가 명시적으로 동의한 경우에만 포함되며, 이외의 경우에는 저장되지 않는다. 또한, 불가피하게 포함되는 경우에도 익명화 및 가명화 기법을 적용하여 재식별 위험을 최소화한다. 또한, 목적 제한성과 보존 기간을 명확히 규정한다. 본 시스템에서 수집된 메타데이터와 서명 값은 오직 콘텐츠의 진위 검증이라는 목적에만 활용되며, 법적 및 정책적 근거가 없는 한 제3자에게 제공되지 않는다. 데이터는 사전에 정의된 검증 유효 기간 내에서만 보관되며, 만료 시 안전 삭제 정책을 적용하여 재사용 가능성을 원천 차단한다. 이를 통해 데이터가 과도하게 축적되거나 오용되는 것을 방지한다. 마지막으로 투명성 확보를 중요한 원칙으로 삼았다. 검증 서버와 투명성 로그는 모든 접근 및 처리 내역을 기록하며, 이 기록은 외부 감사자가 검증할 수 있도록 설계된다. 사용자는 QR 코드나 팝오버 인터페이스를 통해 자신이 소비하는 콘텐츠의 검증 근거를 직접 열람할 수 있다. 이러한 구조는 검증 기술의 신뢰성을 사용자 경험 차원에서 체감할 수 있도록 한다.

3-3 상호운용성과 확장성

본 연구에서 제안하는 영상 진위 검증 체계가 실제 플랫폼 환경에서 효과적으로 채택되기 위해서는 다양한 미디어 스트리밍 포맷과의 상호운용성이 핵심적이다.

현재 글로벌 서비스에서 폭넓게 사용되는 대표적인 포맷은 표 2처럼 MP4의 ISO (international organization for standardization) BMFF (base media file format), ISM (internet server media)의 Smooth streaming, HLS (http live streaming), MPEG-DASH이며, 각각의 포맷은 구조적 및 보안적 특성이 다르기 때문에 표준화된 검증 메커니즘을 도입하기 위해서는 차별적인 정책적 고려가 필요하다. 우선 MP4는 ISO 표준 기반의 컨테이너로, Merkle root와 전자서명을 안전하게 확장 박스에 포함시키는 것이 가능하다. 이를 통해 기존 디코딩 프로세스에 영향을 주지 않으면서도 출처 검증 정보를 보존할 수 있다. ISM은 마이크로소프트의 Smooth streaming 환경에서 활용되며, DRM (digital rights management) 체계와의 충돌을 피하는 것이 중요하다. 따라서 메타데이터의 해시와 키 식별자는 DRM 보호 구조와 병행 운용될 수 있도록 설계되어야 한다. HLS는 애플의 대표적 스트리밍 방식으로, 비교적 단순한 태그 구조를 활용한다. 본 연구에서는 JSON 기반의 서명 및 타임스탬프 바인딩을 제안하였으며, 저대역폭 환경에서도 안정적으로 동작할 수 있도록 태그 확장성에 대한 검증이 필요하다. 마지막으로 MPEG-DASH는 국제 표준으로서 널리 채택되고 있으며, 외부 참조 URI (uniform resource identifier)를 통한 서명 값 제공 방식을 통해 CMAF (common media application format)와의 호환성을 유지할 수 있다. 이는 다양한 기기 및 서비스 환경에서 동일한 절차로 검증 가능성을 확보한다는 점에서 의미가 크다. 이러한 정책은 두 가지 목표를 가진다. 먼저, 비침해성으로 기존 플레이어나 디코더 동작에 영향을 주지 않고 확장 영역만 활용한다. 또한, 확장 가능성으로 DRM, 워터마킹 등 기존 보안 체계와 충돌 없이 병행할 수 있도록 설계한다. 따라서 본 연구의 상호운용성 정책은 특정 플랫폼에 종속되지 않고 글로벌 스트리밍 생태계 전반에서 실질적으로 활용될 수 있는 확장성을 제공한다.

Ⅳ. 실험 결과 및 성능 분석

4-1 기술 성능 평가

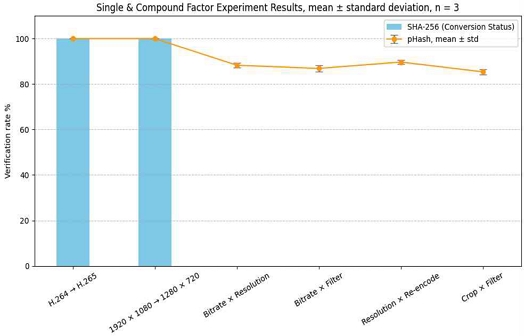

본 연구에서 제안한 메타데이터 기반 영상 진위 검증 체계의 성능은 강건성과 신뢰도를 중심으로 실험을 설계하였다. 이를 위해 다양한 변환 시나리오를 설계하였으며, 실험은 그림 7처럼 크게 단일 요인 실험과 복합 요인 실험으로 구분하여 진행하였다.

먼저, 단일 요인 실험에서는 원본 영상을 다양한 방식으로 변환하여 검증 성능을 측정하였다. 구체적으로는 코덱 변환으로 H.264에서 H.265 변환과 해상도 축소 1920 × 1080에서 1280 × 720 변환과 같은 대표적인 변환 조건을 각각 독립적으로 적용하였다. 이 과정에서 SHA-256 기반 해시는 비트 단위 차이에도 민감하게 반응하기 때문에, 원본과 조금이라도 다른 경우에는 무결성 위반으로 판정되는 특성이 있다. 따라서 SHA-256 단독 결과는 100%의 불일치와 0%의 일치인 이진적인 특성으로 나타났으며, 변환이 적용된 경우 모두 100%로 판정되었다. 이는 강력한 무결성 보장의 장점을 보여주는 동시에, 실제 서비스 환경에서 발생할 수 있는 경미한 변환 상황에 대한 유연성이 부족하다는 한계가 노출되었다. 이를 보완하기 위해 본 연구는 보조 정책으로 pHash (perceptual hash) 기반의 유사성 판정을 도입하였다. pHash는 영상의 구조적 특징을 기반으로 해싱하기 때문에, 재인코딩이나 미세한 필터링과 같은 경미한 변환에도 원본과 높은 유사도를 유지할 수 있다. 본 연구에서는 SHA-256을 1차 기준으로 적용하고, 불일치로 판정된 경우에 한해 pHash를 병행 적용하였다. 두 영상 간의 pHash 유사도가 사전에 정의한 임계값 이상일 경우 동일 콘텐츠로 간주하는 정책을 채택하였다. 이 다층적 접근 방식은 SHA-256의 강력한 무결성 보장과 pHash의 유연한 유사성 검출을 결합함으로써, 불필요한 오탐을 줄이고 실제 유통 환경에서의 실효성을 높이는 데 기여하고자 한다. 다음으로, 복합 요인 실험에서는 실제 스트리밍 및 배포 과정에서 발생할 수 있는 다중 변환 조건을 모사하였다. 모든 가능한 조합을 가적용하는 것은 비현실적이므로, 본 연구에서는 대표적인 일부 조합을 선별하였으며, 비트레이트 × 해상도, 비트레이트 × 필터, 해상도 × 재인코딩, 크롭 × 필터와 같은 2요인의 조합을 구성하여, 단일 요인 대비 복합 조건에서 시스템의 안정성을 평가하였다. 이와 같은 설계는 과도한 변수 증가를 방지하면서도, 실제 환경에서 자주 발생하는 변환 시나리오에 대해 체계적으로 강건성을 검증할 수 있도록 하였다. 복합 요인 실험은 실제 서비스 환경에서 빈번히 발생하는 다중 변환 조건을 모사하여, 제안 검증 체계의 강건성과 신뢰성을 다각도로 평가하고자 한다. 본 연구에서는 SHA-256과 pHash를 결합한 다층적 검증 구조를 적용하였으며, 그 결과는 평균 ± 표준편차 및 95% 신뢰구간 (CI; confidence interval) 형태로 산출하였다. 특히, 해상도 × 재인코딩 조건에서 pHash 검증율은 89.7 ± 0.9%로 가장 높게 나타났다. 이는 해상도 축소와 재인코딩이 동시에 적용된 상황에서도 pHash가 구조적 유사성을 안정적으로 포착했음을 의미한다. 표준편차가 1% 미만으로 낮게 유지된 점은 결과의 재현성과 신뢰도가 높음을 뒷받침한다. 반면, 크롭 × 필터 조건에서는 평균 검증율이 85.4 ± 1.2%로 상대적으로 낮게 측정되었으며, 표준편차가 다른 조건보다 큰 편에 속했다. 이는 크롭이 영상의 공간적 특징 자체를 손실시키고, 필터가 추가적인 변형을 가하기 때문에 pHash가 원본과의 유사성을 포착하는 데 상대적으로 불리했음을 보여준다. 그럼에도 불구하고 80% 이상을 유지했다는 점에서, 제안 체계가 복합 변환에도 일정 수준 이상의 강건성을 제공한다는 사실을 확인할 수 있었다. 따라서 해상도 × 재인코딩 조건은 가장 높은 평균 검증율 89.7%와 낮은 변동성 ± 0.9를 동시에 확보하여, 복합 요인 실험 중에서 가장 객관성과 신뢰도를 보장한 조건으로 평가할 수 있다. 이는 본 연구의 다층적 검증 구조가 현실적 배포 환경에서 발생하는 주요 변환 조건에도 안정적으로 대응할 수 있음을 실험적으로 입증한 결과라 할 수 있다.

4-2 사용자 신뢰성 및 사용성

본 연구는 기술적 성능 평가에 더해, 제안된 검증 UI가 실제 사용자 신뢰성에 미치는 영향을 실험적으로 분석하였다. 기존 연구에 따르면 일반 사용자가 원본 영상과 합성 영상을 시각적 단서만으로 구별하는 정확도는 평균 50~65% 수준에 불과하여[10], 그림 8처럼 시각적 단서만으로는 합성 여부 판별에 한계가 있음을 보여준다.

Cropped faces from different categories of deepfake videos from Facebook database (top row) and the corresponding original versions (bottom row) [11]

반면, 검증 UI를 제공한 경우 정확도가 80% 이상으로 향상된다는 결과가 보고된 바 있다[12]. 또한, 딥페이크 영상의 진위를 독자적으로 판별하기 어렵다고 응답하여, UI 기반 보조 장치의 필요성을 강조한 바 있다[13]. 이를 검증하기 위해 본 연구에서는 30명의 일반 사용자를 대상으로 실험을 수행하였다. 참가자에게 원본 영상 20개와 합성 영상 20개를 무작위로 제시하되, 각 영상은 검증 UI 포함 여부에 따라 두 조건으로 나누어 총 40개 영상으로 구성하였다. 참가자들은 각 영상에 대해 원본 여부를 판별하도록 요청받았으며, 판별 정확도와 반응시간이 주요 지표로 측정되었다. 실험 결과, 표 3처럼 UI 제공 조건에서 평균 판별 정확도는 약 21.5% 포인트 향상되었으며, 반응시간은 평균적으로 1.6초 ± 0.4 단축되었다.

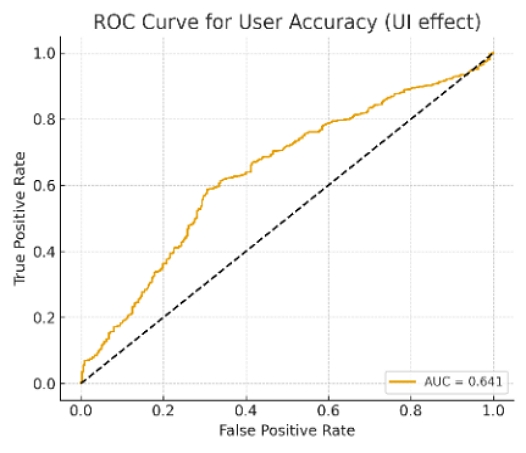

특히 그림 9와 같이 ROC-AUC 분석에서 UI 제공 여부를 기반으로 한 분류 성능은 0.641로 나타나, 무작위 수준(0.5)을 유의하게 상회하는 판별력을 확인하였다. 다만, 본 연구는 30명 규모의 제한된 표본을 대상으로 하였다는 점에서 통계적 일반화에는 한계가 있다. 향후 다양한 연령대와 문화적 배경을 포함한 대규모 실험을 통해 UI의 보편성과 직관성을 검증할 필요가 있다. 또한, 실제 SNS나 스트리밍 플랫폼 환경에서의 A / B 테스트를 수행하여, 실사용 조건에서의 신뢰도 및 사용성 지표를 추가 검증할 계획이다. 더불어, 신뢰 마크의 변조나 가짜 인증 아이콘 삽입과 같은 악용에 대한 대응 방안도 별도의 보안 메커니즘으로 연구되어야 한다.

Ⅴ. 결 론

본 연구는 메타데이터 해시와 전자서명을 활용한 영상 진위 검증 체계를 제안하고, 프로토타입 구현 및 실험을 통해 그 실효성을 검증하였다. 제안 체계는 세그먼트 단위 무결성 검증과 Merkle root 기반으로 구현하였으며, 신뢰할 수 있는 타임스탬프와 소프트웨어 키 서명과 Mock attestation을 결합하여 단순 해시 비교를 넘어 출처 인증 기능까지 수행함을 입증하였다. 실험 결과, SHA-256 기반 서명은 강력한 위변조 탐지를 제공하였고, pHash 기반 보조 정책은 재인코딩 및 경미한 편집과 같은 실제 유통 환경에서도 강건성을 유지하였다. 또한 사용자 평가에서는 UI 기반 신뢰 마크 제공 시 판별 정확도가 약 21.5% 포인트 향상되고, 반응 시간이 단축되는 효과가 확인되었다. 이는 본 연구가 기술적 성능뿐만 아니라 사용자 신뢰성 제고 측면에서도 의미 있는 기여를 한다는 점을 보여준다. 이러한 성과는 기존의 "탐지 고도화 경쟁"이 가진 구조적 한계를 보완한다는 점에서 의의가 크다. 즉, 합성 기술이 고도화될수록 탐지 모델의 추격적 대응은 한계에 직면하는 반면, 본 연구는 생성 및 유통 단계에서 출처를 증명할 수 있는 인프라적 접근을 제시하였다. 이는 탐지 기술과 상호보완적으로 결합하여 디지털 생태계 전반의 신뢰성을 강화하는 기반 기술로 발전할 수 있다. 다만 몇 가지 한계가 존재한다. 먼저, 글로벌 플랫폼 환경에서의 적용 한계가 명확히 드러난다. 실제로 YouTube, Instagram 등 주요 온라인 서비스에서는 업로드 과정에서 영상의 메타데이터가 자동으로 삭제되거나 변형되는 사례가 빈번하다. 이와 같은 플랫폼 구조적 한계는 본 연구의 메타데이터 기반 검증 체계가 의도한 기능을 온전히 발휘하는 데 제약 요인으로 작용할 수 있다. 따라서 향후에는 메타데이터 보호 및 유지 정책을 기술적 및 제도적으로 병행하여 도입할 필요가 있다. 기술적 측면에서는 콘텐츠 업로드 과정에서 메타데이터가 손실되지 않도록 하기 위해, 플랫폼 수준에서 메타데이터 무결성 보존 모듈을 적용하거나, JSON-LD (javascript object notation for linked data)와 같은 표준화된 메타데이터 전송 포맷을 채택하는 방안을 고려할 수 있다. 이를 통해 영상 파일이 재인코딩되거나 CDN (content delivery network)을 거칠 때에도 서명 정보와 진위 검증 관련 데이터가 손상되지 않도록 할 수 있다. 제도적 측면에서는 플랫폼 사업자가 콘텐츠 출처 정보의 유지 및 보존 의무를 준수하도록 하는 정책적 가이드라인 혹은 국가 및 국제 표준 규격 마련이 요구된다. 특히 정부나 국제기구 차원의 디지털 출처 정보 보존 표준화 정책 제정이 추진된다면, 각 플랫폼 간의 호환성과 검증 가능성이 대폭 향상될 것이다. 또한, 제안된 기술의 실제 적용 가능성 및 사용자 참여 유도 측면에서도 현실적 과제가 존재한다. 본 연구의 검증 체계는 원본 영상 생성 단계에서부터 메타데이터 추출, 세그먼트 해시 생성, TEE 기반 서명 등 일련의 절차가 수행되어야만 효과를 발휘한다. 즉, 본 시스템의 작동 전제는 사용자가 전용 촬영 애플리케이션이나 인증된 촬영 장비를 통해 콘텐츠를 생성한다는 가정에 기반한다. 그러나 현재 대부분의 영상은 일반 스마트폰 카메라나 비인증 애플리케이션을 통해 생산 및 유통되므로, 이러한 환경에서는 제안된 체계가 적용되기 어렵다. 따라서 향후에는 사용자의 자발적 참여를 유도하거나, 자동화된 백그라운드 검증 모듈을 운영체제나 플랫폼 수준에서 통합하는 접근이 필요하다. 예를 들어, 스마트폰 제조사나 SNS 플랫폼 사업자와의 협력을 통해 신뢰 기반 촬영 모드를 도입하거나, 촬영 시점에 자동으로 메타데이터 서명 및 해시 생성이 수행되는 구조를 제공함으로써 사용자의 부담을 최소화할 수 있다. 이러한 방식은 시스템의 활용률을 높이는 동시에, 영상 신뢰성 확보를 위한 생태계적 확산의 발판이 될 것이다. 또한 제안된 체계의 활용 범위 역시 현실적 제약을 고려해야 한다. 본 시스템은 모든 영상 콘텐츠를 대상으로 한 범용 솔루션이라기보다는, 언론 보도, 사법 증거, 공공기록물 등 고도의 신뢰성이 요구되는 영역에서 우선적으로 적용될 가능성이 높다. 특히 허위 조작 영상이 사회적 및 법적 영향을 미치는 영역에서 본 연구의 검증 체계를 우선 도입하고, 이후 점진적으로 일반 미디어 플랫폼으로 확장하는 단계적 도입 전략이 타당하다. 다음으로, 개인정보 보호와 투명성 라벨링 간의 균형을 유지하는 것이 중요하며, 메타데이터의 최소화 및 가명화 정책을 엄격히 적용하여 프라이버시 침해를 방지해야 한다. 마지막으로, 검증 마크의 오탐이나 비정상 판별에 대응하기 위해 사용자와 운영자가 함께 참여하는 피드백 프로세스 및 검증 이력 관리 체계가 구축되어야 한다. 향후 연구에서는 본 연구의 실험적 한계를 보완하고, 제안된 검증 체계의 확장성과 일반화 가능성을 강화하는 방향으로 발전할 필요가 있다. 본 연구는 제한된 범위의 실험 환경에서 수행되었기 때문에, 대규모 공개 데이터셋이나 멀티모달 합성, Diffusion 기반 생성 등 최신 합성 기법을 활용한 추가적인 검증이 부족하다는 한계가 있다. 따라서 향후에는 다양한 합성 유형과 변환 조건을 포함한 실험을 통해 제안 체계의 강건성과 일반화 성능을 정량적으로 입증할 필요가 있다. 또한, 학술적 완성도를 높이기 위해 탐지 성능의 고도화와 사용자 연구의 확장이 병행되어야 한다. 특히, 연령 및 사용자 경험, 미디어 활용 성향 등 다양한 변수를 반영한 사용자 실험을 수행함으로써, 검증 UI가 신뢰 인식 및 판단 정확도에 미치는 영향을 보다 폭넓게 분석할 수 있을 것이다. 기술적 측면에서는 현재의 중앙 서버 기반 검증 구조가 트래픽 집중, 단일 실패 지점 발생, 데이터 처리 병목 등 확장성의 한계를 내포하고 있다는 점이 지적된다. 이러한 구조적 제약을 보완하기 위해 향후 연구에서는 블록체인 기반의 분산 검증 구조를 도입하여 시스템의 신뢰성과 확장성을 동시에 강화할 필요가 있다. 블록체인 원장은 모든 검증 이벤트를 탈중앙화된 형태로 기록함으로써 위조 및 변조를 방지하고, 데이터 검증 내역을 여러 노드에서 병렬적으로 검증할 수 있어 처리 효율과 보안성을 동시에 확보할 수 있다. 이를 통해 중앙 집중형 아키텍처에서 발생할 수 있는 단일 실패 지점을 근본적으로 해소하고, 대규모 사용자 환경에서도 안정적인 성능을 유지할 수 있을 것으로 기대된다. 아울러 국제 표준인 C2PA 등 상호운용성을 확보하여, 제안된 시스템이 글로벌 신뢰 인증 인프라로 확장될 수 있도록 구조적 정합성을 높이는 연구가 필요하다. 또한, AI 탐지, 워터마킹, 핑거프린팅 등 이기종 기술과 결합한 다층적 융합 체계를 구축함으로써, 최신 합성 모델에도 대응할 수 있는 지속 가능한 검증 메커니즘을 마련해야 한다. 법적 및 윤리적 측면에서도 법적 증거력 확보를 위한 제도적 논의가 병행되어야 한다. 특히, 메타데이터 처리와 서명 관리 과정에서 개인 식별 정보를 최소화하는 동시에, 사회적으로 신뢰 가능한 디지털 진위 인증 체계로 발전시킬 필요가 있다. 결국 본 연구는 탐지 기술을 보완하는 출처 증명 인프라로서의 가능성을 실험적으로 입증하였으며, 향후 기술적 및 제도적 기반이 함께 마련된다면, 제안된 체계는 글로벌 차원에서 신뢰성 있는 디지털 콘텐츠 검증 구조로 발전할 수 있을 것이다.

References

-

L. Ma, P. Yang, Y. Xu, Z. Yang, P. Li, and H. Huang, “Deep Learning Technology for Face Forgery Detection: A Survey,” Neurocomputing, Vol. 618, 129055, February 2025.

[https://doi.org/10.1016/j.neucom.2024.129055]

-

H. Chen, Q. Xiang, J. Hu, M. Ye, C. Yu, H. Cheng, and L. Zhang, “Comprehensive Exploration of Diffusion Models in Image Generation: A Survey,” Artificial Intelligence Review, Vol. 58, 99, January 2025.

[https://doi.org/10.1007/s10462-025-11110-3]

-

M. Masood, M. Nawaz, K. M. Malik, A. Javed, A. Irtaza, and H. Malik, “Deepfakes Generation and Detection: State-of-the-Art, Open Challenges, Countermeasures, and Way Forward,” Applied Intelligence, Vol. 53, pp. 3974-4026, June 2023.

[https://doi.org/10.1007/s10489-022-03766-z]

-

F. Abbas and A. Taeihagh, “Unmasking Deepfakes: A Systematic Review of Deepfake Detection and Generation Techniques Using Artificial Intelligence,” Expert Systems with Applications, Vol. 252, 124260, October 2024.

[https://doi.org/10.1016/j.eswa.2024.124260]

-

Y. Lu and T. Ebrahimi, “Assessment Framework for Deepfake Detection in Real-World Situations,” EURASIP Journal on Image and Video Processing, February 2024.

[https://doi.org/10.1186/s13640-024-00621-8]

-

M. Amen and M. Lauwl Ranam, “Lightweight Deepfake Detection on Mobile Devices Using Attention-Enhanced MobileNet and Frequency Domain Analysis,” Journal of Technology Informatics and Engineering, Vol. 4, No. 1, pp. 95-114, April 2025.

[https://doi.org/10.51903/jtie.v4i1.275]

-

Y. Zhou and S.-N. Lim, “Joint Audio-Visual Deepfake Detection,” in Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV), Montreal: QC, October 2021.

[https://doi.org/10.1109/ICCV48922.2021.01453]

-

R. Tolosana, R. Vera-Rodriguez, J. Fierrez, A. Morales, and J. Ortega-Garcia, “Deepfakes and Beyond: A Survey of Face Manipulation and Fake Detection,” Information Fusion, Vol. 64, pp. 131-148, December 2020.

[https://doi.org/10.1016/j.inffus.2020.06.014]

-

S. Petrangeli, H. Wang, M. Fisher, D. Kozma, M. Mahamli, P. Blumenthal, and A. Parsons, “Integrating Content Authenticity with DASH Video Streaming,” in Proceedings of the 15th ACM Multimedia Systems Conference (MMSys '24), Bari: Italy, pp. 492-498, April 2024.

[https://doi.org/10.1145/3625468.3652198]

-

A. Diel, T. Lalgi, I. C. Schröter, K. F. MacDorman, M. Teufel, and A. Bäuerle, “Human Performance in Detecting Deepfakes: A Systematic Review and Meta-Analysis of 56 Papers,” Computers in Human Behavior Reports, Vol. 16, 100538, December 2024.

[https://doi.org/10.1016/j.chbr.2024.100538]

-

P. Korshunov and S. Marcel, “Deepfake Detection: Humans vs. Machines,” arXiv:2009.03155, , September 2020.

[https://doi.org/10.48550/arXiv.2009.03155]

-

E. Josephs, C. Fosco, and A. Oliva, “Artifact Magnification on Deepfake Videos Increases Human Detection and Subjective Confidence,” arXiv:2304.04733, , April 2023.

[https://doi.org/10.48550/arXiv.2304.04733]

-

I. Rae, “The Effects of Perceived AI Use on Content Perceptions,” in Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems (CHI '24), Honolulu: HI, pp. 1-14, May 2024.

[https://doi.org/10.1145/3613904.3642076]

저자소개

2024년~현 재: 아주대학교 정보통신대학원 사이버보안학과(석사과정)

※관심분야:사이버보안(Cyber Security), 정보보호(Personal Information), 영상처리(Video Processing) 등

2000년:아주대학교 정보및컴퓨터공학부 졸업(학사)

2002년:아주대학교 정보통신전문대학원 졸업(석사)

2005년:고려대학교 정보보호대학원 졸업(박사)

2004년~2005년: University of Minnesota 방문연구원

2005년~2011년: 삼성전자 통신·DMC 연구소 책임연구원

2017년~2018년: Illinois Insitute of Technology 방문교수

2011년~현 재: 아주대학교 정보통신대학 사이버보안학과 교수

※관심분야:Digital Forensics, ICS/Automotive Security