속성 기반 감성 분석을 활용한 OTT 서비스 포지셔닝 연구

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

디지털 플랫폼의 확산과 함께 소비자 리뷰는 서비스 경험을 이해하는 핵심 자료로 부상하였다. 그러나 전통적 감성 분석은 리뷰 내 다양한 측면에 대한 감성 평가를 정밀하게 반영하기 어렵다. 본 연구는 토픽 모델링, KR-SBERT, 미세 조정된 KoBERT 모델을 결합한 다중 모델 프레임워크를 통해 OTT 서비스의 소비자 리뷰에 대한 속성 기반 감성 분석(ABSA; Aspect Based Sentiment Analysis)을 수행하였다. 국내 주요 OTT 6개 플랫폼의 한글 리뷰를 수집하고 먼저 LDA를 통해 네 가지 핵심 속성을 도출하였다. 다음으로 문장별 속성 자동 할당 및 감성 극성 분류를 진행하고, PCA 및 t-SNE 시각화를 통해 포지셔닝 분석을 수행하였다. 분석 결과 한국어 기반 다중 모델 분석 프레임워크 구축과 도메인 특화 미세 조정을 수행하여 성능 지표 향상을 달성하고 도메인 특화 데이터 세트 구축의 중요성을 입증하는 학술적 기여를 달성하였다. 본 연구의 결과는 시각화 기법을 사용해 OTT 서비스 운영 진단과 차별화 전략 수립에 활용할 수 있는 함의를 제공한다.

Abstract

With the spread of digital platforms, consumer reviews have emerged as a key source of information for understanding service experiences. However, traditional sentiment analysis struggles to accurately reflect the diverse aspects of sentiment within reviews. This study conducted aspect-based sentiment analysis (ABSA) on consumer reviews of over-the-top (OTT) services using a multi-model framework that combined latent Dirichlet allocation (LDA) topic modeling, Korean-specific sentence bidirectional encoder representations from transformers (KR-SBERT), and a fine-tuned Korean BERT (KoBERT) model. We collected Korean reviews from six major OTT platforms in Korea and derived four core aspects through LDA. Subsequently, we performed sentence-level aspect auto-assignment and sentiment polarity classification and conducted positioning analysis through principal component analysis (PCA) and t-distributed stochastic neighbor embedding (t-SNE) visualization. The results of the analysis demonstrated the academic contribution of constructing a Korean-based multi-model analysis framework and domain-specific fine-tuning in improving performance metrics, which underscores the importance of building domain-specific datasets. The findings of this study have implications for utilizing visualization techniques in diagnosing OTT service operations and establishing differentiation strategies.

Keywords:

KoBERT, KR-SBERT, LDA Topic Modeling, OTT, Positioning Analysis키워드:

LDA 토픽 모델링, 온라인 동영상 서비스, 포지셔닝 분석Ⅰ. 서 론

디지털 시대의 온라인 소비자 리뷰는 제품 및 서비스에 대한 직접적인 평가를 포함하고 있어 소비자의 의사결정과 기업 전략 수립에 핵심적인 역할을 한다. 비영리 소비자 단체의 설문조사에 따르면 2022년 소비자의 97.2%가 온라인 쇼핑 시 제품에 대한 이용 후기를 확인하고 이용 후기의 신뢰도는 70.2%에 달하는 것으로 조사되었다[1]. 온라인 소비자 리뷰는 소비자의 실제 경험을 반영하여 기업의 강점과 약점을 파악하고 서비스 개선을 위한 전략을 수립하는 데 유용하게 활용될 수 있다. 그러나 소비자 리뷰는 비정형 텍스트 데이터로 구성되어 작성자의 표현 방식이 다양하고 중복된 정보를 포함하는 경우가 많다. 또한 방대한 양이 지속적으로 축적되므로 단순 수작업 분석이나 전통적인 통계 기법을 통해 분석하는 것은 한계가 있다. 이에 따라 최근 인공지능과 자연어 처리 기법의 발전으로 온라인 리뷰를 효율적으로 활용하기 위한 체계적이고 자동화된 텍스트 분석 기술이 널리 사용되고 있다[2],[3].

감성 분석(Sentiment Analysis)은 온라인 리뷰의 감정을 정량적으로 분석하는 기법으로 급증하는 소비자 리뷰를 효과적으로 분석하기 위한 도구로 주목받고 있다[4]. 그러나 리뷰에 전통적인 감성 분석을 적용할 경우 하나의 제품 및 서비스에 대한 다양한 속성(Aspect)을 감안하지 않고, 하나의 문장을 단일 긍정·부정 범주로 분류하기 때문에 리뷰가 여러 속성에 대해 서로 다른 평가를 포함하게 되어 분석 정확도가 저하될 수 있다. 이러한 문제를 해결하기 위해 Liu의 연구는 특정 측면에 대한 세밀한 감성 분석을 위한 속성 기반 감성 분석(ABSA)을 제안했다[5], 이는 텍스트에 포함된 감정을 복수의 속성으로 식별하고 평가하는 세분화된 접근 방식으로, 조직이 제품이나 서비스의 다양한 속성에 대한 소비자 감성을 정량적으로 측정하며 복수의 개별 속성의 감정 분포를 분석하여 기존 감성 분석의 한계를 보완할 수 있다.

포지셔닝 분석(Positioning Analysis)은 브랜드, 제품 및 서비스의 시장 내 위치를 정의하고 경쟁 요소와의 차별성을 규명하여 의사결정을 지원하는 과정이다[6]. 이는 소비자가 특정 브랜드를 어떻게 인식하는지 파악하고, 시각화를 통해 시장 내 현 위치를 명확히 규정하여 시장 경쟁력을 강화하기 위한 핵심 전략으로 활용된다[7]. 특히 디지털 시대가 전개됨에 따라 온라인 소셜 미디어 데이터를 활용하여 소비자의 감성 변화를 분석하고 이를 포지셔닝 분석에 반영하는 연구가 최근 활발히 이루어지고 있다[8]. 기존 포지셔닝 분석은 소비자 인식과 브랜드 속성을 정량화하여 시각화 자료를 구축하고 이를 통해 브랜드의 시장 내 위치를 평가하고 차별성을 강조하는 방식이 주로 활용되지만[9], 최근에는 단순 시장 내 위치 평가를 넘어 다차원 속성 분석, 특정 속성 관계 시각화 등 복합적인 요소를 포함하는 방향으로의 진화를 통해 정교한 소비자 인식 및 감성 분석을 시도하고 있다[10],[11].

OTT(Over-The-Top) 서비스는 인터넷을 통해 다양한 분야의 영상 콘텐츠를 제공하는 대표적인 온라인 플랫폼으로 미디어 산업의 판도를 변화시키고 있다. Precedence Research 보고서에 따르면 2030년 글로벌 OTT 시장 규모는 1조 2,416억 달러에 이를 것으로 전망되며, 국내 시장 역시 2023년 기준 5조 6천억 원 규모로 성장하였다[12]. OTT 서비스는 사용자가 원하는 콘텐츠를 시공간적 제한 없이 선택적으로 소비할 수 있어, 개인화된 서비스가 중요한 경쟁 요소로 작용한다. 최근의 OTT 서비스의 소비자는 단순한 시청자를 넘어 적극적인 의견 제시자로 진화하고 있어 서비스에 대한 사용자 리뷰와 피드백의 중요성이 부각되고 있다. OTT 서비스 기업 입장에서는 사용자 리뷰가 콘텐츠 품질 평가와 플랫폼 개선에 핵심적인 역할을 하며[13], OTT 서비스 특성상 개인화된 경험이 중요하기 때문에 서비스 전략을 수립하는 데 중요한 데이터 소스가 된다. 하지만 OTT 서비스 리뷰 데이터는 콘텐츠, 사용성, 구독료 등 다양한 속성에 대한 내용이 함께 포함되어 있어 단순 감성 분석만으로는 리뷰를 정확하게 분석하기 어렵다[14]. 따라서 OTT 서비스의 리뷰 데이터를 체계적으로 분석하기 위해 주요 속성을 구분하여 도출하고, 속성별 감성 점수를 기반으로 분석하는 접근 방식이 요구된다.

본 연구는 국내 주요 OTT 서비스 앱(App)의 리뷰 데이터를 수집하여 서비스 리뷰의 주요 속성을 파악하고 속성별 감성을 반영하여 각각의 서비스를 포지셔닝 분석을 수행하는 다중 모델 텍스트 분석(Multi-Model Text Analysis)을 수행하는 방안을 제안한다. 이를 위해 첫째, LDA(Latent Dirichlet Allocation) 토픽 모델링(Topic Modeling)을 사용하여 리뷰의 경향을 파악하고 주요 주제를 도출하여 소비자들이 언급하는 핵심 속성을 정의하였다. 둘째, KR-SBERT(Korean Sentence-BERT) 언어 모델을 활용하여 문장 간 의미적 유사성을 분석하고 리뷰 내용을 해석하여 속성을 자동 할당하였다. 셋째, 한국어 텍스트 분석에 적합한 KoBERT 모델을 적용하여 OTT 서비스 리뷰를 분석하고 감성 점수를 추출하였다. 마지막으로 추출된 감성 점수를 기반으로 포지셔닝 분석을 수행하여 OTT 서비스 속성별 위치 파악 및 개선 방향을 도출하는 시각화 자료를 제공하였다.

Ⅱ. 선행 연구

2-1 텍스트 분석 연구 동향

텍스트 분석(Text Analysis)은 비정형 텍스트 데이터 분석을 통해 유의미한 패턴을 파악하는 기법으로 다양한 응용 분야에 활용되고 있다[15]-[17]. 특히 방대한 양의 문서에서 특정 주제를 분류하고 군집화하며 비정형 데이터의 정량적 분석을 가능하게 한다[18],[19].

텍스트 분석 초기부터 널리 사용된 분석 기법인 토픽 모델링은 텍스트 문서의 주제를 자동으로 추출하는 분석 기법으로 확률적 모델링을 기반으로 주제 구조를 추론하며[20], 2010년대 이후 자연어 처리 기법이 등장하기 이전부터 대규모 문서 분석에서 핵심적인 역할을 해왔다[16]. 토픽 모델링을 위해서는 잠재 디리클레 할당(Latent Dirichlet Allocation, 이하 LDA) 기법이 가장 널리 사용된다[15]. LDA는 문서 내 단어들의 출현 확률을 기반으로 주제를 추론하는 방식으로 비정형 문서의 키워드를 추출하는 방법이다[3]. 최근 온라인 소비자 데이터를 LDA를 사용하여 분석하는 연구가 다수 수행되고 있다. Joung과 Kim은 LDA를 통해 온라인 리뷰 내 제품 속성을 자동 식별하는 방법을 제안하였다[21]. 이는 자동 키워드 필터링 기법을 통해 불필요한 단어를 제거하여 정교한 속성 분석 성능을 보여주었다. Ali 등은 LDA를 활용한 토픽 기반 감성 분석(Topic-Based Sentiment Analysis) 기법을 적용하여 온라인 리뷰의 주제를 추출하고 해당 주제에 대한 감성 극성을 분류하는 모델을 제안하였다[22]. 김 등의 연구는 한의원 리뷰에 LDA를 적용하여 리뷰의 주요 키워드를 추출하고, 키워드를 기반으로 환자들의 서비스 경험 및 만족도를 평가하였다[23]. 이러한 연구들은 LDA가 단순 주제 분류를 넘어 제품 속성 식별, 고객 감성 분석, 서비스 품질 평가 등 다양한 활용 가능성을 제시하였다.

최근 텍스트 분석 기법은 문맥과 의미를 정교하게 파악하는 기계 학습 기법의 발전으로 전통적 확률 기반 모델에서 딥러닝을 활용한 분석으로 확장되고 있다[3],[24],[25]. 이러한 발전은 대규모 비정형 데이터의 문맥을 정확하게 파악하고 주제 분류 및 감성 분석에서 높은 성능을 끌어낸다[26]. 이 중 사전학습 언어 모델(Pre-trained Language Model)은 대규모 데이터로부터 언어의 전반적인 패턴과 의미를 학습하는 특성을 바탕으로 문서 요약, 질의응답 등 고차원적 자연어 처리 분야에서 주목받는 기술 중 하나이다[27]. 특히 본 연구가 주목하는 BERT(Bidirectional Encoder Representations from Transformers)는 대표적인 사전학습 언어 모델로 Transformer 기반 구조를 통해 문장의 양방향(Bidirectional) 문맥을 이해할 수 있도록 설계되었으며[28], 문맥 정보의 양방향성을 반영하는 구조적 특징으로 인해 감성 분석, 질의응답 등 다양하게 활용된다[29]. 하지만 BERT 모델은 영어에 최적화되어 다른 언어 분석에 제한적이므로 특정 언어 및 도메인에 맞는 BERT 파생 모델이 필요하게 되었다[30].

KoBERT(Korean Bidirectional Encoder Representations from Transformers)는 한국어에 특화된 BERT 파생 모델로, 한글의 문맥을 효과적으로 학습하기 위해 위키피디아와 뉴스 등 수백만 개의 한국어 문장으로 이루어진 대규모 말뭉치(corpus)로 사전 학습을 수행하였다[31],[32]. KoBERT는 다양한 분야에서 문장 임베딩을 통해 특징을 추출하고, 의미적 유사성 분석, 감성 분석, 문장 분류 등의 작업에서 활용되고 있다[33]-[35]. Kim은 KoBERT를 활용하여 소셜 미디어 데이터를 분석하여 게임 기업 브랜드 인식을 측정하는 연구를 수행하였고[36], 곽지호와 정유철, 양지훈 등, 김은미 등 여러 연구에서 KoBERT 기반 문장 임베딩이 의미적 유사성 분석, 감성 분석, 문장 분류 등 다양한 자연어 처리 작업에서 높은 성능을 입증하였다[33]-[35].

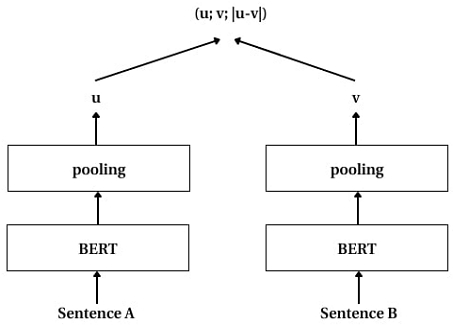

Sentence-BERT(SBERT)는 문장의 의미적 유사성을 효율적으로 계산하기 위해 입력 문장을 동일한 인코더에 통과하여 출력 임베딩 간 유사도를 계산하는 Siamese 네트워크 구조를 적용하여 문장을 고정된 길이의 벡터로 변환하고 이를 기반으로 의미적 유사성을 계산하고 특정 속성을 분류하는 문장 분석 특화 BERT 모델이다[37]. 기존 BERT 모델은 문장 쌍을 네트워크에 개별적으로 입력하여 연산 비용이 급증하는 문제가 발생하였지만 SBERT는 사전 생성된 문장 임베딩을 통해 연산 효율성과 정확도를 동시에 개선하였다. BERT가 개별 토큰 수준의 심층적 문맥 분석에 강점을 보이는 반면, SBERT는 문장 임베딩 생성 및 대규모 유사도 계산에서 높은 정확도를 보이므로 의미적 텍스트 유사성(STS: Semantic Textual Similarity) 분석과 문장 특징 추출(Feature Extraction) 등에 널리 사용되고 있다. Santander-Cruz 등은 SBERT를 통해 치매 환자의 언어적 특성을 분석하여 인지 저하 여부를 분류하는 연구를 수행하여 높은 정확도를 보였고, Nie의 연구는 SBERT와 LSTM-Attention 네트워크를 결합하여 자동 에세이 평가 모델을 개발하고 SBERT 모델이 모든 평가 지표에서 우수한 예측 성능을 보였다고 주장하였다[38],[39].

최근 한국어 문장 분석에 특화된 SBERT 모델인 KR-SBERT, Ko-SBERT, roBERTa 등도 제안되었으며, 이들은 KLUE-NLI(Korean Natural Language Inference), KorSTS(Korean Semantic Textual Similarity) 등의 데이터 세트를 활용하여 특정 과업에 맞게 사전학습 모델을 조정하는 미세 조정 과정을 통해 한국어 텍스트의 문장 간 의미적 유사성을 계산하고 유사성이 높은 문장을 식별하는 데 사용된다[40]. KR-SBERT는 2021년 개발된 한국어 특화 문장 임베딩 모델로 SBERT 구조를 한국어 언어 구조에 맞게 재구성한 모델이다. Park과 Shin에 따르면, KR-SBERT는 기존 다국어 기반 SBERT보다 한국어 문장의 의미적 유사성을 정확하게 반영하는 것으로 나타났다[41]. 그러나 SBERT 및 KR-SBERT는 특정 도메인에 최적화된 추가 학습이 필요하여[42], 충분한 학습 데이터가 확보되지 않은 데이터 세트에서 성능 저하가 발생할 수 있다는 한계점을 극복해야 한다[39].

기계 학습을 활용한 다양한 자연어 처리 기법이 등장함에 따라 최근 전통적 텍스트 분석 기법과 최신 딥러닝 모델을 결합하여 더욱 정교한 분석을 수행하는 다중 모델 연구가 진행되고 있다[26],[43],[44]. Paul 등은 LDA의 확률적 토픽 모델링 기능과 BERT의 문맥적 의미 분석 기능을 결합하여 기존 단일 모델보다 더 정밀한 토픽 모델링 성능을 보였고[44], Tan 등은 BERT-LDA 결합 모델을 통해 대규모 텍스트 데이터의 감성 분석을 수행하여 기존 단일 모델보다 높은 성능을 보였다[43].

2-2 감성 분석 연구 동향과 응용

감성 분석(Sentiment Analysis)은 텍스트 데이터를 분석하여 감성적 의미를 추출하는 자연어 처리 기술로, 최근 온라인 리뷰 데이터의 급증과 함께 기계 학습 및 딥러닝 기법과 결합하여 다양한 연구가 수행되고 있다[45]. 감성 분석은 소비자의 의견을 정량적으로 평가하여 기업의 제품 및 서비스 개선 방향을 도출하는 데 중요한 역할을 한다[46]. 초기 감성 분석 연구는 단순 긍정·부정 감성 분류 방식이 주로 활용되었고 감성 사전 또는 기계 학습 기법을 이용한 분류 모델이 일반적이었다[47]. 그러나 이러한 방식은 문장의 문맥(Context)을 충분히 반영하지 못해 정확도의 한계가 있다. 이를 해결하기 위해 BERT와 같은 사전학습 언어 모델이 감성 분석에 도입되었다.

리뷰 감성 분석은 감성 분석 중에서도 가장 활용이 많은 분야로 온라인 쇼핑, 관광, 금융 등 다양한 산업군의 소비자 의견을 반영하여 서비스 개선 방향을 설정하는 데 중요한 역할을 한다. 따라서 소비자의 리뷰 데이터는 감성 분석을 위한 핵심 데이터로 활용된다. Umarani 등은 단일한 속성에 대한 감성 점수(Sentiment Score)를 활용한 고객 피드백 분석 프레임워크를 제안하였다[46]. 하지만 소비자는 하나의 제품에 대해 여러 측면에서 감성을 반영해야 하므로 소비자 리뷰를 단일 감성으로 분류하는 것은 어렵다. 예를 들어 소비자가 제품의 디자인에 대해서는 긍정적인 감정을 표현하지만, 가격 측면에 대해서는 부정적인 감성을 내포할 수 있다. 이를 해결하기 위해 ABSA가 등장하였다. ABSA는 텍스트가 내포하는 복수의 속성과 특정 속성에 대한 감성을 분석하는 기법으로 기존 감성 분석보다 세밀한 분석이 가능하다. 이는 제품 및 서비스의 다양한 속성의 장단점을 정교하게 파악할 수 있다는 점에서 주목받고 있으며, 속성별 소비자 반응을 정량화하여 제품 개선 및 서비스 품질 향상에 활용될 수 있다. Rodrigues와 Chiplunkar의 연구는 레스토랑 리뷰 데이터를 ABSA로 분석하여 메뉴, 서비스 품질, 가격 등 주요 속성별 감성 분포를 평가하였다[48]. 또한 Bansal과 Kumar는 병원 리뷰 데이터를 분석하여 의료진 서비스, 병원 시설, 비용 등 주요 속성별 감성 점수를 평가하였고[49], Tran 등의 연구는 전자 상거래 플랫폼의 뷰티 제품 리뷰 데이터를 분석하여 색상, 가격, 향 등 속성별 감성 분포를 평가하였다[50].

감성 분석의 결과는 일반적으로 정량적인 감성 점수 또는 감성 분포로 제공되며 이는 주로 텍스트의 긍정·부정·중립 감성 범주로 나뉜다. 이를 바탕으로 소비자의 반응을 명확히 파악할 수 있으며, 최근에는 감성 분석 결과를 다양한 형태로 시각화(Visualization)하여 제공하는 방식이 널리 쓰이고 있다. 시각화는 차트, 표 등 전통적 기술통계 기법과 함께 워드클라우드, 히트맵 등의 형태로 감성 분석 결과를 표현하여 분석 결과를 직관적으로 이해할 수 있도록 한다[48]. 정다운의 연구는 소셜 미디어 데이터를 활용하여 감성 분석을 수행하고 데이터 유형별로 다양한 시각화 사례를 제시하여 시각화가 결과 해석에 효과적임을 보여주었다[51]. Kucher의 연구 또한 감성 분석 시각화가 단순 데이터 표현을 넘어 다차원적, 시각적, 관계적 특성을 내포하여 감성 분석 결과를 효과적으로 전달할 수 있음을 강조하였다[52]. Chatzimparmpas 등은 기계 학습 모델 해석에 시각화가 모델 사용자의 신뢰 형성에 중요한 역할을 하고, 감성 분석에도 시각화 결과가 이해와 활용에 핵심적인 도구임을 뒷받침하는 연구를 수행하였다[53]. 최근 고차원 텍스트 데이터의 감성 점수와 속성 간 관계를 저차원 공간에서 효과적으로 표현하기 위해 주성분 분석(PCA; Principal Component Analysis) 기반 시각화 기법을 적용한 감성 분석 연구가 수행되고 있다. PCA는 데이터의 주요 분산 방향을 유지하며 차원을 축소해 감성 점수나 속성별 인식 구조를 2차원 구조로 표현하는 데 활용된다[54]. 김민재와 이홍주의 연구는 한국 주요 비대면 앱의 사용자 리뷰 데이터의 감성을 분석하여 PCA를 통해 서비스 속성별 감성 점수를 2차원 포지셔닝 맵으로 시각화하였다[8]. PCA와 더불어 고차원 데이터의 지역적 구조를 보존하며 클러스터링 구조를 시각화하는 데 성능이 좋은 t-SNE(t-Distributed Stochastic Neighbor Embedding)를 사용한 연구도 수행되고 있다. t-SNE는 비선형 차원 축소 알고리즘으로 유사도 기반 군집 구조를 시각화하는 데 효과적이다[55]. Kohler 등의 연구는 감성 분석을 통해 소비자 금융 불만 데이터를 분석하여 PCA와 t-SNE를 통해 텍스트 내러티브(Narrative)의 군집 구조를 3차원 공간에 시각화하여 각 감성 범주의 분포 특성을 분석하였다[56]. Greengard 등의 연구는 t-SNE를 통해 자산 가격 결정 요인을 2차원으로 군집화하여 시각화한 후 기존의 PCA 대비 데이터 간 비선형 관계를 효과적으로 표현할 수 있음을 입증하였다[57].

Ⅲ. 연구 방법론

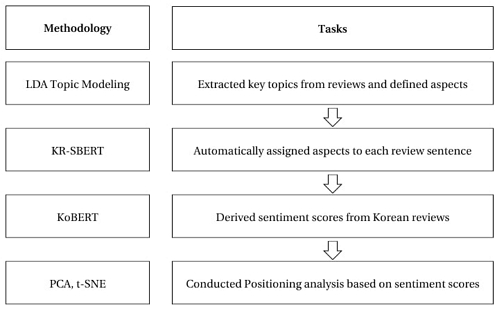

본 연구는 각 단계에서 최적화된 모델로 구성된 다중 모델 방식을 기반으로 리뷰 데이터에서 속성 기반 감성 분석을 수행할 수 있는 방법론을 제안하고 이를 한국에서 제공되는 대표적인 OTT 서비스의 온라인 리뷰를 대상으로 서비스 포지셔닝을 연구하였다. 이를 위해 [그림 1]과 같은 다중 모델을 구축하였다. 먼저 LDA 토픽 모델링을 통해 리뷰의 주요 토픽을 추출하고 이를 기반으로 ABSA에 사용할 리뷰 속성을 정의하였다. 다음으로 한국어 문장 단위 분석에 특화된 KR-SBERT를 통해 문장을 분석하고 리뷰에 속성을 자동으로 할당하였다. 자동으로 속성이 할당된 데이터 세트에 KoBERT 모델을 미세 조정하여 감성 점수를 도출하였다. 마지막으로 다차원 속성에 대한 감성 점수를 토대로 PCA, t-SNE와 같은 포지셔닝 시각화 기법을 시행하였다.

3-1 데이터 탐색

본 연구는 각 OTT 서비스 명칭을 약어로 표기한다. 2025년 1월 한국인 스마트폰 사용자에 대한 표본 조사 결과에 따르면 OTT 서비스 사용 시간 점유율 순위는 NF, TV, CP, WV, DP, WC 순이다[58]. 본 연구는 국내 주요 OTT 앱 시장 점유율 상위 여섯 개의 서비스의 리뷰를 데이터 수집 대상으로 선정하고 안드로이드 기반 앱스토어인 구글 플레이(Google Play)를 데이터 수집을 위한 타겟으로 결정하였다. 고객 리뷰 텍스트 데이터는 2020년 1월 1일부터 2024년 11월 30일 사이에 작성된 리뷰를 Python 크롤링 라이브러리인 google-scraper를 이용한 크롤링으로 수집하였다. 수집한 항목은 사용자 명, 작성 일자, 별점, 리뷰 텍스트, 서비스 버전 정보이다. 이 중 작성 일자, 별점, 리뷰 텍스트를 분석에 사용하였다. 표 1, 표 2는 분석에 사용된 데이터의 정보를 나타낸다. 수집한 리뷰 개수는 총 73,392개로 특수 문자 및 이모티콘 제거, 불용어 제거, 딥러닝 기반의 자동 띄어쓰기를 수행하는 PyoKoSpacing을 이용한 띄어쓰기 보정, 중복 리뷰 제거와 같은 전처리 과정을 거쳤다. 이후 tensorflow.keras 토크나이저를 통해 토큰화 과정을 수행하여 리뷰의 토큰 개수가 5개 미만, 64개 이상인 리뷰를 삭제하여 최종적으로 56,471개의 리뷰를 분석에 사용하였다. 표 2는 별점에 따른 고객 리뷰의 분포로, WC를 제외한 모든 앱 서비스가 1점 리뷰가 제일 많고, 4, 3, 2점 리뷰는 적은 편이며, 5점 리뷰가 1점 리뷰 수와 비슷하거나 적어 J-shape을 띄고 있다[59]. 기계 학습을 위해 전체 데이터를 학습 데이터 70%, 평가 데이터 25%, 미세 조정을 위한 데이터 5%로 나누여 실험을 진행하였다.

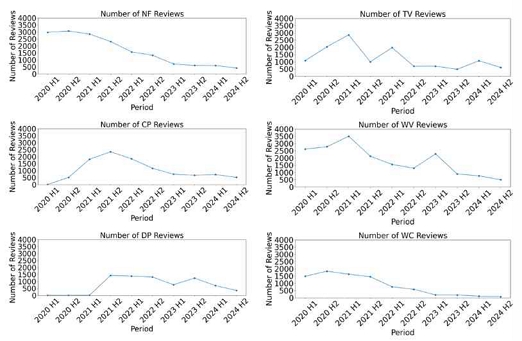

본격적인 분석에 앞서, 분석에 사용할 데이터의 탐색적 분석을 진행하였다. 그림 2는 x축이 날짜, y축이 리뷰 개수를 나타내며 각 앱 서비스별 날짜에 따른 리뷰 개수의 변화를 보여준다. 여섯 개의 서비스별 특징을 살펴보면. 먼저 NF는 2020년과 2021년 초에 리뷰 개수가 급격히 증가하는 패턴을 보이며 이후 지속적인 감소세를 보인 후 점차 평탄한 패턴을 형성한다. TV는 2021년과 2022년 사이에 가장 큰 리뷰 개수 변동을 보이며 이후 비교적 일정한 패턴을 유지하지만, 간헐적인 상승 구간이 존재한다. WV는 2020년과 2021년 동안 여러 차례 급격한 리뷰 개수 증가가 확인되며 이후 점진적으로 리뷰 개수가 감소하는 추이를 보인다. CP는 2021년 중반부터 리뷰 개수가 증가하며 급격한 상승 추세를 보였으나 이후 비교적 일정한 패턴을 유지하며 일부 시기에 급증하는 경향을 보인다. DP는 2021년 한국 출시 이후 급격한 증가 패턴을 보였으나, 리뷰 개수가 급감한 상태에서 일정 수준 유지되고 있다. WC는 2020년과 2021년, 2022년 초반에 리뷰 개수가 급등하였으며 이후 점진적으로 감소하며 일정 추이를 유지한다.

각 서비스의 리뷰 패턴을 분석한 결과 공통적인 패턴과 특징이 도출되었다. 첫째, 서비스 출시 초기에는 리뷰가 급증하는 경향이 있다. 이는 신규 사용자들의 초기 반응 및 평가가 집중되기 때문으로 유추된다. 둘째, 주요 콘텐츠 출시 및 플랫폼 정책 변화가 리뷰 개수에 직접적인 영향을 미친다. 인기 콘텐츠 출시 및 구독 요금 개편은 사용자들의 리뷰 작성 패턴 변화 요인으로 작용한다. 마지막으로 다양한 OTT 서비스가 출시되고 경쟁이 심화함에 따라 연구 기간 전반에 걸쳐서 리뷰 개수의 감소 추세가 관찰된다. 이는 시장 포화 및 사용자의 관심이 감소하는 것과 관련될 가능성이 있다고 판단된다.

표 3, 표 4는 서비스별 등장 빈도수가 높은 단어 10개와 등장 개수를 나타낸 표이다. 리뷰의 토큰은 KoNLPy 패키지에서 제공하는 mecab 형태소 분석기를 사용하여 명사를 추출하였다. 형태소 분석을 위해 Ranks NL에서 제공하는 한국어 불용어 사전을 기반으로 불용어를 정의하였고, 리뷰에 다수 등장하지만, 분석에 불필요한 서비스 명칭을 불용어 사전에 추가하였다. 대부분의 리뷰가 ‘화면’, ‘재생’이 높은 빈도를 보이며, 이외에도 ‘자막’, ‘업데이트’, ‘결제’, ‘영화’가 자주 등장한다. 그림 3은 여섯 개 서비스별로 빈도수 상위 20개의 단어를 워드클라우드를 통해 시각화한 결과다. 워드클라우드는 텍스트 데이터에서 가장 빈번하게 등장하는 단어들을 시각적으로 표현하는 방법으로 직관적이고 효과적인 텍스트 데이터 분석 도구로 사용된다[60]. 그림 3의 워드클라우드 시각화 결과, NF는 ‘화면’, ‘영화’, ‘자막’ 등의 키워드가 크게 나타나며 영상 감상 관련 단어가 다수를 차지했다. TV는 ‘화면’, ‘사용’, ‘드라마’가 주요 키워드로, 콘텐츠 및 재생 관련 단어가 많았다. CP는 ‘화면’, ‘자막’, 플레이‘의 단어가 크게 나타나며, 영상 재생 및 로그인 관련 단어가 포함되었다. WV는 ‘업데이트’, ‘재생’, ‘화면’이 주요 단어로 표현되며, 서비스 이용 및 앱 업데이트 관련 단어가 다수를 차지했다. DP는 ‘자막’, ‘결제’, ‘로딩’이 주요 키워드로 나타나며, 자막 및 결제 관련 키워드가 두드러졌다. 마지막으로 WC는 ‘영화’, ‘결제’, ‘자막’ 단어가 강조되어 콘텐츠 및 결제 관련 단어가 많이 등장했다. 이는 각각의 OTT 서비스에 대한 고객들의 전반적인 리뷰 속성을 파악할 수 있다.

3-2 토픽 모델링

토픽 모델링은 대규모 텍스트 데이터로부터 잠재적인 주제를 자동 추출하는 비지도 학습 기반 텍스트 분석 기법이다. 이는 문서 내 단어 출현 확률을 기반으로 문서-주제-단어 간 관계를 확률적으로 모델링하여 주제를 구성하는 단어 분포를 추정하는 방식이다. 토픽 모델링은 다중 주제의 가중 조합으로 해석하여 비정형 텍스트 데이터의 구조화 및 문서 요약이 가능하다. 대표적인 토픽 모델링 방법론으로는 Blei 등이 제안한 LDA 토픽 모델링이 널리 쓰이며[15], 계층적 확률 분포를 통해 문서 집합의 주제 구조를 체계적으로 분석한다. LDA 토픽 모델링은 문서별 주제 분포와 주제별 단어 분포를 각각 디리클레 분포를 통해 모델링하여 토픽 분포와 단어 분포를 추정한다. 본 연구는 속성 라벨이 없는 OTT 서비스 리뷰 데이터에 대해 ABSA를 수행하기 위해 LDA 토픽 모델링을 적용하여 리뷰로부터 주제를 추출하고 각 토픽에 포함된 주요 키워드와 단어 점수를 분석함으로써 리뷰에 내재된 주요 속성을 도출하였다.

3-3 KR-SBERT를 활용한 자동 속성 할당

본 연구는 한국어 특화 문장 분석 모델인 KR-SBERT를 사용하여 리뷰 문장에 속성을 자동으로 할당하였다. SBERT는 Siamese 네트워크 구조를 적용한 문장 임베딩 모델로, 두 문장을 BERT 기반 인코더에 입력하여 임베딩 벡터를 생성한 후, 벡터의 코사인 유사도 기반으로 문장을 비교한다. 그림 4는 SBERT의 구조를 시각적으로 나타낸 것이다. 먼저 SBERT는 입력 문장을 토크나이징한 후 BERT 인코더를 거쳐 Pooling 과정을 통해 문장 전체를 대표하는 고정 크기의 임베딩 벡터 u, v를 각각 생성한다. 이후 두 벡터의 절댓값 차이(|u - v|)와 함께 u, v를 연결하는 최종 벡터를 구성하며, 이를 기반으로 문장 유사도 계산 및 분류 과업을 수행한다. KR-SBERT는 BERT 기반의 한국어 특화 SBERT 모델로, KorSTS와 KLUE-NLI 데이터 세트를 통해 사전 학습되어, 한국어의 교착어적 특성과 자유로운 어순을 반영하여 문장 의미를 정밀하게 파악할 수 있다.

OTT 서비스 리뷰의 자동 속성 할당 과정은 다음과 같다. 먼저 LDA 토픽 모델링 및 word2vec을 통해 단어 쌍을 추출하고, 이를 기반으로 속성별 단어 사전을 구축하였다. 이후 각 리뷰 문장과 속성별 단어 사전을 KR-SBERT 모델에 입력하여 임베딩 벡터 u, v를 생성하였다. 그림 4와 같이 생성된 리뷰 벡터와 속성 벡터 간 코사인 유사도를 계산하여 유사도가 가장 높은 속성을 해당 리뷰의 주요 속성으로 자동 할당하였다.

본 연구에서는 속성 할당 성능 향상을 위해 베이지안 최적화 알고리즘을 사용하여 효율적으로 하이퍼 파라미터를 탐색하는 Optuna 프레임워크를 사용했다[61]. Optuna 탐색 과정에 배치 사이즈를 16, 32, 64 세 후보로 설정하고, 에포크 수는 5회에서 15회까지 범위에서 조정하였으며, 학습률은 1e-5에서 1e-3 사이의 구간으로 설정하였다. 총 20회의 반복 실험을 통해 최적의 하이퍼 파라미터인 배치 사이즈(Batch size) 64, 에포크 수(Epochs) 15, 학습률(Learning rate) 3.46e-5로 모델 설정 후 모델을 학습하여 전체 리뷰에 대해 속성을 자동 할당하였다. 기존 ABSA는 리뷰 자체의 속성이 기재된 데이터 세트를 사용하거나 수작업으로 속성을 라벨링 해야 하는 한계가 존재하지만, 본 연구는 문장의 문맥을 고려한 의미적 유사성을 바탕으로 자동 속성 할당 방식을 통해 시간과 비용을 절감하고 분석의 정밀도를 높였다[62].

3-4 미세 조정된 KoBERT 기반 ABSA

KoBERT는 Devlin 등이 제안한 BERT 모델 구조를 기반으로 하여 한글의 자모 결합과 형태소 단위 처리를 고려하여 한국어에 최적화된 모델로[28], 오픈 소스 토크나이징 라이브러리인 SentencePiece 토크나이저를 사용하여 어휘를 분할하는 과업을 수행한다[32]. KoBERT의 기본 구조는 Transformer 인코더로 구성되었으며, 입력 문장의 양방향성 문맥 정보를 동시에 고려하여 문장의 의미를 정밀하게 파악할 수 있도록 설계되었다. 입력 문장은 토크나이징 후 임베딩되어, 위치 임베딩 및 세그먼트 임베딩이 추가되고 이를 Transformer 인코더에 전달하여 문맥적 의미를 반영한 고차원 벡터를 생성한다. 최종적으로 [CLS] 토큰의 출력 벡터를 사용하여 감성 분석 결과를 도출한다[32].

본 연구에서는 KoBERT 모델의 감성 분석 과업 적용을 위해 두 단계의 미세 조정을 수행하였다. 먼저 네이버 영화 리뷰를 기반으로 구축된 대규모 감성 분석 데이터 세트(Naver Sentiment Movie Corpus, 이하 NSMC)로 일상적인 감성 표현에 대한 기본 패턴 학습을 수행하였다. 다음으로 도메인 전이 학습(Transfer learning)을 위해 OTT 리뷰 문맥에 적합하게 수동 라벨링 한 1,129개의 도메인 특화 데이터 세트를 구축하여 미세 조정을 수행하였다. 학습 과정은 Kingma과 Ba가 제안한 AdamW 옵티마이저를 적용하였고[63], 최적의 하이퍼파라미터 설정을 위해 Optuna 프레임워크를 사용하였다. Optuna 탐색 범위는 3.3절에 언급된 조건과 동일하다. 그 결과 배치 사이즈 32, 에포크 수 10, 학습률 9.87e-4로 모델 하이퍼 파라미터 설정 후 모델 학습을 진행하였다. 모델 학습을 통해 속성별 감성 점수를 도출하여 다차원 시각화 및 서비스 포지셔닝 분석에 활용하여 서비스를 구체적으로 파악하는 데 사용되었다.

3-5 다차원 시각화

본 연구는 속성 기반 감성 점수를 시장 내 위치를 파악하기 위해 두 가지 시각화 기법을 통해 포지셔닝 분석을 수행하였다. 사용된 시각화 기법은 PCA, t-SNE로 고차원 데이터를 다차원 구조로 시각화하여 서비스 간 차별성 및 개선 방향을 도출하는 데 사용하였다. PCA는 고차원 데이터를 선형 변환하여 가장 큰 분산을 갖는 방향으로 구성하는 차원 축소 기법이다. 본 연구에서 StandardScaler를 이용해 속성 점수를 표준화한 후 2개의 주성분을 도출하고 결과로 생성된 PC1(Principal Component 1)과 PC2(Principal Component 2)를 x, y축으로 설정하여 포지셔닝 분석을 수행하였다. t-SNE는 고차원 데이터의 국소적 구조를 비선형적으로 차원을 축소하는 기법으로, 복잡한 데이터의 국소적 구조나 군집 패턴을 효과적으로 시각화할 수 있다. 본 연구는 t-SNE를 활용하여 OTT 서비스의 감성 점수 분포를 2차원 공간에 투영하여 서비스 간 속성 유사도 및 군집 구조를 직관적으로 분석하였다.

Ⅳ. 결 과

4-1 토픽 추출 및 속성 정의

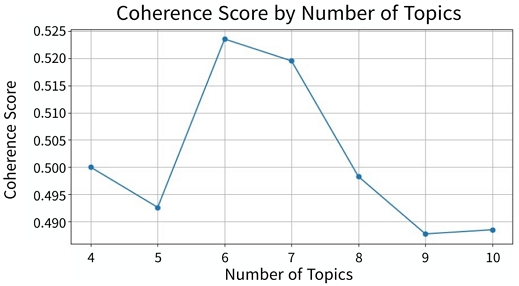

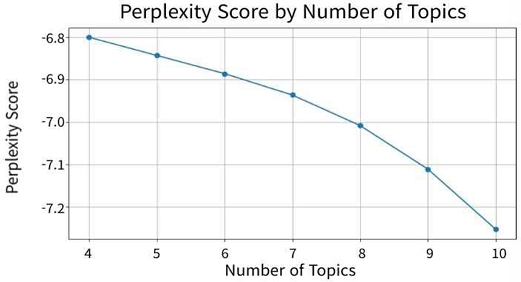

LDA 토픽 모델링 수행 시 토픽 개수 결정 과정에는 Coherence Score, Perplexity Score, PyLDAvis 시각화 결과를 종합적으로 고려하였다. Coherence Score는 토픽 내 단어들의 의미적 일관성을 평가하는 지표로 값이 높을수록 주제 품질이 우수함을 의미한다[64]. Perplexity Score는 모델의 일반화 성능을 평가하는 지표로 값이 낮을수록 모델이 좋은 예측 성능임을 의미한다[15]. 그림 5는 본 연구의 데이터의 토픽 개수별 Coherence Score 변화를 나타낸 그래프로, 토픽 개수가 6개일 때 Coherence Score가 가장 높게 나타나는 것을 확인할 수 있다. 이는 토픽 수가 증가할수록 의미적 응집도가 반드시 향상하는 것이 아니라 일정 수준 이상에서는 오히려 응집도가 감소할 수 있음을 시사한다[65]. 그림 6은 데이터의 토픽 개수별 Perplexity Score 변화를 나타낸 그래프로, 토픽 개수가 증가할수록 Perplexity Score가 지속적으로 감소하는 단조 하강 곡선을 보인다. Perplexity Score는 일반적으로 낮을수록 모델 예측 성능이 우수함을 뜻하지만, 토픽 수가 많아질수록 학습 데이터에 과적합 될 가능성도 함께 증가한다[15],[65]. 따라서 모델 선택에 있어 참고 지표로 활용하되, 해석 가능성 확보를 위해 추가 지표 확인 및 정성적 평가가 병행되어야 한다.

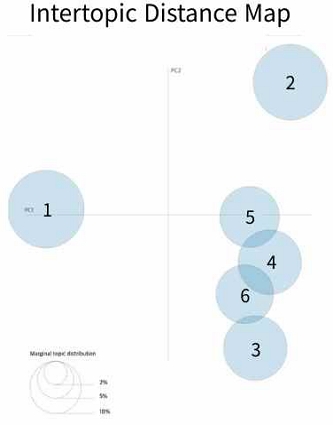

모델 복잡도와 해석 가능성의 균형을 시각적으로 확인하기 위해 pyLDAvis 시각화 기법을 추가로 사용하였다. pyLDAvis는 다차원 척도법(MDS; Multidimensional scaling)을 이용해 토픽 간 상대적 거리를 2차원 평면상에서 시각화하는 도구로 각 토픽의 상호 중복성과 주제 구분의 명확성을 평가하는 데 주로 사용된다[66]. 본 연구의 목적은 서비스 속성 간 관계를 비교하고 분석하는 포지셔닝 분석에 있으므로 토픽 간 균형적인 분포와 독립성이 중요한 기준으로 작용하였다. pyLDAvis의 축인 PC1과 PC2는 고차원 벡터 데이터를 2차원 데이터로 축소하여 최적화한 결과를 나타낸다. 이를 통해 토픽 간의 상대적 거리를 확인할 수 있으며, 토픽 간 분포가 멀리 떨어져 있다면 토픽의 주제가 상반됨을 의미하고, 토픽 분포가 겹쳐있다면 토픽 주제가 일부 중복됨을 뜻한다[66]. 그림 7은 토픽 수를 6개로 설정했을 때 pyLDAvis 결과로, 각 토픽이 데이터 내에 균형적으로 분포하고 주제 구분이 명확하게 이루어지는 것을 보여준다. 그림 8은 토픽 수를 7개로 설정했을 때 결과로, 여러 토픽이 서로 밀집되어 상호 중복성을 확인하였다. 모든 지표를 확인한 결과 토픽 수가 6개일 때 각 토픽이 데이터 내에서 균형적으로 분포하고 상호 중복성이 낮으며 주제 간 명확한 구분이 이루어지는 것으로 판단하여 최종적으로 6개의 토픽 수를 설정하여 분석을 수행하였다.

표 5는 토픽 개수를 6개로 설정 후 LDA 토픽 모델링을 수행하여 도출된 토픽별 단어와 단어 점수(Word Score) 결과를 나타낸다. 이를 통해 토픽별 주요 단어 및 토픽별 성격을 파악하고, 토픽별 단어와 단어 점수를 ABSA 모델 구축 시 속성 정의에 참고 자료로 활용하였다. 단어 점수는 TF-IDF(Term Frequency-Inverse Documen Frequency) 방식을 활용하였으며, 이는 문서 집합 내 특정 단어의 상대적 중요도를 측정하는 통계적 가중치 기법이다. 산출 방식은 (1) ~ (3)의 과정을 거치며 TF-IDF 값이 높을수록 해당 단어가 문서 집합에서 차별적인 중요성을 갖는다[67]. 따라서 TF-IDF 기법으로 토픽 내 단어 점수를 산출하여 단순 빈도수 이상으로 각 단어의 중요도를 반영할 수 있게 한다[68].

| (1) |

| (2) |

| (3) |

표 6은 리뷰의 속성을 정의하기 위해 토픽별 상위 5개 단어와 단어 점수를 토대로 분석에 사용한 최종 속성 4개를 나타낸다. 토픽 모델링 결과를 바탕으로 중복된 속성 및 분석에 불필요한 키워드를 제거한 후 리뷰의 여섯 개의 토픽을 네 가지(콘텐츠, 사용성, 결제/구독, 설치/업데이트/오류) 그룹으로 정의하였다. 첫째 그룹은 토픽 1과 토픽 4로 구성되며 ‘콘텐츠’로 명명하였다. 이는 OTT 서비스의 핵심 요소로, 사용자 만족도에 직접적인 영향을 미치며 OTT 서비스의 지속적인 사용 의도에 강한 영향을 미치는 요인이다[69]. 둘째 그룹은 토픽 2와 토픽 5로 구성되며 ‘사용성’으로 명명하였다. 이는 사용자 인터페이스(UI; User Interface)와 사용자 경험(UX; User Experience)을 포함하는 속성으로 서비스 접근성과 편의성을 결정한다[70]. 셋째 그룹은 토픽 3으로 구성되며 ‘결제/구독’으로 명명하였다. 이는 OTT 서비스의 비즈니스 모델과 직접적으로 연관되며 사용자의 경제적 고려 사항을 반영한다. 손현정과 이상원의 연구는 OTT 서비스의 가격 정책이 서비스 선택에 가장 중요한 요인임을 밝힌 바 있다[71]. 마지막 그룹은 토픽 6으로 구성되며 ‘설치/업데이트/오류’로 명명하였다. 이는 서비스의 기술적인 측면을 다루며 안정성과 신뢰성을 나타낸다. 이 네 가지 속성은 OTT 서비스의 다양한 측면을 균형적으로 평가할 수 있는 구조를 띤다. 이는 권순찬 등의 연구에서 제시된 OTT 서비스의 평가 기준과도 유사성을 보이며 본 연구의 토픽 그룹 분류의 타당성을 뒷받침한다[72].

4-2 속성 자동 할당

리뷰에 자동으로 속성을 할당하기 위해 한국어에 특화된 3개의 SBERT 모델을 본 연구의 데이터 세트를 사용하여 각각 학습시킨 후 비교하였다. 표 7은 한국어 데이터 세트에 자주 사용되는 SBERT 모델(KR-SBERT, Ko-SBERT, roBERTa)을 학습한 결과를 나타낸다. KR-SBERT는 한국어 문장 임베딩 품질 향상을 목적으로 개발된 사전학습 언어 모델로 조사, 어미변화 등 한국어의 언어적 특성을 반영한다. Ko-SBERT는 다중 작업 학습 및 다양한 손실 함수를 도입하여 최적화한 한국어 SBERT 모델로 다양한 태스크(Task) 데이터 세트를 활용하여 미세 조정하였다. roBERTa(Robustly Optimized BERT Approach)는 다국어 및 범용 자연어 처리 분야의 우수한 성능을 보이는 사전학습 언어 모델이다.

본 연구는 가장 좋은 성능을 갖는 모델을 최종 모델로 선택하기 위해 모델의 성능 지표를 확인하였다. BERT 모델의 성능 평가는 일반적으로 정확도(Accuracy), 정밀도(Precision), 재현율(Recall), F1-점수(F1-Score)와 같은 분류 지표를 사용하였고, 이를 통해 성능 결과를 정량적으로 평가할 수 있다[73]. 정확도는 전체 데이터 중 예측 결과가 실제 결과와 일치하는 비율을 의미하며 (4)와 같이 수식화된다. 여기서 TP(True Positive)는 실제 양성을 양성으로 예측함을, TN(True Negative)은 실제 음성을 음성으로 예측함을 의미한다. FP(False Positive)는 실제 음성을 양성으로 예측함을, FN(False Negative)은 실제 양성을 음성으로 예측함을 나타낸다. 정밀도는 모델의 신뢰도를 나타내는 지표로 모델이 양성으로 예측한 표본 중 실제 양성인 표본의 비율을 말하며 (5)처럼 수식화되고, 재현율은 실제 양성 표본 중 모델이 양성으로 올바르게 예측한 비율을 의미하며 (6)처럼 수식화된다. F1-점수는 정밀도와 재현율의 조화평균으로 두 지표의 균형을 평가하며 (7)처럼 수식화고, 클래스 불균형이 존재하는 데이터 세트의 종합적인 분류 성능을 평가하는 데 효과적이다.

| (4) |

| (5) |

| (6) |

| (7) |

표 7의 성능 지표 확인 결과, KR-SBERT 모델의 정확도는 0.5902, Ko-SBERT 모델의 정확도는 0.5385, roBERTa 모델의 정확도는 0.5621로 KR-SBERT 모델의 정확도가 가장 높았다. 또한 f1-score에서도 KR-SBERT 모델이 속성별로 균형 잡힌 예측 성능을 보였다. 따라서 전반적인 성능 지표를 검토하여 KR-SBERT 모델을 최종 모델로 선정하였다. 표 8은 KR-SBERT 모델을 최적화하기 위해 각기 다른 미세 조정을 수행한 결과이다. 미세 조정은 총 3가지로 나누어 수행하였다. 먼저 Softmax 손실 함수를 설정하고, 학습률을 조정한 후 최적의 하이퍼파라미터 도출을 위한 Optuna 패키지를 사용하였다. Softmax 손실함수는 모델의 출력 벡터를 확률 분포로 변환하는 활성화 함수로 분류 정확성의 극대화를 위한 핵심 도구로 사용된다[74]. 학습률은 반복(iteration)마다 가중치를 조정하는 파라미터로, 학습률을 낮출 경우 사전학습 모델이 새로운 데이터 세트의 특성을 과도하게 반영하지 않고 모델에 필요한 부분만 효과적으로 개선할 수 있다[75]. 표 8의 성능 지표 확인 결과 기존 KR-SBERT 모델의 정확도는 0.5901, 기존 모델에 Softmax 손실함수를 적용하고 학습률을 낮춘 미세 조정을 수행한 모델의 정확도는 0.6443, Optuna 프레임워크를 통해 도출한 하이퍼 파라미터값으로 설정한 모델의 정확도는 0.6873으로 가장 좋은 성능을 보였다. 따라서 Optuna 프레임워크를 통해 미세 조정한 KR-SBERT 모델을 속성 자동 할당에 사용할 최종 모델로 선정하였다.

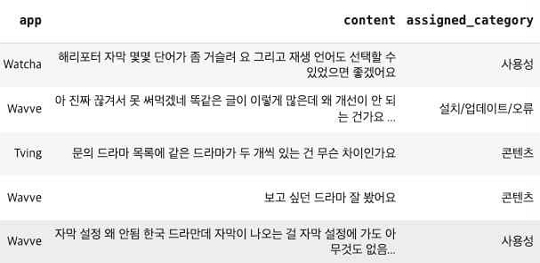

미세 조정된 KR-SBERT 모델을 학습하여 전체 리뷰에 대해 자동으로 속성을 할당하였다. 그림 9는 KR-SBERT 모델로 생성된 데이터 프레임의 예시를 나타낸다. 해당 데이터 프레임은 리뷰가 작성된 OTT 서비스 명칭인 ‘app’, 전처리된 리뷰 텍스트인 ‘content’, KR-SBERT 모델을 통해 자동으로 할당된 속성 카테고리인 ‘assigned_category’로 구성된다. 각 리뷰에 대해 문장의 의미적 특징을 추출하고, LDA 토픽 모델링을 통해 정의된 속성별 단어 사전과 리뷰 문장 간 코사인 유사도를 측정하여 가장 높은 유사도를 보이는 속성을 ‘assigned_category’ 열에 자동으로 할당하였다. 예시로 ‘보고 싶던 드라마 잘 봤어요.’와 같은 리뷰에는 ‘콘텐츠’ 속성이 할당되었고, ‘자막 몇몇 단어가 거슬려요.’ 리뷰에는 ‘사용성’ 속성이 각각 자동 할당되었다.

Sample results of automatically assigned aspects*An image containing Korean text was presented as an example from the actual dataset.

표 9를 통해 OTT 서비스별 속성별 리뷰 개수를 확인하였다. 전체 리뷰 중 ‘설치/업데이트/오류’ 속성이 총 18,809건(37.1%)으로 가장 많은 리뷰가 할당되었다. 이는 구글 플레이에서 기술적 문제와 불만 경험 공유가 빈번하게 나타난다는 점을 시사한다. 다음으로 ‘사용성’ 속성은 11,910건(23.5%)으로 사용자 리뷰 중 상당수가 OTT 앱의 UI/UX, 기능 등 사용 경험에 대한 리뷰가 높은 비중을 차지하고 있다. ‘콘텐츠’ 속성은 11,343건으로 22.4%를 차지한다. 이는 OTT 서비스의 본질적인 경쟁력이 콘텐츠에 있고 사용자가 콘텐츠에 대한 리뷰를 적극 표출하고 있음을 시사한다. 마지막으로 ‘결제/구독’ 속성이 8,661건, 전체 리뷰의 17.1%로 가장 낮은 분포를 보인다.

4-3 감성 점수 도출

서비스별 세부적인 해석을 위해 미세 조정된 KR-SBERT를 통해 속성이 자동 할당된 리뷰의 감성 분석을 수행하여 속성별 감성 점수를 산출하였다. 여기서 미세 조정이란, 사전학습 언어 모델을 특정 도메인 또는 과업에 맞게 추가 학습시키는 과정이다. 본 연구는 모델별 미세 조정을 수행한 후, 4.2절과 같은 방법으로 가장 성능이 우수한 모델을 채택하여 감성 분석을 수행하였다. 표 10은 KoBERT 모델별 성능 지표를 나타낸다. 모델의 옵티마이저는 AdamW 옵티마이저를 적용하였고, 학습률 1e-5, 배치 사이즈 16, 에포크 5로 설정한 후 학습을 진행하였다.

기본 KoBERT 모델은 전반적인 F1-score와 재현율 지표가 매우 낮아 성능이 미흡하였다. 특히 ‘결제/구독’, ‘콘텐츠’ 속성에서 recall이 각 0.0122, 0.0146으로 실제 감성 구분 능력이 제한적이었다. 이에 성능 개선을 위해 한국어 감성 표현에 특화된 NSMC 데이터 세트로 미세 조정한 모델을 적용하였다. NSMC 데이터 세트는 한국어 영화 감상 리뷰 데이터 세트로, 한국어 자연어 처리 연구에 미세 조정 목적으로 널리 사용된다. NSMC 데이터 세트로 미세 조정한 모델은 전반적으로 성능이 향상되었지만, NSMC 데이터 세트가 영화 리뷰에 특화되어 있어 OTT 리뷰 도메인의 문맥과 표현을 충분히 반영하지 못했을 가능성이 있다. 이에 도메인 적합성을 보완하고자 본 연구에서 수집한 데이터 세트의 약 5%를 추출하고 이를 연구자가 수작업으로 리뷰에 긍정, 부정 라벨링(manual labels) 하여 NSMC 데이터 세트와 결합한 후 미세 조정을 수행하였다. 이 과정을 통해 NSMC가 포괄하지 못하는 OTT 리뷰 도메인의 문맥 및 표현을 보완하였다. 표 10의 성능 지표를 비교한 결과, NSMC+도메인 전이 데이터 세트로 학습한 모델이 전반적으로 가장 높은 정확도(0.8696)와 속성별 F1-score(최대 0.9201)를 기록하며 대부분의 속성 성능 편차 없이 안정적인 결과를 나타냈다. 특히 OTT 리뷰 특유의 문맥을 충분히 반영하기 위해 도메인 전이를 고려한 수작업 라벨링 데이터 세트를 통합한 결과, 성능과 도메인 적합성 모두 일정 수준 이상을 충족하는 결과를 얻었다. 따라서 해당 모델을 통해 리뷰의 감성 분석을 수행한 후 리뷰별 감성 점수를 도출하였다.

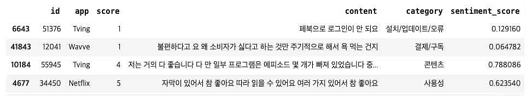

그림 10은 미세 조정된 KoBERT 모델을 학습하여 전체 리뷰에 대해 감성 분석을 수행한 데이터 프레임의 예시를 나타낸다. 해당 데이터 프레임은 리뷰가 작성된 OTT 서비스의 명칭인 ‘app’, 전처리된 리뷰 텍스트인 ‘content’, KR-SBERT를 통해 자동 할당된 속성인 ‘category’, 미세 조정된 KoBERT 모델을 통해 감성 분석을 수행한 결과인 감성 점수를 나타내는 ‘sentiment_score’로 구성된다. 감성 점수는 1에 근접할수록 긍정의 의미를, 0에 근접할수록 부정의 의미를 나타낸다. 예시로 긍정적인 문맥의 리뷰인 “저는 거의 다 좋습니다.” 문장의 감성 점수는 약 0.79로 도출되었고, “불편하다고요.”와 같은 부정적인 문맥의 리뷰는 0.06으로 도출됨을 확인할 수 있다.

Sample results of the dataset used for sentiment analysis*An image containing Korean text was presented as an example from the actual dataset.

표 11은 OTT 서비스의 속성별 감성 점수를 정리한 결과를 보여준다. 먼저 ‘결제/구독(Subscription/Payment)’ 속성은 CP가 가장 높은 점수(0.4307)를 나타냈으며, TV(0.4060), WC(0.3975) 순으로 뒤를 이었다. ‘사용성(Usability)’ 속성은 WC가 가장 높은 점수(0.6161)를 보였고, TV(0.5975), WV(0.5442) 순서로 나타났다. ‘설치/업데이트/오류(Installation/Update/Error)’ 속성은 대부분의 서비스가 0에 근접한 부정 점수를 보였으며 그중에서 WC가 상대적으로 높은 점수(0.2470)를 보였다. 마지막으로 ‘콘텐츠(Content)’ 속성은 WC가 가장 높은 점수(0.6983)를 보였으며 TV가 바로 뒤를 이어 0.6893을 기록하였다. 표 12는 감성 분석 결과에 타당성을 뒷받침하기 위해 구글 플레이의 서비스별 별점 정보를 제시한다. 해당 결과에서도 WC가 ‘사용성(Usability)’, ‘콘텐츠(Content)’, ‘설치/업데이트/오류(Installation/Update/Error) 항목에서 높은 평가를 받았으며, 이는 표 11의 감성 점수와 유사한 추세를 보인다.

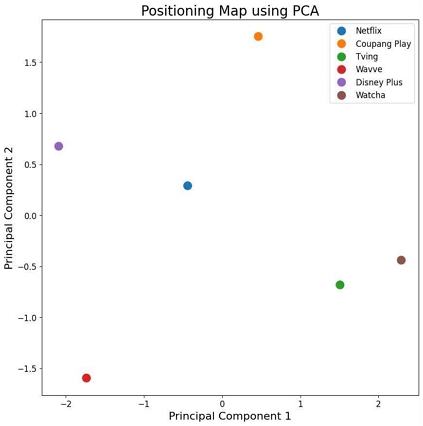

4-4 포지셔닝 분석

4.3절에서 도출한 감성 점수를 이용하여 국내 OTT 서비스 포지셔닝 분석을 수행하였다. 이를 위해 서비스 간 상대적 위치를 시각화하는 PCA와 t-SNE 기법을 적용하였다. 두 기법 모두 데이터 간 유사성과 차이를 표현한다는 공통점이 있으나, 차원 축소 기법 구현 방법과 해석 기준에서 본질적인 차이가 존재한다. 그림 11은 PCA를 통해 도출한 2차원 포지셔닝 맵으로, 고차원 벡터를 주요 분산 방향으로 공간을 변환하는 차원 축소 기법이다. PCA의 X축과 Y축은 데이터 분산 방향인 PC1, PC2로 구성되며, 리뷰의 네 가지 속성(콘텐츠, 사용성, 결제/구독, 설치/업데이트/오류)에 대한 선형 결합 결과이다. PCA에서 서로 인접한 서비스일수록 속성 전반의 평균적 감성 점수 패턴이 유사하고, 멀리 떨어진 서비스는 속성 전반에 걸친 감성 분석 결과의 경향이 상이함을 뜻한다[8]. 그림 11을 통해 WC와 TV는 서로 근접한 위치에 있는 것을 확인하였고, 이는 두 서비스가 전반적으로 유사한 사용자 감성 패턴을 받고 있음을 시사한다. 반면 CP와 DP는 대조적인 위치에 있어 서비스 특성에 대한 감성 패턴이 확연히 다르다는 점을 보여준다. WV는 다른 서비스와 떨어진 위치에 있어, 이는 감성 점수 분포가 다른 서비스와 상이하고 독립적인 사용자 감성 인식을 형성하고 있음을 의미한다. 또한 NF는 포지셔닝 맵의 중심에 위치하여 상대적으로 균형 잡힌 속성별 감성 점수 구조, 즉 중립적인 감성 분석 결과를 나타낸다.

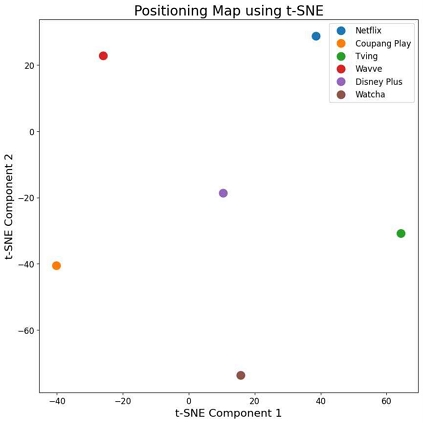

한편 그림 12는 t-SNE를 통해 생성된 2차원 포지셔닝 맵으로, 전체 평균 점수보다 특정 속성에서 유사한 평가를 받은 서비스 간 상대적 관계를 잘 드러낸다. 즉, 서비스가 전반적으로 상이하더라도, 일부 속성에서 유사한 점수를 보이는 경우 근접하게 위치할 수 있다[76]. 그림 12를 통해 각 서비스가 t-SNE 맵 상에서 명확히 분산된 위치를 보이며, 이를 통해 감성 분석 결과 기반 서비스 간 차별화된 특성을 도출할 수 있다. 그림 12를 통해 서비스를 분석한 결과, NF는 맵의 좌하단에 위치하여 다른 서비스와 평가 패턴 차이가 가장 크며, 사용자 리뷰에서 독립적인 감성 점수 구조를 보였다. CP는 맵의 좌상단에 자리하며, 일부 속성에서 강하게 편중된 평가가 나타나는 것으로 해석된다. TV는 우측 중반에 위치하여, 일부 속성에서 타 서비스와 차별적인 감성 패턴을 보였을 가능성이 있다. WV는 우측 하단에 위치하여, 이 또한 타 서비스와 구별되는 감성 분석 결과를 보였다. DP는 좌측 상단에 위치하여, 이는 다른 서비스와 일부 속성에서 유사하지만, 동시에 특정 평가 항목에서는 분명한 차별성을 지님을 시사한다. WC는 맵의 중앙에 위치하며, 이는 전반적으로 속성별 감성 점수가 특정 서비스에 편향되지 않고, 균형적으로 형성되어 있음을 의미한다.

차원 축소 기법을 활용한 포지셔닝 분석 결과, PCA와 t-SNE 모두 감성 점수 기반의 OTT 서비스 위치를 시각화하였고 각 서비스가 포지셔닝 결과에서 뚜렷한 차이를 보이는 점을 확인하였다. 두 시각화 기법은 서로 다른 방식으로 데이터를 축소하고 시각화하므로, 두 기법을 병행한 분석 결과를 사용하면 다각적 해석을 가능하게 하였다. 즉, PCA 맵은 서비스 간 감성 점수의 전반적인 분포와 경향성을 파악하는 데 효과적이고 t-SNE 맵은 속성별 감성 점수 구조의 상대적 차이를 더욱 명확히 표현한다[77]. 이를 통해 OTT 서비스의 구조적 특성 및 차별성을 시각적으로 확인할 수 있어, 향후 사용자 리뷰 기반의 연구 수행 및 실무적 시사점을 도출할 수 있을 것이다.

OTT 서비스의 종합 해석을 위해 서비스별 단어 점수 결과인 4.1절의 표 6, 속성 기반 감성 점수인 4.3절의 표 11, 그리고 서비스 포지셔닝 맵 결과인 그림 11과 그림 12를 종합적으로 고려하여 다음과 같은 서비스별 포지셔닝 해석을 도출하였다.

NF는 콘텐츠 관련 단어 빈도가 높고, PCA 맵에서 중심에 위치하여 전반적으로 균형적인 속성별 감성 점수 분포를 보였다. 그러나 오류 및 화질 관련 단어의 빈번하게 출현하고, 기술적 항목에서 개선 필요성이 드러났다.

TV는 사용성 관련 단어가 다수 등장하였고 해당 속성의 감성 점수도 높게 나타났다. PCA 맵에서 WC와 근접하게 위치하였으나, t-SNE 맵에서는 멀리 떨어져 있어 일부 속성에서 차이가 있었음을 시사한다.

CP는 결제/구독 속성에서 상대적으로 높은 감성 점수를 보였고 관련 단어도 빈번하게 출현하였다. 포지셔닝 맵은 PCA의 중심 상단에 위치하고, t-SNE 맵의 좌측에 위치하여 타 서비스와의 거리 차가 났고, 이는 특정 속성에서 편향이 존재함을 뜻한다. 또한 콘텐츠 속성에서 상대적으로 낮은 단어 출현 빈도와 감성 점수를 기록하였다.

WV는 설치/업데이트/오류 관련 단어의 출현 비율이 높으며, 해당 속성의 감성 점수는 전체 서비스 중 가장 낮았다. 두 가지 포지셔닝 맵에서 모두 다른 서비스와 가장 멀리 떨어져 있으며, 이는 대부분의 속성이 타 서비스와 상이함을 의미한다. 전반적으로 감성 점수 분포가 고르지 않아 개선 여지가 확인된다.

DP는 네 가지 속성 모두 단어 출현이 비교적 균형적으로 분포하였고, 감성 점수 또한 전체적으로 평균적인 수준을 보인다. PCA 맵과 t-SNE 맵 모두 좌측 상단에 위치하여 일부 속성에서 타 서비스와 상대적 거리 차이를 확인하였다. 특정 속성에서 강점은 명확히 드러나지 않았으나, 전반적으로 평이한 수준의 평가를 보인다.

마지막으로 WC는 콘텐츠 속성의 단어 출현이 가장 뚜렷하며, 해당 속성의 감성 점수 또한 높은 수준을 기록하였다. PCA 맵에서 TV와 유사한 위치에 존재하며, 콘텐츠, 사용성 속성에서 일정 수준 평가 유사성을 보인다. t-SNE 맵의 중앙에 위치하여 모든 속성 전반에 걸쳐 균형적인 감성 점수 분포를 나타낸 것으로 해석된다.

Ⅴ. 토 론

본 연구는 각 단계에 최적화된 NLP 모델을 결합한 다중 모델 분석 체계를 구축하였으며, 이를 통해 OTT 서비스의 사용자 인식과 차별성을 다각도로 해석하고자 하였다. 본 연구의 기여점은 다음과 같다. 첫째, 기존 ABSA 연구의 한계를 극복하고자 속성 정의, 속성 자동 할당, 감성 분석, 시각화까지 전 과정을 통합한 한국어 기반 다중 모델 분석 프레임워크를 구축하였다. 기존 연구에서는 영어 데이터 세트 위주의 ABSA 연구가 주로 수행되었기에 한국어 환경의 확장 가능성에 한계가 존재하였다. 또한 ABSA 수행 시 수작업 라벨링에 의존하거나 속성이 기재된 데이터 세트를 사용하였기에 분석에 활용할 수 있는 데이터 세트 자체의 한계가 있었다[78]. 이에 반해 본 연구는 LDA 토픽 모델링을 통해 데이터 세트의 주요 속성을 정의하고, word2vec 단어 벡터를 통해 속성 사전을 구축하여 KR-SBERT 모델의 의미적 유사도 계산에 활용하여 문장 단위 속성 자동 할당을 실현하였다. 기존 KR-SBERT 모델의 분류 정확도는 59.02% 수준이었으나, Optuna 기반 하이퍼파라미터 최적화를 통해 배치 사이즈, 학습률, 에포크 수를 조정하여 최종적으로 68.7%의 정확도를 달성하였다. 이는 기존 모델 대비 속성 분류의 신뢰도 효율성을 동시에 개선한 성과로 평가할 수 있다.

둘째, KoBERT 모델을 통한 기존 감성 분석 연구의 대부분은 미세 조정 시 NSMC 데이터 세트를 활용하였지만[8], 본 연구는 미세 조정 시 리뷰 데이터 세트 도메인에 특화된 라벨링 데이터 세트를 NSMC 데이터 세트에 결합하여 도메인 적합도를 개선하였다. 그 결과 ‘사용성’ 속성의 F1-score는 NSMC 데이터 세트만 사용한 모델은 0.8357인 것에 비교하여 NSMC 데이터 세트에 라벨링 데이터 세트를 결합한 모델은 0.8532로 약 2% 정도 개선된 성능을 보였다. 이처럼 도메인 특화 미세 조정을 수행하여 모델의 모든 성능 지표가 향상되었으며, 감성 분석 시 도메인 특화 데이터 세트 구축의 중요성을 입증하였다.

셋째, PCA와 t-SNE 시각화 기법을 활용한 포지셔닝 분석은 단순 감성 분석 결과를 나열하지 않고, 시각화 기법을 통해 서비스 사용자의 감성 기반 상대적 위치를 파악할 수 있었다. 기존 포지셔닝 분석은 단일 속성 혹은 키워드 중심의 클러스터링을 사용한 연구가 대부분이었지만, 본 연구는 속성 기반 감성 분석 결과를 정량적으로 도출하여 시각화함으로써 서비스 간 유사성과 차별성을 동시에 파악할 수 있도록 하였다.

본 연구는 다음과 같은 한계를 갖는다. 첫째, 본 연구는 분석 대상을 국내 OTT 서비스로 한정하여 연구 결과를 글로벌 OTT 시장에 일반화하지 않았다. 서비스 특성과 사용자 환경이 국가별로 차이가 있기에, 동일한 분석 프레임워크를 해외 서비스에 그대로 적용할 경우 해석 정확도가 저하될 가능성이 있어, 글로벌 플랫폼을 포함한 교차 국가 비교 분석이 필요하다.

둘째, 본 연구에 사용한 수집 데이터 세트는 2020년부터 2024년 11월까지의 특정 기간에 한정되었으며, 해당 시점 이전이나 이후 서비스 변화나 사용 패턴 변화가 반영되지 않았다. 또한 리뷰는 구글 플레이 단일 플랫폼으로 수집되었기에 다른 운영체제 환경의 사용자 경험이 충분히 반영되지 못하였으며, 이에 따른 표본 편향의 가능성이 존재한다. 이에 따라 서비스 출시 초기, 서비스 정책 변경 등과 같이 특정 시점의 데이터 추세를 파악하는 것은 한계가 있다. 따라서 장기 시계열 데이터를 구축하여 서비스별 특정 시점에 데이터 추이 및 감성 패턴 변화를 포착할 수 있는 분석 프레임워크로 확장할 필요성이 있다.

셋째, 본 연구에 속성 자동 할당 시 사용된 KR-SBERT 모델은 속성 라벨링 과정에서 완전한 정확도를 보장하지 못한다. 이는 라벨이 없는 데이터 세트에 자동으로 속성을 할당하여 효율적으로 한국어 속성 자동 할당을 위한 시도로서의 방법론적 가치를 갖기에 향후 정교한 모델 보완을 통해 개선할 가능성이 있다.

넷째, 속성별 데이터 분포에 있어 불균형 문제가 존재한다. 특히 ‘결제/구독’, ‘설치/업데이트/오류’ 속성에 비해 ‘콘텐츠’, ‘사용성’ 속성에 대한 리뷰 수가 상대적으로 적게 나타났다. 이에 따라 ABSA 과정 중 특정 속성의 모델 학습이 상대적으로 제한되었으며, 포지셔닝 분석에서도 속성 간 영향력 편차가 발생할 수 있다. 데이터 불균형 문제를 해결하기 위해 향후 연구에서 속성 균형을 보완한 표본 구성 및 데이터 증강 기법과 같은 전략이 필요하다[79].

향후 연구에서 위의 한계점을 보완하여 다음과 같이 연구를 확장할 수 있을 것이다. 첫째, 시계열 분석 체계를 구축하여 사용자 감성의 실시간 변화를 파악할 수 있을 것이다. 서비스 개편과 같은 특정 시점의 감성 추이를 분석하여 서비스 정책에 대한 사용자 피드백을 정량적으로 파악할 수 있으며, 장기적인 감성 패턴을 도출하여 리뷰 기반 모니터링 및 대응 시스템 구축이 가능할 것이다. 둘째, 분석 프레임워크에 사용된 사전학습 언어 모델의 다양성을 넓혀 다국어 대상 분석 및 특정 언어 특화 모델에 적용하고 정확도를 비교할 수 있다. 이를 통해 특정 도메인 및 언어에 최적화된 언어 모델을 선별할 수 있을 것이다. 셋째, 국내 OTT 시장 분석에 한정하지 않고 글로벌 OTT 서비스 시장 전반을 분석하는 포지셔닝 연구로 확장도 가능할 것이다. 이를 위해서는 데이터 세트 개수를 늘려 특정 속성의 불균형 문제를 해소하고, 다국어 언어 모델의 정확도를 향상하는 노력이 필요할 것이다.

Ⅵ. 결 론

본 연구는 다음과 같은 실무적 함의를 제공한다. 첫째, 속성별 감성 점수를 통해 서비스의 주요 특성을 수치화하여 고객 만족도 및 서비스 운영 진단에 활용할 수 있다. 예시로 CP는 ‘결제/구독’ 속성에서 타 서비스 대비 가장 높은 평균 감성 점수를 기록하여 서비스 구독 및 유료 결제에 대한 사용자 인식이 긍정임을 알 수 있고, NF는 ‘설치/업데이트/오류’ 속성에서 낮은 감성 점수를 기록하여 서비스의 기술적 개선이 필요한 것으로 판단되었다.

둘째, 포지셔닝 맵을 활용한 분석 결과는 서비스의 사용자 인식을 시각적으로 비교 가능하여 타 서비스와의 상대적 위치를 파악하고 차별화 전략 수립의 근거로 활용할 수 있을 것이다. WC와 TV의 경우는 ‘콘텐츠’와 ‘사용성’ 속성에서 유사한 특징을 보이는데, 이는 두 서비스가 유사한 사용자 감성을 지니고 있기에 속성 차별화를 통한 서비스 정체성 강화가 필요함을 뜻한다. 이에 따라 각 서비스의 감성 점수가 낮은 속성을 파악하여 사용자 이탈 방지 전략을 강화할 수 있을 것이다.

셋째, 본 연구에서 제안한 분석 프레임워크는 OTT 서비스 외에도 다양한 플랫폼 산업에서 서비스 품질 진단 도구로 활용할 수 있다. 본 연구에서 사용된 속성과 더불어 서비스의 리뷰를 통해 산업에 맞는 속성 정의를 통하여 사용자의 의견을 정량화한 후 서비스 개편에 근거로 제시할 수 있다. 따라서 본 연구의 프레임워크는 다양한 산업에 확장 가능하며 다양한 서비스의 고객 모니터링, 경쟁 서비스 비교 및 차별화 전략 수립 자료로 실무적 기여가 가능하다.

References

- Consumers Union of Korea. Cumulative Number of Reviews Matters: Consumers Tend to Avoid Purchases when Reviews are Missing or Negative [Internet]. Available: https://cuk.or.kr/information/01_view.asp?no=1019, .

-

J. Guerreiro and P. Rita, “How to Predict Explicit Recommendations in Online Reviews Using Text Mining and Sentiment Analysis,” Journal of Hospitality and Tourism Management, Vol. 43, pp. 269-272, June 2020.

[https://doi.org/10.1016/j.jhtm.2019.07.001]

-

N. Malik and M. Bilal, “Natural Language Processing for Analyzing Online Customer Reviews: A Survey, Taxonomy, and Open Research Challenges,” PeerJ Computer Science, Vol. 10, e2203, 2023.

[https://doi.org/10.7717/peerj-cs.2203]

-

X. Zhang, L. Zhang, and D. Zhou, “Sentiment Analysis on Streaming User Reviews via Dual-Channel Dynamic Graph Neural Network,” in Proceedings of the 2023 Conference on Empirical Methods in Natural Language Processing (EMNLP), Singapore, pp. 7208-7220, 2023.

[https://doi.org/10.18653/v1/2023.emnlp-main.446]

- B. Liu, Sentiment Analysis and Opinion Mining. London, UK: Springer Nature, 2022.

-

P. S. Manhas, “Strategic Brand Positioning Analysis Through Comparison of Cognitive and Conative Perceptions,” Journal of Economics Finance and Administrative Science, Vol. 15, No. 29, pp. 15-34, 2010.

[https://doi.org/10.46631/jefas.2010.v15n29.02]

- F. A. Konuk and O. K. Altuna, “Brand Positioning through Multidimensional Scaling: A Study in the Turkish Shampoo Market,” International Journal of Social Sciences and Humanity Studies, Vol. 3, No. 2, pp. 193-208, 2011.

-

M. Kim and H. J. Lee, “Positioning Analysis of Mobile App Services Using Customer Reviews: Focusing on Telemedicine Apps,” Journal of Intelligence and Information Systems, Vol. 29, No. 4, pp. 69-90, December 2023.

[https://doi.org/10.13088/jiis.2023.29.4.069]

-

C. Wang, Z. Xio, Y. Liu, Y. Xu, A. Zhou, and K. Zhang, “SentiView: Sentiment Analysis and Visualization for Internet Popular Topics,” IEEE Transactions on Human-Machine Systems, Vol. 43, No. 6, pp. 620-630, November 2013.

[https://doi.org/10.1109/thms.2013.2285047]

-

X. Wang, J. He, D. J. Curry, and J. H. Ryoo, “Attribute Embedding: Learning Hierarchical Representations of Product Attributes from Consumer Reviews,” Journal of Marketing, Vol. 86, No. 6, pp. 155-175, 2022.

[https://doi.org/10.1177/00222429211047822]

-

N. L. Rane, P. Desai, J. Rane, and S. K. Mallick, “Using Artificial Intelligence, Machine Learning, and Deep Learning for Sentiment Analysis in Customer Relationship Management to Improve Customer Experience, Loyalty, and Satisfaction,” in Trustworthy Artificial Intelligence in Industry and Society, London, UK: Deep Science Publishing, pp. 233-261, October 2024.

[https://doi.org/10.70593/978-81-981367-4-9_7]

- MezzoMedia, OTT Industry Analysis Report, MezzoMedia, Seoul, Technical Report No. 6, pp. 1-6, Mar 2024.

-

S. Gupta and R. Tomar, “What Drives the User’S Continuous Usage Intention of OTT Video Platforms? Identifying the Role of Cognitive Absorption and Perceived Usefulness with the Impact of OTT Content on it,” International Journal of Professional Business Review, Vol. 8, No. 4, e01494, April 2023.

[https://doi.org/10.26668/businessreview/2023.v8i4.1494]

-

H. Sharma, S. Pangaonkar, R. Gunjan, and P. Rokade, “Sentimental Analysis of Movie Reviews Using Machine Learning,” in Proceedings of the 2nd International Conference on Data Science and Intelligent Applications (ICDSIA-2023), Vol. 53, 02006, June 2023.

[https://doi.org/10.1051/itmconf/20235302006]

-

D. M. Blei, A. Y. Ng, and M. I. Jordan, “Latent Dirichlet Allocation,” Journal of Machine Learning Research, Vol. 3, pp. 993-1022, 2003.

[https://doi.org/10.1162/jmlr.2003.3.4-5.993]

-

R. Alghamdi and K. Alfalqi, “A Survey of Topic Modeling in Text Mining,” International Journal of Advanced Computer Science and Applications (IJACSA), Vol. 6, No. 1, pp. 147-153, 2015.

[https://doi.org/10.14569/IJACSA.2015.060121]

-

L. Muchene and W. Safari, “Two-Stage Topic Modelling of Scientific Publications: A Case Study of University of Nairobi, Kenya,” PLoS One, Vol. 16, No. 1, e0243208, 2021.

[https://doi.org/10.1371/journal.pone.0243208]

-

L. George and P. Sumathy, “An Integrated Clustering and BERT Framework for Improved Topic Modeling,” International Journal of Information Technology, Vol. 15, pp. 2187-2195, May 2023.

[https://doi.org/10.21203/rs.3.rs-1986180/v1]

-

D. F. Surianto and D. F. Surianto, “Enhancing K-Means Clustering for Journal Articles Using TF-IDF and LDA Feature Extraction,” Brilliance: Research of Artificial Intelligence, Vol. 4, No. 2, pp. 964-972, 2025.

[https://doi.org/10.47709/brilliance.v4i2.5547]

-

D. Blei, L. Carin, and D. Dunson, “Probabilistic Topic Models,” IEEE Signal Processing Magazine, Vol. 27, No. 6, pp. 55-65, October 2010.

[https://doi.org/10.1109/msp.2010.938079]

-

J. Joung and H. M. Kim, “Automated Keyword Filtering in Latent Dirichlet Allocation for Identifying Product Attributes from Online Reviews,” Journal of Mechanical Design, Vol. 143, No. 8, 084501, August 2021.

[https://doi.org/10.1115/1.4048960]

-

T. Ali, O. Bencharef, and S. Kaloun, “Analyzing Tourism Reviews Using an LDA Topic-Based Sentiment Analysis Approach,” MethodsX, Vol. 9, 101894, 2022.

[https://doi.org/10.1016/j.mex.2022.101894]

-

C.-M. Kim, A.-R. Jo, and Y.-K. Kim, “Reviews Analysis of Korean Clinics Using LDA Topic Modeling,” Journal of Korean Medicine, Vol. 43, No. 1, pp. 73-86, March 2022.

[https://doi.org/10.13048/jkm.22007]

-

M. Nesca, A. Katz, C. Leumg, and L. Lix, “A Scoping Review of Preprocessing Methods for Unstructured Text Data to Assess Data Quality,” International Journal of Population Data Science, Vol. 7, No. 1, 1757, October 2022.

[https://doi.org/10.23889/ijpds.v7i1.1757]

-

A. Daza, N. D. G. Rueda, M. S. A. Sánchez, W. F. R. Espíritu, and M. E. C. Quiñones, “Sentiment Analysis on E-Commerce Product Reviews Using Machine Learning and Deep Learning Algorithms: A Bibliometric Analysis and Systematic Literature Review, Challenges and Future Works,” International Journal of Information Management Data Insights, Vol. 4, No. 2, 100267, November 2024.

[https://doi.org/10.1016/j.jjimei.2024.100267]

-

I. Bouabdallaoui, F. Guerouate, S. Bouhaddour, C. Saadi, and M. Sbihi. A Hybrid Latent Dirichlet Allocation - BERT Approach for Topic Discovery of Market places [Internet]. Available:

[https://doi.org/10.21203/rs.3.rs-1674353/v1]

-

H. Wang, J. Li, H. Wu, E. Hovy, and Y. Sun, “Pre-Trained Language Models and Their Applications,” Engineering, Vol. 25, pp. 51-65, June 2023.

[https://doi.org/10.1016/j.eng.2022.04.024]

-

J. Devlin, M.-W. Chang, K. Lee, and K. Toutanova, “BERT: Pre-Training of Deep Bidirectional Transformers for Language Understanding,” in Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, Minneapolis, MN, pp. 4171-4186, June 2019.

[https://doi.org/10.48550/arXiv.1810.04805]

-

P. S. Ghatora, S. E. Hosseini, S. Pervez, M. J. Iqbal, and N. Shaukat, “Sentiment Analysis of Product Reviews Using Machine Learning and Pre-Trained LLM,” Big Data and Cognitive Computing, Vol. 8, No. 12, 199, December 2024.

[https://doi.org/10.3390/bdcc8120199]

-

K. Yang, “Transformer-based Korean Pretrained Language Models: A Survey on Three Years of Progress,” arXiv:2112.03014, , November 2021.

[https://doi.org/10.48550/arXiv.2112.03014]

-

J.-W. Lee, W.-S. Jo, and T.-H. Kim, “Design and Implementation of an Interactive Search System Based on KoBERT,” Journal of Knowledge Information Technology and Systems, Vol. 17, No. 5, pp. 1081-1088, October 2022.

[https://doi.org/10.34163/jkits.2022.17.5.028]

-

M. Gu and J. P. Jeong, “Comparison of KoBERT and BERT for Emotion Classification of Healthcare Text Data,” in Proceedings of the 2023 14th International Conference on Information and Communication Technology Convergence (ICTC), Jeju, pp. 1771-1775, October 2023.

[https://doi.org/10.1109/ICTC58733.2023.10393750]

-

J. Gwak and Y. C. Jung, “Enhancing the Pperformance of Low-Resource Text Classification through KoBERT-based Category Mapping and LLM Integration,” Journal of Korean Institute of Information Technology, Vol. 23, No. 1, pp. 1-11, January 2025.

[https://doi.org/10.14801/jkiit.2025.23.1.1]

-

J. Yang, C. Lee, and S. B. Kim, “Development and Utilization of Voice Phishing Prevention Service through KoBERT-Based Voice Call Analysis,” KIISE Transactions on Computing Practices, Vol. 29, No. 5, pp. 205-213, May 2023.

[https://doi.org/10.5626/KTCP.2023.29.5.205]

-

E. Kim, S.-J. Nam, T. Kim, and T. Hong, “The Prediction of Review Helpfulness by Integrating Large Language Models and Deep Learning Based on KoBERT and KoGPT2,” Journal of Intelligence and Information Systems, Vol. 30, No. 2, pp. 195-209, June 2024.

[https://doi.org/10.13088/jiis.2024.30.2.195]

-

H. Kim, “A Study on Brand Image Analysis of Gaming Business Corporation Using KoBERT and Twitter Data,” Journal of the Korea Game Society, Vol. 21, No. 6, pp. 75-85, December 2021.

[https://doi.org/10.7583/JKGS.2021.21.6.75]

-

N. Reimers and I. Gurevych, “Sentence-BERT: Sentence Embeddings Using Siamese BERT-Networks,” arXiv:1908.10084, , August 2019.

[https://doi.org/10.48550/arXiv.1908.10084]

-

Y. Santander-Cruz, S. Salazar-Colores, W. J. Paredes-García, H. Guendulain-Arenas, and S. Tovar-Arriaga, “Semantic Feature Extraction Using SBERT for Dementia Detection,” Brain Sciences, Vol. 12, No. 2, 270, February 2022.

[https://doi.org/10.3390/brainsci12020270]

-

M. Al Sulaiman, A. M. Moussa, S. Abdou H. Elgibreen, M. Faisal, M. Rashwan, “Semantic Textual Similarity for Modern Standard and Dialectal Arabic Using Transfer Learning,” PLoS One, Vol. 17, No. 8, e0272991, 2022.

[https://doi.org/10.1371/journal.pone.0272991]

-

J. Ham, Y. J. Choe, K. Park, I. Choi, and H. Soh, “KorNLI and KorSTS: New Benchmark Datasets for Korean Natural Language Understanding,” arXiv:2004.03289, , April 2020.

[https://doi.org/10.48550/arXiv.2004.03289]

-

Y. Park and Y. Shin, “Using Multiple Monolingual Models for Efficiently Embedding Korean and English Conversational Sentences,” Applied Sciences, Vol. 13, No. 9, 5771, May 2023.

[https://doi.org/10.3390/app13095771]

-

Y. Nie, “Automated Essay Scoring with SBERT Embeddings and LSTM-Attention Networks,” PeerJ Computer Science, Vol. 11, e2634, February 2025.

[https://doi.org/10.7717/peerj-cs.2634]

-

X. Tan, M. Zhuang, X. Lu, and T. Mao, “An Analysis of the Emotional Evolution of Large-Scale Internet Public Opinion Events Based on the BERT-LDA Hybrid Model,” IEEE Access, Vol. 9, pp. 15860-15871, January 2021.

[https://doi.org/10.1109/ACCESS.2021.3052566]

- P. C. Paul, M. Rahman, A. Begum, and M. T. Ahmed, “Combining BERT with LDA: Improved Topic Modeling in Bengali Language,” IAENG International Journal of Computer Science, Vol. 52, No. 2, pp. 383-393, February 2025.

-

S. T. Al-Otaibi and A. A. Al-Rasheed, “A Review and Comparative Analysis of Sentiment Analysis Techniques,” Informatica, Vol. 46, No, 6, pp. 33-44, July 2022.

[https://doi.org/10.31449/inf.v46i6.3991]

-

V. Umarani, A. Julian, and J. Deepa, “Sentiment Analysis Using Various Machine Learning and Deep Learning Techniques,” Journal of the Nigerian Society of Physical Sciences, Vol. 3, No. 4, pp. 385-394, November 2021.

[https://doi.org/10.46481/jnsps.2021.308]

-

T. A. Al-Qablan, M. Mohd Noor, M. A. Al-Betar, and A. T. Khader, “A Survey on Sentiment Analysis and its Applications,” Neural Computing and Applications, Vol. 35, No. 29, pp. 21567-21601, August 2023.

[https://doi.org/10.1007/s00521-023-08941-y]

-

A. P. Rodrigues and N. N. Chiplunkar, “Aspect Based Sentiment Analysis on Product Reviews,” in Proceedings of the 2018 14th International Conference on Information Processing (ICINPRO), Bangalore: India, pp. 1-6, December 2018.

[https://doi.org/10.1109/ICINPRO43533.2018.9096796]

-

A. Bansal and N. Kumar, “Aspect-Based Sentiment Analysis Using Attribute Extraction of Hospital Reviews,” New Generation Computing, Vol. 40, No. 4, pp. 941-960, November 2021.

[https://doi.org/10.1007/s00354-021-00141-3]

- Q.-L. Tran, P. T. D. Le, and T.-H. Do, “Aspect-Based Sentiment Analysis for Vietnamese Reviews about Beauty Products on e-Commerce Websites,” in Proceedings of the 36th Pacific Asia Conference on Language, Information and Computation (PACLIC 36), Manila: Philippines, pp. 767-776, October 2022.

-

D. Chung, “A Case Study of Visualizing Emotions with Social Media Emotion Analysis: Focused on Media Art Cases,” Archives of Design Research, Vol. 35, No. 1, pp. 237-257, February 2022.

[https://doi.org/10.15187/adr.2022.02.35.1.237]

-

K. Kucher, C. Paradis, and A. Kerren, “The State of the Art in Sentiment Visualization,” Computer Graphics Forum, Vol. 37, No. 1, pp. 71-96, February 2018.

[https://doi.org/10.1111/cgf.13217]

-

A. Chatzimparmpas, R. M. Martins, I. Jusfi, K. Kucher, F. Rossi, and A. Kerren, “The State of the Art in Enhancing Trust in Machine Learning Models with the Use of Visualizations,” Computer Graphics Forum, Vol. 39, No. 3, pp. 713-756, July 2020.

[https://doi.org/10.1111/cgf.14034]

-

I. T. Jolliffe and J. Cadima, “Principal Component Analysis: A Review and Recent Developments,” Philosophical Transactions of the Royal Society A: Mathematical, Physical and Engineering Sciences, Vol. 374, No. 2065, 20150202, April 2016.

[https://doi.org/10.1098/rsta.2015.0202]

- L. van der Maaten and G. Hinton, “Visualizing Data Using t-SNE,” Journal of Machine Learning Research, Vol. 9, No. 86, pp. 2579-2605, 2008.

-

M. Kohler, L. Sondermann, L. Forero, and M. A. Pacheco, “Classifying and Grouping Narratives with Convolutional Neural Networks, PCA and t-SNE,” in Proceedings of the 18th International Conference on Hybrid Intelligent Systems (HIS 2018), Porto: Portugal, pp. 22-30, December 2018.

[https://doi.org/10.1007/978-3-030-14347-3_3]

- P. Greengard, Y. Liu, S. Steinerberger, A. Tsyvinski. Factor Clustering with t-SNE [Internet]. Available: https://ssrn.com/abstract=3696027, .

- Hankyung. “Netflix No.1” Sees Record-Low Lead⋯ Tving Users Increase by 45%’ [Internet]. Available: https://www.hankyung.com/article/202407054121g

-

N. Hu, J. Zhang, and P. A. Pavlou, “Overcoming the J-Shaped Distribution of Product Reviews,” Communications of the ACM, Vol. 52, No. 10, pp. 144-147, October 2009.

[https://doi.org/10.1145/1562764.1562800]

-

F. Heimerl, S. Lohmann, S. Lange, and T. Ertl, “Word Cloud Explorer: Text Analytics Based on Word Clouds.” in Proceedings of 2014 47th Hawaii International Conference on System Sciences, pp. 1833-1842, January 2014.

[https://doi.org/10.1109/HICSS.2014.231]

-

T. Akiba, S. Sano, T. Yanase, T. Ohta, M. Koyama, “Optuna: A Next-Generation Hyperparameter Optimization Framework,” in Proceedings of the 25th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining, Anchorage: AK, pp. 2623-2631, July 2019.

[https://doi.org/10.1145/3292500.3330701]

-

W. S. Kang, S. Lee, and S. M. Choi, “A Matrix Factorization-Based Recommendation Approach with SBERT Embeddings,” Journal of Korean Institute of Information Technology, Vol. 21, No. 11, pp. 203-211, November 2023.

[https://doi.org/10.14801/jkiit.2023.21.11.203]

-

D. P. Kingma and J. Ba, “Adam: A Method for Stochastic Optimization,” arXiv:1412.6980, , December 2014.

[https://doi.org/10.48550/arXiv.1412.6980]

-

M. RRöder, A. Both, and A. Hinneburg, “Exploring the Space of Topic Coherence Measures,” in Proceedings of the 8th ACM International Conference on Web Search and Data Mining (WSDM), Shanghai: China, pp. 399-408, February 2015.

[https://doi.org/10.1145/2684822.268532]

- D. Newman, J. H. Lau, K. Grieser, and T. Baldwin, “Automatic Evaluation of Topic Coherence,” in Proceedings of the Human Language Technologies: The 2010 Annual Conference of the North American Chapter of the Association for Computational Linguistics, Los Angeles: CA, pp. 100-108, June 2010.

-

C. Sievert and K. Shirley, “LDAvis: A Method for Visualizing and Interpreting Topics,” in Proceedings of the Workshop on Interactive Language Learning, Visualization, and Interfaces, Baltimore: MD, pp. 63-70, June 2014.

[https://doi.org/10.13140/2.1.1394.3043]

- T. H. Cho and J. H. Seo, “Neural Based Approach to Keyword Extraction from Documents,” Journal of the Korean Institute of Information Scientists and Engineers, Vol. 27, No. 2, pp. 317-319, October 2000.

-

M. Das, S. Kamalanathan, and P. J. A. Alphonse, “A Comparative Study on TF-IDF Feature Weighting Method and Its Analysis Using Unstructured Dataset,” arXiv:2308.04037, , August 2023.

[https://doi.org/10.48550/arXiv.2308.04037]

-

H. Park, S. Kim, and C. Sohn, “The Effect of OTT Characteristics on Perceived Value, User Satisfaction and Continuous Use Intention in OTT: Focusing on the Moderating Effect of Hedonic Innovativeness,” Journal of Digital Convergence, Vol. 20, No. 3, pp. 169-180, March 2022.

[https://doi.org/10.14400/JDC.2022.20.3.169]

-

J. R. Lewis and J. Sauro, Usability and User Experience: Design and Evaluation, in Handbook of Human Factors and Ergonomics, 5th ed. Hobken, NJ: Wiley, ch. 38, pp. 972-1015, August 2021.

[https://doi.org/10.1002/9781119636113.ch38]

-

H. Son and S. Lee, “A Study on Subscription Video-on-Demand Service Users’ Intention of Switching to Advertising-Based Plans,” Korean Journal of Communication & Information, No. 124, pp. 50-92, April 2024.

[https://doi.org/10.46407/kjci.2024.04.124.50]

-

S. Kwon, J. Kim, and B. Jang, “Comparative Study of User Reactions in OTT Service Platforms Using Text Mining,” Journal of Internet Computing and Services, Vol. 25, No. 3, pp. 43-54, June 2024.

[https://doi.org/10.7472/jksii.2024.25.3.43]

-

M. Sokolova and G. Lapalme, “A Systematic Analysis of Performance Measures for Classification Tasks,” Information Processing & Management, Vol. 45, No. 4, pp. 427-437, 2009.

[https://doi.org/10.1016/j.ipm.2009.03.002]

-

W. Liu, Y. Wen, Z. Yu, M. Yang, “Large-Margin Softmax Loss for Convolutional Neural Networks,” arXiv:1612.02295, , December 2016.

[https://doi.org/10.48550/arXiv.1612.02295]

-

Y. Wu and L. Liu, “Selecting and Composing Learning Rate Policies for Deep Neural Networks,” ACM Transactions on Intelligent Systems and Technology, Vol. 14, No. 2, pp. 1-25, 2022.

[https://doi.org/10.1145/3570508]

-

D. Kobak and P. Berens, “The Art of using t-SNE for Single-Cell Transcriptomics,” Nature Communications, Vol. 10, No. 1, 5416, November 2019.

[https://doi.org/10.1038/s41467-019-13056-x]

-

M. M. Ghassemi, R. G. Mark, and S. Nemati, “A Visualization of Evolving Clinical Sentiment Using Vector Representations of Clinical Notes,” in Proceedings of the 2015 Computing in Cardiology Conference (CinC), Nice: France, pp. 629-632, February 2016.

[https://doi.org/10.1109/CIC.2015.7410989]

-

G. Negi, R. Sarkar, O. Zayed, and P. Buitelaar, “A Hybrid Approach to Aspect Based Sentiment Analysis Using Transfer Learning,” arXiv:2403.17254, , Mar 2024.

[https://doi.org/10.48550/arXiv.2403.17254]

-

K. Lee, J. Lim, K. Bok, and J. Yoo, “Handling Method of Imbalanced Data for Machine Learning: Focusing on Sampling,” Journal of the Korea Contents Association, Vol. 19, No. 11, pp. 567-577, November 2019.

[https://doi.org/10.5392/JKCA.2019.19.11.567]

저자소개

2022년:경기대학교 응용통계학과, 산업경영공학과 (경제학사, 공학사)

2024년:성균관대학교 일반대학원 산업공학과 석사 과정

2021년~2022년: 메이크미업 주식회사

2022년~2023년: 주식회사 레페리 데이터팀

2024년~현 재: 성균관대학교 산업공학과 석사 과정

※관심분야:데이터 분석, 비즈니스 애널리틱스 등

1983년:서울대학교 산업공학과 (공학사)

1985년:서울대학교 일반대학원 산업공학과 (공학석사)

1991년:Georgia Institute of Technology, Industrial & System Engineering (Ph.D)

1991년~1995년: KT 통신망 연구소 선임연구원

1995년~1995년: 한국외국어대학교 산업공학과 조교수/부교수

2003년~현 재: 성균관대학교 시스템경영공학과/기술경영전문대학원 기술경영학과 교수

※관심분야:기술경영, 경영과학, 비즈니스 애널리틱스 등