디지털 트윈 기술 적용을 위한 IoT 센서 기반 실시간 작업자 안전 모니터링 연구

Copyright ⓒ 2025 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

전 세계 건설 현장에서 발생하는 사고는 매년 증가하고 있다. 건설 현장의 안전 지침이 발전했음에도 불구하고 근로자의 실수, 부주의, 외부적 환경요인으로 인해 근로자의 사고가 자주 발생하고 있다. 이 연구는 근로자의 행동을 실시간으로 분석하기 위해 IoT 센싱 기술을 근로자 행동에 기반한 안전 모니터링으로 활용하고자 수행되었다. 안전 모니터링에 활용되는 센서는 UWB 위치 측위 센서와 웨어러블 센서를 사용하였으며 웨어러블 센서는 총 5개의 위치에 부착하여 각각 다른 알고리즘을 적용해 작업자의 행동 패턴을 분석하였다. 또한 실제 웨어러블 시제품을 제작하여 실제 테스트를 수행하였다. 해당 기술을 실시간 디지털 트윈 기술을 적용하기 위해 데이터를 구축하였다. 최종적으로 도출되는 5개 위치의 데이터를 기반으로 작업자의 행동을 분석하는 알고리즘을 개발하고 이를 적용한 결과 약 95%의 높은 정확도를 확인할 수 있었다.

Abstract

Accidents occurring at construction sites around the world are increasing every year. Despite the advancement of safety guidelines for construction sites, worker mistakes, carelessness, and external environmental factors frequently cause accidents. This study was conducted to utilize IoT sensing technology for safety monitoring of worker behavior, thereby analyzing the behavior in real time. The sensors used for safety monitoring were wearable and ultra-wideband (UWB) positioning sensors. The wearable sensors were attached to six locations and, different algorithms were applied to analyze worker behavior patterns. In addition, wearable prototypes were produced and actual tests were performed. Data are constructed to apply the IoT sensing technology to real-time digital twins. Based on the data from the six locations, an algorithm was developed to analyze worker behavior, and the results showed a high accuracy of approximately 95%.

Keywords:

IoT, Digital Twin, Wearable Sensor, Algorithm, Worker Safety키워드:

디지털 트윈, 웨어러블 센서, 알고리즘, 작업자 안전Ⅰ. 서 론

1-1 연구 배경

매년 전 세계적으로 많은 작업자 사고가 발생하고 있으며, 이는 큰 사회적 문제가 되고 있다. 작업자의 사고는 크게 건설 현장에서의 사고와 제조 현장에서의 사고로 나뉘며 약 80%의 사고가 건설 현장에서 발생하고 있다. 따라서 이 문제를 해결하기 위한 다양한 연구가 진행되고 있으며, 최근에는 IoT 센싱 기술 및 CCTV의 영상을 활용한 실시간 모니터링 연구가 진행되고 있다. 이 중 본 연구의 최종 목표는 근로자 행동에 기반한 안전 모니터링 및 예측 기술을 개발하는 것으로써, 산업현장에서 근로자의 안전을 보장하기 위해 UWB, Wearable Sensor 등의 IoT 센싱 기술을 활용한 행동 기반 위험 모니터링 및 예측 기술을 개발하는 것이 목적이다. 위의 기술들은 CCTV의 사각지대에서 작업자의 안전사고를 감지할 수 있기에 연구개발이 활발히 이루어지고 있다. 특히, UWB 기술은 근로자의 위치를 파악하고 근로자가 위험구역에 진입했을 때 실시간 알람을 제공할 수 있으며, Wearable Sensor는 근로자의 행동을 파악하고 정보를 제공하여 사고 발생 시 즉각적인 조치를 취할 수 있다는 장점을 가진다.

1-2 연구 동향

작업자의 행동에 기반한 안전 모니터링 및 예측 기술은 크게 IoT와 같은 센서를 이용한 연구와 CCTV와 같은 영상을 이용한 연구가 주로 이루어 지고 있다. 이중 영상을 이용한 연구로는 Rijayanti 등은 제조 현장에서 작업자의 행동을 모니터링하고, 잠재적 실수를 식별하기 위해 Mask R-CNN 및 MediaPipe를 활용한 모델을 개발하였으며[1], 이태준 등 및 전소연 등은 YOLO-v4 알고리즘을 활용하여 작업장에서 위험 객체와 작업자 간의 거리를 예측하는 모델을 구현하였다[2],[3]. 또한, Hari Iyer 등은 컴퓨터 비전 기반의 프레임워크를 통해 작업자의 상하체 움직임을 정량화하여 움직임이 임계값에 도달하면 경고를 발령하는 연구를 진행하였다[4]. 이희성 등의 경우에는 산업현장의 CCTV를 이용하여 컴퓨터 비전 및 기계 학습 알고리즘을 이용하여 작업자의 비정상 행동이 발생했을 때 이를 자동으로 알려주는 시스템을 연구개발 하였다[5].

웨어러블 센서 및 UWB를 이용하여 작업자의 행동 인지와 위치 측위에 관한 연구로는 Heinrich 등이 연구한 스마트 폰 기반의 UWB 연구[6]를 통해 정확도를 검증하였으며 안종우 등은 3차원 실내 측위에 대한 정확도 시스템을 개발하였다[7]. Shi Ling-Feng 등은 실내 PDR 기반 초저가형 IMMU를 개발하였으며[8], Cahyadi 등은 GPS와 IMU 센서를 병합하여 칼만 필터의 정확도를 보정 하는 연구를 진행하였다[9]. Xia 등은 6개의 별도 센서를 활용하여 인간의 자세를 분석하는 연구를 수행하였다[10]. 최근들어 인공지능을 활용한 방법이 많이 제시되고 있는데, 가속도 및 자이로 센서, 고도계 센서 등의 계측 데이터를 활용하여 CNN, LSTM 등의 알고리즘을 통해 작업자의 위험 행동에 대해 분류하고자 하는 연구가 활발히 진행되고 있다[11]-[13].

하지만, CCTV와 같이 영상을 활용한 연구는 영상의 사각지대, 혹은 먼 거리 작업자의 경우 측정 정확도가 낮아지는 한계점이 존재하며, 인공지능을 활용한 작업자 행동 인지는 학습 모델이 무거워지게 된다면 실시간으로 결과를 분석하여 모니터링 화면에 표출하기까지 행동과 결과 사이에 gap이 존재할 수 있다. 이에, 본 연구에서는 UWB 기반 측위와 6개의 웨어러블 센서를 활용하여 작업자의 현재 상태를 파악하는 연구를 수행하고자 하였으며 이를 통해 실시간으로 작업자의 안전을 확인할 수 있는 디지털 트윈 기반의 플랫폼의 기초자료를 제공하고자 하였다.

Ⅱ. 이론 및 초기 실험

2-1 UWB(Ultra Wide Band)

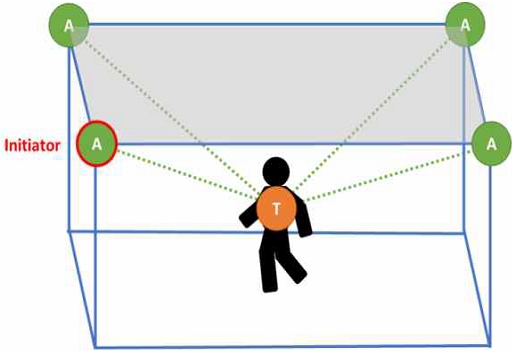

UWB 기술의 구성은 태그에서 최소 3개의 앵커의 신호가 도달하는 태그의 위치를 측정하고, 태그 위치 지정은 위치 정확도와 신뢰성을 보장하기 위해 최소 4개의 앵커를 사용하여 연구를 진행하였다. 앵커는 그림 1과 같이 벽이나 삼각대에 설치하여 시야가 확보되는 높은 위치에 설치하여 분석의 용이성을 활보하였다. 태그 위치 정보는 개방된 공간, 구조물 등 다양한 공간에 대해 얻을 수 있으며, 네트워크를 공유하는 게이트웨이를 사용하여 여러 개의 태그 센서 데이터를 모니터링할 수 있다. 또한 게이트웨이를 통해 태그 센서에서 수집한 데이터를 상위 서버로 전송하여 확인할 수 있다. 3차원 공간 축에 대한 UWB 센서 응용 실험은 다음과 같다. UWB 센서 실험은 고정 센서를 설치하고 앵커의 세 축 x(적색), y(녹색), z(청색)에 대한 위치 정보를 사용 후 센서 테스트를 시행한 결과 태그의 위치 오차는 약 0.5m인 것으로 확인되었다.

2-2 웨어러블 센서

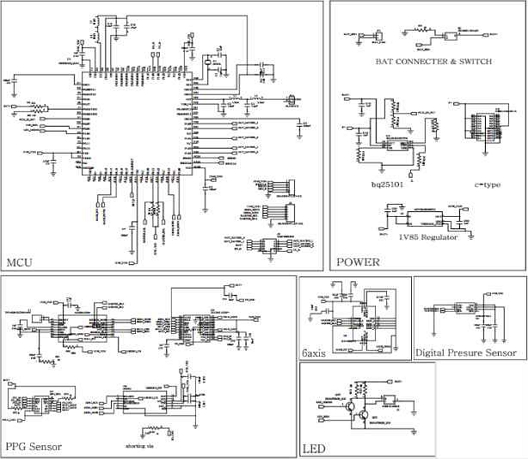

작업자의 안전을 모니터링하기 위해 3축(x,y,z) 가속도 센서, 3축(x,y,z) 각속도 센서, 광학 심박수 센서, 기압 센서를 포함하는 웨어러블 센서 프로토타입을 설계하였다. 3축 가속도 센서와 3축 각속도 센서의 경우 작업자의 머리, 팔, 다리, 몸통에 부착되고 광학 심박수 센서의 경우 작업자의 팔에 부착하였다. 따라서 머리, 몸통, 다리에 6축 가속도 및 각속도 센서를 부착하고 팔에 6축 가속도 및 각속도 센서와 광학 심박수 센서를 부착한 최종형태로 구성되었다. 그림 3은 설계된 웨어러블 센서의 프로토타입과 3D 프린팅을 사용하여 설계된 케이스의 설계 회로도를 나타낸 내용이다.

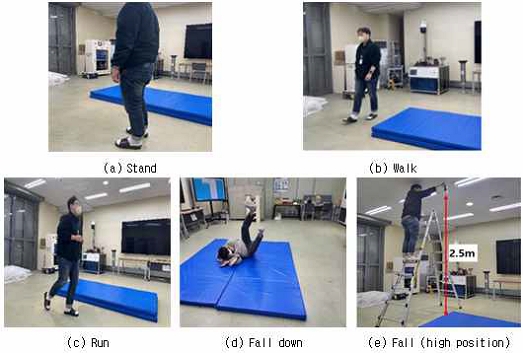

설계된 회로도와 3D 프린팅을 통해 프로토타입 웨어러블 센서를 제작하였다. 프로토타입의 웨어러블 센서를 6개 부위(몸통, 머리, 양손, 양발)에 착용하여 데이터를 취득하기에 앞서, 센서의 검증과 데이터 추이를 살펴보는 실험을 수행하여 각 행동유형에 대한 데이터를 취득하였다. 알고리즘을 구현하였다. 프로토타입의 센서를 손에 착용한 후, 서기, 걷기, 달리기, 넘어지기, 넘어지는 상황에 대한 가속도, 각속도, 심박수, 기압 데이터를 취득하는 실험을 수행하였다. 그림 4와 같이 총 5명이 각 상황별로 5회씩 실험을 수행하여 총 75개의 실험 데이터를 취득하였다. 낙하 실험의 경우, 안전상의 이유로 물병에 웨어러블 센서를 부착하여 피험자가 넘어지는 실험을 수행하였다.

Ⅲ. 알고리즘 및 실험

3-1 가속도계 기반 불완전 행동 판단 알고리즘

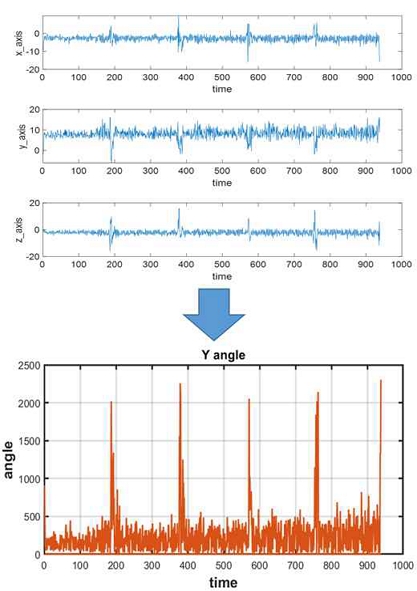

본 연구는 3축 가속도 센서 데이터에서 중력이 형성하는 각도 Y_angle을 이용하여 수행된다. 웨어러블 센서를 팔에 착용한 경우 y축 방향은 중력 방향과 반대이므로 y축과 중력 사이의 각도를 통해 착용자의 작용 각도를 계산할 수 있으며, 그 방정식은 다음과 같다.

| (1) |

위의 방정식을 이용하여 가속도 센서 데이터를 그림 5와 같이 y_angle 데이터로 변환하여 매개변수로 사용하고, 값을 제곱하여 표현하여 변화 추이를 명확히 볼 수 있도록 하였다. Y_Angle2 임계값 설정의 경우 실험 결과 얻은 데이터베이스를 기반으로 정상 상황(걷기, 달리기)과 비정상 상황에 대한 데이터를 분석하여 설정하였다. 정상적인 상황에서 Y_Angle2 데이터를 분석한 결과, 데이터가 0~2000 사이에 분포하는 것을 확인하였고, 비정상적인 상황에서는 데이터가 4000~6000 사이에 분포하는 것을 확인할 수 있었다.

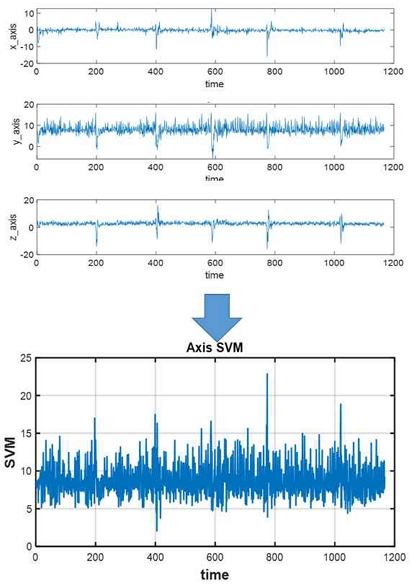

3-2 3축 가속도 센서 분석을 위한 SVM 알고리즘

웨어러블 센서에서 사용되는 x, y, z축 데이터를 결합한 결과를 통해 중력가속도에 미치는 영향을 최소화할 수 있으며, SVM을 통해 각 가속도 데이터의 에너지 값과 충격량으로 활용할 수 있다. 그림 6은 SVM을 활용한 3축 가속도 센서 분석에 관한 내용을 도식한 내용이다.

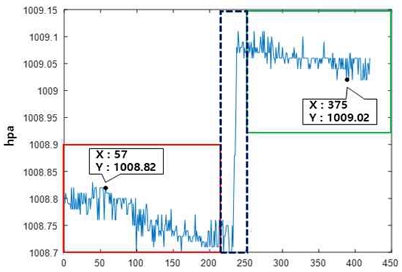

3-3 기압 센서를 활용한 불완전 행동 판단 알고리즘

낙하 상황을 구분하기 위해 기압 센서의 파라미터를 이용하여 낙하 중의 상황과 낙하 후 상황을 구분하고자 시도하기 위해 낙하 실험을 수행하였다. 낙하 발생 시 안전상의 문제로 웨어러블 디바이스를 물체에 부착하여 2.5m 높이에서 물체를 떨어뜨려 실험을 수행하였다. 낙하 실험 결과 낙하 전후의 최고점과 최저점을 비교하였을 때 0.2hpa 이상의 gap이 있는 것을 확인하였다. 기압 센서 데이터를 이용하여 낙하를 구분할 수 있으며, 이를 통해 상황을 구분하는 것도 가능함을 확인하였다. 다음 그림 7은 낙하 상황에 따른 기압의 변화를 보여주는 내용이다.

Ⅳ. 실험 결과

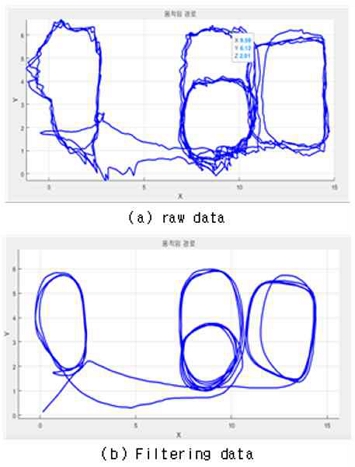

4-1 UWB 실내 측위 테스트

공사 현장 내부의 안전통로의 경우 GPS 신호가 정확하게 포착되지 않기 때문에 실험 환경은 현장 내부의 콘크리트 벽이나 철근에 UWB 앵커를 부착하여 작업자의 위치를 파악하도록 설정했다. 앵커는 일반적으로 2m 이상의 높이에서 위치를 파악할 수 있으므로 2.7m 높이에 설치하여 실험을 진행하였고, 가장 정확한 데이터를 얻기 위해 최적의 위치에 앵커 6개를 설치했다. 그 결과 설정 높이보다 약 0.35m 높은 값이 나왔으므로 Low-Pass-Filter를 사용하여 결과를 비교하여 오차를 보정했다. Low-Pass-Filter를 적용한 후 태그의 최대 오차는 약 0.1m로, 필터링된 데이터를 사용하는 것이 UWB 센서의 원시 데이터를 사용하는 것보다 정확하다는 것을 확인했다.

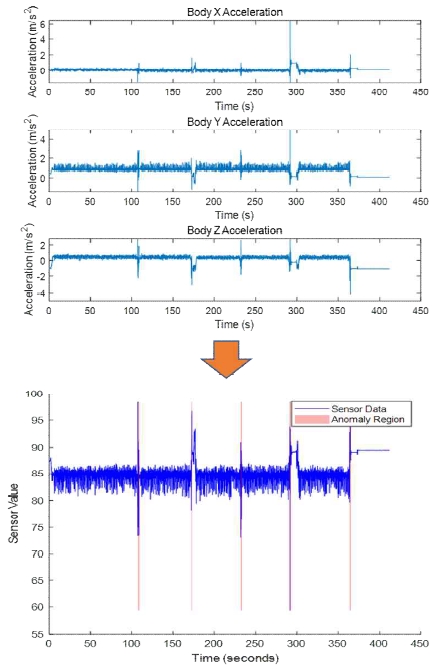

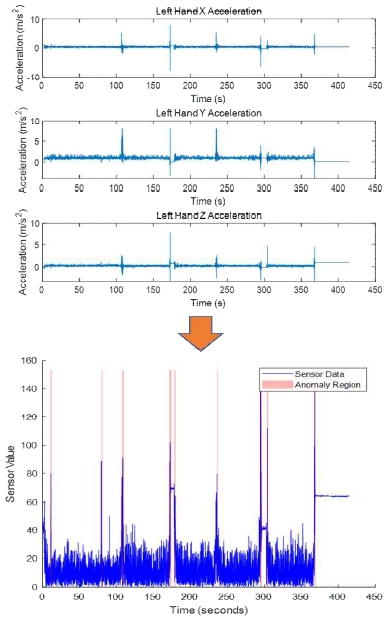

4-2 작업자 행동 탐지 실험 결과

건설 현장 위험구역에서의 불안전 이동행동 유형은 점프(개구부)와 낙하(돌출부)로, MEMS 센서를 이용하여 실시간으로 유형을 측정할 수 있는 실험 환경을 구축하였다. 작업자의 각 부위별 센싱 데이터를 활용하여 낙하, 보행, 점프 등의 불안전 이동 행동에 대하여 점프 2회, 낙하 3회를 포함하여 약 5분간 총 5회의 비정상 상태 데이터를 포함하는 실험을 수행하였다. 머리와 몸의 경우 점프나 낙하가 발생하면 축이 바뀌는데, MEMS 센서의 y축을 기준으로 축이 바뀐다. 따라서 세타 y 값에 따른 데이터의 변화량의 차이를 통해 데이터를 도출하였고, 임계값이 10의 변화를 보이면 비정상 상태로 설정하였다. 왼손과 오른손의 경우, 정상적인 상황에서 걷는 경우 사람은 팔을 흔들며 걷고 비정상적인 상황(점프, 넘어짐)에서는 팔의 각도가 정상적인 상황과 다른 각도를 보인다. 따라서 우리는 왼손과 오른손의 각도를 이용하여 비정상 상태를 구별하고자 시도했다. 특히, 보완 필터를 이용하여 각속도 센서와 가속도 센서 데이터를 결합하여 손 각도의 변화를 감지하는 알고리즘을 만들었다. 각도의 경우 0°에서 180°까지 감지가 가능하며, 피치 값을 통해 각도를 감지했다. 각속도와 가속도 공식을 결합한 보완 필터의 수식은 다음과 같다.

| (2) |

식 (2)에서 output은 필터링된 결과이고, outputprev는 이전 시간 단계에서의 필터 출력이고, gyro는 각속도 센서의 출력이고, Δt는 시간 간격이고, accel은 가속도 센서에서 얻은 데이터이고, α는 보완 필터의 가중치이다. 일반적으로 α 값은 센서의 특성, 노이즈 레벨, 원하는 응답에 따라 조정할 수 있다. 이 알고리즘의 경우 보완 필터의 가중치 값을 0.996으로 설정했다. 또한, 이상치 구역 설정은 1초 데이터 윈도우를 사용하여 수행하였고, 이상치 판별 임계값은 값이 60 이상으로 변하는 시점을 기준으로 설정하였다.

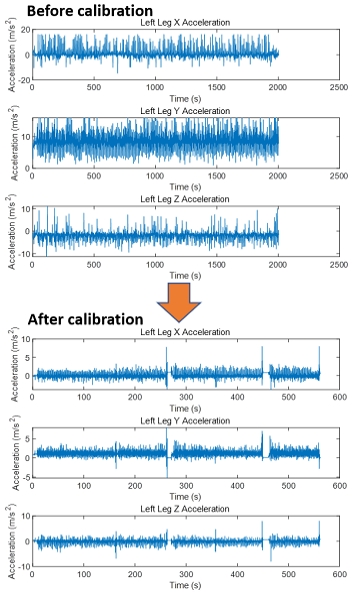

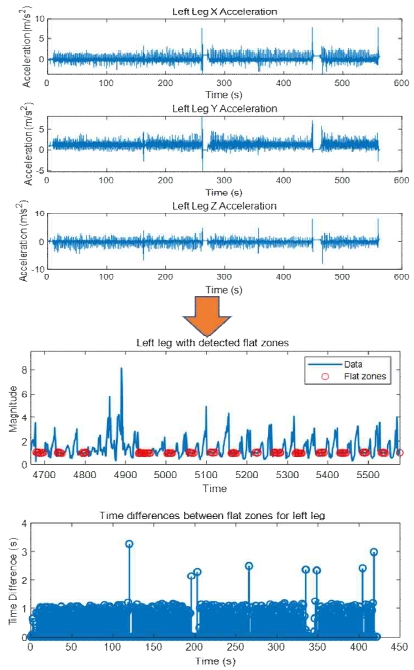

좌우 발의 경우 걷기, 점프, 넘어짐 등의 동작에 대한 걸음 검출을 위해 제로 크로싱 검출, 피크 검출 등 다양한 방법을 사용하지만, 본 연구에서는 플랫 존 검출 방법을 적용했다. 가속도 센서의 신호는 사람의 발이 땅에 닿아 있는 동안 특정 특성을 보인다. 이는 구간을 검출하는 방법이다. 본 연구에서 적용한 플랫 존의 경우 좌우 발의 가속도 센서 데이터에 SVM을 적용하였고, SVM 값이 0.9~1.1 사이이고, 이전 데이터와 비교했을 때 차이값이 1일 때 임계값을 설정했다. 하지만 플랫 존 검출 결과를 보면 오검출이 발생하기 때문에 이러한 오검출 결과를 제거해야만 올바른 걸음을 검출할 수 있다. 따라서 5개 이상의 평탄 영역이 검출된 구간만을 평탄 영역으로 정의하고, 다른 구간은 오검출하여 이를 제외하는 방법을 적용하여 오검출 구간을 최소화하였다.

4-3 작업자 행동 탐지를 위한 알고리즘 흐름도 제작

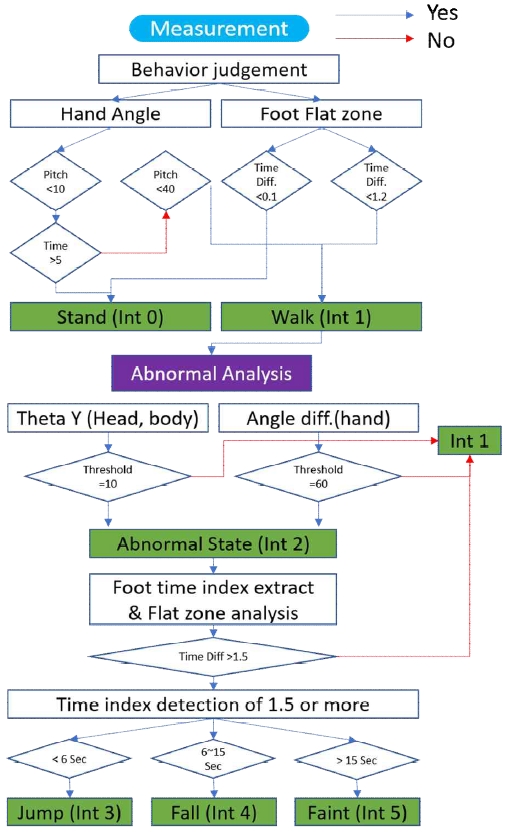

본 연구에서 활용된 다양한 알고리즘을 통합하여 최종적인 작업자의 행동을 분석하는 알고리즘을 제작하였다. 알고리즘은 크게 양손의 각도(Pitch) 분석 알고리즘, 양발의 Flat Zone 알고리즘을 우선으로 분석하며 해당 단계에서 불완전 행동을 검출하게 된다. 이후 불완전 행동의 세부 분석을 위해 머리와 몸통 간의 Theta Y 분석과 양팔의 각도 변화 등을 통해 우선 검출하게 되며 이후 양발의 Flat Zone 상세 분석을 통해 최종적인 5개의 행동유형을 탐지한다.

알고리즘의 흐름은 먼저 양손의 각도와 양말의 분석 알고리즘을 통해 서있기와 걷기를 우선으로 분석한다. 이 과정에서 걷기로 판단된 행동들을 모두 불완전 행동으로 인식한 뒤 추가적인 알고리즘 적용을 수행하는데 머리와 몸통의 Theta Y, 양손의 각도가 임계값을 만족하면 그대로 걷기로 판단하고 아닐 경우 비정상 행동(Int 2)로 적용한다. Int 2에는 양발의 Flat Zone 분석을 통해 점프, 낙하, 기절 등으로 분류할 수 있으며 해당 임계값은 그림 13에서 확인할 수 있다.

해당 알고리즘은 센서에 탑재할 수 있을 정도로 알고리즘을 가볍게 하여 웨어러블 센서에 적용할 수 있으며, 작업자 행동 파악에 대한 데이터를 바로 송수신할 수 있어서, raw data를 받아 알고리즘을 적용하는 방식 대비 거의 실시간으로 작업자의 행동에 대해 파악할 수 있는 장점을 가진다.

Ⅴ. 결 론

본 연구는 다양한 센서를 통해 작업자의 행동 패턴을 인식하고, 실시간으로 작업자의 현재 상태를 모니터링하는 기술에 관한 연구이다. 결론은 다음과 같다.

첫째, UWB를 이용한 실내 측위 시험에서 정확도는 0.5m 이내, 데이터 연동은 0.1초 이내로 확인되었다. 이는 디지털 트윈에서 실시간으로 작업자의 위치 데이터를 공유할 수 있을 뿐만 아니라, 비상시 신속한 대응이 가능하다는 것을 의미한다.

둘째, 가속도를 이용한 웨어러블 센서 시험은 필터를 이용하여 매우 높은 확률(95%)로 인식을 수행할 수 있으나, 원시 데이터로는 바로 활용하기 어렵다. 이는 필터링 시간이 약 3초 이상 소요되기 때문에 필터의 단순화를 통해 정확도가 1초 이내인 데이터 분석 기법이 필요하기 때문이다.

마지막으로 기압 센서를 이용한 작업자 낙상 사고 분석의 경우 필터링 없이도 바로 기압 차이가 발생하는 것을 확인하였다. 따라서 건설 현장에서 가장 많이 발생하는 낙상 사고를 예방하는 데 활용할 수 있을 것이다.

또한, 본 연구와 같이 실시간 모니터링이 중요한 경우 높은 정확도가 중요하지만, 실시간은 훨씬 더 중요한 요소이다. 따라서 정확도를 97% 이상으로 높여 최단 시간 내에 모니터링을 수행할 수 있도록 하는 추가적인 연구가 필요하다.

Acknowledgments

본 연구는 행정안전부 지역맞춤형 재난안전 문제해결 기술개발 사업(RS-2024-00402840)과 취약계층‧시설 등 안전사고 예방기술 개발사업[2022-MOIS38-002(RS-2022-ND630021)]의 연구비 지원을 받아 수행되었습니다.

References

-

R. Rijayanti, M. Hwang, and K. Jin, “Worker’s Behavior Identification from Manufacturing Site Images Using Mask R-CNN and MediaPipe,” Journal of the Korea Institute of Information and Communication Engineering, Vol. 27, No. 2, pp. 281-290, February 2023.

[https://doi.org/10.6109/jkiice.2023.27.2.281]

- T. Lee, M. Cho, H. Kim, T. Kim, and H. Jung, “Implentation of a Model for Predicting the Distance between Hazardous Objects and Workers in the Workplace Using YOLO-v4,” in Proceedings of 2021 Korea Institute of Information and Communication Engineering Fall Conference, Gunsan, pp. 332-334, October 2021.

-

S. Y. Jeon, J. H. Park, S. B. Youn, Y. S. Kim, Y. S. Lee, and J. H. Jeon, “Real-Time Worker Safety Management System Using Deep Learning-Based Video Analysis Algorithm,” Smart Media Journal, Vol. 9, No. 3, pp. 25-30, September 2020.

[https://doi.org/10.30693/SMJ.2020.9.3.25]

-

H. Iyer, N. Macwan, S. Guo, and H. Jeong, “Computer-Vision-Enabled Worker Video Analysis for Motion Amount Quantification,” arXiv:2405.13999, , 2024.

[https://doi.org/10.48550/arXiv.2405.13999]

- H. Lee, M. Cho, M. Cheon, J. Sung, M. Roh, H. Kim, ... and D. Lee, “Intelligent Image Analysis System for Worker Safety in the Industrial Site,” Korean Journal of Industrial Security, Vol. 5, No. 1, pp. 43-70, June 2015.

-

A. Heinrich, S. Krollmann, F. Putz, and M. Hollick, “Smartphones with UWB: Evaluating the Accuracy and Reliability of UWB Ranging,” arXiv:2303.11220, , March 2023.

[https://doi.org/10.48550/arXiv.2303.11220]

-

J. An, L. Yang, and J. Lee, “Three-Dimensional Indoor Location Estimation Using Single Inertial Navigation System with Linear Regression,” Measurement Science and Technology, Vol. 30, No. 10, 105101, October 2019.

[https://doi.org/10.1088/1361-6501/ab2526]

-

L.-F. Shi, Y.-J. Dong, and Y. Shi, “Indoor PDR Method Based on Foot-Mounted Low-Cost IMMU,” in Proceedings of 2022 IEEE International Conference on Networking, Sensing and Control (ICNSC), Shanghai, China, pp. 1-6, December 2022.

[https://doi.org/10.1109/ICNSC55942.2022.10004055]

-

M. N. Cahyadi, T. Asfihani, R. Mardiyanto, and R. Erfianti, “Performance of GPS and IMU Sensor Fusion Using Unscented Kalman Filter for Precise i-Boat Navigation in Infinite Wide Waters,” Geodesy and Geodynamics, Vol. 14, No. 3, pp. 265-274, May 2023.

[https://doi.org/10.1016/j.geog.2022.11.005]

-

D. Xia, Y. Zhu, and H. Zhang, “Faster Deep Inertial Pose Estimation with Six Inertial Sensors,” Sensors, Vol. 22, No. 19, 7144, September 2022.

[https://doi.org/10.3390/s22197144]

- N.-J. Kim and J.-P. Jeong, “Proposal of Human Activity Recognition Methodology for Worker Safety Based on Deep Learning,” in Proceedings of 2023 Comprehensive Conference on the Institute of Internet, Broadcasting and Communication (IIBC 2023), Jeju, November 2023.

- S.-H. Lee, J.-J. Bak, and T.-H. Lee, “Edge Computing Based Industrial Field Worker’s Behavior Analysis System Using Deep Learning,” in Proceedings of 2020 Winter Conference on the Korean Society of Computer Information, Daejeon, pp. 63-64, January 2020.

- S.-H. Lee, H.-W. Kim, J.-H. Yoo, and J.-H. Tak, “Worker’s Behavior Monitoring Using Deep Learning,” in Proceedings of 2019 Winter Conference on the Korean Society of Computer Information, Gumi, pp. 57-58, January 2019.

저자소개

2020년:성균관대학교 대학원 (공학석사)

2020년~현 재: 차세대융합기술연구원

※관심분야:재난, 안전, 유지관리

2013년:성균관대학교 대학원 (공학석사)

2019년:성균관대학교 대학원 (공학박사-방재안전공학)

2013년~2014년: 한국원자력연구원 연구원

2014년~2015년: 국립재난안전연구원 연구원

2019년~2020년: 성균관대학교 박사후 연구원

2020년~현 재: 차세대융합기술연구원 선임연구원

※관심분야:재난, 안전, 위성영상

2022년:성균관대학교 대학원 (공학석사)

2022년~현 재: 차세대융합기술연구원

※관심분야:재난, 안전, 위성영상

2020년:한국공학대학교 대학원 (공학석사)

2021년~현 재: 차세대융합기술연구원

※관심분야:재난, 안전, 인공지능