YOLOv8과 3D 모델링 기반의 화재 대응 로봇 시스템 구현

Copyright ⓒ 2024 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

화재는 인명과 재산에 큰 피해를 초래할 수 있는 심각한 재난으로, 특히 초기 단계에서의 신속한 대응이 매우 중요하다. 본 논문에서는 이러한 화재 대응을 위해 YOLOv8 객체 탐지 알고리즘을 기반으로 한 화재 감지 모델과 3D 환경 모델링 기술을 적용한 소화 로봇 시스템을 제안한다. YOLOv8 알고리즘을 활용하여 학습된 화재 감지 모델은 다양한 시나리오에서 신뢰성 있는 감지 성능을 보였으며, 3D 환경 모델링을 통해 로봇이 작동할 환경을 시각적으로 재현하였다. 이를 통해 효율적으로 화재를 진압할 수 있도록 설계하여 화재로 인한 피해를 최소화하는 데 기여할 것으로 기대된다. 본 연구는 AI 기반 화재 대응 시스템의 실용성을 제고하고, 향후 로봇을 활용한 화재 예방 및 기술의 발전에 중요한 기여를 할 것으로 기대된다.

Abstract

Fires are catastrophic events that pose significant threats to life and property, making a rapid response, particularly in the early stages, crucial. This paper proposes a fire detection model based on the YOLOv8 object detection algorithm, integrated with a fire-extinguishing robot system that utilizes 3D environment modeling technology. The fire detection model, trained using the YOLOv8 algorithm, demonstrated reliable detection performance across a variety of scenarios. Simultaneously, the robot's operating environment was recreated using 3D environmental modeling to enhance response efficiency. This approach is expected to contribute to minimizing fire-related damage by optimizing fire suppression operations. The study holds promise for enhancing the practicality of AI-based fire response systems and making a significant contribution to the future development of fire prevention technologies and robotics.

Keywords:

Object Detection, Deep Learning, GAN, YOLOv8, 3D Model키워드:

객체 탐지, 딥러닝, 3D 모델Ⅰ. 서 론

화재는 언제 어디서든 발생할 수 있는 위험한 재난 사고이다. 특히 화재가 발생한 초기 단계에서의 신속한 대응이 매우 중요하다. 하지만 실제 화재 현장은 인간이 접근이 어렵거나, 화재의 징조를 초기에 파악하기 어려운 경우가 많다. 이러한 문제로 인해 화재 발생 시 대응이 지연되는 경우가 발생한다. 경기 지역의 경우, 도로 혼잡과 소방서의 원거리 위치로 인해 화재 발생 시 소방 차량의 신속한 출동이 어려운 상황이 많다. 이로 인해 화재 초기 단계에서 연소가 빠르게 확산되는 경우가 연간 100건 이상 발생하였다. 소방서가 화재 현장에 도착하기까지 시간이 지연되면서, 불이 크게 번지게 되어 대형 인명 피해로 이어지는 사례가 다수 발생하였다. 특히 교통 정체 등으로 소방 차량의 접근이 어려운 지역일수록 이러한 문제가 심각했다[1]. 이러한 문제를 해결하기 위해서는 화재 현장에 신속히 대응할 수 있는 새로운 방안이 필요한 상황이라고 볼 수 있다. 본 논문에서는 화재 취약 지역에 배치할 수 있는 AI 기반의 화재 제압 로봇 시스템을 제안한다. YOLOv8 객체 탐지 알고리즘을 활용하여 화재를 조기에 감지하고, 신속하고 효과적으로 대응할 수 있도록 제안한다. 또한 로봇의 환경 인식과 경로 설정을 위해 3D 환경 모델링 및 시각화 기술을 적용하여, 화재 현장의 복잡한 구조에서도 정확하게 작동할 수 있는 능력을 부여한다. 이러한 접근 방식을 통해 화재로 인한 피해를 최소화할 수 있을 것으로 기대된다.

Ⅱ. 관련 연구

2-1 GAN 알고리즘

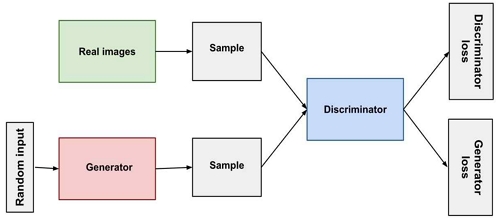

생성적 적대 신경망(Generative Adversarial Network, GAN)은 최근 딥러닝 분야에서 주목받고 있는 대표적인 생성 모델이다. GAN은 생성자와 판별자로 구성된 두 개의 신경망 모델로 이루어져 있으며, 이들 모델은 서로 경쟁하며 학습한다. 생성자 모델은 무작위 노이즈를 입력받아 실제 데이터와 유사한 가짜 데이터를 생성하고, 판별자 모델은 실제 데이터와 가짜 데이터를 구분하는 역할을 한다. 두 모델은 경쟁하는 과정에서, 생성 신경망은 판별자를 속이기 위해 점점 더 실제와 유사한 데이터를 생성하고, 판별자는 이러한 가짜 데이터를 더 정확하게 구분하기 위해 학습한다. 이 두 신경망은 적대적인 관계에서 학습되며, 이 과정을 적대적 학습(adversarial training)이라고 한다[2]. GAN의 강력한 생성 능력은 부족한 데이터셋을 보완하는 데 매우 유용하며, 특히 의료 이미지 분석, 자율주행 차량을 위한 가상 시나리오 생성 등에서 중요한 역할을 하고 있다. 또한, 최근에는 GAN의 다양한 변형 모델들이 제안되며, 이미지 해상도 향상, 스타일 변환, 텍스처 합성 등에서 그 활용 범위를 넓혀가고 있다[3]. 본 논문에서는 GAN 기반 접근법을 활용하여 화재 이미지 생성 데이터를 증강하고, 이를 학습데이터로 활용하고자 한다.

2-2 YOLOv8 알고리즘

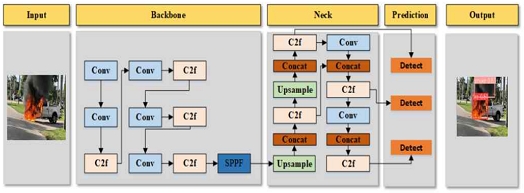

YOLOv8은 Ultralytics에서 개발한 실시간 객체 검출 모델(real-time object detection model)로, YOLOv5와 달리 YOLOv8은 다양한 백본 네트워크를 지원하여 모델의 크기와 정확도를 유연하게 조절할 수 있는 특징을 지니고 있다. 특히, 객체의 존재 여부, 분류, 박스 회귀 작업을 각각 독립적으로 처리하는 분리된 헤드를 가진 anchor-free 프리 모델을 채택함으로써, 전반적인 성능 향상을 이루어 냈다[4],[5]. 이는 기존의 YOLO 계열 모델들이 단일 헤드에서 이러한 작업들을 통합적으로 수행했던 것과 대비되는 혁신적인 설계 방식이다. 또한 YOLOv8은 SPPF Layer(Spatial Pyramid Pooling Fast Layer)를 활용하여 이미지 특징을 고정된 맵에 풀링(pooling)함으로써 연산 속도를 크게 높였다[6]. 더불어 YOLOv8은 객체 검출, 인스턴스 분할 이미지 분류 등 다양한 컴퓨터 비전 작업을 수행할 수 있는 통합 프레임워크를 제공하여, 사용자의 편의성과 활용도를 높였다. 본 논문에서는 YOLOv8 모델을 활용하여 다양한 화재 감지와 인식 기능을 구현하고자 한다.

2-3 Matterport

Matterport는 3D 공간 스캐닝과 모델링을 위한 혁신적인 기술로, 고해상도 3D 카메라와 클라우드 기반의 소프트웨어를 결합하여 실내 공간을 정확하게 디지털화하며, 사용자에게 사실적인 3D 모델을 제공한다. Matterport의 스캐닝 프로세스는 사용자가 공간의 각 지점에서 카메라로 360도를 캡처하고, 이를 클라우드로 업로드하면, 자동으로 이미지를 결합하여 전체 공간의 3D 모델을 생성한다[7]. 이로 인해 다양한 산업에서 공간 분석과 시각화 작업을 보다 효율적으로 수행할 수 있다. 본 논문에서는 Matterport 기술을 활용하여 화재 감지 및 대응 시스템을 위한 3D 환경 모델링을 구현하고자 한다.

Ⅲ. 화재 감지 구현

3-1 화재 감지 모델 설계

본 논문에서는 그림 4의 프로세스를 통해 화재 감지 모델을 설계하였다. 화재 데이터를 수집하여 라벨링 한 후, 이를 기반으로 AI 모델을 학습시키며, 최종적으로 학습된 AI 모델을 사용하여 화재를 감지하는 일련의 과정을 포함한다. 첫 번째 단계는 데이터 수집으로, GAN을 활용하여 다양한 화재 데이터를 수집한다. 두 번째 단계는 수집된 데이터를 라벨링하여 AI 모델 학습에 적합한 형식으로 준비하는 것이다. 이후, 준비된 데이터를 바탕으로 YOLOv8n 모델을 학습시키며, 마지막 단계에서는 학습된 모델을 사용하여 실제 환경에서 화재를 감지하는 작업이 이루어진다. 이러한 프로세스를 통해, 실환경에서 화재를 신속하고 정확하게 감지할 수 있는 AI 기반 화재 감지 모델을 개발하는 것이 본 연구의 목표이다.

3-2 GAN 모델 데이터 증강

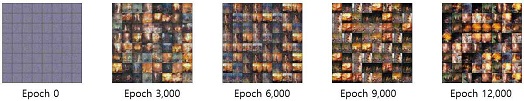

다양한 화재 및 연기 감지 모델의 성능을 향상시키기 위해 본 연구에서는 기존의 단순 데이터 증강 기법을 통해 데이터의 양을 늘리는 대신, GAN(Generative Adversarial Network) 모델을 활용하여 보다 현실적이고 다양한 상황을 반영한 데이터를 생성하였다. 총 12,000 에폭(Epoch)에 걸쳐 학습되었으며, 그 학습 과정은 그림 5와 6에 자세히 나타나 있다.

그림 5는 GAN 모델을 통해 증강된 화재 데이터를, 그림 6은 GAN 모델을 통해 증강된 연기 데이터를 보여준다. 이 두 데이터는 초기에는 무작위에 가까운 이미지로 시작되었으나, 시간이 지남에 따라 구체화되어 실제 화재 및 연기와 유사한 이미지들로 발전되었다. 이 과정을 통해 총 48장의 화재 이미지와 48장의 연기 이미지를 바탕으로 학습을 진행했으며, 최종적으로는 2,560장의 증강된 이미지 데이터를 생성하였다. 이렇게 생성된 데이터는 이후 YOLOv8 모델 학습에 사용될 계획이다.

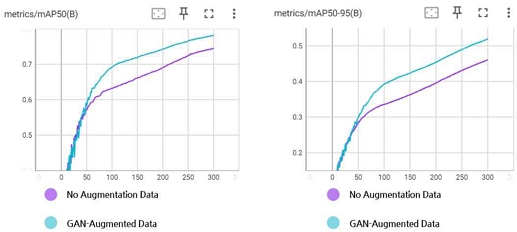

GAN을 통해 증강된 데이터를 바탕으로 YOLOv8 모델을 300Epoch 동안 학습한 결과, 증강 데이터를 추가하지 않은 모델과 비교하여 GAN 증강 데이터를 추가한 모델은 mAP@50에서 약 4.91%, mAP@50-95에서 약 12.74% 성능이 향상되었음을 확인할 수 있었다. 이는 GAN을 통해 다양한 화재와 연기 상황을 보다 효과적으로 반영한 데이터를 추가함으로써 모델이 정확도와 신뢰도가 증가했음을 보여준다.

3-3 데이터 학습

총 18,204장의 이미지 데이터를 사용하여 화재 감지 모델에 학습하였다. 이 중 15,644장은 Roboflow(로보플로우)에서 수집된 실제 화재 및 연기 이미지 데이터이며, 나머지 2,560장은 GAN 알고리즘을 활용하여 생성된 증강데이터로 구성되었다. 이 데이터들을 바탕으로 YOLOv8n 모델을 Google Colab Pro 환경에서 학습시켰으며, 배치 크기(Batch Size) 48, 총 300 에폭 동안 학습을 진행하였다. 학습 과정에서 사용된 Google Colab Pro 사양과 파라미터는 각각 표 1과 표 2에 제시되어 있다.

3-4 YOLOv8 학습 결과

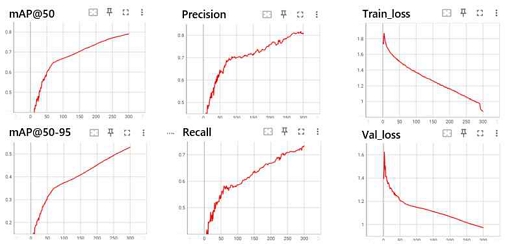

화재 감지 모델의 성능을 평가하기 위해 YOLOv8 모델을 300 에폭(Epoch) 동안 학습시켰으며, 그 결과는 그림 7에 요약되어 있다.

그림 7에 나타난 mAP@50과 mAP@50-95 지표는 모델의 전반적인 성능을 평가하는 핵심 지표들이다. 이 지표들은 학습이 진행될수록 점진적으로 증가하는 경향을 보였으며, 이는 모델이 다양한 조건에서 화재를 보다 정확하게 감지하는 능력이 향상되고 있음을 나타낸다. 이 지표들은 모델의 정밀도와 재현율이 학습이 진행됨에 따라 꾸준히 향상되었음을 보여준다. Precision(정밀도)과 Recall(재현율) 지표 역시 모델의 감지 정확도와 감지 능력을 평가하는데 두 지표 모두 학습이 진행될수록 향상되었으며 시간에 따라 더욱 정밀하게 화재를 감지하고, 놓치는 화재의 비율을 줄여가고 있음을 보여준다. 또한, 학습 손실과 검증 손실 부분은 모델이 검증 데이터에 대해서도 잘 일반화되고 있음을 보여주며, 과적합의 위험 없이 성능이 향상되고 있음을 보여준다.

표 3, 표 4, 표 5는 각각 100, 200, 300 에폭 동안 학습된 YOLOv8 모델의 성능을 요약한 것이다. 학습 에폭이 증가함에 따라 YOLOv8 모델의 성능 지표들이 전반적으로 향상되었음을 확인할 수 있다. 특히 mAP@50과 mAP@50-95 지표의 지속적인 상승은 모델이 더 높은 정확도와 재현율을 바탕으로 화재와 연기를 효과적으로 감지하고 있음을 보여준다.

그림 8에 나타난 테스트 결과는 제안된 YOLOv8 모델이 다양한 조건에서 화재를 정확하게 감지할 수 있음을 보여준다. 각 이미지에 모델은 화재와 연기를 바운딩 박스로 정확하게 표시하고 있으며, 다양한 환경과 화재 상황에서도 일관된 감지 성능을 발휘하고 있음을 확인할 수 있다. 이러한 결과는 모델의 높은 일반화 능력과 신뢰도를 반영하며, 실제 화재 감지 시스템에 효과적으로 적용될 수 있는 가능성을 제시한다.

Ⅳ. 환경 모델링 및 시각화

4-1 환경 모델링 및 3D 시각화

로봇이 화재 감지 및 진압을 효과적으로 수행할 수 있도록 실제 환경을 3D로 모델링하고 시각화하였다. 이를 위해 Matterport 앱을 사용해 건물 내부를 다양한 각도에서 고해상도로 스캔하여 데이터를 수집하였다. 이러한 데이터는 건물 내부의 텍스처와 구조적 요소를 매우 세밀하게 기록하여, 실제 공간을 정확하게 재현할 수 있는 중요한 자료로 활용되었다. 수집된 Matterport 데이터를 기반으로 3D MAX 소프트웨어에서 정밀한 3D 모델을 제작하여 건물의 물리적 환경을 사실적으로 반영하였다. 그림 10은 Matterport로 스캔한 공간 데이터를 3D MAX를 통해 시각화한 결과물이다. 이러한 3D 모델은 로봇이 다양한 상황에 유연하게 대응하고, 복잡한 환경에서도 효과적인 진압 작업을 수행하는 데 도움이 될 것으로 보인다.

4-2 3D 모델 결과 분석

로봇이 화재 감지 및 진압 작업을 수행하는 환경을 3D로 모델링하고, 이 과정에서 생성된 상면도, 전면도, 측면도를 통해 로봇이 작업할 공간의 구조적 특성을 분석하였다. 그림 11은 상면도, 전면도, 측면도를 시각적으로 나타내며, 이는 로봇이 환경을 탐색하는 데 도움이 되는 정보들을 제공한다. 상면도는 공간의 전체적인 배치와 주요 경로를 시각적으로 제공하여, 로봇이 공간 내에서 이동할 때 경로를 설정하는 데 참고할 수 있다. 이를 통해 로봇은 주요 경로를 파악하고 이보다 효율적인 이동 계획을 세울 수 있을 것이다. 전면도와 측면도는 공간의 높이와 깊이를 시각화하여, 로봇이 3차원적인 공간 내에서 입체적으로 환경을 이해하는 데 도움을 줄 수 있다. 예를 들어, 높은 곳에 있는 장애물이나 깊이 차이가 있는 환경 요소들을 고려하여 경로를 설정하고, 장애물을 피할 수 있을 것으로 기대된다. 이러한 3D 시각화는 로봇이 환경을 이해하고, 경로를 계획하며, 장애물을 회피하는 데 필요한 데이터를 제공하여, 더 정밀한 탐색과 이동을 가능하게 할 것으로 예상된다.

4-3 3D 모델 데이터 활용 방안

3D 모델 데이터는 로봇의 화재 감지 및 진압 시스템에서 중요한 역할을 하며, 로봇이 환경을 보다 정확하게 이해하고 효율적으로 경로를 설정하는 데 기여할 수 있을 것으로 기대된다. 특히 3D 모델 데이터는 LiDAR와 같은 실시간 센서 데이터와 결합함으로써 더욱 정교한 환경 인식이 가능해진다. LiDAR 센서는 실시간으로 주변 환경을 스캔하여 변화하는 상황을 파악하고, 3D 모델 데이터는 이를 바탕으로 실시간 경로 탐색 및 장애물 회피를 지원한다. 이 결합을 통해 로봇은 실시간으로 주변 환경을 분석하여 장애물을 정확하게 탐지하고, 안전한 경로를 신속하게 설정할 수 있다. 이는 화재 진압 작업에서 중요한 요소로, 로봇이 다양한 상황에 유연하게 대응할 수 있게 하는데 중요한 역할을 한다. 3D 모델 기반으로 가상의 화재 감지 모델을 보다 정교하게 훈련시켜 실제 화재 상황에서 로봇이 효과적으로 작동할 수 있도록 준비시키는 중요한 역할을 할 것이다. 단순한 시각적 정보 제공을 넘어, 실시간 데이터와 결합해 로봇의 화재 감지 및 진압 성능을 크게 향상시킬 수 있으며, 다양한 환경에서의 신속하고 안전한 작업 수행하는 데 중요한 자원으로 활용될 것이다.

Ⅴ. 화재 발생 시 대응 방안 및 향후 계획

본 연구에서는 화재 감지 AI 모델을 설계하고, 로봇 기반 화재 대응 시스템을 위한 3D 환경 시각화를 수행하였다. 그러나 현재까지는 실제 화재 발생 시 자동으로 대응할 수 있는 기능이 구현되지 않은 상태이다. 향후 계획으로는, 이 시스템을 더욱 발전시켜, 실제 화재 발생 시 실시간으로 대응할 수 있는 통합적인 화재 대응 솔루션을 개발하고자 한다. 이 시스템은 기존의 화재 감지기에서 전달받은 화재 경고를 통해 대략적인 위치를 추정하고, 3D로 시각화된 환경을 바탕으로 로봇이 최적의 경로를 탐색하여 신속하게 화재 발생 지점으로 이동할 수 있도록 알고리즘을 개발할 예정이다. 로봇이 화재 발생 지점에 도착한 후에는, 화재를 효과적으로 진압할 수 있는 대응 시스템을 계획하고 통합할 것이다. 이를 통해 산업 및 제조 시설에서 화재가 발생했을 때 로봇이 신속하게 대응하여 화재를 제압할 수 있는 실질적인 화재 대응 솔루션을 구축하는 것을 목표로 하고 있다. 이는 인명과 재산을 보호하는 데 중요한 기여를 할 것으로 기대된다.

Ⅵ. 결 론

본 논문에서는 YOLOv8 모델과 GAN을 활용하여 화재 감지 AI 모델을 설계하고, 로봇 기반의 화재 대응 시스템을 위한 3D 모델링 및 시각화 기술을 적용하였다. 연구 과정에서 GAN을 통해 생성된 화재 및 연기 데이터를 포함한 다양한 데이터셋을 사용하여 모델을 학습시킨 결과, 넓은 범위의 평가 기준에서 화재 및 연기 감지 성능이 뛰어났음을 확인하였다. 특히, 주요 성능 지표에서 모델은 79.0%의 정확도로 화재를 감지하였으며, 다양한 조건에서도 53.0%의 평균적인 감지 성능을 유지하였다. 이는 제안된 모델이 제안된 모델이 다양한 조건에서 화재를 효과적으로 감지할 수 있음을 확인하였다. 또한, 3D 모델링을 통해 화재 현장의 구조적 특성을 시각화함으로써, 로봇이 화재 발생 시 최적의 경로를 탐색하고, 장애물을 회피하며 신속하게 대응할 수 있는 환경을 구축하였다. 이 과정에서 Matterport 앱을 사용하여 고해상도의 데이터를 수집하고, 3D MAX 소프트웨어를 통해 3D 환경을 재현하였다. 이러한 시각화는 로봇이 복잡한 환경에서도 효과적으로 화재에 대응할 수 있는 능력을 향상시키는 데 기여하였다. 향후 연구에서는 로봇의 화재 진압 기능을 통합하고, 실시간으로 변화하는 상황에 더욱 효과적으로 대응할 수 있는 시스템을 개발하는 데 주력할 것이다. 이 연구는 로봇 기반 화재 대응 시스템의 발전 가능성을 제시하며, 다양한 산업 분야에서의 안전성을 높이는 데 중요한 역할을 할 것으로 기대된다. 앞으로의 연구와 개발을 통해 본 시스템이 더욱 정교화되고, 실제 화재 상황에서 그 효과가 입증될 수 있기를 기대한다.

Acknowledgments

본 연구는 과학기술정보통신부 및 정보통신기획평가원의 지역지능화혁신인재양성사업의 연구결과로 수행되었음(IITP-2024-RS-2022-00156287).

References

- Incheon Ilbo. [Gyeonggi-do Fire Protection ‘Emergency’ Report] ③ ‘Continued’ Casualties due to Initial Response Failure [Internet]. Available: https://www.incheonilbo.com/news/articleView.html?idxno=1109266, .

-

Y. J. Jo, K. M. Bae, and J. Y. Park, “Research Trends of Generative Adversarial Networks and Image Generation and Translation,” Electronics and Telecommunications Trends, Vol. 35, No. 4, pp. 91-102, August 2020.

[https://doi.org/10.22648/ETRI.2020.J.350409]

-

M. Cui, M. Kim, S. Choi, and S. Lee, “The Usage and Impact of GAN in Graphic Design,” Archives of Design Research, Vol. 35, No. 4, pp. 285-307, November 2022.

[https://doi.org/10.15187/adr.2022.11.35.4.285]

-

D.-H. Kim and H. H. Choi, “A Research on Cylindrical Pill Bottle Recognition with YOLOv8 and ORB,” Journal of the Korea Society of Computer and Information, Vol. 29, No. 2, pp. 13-20, February 2024.

[https://doi.org/10.9708/jksci.2024.29.02.013]

-

M. N. Sadik, T. Hossain, and F. Sayeed, “Real-Time Detection and Analysis of Vehicles and Pedestrians Using Deep Learning,” arXiv:2404.08081v1, April 2024.

[https://doi.org/10.48550/arXiv.2404.08081]

- C.-M. Lee, W.-S. Jeon, and S.-Y. Rhee, “A Real-Time System for Judging Vehicle Loads and Overloaded Using Yolo with Post-Processing Algorithm,” Journal of Korean Institute of Intelligent Systems, Vol. 33, No. 5, pp. 414-422, October 2023. http://dx.doi.org/10.5391/JKIS.2023.33.5.414

-

A. Chang, A. Dai, T. Funkhouser, M. Halber, M. Niebner, M. Savva, ... and Y. Zhang, “Matterport3D: Learning from RGB-D Data in Indoor Environments,” in Proceedings of 2017 International Conference on 3D Vision (3DV), Qingdao, China, pp. 667-676, October 2017.

[https://doi.org/10.1109/3DV.2017.00081]

저자소개

2019년~현 재: 호남대학교 소프트웨어학과 학사과정

※관심분야:클라우드, 백엔드, 인공지능

1997년:포항공과대학교 정보통신학과

2013년:전남대학교 전산통계 이학박사

1991년~1997년: 포스코 ICT(주) 연구원

1998년~현 재: 호남대학교 컴퓨터공학과 부교수

※관심분야:사물인터넷, 인공지능, 응용 SW

1994년:울산대학교 시각디자인학과 디자인학사

1998년:국립큐슈예술공과대학 대학원 정보전달 예술공학석사

2002년:국립큐슈예술공과대학 대학원 정보전달 예술공학박사 수료

2002년~2012년: 호남대학교 소프트웨어학과 조교수

2013년~현 재: 호남대학교 컴퓨터공학과 부교수

※관심분야:VR/AR, UI/UX, 컴퓨터비젼

1990년:조선대학교 전자계산학과 이학학사

1995년:조선대학교 전산통계학과 이학석사

2003년:조선대학교 전산통계학과 이학박사

2018년~2021년: 조선대학교 SW중심대학 초빙객원교수

2021년~현 재: 호남대학교 컴퓨터공학과 조교수

※관심분야:스마트팩토리 자동화 시스템, AI 딥러닝, 빅데이터 고도화 처리