GPS 및 딥러닝을 이용한 스마트 시티 투어 모바일 애플리케이션

Copyright ⓒ 2023 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 논문에서는 GPS 및 딥러닝 기반의 스마트 시티 투어 모바일 애플리케이션을 제안한다. 제안된 애플리케이션은 딥러닝을 이용하여 랜드마크 이미지 인식 기능을 제공하고 위치기반 서비스를 통해 현재 사용자의 위치에 기반하여 주변 관광지 정보를 제공한다. 이미지 인식 서비스는 사용자가 애플리케이션에 랜드마크 이미지를 업로드하면 딥러닝 모델을 통해 이미지를 식별하고, 해당 랜드마크의 세부 정보를 제공한다. 랜드마크 이미지는 ResNet-D 모델을 사용하여 서울시에 있는 13개의 랜드마크에 대해 학습을 진행하여 최종 모델의 평균 분류 정확도는 약 0.957, 평균 F1-Score는 약 0.938로 좋은 성능을 얻었다. 또한 애플리케이션 내에서 위치기반 서비스를 통해 사용자의 현재 위치로부터 가까운 랜드마크의 정보를 알 수 있으며, 각 랜드마크의 정보를 다른 사용자에게 공유할 수 있다. 본 애플리케이션을 통해 여행 중이거나 여행을 계획 중인 외국인들에게 수도 서울에 대한 정보를 신속하게 제공하여 여행에 도움을 줄 수 있다.

Abstract

In this study, we propose a smart city tour mobile application based on GPS and deep learning. The proposed application provides the landmark image recognition service using deep learning and provides information on nearby tourist attractions based on the current user’s location through location-based services. The image recognition service identifies the image through a deep learning model when a user uploads a landmark image to the application and provides a detailed description of the landmark. We trained landmark images using the ResNet-D model on 13 landmarks in Seoul and achieved good performance of the final model with average classification accuracy and F1-score of around 0.957 and 0.938, respectively. In addition, location-based services within the application allow users to know information about landmarks close to their current location and share the information with other users. Foreigners who are traveling or planning to travel can easily obtain information about the capital Seoul with this application to aid their travel.

Keywords:

Smart tourism, Location-based services, Deep learning, Mobile applications, Image classification키워드:

스마트 투어, 위치 기반 서비스, 딥러닝, 모바일 애플리케이션, 이미지 분류Ⅰ. 서 론

최근 4차 산업혁명의 가속화와 함께 5G, 인공지능, 빅데이터, 증강현실 등의 첨단 ICT 기술이 발전함에 따라 이러한 기술을 이용한 스마트 투어(Smart Tourism) 서비스가 연구 개발되고 있으며 관광객들에게 더 편리하고 즐거운 여행 경험을 선사하는 것에 그 목적을 두고 있다[1].

빅데이터 기술은 대용량 데이터를 어떻게 효과적으로 처리하고 분석하는지에 초점을 맞춘 기술로 인터넷 환경에서 생성되는 데이터로 규모가 크고, 생성 속도도 빠르며 형태도 정형화된 수치 데이터뿐 아니라 비정형 데이터도 포함된다[2]. 이러한 빅데이터 기술을 활용하여 소셜미디어의 주요 온라인 커뮤니티인 카페 및 블로그 등에서 생성된 콘텐츠를 대상으로 관광 소비자의 주요 의사결정을 위한 생각 및 의견 등을 비정형 형태로 추출하고, 데이터 간의 관계를 분석하여 시사점을 얻거나, 관광 산업에서 관광객 수요 예측이나 고객과의 상호 작용 관리 및 맞춤형 마케팅 등의 서비스 제공을 위해 활용할 수 있다[3],[4].

관광 산업에서의 딥러닝 기술은 복잡한 비선형적 관계의 상호작용을 모델링하고 개인별 선호도를 예측하는데 탁월한 성능을 입증할 수 있는 기술이다. 주로 빅데이터 기술과 융합되어 활용되어왔으며 주로 관광객들의 데이터를 수집하여 정제한 뒤 새로운 사용자에게 관광지를 추천하는 추천 시스템 위주의 연구들이 활발히 진행 중이다[5].

증강현실(Argument Reality) 기술은 사용자가 눈으로 보는 현실화면 또는 실영상에 문자, 그래픽과 같은 가상정보를 실시간으로 중첩 및 합성하여 하나의 영상으로 보여주는 기술이다. 증강현실은 스마트폰과 같은 퍼스널 스마트 디바이스를 통해 현실 세계에 가상의 정보를 혼합하여 실시간으로 정보를 획득할 수 있고 상호작용이 가능하며 또한 멀티미디어의 발달과 스마트폰의 보급으로 이동의 자율성 및 조작의 용이성 그리고 접근의 편리성이 가능해지면서 고정된 장소에서의 증강현실 콘텐츠뿐 아니라 스마트폰 기반 증강현실 애플리케이션 콘텐츠로 활용사례가 확장되고 있다. 증강현실 애플리케이션 콘텐츠는 게임, 교육, 전시, 광고, 정보 등 여러 분야에서 각각의 목적에 따라 다양한 유형의 콘텐츠를 제공한다[6].

현재 서비스 중인 스마트 투어 애플리케이션들은 위와 같은 첨단 ICT 기술을 적극적으로 활용하는 것이 아니라 기존의 사용자가 원하는 여행지에 대한 이동 수단, 액티비티, 여행 스케줄링 등 개인화된 여행 추천 기능 또는 기존 사용자로부터 획득한 빅데이터를 기반으로 추천 시스템을 활용하여 새로운 사용자에게 관광지를 추천하거나 증강현실 기술을 활용하여 관광지에 대한 콘텐츠를 제공하는 등의 제한된 기술 위주의 서비스만 진행 중이다.

본 논문에서는 전통적인 방법인 GPS를 활용한 위치기반 서비스와 딥러닝을 융합하여 외국인 관광객을 위한 스마트 시티 투어 모바일 애플리케이션을 제안한다. 애플리케이션의 관광 명소는 서울지역을 중심으로 제작되었으며 스마트 투어의 적용 대상은 2021~2022 한국 관광 100선 중 서울지역 랜드마크 9종 13개를 대상으로 선정하였다. 또한 13개의 랜드마크 정보뿐만 아니라 200여 개의 서울 주요 랜드마크에 대한 정보를 위치기반 서비스에 기반하여 제공한다. 그리고 외국인 관광객이 서울시를 관광하며 촬영한 랜드마크 사진이나 블로그, SNS 등에서 획득한 랜드마크 사진을 딥러닝 모델을 통해 식별하여 해당 장소의 정보를 제공하는 스마트 투어 서비스도 제공 중이다.

본 논문의 구성을 다음과 같다. 2장에서는 관련 연구 및 애플리케이션에 관해 기술하고 3장에서는 랜드마크 이미지 분류를 위한 딥러닝에 관해 기술한 뒤 4장에서는 딥러닝과 위치기반 서비스를 기반으로 개발한 스마트 시티 투어 모바일 애플리케이션에 관해 기술한다. 마지막으로 5장에서는 결론 및 한계점에 관하여 기술한다.

Ⅱ. 관련연구 및 애플리케이션

2-1 관련 연구

기존의 스마트 투어 서비스 관련 연구는 위치기반 서비스와 첨단 ICT 기술을 결합하여 실시간으로 사용자와의 상호작용이 가능하고 접근이 쉬운 모바일 애플리케이션에 접목하는 방향으로 진행되었으며, 기존 사용자의 과거 행동 데이터나 추가 데이터를 바탕으로 현재 사용자에게 필요한 정보를 추천해주는 추천 시스템과 사용자의 현재 위치를 기반으로 랜드마크에 대한 안내 및 콘텐츠를 제공하는 방식의 연구들이 진행되었다.

[7]에서는 제주도의 주요 관광 명소에 애플리케이션 기반 스마트 투어 가이드 서비스를 제공한다. 해당 애플리케이션은 여행하기 전 준비 과정뿐만 아니라 여행 중과 여행 후에 사용할 수 있는 서비스를 제공하여 추천 관광지 여행 상품을 선택하거나 애플리케이션에서 제공하는 정보를 통해 개인 일정표를 계획하여 여행을 준비할 수 있다. 여행 과정에서는 애플리케이션의 지리정보시스템을 기반으로 관광지 주변의 정보를 제공하고 여행 후에는 사용자가 애플리케이션에 등록한 일정표를 다른 사용자에게 추천하는 기능을 제공한다.

[8]에서는 특정 장소에 대한 정보를 스토리텔링 형식으로 안내하는 증강현실 기반 3D 가이드 애플리케이션을 제안하였다. 해당 애플리케이션은 증강현실 기술과 위치기반서비스를 접목하였으며 애플리케이션의 위치기반서비스를 통해 사용자의 위치를 실시간으로 획득하여 데이터베이스에 업로드한 뒤 사용자의 위치를 통해 해당 위치에 대한 정보를 증강현실 기술을 활용하여 3D로 제공하여 사용자에게 해당 위치에 대한 설명 및 안내가 가능하다.

[9]에서는 서울 경복궁 내의 다양한 문화재 이미지를 식별하여 해당 문화재의 정보를 제공하는 서울 경복궁 모바일 관광 가이드 애플리케이션을 제안하였다. 해당 애플리케이션은 서울 경복궁 내의 문화재에 관한 콘텐츠를 중심으로 실시간 문화재 인식, GPS 위치 확인, 얼굴인식 기반 AR 카메라, 행사 정보 제공의 총 4개의 서비스를 제공한다.

2-2 관련 애플리케이션

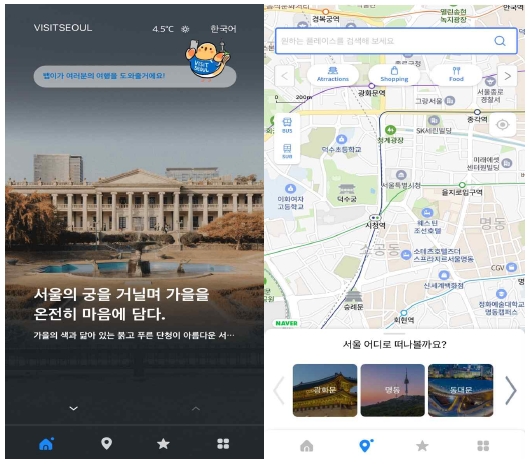

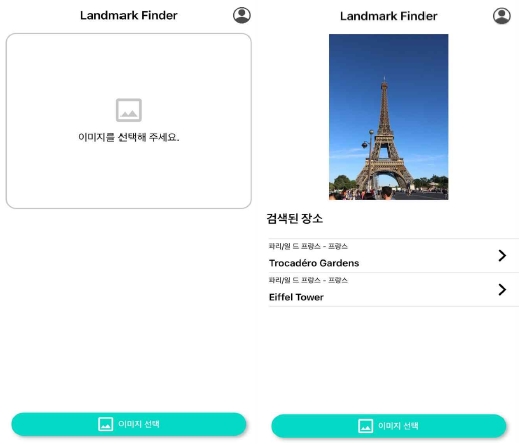

본 논문에서 제안하는 애플리케이션과 유사한 현재 서비스 중인 애플리케이션으로는 서울시의 공식 모바일 여행 가이드 애플리케이션인 ‘VisitSeoul’[10]과 이미지 기반 랜드마크 검색 애플리케이션인 ‘Landmark Finder’[11]가 있다.

첫 번째로 VisitSeoul 애플리케이션은 서울시 공식 관광 정보 사이트(VisitSeoul.net)와 연동하여 관광명소, 맛집, 숙박, 교통정보, 각종 행사 등에 관한 실시간 정보를 제공한다(그림 1). 부가적으로 증강현실 기술을 활용하여 서울 관광 가이드북의 특정 페이지를 스마트폰으로 비추면 사용자에게 여행 정보가 실시간으로 제공된다.

두 번째 애플리케이션인 Landmark Finder는 각국의 대표 랜드마크에 대한 이미지 인식 애플리케이션이다(그림 2). 이미지를 업로드하면 이미지를 식별한 뒤 해당 장소에 대한 정보를 알려주는 서비스를 제공하며 이미지를 식별한 후에는 사용자 휴대전화에 내장된 지도 애플리케이션으로 자동 연동되어 주변 근방의 랜드마크 정보를 제공한다.

하지만 VisitSeoul은 검색을 통한 관광지 정보 획득과 GPS를 통한 관광지 길 찾기 서비스 및 정보 공유가 가능하지만, 애플리케이션 내에 보이는 지도에서 사용자 근처에 어떤 랜드마크가 있는지 뚜렷하게 구분하기 어렵다. 그리고 랜드마크 장소의 이름을 모르고 이미지만 있는 사용자는 애플리케이션 내의 정보를 하나씩 살펴봐야 한다는 단점이 있다. Landmark Finder는 관광지에 대한 정보를 딥러닝 기반 이미지 인식을 통해서 제공하지만, 장소의 이름과 위치 및 설명에 대한 정보만 제공하며 이외의 자세한 정보의 획득 및 정보 공유가 제한된다는 단점이 있다. 또한 전 세계 대표 랜드마크 인식에 목적을 두어 특정 나라나 지역 관광용 애플리케이션으로는 부적합하다.

기존에 서비스 중인 관광 정보 모바일 애플리케이션에 대한 기능 비교를 위해 관광 애플리케이션 관련 선행 연구[12],[13]에서 제시한 사용의 편의성과 얼마나 빨리 정보를 획득할 수 있는지를 고려하여 분석 기준을 정했다. 최종적으로 관광지 정보 제공, GPS 기반 사용자 주변 관광지 정보 제공, 이미지 인식을 통한 정보 제공, 정보 공유기능의 유무 총 4개의 기준을 선정하여 비교 분석(표 1)을 진행하였다.

분석 결과 제안하는 애플리케이션은 랜드마크 이미지에 대해 학습된 딥러닝 모델을 통한 랜드마크 인식 서비스와 GPS를 활용한 위치기반 서비스 기능을 이용하여 사용자는 더욱 편리하고 신속하게 자세한 관광지 정보를 제공받을 수 있어 기존의 애플리케이션들과는 차별화된다.

Ⅲ. 랜드마크 이미지 분류를 위한 딥러닝

3-1 학습용 이미지 데이터 수집 및 전처리

인공지능 모델 학습을 위한 13개의 랜드마크 이미지 데이터는 다음과 같은 두 가지 방법으로 획득하였다. 먼저 AI-Hub[14]의 랜드마크 이미지 데이터 및 한국형 사물 이미지 데이터를 통해 일부 레이블에 대한 고화질 사진을 획득하였다. 해당 데이터셋은 각 랜드마크 당 50장 이상의 이미지를 포함하지만, 대부분 촬영자가 짧은 시간 내 다각도에서 연속적으로 찍은 이미지로 구성되어 계절이나 날씨, 야간시간과 같은 실제 사용자들의 다양성에 대응하기가 어렵다는 한계점이 존재한다.

두 번째로는 이러한 한계점을 보완하기 위해 데이터 직접 수집 방법 중 크롤링(Crawling)을 활용하여 추가 이미지 데이터를 확보하였다. 크롤링 대상 사이트로는 구글과 네이버를 선정하였으며, 다양한 이미지 수집을 위해 검색 키워드를 한글과 영문 두 가지로 설정하여 후처리 작업을 통해 중복되는 사진은 제거하였다. 크롤링 시에는 저작권이 있는 사진까지 함께 수집될 수 있는 문제가 있지만, 본 논문에서는 CCL(Creative Commons License)을 준수하여 상업적 이용 가능 이미지만 수집하였다. 또한 학습 중 병목현상을 최소화하기 위해 고화질 이미지를 320x320 크기의 이미지로 다운샘플링 하여 전처리를 수행하며 최종적으로 랜드마크 별 획득한 학습 이미지 수는 표 2와 같다.

3-2 랜드마크 이미지 분류 모델 선정

기존의 인공지능을 활용한 랜드마크 이미지 식별은 Large Scale Instace-Level Recognition[15], Large Scale Image Retreival[16]과 같이 대용량 데이터에서 유사 이미지 인식 및 분류를 중심으로 진행되어왔다. 하지만 본 논문에서 인공지능 학습에 사용한 레이블의 개수는 비교적 적은 13개로, 빠르고 정확한 랜드마크 식별을 위해 이미지 인식에 우수한 성능을 보이는 깊은 합성곱 신경망(Deep Convolutional Neural Network)으로 구성된 모델에 대한 실험을 진행하여 이미지 분류 모델을 선정하였다.

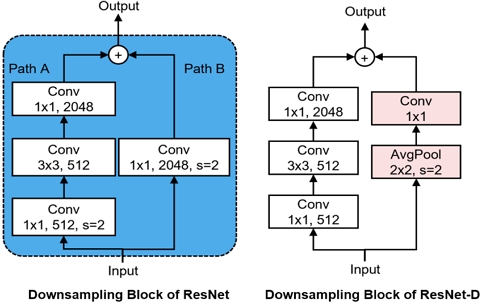

백본 네트워크 선정을 위해 먼저 계층적 샘플링(Stratified Sampling)을 통해 레이블별 데이터 비율을 유지하여 학습 및 검증 데이터를 8:2로 분리하였다. 실험은 PyTorch 프레임워크에서 VGG[17], ResNet[18], EfficientNet[19], ResNet-D[20]총 4종에 대해 진행하였다. ResNet-D 모델은 기존의 ResNet 모델의 단점인 잔차(Residual) 학습 시 잔차 연결의 차원 축소에 따른 정보 유실 문제를 개선한 모델이다. ResNet에서는 잔차학습 시 잔차 연결에 대해 1x1 합성곱 연산을 바로 수행하는 반면 ResNet-D에서는 평균 풀링(Average Pooling) 레이어를 거친 뒤 1x1 합성곱 연산을 수행해 입력인 이전 레이어에 대한 정보 유실 문제를 해결하였으며 두 모델의 잔차 학습 과정은 그림 3과 같다.

또한 실험 진행 시 빠른 학습을 위해 ImageNet 데이터셋으로 사전 학습된 모델의 가중치를 활용한 전이학습(Transfer Learning)을 진행하였다. 학습 매개변수로는 Batch Size는 32, Image Size는 224x224, Optimizer는 AdamW, Learning Rate는 0.0001로 설정하여 총 50 epoch 동안 학습을 진행하였다. 성능 평가는 검증 데이터에 대해 정확도(Accuracy)와 데이터 불균형 문제를 고려하여 F1-Score로 평가를 진행하였다. F1-Score는 정확도와는 다르게 모델의 정밀도(Precision)와 재현율(Recall)을 고려한 평가지표로 정밀도와 재현율의 조화평균(Harmonic Mean)으로 식 (1)과 같이 계산된다.

| (1) |

실험 결과 ResNet-D 모델이 검증 데이터에 대한 분류 정확도가 약 93%로 가장 우수한 성능을 보여주어 최종적인 랜드마크 이미지 분류 모델의 백본으로 선정하였으며 각 모델에 대한 실험 결과는 표 4와 같다.

3-3 랜드마크 데이터 증강

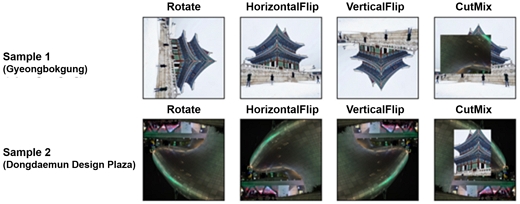

수집한 랜드마크 데이터로는 딥러닝 모델을 학습시키기에는 데이터의 양이 충분하지 않아 랜드마크 이미지 분류 모델 선정 실험 시 과적합(Overfitting)이 빠르게 일어났으며, 이는 애플리케이션 서비스 시 품질 저하 문제로 이어지게 된다. 따라서 학습 성능을 높이고 과적합 방지를 위해 학습 데이터 증강을 수행하였으며, 수집한 데이터는 사전에 증강하는 것이 아닌 학습 중 확률적으로 데이터를 증강하여 학습 난이도를 보다 더 어렵게 설계하였다. 이러한 확률적 데이터 증강 기법은 하나의 데이터에 여러 가지 증강 기법이 확률적으로 적용되어 보다 다채로운 증강이 가능하다. 증강 방법으로는 먼저 오픈소스 라이브러리인 Albumentations[21]의 무작위 90도 회전 (RandomRotate90), 상하(VerticalFlip) 및 좌우 반전(HorizontalFlip)을 활용하였다. 두 번째로는 하나의 이미지의 일부를 자른 뒤 해당 부분에 다른 레이블의 데이터 일 부를 삽입하는 Cutmix[22]를 데이터 증강에 활용하였으며, 증강된 학습 이미지 예시는 그림 4와 같다.

학습 데이터 증강에 따른 성능 향상 검증을 위해 3-2에서 선정한 백본 네트워크인 ResNet-50-D에 대해 첫 번째로 Albumentation 라이브러리의 무작위 90도 회전, 상하 및 좌우 반전의 증강 확률을 각각 50%로 설정한 뒤 실험을 진행하였다. 두 번째로는 Cutmix만으로 데이터 증강을 진행해 실험을 진행하였으며, 마지막으로는 두 기법을 동시에 적용하여 실험을 진행하였다.

실험 결과 각 데이터 증강 기법은 성능향상이 있음을 확인하였다. 두 번째 방법과 세 번째 방법의 검증 데이터에 대한 정확도는 0.9602로 같은 수치를 기록했으나, 각 기법을 모두 적용한 세 번째 방법의 F1 Score가 근사하게 높음을 확인하여 최종적으로 데이터 증강에는 두 기법 모두 채택하였다.

3-4 최종 모델 학습

서비스를 위한 일반화를 높이기 위해 이전의 실험을 통해 선정한 네트워크의 백본과 데이터 증강 기법에 K-Fold Validation을 활용하여 최종 모델을 학습하였다. 이때 K값은 5로 설정하였으며, 검증 데이터에 대한 평균 정확도는 약 0.957, 평균 F1 Score는 약 0.938의 좋은 성능을 기록하였다.

추론 과정에서는 사용자에게 이미지를 입력받으면 최종 학습된 5개의 모델의 결과에 대한 소프트 보팅(Soft Voting) 결과를 최종적으로 전달하는 구조이다.

IV. 스마트 시티 투어 모바일 애플리케이션

본 논문에서 개발한 모바일 스마트 시티 투어 애플리케이션은 4가지 주요기능(회원가입 및 로그인, 랜드마크 이미지 식별, 위치기반서비스, 랜드마크 정보 제공)으로 구성되어 있으며 본 장에서는 애플리케이션의 동작 과정 및 세부 기능에 관해 기술한다.

제안하는 애플리케이션은 사용자의 현재 위치를 기반으로 주변에 있는 관광 명소에 대한 이름, 위치, 전화번호와 같은 정보를 제공할 뿐만 아니라, 사용자가 애플리케이션에 랜드마크 이미지를 업로드하면 딥러닝 모델 통해 이미지를 식별하여 해당 랜드마크에 대한 정보를 제공한다. 또한 애플리케이션 내에서 위치 기반 서비스를 통해 사용자가 현재 위치로부터 가까운 랜드마크의 정보를 알 수 있으며 각 랜드마크의 정보를 다른 사용자에게 공유하는 기능도 제공한다.

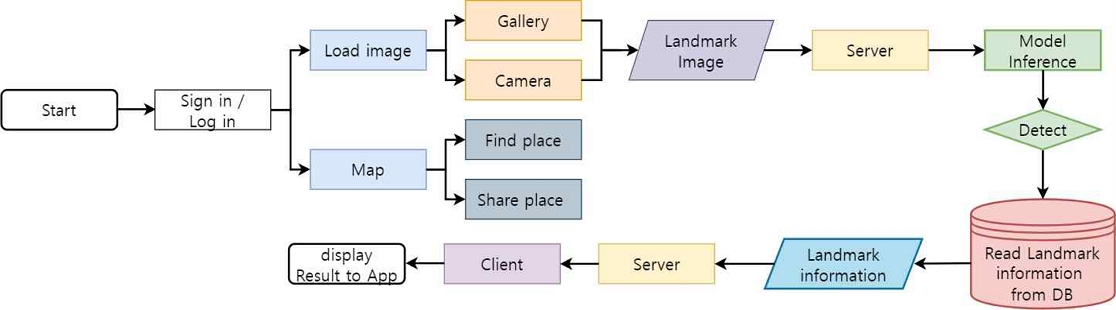

사용자가 처음 애플리케이션을 실행하면 회원가입 창이 나타나고 구글 로그인 또는 직접 회원가입을 선택할 수 있으며 최초로 로그인에 성공하면 이후에는 애플리케이션을 재실행하여도 로그인 상태가 유지된다. 그다음 사용자가 스마트 투어 서비스를 이용할지 아니면 위치기반 서비스를 이용할지 선택하게 된다. 스마트 투어 서비스를 이용하면 사용자가 실시간으로 사진을 촬영하거나 갤러리에 저장된 사진을 불러와 랜드마크 인식이 가능하다. 또한 위치기반 서비스를 선택하게 되면 주변의 관광지 목록이 출력되며 관광지 이름, 전화번호, 주소와 같은 정보를 공유할 수 있는 기능을 제공하며 기술한 내용을 도식화한 전체 애플리케이션 흐름도는 그림 5와 같다.

4-1 서버와 클라이언트

파이썬 서버와 안드로이드 클라이언트의 통신을 위해 구글의 파이어베이스(Firebase)와 소켓 통신을 활용하였다. 통신 과정에서 먼저 사용자로부터 전송받은 이미지의 파일명을 전송 시점 기준 유닉스 타임(UNIX Time)으로 변경하여 파이어베이스 저장소(Storage)에 업로드 한다. 다음으로 업로드된 파일명을 소켓 통신 시 쿼리 값으로 활용하여 이미지를 다운받아 학습된 딥러닝 모델을 통해 랜드마크를 분류한다. 분류된 결괏값은 파이어베이스의 실시간 데이터베이스에 업로드되며, 동시에 안드로이드 클라이언트에도 전송하여 랜드마크 데이터베이스의 쿼리 값으로 이용된다. 마지막으로 분류된 결과에 해당하는 정보를 데이터베이스에서 검색하여 애플리케이션에 전달 및 출력한다.

4-2 애플리케이션 메인화면

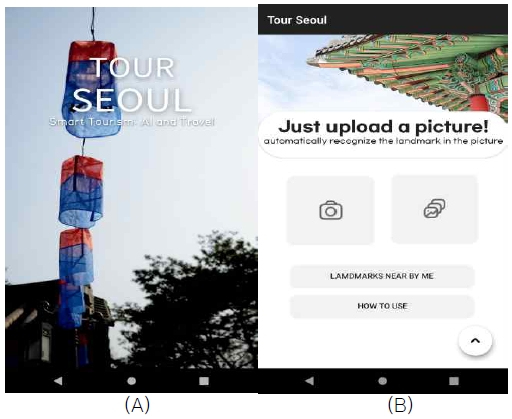

본 애플리케이션을 실행하면 그림 6(A)과 같이 초기화면이 나타난 뒤, 그림 6(B)과 같이 두 가지 서비스로 구성된 메인 화면으로 전환된다. 먼저 첫 번째 서비스로는 스마트 투어가 적용된 랜드마크 식별 서비스로 사용자가 실시간으로 사진을 촬영하거나, 휴대폰에 저장된 사진을 불러와 서비스 이용이 가능하다. 두 번째 서비스는 위치기반의 스마트 투어 서비스로, 해당 서비스는 서울 도시 내에 있는 랜드마크의 정보뿐만 아니라 사용자 근처에 있는 랜드마크를 확인할 수 있는 기능을 제공한다.

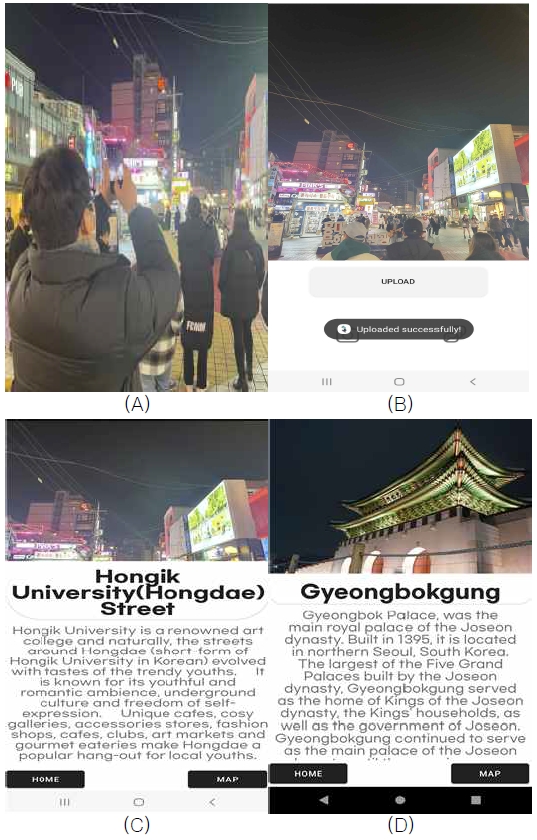

랜드마크 식별 서비스는 그림 7(A)과같이 사용자가 직접 사진을 찍거나 갤러리에 있는 이미지를 업로드를 하여 이용할 수 있다. 애플리케이션에 사진을 업로드하면 식별하고자 하는 이미지가 업로드 할 이미지가 맞는지 사용자에게 최종적으로 확인한다(그림 7(B)). 해당 화면에서 ‘UPLOAD’ 버튼을 누르면 해당 이미지가 서버로 전달되고, 해당 이미지의 장소를 식별한 결과와 함께 해당 장소의 정보가 사용자에게 전달된다(그림 7(C), (D)).

4-3 위치기반서비스

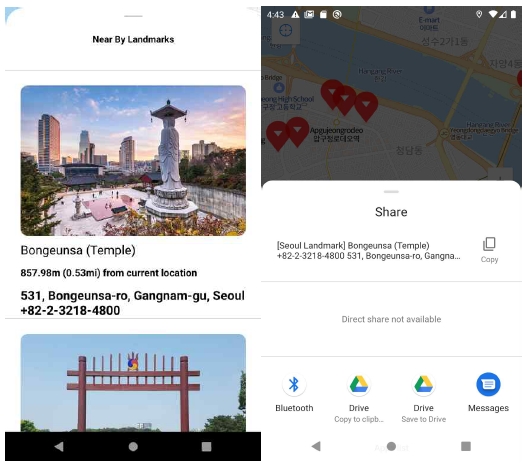

지도 화면은 마커(Marker), 뷰페이저(ViewPager), 바텀 시트(Bottom Sheet)로 구성되어 있으며 지도에 표시된 마커를 통해서 사용자 근처에 어떤 랜드마크가 있는지 알 수 있다(그림 8). 사용자의 현재 위치에는 초록색 마커로 표시되고 각 랜드마크 장소의 위치는 빨간색 마커로 표시된다. 또한 좌/우 뒤집기를 통해 페이지를 전환할 수 있도록 만들어주는 컨테이너인 뷰페이저를 통해 랜드마크의 간단한 정보를 확인할 수 있다. 뷰페이저를 슬라이드 하면 동적으로 다른 장소 위치로 전환되며, 해당 뷰페이저를 클릭하면 랜드마크 정보에 대한 공유기능을 제공한다.

사용자 근처에 있는 랜드마크의 정보는 스마트폰에 내장된 GPS 기능을 사용하여 현재 사용자의 위치를 실시간으로 획득하여 제공한다. 사용자에게 위치 추적 권한을 승인받으면 지도가 표시되며 지도 화면은 네이버 지도 API와 서울관광재단의 VisitSeoul 영문 랜드마크 정보 API[23]를 활용하여 구성하였다.

추가로 지도 화면의 하단에는 ‘Near By Landmarks’로 표시된 바텀시트가 있다. 바텀시트는 사용자의 액션을 위해 화면 하단에 출력되는 모달 사용자 인터페이스(User Interface)로 사용자가 바텀시트를 밀어 올리면 현재 위치 부근에 있는 랜드마크의 장소 이름, 현재 위치로부터의 거리, 상세 주소, 전화번호 등 자세한 정보를 알 수 있다(그림 9).

V. 결론 및 한계점

본 논문에서는 현재 서비스 중인 관광 정보 모바일 애플리케이션을 비교하여 관광지의 정보 흭득 측면에서 간편성과 실용성의 한계를 보완하기 위해 대한민국의 수도인 서울을 중심으로 딥러닝 중 컴퓨터 비전 분야의 이미지 분류 기술과 위치기반 서비스를 접목한 모바일 시티 투어 모바일 애플리케이션을 제안하였다.

본 논문에서는 여행 중이거나 여행을 계획 중인 외국인을 대상으로 하여 서울에 대한 관광지 정보 제공, GPS 기반 사용자 주변 관광지 정보 제공, 그리고 딥러닝 기반 이미지 인식을 통한 정보 제공 기능을 통해 정보를 빠르고 쉽게 얻을 수 있는 애플리케이션을 제안한다. 제안하는 애플리케이션을 여행 중에 이용한다면 여행자에게 도움을 줄 수 있으며 딥러닝 기반 스마트 관광을 통해 사용자의 관심을 유도할 수 있을 뿐만 아니라, 서울 여행을 계획 중인 사용자에게도 계획 수립에 도움을 줄 수 있다.

개발된 스마트 투어 서비스는 일부 서울시 랜드마크를 기반으로 제한적인 관광지 정보 서비스를 제공하고 있으며 세부 랜드마크 정보들은 위치기반 서비스에 의존하고 있다. 추후 연구로는 서울 한정 서비스가 아닌 비교적 외국인 관광객의 방문이 많은 부산이나 대구 등의 주요 거점도시에 대한 스마트 관광 서비스를 확장하여 사용성 평가를 통한 효과성을 판단할 계획이다. 끝으로 개발된 스마트 투어 서비스를 통하여 국내 관광 활성화에 도움이 될 것을 기대한다.

References

-

C. K. Pai, Y. Liu, S. Kang, and A. Dai, “The role of perceived smart tourism technology experience for tourist satisfaction, happiness and revisit intention,” Sustainability, Vol. 12, No. 16, pp. 1-14, December 2020.

[https://doi.org/10.3390/su12166592]

- F. Gao, “Segmentation of Chinese tourist market according to travel destination image by big data analysis : Centered in Seoul metropolitan city,” Master’s thesis, Graduate School, Kyung Hee University, Seoul, 2019.

-

J. S. Hong and I. K. Oh, “Image difference of before and after an incident using social big data analysis: Focusing on a ramp return of “K” airline,” International Journal of Tourism and Hospitality Research, Vol. 30, No. 6, pp. 119-133, June 2016.

[https://doi.org/10.21298/IJTHR.2016.06.30.6.119]

-

L. Ardito, R. Cerchione, P. Del Vecchio, and E. Raguseo, “Big data in smart tourism: Challenges, issues and opportunities,” Current Issues in Tourism, Vol. 22, No. 15, pp. 1805-1809, July 2019.

[https://doi.org/10.1080/13683500.2019.1612860]

-

M. S. Hong, N. H. Chung, and S. H. Han, “Deep learning-based smart tourism recommendation algorithm development research: A novel OTA restaurant recommender system,” Journal of Tourism and Leisure Research, Vol. 34, No. 3, pp. 431-444, March 2022.

[https://doi.org/10.31336/JTLR.2022.3.34.3.431]

-

S. Y. Jung, “Analysis of augmented reality-based museum APP contents types,” Bulletin of Korean Society of Basic Design & Art, Vol. 20, No. 2, pp. 385-396, April 2019.

[https://doi.org/10.47294/KSBDA.20.2.28]

-

J. W. Jwa, “Service platform and mobile application for smart tour guide,” The Journal of Institute of Internet, Broadcasting and Communication, Vol. 16, No. 6, pp. 203-209, December 2016.

[https://doi.org/10.7236/JIIBC.2016.16.6.203]

- G. S. Cho, Y. J. Kwon, K. B. Lee, S. G. Yeo, S. M. Oh, and Y. Y. Lee, “Augmented reality based region guide application for new normal smart tour,” Proceedings of Symposium of the Korean Institute of Communications and Information Sciences, Online, pp. 553-554, November 2020.

- H. J. Oh, J. S. Jung, S. J. Park, and K. Y. Lee, “Development of a tour information system for smart phones using CNN,” Proceedings of the Korean Information Science Society Conference, pp. 1642-1644, June, 2019.

- VisitSeoul [Internet]. Available: https://www.visitseoul.net/

- Landmark Finder [Internet]. Available: https://landmarkfinder.blogspot.com/

-

S. T. Kim, “The effect of e-service quality of mobile tourism information applications on purchase intention : The moderated mediation effect of perceived usefulness and user innovation,” International Journal of Tourism and Hospitality Research, Vol. 35, No. 6, pp. 103-119, June 2021.

[https://doi.org/10.21298/IJTHR.2021.6.35.6.103]

-

Y. S. Yeo and S. H. Na, “Effect of characteristics of smartphone tourism information service on reliability of tourist information and destination selection attributes,” Journal of Information Technology and Applied Engineering, Vol. 9, No. 1, pp. 53-58, September 2019.

[https://doi.org/10.22733/JITAE.2019.09.01.007]

- Ai Hub [Internet]. Available: https://aihub.or.kr/

-

G. Amato, F. Carrara, F. Falchi, C. Gennaro, and L. Vadicamo, “Large-scale instance-level image retrieval,” Information Processing & Management, Vol. 57, No. 6, 102100, November 2020.

[https://doi.org/10.1016/j.ipm.2019.102100]

-

H. Noh, A. Araujo, J. Sim, T. Weyand, and B. Han, “Large-scale image retrieval with attentive deep local features,” in Proceedings of the IEEE International Conference on Computer Vision, pp. 3456-3465, April 2017.

[https://doi.org/10.48550/arXiv.1612.06321]

-

K. Simonyan and A. Zisserman, “Very deep convolutional networks for large-scale image recognition,” arXiv: 1409.1556, , September 2014.

[https://doi.org/10.48550/arXiv.1409.1556]

-

K. He, X. Zhang, S. Ren, and J. Sun, “Deep residual learning for image recognition,” in Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, pp. 770-778, December 2015.

[https://doi.org/10.48550/arXiv.1512.03385]

-

M. Tan and Q. Le, “Efficientnet: Rethinking model scaling for convolutional neural networks. In International conference on machine learning,” PMLR, pp. 6105-6114, May 2019.

[https://doi.org/10.48550/arXiv.1905.11946]

-

T. He, Z. Zhang, H. Zhang, Z. Zhang, J. Xie, and M. Li, “Bag of tricks for image classification with convolutional neural networks,” in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 558-567, December 2019.

[https://doi.org/10.48550/arXiv.1812.01187]

-

A. Buslaev, V. I. Iglovikov, E. Khvedchenya, A. Parinov, M. Druzhinin, and A. A. Kalinin, “Albumentations: Fast and flexible image augmentations,” Information, Vol. 11 No. 2, 125. February 2020.

[https://doi.org/10.3390/info11020125]

-

S. Yun, D. Han, S. J. Oh, S. Chun, J. Choe, and Y. Yoo, “Cutmix: Regularization strategy to train strong classifiers with localizable features,” in Proceedings of the IEEE/CVF International Conference on Computer Vision, pp. 6023-6032, August 2019.

[https://doi.org/10.48550/arXiv.1905.04899]

- New tourism resource information API of Visit Seoul [Internet]. Available: https://www.visitseoul.net/

저자소개

2017년~현 재 : 경상국립대학교 컴퓨터과학부 (학사)

※관심분야 : 인공지능(Artificial Intelligence), 텍스트 마이닝(Text Mining), 이미지 분류(Image Classification), 이상치 탐지(Anomaly Detection)

2020년~현 재 : 경상국립대학교 컴퓨터과학부 (학사)

※관심분야 : 인공지능(Artificial Intelligence), 텍스트 마이닝(Text Mining), 이미지 분류(Image Classification)

2010년: 광주과학기술원 (공학석사)

2017년: 광주과학기술원 (공학박사)

2018년~현 재: 경상국립대학교 컴퓨터과학부 부교수

※관심분야:컴퓨터 그래픽스(Computer Graphics), 인터랙티브 미디어(Interative Media), 증강현실(Augmented Reality), 인공지능(Artificial Intelligence)