촬영 각도에 따른 3D 모델 복원 품질 비교 연구 : 포토그래메트리를 중심으로

Copyright ⓒ 2023 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

높은 비용과 기술적 전입 장벽으로 인해 건축 또는 토목 분야에서 측량을 위해 한정적으로 사용되어온 이미지 분석 기반 3D 스캔 방식 포토그래메트리(Photogrammetry) 기술은 약 150년의 사진 만큼이나 오랜 역사를 가지고 있다. 긴 역사만큼 그래픽 프로세서와 카메라 또한 비약적인 성능 발전을 이루었는데, 포토그래메트리 기술은 이와 함께 건축, 토목뿐만이 아닌 다양한 분야에 활용되고 있고 실제로 다수의 포토그래메트리 기술 기반 3D 모델 복원 과정에 대한 연구가 진행되고 있다. 하지만 표준화되지 않은 촬영 프로세스로 인해 복원 물체의 구조적 결함이나 노이즈(Noise)의 발생과 같은 문제점이 수반된다. 본 연구에서는 첫째, 실측 자료(Ground Truth)로 쓰일 병마용(兵馬俑) 오브젝트를 모델링하고 3D 프린팅한다. 둘째, 최적의 촬영 방법을 도출하기 위해 세로축과 가로축, 총 두 축을 중심으로 회전하는 테이블 3D 스캐닝 시스템을 개발하고, 해당 시스템에서 스마트폰 카메라를 통해 다각도에서 대상 물체의 사진 데이터를 획득한다. 마지막으로는 획득한 데이터를 C2M(Cloud-to-Mesh Distances) 정량적 비교 알고리즘을 사용하여 품질과 유사도를 비교‧분석한다.

Abstract

3D scanning photogrammetry technology based on image analysis has a history as long as that of photography for about 150 years. Graphic processors and cameras have also achieved dramatic performance developments in the same way as the long history and progressing. However, non-standardized imaging processes are accompanied by problems such as structural defects in the reconstructed object and the generation of noise. In this research, first, we will model and 3D print the terracotta army object used in the actual measurement data (Ground Truth). Second, in order to derive the optimal shooting method, we developed a table 3D scanning system that rotates around a total of two axes, the vertical axis and the horizontal axis and Get photo data. Finally, the acquired data are compared and analyzed for quality and similarity using a C2M (Cloud-to-Mesh Distances) quantitative comparison algorithm.

Keywords:

Photogrammetry, 3D Reconstruction, 3D Scan, Computer Vision, Computer Graphics키워드:

포토그래메트리, 3차원 복원, 3차원 스캔, 컴퓨터비전, 컴퓨터그래픽스Ⅰ. 서 론

1-1 연구배경 및 목적

최근 현실 세계에 존재하는 사물, 시스템, 환경 등을 디지털 공간에 그대로 재현 또는 만들어보는 디지털 트윈 기술, 그리고 가상 세계 속의 기존 유형들이 융복합된 가상공간의 활용이 많아지고 있다. 이에 가상공간을 구성하는 3D 모델링 데이터들의 활용성이 높아지고 있으며, 이 모델링 데이터들을 실제 존재하는 물체처럼 현실적이고 정밀하게 구현하는 것에 대한 관심이 높아지고 있다. 대표적인 디지털 입체 모델 구현 방식은 작업자가 직접 그리는 방식, 3D 스캔 시스템을 이용한 포토그래메트리(Photogrammetry) 방식 등이 있다.[1]

포토그래메트리 방식은 주로 광범위한 지형의 모델링 과정에 한정하여 사용되었지만, 최근에는 사람이나 동물 모형과 같은 비교적 작은 사물의 모델링에도 많이 사용되고 있다.[2]적은 예산으로 카메라를 통해 사진 데이터를 취득하여 3D 데이터를 생성함으로써, 접근성이 좋고 고도의 정밀함을 요구하지 않는 다양한 분야에 두루 활용되고 있다. 포토그래메트리 기반 3D 모델 제작 방식은 대상물 주변의 다양한 각도에서 사진을 촬영하여 3차원 데이터를 생성하고, 생성된 3차원 데이터를 수집하여 3D 모델 데이터를 제작하는 것이다.[3] 전통적인 방식의 3D 모델링 프로세스를 통해 제작하는 과정보다 빠르고 신속하게 3D 모델 데이터의 제작이 가능하기 때문에 포토그래메트리 기술 기반의 3D 모델링 제작 방식은 다양한 영역으로 사용범위가 확대되고 있다.[4]

하지만, 비교적 작은 사물의 3차원 복원을 위한 근거리 포토그래메트리 방식을 위해 사용되는(非 미터법) 촬영 절차는 항공 카메라의 촬영 절차(미터법)만큼 표준화되어 있지 않다.[5] 즉 정확도, 촬영 장비의 효율성 및 가용성에 따라 촬영 방향 및 추가 매개변수의 추정과 관련된 문제를 해결하여 고품질 결과물을 얻기 위해 촬영 방법에 대한 정교하고 세분화된 정의가 필요한 상황이다.

1-2 연구 동향

포토그래메트리 기술은 사진으로부터 3차원 모델 데이터 생성을 위해 주로 포인트 클라우드를 이용한다. 포인트 클라우드 정보를 획득하기 위해선 촬영 방식이 중요한데, 해당 기술의 경우 상용 디지털 카메라를 이용하는 관계로 이미지 획득이 용이하다.[5] 또한 먼 거리에 있는 물체나 면적이 넓은 대상의 3차원 모델 데이터 생성이 가능한 장점이 있다. 최근 급격한 하드웨어 발전이 이루어지고 있는 드론과 같은 무인항공기를 활용하여 이미지를 획득한 후 포토그래메트리 기술을 적용시켜 물체의 3차원 모델 데이터를 얻는 방법도 사용되고 있다. 드론(DJI사 Phantom 4)을 활용한 연구[6]에서는 8m 높이의 석상을 촬영하여 이미지 126장을 획득한 후 이를 기반으로 3차원 모델 데이터를 생성하였다. 생성된 데이터는 Autodesk사 3DS MAX 소프트웨어를 이용하여 애니메이션 결과로 나타냈다. 해당 연구에서는 포토그래메트리 기반 3차원 모델 데이터 생성 방법뿐만 아니라 드론 비행 방법이나 촬영 방법, 드론과 사물의 거리 등 세부적인 내용을 서술하였고, 다양한 분야로의 활용 가능성도 제시하였다. 또한 포토그래메트리 기법을 통해 획득한 3차원 모델 데이터와 디스플레이스먼트 맵을 활용하여 일반적인 컴퓨터 그래픽이 제공하는 쉐이딩(Shading) 기술로 구현된 질감보다 사실적인 3차원 프린팅 결과물을 획득할 수 있는 연구도 진행되고 있다[7].

본 논문의 구성은 다음과 같다. 2장에서는 포토그래메트리 기술을 기반으로 한 테이블 3D 스캔 시스템의 세부 구성 요소를 소개하고, 3장에서는 해당 시스템을 이용한 사진 촬영 방법을 통해 촬영 각도 중심의 3D 모델 복원 품질 비교 실험 및 분석 방법을 제시한다. 4장에서는 원본 모델 데이터와 복원 데이터의 비교 분석 결과를 히트맵이나 히스토그램과 같은 시각화 자료를 기반으로 요인별 결과를 분석하여 검증하고, 마지막으로 5장에서는 결론 및 향후 연구 방향을 제시한다.

Ⅱ. 테이블 3D 스캐너 제작

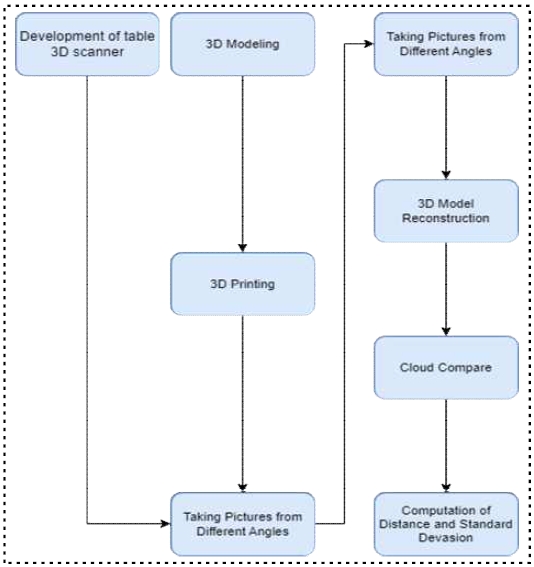

본 실험에서 사용한 촬영 시스템은 테이블 3D 스캐너에 거치된 스마트폰 카메라를 통해 다각도의 사진 데이터를 수집하고 정합하여 시각화하는 시스템이며 구조도는 아래 그림 과 같다.

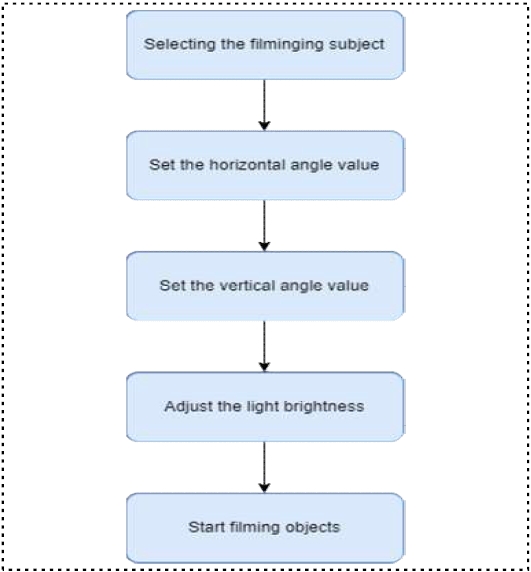

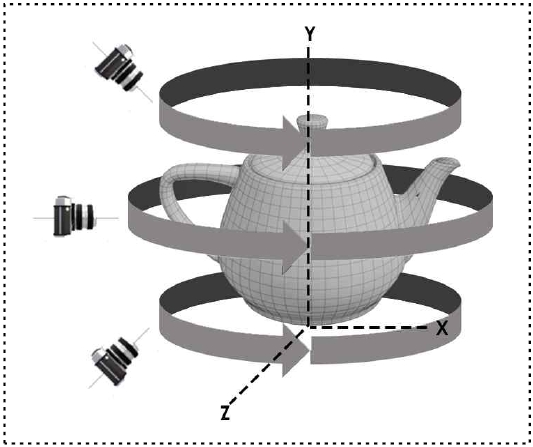

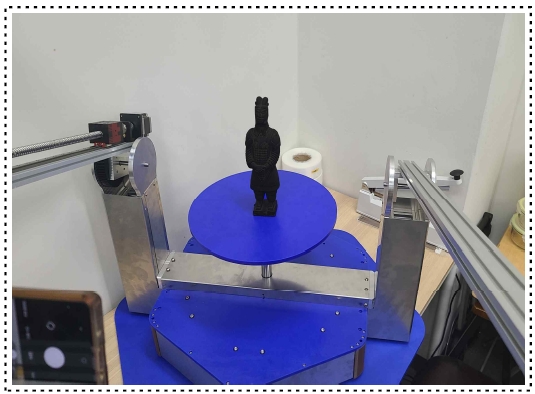

본 실험의 첫 번째 프로세스는 포토그래메트리 기술 기반의 3D 스캐너를 통해 일정한 규칙의 각도 변화 속에서 다수의 사진을 수집‧획득하는 것이다. 해당 내용을 기조로 삼아 제작한 테이블 3D 스캐너는 세로축과 가로축, 총 두 방향을 중심으로 회전하며 순차적으로 이미지 데이터를 획득한다. 예시 이미지는 그림 2와 같다.

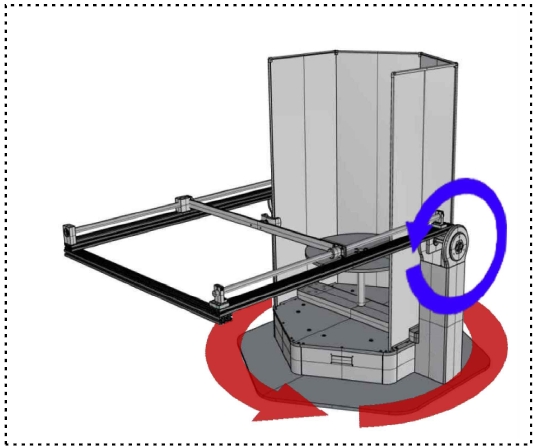

본 연구에서 제안하는 스캐너는 그림과 같이 촬영 대상의 y축을 중심으로 360° 회전하며 상부에서 하부로 높낮이에 따라 각도에 변화를 주어 촬영을 수행한다. 두 축으로 회전하기 위해 2개의 모터를 각 방향별로 개별 설치하여 독립적인 움직임이 가능케 하고, 모터가 해당 과정을 반복 수행함으로써 촬영 대상의 사진 데이터가 일정한 환경에서 수집되도록 구성한다.

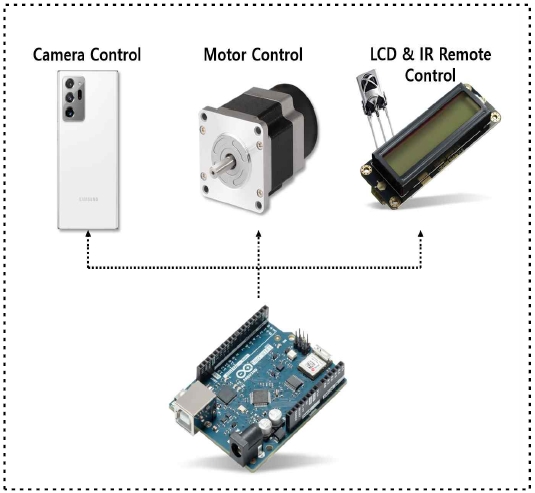

그림 3은 테이블 3D 스캐너 제작에 필요한 3가지 핵심 구성 요소이다. 아두이노(Arduino)를 통해 스마트폰과 모터 그리고 적외선 센서와 연결된 LCD(Liquid Crystal Display)를 사용자가 직접 제어할 수 있으며, 해당 과정에서 서버와 클라이언트 역할을 위해 Wi-Fi를 지원하는 아두이노 UNO WIFI Rev2를 사용하였다.

또한, 자동 사진 촬영을 위한 코드에는 1.8.13 버전의 ‘WiFiNINA’ 라이브러리와 5.13.5 버전 ‘ArduinoJson’ 라이브러리를 사용하여 대상 물체를 자동으로 촬영하도록 설계하였다. 카메라는 12MP, f/1.8, 26mm, 1/1.76", 1.8µm, 듀얼 픽셀 PDAF, OIS 사양의 삼성 갤럭시 노트 20의 표준 촬영모드를 사용하였고, 모터는 DM2282 대용량 2상 Stepper Motor Driver와 STP-86D3018 시나노겐시 Encoder Step Servo Motor 2상 6 Nm를 사용하여 충분한 회전력(Torque)을 확보하였다.

그림 4는 상기 내용을 바탕으로 만들어진 콘셉트 디자인의 렌더링 이미지와 각 축의 진행 방향을 설명하는 그림이다. 1번 축은 피사체의 y축을 중심으로 수평 각에 따라 360° 회전하는 축이며, 2번 축은 촬영 대상의 z축을 중심으로 수직 각에 따라 회전하는 축이다. 이때 허용 가능한 사물의 최대 크기는 300 mm × 300 mm × 300 mm(가로×세로×높이)이다. 위와 같은 구성을 통해 사용자는 일정한 규칙으로 촬영된 사진 데이터의 획득이 가능해진다.

표 1은 본 실험을 위해 제작한 테이블 3D 스캐너와 유사한 형태의 3D 스캐너들의 사양 비교표이다. 카메라가 회전하며 세밀한 촬영 각 조절이 가능한 포토그래메트리 방식의 테이블 스캐너는 피사체가 회전하며 스캐닝하는 제품에 비해 카메라 정렬 오류 발생 가능성이 낮으며, 사용법 또한 간편하다는 특징을 보인다.

Ⅲ. 실험 방법

본 실험에서는 촬영 방법에 따른 3D 모델 복원 품질의 비교와 분석을 위해 테이블 3D 스캐너를 제작하고 수직 각도와 수평 각도를 세부적으로 나누어 스마트폰 카메라를 통해 촬영이 가능한 환경을 구성하였다. 실험에 사용된 객체는 병마용(兵馬俑) 3D 모델링 데이터를 원본 실측자료(Ground Truth)로 사용했고, 각 촬영 방법별 결과물과 함께 오픈소스 소프트웨어인 클라우드컴페어(Cloudcompare)를 사용하여 품질 비교 분석을 진행하였다. 실험 절차 워크플로우는 아래 그림 5와 같다.

3-1 실측 자료

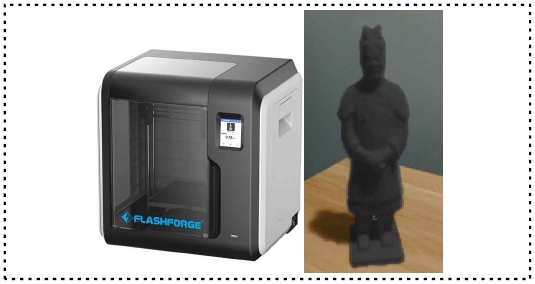

실측자료(Ground Truth)로 사용된 병마용은 오픈소스 3D 모델링 소프트웨어인 블렌더(Blender)를 활용하여 모델링 하였다. 3D 모델링 결과물은 그림 6과 같다.

블렌더로 제작된 병마용 3D 모델 데이터는 Flashforge사의 FFF((Fused Filament Fabrication) 방식 3D 프린터 Adventurer 3(150 mm (H) × 150 mm (W) × 150 mm (D)를 사용하여 출력했고, 결과물은 아래 그림 7과 같다.

3-2 촬영 방법

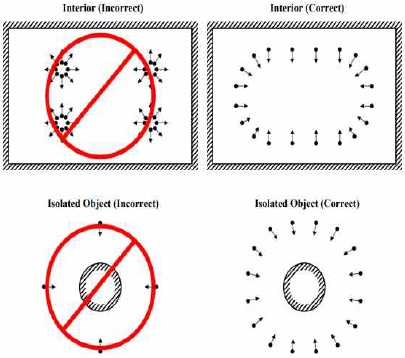

포토그래메트리를 활용한 3D 모델 복원 과정은 다양한 각도에서 촬영한 사진 데이터를 기반으로 3D 모델을 재구성한다. 이때 한 쌍의 사진 사이에 많은 겹침이 이루어져야 하며 필요 사진의 수는 표본의 복잡성과 결과물 해상도에 따라 다르지만 3차원 데카르트 좌표를 생성하려면 서로 다른 위치의 사진이 최소 2장 이상 존재해야 한다.[8]

표 2는 대표적인 포토그래메트리 기반 3D 모델 복원 소프트웨어인 Agisoft사에서 제공하는 3D 모델 촬영 가이드이다. 해당 내용을 살펴보면 촬영 방향, 해상도(Resolution), 이미지 형식(Format)은 구체적으로 제시되었으나 실질적인 촬영 방법에 대해선 명확하게 제시된 바가 없다. 이는 다각도의 사진을 통해 결과물을 도출하는 포토그래메트리 기술 특성에 기인한다.

본 연구에서는 촬영 대상을 중심으로 수평 각, 수직 각을 규칙적으로 세분화하여 촬영하고 복원하여 방향 알고리즘의 적절한 수렴을 보장하는 최적의 촬영 방법을 찾고자 한다. 카메라 위치에 의한 촬영 각도, 도출 이미지 수, 3차원 모델 복원 시간은 아래 표 3과 같다.

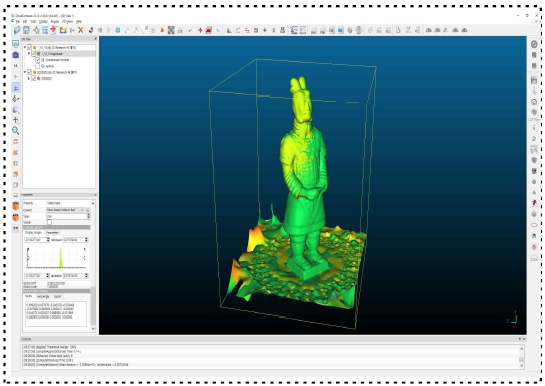

3D 모델링 데이터의 비교는 오픈소스 소프트웨어 클라우드컴페어를 활용한다. C2M(Cloud-to-Mesh Distances) 정량적 비교 알고리즘을 사용하여 데이터 품질을 비교하고, 각 실험을 통해 획득한 3D 모델링 데이터 메쉬의 정점에서 실측자료까지의 거리를 계산하여 유사도를 비교‧분석하여 평가한다.[10] 클라우드컴페어를 통한 메쉬 비교 분석 과정은 그림 8과 같다.

Ⅳ. 실험 결과

4-1 촬영 및 복원

본 실험에서 제작 한 테이블 3D 스캐너와 삼성 갤럭시노트 20을 활용하여 수직 각(0°~90°)과 수평 각(0°~350°) 별 24개의 이미지 세트(2,040장)를 도출하였다. 촬영 장면은 그림 9와 같다.

4-2 분석 결과

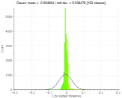

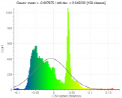

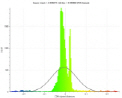

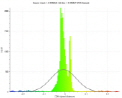

표 5는 C2M 정량적 비교 알고리즘을 사용하여 분석한 결과의 가우시안(Gaussian) 분포 히스토그램으로 해당 분포 매개변수를 계산하고 적합 분포에 해당하는 회색 곡선으로 스칼라 히스토그램을 표시한다. 평균 거리(Mean Distance)의 숫자는 적을수록 실측 자료의 접촉면과 가까워지며, 표준편차(Standard Deviation)의 숫자는 적을수록 실측 자료와 비교 대상 메쉬 데이터의 결과가 서로 근접한다는 의미를 가진다. 즉, 평균 거리의 값이 작을수록 비교 대상 메쉬의 정점이 실측 자료와의 거리 비교에서 더 가까이 있고, 표준편차가 작을수록 정점들이 더 균일하게 분포되어 있음을 나타낸다.

평균 거리의 값에 따라 각각의 결과물을 분석한 결과 수평 각 10°, 수직 각 30°의 환경에서 총 144회 사진 촬영을 진행하고 3차원 복원을 진행한 결과물이 실측 자료와의 거리 비교에서 평균값 0.000029로 가장 가까이 위치하였다. 두 번째로는 수평 각 30°, 수직 각 15°의 환경에서 총 84회, 세 번째로는 수평 각 30°, 수직 각 45°의 환경에서 총 36회 촬영을 통해 도출된 결과물이 실측 자료와 가까운 거리에 위치함을 알 수 있었다. 해당 실험의 분석 결과는 아래 표 6과 같다.

표준편차는 비교 대상 오브젝트의 정점이 균일하게 분포되어 있는지를 나타낸다. 표준편차에 따라 각각 분석한 결과 수평 각 10°, 수직 각 10° 환경에서 총 360회 사진 촬영을 진행하고 3차원 복원이 이루어진 결과물 오브젝트의 정점이 비교군 안에서 가장 균일하게 분포되어 있음을 알 수 있었다. 해당 실험의 분석 결과는 아래 표 7과 같다.

4-3 소결

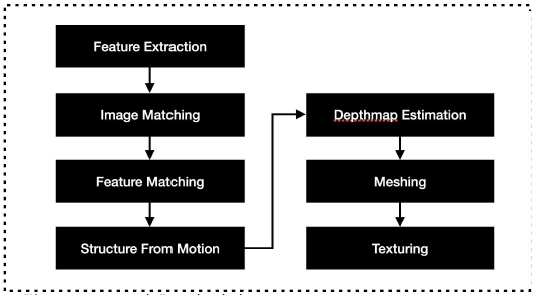

현재 일반적인 포토그래메트리 방식의 복원은 < Feature Extraction → Image Matcing → Feature Matching →Structure From Motion → Depthmap Estimation → Meshing → Texturing > 순으로 진행되며 해당 과정은 아래 그림 10과 같다.

해당 과정에서 3차원 정점을 검출하려면 첫째, 피사체의 겹침이 발생해야 한다. 그리고 겹침이 발생한 두 이미지 사이에서 같은 지점을 표현하는 Feature Matching 과정을 통해 속성의 동일성이 알고리즘으로 판단되어야 하며, 마지막으로 특징점이 이미지에 두 개 이상 각각 존재해야 삼각측량법 기반 Structure From Motion 과정에서 계산이 가능하다.

이러한 포토그래메트리 방식의 복원 원리를 바탕으로 살펴보면 촬영 각도가 커질수록, 두 이미지 또는 다수의 이미지 간 겹치는 부분이 감소하게 되며, 특징점 간의 겹침에 오차율 또한 높아진다. 그리고 매칭점이 발견되지 않을 시 복원이 불가하다는 것도 확인할 수 있다.

포토그래메트리 기술 특성상 입력 이미지 수가 증가할수록 최종 결과물을 얻기 위한 계산 시간 또한 증가한다는 특징이 있다. 평균 거리에 따른 분석 결과 가장 우수한 품질을 보인 수평 각 10°, 수직 각 30°에서 144회 촬영을 진행할 경우, 표준편차 기준 가장 우수한 품질을 보인 수평 각 10°, 수직 각 10°에서 360회 촬영을 진행한 결과물 대비 1/3 수준의 시간으로 동일한 품질의 결과물을 얻을 수 있다.

본 실험에서 사용한 촬영 대상 물체의 경우 일반적인 물체 표면의 복잡한 형상을 거의 포함하고 있다. 해당 물체보다 단순한 표면 구조를 가진 물체의 경우 상기 결과와 다르게 적은 입력 이미지로 높은 품질의 결과물을 얻을 수 있다.

Ⅴ. 결론 및 제언

본 실험은 다중 이미지 기반 비접촉 3D 스캔 방식인 포토그래메트리를 활용한 3D 복원 과정의 핵심 요소이지만 현재 표준화 되어 있지 않은 촬영 방법, 그중 촬영 각도에 따른 3D 모델 복원 결과물의 품질을 비교‧분석하는데 의의가 있다.

실험 결과, 평균 거리와 표준편차 모두 촬영 횟수가 상대적으로 많은 조건에서 대부분 실측 자료와의 거리가 가까웠고 정점 또한 균일하게 분포되어 있음을 확인했다. 하지만 집단별 상위 품질의 결과물을 비교해봤을 때 일정 수량 이상의 입력 이미지 수는 계산 시간을 증가시키고 불필요한 연산을 통해 품질을 감소시키는 결과가 도출되었다. 이를 통해 결과물의 정확도와 촬영 방법의 효율성을 제고하여 고품질 결과물을 얻기 위한 세분화된 촬영 방법을 찾을 수 있었다.

하지만 본 실험에서는 포토그래메트리 기술 기반 3D 복원 과정에 큰 영향을 미치는 광량, 광질 등 빛에 대한 통제가 부족했고, 적층 방식인 FFF 방식 3D 프린터를 사용하여 실측 자료 표면이 다소 매끄럽지 못한 경향이 있었다. 추후 연구에서는 빛에 대한 다양한 변수 설정과 3D 프린팅 방식의 변경 등 본 실험에서 부족했던 부분의 보완이 이루어진다면 본 실험 대비 진일보한 촬영 방법을 도출할 수 있을 것으로 기대한다.

References

- J.S Lee, “3D Modeling Product Design Process Based on Photo Scanning Technology“ Journal of the Korea Institute of Information and Communication Engineering v.22 no.11, pp. 1505–1510, November 2018, 10.6109/jkiice.2018.22.11.1505

-

Ana Bucchi, “Recommendations for Improving Photo Quality in Close Range Photogrammetry, Exemplified in Hand Bones of Chimpanzees and Gorillas” International Journal of Morphology 38(2):348-355, April 2020, 10.4067/S0717-95022020000200348

[https://doi.org/10.4067/S0717-95022020000200348]

- H.J. Kim, “Trends in High-Resolution 3D Data Generation Technologies”, ETRI(Electronics and Telecommunications Research Institute), Yuseong: Daejeon, 10.22648/ETRI.2022.J.370307, 64-73, June 2022,

- S.H. Park, “A Study on the Use of 3D SCAN Technics in Architectural Survey of Stone Heritage” Proceeding of Annual Conference of the Regional Association of Architectural Institute of Korea, pp.265-268, December 2013

- Marek Fraštia, “Possibilities of using inexpensive digital cameras in applications of close-range photogrammetry”, Slovak Journal of Civil Engineering, pp. 20-28, October 2005

-

Lee, J., & Lee, I. . “The 3D Modeling Data Production Method Using Drones Photographic Scanning Technology,” Journal of the Korea Institute of Information and Communication Engineering, vol. 22, no. 6, pp. 874–880, Jun. 2018,

[https://doi.org/10.6109/JKIICE.2018.22.6.874]

-

J.K. Kim, "A Study on the Application of Displacement Map in 3D Printing Using Photogrammetry", Journal of Communication Design v. 75, pp. 85-96. 2021

[https://doi.org/10.25111/jcd.2021.75.06]

- D. HodgettsP. L. Manning, “Application of high-resolution laser scanning and photogrammetric techniques to data acquisition, analysis and interpretation in palaeontology”, International Archives of the Photogrammetry, Remote Sensing, and Spatial Information Sciences, XXXVIII, Part 5:68-73, 2010

-

Allowen Evin, Thibaud Souter, Ardern Hulme-Beaman, Carly Ameen, Richard Allen, Pietro Viacava, Greger Larson, Thomas Cucchi, Keith Dobney, “The use of close-range photogrammetry in zooarchaeology: Creating accurate 3D models of wolf crania to study dog domestication”, Journal of Archaeological Science: Reports, Volume 9, Pages 87-93, 2016, 10.1016/j.jasrep.2016.06.028

[https://doi.org/10.1016/j.jasrep.2016.06.028]

-

Verónica Díez Díaz, “Comparing surface digitization techniques in palaeontology using visual perceptual metrics and distance computations between 3D meshes”, Palaeontology, Vol. 64, Part 2, pp. 179–202, January 2021, 10.1111/pala.12518

[https://doi.org/10.1111/pala.12518]

저자소개

2012년 : 한남대학교 멀티미디어 (학사)

2014년 : 한남대학교 멀티미디어 (석사)

2016년 : 한남대학교 멀티미디어 (박사 수료)

2017년~2019년: 씨큐엠 대표

2019년~2022년: 한남대학교 디자인팩토리 연구원

2022년~현 재: 주식회사 메타뱅크 연구원

※관심분야 : 영상처리, 확장현실, 게임, 컴퓨터그래픽스

2000년 : 한남대학교 멀티미디어 (학사)

2022년 : 한남대학교 멀티미디어 (석사)

2022년~현 재: 주식회사 메타뱅크 연구원

※관심분야 : 컴퓨터비전, IOT, 이미지 프로세싱

1992년 : 홍익대학교 회화과 (학사)

1995년 : 홍익대학교 대학원 서양화과 (석사)

1998년 : 뉴욕공과대학교 커뮤니케이션학 (석사)

2003년~현 재: 한남대학교 미디어영상전공 교수

※관심분야 : 확장현실, 게임