CNN 기반 사과의 품질 등급 분류를 위한 영향력 있는 색상 채널 탐색

Copyright ⓒ 2022 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

농산물을 판매하기까지의 유통 과정 중 농산물의 외관 품질 판별 과정은 주로 육안으로 진행되고 있어 불균일한 품질 문제가 발생한다. 품질 문제로 인한 상품성 하락 및 경제적 손실 등의 감소를 위해 품질 판별 과정 중에서도 등급 분류 과정의 오류를 줄이고자 하였다. 이를 위해 CNN 기반의 품질 등급 분류 연구를 후지 사과를 대상으로 진행하였으며, 3개의 채널(Red, Green, Blue)로 이루어져 있는 컬러 이미지 중 품질 등급의 분류를 결정짓는 단일색상을 찾고자 하였다. 색상별 영향력 확인을 위해 층과 합성곱층의 필터의 수를 다르게 설정한 8가지 모델 구조를 통하여 5가지 채널(RGB, Red, Green, Blue, gray)에 대한 실험을 진행하였고, 본 연구를 통해 Blue채널이 사과의 품질 등급 분류에 있어 가장 안정적인 색상이자 영향력 있는 색상 채널임을 확인하였다.

Abstract

During the distribution process until the sale of agricultural products, the process of determining the appearance quality of agricultural products is mainly conducted with the naked eye, resulting in uneven quality problems. In order to reduce the decline in merchantability and economic loss due to quality problems, it was intended to reduce errors in the classification process among the quality discrimination processes. To this end, a CNN-based quality grade classification study was conducted on Fuji apples, and a single color that determines the classification of quality grades among color images consisting of three channels (Red, Green, and Blue) was sought. In order to check the influence of each color, eight model structures with different numbers of layers and convolution filters were set, and experiments were conducted on five channels (RGB, Red, Green, Blue and Gray). Through this study, it was confirmed that the Blue channel is the most stable color and influential color channel in the classification of apple quality grades.

Keywords:

Deep Learning, Convolution Neural Network, Apple, Quality Grade, Classification키워드:

딥러닝, 사과, 품질 등급, 분류Ⅰ. 서 론

농산물의 선별과정 중 농산물의 외관 품질 판별 과정은 육안 검수 과정을 거치기에 많은 노동력이 투입되는 과정이다. 육안 검수로 인해 발생하는 사람의 주관적 기준 개입은 균일하지 못한 상품의 품질 문제로 이어지며, 이는 상품성 및 신뢰성 하락 등 농가의 경제적 손실로 이어진다. 농산물의 선별 및 등급 판정 과정은 가격을 결정짓는 주요요소이다. 농가의 소득증대를 위해서는 생산과정에서의 생산비 절감을 위한 노력도 중요하지만 수확 후의 선별 및 품질 판정 과정에서 개체를 균일하게 분류하여 규격 출하함으로써 소비자의 만족도와 상품의 부가가치를 높일 필요가 있다[1].

통계청 자료에 따르면 농가의 고령 인구 비율은 1970년 4.9%에서 2019년 46.6%로 41.7% 증가하였으며, 농가 인구가 차지하는 비중은 전체인구 기준 1970년 45.9%에서 2019년 4.3%로 41.6% 감소하였다[2]. 증가하는 농가의 고령인구에 비해 농가 수는 계속 감소하고 있어 농촌은 보유 인력 부족으로 인한 노동력 문제를 겪고 있으며 이러한 문제는 인건비 상승으로도 이어진다. 농가의 노동력 문제 해결을 위한 다양한 선별기가 존재하지만, 고비용 투자 부담으로 인해 대부분의 농가들은 크기나 무게를 선별하는 중량선별기 혹은 형상선별기 정도만을 사용중에 있다.

이와 같은 농촌의 문제를 해결하기 위해 육안 검수 과정이 이루어지는 외관 품질 판별 과정 중에서도 품질의 등급을 분류하는 과정에서 발생하는 주관성을 줄이고자 하였다. 농가의 노동력 문제 해결함과 동시에 상품의 품질 판정 오류를 줄임으로써 안정적인 분류를 통해 상품의 가치를 향상시키고자 한다. 한국농촌경제연구원의 ‘2020 식품소비행태조사 보고서’에 따르면 한국인이 좋아하는 과일 1순위는 사과(22.5%)이며, 2순위는 수박(19.1%), 3순위는 귤(10.4%)로 나타났다[3]. 사과는 암과 심장병 예방, 체중 및 콜레스테롤 감소, 신경 및 뇌세포 보호 등과 같은 기능성을 가지고 있으며, 당, 식이섬유, 비타민 C, 미네랄, 페놀성 물질 등이 풍부한 영양학적 가치 또한 풍부한 과실이다[4]. 또한 사과는 다양한 품종이 존재하며 품종마다 등급규격으로 정해진 착색 비율이 다르다. 착색 면적에 대한 비율을 육안으로 구분하는 과정에서 균일하지 못한 품질 문제가 발생하기 쉽다. 따라서 본 연구에서는 딥러닝을 활용하여 사과의 품질 등급 분류 관련 연구를 진행하고자 한다. 딥러닝 중에서도 CNN은 이미지 인식 분야에서 뛰어난 성능을 보여주는 딥러닝 기법 중 하나이다. CNN 구조를 기반으로 학습을 진행하며, 사과의 등급을 판별하는 데에 결정적인 역할을 하는 단일 색상을 찾고자 한다.

본 논문의 구성은 다음과 같다. 2장에서는 이론적 배경 및 관련 연구에 대해 소개하며, 3장에서는 품질 분류를 위한 모델 설계와 관련하여 설명하고, 4장에서는 실험 및 결과에 대해 서술하며, 마지막으로 5장에서 결론을 맺는다.

Ⅱ. 이론적 배경 및 관련 연구

2-1 CNN

CNN(Convolutional Neural Network)은 딥러닝 기반의 신경망 중 하나이다. 이미지 및 음성 인식 등의 다양한 영상처리 분야에서 많이 사용되고 있다[5]. CNN은 크게 합성곱층(Convolution Layer)과 풀링층(Pooling Layer)으로 구성되어있다. 합성곱층에서는 필터(Filter 또는 Kernel)를 통해 특징을 추출하여 특징맵(Feature map)을 만들어 낸다. 필터는 입력데이터의 첫 부분부터 차례대로 이동하며 적용 후 이를 통해 특징을 추출한다. 합성곱에 의해 다음 층으로 넘어가면 이전 층보다 더 큰 공간 영역을 반영하게 되고 뒤쪽 층들은 앞쪽 층들에서 검출된 좀 더 단순한 도형들의 조합으로 이루어진 좀 더 복잡한 패턴을 검출한다[6]. 일반적으로 합성곱 과정에서 나오게 되는 특징맵의 크기는 이전보다 작아지게 되는데, 이때 입력데이터의 크기 축소를 피하고 경계면의 정보 손실을 방지하기 위해서 입력데이터의 테두리에 특정한 값을 지정하여 넣는 패딩(Padding)기법을 사용한다. 패딩기법 중 주로 0값을 사용하여 넣는 제로패딩(Zero Padding)을 많이 사용한다. 필터의 크기를 정할 수 있듯 필터의 이동 간격 또한 정할 수 있는데, 이를 스트라이드(Stride)라고 한다. 풀링층은 합성곱층에서 만들어진 특징맵에서 대표값을 새롭게 추출하여 축소하는 과정으로, 최대 풀링(Max Pooling)과 평균 풀링(Average Pooling) 등이 있다.

최초의 CNN은 1998년에 나온 얀 르쿤(Yann LeCun)의 LeNet[7]이며, 이후 등장한 CNN 아키텍처로 AlexNet[8], GoogleNet[9], VGGNet[10], ResNet[11] 등이 있다.

CNN은 다양한 분야에 활용되어 연구가 이루어지고 있으며, 농업 분야에서도 농산물의 질병 감지 및 분류 등을 위해 사용되고 있다. [12]는 CNN을 통해 네 가지 종류의 과일을 3가지 단계(Raw, Ripe, Over ripe)로 분류하여 과일의 식용 여부를 알기 위한 연구를 하였으며, [13]은 포도의 숙성도를 인식하여 익은 과일과 덜 익은 과일로 분류하기 위해 CNN과 SVM를 사용하여 비교하였고, CNN이 포도의 숙성 단계 분류에 더 높은 분류 결과를 보여줌을 확인하였다. 또한, [14]는 농산물의 결함을 검출하여 노동시간을 단축시켜 노동력을 감소시키고 생산원가를 낮추고자 CNN을 활용하여 세 가지 종류의 과일을 대상으로 신선한 과일과 썩은 과일을 구별하는 연구를 진행하였다.

2-2 선별

선별 작업은 원예 산물의 상품 가치로 이어지는 품질을 향상시키는 중요한 작업이며, 그중 과일의 등급 선별은 대상물의 특성에 따라서 크기, 무게, 형상, 색깔, 당도, 향기, 맛, 그리고 상처의 유무 등 과일의 품질을 결정지을 수 있는 요인이 다양하여 각종 선별 인자가 복합적으로 관련되어 선별이 이루어진다. 지금까지는 등급과 규격이 주로 인력에 의해 선별이 이루어져 왔다. 하지만 최근 산업 기술의 급속한 발전과 함께 새로운 선별 방법 및 기술이 개발기기의 원리 및 방법에 의해 분류되고 있다. 이러한 선별기는 선별 능력, 선별 정도, 선별 균일도, 가격 등이 각각 다르며 기종에 따라 선별 대상물도 다르다[15].

선별의 기계화는 구형 과실을 대상으로 기계적인 체를 사용하여 과실의 크기에 따라 선별하는 형상선별기에서부터 시작되었고, 과실의 중량을 기계적인 저울에서 계량 선별하는 중량선별기가 개발되었다. 이 단계에서의 선별포장시설은 이러한 계급선별기를 사용하여 계급선별하였으며, 아울러 등급 선별은 사람의 주관적 판단에 의존하는 작업으로 계급선별공정의 전후에 많은 노동력이 소비되어왔다[16]. 농가나 선과장 등 현장에서는 상대적으로 측정하기 쉬운 중량, 크기, 길이 등의 크기선별이 주로 이루어지고 있으며 영상처리선별기, 비파괴선별기, 숙도선별기는 가격이 고가이기에 규모가 큰 산지처리센터(APC)에서 활용되고 있다[17]. 선별시스템은 과수 농가의 가격 경쟁력을 높이기 위한 필수 사항이지만 고비용 설비로 설치가 쉽지 않아 선별시스템의 비용절감을 위한 디지털 영상을 이용한 과일의 특징 추출 알고리즘 개발[18] 및 인공지능을 활용한 저가 카메라 기반의 과일 선별기 구축 연구[19] 등의 영세 과수 농가의 활성화를 위한 농산물의 선별 관련 다양한 연구가 진행되고 있다.

Ⅲ. 품질 분류를 위한 모델 설계

3-1 이미지 데이터 수집

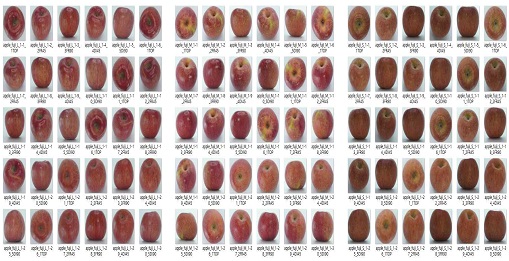

본 연구에서는 사과의 품질 등급 분류를 위해 AI Hub의 공개데이터인 농산물 품질(QC) 이미지 데이터를 통해 사과의 등급별 이미지를 수집하였다[20]. 사과의 이미지는 후지(부사)로 불리는 품종의 이미지이다. 등급별로 특, 상, 보통으로 나뉘며 각 2,380장, 총 7,140장으로 이루어져 있다. 그림 1을 통해 사과의 등급별 이미지를 확인할 수 있다.

AI Hub의 공개데이터는 수집, 정제, 가공, 검수 과정을 걸쳐 최종적으로 구축되었다. 농산물 표준규격에 명시된 사과의 등급규격을 참고하여 구축하였고, 사과의 등급규격은 ①낱개의 고르기, ②색택, ③신선도, ④중결점과, ⑤경결점과 총 5가지 항목을 기준으로 이루어져 있다.

데이터 수집을 위한 촬영은 수직과 수평을 고려하였으며, 수직으로는 5대의 카메라를 통해 Top, FR45°, FR90°, DI45°, DI90°의 위치에서 수평으로는 0, 90, 180, 270 각도로 앞 20장, 뒤 20장 총 40장씩 촬영되었다. 촬영된 이미지는 1000×1000 크기의 PNG 파일 형식이다.

3-2 전처리

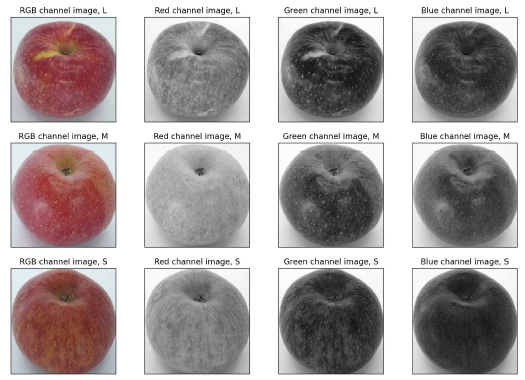

학습에 사용할 수집된 사과 이미지는 RGB 컬러 이미지이며, 3개의 채널로 이루어진 다채널(multi channel) 이미지이다. 이러한 다채널 이미지인 RGB를 Red, Green, Blue로 각각 분리하여 1개의 채널을 가진 단일채널(single channel) 이미지로 변환하였다. 비교를 위해 다채널인 RGB와 함께, RGB를 단일채널로 변환하기 위해 RGB에 포함되는 세 가지 색상을 조합하여 만들어지는 회색조(grayscale) 이미지인 gray를 추가하여 총 5가지 채널(RGB, Red, Green, Blue, gray)에 대한 학습을 진행하였다. 또한 1000×1000 크기의 사과 이미지를 64×64 크기로 resize하였으며, 입력 이미지의 픽셀값을 255로 나누어 0과 1 사이의 값을 가지도록 조정하였다.

3-3 모델 구성

품질 등급 분류에 있어 색상별 영향력 확인을 위해 층의 수와 합성곱층에서의 사용되는 필터 수를 다르게 설정한 8가지 모델 구조를 통해 실험을 진행하였다. 모델은 층이 증가함에 따라 합성곱층과 풀링층이 반복되는 구조이다.

층의 수와 합성곱층의 필터 수를 제외한 모든 실험조건은 동일하게 설정하여 진행하였다. 클래스는 사과의 등급인 특, 상, 보통으로 나누었다. 훈련 데이터셋(training dataset)과 시험 데이터셋(test dataset)의 비율은 7:3이며, 이미지의 입력 사이즈는 64×64, 필터 크기는 3×3, 풀링 크기는 2×2이다. 드롭아웃(Drop out)은 사용하지 않았다. 활성화 함수(activation function)는 ReLU를 사용하였고, 손실 함수(loss function)는 categorical crossentropy, 최적화(optimizer)를 위해 Adam을 사용하였다. 에포크(epoch) 수는 30으로 설정하여 진행하였으며, 마지막으로 flatten 후 분류를 위한 함수로 Softmax를 사용하였다. 표기하지 않은 실험조건은 모두 tf.keras의 default 값을 사용하였다. 층의 수와 그에 따른 합성곱층에서의 필터 수를 다르게 설정한 8가지 모델 구조는 표 1을 통해 확인할 수 있다

Ⅳ. 실험 및 결과

4-1 실험 결과

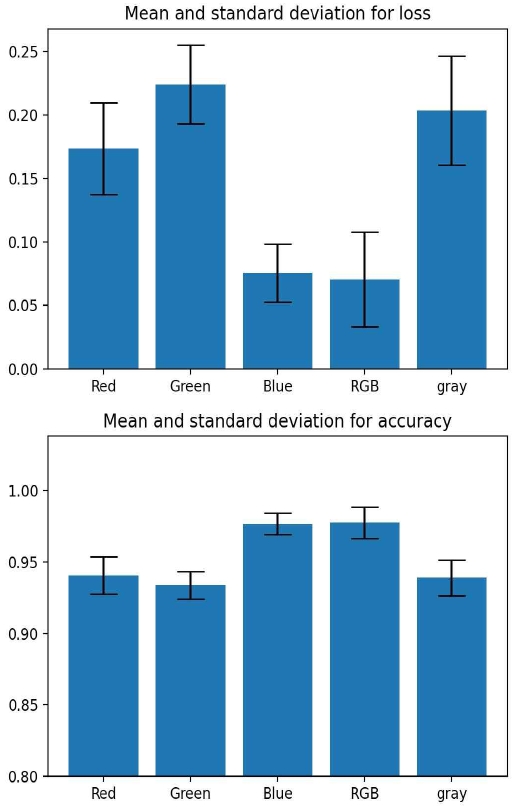

표 1의 구조에 대한 시험 데이터셋의 채널별 학습 결과를 표 2를 통해 볼 수 있다. 표 2의 결과는 seed를 고정하지 않고, 총 5회 학습을 진행한 결과를 토대로 평균과 표준편차를 구하여 값을 표기하였으며, 실험 결과를 통해 평균적으로 RGB, Blue, Red, gray, Green 순으로 좋은 성능을 보여줌을 알 수 있다. 이 중 s8의 RGB채널이 loss 0.0232, accuracy 0.9931으로 가장 좋은 성능을 보여주었다.

본 연구에서 진행한 실험을 통해 단일채널 중 Blue채널이 사과의 품질 등급 분류에 가장 좋은 성능을 보여줌을 알 수 있으며, 다채널인 RGB채널과 비교하여 보았을 때 단일채널인 Blue채널이 이와 비슷한 성능을 보여주는 것을 확인할 수 있다. 또한 일부 구조(s2, s3, s5)에 있어서는 Blue채널이 RGB채널보다 좋은 성능을 보여주었으며, 이를 통해 영향력 있는 단일채널을 사용한 학습이 다채널보다 적은 파라미터 수를 사용하여 비슷한 성능을 낼 수 있음을 확인하였다. 추가적으로, gray채널과 Blue채널의 비교에서도 Blue채널이 gray채널보다 좋은 성능을 보여주는 것을 알 수 있다.

표 3은 8가지 모델 구조에 대한 학습 결과를 색상 채널을 기준으로 평균과 표준편차를 구하여 표기한 값이며, 그림 2를 통해 이를 시각화한 그래프를 확인할 수 있다. 표 3과 그림 2를 통해 Blue채널의 loss와 accuracy의 표준편차가 색상 채널 중 가장 적은 것을 알 수 있다. 따라서 Blue채널이 다른 색상 채널보다 안정적인 결과를 나타내는 색상 채널임을 확인하였다.

4-2 결과 분석

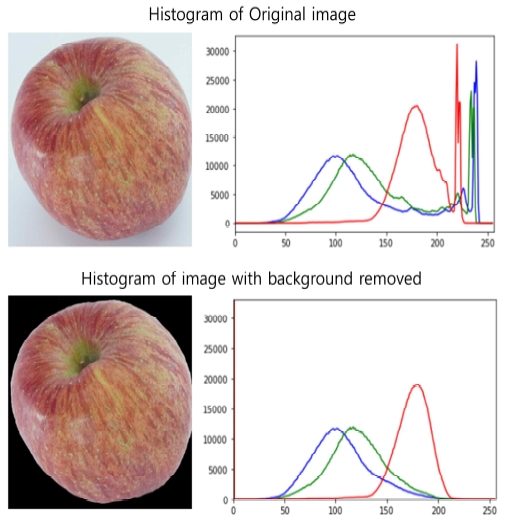

실험을 통해 학습의 loss 및 accuracy의 결과를 확인함으로써 단일채널 중 Blue채널이 가장 좋은 성능을 보여주는 것을 확인하였으며, 사과의 품질 등급을 분류함에 있어서 Blue채널이 학습에 가장 큰 기여를 하고 있음을 알 수 있다. 이러한 실험 결과를 이해하기 위해, 사과의 품질 등급 분류 학습에 있어서 사과의 착색 정도가 중요하다고 생각되어 데이터셋에 대한 픽셀 분포도를 확인해보고자 이미지를 학습에 사용되는 크기인 64×64로 변경하여 히스토그램을 확인해보았다.

히스토그램의 가로축은 픽셀의 값을 의미하고, 세로축은 픽셀의 빈도를 의미한다. 픽셀값이 0에 가까워질수록 어두운 픽셀을 의미하며, 255에 가까워질수록 밝은 픽셀임을 의미한다. 해당 데이터셋의 배경 이미지는 흰색에 가까운 회색 색으로 이루어져있기에 200이상의 픽셀값은 배경이미지로 보았다. 이는 원본이미지에 대한 히스토그램과 배경을 검정색으로 제거한 이미지의 히스토그램을 비교한 그림 3을 통해 확인할 수 있다.

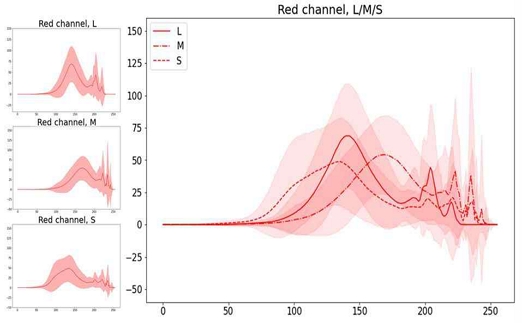

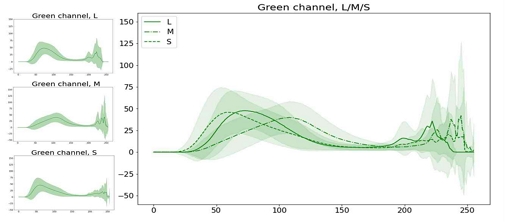

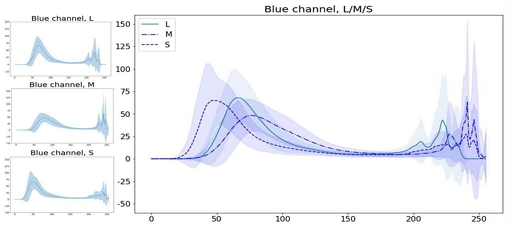

표시의 편의를 위해 사과의 등급인 특, 상, 보통을 L, M, S로 표기하였다. 그림 4, 그림 5, 그림 6은 등급별로 2,380장으로 이루어진 총 7,140장에 대한 히스토그램이다. 사과의 이미지에 포함된 픽셀을 색상별, 등급별로 구분하여 평균과 표준편차를 나타내었다.

그림 4는 Red채널에 대한 히스토그램이다. 사과의 색상은 대부분 빨간색으로 이루어져 있기에 사과 이미지에는 다양한 값의 Red색상 픽셀이 포함되어있게 된다. 때문에 Red채널의 등급별 그래프가 다른 색상 채널의 그래프보다 분포가 넓고, 표준편차가 큰 것을 알 수 있다. 등급이 낮아질수록 픽셀의 분포가 더욱 넓어지는 것은 등급이 낮아질수록 표준규격으로 정해진 착색 비율의 퍼센트(%)가 낮아지기 때문에 더욱 이러한 그래프가 나타난다고 볼 수 있다.

그림 5은 Green채널에 대한 히스토그램이다. Green채널은 Red채널과 Blue채널에 비해 픽셀의 빈도가 낮고 넓게 분포되어 있다. 등급끼리의 구별이 명확히 이루어지지 않으며 중첩되는 구간이 보이는 것을 통해 사과의 이미지에 포함되어있는 Green색상의 픽셀들이 등급마다 비슷한 범위의 값들로 이루어져 있음을 알 수 있다.

마지막으로 그림 6은 Blue채널에 대한 히스토그램이다. Blue채널의 그래프는 다른 채널들에 비해 표준편차가 적고, 픽셀이 특정 구간에 집중되어있음을 보인다. 이러한 점을 통해 Blue채널이 다른 색상 채널들보다 등급별 그래프의 구분이 더욱 뚜렷한 점을 볼 수 있다.

Red, Green, Blue채널에 대한 히스토그램을 통해 이미지 데이터셋에 포함된 픽셀의 분포도를 확인해보았다. Red색상이 사과를 표현함에 있어 지배적인 색상이기에 큰 분포를 가지고 있으며, blue색상은 비교적 덜 우세한 색상임을 알 수 있다. 그림 3을 통해 데이터셋에 포함된 등급별 사과의 이미지를 색상별로 분리하여 회색조 이미지로 출력해봄으로써 Blue채널이 다른 채널에 비해 사과 표면의 특징을 대비시켜 표현하기보다는 완화시켜 전체적인 색상 자체를 강조시키는 효과를 내는 것을 확인할 수 있다. 이는 사과에 Blue색상이 많이 포함되지 않기 때문이며, 따라서 Blue채널의 등급별 그래프에 표시되는 픽셀이 대부분 낮고 적은 표준편차를 가지게 되는 것을 알 수 있다. 이러한 사과의 색상 특성으로 인해 Blue채널은 픽셀의 빈도수가 특정 구간에 집중되며, 등급별 착색 정도를 구분하기에 적합하여 단일색상 중 품질 등급 분류 학습의 성능에 가장 영향력이 있는 것으로 보인다.

Ⅴ. 결 론

본 연구는 품질 등급 분류 과정에서 발생하는 주관성을 줄여 불균일한 품질 문제를 해결하고자 사과를 대상으로 실험을 진행하였다. 컬러 이미지는 3개의 채널로 이루어져 있다. 컬러 이미지에 포함된 Red, Green, Blue 색상 중 영향력 있는 단일색상 채널을 찾고자 하였다. 이 과정에서 학습에 영향력이 적은 색상 정보를 제거하여 입력데이터의 불필요한 파라미터를 줄임으로써 단일색상만을 사용한 학습으로 연산량을 감소시킬 수 있다.

실험을 위해 층의 수와 합성곱층의 필터 수를 다르게 설정한 CNN 기반의 모델 구조 8개를 구성하였다. 모델의 층은 합성곱층과 풀링층이 반복되는 구조로 이루어져 있다. Red, Green, Blue 외에 비교를 위해 RGB와 gray를 추가하여 총 5가지 색상에 대한 학습을 진행하였다. gray채널은 다채널을 단일채널로 변환하기 위해 RGB의 세 가지 색상을 조합하여 만들어 사용하는 회색조 이미지이다.

학습은 총 5회 진행한 결과를 토대로 평균과 표준편차를 구하여 통계를 내었다. 이를 통해 실험을 진행한 모델 구조에 대해서 RGB, Blue, Red, gray, Green 순으로 좋은 결과를 내는 것을 알 수 있었다. 단일채널 중에서는 Blue가 가장 좋은 성능을 보여주었으며, 일부 구조에서는 다채널인 RGB보다 좋은 성능을 낼 수 있음을 확인하였다. 또한 8가지 모델 구조에 대한 학습 결과를 색상 채널을 기준으로 평균과 표준편차를 구하여 표시한 그래프를 통해 표준편차가 가장 적었던 색상 채널이 Blue채널이었음을 확인함으로써 가장 안정적인 학습 결과를 내는 색상임을 알 수 있었다.

이러한 실험 결과를 이해하기 위해 사과의 품질 등급에 따른 채널별 이미지를 출력해봄과 동시에 데이터셋에 대한 픽셀 분포도를 확인해보았고, Blue채널이 사과의 등급별 색상 특성을 구분하여 품질 등급을 분류하기에 적합한 색상임을 확인하였다. 향후 연구를 통해 농산물의 품목 및 품종을 확장하여, 추가되는 농산물의 분류에 있어서 영향력 있는 단일색상을 찾고자 하며, 해당 단일색상을 사용한 다품종 품질 분류에 관한 연구를 진행하고자 한다.

References

- Kim, J. H., (2011), Agricultural products sorting facility, The Magazine of the Society of Air-Conditioning and Refrigerating Engineers of Korea, 40(7), 20-29.

- Statistics Korea. Changes in the structure of agriculture through statistics [Internet]. Available: https://kostat.go.kr/portal/korea/kor_nw/1/1/index.board?bmode=read&aSeq=386238

- Kim, Hongsang, The Consumer Behavior Survey for Food 2020, KOREA RURAL ECONOMIC INSTITUTE(KREI), vol.6, no.7, pp.602, 2020.

- National Institute of Agricultural Sciences(NAAS), Research of internal and external defect discrimination technology of apple using whole surface scan and image analysis, Rural Development Administration(RDA), Korea, PJ01008, pp.1, February 2014.

- James Loy, “Neural Network Projects with Python”, gilbut, pp.136-137, 2020.

-

Charu C. Aggarwal, “Neural Networks and Deep Learning“, jpub, pp.468-472, 2019.

[https://doi.org/10.1007/978-3-319-94463-0]

-

Y. Lecun, L. Bottou, Y. Bengio and P. Haffner, “Gradient-based learning applied to document recognition.” In Proceedings of the IEEE, Vol. 86, No. 11, pp. 2278-2324, Nov 1998.

[https://doi.org/10.1109/5.726791]

- A. Krizhevsky, I. Sutckever, G. E. Hinton, “ImageNet Classification with Deep Convolutional Neural Networks”, Advances in Neural Information Processing Systems 25(NIPS), 2012

-

C. Szegedy et al., “Going deeper with convolutions”, 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp. 1-9. June 2015.

[https://doi.org/10.1109/CVPR.2015.7298594]

- K. Simonyan and A. Zisserman, “Very deep convolutional networks for large-scale image recognition,” arXiv preprint arXiv:1409.1556, , 2014.

-

K. He, X. Zhang, S. Ren and J. Sun, (2016). “Deep residual learning for image recognition”, In Proceedings of the IEEE conference on computer vision and pattern recognition(CVPR), pp. 770-778. June 2016.

[https://doi.org/10.1109/CVPR.2016.90]

-

R. Dandavate and V. Patodkar, "CNN and data augmentation based fruit classification model", 2020 Fourth International Conference on I-SMAC (IoT in Social, Mobile, Analytics and Cloud)(I-SMAC). IEEE, pp. 784-787, November 2020.

[https://doi.org/10.1109/I-SMAC49090.2020.9243440]

-

K. Kangune, V. Kulkarni and P. Kosamkar, "Grapes Ripeness Estimation using Convolutional Neural network and Support Vector Machine", 2019 Global Conference for Advancement in Technology (GCAT). IEEE, pp. 1-5, October 2019.

[https://doi.org/10.1109/GCAT47503.2019.8978341]

-

S. Chakraborty, F. M. J. M. Shamrat, M. M. Billah, M. A. Jubair, M. Alauddin and R. Ranjan, "Implementation of Deep Learning Methods to Identify Rotten Fruits", 2021 5th International Conference on Trends in Electronics and Informatics (ICOEI). IEEE, pp. 1207-1212, June 2021.

[https://doi.org/10.1109/ICOEI51242.2021.9453004]

- nongsaro, Rural Development Administration(RDA). Agricultural Technology Guide-Agricultural products post-harvest processing machine. [Internet]. Available: https://nongsaro.go.kr/portal/ps/psb/psbx/cropEbookLst.ps?menuId=PS65290&stdPrdlstCode=AE&sStdPrdlstCode=AE03AE36&totalSearchYn=Y#

- Jeong, M. C. “Current status and research trends of agricultural product screening technology”, Bulletin of Food Technology, Vol. 8, No. 1, pp.34-46, March 1995.

- nongsaro, Rural Development Administration(RDA). Agricultural Technology Guide-Post-harvest management of horticultural products. [Internet]. Available: https://nongsaro.go.kr/portal/ps/psb/psbx/cropEbookLst.ps?menuId=PS65290&stdPrdlstCode=CS&sStdPrdlstCode=CS04CS4J&totalSearchYn=Y#

- Min-jeong Koo, Dong-kuk Hwang, Woo-ram Lee. “A fruite grader system base on Digital image”, Journal of The Korea Society of Computer and Information (JKSCI), Vol. 16, No. 1, pp.237-241. June 2008.

-

Soo-ho Jeong, Meong-hun Lee, Hyun Yoe, “Fruit Classification System Using Deep Learning”, Journal of Knowledge Information Technology and Systems (JKITS), Vol. 13, No. 5, pp. 589-595, 2018.

[https://doi.org/10.34163/jkits.2018.13.5.009]

- AI Hub, Agricultural Products Quality (QC) Image [Internet]. Available: https://aihub.or.kr/aidata/30726

저자소개

2019년 : 전주대학교 (사회복지학사)

2022년 : 전주대학교 대학원 (공학석사)

2022년~현 재: 전주대학교 문화기술학과 인공지능 Lab 박사과정

※관심분야 : 인공지능, 딥러닝, 스마트팜

1989년 : 한국과학기술원 (공학석사)

2001년 : 한국과학기술원 (공학박사)

1992년~2000년: LG CNS

2000년~2010년: 한국 IBM, SAP

2011년~2014년: KT

2014년~2020년: 전주대학교 스마트미디어학과 교수

2017년~현 재: 전주대학교 일반대학원 Agro AI학과 교수

2021년~현 재: 전주대학교 인공지능학과 교수, 인공지능연구소 기획담당

※관심분야 : 스마트팜, 인공지능, 블록체인, ERP, SCM, 정보전략