국내외 언론이 바라본 딥페이크 기술

Copyright ⓒ 2022 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

딥페이크(deepfake)는 적대관계생성신경망 (Generative Adversarial Networks, GAN)을 이용하여 원본 이미지 위에 다른 이미지를 결합해 새로운 이미지를 생성하는 기술로 미디어 산업에서 다양한 활용 가능성을 보여주고 있다. 하지만 딥페이크 기술의 악용사례가 빈번히 등장하면서 딥페이크 기술에 대한 사회적인 인식은 다소 부정적이다. 본 연구는 다른 환경에서 동일한 기술에 대한 인식과 논의가 어떻게 다른지 살펴보기 위하여 딥페이크와 관련된 국내외 언론 보도 기사(국내-1,576건, 국외-2,107건)를 수집하여 국내외 언론 보도의 경향성을 비교 분석하고자 하였다. 연구 결과, 국내 언론보도는 ‘n번방’과 특정 범죄 사건과 연관된 키워드와 토픽이 주를 이루었으며 국외 언론보도는 딥페이크 기술의 주요 키워드인 ‘video’, ‘fake’등의 키워드와 함께 소셜 미디어, 정치 등 좀 더 다양한 토픽이 등장하였다. 국내 언론이 딥페이크 기술을 범죄 사건과의 깊은 연관성 상에서 언급한 것과 달리, 국외 언론에서는 딥페이크로 만들어진 가짜 동영상 사건을 중심으로 이에 대한 대응방안, 기술적 설명 등으로 좀 더 다양한 시각을 보여주고 있었다.

Abstract

Deepfake, which contains various aspects of usage, is expected to complement limitations on human based media production. But current social perception towards deepfake is formed negatively because abuse cases were occurred using deepfake technology. To understand how perceptions and discussions of the deepfake technology vary in different contexts, this study attempted to compare and analyze articles related to deepfake from S. Korea(n=1,576) and others(n=2,107). As a result of keyword frequency analysis, S. Korean media attempted to report articles focused on specific sexual crime case(=nth room), meanwhile others were reporting articles based on various cases. In this context, we also found out that, S. Korean media was reporting fragmentary contents related to specific cases through topic modeling and keyword network analysis.

Keywords:

Deepfake, Media coverage, Topic modeling, Keyword Network, Comparative Study키워드:

딥페이크, 언론보도, 토픽모델링, 키워드 네트워크, 국내외 비교연구Ⅰ. 서 론

딥페이크(Deepfake)는 적대관계생성신경망(Generative Adversarial Networks, GAN)을 이용하여 원본 이미지 위에 다른 이미지를 결합해 새로운 이미지를 생성하는 기술이다. 적대관계생성신경망 기술은 원본과 차이가 없는 데이터를 만들려는 생성모델과, 원본과 다른 점을 찾아내는 분류모델을 서로 경쟁시켜 반복실행을 통해 원본과 흡사한 데이터를 만들어내는 알고리즘인데, 큰 틀에서보면 AI기술, 그 안에서도 딥러닝 기술의 하나이다[1]. AI프로그램이 이미지를 조작하여 실제처럼 보이는 가짜 이미지나 동영상을 만드는 것을 전반적으로 통틀어 딥페이크라 부르기도 하지만[2] GAN을 이용한 이미지 생성 기술에는 드라마·영화상에서 배우가 직접 촬영하기 어려운 부분에 대역을 사용한 후 대역의 얼굴을 배우의 얼굴로 변환하는 '페이스에디팅(face-editing)'기술[3], 배우의 얼굴(주름, 나이대 등)을 보정하는 '페이스에이징/디에이징(face-aging/ deaging)' 기술 등 여러 가지가 있다.

GAN을 이용한 기술들은 이미지를 생성해낸다는 특성 때문에 미디어 산업에서 널리 쓰이고 있다. 기존 수작업으로 이루어지던 VFX(visual effects) 작업에 AI 기술을 도입함으로써 인간의 관여를 최소한으로 줄이고, 구현해 내기 어려운 영상도 새롭게 만들어낼 수 있게 되면서 시간, 비용 및 제작환경 등에 영향을 덜 받는 결과물 창출이 가능하게 되었다. 예를 들어 딥페이크 기술을 이용하면 상당히 사실적인 음성 더빙을 만들어낼 수 있는데, 영상에 나타나는 사람이 실제로는 한국어를 사용하지만, 영어나 프랑스어 등을 말하는 것처럼 입 모양을 바꾸어 매우 자연스럽게 외국어를 구사하는 것처럼 보이는 영상을 만들어낼 수 있다. 실제로 축구선수인 데이비드 베컴이 출연한 2019년 글로벌 말라리아 인식 캠페인에서는 데이비드 베컴이 다국어를 구사하는 것처럼 자연스러운 영상을 만들어 세계 각지에 홍보하며 캠페인의 효과를 높이기도 하였다 [4].

딥페이크 기술의 활용도가 높아지면서 이에 대한 관심도 최근 몇 년간 급증했다. 이승환 (2020)은 소셜 미디어에서 딥페이크가 언급된 횟수와 양상을 연구하였는데, 2017년 말 언급되기 시작한 딥페이크는 2018년에 폭발적으로 그 양이 증가했다고 한다[5]. 그런데, 딥페이크 기술과 관련된 사회적 관심의 면면을 살펴보면 대부분 부정적인 평가가 크다. 이승환 (2020)의 연구에서 딥페이크(Deepfake)라는 단어가 언급될 때 함께 나타나는 감정적 반응을 조사한 결과, 딥페이크와 함께 나타난 단어들 중 부정적 단어가 긍정적인 단어의 3배 이상이 되는 것으로 나타났다. 유사한 AI 기술을 활용한 영상 편집 기술 중 유독 딥페이크가 부정적인 기술로 인식되고 있는 것은 딥페이크 기술이 사회적으로 생성되고 확산되는 과정에서 부정적인 면이 많이 부각되었기 때문일 것이다. 딥페이크 기술이 처음 대중적으로 알려지기 시작한 것도 유명인의 얼굴을 합성하여 만들어진 불법 동영상이 소셜미디어에서 공유되면서였고, 유명인의 얼굴을 합성한 동영상들이 종종 유포되면서 딥페이크 기술이 풍자(satirical), 밈(meme), 음란(pornographic), 기만(deceptive)의 목적으로 활용되는 경우가 많았다[6]. 최근 우크라이나와 러시아의 전쟁이 발발한 시점에서 각국 대통령의 딥페이크 영상을 이용한 가짜뉴스가 SNS상에 전파되기도 하였다[7].

딥페이크 기술을 악용하는 사례들은 해당 기술에 대한 부정적 인식을 증가시키는 것이 사실이지만, 악용의 사례들 때문에 딥페이크 기술을 ‘나쁜’ 기술이라고 할 수는 없다. 앞선 사례처럼 긍정적인 목적으로 활용되는 경우도 있기 때문이다. 그럼에도 불구하고 악용된 사례들이 더 많이 부각되고 그로 인해 부정적 이미지가 커진다는 것은 어떤 기술인가 하는 기능적 문제와 함께 그것을 어떻게 활용하는가 매우 중요하다는 것을 보여준다. 기술이 활용되고 그것에 대한 인식이 형성되는 과정에는 기술 자체의 특성 외에 그것이 활용하는 사회적 집단이나 환경이 주요하게 영향을 미친다고 볼 수 있다[8].

딥페이크와 같은 AI 기술이 사회적으로 받아들여지는 양상이 중요한 것은 주요 기술들이 소수의 기술자나 기업들이 독점하던 과거와 달리 누구나 기술을 쉽게 활용할 수 있는 기술의 대중화가 가능해졌기 때문이다. 실제로 딥페이크 기술은 스마트폰 애플리케이션을 다운받아 누구나 간단히 이용할 수 있을 만큼 대중화되었다. 기술의 대중화는 쓰임에 따른 책임이 기술을 독점하는 소수에게 있는 것이 아니라 대중에게 있다는 의미가 된다. 기술이 사회적으로 활용되는 받아들여지는 양상은 기술 활용의 부작용을 개선하며 해당 기술을 발전시키는 일련의 과정을 이해하는 데 도움을 준다. 사회적 환경을 중요시하는 이러한 관점은 사회적 환경이 다른 국가나 문화권에서 같은 기술이 다르게 활용될 수 있다는 점을 시사하기도 한다[9].

대중적으로 확산되고 있는 AI 기술 중 하나인 딥페이크가 다른 문화권에서 어떻게 활용되고 이해되고 있는지 살펴보기 위해서 본 연구에서는 국내외의 약 3,600건의 기사 제목 데이터를 수집하여 국내외 언론 보도의 경향성을 비교 분석하고자 하였다. 내용분석, 주제어 빈도분석, 토픽모델링, 언어 네트워크 분석을 실시하여 딥페이크에 대한 국내 언론과 영어권 (미국과 영국) 언론의 주요 의제를 도출해보고, 그것을 통해 같은 기술이 국내외에서 어떻게 다르게 인식되고 있는지 살펴보고자 한다.

Ⅱ. 문헌연구

2-1 딥페이크 기술의 긍정적 활용

초기 딥페이크 기술의 경우, 오토인코더(Autoencoder) 기술을 기반으로 원본(source)의 특정 부분을 단순히 바꿔 합성한다는 개념에 그쳐 다소 부자연스러운 결과물이 구현되었으나, 최근 적대적 생성 신경망(GANs, Generative Adversarial Neworks) 기술이 접목됨에 따라 더욱 고도화된 결과물을 구현할 수 있게 되었다[10]. GANs 기술은 인공신경망(Artificial Neural Network) 내에 다른 목적을 지닌 두 네트워크(Generator&Discriminator)를 위치 시켜, 각 모델이 학습을 반복하며 최종적인 결과물을 생성해내는 기술이다. 즉, 생성모델(generator)은 주어진 원본값을 토대로 진짜 같은 가짜 영상을 지속해서 생성하며, 분류모델(discriminator)은 생성모델이 전달하는 영상에 대한 진짜와 가짜 유무를 판독하며 서로 상호 발전하게 된다. 따라서 결론적으로 생성모델은 실제와 매우 유사한 영상을 생성하게 되며, 분류모델이 가짜 영상임을 인식하지 못할 때 최종적인 결과물이 생성되는 방식이다[11]. 이후, 지속 개발·보완된 딥페이크 기술은, AI가 여러 원본 소스를 학습하여 완전히 새로운 가상의 영상(image)을 생성하고, 영상의 심층적인 조작(표정, 입 모양 등)을 가능하게 하는 StyleGAN(Style Generative Adversarial Networks) 기술로까지 발전을 거듭한 상황이다[12].

점차 딥페이크 기술이 고도화됨에 따라 딥페이크 기술이 방송·미디어 콘텐츠 산업에 접목되는 사례가 빈번해지고 있다. 딥페이크 기술은 방송·미디어 산업에서 제작자의 시간·비용·기술적 제약을 보완함과 동시에 완성도를 높이고 배우가 소화 가능한 연기의 범위를 확장하고 있다. 최근 tvN에서 방영된 드라마 <나빌레라>는 배우가 소화할 수 없는 장면에 대역을 활용해 AI로 하여금 대역의 동작을 학습시키고, 이후 편집과정에서 배우의 얼굴을 합성시키는 페이스 에디팅 기술을 활용하였으며[13], Mnet의 <AI 음악프로젝트 다시 한 번>은 과거 영상·음성 자료를 바탕으로 페이스에디팅 기술과 AI 음성복원 기술을 융합하여 사망한 가수의 무대를 새롭게 재현하였다[14-15]. 이어서, TvN의 예능 <불꽃미남>에서는 디에이징 기술을 활용해 출연진들의 얼굴을 20대 시절의 외모로 변환하여 송출하고, <강식당>에서는 객체 제거 기술을 활용하여 브랜드 로고와 방송 카메라 등을 화면에서 제거하여 시청자들의 몰입도를 높였다[16]. 또한 영화 <Avengers: Endgame(2019)>와 <The Irishman(2019)>, 그리고 <Gemini Man(2019)>에서는 페이스 디에이징 기술이 중년 배우들의 다양한 연령대의 연기를 구사하기 위한 수단으로 활용되기도 하였다[17-18].

딥페이크의 활용성은 방송·미디어 산업에서만 국한되지는 않는다. 최근 3D 모델링을 통해 형성된 디지털 휴먼(Digital Human)은 딥페이크 기술을 응용하여 실시간으로 다양한 언어(언어적 표현 및 비언어적 표현)를 구사할 수 있도록 발전하고 있으며, 이는 엔터테인먼트, 마케팅, 교육 등과 같은 부문에서 활용되고 있다[19]. 또한, 독일 뤼벡대학교의 의료정보학연구소는 딥페이크 기술을 응용하여 촬영된 CT, MRI, X-Ray 자료를 바탕으로 암의 징후와 이상 신호 등을 검출하는 기술을 개발하는 등[20] 딥페이크 기술은 매우 다양한 사례에서 긍정적으로 활용되고 있다.

2-2 딥페이크 기술에 대한 논쟁

딥페이크 기술은 2017년 12월 해외 유명 커뮤니티 사이트 레딧(Reddit)에 'deepfakes'라는 ID를 가진 한 사용자가 음란물에 해외 유명 여배우의 얼굴을 합성한 게시물을 업로드하면서부터 대중적으로 알려지기 시작했다[21]. 이후 유명 개발자 커뮤니티(TenseorFow, OpenCV, Reddit 등)에 바로 구현 가능한 무료 API/SDK(Application Programing Interface/Software Development Kit)가 공유되고, 딥페이크 제작 애플리케이션과 웹사이트 등이 생겨나면서 누구나 쉽게 딥페이크 동영상을 이용할 수 있게 되었고 딥페이크 기술을 악용하는 사례도 증가했다 [21-23]. 유명인과 일반인을 대상으로 합성된 가짜 영상물이 제작·유포되는 사례가 잇따라 등장하고 있으며[24-25], 2019년 기준 딥페이크 영상 총 14,678건 중 약 96%가 음란물로 확인된다는 연구 결과가 나올 정도로 불법 동영상이 증가했다[26].

나아가, 제공되는 미디어 콘텐츠에 대해 비판적으로 수용하고 대응할 수 있는 '비판적 소비 능력'이 부족한 상황 속에서 증가하는 딥페이크 기술의 활용은 '가짜뉴스'의 생산에 힘을 실어주게 되는 것이며[27], 생산된 '가짜뉴스'는 소셜미디어(social media) 환경을 통해 급속도로 확산될 가능성이 높다[22]. 즉, 기본적으로 인간의 일반적인 감각으로는 구별 불가한 딥페이크 정보가 가짜뉴스에 포함될 시, 정보를 수동적(passive)으로 받아들이는 수용자(대중)는 해당 정보를 그대로 받아들이게 되며 이를 타인과 공유하여 전파의 확산을 높일 수 있다는 것이다. 더군다나, 디지털 디바이스의 보편화로 이용자들이 시·공간 제약 없이 소셜네트워크서비스(Social Network Service)상에서 딥페이크 정보를 바탕으로 잘못된 여론을 단기간에 형성할 수 있기에, 그 점 또한 우려되는 상황이다[28].

2-3 딥페이크 관련 선행연구

딥페이크 기술은 긍정적인 활용 측면과 부정적인 활용 측면을 동시에 지니고 있지만, 딥페이크를 향한 사회적 인식은 부정적인 면이 크다. 이러한 상황에서, 현재 딥페이크에 관련된 연구들은 기술의 부작용과 우려를 예방하기 위한 '기술 개발'의 관점과 '사회·법/제도' 관점에서 이루어지고 있다. 우선, 딥페이크 기술과 관련된 연구의 경우 '딥페이크 생성 기술'과 '딥페이크 탐지 기술'로 나뉘어 진행되고 있는데[29], 최근 들어 기술에 대한 사회적 우려가 높아짐에 따라 '딥페이크 탐지 기술'에 관련된 연구가 주로 이루어지고 있는 상황이다. 이에 따라, 박준 외(2019); 김정호 외(2020); 손석빈 외(2021)는 현재 국내외에서 개발된 딥페이크 탐지 기술 동향을 바탕으로 비교 및 검증을 실시하여 기술적 보완을 위한 제언을 제시하였다[10, 23, 29]. '사회·법/제도' 관점에서 이루어진 연구의 경우, 앞서 나타난 딥페이크 부작용 사례를 바탕으로 사회적으로 정비되어야 할 법/제도의 마련과 대응 방안에 대한 함의를 도출하였다. 최근에는 딥페이크 기술이 적용된 애플리케이션을 활용해 초등학생들을 대상으로 윤리교육을 실시하여 유의미한 성과를 나타낸 연구도 있다[30]. 최순옥 외(2019)와 이민영(2020)은 딥페이크가 사회적 여론 과정에서 초래할 수 있는 역기능에 대하여 사회 구조적 맹점과 법/제도적 대응에 대한 논제를 제시하였으며, 올바른 규제의 방향성과 입법 정책적 과제를 제안하였다[21-22]. 그리고 홍태석(2020)은 딥페이크 악용 사례에 대한 해외 판례를 중심으로 새로운 유형의 범죄에 대한 필요성을 주장하며 사회적 차원에서 고려되어야 할 법·제 대응 방안을 제시한 바 있다[31].

2-4 언론을 통해 본 딥페이크 기술에 대한 사회적 시각

다양한 분야에서 딥페이크 기술의 발전 방향에 대한 연구가 이루어지고 있지만, 언론의 담론은 사건⋅사고에 집중되어 있다. 국내 언론은 주로 딥페이크 기술을 악용한 사건이나 부작용 및 우려에 초점을 맞추고 있으며, 그 외 기술의 다양한 활용 및 해결해야 할 과제 등에 대한 담론은 부족하다[32]. 이러한 제한적이고 부정적인 담론은 대중들이 담론의 대상에 대해 부정적 인식을 형성하는 데 영향을 미치게 된다[33-35].

Westerlund (2019)은 구글에서 검색된 84개의 신문 기사 분석을 통하여 딥페이크 기술 활용의 예, 이점과 위협, 그것에 대응하는 방법에 대해서 연구하였다[36]. Westerlund의 연구에서는 딥페이크가 정치 시스템이나 경제활동에 위협적인 면도 있지만 입법이나 교육 등을 통해 극복될 수 있음을 설명하고 있다. 이는 국내 언론이 딥페이크를 범죄 사건과 연결 지어 사건 중심의 기사를 주로 내보낸 것과는 차이가 있는 부분이다. 하지만 Westerlund (2019)의 연구는 구글 검색을 통해 소수의 기사만을 분석하였고 분석 기간도 제한적이어서 한국의 경우와 직접적인 비교를 하기에는 무리가 있다. 이에 본 연구는 국내 신문 기사와 국외 신문 기사를 비교함으로써 딥페이크기술에 대해 국내와 국외 언론이 기술의 활용 양상 및 논란, 또는 논란에 대한 대안 및 발전 방향 등에 대해서 각기 어떠한 토픽을 형성하여 보도하였는지 비교하여 분석해보고자 한다. 이를 통해 동일한 기술에 대한 사회적 이해가 국내외적으로 어떻게 다른지를 살펴 볼 수 있을 것으로 생각된다.

Ⅲ. 연구방법

3-1 데이터 수집

본 연구는 언론이 딥페이크 기술을 보도함에 있어 국내와 국외에서 어떠한 차이를 나타내는지 살펴보고자, 기사의 내용에 대한 요약 및 논점이 드러나는 '기사 제목'을 바탕으로[37] 국내와 국외의 보도 경향을 비교분석하였다. 국내 언론보도 기사 제목 데이터는 한국언론진흥재단의 '빅카인즈'를 통해 수집하였다. 국외 언론보도 기사 데이터 수집은 LexisNexis 사의 'Lexis+®'를 활용하였다. LexisNexis 사는 자체 구축한 데이터베이스를 전 세계 주요 언론사에서 수집된 뉴스(신문, 잡지, 통신, 기사 등), 법률 및 국가에 관한 자료 등을 제공하는 기업이다[38-40].

데이터를 수집하기 위해 키워드는 국내의 경우 "딥페이크," 국외의 경우 "deepfake"를 사용하여 검색되는 신문 기사를 수집하였다. 데이터 검색 기간은 2000년 1월 1일부터 2021년 11월 23일로 설정하였다. 빅카인즈를 통해 수집된 국내 언론보도 기사 제목은 1,625건으로 중복 및 관련 없는 기사 49건을 제외하고, 총 1,576건의 기사를 수집하였다. Lexis+® 를 통해 수집된 국외 기사 제목은 2,546건으로 중복 및 관련 없는 기사(단순히 단어 'deep'과 'fake'가 포함된 기사) 439건을 제외하고 총 2,107건의 기사를 수집하였다. 본 연구를 위하여 'Lexis+®'로 검색되는 기사들 가운데 영어로 작성된 기사만을 선택하였다.

3-2 데이터 분석방법

수집된 국내외 신문 기사의 추이를 살펴보고자 연도 및 분기별 기사량 추이를 도출하였으며, 키워드 빈도분석과 토픽모델링, 그리고 키워드 네트워크 분석을 위해 R을 이용하였다. 토픽모델링은 LDA(Latent Dirichlet Allocation) 방법을 활용하였으며, FindTopicNumbers 함수를 통하여 Griffiths2004, CaoJuan2009, Arun2010, Deveaud2014 등 4개의 지수값을 기준으로 최적의 토픽 개수를 결정하였다<부록 1, 2>. 이어서 키워드 네트워크 분석을 위해 ‘ggraph’ 함수를 활용하여 연결 중심성(degree centrality)을 중심으로 네트워크를 형성하였다. 네트워크 분석은 검색어인 딥페이크(deepfake)는 제외한 경우와 제외하지 않은 경우를 분리하여 분석을 실시하였고, 이를 통해 키워드와 다른 단어 간의 연관성을 살펴보았다.

3-3 데이터 전처리

본 연구를 위해 수집된 비정형 데이터의 전처리를 위해 다음과 같이 전처리 작업을 진행하였다. 데이터의 전처리는 R의 'tm', 'KoNLP', 'dplyr', 'stringr', 'textclean', 'tidytext', 'tidyr' 등과 같은 패키지를 활용하여 진행하였다. 국내 기사의 경우 불필요한 단어처리의 용이성을 위하여 우선 'n번방'과 'n 번방'과 같은 주요 동의어를 '엔번방'으로 우선 변환하여, 한 글자 삭제 등과 같은 기타 전처리 작업 후 다시 ‘n번방’으로 변환하는 작업을 진행하였다. 영어 기사의 경우 artificial intelligence와 같이 두 단어 이상으로 이루어진 하나의 키워드가 두 가지 키워드로 분리되는 것을 최소화하기 위하여 명사 추출 전 같은 의미의 한 단어 키워드로 변형시켰다. ‘Daily news’ 나 ‘Today’s news’와 같은 신문 섹션 정보와 날짜도 불용어로 처리하였다. 명사 추출 후 동의어, 축약어 및 불용어에 대한 추가적인 전처리를 실시하여 'facebook's, facebook과 같이 동일하게 처리할 수 있는 단어들은 같은 단어로 변환하였으며, 무의미한 숫자 및 기호(구두점, 괄호 등)도 제거하였다. 이러한 과정을 거쳐 최종적으로 8,824개(국내), 14,763개(국외)의 명사 키워드를 추출하였다.

Ⅳ. 연구결과

4-1 기사량 추이와 키워드 빈도

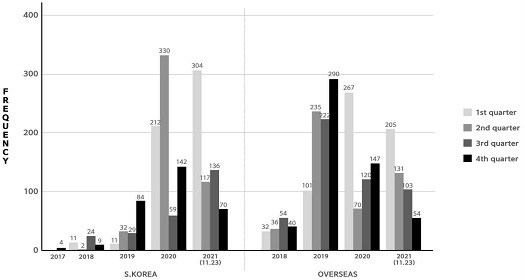

국내와 국외 언론의 딥페이크 관련 보도는 년도 및 분기별로 상이한 기사량을 나타내고 있다[그림 1]. 2017년도부터 2021년 11월 23일까지 분기별 딥페이크 관련 보도량(기사량)을 분석해본 결과, 딥페이크와 관련된 국내 언론보도는 2017년도부터 차츰 이루어지기 시작하였으며 2020년 1-2분기, 2021년 1분기와 같이 특정 시점에만 급증하는 양상을 보였다. 반면, 국외의 언론보도는 2018년부터 관련 기사가 나타나다가 2019년 1분기를 기점으로 2020년 1분기까지 보도량이 늘어났으나, 이후 점차 줄어드는 추세를 나타내고 있다. 2017년 12월, 해외 유명 커뮤니티 사이트에서 연예인 얼굴을 합성한 가짜 동영상이 등장한 직후부터 딥페이크란 용어가 등장하였음에도 불구하고[5] 2017년에는 국외 신문 기사 데이터를 수집할 수 없었는데, 이는 당시 이슈가 된 가짜 동영상에 대한 기사를 보도한 언론사가 데이터 수집을 위해 활용된 Lexis+®에서 수집되지 않는 인터넷 언론사였기 때문이다.

국내외 언론의 주요 키워드 차이를 좀 더 세부적으로 살펴보고자 연도별 키워드 빈도분석을 실시하였다. 빈도수는 각각 검색어인 딥페이크와 ‘deepfake’를 제외한 후 계산되었다. 2019년까지는 국내외 언론이 동일하게 딥페이크 기술의 악용 사례(가짜 뉴스, 음란물 등)에 대한 키워드가 주로 나타났으나, 2020년을 기점으로 점차 달라지기 시작하였다. <표2>에 나타난 국내기사 키워드를 보면, 2020년 초 국내에서 일어난 ‘n 번방’사건을 기점으로 디지털 성범죄, n 번방 가해자(강훈, 부따, 박사, 조주빈 등), 가해자 처벌 등과 같은 키워드가 주로 나타났으며, 2021년 초 ‘제2 n 번방’사건이 조명됨에 따라 알페스와 연예인(아이돌) 성 착취물 제작·유포를 중점으로 키워드가 나타나고 있다. 즉, 딥페이크와 관련된 국내 언론 보도의 경우 특정 성범죄 사건을 중심으로 기사가 보도되었음을 볼 수 있다.

반면, 국외의 경우 딥페이크와 키워드가 범죄 사건에 국한되지 않고 좀 더 다양하게 나타나고 있었다. 딥페이크와 관련된 기사량이 가장 높게 나타난 시점인 2019년과 2020년의 키워드 빈도분석 결과를 보면 을 실시한 결과 소셜 미디어 플랫폼이나 관련회사와 관련된 키워드(facebook, twitter, youtube, microsoft 등), 선거, 가짜 동영상 등의 키워드가 나타나고 있다. 이는 2020년 11월 미 대통령 선거를 전후하여 정치적 캠페인과 관련하여 정치인 가짜 동영상과 이에 대응하는 소셜 미디어에 관련된 기사가 많이 보도되었음을 유추할 수 있다. 또한 영국의 한 방송사(Channel4)가 조작된 정보 유포의 위험성을 알리기 위해 기획한 '딥페이크 엘리자베스 여왕의 연설'이 이슈가 되었는데, 이에 대한 기사들에서 여왕이라는 키워드도 추출된 것을 볼 수 있다. 이후 2021년부터는 AI, technology, woman, life 등과 같이 키워드의 종류가 다양해지는 것을 볼 수 있다. 이는 딥페이크 기술과 관련하여 사회적 논의점을 확장하는 기사들이 보도되고 있음을 유추해 볼 수 있다. 전반적으로 국내 기사에 비해 국외 기사에서 더 다양한 키워드들이 나타나고 있음을 볼 수 있는데, 이는 전체 기간을 대상으로 수집한 주요 키워드의 순서를 보면 더욱 명확하다. <표 3>을 보면 국내 언론보도에서 가장 많이 언급된 키워드는 'n번방', '디지털', '성범죄', '가짜', '영상', '합성', '착취물', '처벌', '사진'의 순이였으며, 국외 언론보도에서 가장 많이 언급된 키워드는 'videos', 'fake', 'technology', 'facebook', 'AI', 'news', 'election', 'Trump', 'porn', 'ban'의 순으로 나타났다.

빈도분석 결과를 보면 국내 신문 기사 제목에서 나타나는 키워드는 주로 딥페이크를 활용한 성범죄 사건 및 범죄자에 대한 키워드가 많으며, 국외의 경우는 소셜 미디어 게시물, 기술, 정치, 가짜와 관련된 키워드들이 나타나고 있다.

4-2 토픽모델링

국내외 언론들이 다루는 주요 토픽을 살펴보기 위하여 언론 기사 제목을 바탕으로 토픽모델링을 실시하였다. 딥페이크와 관련된 국내외 기사 제목에 대한 토픽 수는 동일하게 7개로 도출되었으며 도출된 토픽별 상위 10개의 키워드는 <표 4>과 <표 5>와 같다. 이때, 도출된 토픽별로 나열된 키워드의 beta값은 각 토픽에 해당 키워드가 나타날 확률값을 의미한다[41].

도출된 토픽에 따른 토픽 명을 결정하기 위하여 각 키워드를 참고함과 동시에 각 토픽을 높은 확률로 보여주는 신문 기사를 무작위로 선정하여 본문을 검토한 후, 각 토픽을 가장 포괄적으로 설명할 수 있는 토픽 명을 정하였다.

국내 언론보도 기사의 토픽 1에 나타난 키워드는 가짜, 영상, 뉴스, 사진, 음란물, 진짜 등으로, 각종 매체를 통해 전파되는 가짜뉴스와 이를 대응하기 위한 각종 대응 방안에 관련된 내용이 포함되어있어 '가짜뉴스 대응 강화'로 명명하였다. 토픽 2의 경우 n번방의 beta 값이 눈에 띄게 높게 나타났으며 이어서 'n번방' 방지법과 관련된 키워드 불법, 국회, 촬영, 영상 등이 나타나 'n번방 방지법'으로 명명하였고, 토픽 3은 착취물, 유포, 경찰, 기술, 수사, 피해자, 공개 등의 키워드의 비중이 높게 나타나 '국내 최대 딥페이크 범죄 사건'으로 명명하였다. 그리고, 토픽 4는 디지털과 성범죄 키워드의 비중이 확연히 높게 나타났으며 이어서 텔레그램, 범죄, 처벌 등의 키워드가 등장해 '디지털 성범죄 대응 대책'으로 명명하였으며, 토픽 5에서는 알페스, 처벌, 청원, 디스코드, 포르노 등의 키워드와 같이 사회적으로 제2 'n번방' 사건으로 논란이 된 내용이 주로 담겨있어 '제2 n번방 사건'으로 명명하였다.

나아가, 토픽 6은 얼굴, 합성, 연예인, 제작 등과 함께 징역 등의 키워드가 등장하여 '디지털 성범죄의 처벌 기준 확대'로 명명하였으며, 토픽 7은 강훈, 부따에 이서 박사방, 범죄단체, 조주빈, 조직, 공범 등의 키워드가 함께 나열되어 '국내 최대 딥페이크 범죄단체의 검거 및 구속 소식'으로 명명하였다.

이어서 국외 언론보도 기사의 토픽 1에 나타난 키워드는 fake, news, videos, create, real 등으로 가짜뉴스의 전파와 경고에 관련된 내용으로 '가짜뉴스의 전파와 경고'로 명명하였다. 토픽 2는 election, threat, app, disinformation, doctored 등의 키워드가 나타나, 정교한 딥페이크 기술 및 사건을 바탕으로 발생 가능한 사회적 우려에 대한 내용이 포함되어 '딥페이크 기술의 정교함과 사회적 우려'로 명명하였다. 토픽 3의 경우 technology, ai, future, digital, media의 키워드와 함께 voice, deep 등의 키워드가 등장하며 딥페이크 기술 자체의 활용 및 범용성에 대한 내용이 포함되어 '딥페이크 기술의 성장'으로 명명하였다. 그리고, 토픽 4에서는 videos, facebook, nancypelosi, expert, markzuckererg, tomcruise, star 등의 키워드가 연이어 등장하여 페이스북에 업로드된 조작된 게시물의 유형과 이에 대한 페이스북의 대응에 관한 내용으로 '조작된 게시물과 페이스북의 대응'과 같이 명명하였으며, 토픽 5에서는 ban, facebook, twitter, political, socialmedia, ad, fight, race 등의 키워드가 연이어 등장해 'SNS 플랫폼의 대응책 마련'으로 명명하였다.

마지막으로, 토픽 6에서는 porn, women, online, image, life, law, revenge 등의 키워드가 주로 나타나 '성범죄 피해자와 성범죄 유형'으로 명명하였고, 토픽 7에서는 trump, qeen, misinformation, reality, manipulated, danger 등의 키워드가 등장하며 '조작된 정보에 대한 정부의 경고'로 명명하였다.

4-3 키워드 네트워크

토픽모델링 분석은 키워드 중심으로 토픽을 추출하여 비정형화된 텍스트 데이터 내에서 구조화된 맥락적 정보를 추출하기 어렵다는 단점을 지닌다[42].

이에 따라 본 연구는 도출된 특정 키워드의 동시출현관계(co-occurrence relationships)를 바탕으로 키워드 네트워크를 형성하여, 제시된 키워드 간의 맥락적 정보와 그 의미를 파악하고자 하였다[43-44].

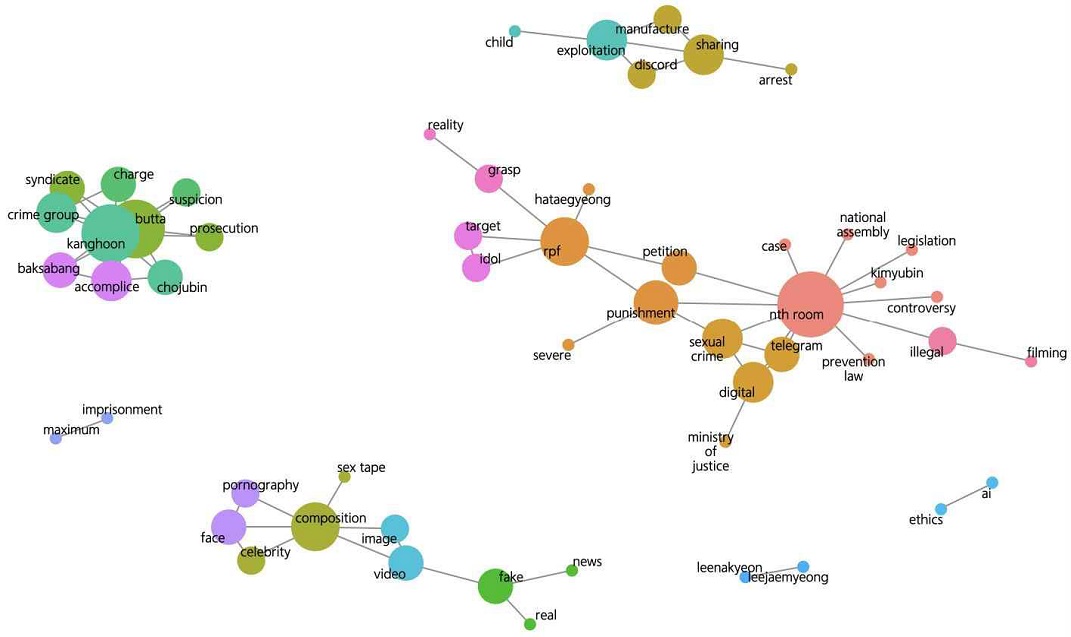

국내 언론보도 기사 제목을 바탕으로 형성된 키워드 네트워크는 <그림 2>와 같이 크게 4개의 컴포넌트(component)와 3개의 독립 컴포넌트(isolated component)로 분할되어 형성되어 있다. 각 컴포넌트는 앞서 제시된 토픽모델링 결과와 매우 유사하게 형성되어 있으며, 국내에서 논란이 된 사건을 중심으로 형성되어있음을 찾아볼 수 있다. 먼저, 가장 크게 나타나는 컴포넌트의 경우 'n번방' 사건을 중심으로 '디지털 성범죄'와 'n번방 방지법' 관련 키워드가 나타나고 있고, 이어서 알페스 및 디스코드를 통해 추가로 제기된 디지털 성범죄를 중심으로 클러스터(cluster)와 별도의 컴포넌트가 형성되었음을 살펴볼 수 있다. 다음으로, 키워드 네트워크 좌측에 위치한 컴포넌트의 경우 강한 연결 중심성을 가진 노드들을 중심으로 컴포넌트가 형성되었는데, 이는 곧 'n번방' 범죄단체의 검거와 관련된 내용의 기사에서 제시된 키워드로 유추할 수 있다.

키워드 네트워크 하단에 위치한 컴포넌트의 경우 합성, 연예인, 얼굴, 음란물, 사진, 영상 등의 키워드와 함께 가짜, 뉴스, 진짜의 키워드가 도출되었는데, 이는 국내에서 발생한 딥페이크 범죄의 유형에 관한 기사가 다수 보도되었음을 내포

한다. 이와 더불어, 키워드 네트워크에서 나타난 독립 컴포넌트의 경우 두 개의 키워드(최대-징역, 이낙연-이재명, 인공지능-윤리) 외에는 별도의 연결성이 없는 것으로 나타났다. 따라서 두 키워드는 딥페이크 기술에 대한 내용이 포함된 기사에서, 단순히 제목 구성을 위해 높은 비중으로 함께 사용되었음을 확인할 수 있다.

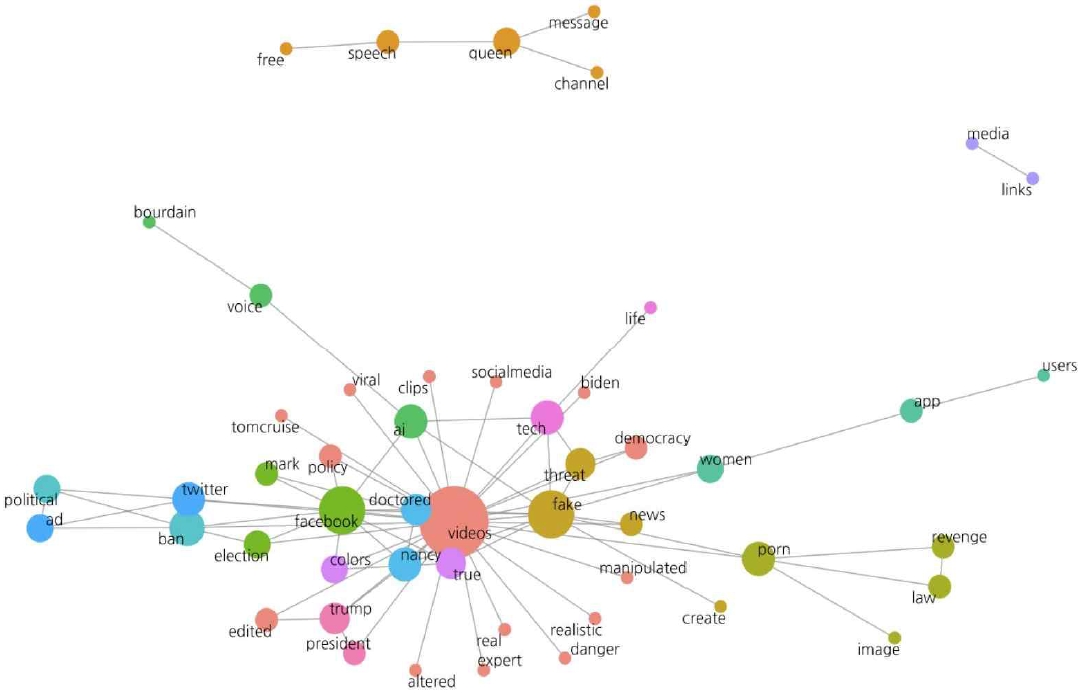

반면 국외 언론보도 기사 제목을 바탕으로 형성된 키워드 네트워크는 <그림 3>과 같이 키워드 'videos'를 중심으로 다양한 방면에서 기사가 다루어졌음을 확인할 수 있다. 특히 국내 언론보도의 결과와는 달리, 딥페이크 기술의 악용에 대한 플랫폼 기업의 대응(facebook, markzuckerberg, twitter, ban 등)에 관한 내용이 다루어졌으며, 기술적인 주제(AI, voice, technology 등)를 바탕으로 기사가 보도되기도 하였다. 그리고 중심 키워드 'videos'를 중심으로, 딥페이크 기술이 활용된 결과물들에 대한 유형(nancypelosi, tomcruise 등) 및 특성(doctored, clips, socialmedia, realistic, danger 등)이 나열되었고, 키워드 'fake'와 연결되어 가짜뉴스(fake, news, threat 등) 및 음란물(porn, revenge, law, image 등)에 관련된 기사가 다수 보도되었음을 살펴볼 수 있다. 나아가 상단에 위치한 별도의 컴포넌트는 조작된 정보의 위험성을 알리기 위해 기획된 내용으로, 기존의 기사들과 달리 기획성을 지니고 있었음을 감안하면 분석 결과의 추출은 잘 이루어진 것으로 확인된다.

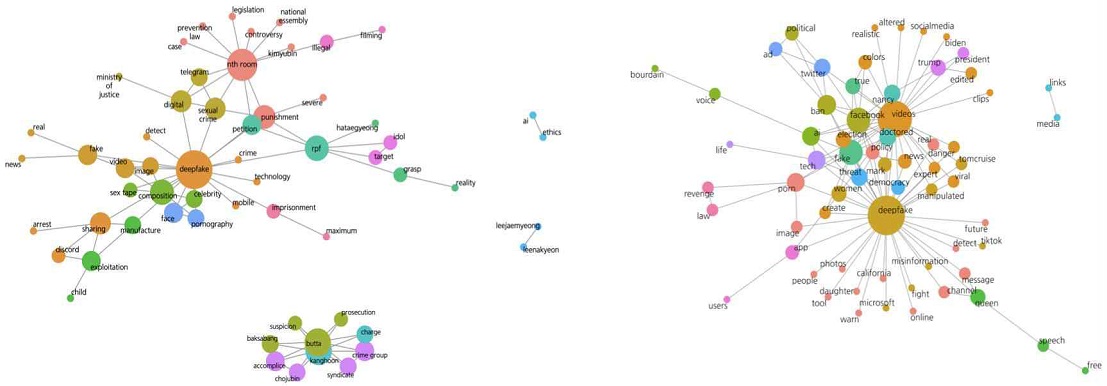

이를 바탕으로 국내외 키워드 네트워크 분석 결과를 비교하였을 때, 국내 언론은 국내에서 발생한 특정 사건을 토대로 의제를 형성하여 사건에 대한 단편적인 내용을 다룬 반면, 국외 언론은 키워드 'videos'를 중심으로 다양한 의제를 확장하여 기사를 보도하고 보다 심층적인 논의를 이루고 있음이 확인되는 바이다. 이러한 양상은 검색 키워드 "딥페이크"와 "deepfake"가 포함된 키워드 네트워크 <그림 4>를 통해 더욱 뚜렷이 나타나게 된다. 검색 키워드 "딥페이크"가 포함된 국내 키워드 네트워크(좌)에 형성된 군집을 살펴보면 제시된 대부분의 키워드가 딥페이크나 N번방을 중심으로 연결된 반면, "deepfake"가 포함된 국외 키워드 네트워크(우)에 제시된 키워드는 “deepfake”와 “videos”를 중심으로, 페이스북, 가짜 정치 등 딥페이크 기술 및 활용에 대한 키워드들이 나타나고 있다.

Ⅴ. 결론 및 토의

본 연구는 딥페이크와 관련된 국내외 언론보도 기사의 제목을 수집하여 국내와 국외에서 딥페이크 기술을 보도하는 데 있어 어떠한 차이가 존재하는지를 살펴보고자 하였다. 이에, 수집된 데이터(국내-1,625건, 국외-2,107건)를 바탕으로 빈도분석, 토픽모델링, 키워드 네트워크 분석 등 다양한 텍스트 마이닝 분석을 실시하였다. 결론적으로 분석 결과를 통해 국내와 국외 언론이 상이한 키워드와 토픽을 보여주고 있음을 확인하였다.

우선, 국내외 언론보도가 특정 사건을 기점으로 기사량이 급증하는 유사한 양상을 나타내기는 하였으나, 국내 언론보도의 경우 성범죄 사건을 중심으로 딥페이크 기술을 보도한 반면, 국외 언론보도는 좀 더 다양한 방면에서 딥페이크 기술을 다루었다는 데에 차이점이 존재하였다. 국내 언론의 경우, 딥페이크 기술을 이용한 범죄 사건에 집중된 기사가 많아 추출된 7개의 토픽 중 한 가지 토픽을 제외하고는 모든 토픽들이 N번방이나 성범죄 등과 관련이 있었다. 키워드 간 네트워크에서도 검색어인 ‘딥페이크’ 와 함께 ‘N번방’이 높은 중심성을 보여주고 있었다. 이것은 국내에서 딥페이크 기술이 범죄 사건과 높은 관련성을 가진 기술로 보도되고 있음을 보여준다.

국외 언론은 정치인과 연예인의 가짜 동영상 유포 등과 관련한 사건을 보여주는 '성범죄', '가짜뉴스' 등의 키워드와 함께, '기술력', '플랫폼‘, '대응 방법' 등 좀 더 다양한 시각을 볼 수 있는 키워드들이 나타났다. 특히 딥페이크 기술과 관련된 핵심 단어인 ’video’가 네트워크 분석에서 높은 중심성을 보이며, 가짜뉴스, 기술의 정교함, 사회적 우려, 정부의 경고, 소셜 미디어 대응처럼 다양한 키워드들과 연관되어 있었다. 국내외 언론이 동일하게 딥페이크 기술이 활용된 사건을 다루었으나 국내의 언론이 성범죄 사건 및 범죄자의 처벌에 대한 내용을 중심으로 사건의 흐름에 따라 보도한 데 비해, 국외 언론은 딥페이크 기술의 기술력과 주요 기업의 대응 방안 등을 함께 다루며 딥페이크 기술 자체를 기술적 측면에서 바라보며 보도하였다고 볼 수 있다.

딥페이크 기술이 가짜 동영상, 성 착취 동영상 등 악용된 사례가 많기 때문에 신문 기사에서 이러한 사례들이 보도되고 우려를 표하는 것은 당연한 일이다. 하지만 국내 신문 기사들에서 나타나는 주요 키워드와 토픽들을 살펴보면 딥페이크가 n번방이나 성범죄를 대표하는 단어처럼 자주 언급되며 범죄 용어들과 높은 연관성을 이루고 있다. 국외 언론에서 나타나는 키워드의 면면과 비교해보면 국내 언론이 범죄와 관련된 처벌, 피해자 등의 논의에서 벗어나 딥페이크 기술이 범죄에 악용되는 원인이나 문제점, 사회적 시사점이나 해결 방안 등 좀 더 포괄적인 시각이 나타나지 못한 점에 대해 아쉬움이 있다.

국내 언론뿐만 아니라 국외 언론에서도 딥페이크와 관련된 여러 가지 불법적 행위나 범죄들이 신문 기사를 통하여 많이 보도되고 있는 것은 당연한 과정이지만, 이에 대한 의미 있는 논의는 필요하다고 생각된다. 언론의 보도가 사회적 담론을 형성하는 데 중요한 역할을 하는 만큼[45], 사회적으로 영향이 있는 딥페이크 기술에 대한 객관적인 정보전달이나, 악용에 대한 우려 및 이를 줄여나가기 위한 논의가 필요하다고 본다. 동시에 딥페이크 기술이 범죄에 활용되었다고 해서 지나치게 특정 기술에 대한 부정적인 프레임을 형성하는 것 또한 지양해야 할 것이다. 기술에 대한 사회적 편견(bias)보다는 문제해결을 위한 긍정적 논의가 더 필요하다고 생각된다[46-47]. 언론은 딥페이크 기술과 같은 지능정보기술을 보도하는 데 있어서 보다 다양한 측면과 사례를 포함한 기사를 생성하여 사회적으로 다양한 인식과 시각을 구축하기 위하여 단순 사건을 조명하는 형태의 기사에서 나아가 보다 심층적인 논의를 구성할 필요가 있을 것이다[49].

본 연구가 국내외의 언론보도 기사 제목을 바탕으로 분석 결과를 도출하였기에 기사 본문에 대한 분석을 하지 못하였다는 것에 연구의 한계점이 존재하지만, 국내외 언론의 기사를 비교 분석함으로써 그 차이를 살펴보았다는 점에서 의미가 있다. 또한 국내외 언론 기사의 키워드 및 토픽별 차이를 통해 동일한 기술에 대한 사회적 논의와 대응 방식이 다르다는 것을 알 수 있었다.

딥페이크 기술이 발전하는 초기 과정에서 나타난 악용 사례들로 인하여 사회적으로 딥페이크 기술에 대한 부정적 키워드들이 많이 등장하고 있지만, 향후 활용양상과 논의 방안에 따라 이러한 시각들이 달라질 수 있을 것이라 생각된다. 또한 다른 환경에서 다른 양상으로 발전할 수도 있을 것이다. 사회적으로 딥페이크 기술이 활용되는 양상과 그에 대한 논의를 지속적으로 관찰하여 그 과정을 기록하는 후속 연구로 발전시킨다면 기술이 사회와 상호작용하며 발전하는 과정에 대한 좀 더 의미 있는 결과를 찾아낼 수 있을 것이라 기대한다.

Acknowledgments

본 연구는 대한민국 교육부와 한국연구재단의 지원을 받아 수행된 연구입니다 (NRF-2019S1A3A2099973).

References

-

A. A. Maksutov, V.O. Morozov, A.A. Lavrenov, and A. S. Smirnov, “Methods of deepfake detection based on machine learning,” In 2020 IEEE conference of russian young researchers in electrical and electronic engineering (EIConRus) pp. 408-411, March 2020.

[https://doi.org/10.1109/EIConRus49466.2020.9039057]

-

M. H. Maras, & Alexandrou, A. “Determining authenticity of video evidence in the age of artificial intelligence and in the wake of Deepfake videos”, The International Journal of Evidence & Proof, Vol. 3, No. 3, pp. 255-262, October 2019.

[https://doi.org/10.1177/1365712718807226]

- S. W. Kang. The singer who was restored to AI. How did it become realistic? [Internet]. Available: https://www.sedaily.com/NewsVIew/22HDOPL0Z9, .

- H. G. Shin. Beckham speaks nine languages? Deepfake changes the shape of your mouth [Internet]. Available: https://www.mk.co.kr/news/it/view/2020/12/1339733/, .

- S. H. Lee, Big data analysis for Deepfake: The war against fakes, Software Policy & Research Institue, Seongnam: Gyeonggi, SPRI Report IS-090, 2020.

- T. D. Fikse, Imaging Deceptive Deepfakes An ethnographic exploration of fake videos, Masters thesis, University of Oslo, Oslo, Norway, October 2018.

- J. Wakefield. Deepfake presidents used in Russia-Ukraine war [Internet]. Available: bbc.com/news/technology-60780142

-

T. J. Pinch, & W. E. Bijker, “The social construction of facts and artefacts: Or how the sociology of science and the sociology of technology might benefit each other”, Social studies of science, Vol. 14, No. 3, pp. 399-441, August 1984.

[https://doi.org/10.1177/030631284014003004]

- D. G. Douglas, The Social Construction of Technological Systems, anniversary edition: New Directions in the Sociology and History of Technology. MIT press, 2012.

- J. Park & Y. H. Cho, “Technology Trends Related to Deepfake Video Detection”, Korea Software Congress 2019, Pyeongchang, pp.724-726, December 2019.

-

L. Guarnera, O. Giudice & S. Battiato, “Deepfake detection by analyzing convolutional trace”, Conference on Computer Vision and Pattern Recognition Workshops, pp. 666-667, 2020.

[https://doi.org/10.1109/CVPRW50498.2020.00341]

-

T. Karras, S. Laine, M. Aittala, J. Hellsten,, J. Lehtinen &, T. Aila, “Analyzing and improving the image quality of stylegan”, Conference on Computer Vision and Pattern Recognition, pp. 8110-8119, 2020

[https://doi.org/10.1109/CVPR42600.2020.00813]

- H. N. Lee. The world must actively discuss AI ethics and deepfake technology … [Internet]. Available: http://www.aitimes.com/news/articleView.html?idxno=140468

- M. J. Kim. AI Music Project, once again, "Using the voice of the late Turtle Man, let's see the entire turtle performance [Internet]. Available: https://www.gukjenews.com/news/articleView.html?idxno=2123459

- H. J. Lee. Face editing skills to revive a dead singer...Change the Drama Production Environment with AI [Internet]. Available: https://magazine.hankyung.com/business/article/202103049965b

- CJ OLIVENETWORKS AI lab. AI and contents [STEP 1] AI BM, planning [Internet]. Available: https://youtu.be/_2vLNMsPfyw

- S. Li. How Hollywood Became Obsessed With De-aging Its Stars [Internet]. Available: https://www.theatlantic.com/entertainment/archive/2019/12/irishman-gemini-man-and-rise-de-aging/603130/

- K. Howard. Avengers: Endgame Deepfake Casts Nicolas Cage as Captain America. <DEN OF GEEK> [Internet]. Available: https://www.denofgeek.com/movies/avengers-endgame-deepfake-nicolas-cage-captain-america/

- S. Kim & J. Heo, “Fashion as an Identifier of Digital Human Persona : Focusing on the Advertisement Use”, KSDS Conference Proceeding, Seoul, pp. 108-109, May 2021.

- K. Hao. A new way to use the AI behind deepfakes could improve cancer diagnosis [Internet]. Available: https://www.technologyreview.com/2019/07/05/134286/ai-deepfakes-gans-medical-cancer-diagnosis/

-

S. Choi, S. U. Oh & S. E. Lee, “Deepfake Image Manipulation: Crisis of Factuality and Creation of Punctum by Deep Automation”, Media, Gender & Culture, Vol. 34, No. 3, pp. 339-380, September 2019.

[https://doi.org/10.38196/mgc.2019.09.34.3.339]

- M. LEE, "Deepfake as powerized algorithm and public opinion regulated by post-truth", Study on the American Constitution, Vol. 31, No.1, pp. 199-241, April 2020.

- J. Kim, J. An, B. Yang, J. Jung & S. Woo, “Investigation of the latest technological trends in data-based deep-fake detection techniques”, Journal of the Society for Information Protection, Vol. 30, No. 5, pp. 79-92, October 2020.

- J. W. Chae. They said it was a joke... They photoshopped my face into a racy video [Internet]. Available: https://www.chosun.com/national/2021/09/29/4DUWR67IYFG4PF3QO2VL4O7DCA/?utm_source=naver&utm_medium=referral&utm_campaign=naver-news

- L. Y. Huang, K. H. Wen, H. K. Wang, Y. Y. Wang & Y. C. Chiang. Main suspect behind deepfake pornography released on bail [Internet]. Available: https://focustaiwan.tw/society/202110190012

- H. Ajder, G. Patrini, F. Cavalli & L. Cullen, The state of deepfakes: landscape, threats, and impact, DEEPTRACE, 2019.

-

J. Y. Yum & S. H. Jeong, "Predictors of fake news exposure and sharing : personality, new media literacy, and motives", Korean Journal of Journalism & Communication Studies, Vol. 63, No. 1, pp.7-45, February 2019.

[https://doi.org/10.20879/kjjcs.2019.63.1.001]

- J. I. Park, “Development of Deep Fake Technology and New Threats to Journalism - Need to Check Video Facts to Secure Image Fairness”, Press Arbitration Commission, Vol. 156, pp.52-69, 2020.

- S. B. Son, H. H. Jo, H. Y. Kang, B. G. Lee & Y. K. Lee, "A Comparative Study on Deepfake Detection using Gray Channel Analysis", Journal of Korea Multimedia Society, Vol. 24, No. 9, pp. 1224-1241, September 2021.

-

J. Hwang, E. Choe & J. H. Han, "Development and Application of Ethics Education STEAM Projects using DeepFake Apps", Journal of the Korean Association of information Education, Vol. 25, No. 2, pp. 405-412, April 2021.

[https://doi.org/10.14352/jkaie.2021.25.2.405]

- T. S. Hong, "Criminal responsibility of children's pornography producers using deepfake -Through the review of Japanese precedents and discussions-", Journal of Digital Forensics, Vol. 14, No. 2, pp. 139-151, June 2020.

- C. Choi, Y. Jung & J. Kim, “Discourse analysis on deepfake technology using text mining”, The Journal of The Korean Institute of Communication Sciences, Vol. 47, No. 6.

- S. Choi, "Frame and Affective Tone of Hallyu News Reports by the U. S. and China after Psy’s ‘Gangnam Style’", Korean Journal of Journalism & Communication Studies, Vol. 58, No. 2, pp. 505-532, April 2014.

-

E. N. Neumann E. N, “The Spiral of Silence: A Theory of Public Opinion”, Journal of Communication, Vol. 24, pp. 43-51, June 1974.

[https://doi.org/10.1111/j.1460-2466.1974.tb00367.x]

- J. H. Yong, "The Network Analysis of Public Opinion Building in Korea: Shared Editorials among Nine Major Daily Newspapers", Korean Journal of Journalism & Communication Studies, Vol. 41, pp. 108-141, 1997.

-

M. Westerlund, "The emergence of deepfake technology: A review" Technology Innovation Management Review 9, No. 11, November 2019.

[https://doi.org/10.22215/timreview/1282]

- J. W. Rhe, S. M. Yang, K. C. Kim & H. J. Song, "Direct Quotations in Newspaper Headlines in the Coverage of the Local Election on May 31, 2006", Korean Journal of Journalism & Communication Studies, Vol. 51, No. 3, pp. 64-90. June 2007.

- Korea Data Agency, Exploration of overseas DB banks – LEXIS/NEXIS, Database World, Vol. 45, pp. 52-58, 2017.

- S. Park, C. C. Park, J. H. Kim, G. Y. An & I. H. Choi. web database construction model and methodology study [Internet]. Available: https://www.kdata.or.kr/info/info_01_download.html?dbnum=29

- LexisNexis. Lexis Advance [Internet]. Available: http://www.lexisnexis.kr/en-kr/products/lexis-advance.page

- Y. M. Baek, text mining using R, Hanul Academy, 2017.

- I. Y. Nam & H. W. Park, "Network Analysis of Headlines in the Newspaper Articles on the Prospective Presidential Candidates and their PR Strategy in Korea", Korean Party Studies Review, Vol. 6, No. 1, pp. 79-107, February 2007.

- Y. H. Kim. Social Network Analysis (3rd Edition), Pakyongsa, 2011

-

K. Sohn & H. S. Yoon, "A Comparative Analysis on the Research Trends in Law on Artificial Intelligence using Keyword Network and BERT Model", Public Law, Vol. 50, No. 1, pp. 407-444, October 2021.

[https://doi.org/10.38176/PublicLaw.2021.10.50.1.407]

- J. Habermas, & J. Habermas, The Structural Transformation of the Public Sphere: An Inquiry into a Category of Bourgeois Society, MIT press, 1991.

- J. J. An, “Media Fuses AIDS Prejudice and Discrimination”, RedRibbon, Vol. 51, pp. 10-11, 2003.

- G. R. Hwang & S. G. Lee, “Analysis of media reports related to schizophrenia”, Journal of the Korea Academy of Mental Health Social Work, Seoul, pp. 269-297, May 2019.

- H. R. Song & H. M. Cho, "Introduction of Trends in Reporting Science Technology Risk by Korean Media - Focusing on Analysis of Newspaper Coverage of Nanotechnology in Major Daily Newspapers -", Crisisonomy, Vol. 9, No. 11, November 2013.

저자소개

2021년 : 부경대학교 신문방송학과 (학사)

2021년~현 재: 부경대학교 신문방송학과 석사과정

※관심분야 : AI, 미디어, 플랫폼서비스, 디지털콘텐츠 등

2006년 : 한양대학교 사회학과 (석사)

2018년 : Media and Information Studies, Michigan State University (박사)

2021년~현 재: 부경대학교 신문방송학과 연구교수

※관심분야 : 뉴미디어, 데이터사이언스, 개인정보, 프라이버시 등