딥러닝을 이용한 증강현실 기반 음료정보 시각화 및 공유 시스템

Copyright ⓒ 2020 The Digital Contents Society

This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-CommercialLicense(http://creativecommons.org/licenses/by-nc/3.0/) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

초록

본 논문에서는 이미지 인식기술을 이용하여 시중의 음료·주류 상품을 검색하고, 상품의 정보를 증강현실 시스템을 이용해 시각화 하는 시스템을 소개한다. 또한 사용자들이 웹기반 모바일 플랫폼을 이용하여 제품의 맛 정보를 등록 및 공유할 수 있는 시스템의 설계 및 개발 내용을 소개하고 있다. 이미지 인식을 위하여 음료 이미지의 데이터셋 구축 및 확장기술을 통해 학습데이터를 생성하고 CNN(Convolution Neural Network)학습을 진행하였다. 증강현실 시각화를 위해서는 UDT(User Define Target) 마커인식 방법을 사용하여 제품인식 후에 즉각적인 마커의 등록을 통해 증강현실 시스템이 동작하도록 설계하였다. 마지막으로 다중선형회귀 모델로 개발한 제품 추천기술을 적용한 소비자 친화적인 공유시스템을 제안하였다. 제안된 연구는 소비자가 카메라를 통해 제품의 정보를 쉽게 얻을 수 있도록 하고, 더 나아가 정보검색 및 공유시장에 새로운 사업 전략으로서 응용 될 수 있을 것이다.

Abstract

In this paper, we introduce a system that searches for commercial beverages and alcohol products using image recognition technology and visualizes the information of the products using augmented reality system. It also introduces the design and development of a system that allows users to register and share product taste information using a web-based mobile platform. For image recognition, learning data was generated through the data set construction and expansion technology of beverage images and CNN learning was conducted. For augmented reality visualization, the augmented reality system is designed to operate by immediately registering a marker after product recognition using a UDT marker . Lastly, we proposed a consumer-friendly sharing system applying the product recommendation technology developed by the multiple linear regression model. The proposed research is expected to make it easy for consumers to obtain product information through cameras and to be applied as a new business strategy in the information retrieval and sharing market.

Keywords:

Image Recognition, Augmented Realty, Deep Learning, Product Search, Share system키워드:

영상인식, 증강현실, 딥러닝, 상품검색, 정보공유시스템Ⅰ. 서 론

시중의 음료·주류 회사들의 경쟁, 해외 제품들의 수입 등에 의한 음료 품목들의 증가와 스트리밍 서비스를 통한 홍보로 인해 사용자들이 접하는 정보의 양이 매우 빠른 속도로 증가하고 있다. 그러나 사용자들이 받아들일 수 있는 정보의 양은 한계가 있음에도 불구하고 개선을 위한 검색 및 시각화 시스템은 사용자 에게 제공되고 있지 않다.

사용자가 많은 양의 데이터를 스스로 필터링하여 볼 수 있도록 하는 방법 중 하나는 검색이다. 하지만 검색은 사용자가 스스로 수행해야하는 작업이기 때문에 한 가지 이상 검색대상의 사전 정보가 필요로 하다. 또한 확실하게 필터링 할 수 있는 사전 지식이 입력되지 않으면 정확한 검색이 불가능하다.

본 논문은 시중의 음료·주류 소비자들을 위해 상품에 대한 정보를 쉽게 검색하고 공유할 수 있는 시스템을 제안하고자 한다. 검색기능은 기존 방식들과 다르게 이미지 검색을 방식을 사용한다. 이미지 검색방식은 인공신경 망을 기반으로 구축되며, 사용자는 사전 지식 없이 검색이 가능하고, 세부적인 필터링을 통해 정확한 검색결과를 제공 받는다. 추가적으로 증강현실을 통한 정보의 시각화와 추천기술을 탑재하여 사용자 친화적인 시스템을 구축 하였다.

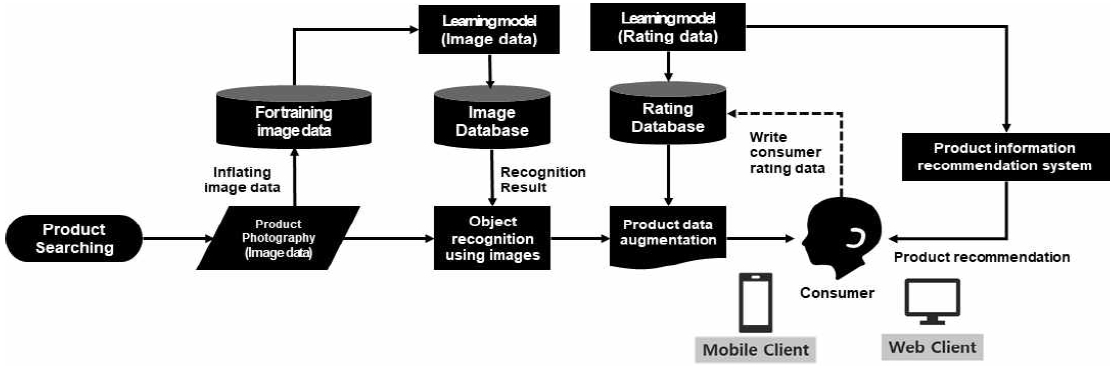

목표로 하는 시스템의 흐름은 정보를 검색에서 끝나는 것이 아닌 소비자가 스스로 데이터를 수집 및 공유하는 흐름을 포함한다. 따라서 직접 상품 정보를 등록하고, 공동으로 편집 및 관리되는 위키피디아 형태의 데이터 수집 및 공유 시스템을 구축한다. 구축된 수집 및 공유시스템은 이미지 학습 데이터 및 추천기술 학습 데이터의 확보 방법으로 써 활용된다. 제안된 시스템은 프로토타입의 성격을 뛰며, 추후에는 음료·주류뿐만 아니라 다양한 품종으로 확대 될 수 있다. 그림 1은 제안된 시스템의 시스템 흐름 및 구조를 보여주고 있다.

Ⅱ. 관련 연구

2-1 상용 검색 및 추천 서비스

구글(Google)의 이미지 검색은 Web 환경을 통해 제공된다. 사용자는 단말의 카메라나 저장된 파일을 통해 이미지 검색을 수행할 수 있다. 이러한 구글의 이미지 검색은 높은 인식률과 방대한 검색 결과를 제공한다는 장점이 있지만, 그 결과가 사물에 대한 일반적인 형태 인식에 그친다는 한계가 있다. 그림 2에서 볼 수 있듯이 음료·주류 상품의 이미지를 검색할 경우 캔(can), 병(bottle)과 같은 검색 결과만을 보여줘, 실제 상품을 특정해내는 데 어려움이 있다.

국내의 검색 포털 서비스인 네이버(Naver)는 ‘네이버 스마트 렌즈’라는 이미지 검색 기능을 제공한다. 스마트 렌즈는 다양한 상품 인식 및 검색에 특화되어 있으며, 높은 정확도로 해당 상품을 찾아낸다. 그러나 그림 3에서 볼 수 있듯이 상품에 대한 정보 제공을 개인 블로그에 의존하여 있어, 객관적이고 통합적인 정보를 제공받기에는 한계가 있다.

왓챠(Watcha)는 국내의 벤처 기업으로, 영화 추천 서비스를 제공한다. 왓챠의 이용자는 최초 회원 가입 시 정해진 숫자 이상의 작품에 대해 1에서 5점 사이의 별점을 매겨야 한다. 장르와 감독, 배우와 같은 데이터 분류 기준으로 영화 데이터를 추출한 후, 비슷한 취향을 가진 사람들을 분석하는 딥러닝 기반의 협업 필터링(collaborative filtering) 알고리즘을 중심으로 하는 복합적인 방법을 적용하여 사용자에게 영화를 추천한다.

스포티파이(Spotify)는 전 세계에서 가장 많은 이용자를 확보하고 있는 음악 스트리밍 서비스이다. 스포티파이는 협업 필터링과 자연어 처리, 오디오 분석 모델을 복합적으로 사용한 음악 추천 기능을 제공한다. 자연어 처리의 경우 인터넷에 존재하는 음악과 아티스트에 대한 기사, 블로그 포스트 등의 메타데이터를 수집한 후, 사용자에게 연관된 키워드를 제공하는 형태이다. 오디오 분석 모델은 딥러닝 기반의 CNN을 통해 구현되었으며, 음악의 빠르기와 스케일, 분위기 등을 학습하여 사용자가 선호하는 음악과 유사한 음악을 추천한다.

2-2 인공지능 및 증강현실

박제강 등은 CNN을 기반으로 하는 차량 검출 실험을 분석 했다. 인식대상은 차량의 전면부로 진행 했으며, 전면 부에 해당하는 학습 샘플은 직접 수집 했다. 실험 결과 학습 샘플이 적을 경우 일정수준 이상의 차량 인식률을 보일 수 있으나 거짓긍정 오류가 발생한다는 것을 확인 하였다. 오류 해결방법 으로는 군집화 알고리즘을 사용 했다[1]. 앞선 논문에서 언급 되었듯이 높은 인식률과 거짓긍정 오류 방지를 위해선 기본적으로 많은 양의 데이터셋이 요구된다. 전 세계적으로 기계 학습 및 딥러닝을 위한 오픈 데이터셋이 구축되고 있지만 모든 물체의 학습 데이터셋이 준비된 것은 아니다. 그러므로 딥러닝을 이용해 새로운 분야에 산업적, 연구적으로 시도를 하기 위해선 초반 데이터셋 구축 구조가 필요하다[2]. 따라서 본 논문은 데이터셋 구축을 공유라는 커뮤니티방식을 차용하여 소비자가 상품을 인식할시 학습데이터를 수집할 수 있는 구조를 설계하여 초기 데이터셋이 상대적으로 적게 필요하며 시간이 지남에 따라 자동적으로 데이터셋의 크기가 커지는 시스템 흐름을 제안했다.

Yim과 Park은 AR과 Web서비스기반으로 하는 피팅 시스템의 사용성을 비교하고 이를 통해 AR기반 피팅 시스템의 장점과 일반 사용자에게 널리 사용되지 못하는 이유에 대해 분석했다. 분석결과 AR은 즉각적인 이미지 투사와 확장된 정보의 제공을 통해 사용자에게 미디어적인 측면에서 강한 자극을 주어 사용자 만족도를 상승시킬 수 있으나 일부에서는 오히려 이러한 자극이 불편함을 준다는 것으로 나타났다. 또한 상품 판매에 AR기술의 적용과 모바일 환경에서의 시도가 드물며 대화식 환경이 갖춰 져야한다고 설명한다[3]. 따라서 본 논문은 모바일 환경에서의 동작을 고려했으며, 사용자가 쉽게 사용할 수 있도록 디자인 및 시스템 구조를 연구하였다.

증강현실 관련 기술로, Hirzer은 “평면 마커를 이용해 증강현실을 구축하고 개선된 특징점 추출 방법에 대해 제안하였다[4]. 평면 마커방식은 마커 자체를 디자인 하는 것이 쉽고 특징점을 추출하는데 다른 마커 방식보다 빠른 성능을 보여준다. 하지만 마커가 2D인 만큼 증강되는 가상객체와 마커인식 범위가 넓지 않아서 가변적인 환경에서 사용하기에 무리가 있다. 따라서 본 논문은 UDT 마커방식을 사용하여 평면 마커의 한계를 해결하고 실시간으로 트래킹이 가능한 증강현실 시스템을 제안한다.

Ⅲ. 연구 내용

3-1 이미지를 이용한 상품 검색

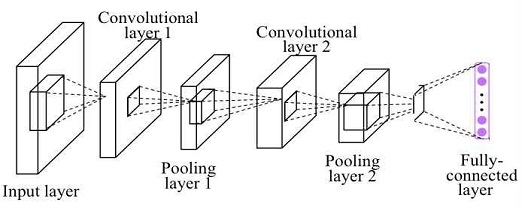

본 논문은 이미지를 이용해 상품을 검색하는 시스템을 CNN을 이용하여 구현하였다. CNN은 대뇌피질의 시각피질을 모델화 한 것으로 합성곱계층과 풀링계층으로 구성되어 있으며 역전파 방법과 GPU발전에 따라 다중 이미지 데이터베이스에서 좋은 성능을 보이고 있다[5, 6]. 그림 4는 CNN신경망의 계층 구조를 보여준다.

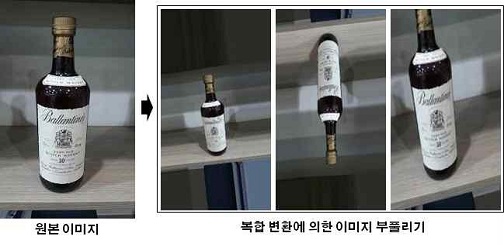

신경망구현 이후에는 데이터셋의 구축이 중요한 과제이다. 데이터셋이 제대로 구축이 되지 못한다면 거짓긍정 오류 혹은 낮은 정확도를 보이기 때문이다. 본 논문은 음료·주류 상품에 관한 상품검색을 시도한다. 따라서 시중에 판매되고 있는 음료·주류상품의 다양한 환경에서 생성된 이미지가 필요로 한다. 하지만 시중에 있는 상품처럼 세부적으로 분류되는 객체의 이미지를 구하는 것은 불가능하다. 또한 일반적인 데이터 학습과 인식 연구를 진행 할 때 사용되는 오픈 데이터셋을 사용하는 것도 세부적으로 상품을 구분한 이미지를 가지고 있지 않기 때문에 불가능 하다. 따라서 본 논문에서는 최소한의 데이터를 웹 크롤링(Web crawling)을 이용해 확보하고 부족한 이미지 데이터를 케라스의 데이터 부풀리기 방법을 통해 데이터셋을 확장하여 학습에 활용하였다. 케라스의 이미지 부풀리기 함수는 하나의 이미지를 회전, 이동, 비틀기, 확대 등의 방법으로 수정하여 여러 다른 형상을 가진 이미지로 복사하는 기능을 수행 한다. 그림 5는 케라스를 활용하여 확장된 데이터셋의 예시를 보여주고 있다.

웹에서 클롤링한 이미지만을 사용한 결과와 부풀리기된 이미지들을 활용하여 학습한 결과의 차이는 명확했으며, 많은 데이터셋을 통해 학습하고 인식한 결과가 월등히 좋아짐을 실험을 통해 확인할 수 있었다.

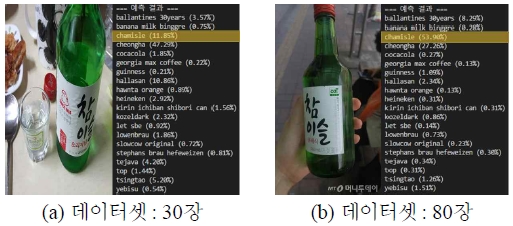

그림 6은 데이터 부풀리기를 적용한 전·후의 인식률 비교의 예시를 보여준다.

그림 6에서 사용한 참이슬 상품의 초기 학습데이터는 30장이며, 데이터 부풀리기를 통해 80장으로 확장하여 학습을 진행하였다. 전자의 경우 인식률이 11.85%이며 데이터 부풀리기 적용 후에는 53.09%로 인식률이 좋아졌음을 볼 수 있다. 비록 적은 데이터를 통한 학습이지만 데이터 부풀리기가 인식결과를 향상시켜주는 한 가지 방법임을 확인할 수 있다.

3-2 증강현실을 이용한 데이터 시각화

증강현실은 가상세계와 현실세계가 같은 공간에 존재하는 것처럼 겹쳐 보여주는 기술이다[7]. 따라서 현실세계를 확장, 변형 등을 하거나, 객체간의 연결성을 보여주는 분야에 큰 효과를 보인다. 특히 이러한 효과는 데이터를 시각화하는 것에 최적화 되어있다. 증강현실이 데이터를 시각화 하는 기존의 방식보다 긍정적인 효과를 보이는 이유는 시각화 공간의 차원에 차이 때문이다. 시각화 공간은 기존의 방식에서 2차원을 기반으로 하며 증강현실 방식에서는 3차원을 기반으로 하고 있다. 3차원은 기본적으로 2차원 보다 많은 공간을 활용할 수 있다. 따라서 많은 양의 데이터를 한 번에 표현 할 수 있고 시각의 유연성을 제공한다[8, 9, 10, 11].

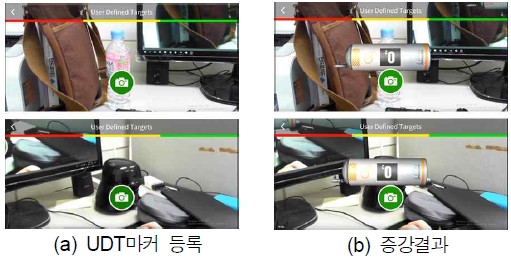

본 논문은 증강현실을 개발엔진(Unity)과 Vuforia SDK를 사용하여 구축하였으며, 마커인식 방법은 UDT(User Define Target)을 사용하였다. UDT방식은 이미지 마커 방식을 기반으로 하고 있으며, 기존 마커, 마커리스 방식들과 달리 사전에 마커를 등록하지 않고 실시간으로 마커를 생성하는 방식이다[12, 13, 14]. 이미지 기반의 마커를 생성은 점, 선 ,곡선, 구 등의 윤곽선 또는 색의 대비를 통해 추출된 특징점을 바탕으로 한다. 이후 특징점을 이용하여 위치 및 이동 정보를 2차원 또는 3차원 상에서 하느냐에 따라 마커기반에서 마커리스기반으로 확장 될 수 있다[15, 16].

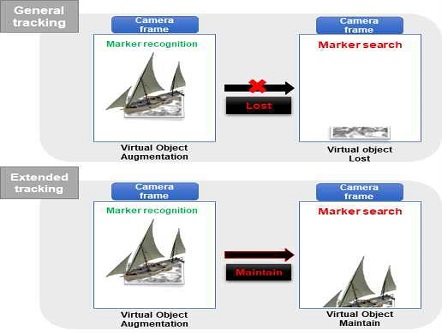

UDT방식은 마커의 실시간 생성과정의 추가이외에는 기존 방식들과의 차이가 없기 때문에 마커를 인식하는 과정에 있어 방해를 받는 다거나 끊김 현상이 여전히 존재한다. 따라서 본 논문에서는 확장 추적 방법을 사용하여 인식 중 연결된 시각적 표현이 가능하도록 했다. 그림 7은 확장 추적 방법을 보여준다. 그림 8은 실제 Unity3D 엔진에서 Vuforia SDK를 이용한 UDT마커 방식의 증강사례를 보여주고 있다.

그림 8은에서 보이듯이 사용자가 증강하길 원하는 대상을 화면 가운데에 위치하고 마커를 설정하는 사용자 입력을 받게 되면 마커로 사용하길 원하는 객체를 중심으로 가상물체가 3차원으로 증강된 것을 확인할 수 있다.

3-3 상품정보 추천시스템

최근 영화, 음악, 쇼핑 등의 다양한 분야에서 추천서비스가 사용되어지고 있다. 추천서비스의 사용이유는 소비자, 공급자 모두에게 이득을 주는 기술이기 때문이다. 소비자는 서비스를 이용할 때 대부분의 시간을 “선택”을 하는 것에 보낸다. 하지만 추천서비스를 이용하면 이러한 시간을 단축할 수 있으며, 남는 시간에 자신의 의견을 공유함으로써 커뮤니티를 생성하고 새로운 정보를 수집할 수 있다. 공급자에 경우 소비자의 추가적인 소비를 유도할 수 있으며 자신이 공급하는 서비스가 커뮤니케이션 공간이 됨으로써 추가적인 소비자의 유입을 유도할 수 있다[17].

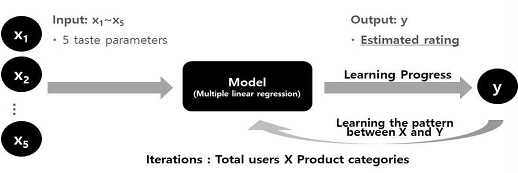

본 논문은 다중 선형회귀분석모델을 이용하여 추천시스템을 개발했다. 다중 선형회귀분석모델은 여러 개의 독립변수(x)들을 가지고 종속변수(y)를 예측하기 위한 회귀모델이다. 다중 선형회귀분석모델을 이용해 추천시스템을 개발한 이유는 추천시스템을 개발하기 위해서는 영향도를 파악하는 것이 중요한데 다중 선형회귀분석모델은 독립변수가 종속변수에 영향을 미치는지에 대한 파악과 얼마나 영향을 미치는지 알려주는 것에 특화 되어있기 때문이다. 따라서 추천시스템 개발에 적절하다고 파악되었다. 그림 9는 추천시스템 다중 선형회귀 모델을 보여준다.

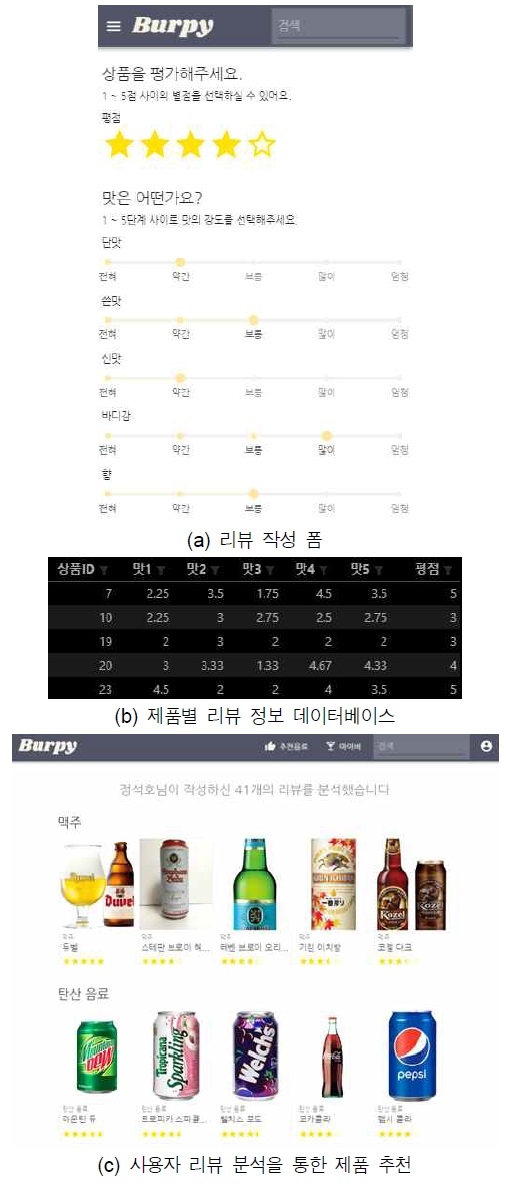

추천시스템에 필요한 데이터는 소비자에게 리뷰를 통해 5개의 맛 파라미터를 1~5의 수치 값으로 입력받는다. 아직 소비자가 리뷰하지 않은 상품들에 대해서는 예상평점을 매겨 높은 평점을 받은 상품을 추천하는 구조를 사용한다. 다섯 개의 맛 파라미터는 표 1과 같이 음료의 종류에 따라 구분하였다.

Ⅳ. 실험 결과

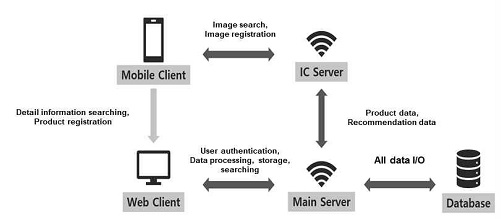

본 논문의 이미지 인식을 이용한 증강현실 기반 음료 정보 검색 및 공유 시스템은 크로스 플랫폼 환경에서 동작할 수 있도록 개발 되었다. 또한 인식 및 증강기술은 Mobile 클라이언트에 탑재하여 테스트하였으며, 공유 및 추천기술은 Web클라이언트에 탑재되었다. 그림 10은 전체적인 시스템간의 구조를 보여준다. 또한 시스템은 표 2에 나와 있는 개발 엔진 및 라이브러리를 이용하여 개발 되었다.

4-1 이미지를 이용한 상품 인식 시스템

본 논문은 총 50개의 상품에 각각 100개의 이미지 데이터셋을 준비 하였으며, 총 1,000회의 학습을 진행 하였다. 그림 11은 음료상품인식 시스템 실험 결과의 예시화면을 보여주고 있다.

그림 11에서 보이는 것과 같이 총 4개의 상품을 가지고 인식을 진행했을 때 4번 모두 올바른 검색결과가 나온 것을 확인 할 수 있다.

4-2. 증강현실을 이용한 데이터 시각화 시스템

본 문단의 실험에서는 한 개의 상품을 인식하고 결과에 따른 데이터를 시각화한다. 증강현실을 이용해 시각화하는 도중 상품을 회전하거나 이동시켜 마커의 등록, 트래킹이 제대로 동작하는지 확인 하였다. 그림 12는 증강현실을 통해 데이터를 시각화하는 실험의 결과를 보여준다.

그림 12에서 보이듯이 마커등록이 인식상품에 성공적으로 이루어져 증강되는 데이터가 상품 옆에 올바르게 위치되어있는 것을 그림 12-(b)에서 확인 할 수 있다. 또한 트래킹도 제대로 작동되어 상품을 이동하거나 회전해도 증강이 실패되는 현상이 발생하지 않는 것을 그림 12(c), (d)에서 확인가능하다.

Ⅴ. 결론

본 논문은 기존에 주류 · 음료 제품을 찾을 때 발생하는 불편을 개선하기 위해, 이미지 인식 기반의 검색 기능과 정보 공유 기능을 제공하는 모바일/웹 서비스를 제안하고 있다. 주요 목적은 기존 키워드 기반 검색의 불편을 해소하고, 주류 · 음료에 특화된 정보 공유 플랫폼을 구축하는 데에 있다. 특히 이미지 인식 기능과 상품 추천 기능의 구현에 딥러닝을 적극 활용하였으며, 이를 통해 높은 성능의 인식, 추천 결과를 낼 수 있도록 하였다. 이미지 인식 기능의 경우 지속적으로 새롭게 출시되는 상품들에 대응하고, 기존에 등록된 상품에 대해서도 지속적인 이미지 인식률 개선이 이루어질 수 있도록 하는 이미지 등록 기능을 세심하게 설계된 UX와 함께 제공한다.

웹 환경에서는 사용자가 상품에 대한 정보를 직접 등록 및 수정하거나, 평가를 등록할 수 있는 서비스를 제공하며, 능동적인 참여를 유도하기 위해 사용자 보상 시스템과 평가 기반의 개인화된 추천 기능을 제공하도록 개발되었다.

향후 기능적 보완과 상업화 방안이 마련되면 충분히 운영 가능한 서비스가 될 수 있을 것으로 기대되며, 추천시스템 검증을 통해 현 시스템이 실제 소비자들에게 서비스 되었을 때 어느 정도 부합하는지 확인하고 지속적으로 알고리즘을 개선하는 연구를 진행 하고자 한다.

Acknowledgments

이 논문은 2019년도 정부(교육과학기술부)의 재원으로 한국연구재단의 지원을 받아 수행된 기초연구사업임(No. NRF-2019R1F1A1058715)

참고문헌

-

Y. K. Park, J. K. Park, H. I. On, and D. J. Kang, “Convolutional neural network-based system for vehicle front-side detection,” Journal of Institute of Control, Robotics and Systems, Vol. 21, Issue. 11, pp. 1008-1016, 2015.

[https://doi.org/10.5302/J.ICROS.2015.15.0163]

-

B. Collins, J. Deng, K. Li, and L. Fei-Fei, "Towards scalable dataset construction: An active learning approach," European conference on computer vision. Springer, Berlin, Heidelberg, pp. 86-98, 2008.

[https://doi.org/10.1007/978-3-540-88682-2_8]

-

M. Y. C. Yim, and S. Y. Park, "“I am not satisfied with my body, so I like augmented reality (AR)”: Consumer responses to AR-based product presentations," Journal of Business Research, Vol. 100, pp. 581-589, July 2019.

[https://doi.org/10.1016/j.jbusres.2018.10.041]

- M. Hirzer, "Marker detection for augmented reality applications," Seminar/Project Image Analysis Graz, pp. 1-2, October 2008.

-

Y. Jia, E. Shelhamer, J. Donahue, S. Karayev, J. Long, R. Girshick, S. Guadarrama, and T. Darrell, "Caffe: Convolutional architecture for fast feature embedding," Proceedings of the 22nd ACM international conference on Multimedia. ACM, pp. 675-678, November 2014.

[https://doi.org/10.1145/2647868.2654889]

-

Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, and L. D. Jackel, "Backpropagation applied to handwritten zip code recognition," Neural computation, Vol. 1, Issue. 4, pp. 541-551, 1989.

[https://doi.org/10.1162/neco.1989.1.4.541]

-

R. Azuma, Y. Baillot, R. Behringer, S. Feiner, S. Julier, and B. MacIntyre, "Recent advances in augmented reality," IEEE computer graphics and applications, Vol. 21, Issue. 6, pp. 34-47, 2001.

[https://doi.org/10.1109/38.963459]

- G. W. Roberts, A. Evans, A. Dodson, B. Denby, S. Cooper, and R. Hollands, "The use of augmented reality, GPS and INS for subsurface data visualization," FIG XXII International Congress, pp. 1-12, 2002.

-

E. Olshannikova, A. Ometov, Y. Koucheryavy, and T. Olsson, "Visualizing Big Data with augmented and virtual reality: challenges and research agenda," Journal of Big Data, Vol. 2, No. 22, pp.1-27, 2015.

[https://doi.org/10.1186/s40537-015-0031-2]

-

J. Hong, M. R. Yu, and B. Choi, "An Analysis of Mobile Augmented Reality App Reviews Using Topic Modeling," The Journal of Digital Contents Society, Vol. 20, No. 7, pp. 1417-1427, Jul 2019.

[https://doi.org/10.9728/dcs.2019.20.7.1417]

-

S. Lee, "Efficient Specific Object Recognition for Standalone Mobile Augmented Reality", The Journal of Digital Contents Society, Vol. 20, No. 11, pp. 2141-2145, Nov 2019.

[https://doi.org/10.9728/dcs.2019.20.11.2141]

-

R. Gusman, and M. E. Apriyani, "Analisis Pemanfaatan Metode Markerless User Defined Target Pada Augmented Reality Sholat Shubuh," Jurnal Infotel, Vol. 8, No. 1, pp. 64-70, 2016.

[https://doi.org/10.20895/infotel.v8i1.53]

-

N. Adam, D. Purnamasari, and A. Ibrahim, "Implementation of Object Tracking Augmented Reality Markerless using FAST Corner Detection on User Defined-Extended Target Tracking in Multivarious Intensities," Journal of Physics: Conference Series, IOP Publishing, Vol. 1201, No. 1, pp. 012041, 2019.

[https://doi.org/10.1088/1742-6596/1201/1/012041]

- Vuforia. User Defined Targets Library[Internet]. Available: https://library.vuforia.com/articles/Training/User-Defined-Targets-Guide

- A. I. Comport, É. Marchand, and F. Chaumette, "A real-time tracker for markerless augmented reality," Proceedings of the 2nd IEEE/ACM International Symposium on Mixed and Augmented Reality. IEEE Computer Society, pp. 36, 2003.

- J. H. Min, M. K. Islam, A. K. Paul, and J. H. Baek, "Realtime Markerless 3D Object Tracking for Augmented Reality," The Journal of Advanced Navigation Technology, Vol. 14, Issue. 2, pp. 272-277, 2010.

-

P. A. Dabholkar, and X. Sheng, "Consumer participation in using online recommendation agents: effects on satisfaction, trust, and purchase intentions," The Service Industries Journal, Vol. 32, Issue. 9, pp. 1433-1449, 2012.

[https://doi.org/10.1080/02642069.2011.624596]

저자소개

2019년 : 성결대학교 멀티미디어공학부 (학사)

2019년 ~ 현재 : 중앙대학교 컴퓨터공학부 (석사과정-컴퓨터그래픽스)

※관심분야:컴퓨터그래픽스(Computer Graphics), 비사실적 렌더링(Non-Photorealistic Rendering), 가상/증강현실(Virtual Reality/Augmented Realtiy), 게임 기술(Game Technology)

2018년 : 성결대학교 멀티미디어공학부 (학사)

2018년 ~ 현재 : 중앙대학교 컴퓨터공학부 (석사과정-컴퓨터그래픽스)

※관심분야:컴퓨터그래픽스(Computer Graphics), 비사실적 렌더링(Non-Photorealistic Rendering)

2006년 : 중앙대학교 컴퓨터공학과 (학사)

2013년 : 중앙대학교 컴퓨터공학과 (공학박사-컴퓨터그래픽스)

2015년 ~ 2017년 : 영국 Bournemouth University Visiting Researcher

2017년 ~ 2018년 : 영국 Bournemouth University Marie Curie Fellow

2018년 ~ 현재 : 서울과학기술대학교 컴퓨터공학과 조교수

※관심분야:컴퓨터그래픽스(Computer Graphics), 비사실적 렌더링(Non-Photorealistic Rendering), 영상처리(Image Processing), 감성컴퓨팅(Affective Computing)

1998년 : 중앙대학교 컴퓨터공학과 (학사)

2000년 : 중앙대학교 첨단영상대학원 영상공학과 (공학석사-컴퓨터그래픽스)

2010년 : 중앙대학교 첨단영상대학원 영상공학과 (공학박사-컴퓨터그래픽스및가상환경)

2002년 ~ 2005년 : (주)지노시스템, 다차원공간기술 연구소, 선임연구원

2010년 ~ 2011년 : 중앙대학교, 박사후연구원

2011년 ~ 2013년 : 프랑스 리옹 1대학, LIRIS 연구소, Post-Doc

2013년 ~ 2016년 : 한국전자통신연구원, 선임연구원

2016년 ~ 2019년 : 성결대학교 미디어소프트웨어학부 조교수

2019년 ~ 현재 : 중앙대학교 예술공학대학 컴퓨터예술학부 부교수

※관심분야:컴퓨터그래픽스(Computer Graphics), 비사실적 렌더링(Non-Photorealistic Rendering), 가상/증강현실(Virtual Reality/Augmented Realtiy), 게임 기술(Game Technology)